Die Fortran Programmiersprache ist eine Ikone in der Welt der Computermodellierung und numerischen Simulation. Seit ihrer Entstehung in den 1950er Jahren hat sie Generationen von Wissenschaftlern und Ingenieuren befähigt, komplexe Probleme zu lösen, von der Wettervorhersage bis zur Finanzmodellierung. Trotz der rasanten Entwicklung neuerer Sprachen behält Fortran seine Nische als unverzichtbares Werkzeug, insbesondere im Hochleistungsrechnen (HPC).

Dieser Blogbeitrag taucht tief in die Welt von Fortran ein. Wir werden seine faszinierende Geschichte von den Anfängen bei IBM bis zu den modernen Standards beleuchten, seine Stärken und Schwächen im Kontext aktueller Technologieanforderungen analysieren und ihn mit anderen prominenten Sprachen im Bereich der Data Science vergleichen. Ziel ist es, Entwicklern, Studenten und Technologiebegeisterten ein umfassendes Verständnis für diese leistungsstarke, aber oft missverstandene Sprache zu vermitteln und ihre anhaltende Relevanz für anspruchsvolle wissenschaftliche Programmierung aufzuzeigen.

Fortran: Eine Einführung in die Hochleistungswelt

Fortran, abgeleitet von „FORmula TRANslation“, ist eine der ältesten und am längsten genutzten Programmiersprachen. Sie wurde speziell für die Bewältigung von Problemen in der Wissenschaft und im Ingenieurwesen entwickelt, bei denen die Rechenleistung und die Präzision numerischer Operationen von entscheidender Bedeutung sind. Ursprünglich konzipiert, um die manuelle Codierung von Maschinenbefehlen zu vereinfachen, etablierte sich Fortran schnell als Standard für numerisch intensive Programme.

Der Hauptvorteil von Fortran liegt in seiner herausragenden Effizienz, insbesondere bei arithmetischen Operationen und der Verarbeitung großer Arrays. Programme, die in Fortran geschrieben sind, können vom Compiler extrem stark optimiert werden, um auf Hochleistungsrechnern (HPC-Clustern und Supercomputern) maximale Geschwindigkeit zu erreichen. Dies ist ein entscheidender Faktor für Anwendungen wie komplexe Wettervorhersagemodelle, atomare Simulationen oder Strukturmechanikberechnungen, bei denen Tausende oder Millionen von Rechenoperationen pro Sekunde erforderlich sind. Im Vergleich zu anderen leistungsfähigen Sprachen wie C++ bietet Fortran zudem den Vorteil, dass Entwickler sich oft weniger um Feinheiten der Speicherzuweisung kümmern müssen, was die Entwicklung und Wartung von Code erleichtern kann. Fortran ist eine sogenannte „ahead-of-time“-kompilierte Sprache, was bedeutet, dass der gesamte Quellcode vor der Ausführung in Maschinencode übersetzt wird, im Gegensatz zu interpretierten Sprachen wie Python oder R, die Anweisungen zur Laufzeit übersetzen, was typischerweise zu einer geringeren Rechengeschwindigkeit führt.

Die Geschichte von Fortran: Von IBM zur modernen Spezifikation

Die Entstehung von Fortran: Eine historische Perspektive

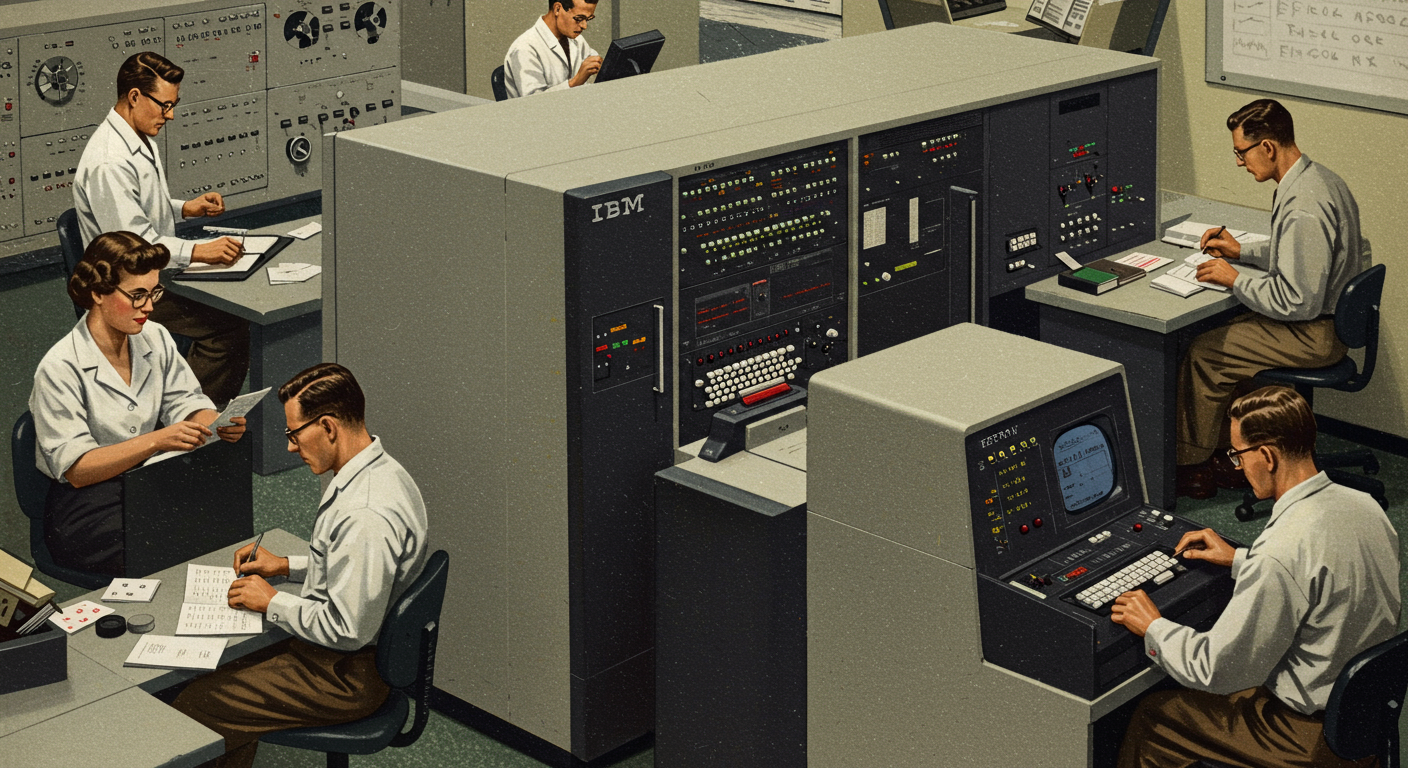

Die Wurzeln von Fortran reichen zurück bis in die Mitte der 1950er Jahre. Während Konrad Zuse mit Plankalkül bereits die erste höhere Programmiersprache konzeptionierte, war es John Backus und sein Team bei IBM, die die erste tatsächlich implementierte und weit verbreitete höhere Programmiersprache schufen. John Backus, ein Mathematiker, der bei IBM als Programmierer tätig war, sah die immense Herausforderung und den Zeitaufwand, die damals für das Programmieren von Maschinen wie dem „Selective Sequence Electronic Calculator“ (SSEC) erforderlich waren. Der SSEC war ein elektromechanischer Computer mit Tausenden von Relais und Vakuumröhren, dessen Programmierung eine äußerst mühsame und fehleranfällige Aufgabe darstellte.

Ende 1953 präsentierte Backus ein wegweisendes Konzept für eine effizientere Programmiersprache für den IBM 701 Mainframe-Computer. Seine Vision war es, den Prozess der Computerprogrammierung zu beschleunigen und zu vereinfachen. IBM unterstützte dieses Vorhaben, und Backus leitete ab 1954 ein kleines Team im IBM Watson Scientific Laboratory. Nach dreijähriger intensiver Entwicklungsarbeit wurde 1957 die erste Version von Fortran der Öffentlichkeit vorgestellt. Sie war ein technologischer Durchbruch, bestehend aus 25.000 Zeilen Code, die auf einer Magnetkassette mit jedem IBM 704-System ausgeliefert wurden. Fortran wurde schnell von Wissenschaftlern und Mathematikern angenommen, insbesondere für die Entwicklung von numerisch intensiven Programmen, die damals manuell kaum zu bewältigen waren.

Evolution der Fortran-Standards: Von prozedural zu objektorientiert

Die Entwicklung von Fortran war dynamisch und von ständigen Verbesserungen geprägt, um den wachsenden Anforderungen der wissenschaftlichen Gemeinschaft gerecht zu werden. Bereits 1958 folgte Fortran II, das wichtige Neuerungen wie Datentypen für komplexe Zahlen einführte – ein Game-Changer für Bereiche wie die Elektrotechnik. Eine entscheidende Verbesserung war die Einführung von benutzerdefinierten Funktionen, die die Möglichkeiten der prozeduralen Programmierung erheblich erweiterten. Fortran III wurde zwar entwickelt, aber nie kommerziell veröffentlicht. Ab 1960 gab es bereits zahlreiche Fortran-Versionen für verschiedene IBM-Computer, und die Popularität der Sprache führte dazu, dass andere Computerhersteller eigene Compiler entwickelten; bis 1963 waren über 40 verschiedene Implementierungen verfügbar.

Ein Meilenstein war Fortran IV (1961), das maschinenabhängige Funktionen eliminierte und neue Datentypen wie den logischen Datentyp hinzufügte. Diese Version wurde 1965 von der American Standards Association standardisiert, was Fortran zu einer weit verbreiteten Sprache im Bildungsbereich machte. Trotz der Standardisierung entstanden weiterhin Varianten, die zu weiteren Überarbeitungen führten, darunter der einflussreiche Standard Fortran 77. Die Sprache wurde über die Jahrzehnte hinweg kontinuierlich weiterentwickelt, wobei der jüngste Standard, Fortran 2018, neue Funktionen eingeführt hat, um die Leistungsfähigkeit der Sprache zu erhalten und sie für moderne Herausforderungen des wissenschaftlichen Rechnens zu rüsten. Dazu gehören objektorientierte Merkmale wie Typenerweiterung und Polymorphismus, die Fortran von einer rein prozeduralen Sprache zu einer flexibleren Entwicklungsplattform machen. Konzepte wie „block if“ und „end if“ verbesserten die strukturierte Programmierung und zeigen, wie Fortran sich an die Best Practices moderner Programmiersprachen wie C++, Java und Python annäherte. Fortran hat im Laufe der Zeit nicht nur viele Sprachen inspiriert, sondern auch die Entwicklung von Kompilierungstechniken maßgeblich beeinflusst.

„Das Ziel war es, dem Programmierer die Denkweise eines Mathematikers zu ermöglichen und ihn von den mechanischen Details der Maschine zu befreien.“

– John Backus über die Entwicklung von Fortran

Hier ein einfaches Fortran-Beispiel, das die Struktur einer grundlegenden Berechnung und einer Schleife zeigt:

! Dateiname: sum_array.f90

! Ein einfaches Fortran-Programm zur Summation von Array-Elementen

PROGRAM SummationExample

IMPLICIT NONE ! Strikte Deklaration aller Variablen erzwingen

INTEGER :: n ! Deklaration einer Integer-Variablen für die Array-Größe

REAL, DIMENSION(10) :: data_array ! Deklaration eines REAL-Arrays der Größe 10

REAL :: total_sum ! Deklaration einer REAL-Variablen für die Summe

INTEGER :: i ! Schleifenindex

! Array-Größe festlegen (dynamische Zuweisung ist in modernem Fortran möglich)

n = 10

! Array-Elemente initialisieren

DO i = 1, n

data_array(i) = REAL(i) 2.5

END DO

! Summe berechnen

total_sum = 0.0

DO i = 1, n

total_sum = total_sum + data_array(i)

END DO

! Ergebnis ausgeben

WRITE(,) 'Die Elemente des Arrays sind:'

WRITE(,) data_array

WRITE(,) 'Die Summe der Array-Elemente ist: ', total_sum

END PROGRAM SummationExampleDieses Beispiel zeigt die explizite Deklaration von Variablen, die Nutzung von Schleifen (DO ... END DO) und einfache Ein- / Ausgabe (WRITE), charakteristisch für prozedurale Programmierung in Fortran.

Anwendungsbereiche von Fortran in der modernen Wissenschaft und Technik

Die Stärken von Fortran, insbesondere seine Fähigkeit, mathematische Formeln effizient in Code umzusetzen und hochperformante Anwendungen zu erstellen, machen es auch heute noch zu einer bevorzugten Wahl in spezialisierten Forschungsbereichen. Fortran ist tief in der Welt der wissenschaftlichen Informatik verwurzelt. Einige der bekanntesten und komplexesten Simulationsmodelle und Rechenprogramme basieren nach wie vor auf Fortran.

Beispiele hierfür sind das NEMO-Framework (Nucleus for European Modelling of the Ocean), das zur Modellierung von Ozeansystemen verwendet wird, und der OFF-Code für Fluiddynamik-Simulationen. Auch die globalen Klimamodelle des Goddard Institute for Space Studies (GISS), die für die Erforschung des Klimawandels von entscheidender Bedeutung sind, nutzen Fortran extensiv. Die Eignung von Fortran für Klimamodellierungsprogramme und Wettervorhersagen ergibt sich aus der direkten Umsetzbarkeit komplexer mathematischer Gleichungen in Code und der Fähigkeit, rechenintensive Operationen auf Supercomputern effizient zu parallelisieren. Auch in Bereichen wie dem Finanzhandel, wo schnelle Algorithmen für Hochfrequenzhandel (HFT) entscheidend sind, oder in der technischen Simulation in der Luft- und Raumfahrt sowie im Automobilbau findet Fortran weiterhin Anwendung.

Fortran im Vergleich: Spezialist vs. Allrounder

Obwohl Fortran in seinen spezifischen Domänen glänzt, hat seine allgemeine Popularität im Vergleich zu Sprachen wie Python oder Java abgenommen. Das TIOBE-Index, das die Beliebtheit von Programmiersprachen misst, zeigt Fortran zwar nicht mehr in den Top-Positionen, aber es bleibt eine feste Größe im High-Performance Computing. Dies liegt daran, dass Fortran-Compiler über Jahrzehnte hinweg optimiert wurden, um das volle Potenzial der Hardware auszuschöpfen. Seine Fähigkeit zur Parallelisierung von Rechenoperationen ist für die aktuelle Generation von Supercomputern unerlässlich. Während Fortran im Bereich der Systemprogrammierung oder Webentwicklung kaum eine Rolle spielt, ist es im Kern wissenschaftlicher Simulationssoftware oft unersetzlich.

Fortran und Data Science: Eine Betrachtung der Sprachenlandschaft

Im aufstrebenden Feld der Data Science, das sich mit der Extraktion von Wissen aus Daten befasst, sind die Anforderungen an Programmiersprachen vielfältig. Während Fortran für grundlegende numerische Berechnungen im HPC-Kontext unschlagbar sein kann, übertreffen es andere Sprachen in Bezug auf Datenmanipulation, Visualisierung, Machine Learning und die Entwicklung komplexer Analyse-Workflows. Sprachen wie Python, R und Julia haben sich als führend für die Hochleistungsdatenanalyse etabliert, bieten umfangreiche Bibliotheken und eine höhere Produktivität für Data Scientists.

Python: Der unangefochtene Champion der Data Science

Python hat sich zur populärsten Programmiersprache in der Data Science entwickelt. Seine einfache Syntax, hervorragende Lesbarkeit und die riesige Menge an verfügbaren Bibliotheken machen es zur ersten Wahl für viele Aufgaben, von der Datenbereinigung über die statistische Modellierung bis hin zum Machine Learning und Deep Learning. Für Entwickler und Studenten, die sich mit Datenanalyse befassen, ist Python für Ingenieure und Wissenschaftler ein essenzielles Werkzeug.

Zu den wichtigsten Bibliotheken für Python für Data Science gehören:

- NumPy: Bietet leistungsstarke Funktionen für die Arbeit mit multidimensionalen Arrays und mathematischen Operationen, die oft in C oder Fortran implementiert sind, um hohe Geschwindigkeit zu gewährleisten.

- Pandas: Eine Bibliothek für Datenstrukturen und Datenanalyse, insbesondere für Tabellendaten (DataFrames).

- SciPy: Eine Sammlung von Algorithmen für wissenschaftliches und technisches Rechnen, einschließlich Optimierung, Integration, Interpolation und linearer Algebra.

- Scikit-learn: Eine umfassende Bibliothek für Machine-Learning-Algorithmen (Klassifizierung, Regression, Clustering).

- Matplotlib/Seaborn: Für Datenvisualisierung und grafische Darstellungen.

- TensorFlow/PyTorch: Für Deep Learning und neuronale Netze.

Ein einfaches Beispiel für Datenanalyse mit Python und NumPy:

# Dateiname: python_data_analysis.py

import numpy as np

# Ein einfaches Array in Python mit NumPy erstellen

data = np.array([10.5, 12.3, 15.1, 8.9, 11.7, 13.0, 14.2])

# Grundlegende statistische Berechnungen durchführen

mean_value = np.mean(data) # Mittelwert

median_value = np.median(data) # Median

std_dev = np.std(data) # Standardabweichung

max_value = np.max(data) # Maximalwert

min_value = np.min(data) # Minimalwert

print(f"Originaldaten: {data}")

print(f"Mittelwert: {mean_value:.2f}")

print(f"Median: {median_value:.2f}")

print(f"Standardabweichung: {std_dev:.2f}")

print(f"Maximalwert: {max_value:.2f}")

print(f"Minimalwert: {min_value:.2f}")

# Beispiel für Vektorisierung: Alle Werte um 2 erhöhen

increased_data = data + 2

print(f"Daten um 2 erhöht: {increased_data}")R: Die Sprache für statistische Analysen

R ist eine leistungsstarke Programmiersprache und eine Umgebung, die speziell für statistische Berechnungen und Grafiken entwickelt wurde. Entstanden in den frühen 1990er Jahren, ist R die bevorzugte Wahl vieler Statistiker und Data Analysts. Mit über 11.000 Paketen im Comprehensive R Archive Network (CRAN) bietet R eine unvergleichliche Fülle an Funktionen für fast jede statistische Methode, die man sich vorstellen kann. Diese Pakete sind größtenteils in R selbst geschrieben, können aber auch C, Java oder Fortran-Komponenten enthalten, um die Leistung zu optimieren. Spezialisierte Umgebungen wie Bioconductor konzentrieren sich auf bestimmte Bereiche wie die Analyse von Genomdaten. R ist ideal für interaktive Datenexploration und -visualisierung.

Julia: Die aufstrebende Alternative für wissenschaftliches Rechnen

Julia, im Jahr 2009 entwickelt, ist eine relativ neue, aber äußerst vielversprechende Programmiersprache, die das „Two-Language Problem“ im wissenschaftlichen Rechnen lösen soll. Traditionell mussten Entwickler in Sprachen wie Python Prototypen erstellen und dann leistungskritische Teile in C oder Fortran umschreiben. Julia wurde von Grund auf für Hochleistung konzipiert, bietet aber gleichzeitig die Produktivität und Flexibilität einer dynamischen Sprache. Es unterstützt prozedurale, objektorientierte und funktionale Paradigmen und ist hervorragend für verteiltes oder paralleles Rechnen geeignet. Mit über 1700 Paketen im Julia Package Manager, die oft in Julia, C oder Fortran geschrieben sind, deckt es alle Bereiche der Data Science ab. Die Fähigkeit, Python-Funktionen über PyCall oder C-Funktionen direkt aufzurufen, macht Julia zu einem mächtigen Werkzeug.

C und C++: Fundament für Hochleistungs-Bibliotheken

Die Programmiersprachen C und C++ sind die Arbeitspferde der Systemprogrammierung und des Hochleistungs-Computings. C ist eine allgemeine Sprache, die für ihre Effizienz und ihren direkten Zugriff auf Hardware bekannt ist. Viele leistungsstarke Bibliotheken, die von Python oder R verwendet werden, sind intern in C oder C++ implementiert. C++ erweitert C um objektorientierte Funktionen und ist eine bevorzugte Wahl, wenn es um maximale Performance, feingranulare Speicherverwaltung und die Entwicklung komplexer Softwaresysteme geht. Für die Data Science bieten sie zwar nicht die gleiche Entwicklungsgeschwindigkeit wie Python, sind aber unverzichtbar für die Erstellung der zugrunde liegenden, rechenintensiven Algorithmen und Datenverarbeitungs-Engines.

| Merkmal | Fortran | Python (mit NumPy/SciPy) | C/C++ | R | Julia |

|---|---|---|---|---|---|

| Primärer Fokus | Numerisches HPC, Wissenschaft, Ingenieurwesen | Allgemeine Programmierung, Data Science, KI | Systemprogrammierung, Hochleistungsanwendungen | Statistische Analyse, Grafik | Wissenschaftliches Rechnen, Leistung, Produktivität |

| Leistung | Extrem hoch (durch Compileroptimierung) | Hoch (durch C/Fortran-basierte Bibliotheken) | Extrem hoch (direkte Hardwarekontrolle) | Mittel bis hoch (durch C/Fortran-basierte Pakete) | Sehr hoch (JIT-Kompilierung) |

| Lernkurve | Moderativ (ältere Syntax, spezifische Paradigmen) | Einfach bis moderativ (breites Ökosystem) | Steil (Speicherverwaltung, Zeiger) | Moderativ (statistischer Fokus, spezielle Syntax) | Moderativ (ähnlich Python, aber leistungsstark) |

| Ökosystem | Spezifisch (HPC-Bibliotheken) | Sehr umfangreich (breite Anwendungsbereiche) | Umfangreich (System- und Anwendungsentwicklung) | Sehr umfangreich (statistische Pakete) | Wächst schnell (wissenschaftliche Pakete) |

| Speicherverwaltung | Meist statisch/stapelbasiert, vereinfacht | Automatisch (Garbage Collection) | Manuell (Zeiger, Allokation) | Automatisch (Garbage Collection) | Automatisch (Garbage Collection) |

| Paradigmen | Prozedural, später objektorientiert | Objektorientiert, prozedural, funktional | Prozedural, objektorientiert, generisch | Funktional, prozedural, objektorientiert | Funktional, prozedural, objektorientiert, Meta |

Fortran Programmierung erlernen: Ein Wegweiser für Entwickler

Das Erlernen der Fortran Programmierung kann eine wertvolle Bereicherung für jeden Entwickler sein, insbesondere wenn man sich auf wissenschaftliche Simulationen oder das Hochleistungsrechnen spezialisieren möchte. Während für viele moderne Data Science-Anwendungen Python die erste Wahl ist, bietet Fortran unübertroffene Vorteile in Szenarien, wo reine Rechenleistung und die Interaktion mit etablierten numerischen Bibliotheken im Vordergrund stehen. Ein tiefes Verständnis der Fortran-Syntax und seiner Optimierungsmöglichkeiten kann die Leistung von komplexen Algorithmen erheblich steigern und Türen zu spezialisierten Karrierewegen in der Computational Science öffnen.

Für den Einstieg in die Fortran-Programmierung empfiehlt es sich, mit einem modernen Fortran-Standard wie Fortran 90/95 oder neuer zu beginnen, um von erweiterten Funktionen wie dynamischer Speicherzuweisung, Modulen und objektorientierten Ansätzen zu profitieren. Ressourcen wie Online-Tutorials, offizielle Dokumentationen und Lehrbücher sind hervorragende Startpunkte. Die Kombination von Fortran mit anderen Sprachen wie Python (z.B. über F2Py) ermöglicht es, das Beste aus beiden Welten zu nutzen: die Rechenleistung von Fortran-Routinen in einer flexiblen Python-Umgebung. Der Fokus sollte darauf liegen, die Grundlagen der prozeduralen und numerischen Programmierung zu meistern, da dies die Kernstärke der Sprache ist. Indem man die Prinzipien des effizienten Algorithmen-Designs lernt, kann man die volle Leistung von Fortran entfesseln.

Häufig gestellte Fragen zur Fortran Programmierung

Warum ist Fortran immer noch relevant?

Fortran bleibt relevant wegen seiner unübertroffenen Rechenleistung für numerische Simulationen und der riesigen Menge an bestehendem Legacy-Code in wissenschaftlichen Bereichen. Viele kritische Infrastrukturprogramme, von der Klimaforschung bis zur Luft- und Raumfahrt, wurden in Fortran entwickelt und werden kontinuierlich gewartet und erweitert. Seine Optimierung für Supercomputing-Anwendungen ist nach wie vor führend.

Ist Fortran für Anfänger geeignet?

Fortran kann für Anfänger geeignet sein, die einen direkten Einstieg in die wissenschaftliche Programmierung suchen. Seine Syntax ist relativ geradlinig und fokussiert auf arithmetische Operationen. Allerdings kann der Mangel an modernen, benutzerfreundlichen Entwicklungsumgebungen und der spezialisierte Anwendungsbereich im Vergleich zu Sprachen wie Python für absolute Einsteiger eine Hürde darstellen.

Welche Tools benötigt man für Fortran-Entwicklung?

Für die Fortran-Entwicklung benötigt man einen Fortran-Compiler (z.B. GNU Fortran (gfortran), Intel Fortran Compiler, PGI Fortran Compiler) und einen Texteditor oder eine integrierte Entwicklungsumgebung (IDE), die Syntax-Highlighting für Fortran unterstützt (z.B. VS Code mit Fortran-Erweiterungen, Eclipse mit Photran). Für das Hochleistungsrechnen sind oft auch Debugger und Profiling-Tools erforderlich.

Kann Fortran mit modernen Sprachen interagieren?

Ja, modernes Fortran kann gut mit anderen Sprachen interagieren. Über Schnittstellen wie Fortran-C-Interoperabilität oder spezielle Tools wie F2Py kann Fortran-Code in Python-Programmen aufgerufen werden. Dies ermöglicht es Entwicklern, rechenintensive Teile in Fortran zu belassen und die flexibleren Aspekte (z.B. Datenmanipulation, Visualisierung) mit Python zu handhaben.

Vielen Dank für diesen interessanten Einblick in die Geschichte und die Leistungsfähigkeit von Fortran! Es ist beeindruckend, wie lange diese Sprache schon im Einsatz ist und welche komplexen Probleme damit gelöst werden.

Meine Sorge als jemand, der nicht direkt im Hochleistungsrechnen steckt, ist die praktische Anwendbarkeit für den Durchschnittsnutzer. Ist Fortran wirklich nur etwas für wissenschaftliche Experten und komplexe Simulationen, oder gibt es auch Anwendungsbereiche, wo es für den „normalen“ Entwickler oder gar in alltäglichen Kontexten nützlich sein könnte, ohne dass es gleich übermäßig kompliziert wird? Oder ist die Lernkurve für solche Zwecke einfach zu steil?

Und wie sieht es mit der Kompatibilität aus? Funktioniert die beschriebene Technologie auch noch gut mit älterer Hardware oder Software, oder ist man hier auf sehr aktuelle Systeme angewiesen? Es wäre super, wenn der Beitrag auch diese Fragen etwas beleuchten könnte, um ein besseres Gefühl dafür zu bekommen, wo Fortran heute wirklich steht und für wen es relevant ist.

Man spricht von „komplexen Problemen“, „numerischer Simulation“ und „Data Science“ – aber welche *Daten* genau werden hier verarbeitet? Wenn Fortran so mächtig im „Hochleistungsrechnen“ ist, welche Art von sensiblen Informationen könnte damit analysiert werden, vielleicht sogar ohne unser Wissen oder unsere explizite Zustimmung? Von „Wettervorhersage“ bis zur „Finanzmodellierung“ – sind wir uns der vollen Bandbreite der Datensätze bewusst, die diese Systeme verarbeiten, und ob darunter nicht auch sehr persönliche oder gar personenbezogene Daten sind, die tiefgreifende Einblicke in unser Verhalten und unsere Entscheidungen ermöglichen? Wer hat Zugriff auf die Erkenntnisse, die aus diesen „numerischen Simulationen“ gewonnen werden, und wie wird sichergestellt, dass diese nicht missbraucht werden oder unsere Privatsphäre untergraben? Die Fähigkeit, „komplexe Probleme zu lösen“, klingt beeindruckend, aber zu welchem Preis für unsere informationelle Selbstbestimmung? Wer schützt uns vor den unsichtbaren Algorithmen, die unsere digitalen Spuren verfolgen und Muster erkennen, die wir selbst nicht kennen?

Das sind sehr wichtige und berechtigte Fragen, die Sie hier aufwerfen. Es ist absolut entscheidend, sich nicht nur mit den technologischen Möglichkeiten, sondern auch intensiv mit den ethischen Implikationen und dem Datenschutz auseinanderzusetzen, insbesondere wenn es um die Verarbeitung großer und potenziell sensibler Datenmengen geht. Die Art der verarbeiteten Daten variiert stark je nach Anwendungsgebiet. Bei Wettervorhersagen sind es beispielsweise meteorologische Messdaten, während es in der Finanzmodellierung um Marktdaten, Transaktionen oder auch aggregierte Verhaltensmuster gehen kann.

Die Frage nach dem Schutz unserer informationellen Selbstbestimmung ist dabei zentral. Es ist die Aufgabe von Gesetzgebern, Entwicklern und Anwendern, transparente Rahmenbedingungen zu schaffen und sicherzustellen, dass Datenschutzstandards wie die DSGVO konsequent eingehalten werden. Der Zugriff auf Erkenntnisse aus solchen Simulationen muss streng reguliert und die Zweckbindung der Datenverarbeitung klar definiert sein, um Missbrauch zu verhindern. Vielen Dank für diesen wertvollen Kommentar, der die Diskussion bereichert. Ich lade Sie herzlich ein, auch meine anderen Artikel in meinem Profil oder meine weiteren Veröffentlichungen anzusehen.