Deep Neural Networks (DNNs), oder Tiefe Neuronale Netze, sind eine faszinierende und transformative Technologie im Bereich der Künstlichen Intelligenz (KI). Inspiriert von der komplexen Struktur und Funktionsweise des menschlichen Gehirns, bilden sie das Herzstück vieler moderner KI-Anwendungen, die unsere digitale Welt täglich prägen. Von der Mustererkennung bis hin zur komplexen Datenanalyse ermöglichen diese fortschrittlichen Algorithmen Maschinen, aus riesigen Datenmengen zu lernen und fundierte Entscheidungen zu treffen. Ihr Potenzial, die Art und Weise, wie wir mit Technologie interagieren, zu revolutionieren, ist immens und wächst stetig.

In diesem umfassenden Blogbeitrag werden wir die Grundlagen von Deep Neural Networks detailliert beleuchten. Wir tauchen tief in ihre architektonischen Besonderheiten ein, erklären die faszinierende Funktionsweise Deep Neural Network und wie sie durch Deep Learning trainiert werden. Zudem untersuchen wir konkrete Anwendungsfälle Deep Learning in verschiedenen Branchen und stellen die wichtigsten Frameworks vor, die für ihre Entwicklung und Implementierung zum Einsatz kommen. Für Entwickler, Studenten und Technologiebegeisterte bietet dieser Artikel einen fundierten Einblick in diese Schlüsseltechnologie der modernen KI.

Deep Neural Networks: Definition und Aufbau

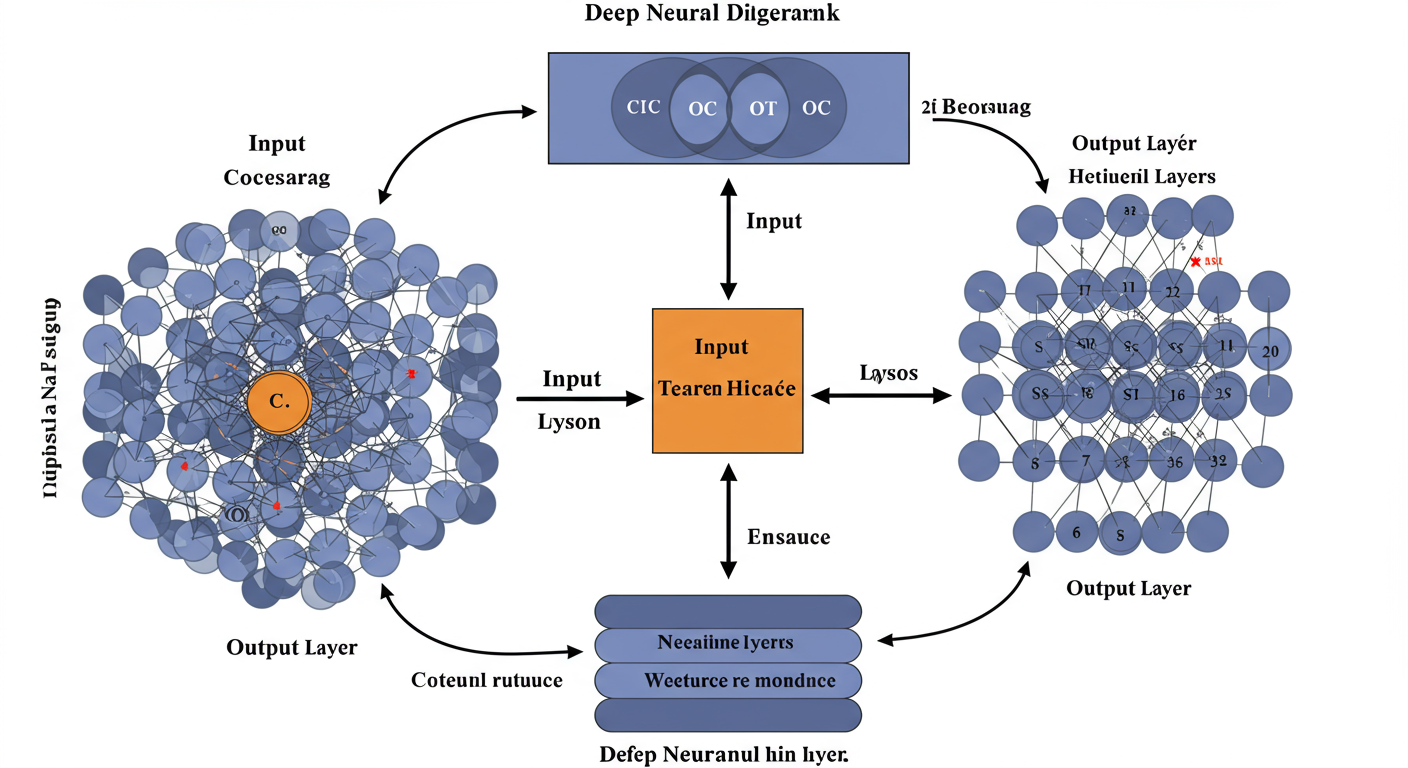

Ein Neuronales Netzwerk ist im Kern eine Ansammlung von Algorithmen, die darauf abzielen, die Verhaltensweisen des menschlichen Gehirns nachzubilden. Insbesondere geht es darum, Muster zu erkennen und Informationen zwischen verschiedenen Schichten von neuronalen Verbindungen zu übertragen. Ein Deep Neural Network unterscheidet sich von einem traditionellen Neuronalen Netzwerk durch seine besondere Architektur: Es besteht aus mindestens zwei, oft aber aus vielen weiteren, „verborgenen“ Schichten zwischen der Eingabe- und der Ausgabeschicht. Diese Tiefe ermöglicht es, Daten auf eine wesentlich komplexere Weise zu verarbeiten und fortgeschrittene mathematische Modelle zur Extraktion hochabstrakter Merkmale einzusetzen.

Der Aufbau Deep Neural Network ist entscheidend für seine Leistungsfähigkeit. Jede dieser Schichten ist für spezifische Arten der Sortierung und Kategorisierung verantwortlich, ein Prozess, der als Feature Hierarchy oder Merkmalshierarchie bezeichnet wird. Die Eingabeschicht nimmt die Rohdaten auf, die verborgenen Schichten führen sukzessive Transformationen und Abstraktionen der Merkmale durch, und die Ausgabeschicht liefert das Endergebnis, beispielsweise eine Klassifizierung oder Prognose. Je mehr verborgene Schichten vorhanden sind, desto „tiefer“ ist das Netzwerk und desto komplexere Zusammenhänge kann es lernen.

Die Schichten eines Deep Neural Networks im Detail

Die Struktur eines Deep Neural Networks lässt sich in drei Haupttypen von Schichten unterteilen, die jeweils eine spezifische Rolle in der Datenverarbeitung spielen. Das Verständnis dieser Schichten ist fundamental, um die Funktionsweise Deep Neural Network zu begreifen.

- Eingabeschicht (Input Layer): Dies ist die erste Schicht des Netzwerks. Sie empfängt die ursprünglichen Daten in Form von numerischen Werten. Bei Bildern könnten dies beispielsweise Pixelwerte sein, bei Texten Vektordarstellungen von Wörtern. Jedes Neuron in dieser Schicht repräsentiert eine Eingangseigenschaft der Daten.

- Verborgene Schichten (Hidden Layers): Dies sind die Kernkomponenten, die einem Netzwerk seine „Tiefe“ verleihen. Ein DNN muss mindestens zwei solcher Schichten haben. In diesen Schichten werden komplexe Berechnungen und Transformationen der Eingabedaten durchgeführt. Jede verborgene Schicht lernt, spezifische Merkmale aus den Ausgaben der vorhergehenden Schicht zu extrahieren. Beispielsweise könnte eine frühe Schicht Kanten in einem Bild erkennen, während eine spätere Schicht Kombinationen von Kanten zu Formen und dann zu Objekten zusammensetzt. Diese sukzessive Abstraktion ermöglicht es dem Netzwerk, hochkomplexe Muster zu erkennen. Die Anzahl der Neuronen und Schichten kann stark variieren und hängt von der Komplexität des Problems ab.

- Ausgabeschicht (Output Layer): Die letzte Schicht des Netzwerks liefert das Endergebnis. Die Anzahl der Neuronen in dieser Schicht hängt von der Art der zu lösenden Aufgabe ab. Bei einer Klassifikationsaufgabe mit zehn Kategorien (z.B. Ziffernerkennung von 0-9) hätte die Ausgabeschicht zehn Neuronen, die jeweils die Wahrscheinlichkeit für eine bestimmte Kategorie darstellen könnten. Bei einer Regressionsaufgabe (z.B. Preisvorhersage) könnte es ein einzelnes Neuron sein, das einen kontinuierlichen Wert ausgibt.

Aktivierungsfunktionen und Gewichte: Die Bausteine der Verarbeitung

Innerhalb jeder Schicht eines Deep Neural Networks sind die einzelnen Knoten, oft als Neuronen bezeichnet, vergleichbar mit Neuronen im menschlichen Gehirn. Sobald sie durch Reize (Eingabedaten) erreicht werden, wird ein Prozess ausgelöst. Jeder Knoten verarbeitet die erhaltenen Eingaben, und wenn das Ergebnis dieser Verarbeitung einen bestimmten Schwellenwert überschreitet, wird ein Signal an die Neuronen der nächsten Schicht weitergeleitet. Diese Weiterleitung und Transformation der Signale ist das Herzstück der intelligenten Verarbeitung.

Zwei Schlüsselkonzepte sind hierbei von zentraler Bedeutung:

- Gewichte (Weights): Jede Verbindung zwischen zwei Neuronen in aufeinanderfolgenden Schichten ist mit einem „Gewicht“ assoziiert. Dieses Gewicht bestimmt den Einfluss der Daten des vorgelagerten Neurons auf das Ergebnis des nachfolgenden Neurons und letztendlich auf das Endergebnis. Während des Trainings werden diese Gewichte angepasst, um die Genauigkeit des Netzwerks zu verbessern. Ein höheres Gewicht bedeutet eine stärkere Bedeutung dieser Verbindung.

- Aktivierungsfunktionen (Activation Functions): Nachdem die Eingaben eines Neurons mit ihren jeweiligen Gewichten multipliziert und summiert wurden, wird das Ergebnis durch eine Aktivierungsfunktion transformiert. Diese Funktion führt eine Nichtlinearität in das Netzwerk ein, was entscheidend ist, damit das DNN komplexe, nichtlineare Muster lernen kann. Ohne Aktivierungsfunktionen würde das gesamte Deep Neural Network trotz seiner vielen Schichten nur ein einfaches lineares Modell darstellen. Gängige Aktivierungsfunktionen sind ReLU (Rectified Linear Unit), Sigmoid und Tanh.

Ein einfaches Beispiel für die Berechnung in einem Neuron:

import numpy as np

# Beispiel für eine Sigmoid-Aktivierungsfunktion

def sigmoid(x):

return 1 / (1 + np.exp(-x))

# Ein einfaches Neuron mit zwei Eingaben

eingaben = np.array([0.7, 0.3])

gewichte = np.array([0.5, 0.8])

bias = 0.1 # Ein Bias-Wert wird oft hinzugefügt, um das Modell flexibler zu machen

# Berechnung der gewichteten Summe

gewichtete_summe = np.dot(eingaben, gewichte) + bias

# Anwendung der Aktivierungsfunktion

output = sigmoid(gewichtete_summe)

print(f"Eingaben: {eingaben}")

print(f"Gewichte: {gewichte}")

print(f"Bias: {bias}")

print(f"Gewichtete Summe: {gewichtete_summe}")

print(f"Output des Neurons (nach Sigmoid-Aktivierung): {output}")

# Ausgabe:

# Eingaben: [0.7 0.3]

# Gewichte: [0.5 0.8]

# Bias: 0.1

# Gewichtete Summe: 0.35 + 0.24 + 0.1 = 0.69

# Output des Neurons (nach Sigmoid-Aktivierung): 0.6659

Dieses Beispiel verdeutlicht, wie Rohdaten durch die Multiplikation mit Gewichten und die Anwendung einer Aktivierungsfunktion in eine transformierte Ausgabe überführt werden, die dann an die nächste Schicht weitergeleitet wird. Dieser Prozess wiederholt sich über alle Hidden Layers in neuronalen Netzen, bis die Ausgabeschicht erreicht ist.

Deep Learning ist keine Zukunftstechnologie, sondern eine Gegenwartstechnologie, die bereits heute vielfältige Problemstellungen in Unternehmen löst.

Deep Learning: Das Training von DNNs

Damit ein Deep Neural Network seine beeindruckende Fähigkeit zur Mustererkennung und Datenklassifizierung entfalten kann, muss es zunächst trainiert werden. Dieser Trainingsprozess wird als Deep Learning bezeichnet – eine spezialisierte Form des maschinellen Lernens. Im Gegensatz zu herkömmlichen Machine-Learning-Modellen, die oft manuell ausgewählte Merkmale benötigen, lernen DNNs ihre Merkmale selbst aus den Daten, was ihre Flexibilität und Leistungsfähigkeit erhöht.

Während der Trainingsphase wird dem KI-System eine große Menge an Beispieldaten präsentiert. Diese Daten sind in der Regel gelabelt, das heißt, die korrekte Ausgabe oder Kategorie ist bekannt. Das Netzwerk lernt, aus diesen Beispieldaten Muster und Merkmale zu erkennen und die internen Gewichte und Biases so anzupassen, dass es die korrekten Vorhersagen trifft. Dieses iterative Lernen und Anpassen ist der Kern der Intelligenz, die ein DNN entwickelt.

Der Lernprozess und Fehlerkorrektur: Backpropagation

Der Lernprozess eines Deep Neural Networks ist ein iterativer Optimierungsvorgang. Wenn das Netzwerk neue, ungelabelte Daten erhält, versucht es, diese zu kategorisieren oder eine Vorhersage zu treffen. Die Qualität dieser Vorhersage wird anhand einer sogenannten Verlustfunktion (Loss Function) bewertet, die quantifiziert, wie weit die Vorhersage von der tatsächlichen, bekannten korrekten Antwort abweicht. Wenn die Vorhersage falsch ist oder nicht optimal, muss das System aus diesem Fehler lernen.

Hier kommt der Algorithmus der Backpropagation ins Spiel. Backpropagation ist die Methode, mit der der Fehler aus der Ausgabeschicht rückwärts durch das Netzwerk propagiert wird, um die Gradienten der Verlustfunktion bezüglich der Gewichte und Biases zu berechnen. Diese Gradienten zeigen an, in welche Richtung und wie stark die Gewichte angepasst werden müssen, um den Fehler zu minimieren. Ein Optimierungsalgorithmus, wie z.B. der stochastische Gradientenabstieg (SGD) oder Adam, nutzt diese Gradienten, um die Gewichte des Netzwerks schrittweise zu aktualisieren. Dieser Zyklus aus Vorwärtslauf (Vorhersage), Fehlerberechnung (Verlustfunktion) und Rückwärtslauf (Backpropagation und Gewichtsaktualisierung) wiederholt sich Tausende oder Millionen von Malen, bis das Netzwerk eine hohe Genauigkeit erreicht. Das System lernt aus seinen Fehlern, und seine Erfolgsrate verbessert sich kontinuierlich.

Ein vereinfachtes Codebeispiel für einen Lernschritt (Forward- und Backward-Pass):

import numpy as np

# Beispiel: Einfaches Neuronales Netzwerk (ein Neuron, für Demonstration)

# Eingabe x, Gewicht w, Bias b, gewünschter Output y_true

# Simulierte Trainingsdaten

X_train = np.array([[0.5], [1.0], [1.5]])

y_train = np.array([[0.8], [1.2], [1.7]])

# Initialisierung der Parameter

w = np.random.randn(1, 1) 0.01 # Gewicht

b = np.zeros((1, 1)) # Bias

learning_rate = 0.01

# Einfache lineare Aktivierungsfunktion für Demonstration: f(x) = x

# Eine komplexere Aktivierungsfunktion wäre in echten DNNs üblich.

print(f"Initiales Gewicht: {w[0][0]:.4f}, Initialer Bias: {b[0][0]:.4f}")

# Trainingsschleife (einige Epochen)

for epoch in range(500):

for i in range(len(X_train)):

x = X_train[i]

y_true = y_train[i]

# 1. Forward-Pass: Berechnung der Vorhersage

y_pred = np.dot(x, w) + b # y_pred = x w + b

# 2. Verlustfunktion: MSE (Mean Squared Error)

loss = (y_pred - y_true)2

# 3. Backward-Pass: Gradienten berechnen

# Gradient von Loss bezüglich y_pred: 2 (y_pred - y_true)

d_loss_d_y_pred = 2 (y_pred - y_true)

# Gradient von y_pred bezüglich w: x

d_y_pred_d_w = x

# Gradient von y_pred bezüglich b: 1

d_y_pred_d_b = 1

# Kettenregel anwenden, um Gradienten von Loss bezüglich w und b zu erhalten

gradient_w = d_loss_d_y_pred d_y_pred_d_w

gradient_b = d_loss_d_y_pred d_y_pred_d_b

# 4. Parameter-Update

w -= learning_rate gradient_w

b -= learning_rate gradient_b

if epoch % 100 == 0:

total_loss = np.mean([(np.dot(X_train[j], w) + b - y_train[j])2 for j in range(len(X_train))])

print(f"Epoche {epoch}, Durchschnittlicher Verlust: {total_loss[0]:.4f}, Gewicht: {w[0][0]:.4f}, Bias: {b[0][0]:.4f}")

print(f"nEndgültiges Gewicht: {w[0][0]:.4f}, Endgültiger Bias: {b[0][0]:.4f}")

# Test mit neuen Daten

new_x = np.array([2.0])

predicted_y = np.dot(new_x, w) + b

print(f"Vorhersage für x={new_x[0]}: {predicted_y[0][0]:.4f}")

Dieses Beispiel zeigt, wie Gewichte und Biases iterativ angepasst werden, um den Fehler zwischen Vorhersage und tatsächlichem Wert zu minimieren. In einem echten DNN würde dieser Prozess für jede Schicht und jeden Parameter durchgeführt, was die Komplexität und Rechenintensität von Deep Learning unterstreicht.

Typische Herausforderungen im Training

Obwohl das Training von Deep Neural Networks äußerst leistungsfähig ist, birgt es auch spezifische Herausforderungen:

- Overfitting (Überanpassung): Das Netzwerk lernt die Trainingsdaten zu gut und kann sich nicht gut auf neue, unbekannte Daten generalisieren. Es „merkt“ sich die Trainingsbeispiele, anstatt die zugrunde liegenden Muster zu verstehen. Techniken wie Regularisierung (L1, L2), Dropout und Datenaugmentation helfen, dies zu mindern.

- Vanishing/Exploding Gradients: Besonders in sehr tiefen Netzwerken können die Gradienten während der Backpropagation extrem klein (Vanishing Gradient) oder extrem groß (Exploding Gradient) werden. Dies erschwert oder verhindert das effektive Lernen der frühen Schichten. Architekturen wie ResNets oder BatchNorm, sowie angepasste Aktivierungsfunktionen (z.B. ReLU) und Gradient Clipping, können dieses Problem adressieren.

- Rechenleistung und Datenmenge: Das Training großer DNNs erfordert immense Rechenleistung (GPUs, TPUs) und eine große Menge an qualitativ hochwertigen, gelabelten Daten, die oft schwierig und teuer zu beschaffen sind.

Anwendungsgebiete von Deep Neural Networks

Deep Neural Networks sind heute der Motor hinter zahlreichen Innovationen und haben ihren Weg in nahezu jede Branche gefunden. Einer der Haupteinsatzbereiche dieser fortschrittlichen Netzwerke ist die Verarbeitung von unstrukturierten Daten verarbeiten. Im Gegensatz zu strukturierten Daten, die in Tabellen oder Datenbanken leicht organisiert sind, sind unstrukturierte Daten (wie Bilder, Texte, Audio) für traditionelle Algorithmen schwer zu handhaben. DNNs sind jedoch in der Lage, Muster und Bedeutungen in diesen komplexen Datentypen zu erkennen und zu klassifizieren, was sie für die Organisation und Analyse riesiger, zuvor unzugänglicher Datenmengen unerlässlich macht.

Darüber hinaus sind Deep Neural Networks äußerst nützlich, um menschliche Arbeitsaufgaben zu automatisieren. Ihre Fähigkeit, komplexe Entscheidungen zu treffen und Muster in Echtzeit zu erkennen, hat zu einer Vielzahl von Anwendungen geführt, die unseren Alltag grundlegend verändern.

Bild- und Spracherkennung: Die digitale Wahrnehmung

Die Gesichtserkennung Deep Learning ist ein Paradebeispiel für die Leistungsfähigkeit von DNNs. In der Videoüberwachung, bei der biometrischen Authentifizierung oder der Organisation von Fotoalben verlassen sich Systeme auf tiefe Faltungsnetzwerke (Convolutional Neural Networks, CNNs), um Gesichter zu identifizieren und zu analysieren. Diese Netzwerke können Gesichter auch unter schwierigen Bedingungen (unterschiedliche Beleuchtung, Winkel, Verdeckungen) zuverlässig erkennen.

Ebenso sind virtuelle Assistenten wie Siri, Alexa oder Google Assistant ohne Deep Learning und insbesondere Rekurrente Neuronale Netze (Recurrent Neural Networks, RNNs) und Transformer-Architekturen undenkbar. Diese Systeme nutzen DNNs, um menschliche Sprache zu verstehen (Spracherkennung), die Absicht hinter den Anfragen zu interpretieren (Natural Language Processing, NLP) und adäquate Antworten zu generieren (Sprachsynthese). Die beeindruckenden Fortschritte in der generativen KI, wie Large Language Models (LLMs), basieren ebenfalls auf extrem großen und tiefen neuronalen Netzen.

Empfehlungssysteme und Prognosen: Personalisierung und Effizienz

Die Personalisierung unserer digitalen Erfahrungen ist ein weiteres prominentes Einsatzgebiet. Wenn Sie bei Netflix einen Film empfohlen bekommen, bei Spotify neue Musik entdecken oder bei Amazon Produkte vorgeschlagen bekommen, basieren diese Empfehlungssysteme Deep Neural Network auf hochentwickelten DNNs. Diese analysieren Ihr Nutzerverhalten, Ihre Vorlieben und die Interaktionen ähnlicher Nutzer, um maßgeschneiderte Empfehlungen zu generieren, die relevant und ansprechend sind.

Im Finanzsektor spielt die Betrugserkennung KI eine immer größere Rolle. Banken und Finanzdienstleister nutzen DNNs, um Transaktionsmuster in Echtzeit zu analysieren und ungewöhnliche Aktivitäten zu identifizieren, die auf Betrug hindeuten könnten. Dies ermöglicht eine schnelle Reaktion und schützt Kunden und Institute vor erheblichen Verlusten. Die Fähigkeit der DNNs, komplexe Korrelationen in riesigen Datenmengen zu finden, ist hier von unschätzbarem Wert.

Tabelle: Beispiele für Anwendungsbereiche von Deep Neural Networks

| Branche | Anwendungsfall | Typisches DNN / Technologie |

|---|---|---|

| Gesundheitswesen | Krankheitsdiagnose (z.B. Krebs, Retinopathie) | CNNs für Bildanalyse (MRT, Röntgen) |

| Automobilindustrie | Autonome Fahrzeuge KI | CNNs für Objekterkennung, RNNs für Fahrverhalten |

| Finanzwesen | Betrugserkennung, Kreditrisikobewertung | Feedforward Networks, RNNs für Zeitreihen |

| Fertigung | Predictive Maintenance, Qualitätssicherung | CNNs für Defekterkennung, RNNs für Sensordaten |

| E-Commerce | Produktempfehlungen, Kundenservice-Bots | Kollaborative Filter mit DNNs, NLP-Modelle |

| Energie | Optimierung von Stromnetzen, Prognose des Energieverbrauchs | RNNs, Feedforward Networks für Zeitreihenanalyse |

Deep Learning in der Industrie: Einblicke

Deep Learning transformiert schrittweise alle Sektoren:

- Gesundheitswesen: DNNs werden eingesetzt, um medizinische Bilder (MRT, CT-Scans) zu analysieren und Krankheiten wie Krebs oder Retinopathie in einem frühen Stadium mit hoher Genauigkeit zu erkennen, oft besser als menschliche Experten. Dies beschleunigt die Diagnostik und verbessert die Behandlungsergebnisse.

- Luftfahrt: In der Luftfahrtindustrie optimieren DNNs Flugzeugflotten, indem sie prädiktive Wartung durchführen. Sie analysieren Sensordaten von Flugzeugen, um voraussichtliche Ausfälle von Komponenten zu erkennen und Wartungsarbeiten proaktiv zu planen, was die Sicherheit erhöht und Kosten senkt.

- Öl- und Gasindustrie: Hier kommen tiefe künstliche neuronale Netze für die Predictive Maintenance KI von Maschinen zum Einsatz. Sie überwachen den Zustand von Bohranlagen, Pipelines und anderen kritischen Infrastrukturen, um ungeplante Ausfallzeiten zu minimieren und die Betriebseffizienz zu steigern.

Die Evolution der Künstlichen Intelligenz hat ihren vorläufigen Höhepunkt in den Deep Neural Networks gefunden. Ursprünglich wurde maschinelles Lernen genutzt, um statistische Modelle durch Algorithmen zu automatisieren und bessere Vorhersagen zu treffen. Ein Machine Learning Modell war in der Lage, Vorhersagen für eine einzelne Aufgabe zu treffen und lernte, indem es seine Gewichte bei jeder fehlerhaften Vorhersage anpasste, um an Genauigkeit zu gewinnen. Anschließend entstanden künstliche neuronale Netze, die eine einzige verborgene Schicht verwendeten, um den Einfluss jeder Eingabe auf die Endausgabe zu speichern und zu bewerten. Deep Neural Networks gehen noch weiter, indem sie mehrere verborgene Schichten kombinieren, um noch komplexere und abstraktere Muster zu lernen.

Wichtige Deep Learning Frameworks

Um die Entwicklung und das Training von Deep Neural Networks zu erleichtern, haben sich verschiedene Deep Learning Frameworks etabliert. Diese Bibliotheken und Ökosysteme bieten wiederverwendbare Codeblöcke, Werkzeuge für die Datenvorverarbeitung, Modellarchitekturen und Optimierungsalgorithmen. Sie abstrahieren die komplexe mathematische Logik des Deep Learning und ermöglichen es Entwicklern, sich auf die Modellarchitektur und die Daten zu konzentrieren, anstatt auf die Implementierung jedes einzelnen Neurons oder jeder Backpropagation-Gleichung. Viele große Technologieunternehmen und Start-ups haben Open-Source-Projekte ins Leben gerufen, um die Nutzung von Deep Neural Networks zugänglicher zu machen.

Überblick über gängige Frameworks

Die Landschaft der Deep Learning Frameworks ist reichhaltig und entwickelt sich ständig weiter. Hier sind einige der prominentesten Beispiele:

- TensorFlow: Ein von Google entwickeltes Open-Source-Framework, das für seine Skalierbarkeit und Flexibilität bekannt ist. Es wird sowohl für Forschungs- als auch für Produktionsumgebungen eingesetzt und unterstützt eine Vielzahl von Deep Learning Architekturen. TensorFlow bietet eine umfassende Sammlung von Tools, Bibliotheken und Community-Ressourcen.

- PyTorch: Eine Open-Source-Bibliothek für Python, die von Facebook (jetzt Meta) entwickelt wurde. PyTorch ist besonders beliebt in der Forschungsgemeinschaft aufgrund seiner imperativen Programmierweise und des dynamischen Rechengraphen, der das Debugging und die Entwicklung neuer Modelle vereinfacht. Es bietet eine hohe Flexibilität und ist ideal für schnelle Prototypenentwicklung.

- Keras: Eine High-Level-API, die ursprünglich auf TensorFlow aufbaute, aber auch mit anderen Backends (wie Theano und CNTK) kompatibel war. Keras wurde entwickelt, um das schnelle Experimentieren mit Deep Learning zu ermöglichen, indem es eine benutzerfreundliche Schnittstelle bietet. Es ist bekannt für seine Einfachheit und eignet sich hervorragend für Einsteiger und für die schnelle Implementierung gängiger Netzwerkarchitekturen. Mittlerweile ist Keras ein fester Bestandteil von TensorFlow und wird oft als dessen Standard-API genutzt.

- MxNet: Ein weiteres Open-Source-Deep-Learning-Framework, das von AWS unterstützt wird. Es ist bekannt für seine Effizienz und Skalierbarkeit über mehrere GPUs und Maschinen hinweg. Gluon ist eine benutzerfreundliche API für MxNet, ähnlich wie Keras für TensorFlow.

Die Wahl des richtigen Frameworks hängt oft von den spezifischen Anforderungen des Projekts, der Teamerfahrung und den Präferenzen ab. Viele dieser Frameworks bieten mittlerweile auch Unterstützung für spezialisierte Hardware wie TPUs (Tensor Processing Units) von Google oder GPUs von Nvidia, um das Training von Deep Neural Networks weiter zu beschleunigen.

Praktisches Beispiel mit Keras: Einfache Bildklassifikation

Um die praktische Anwendung eines Deep Learning Frameworks zu illustrieren, betrachten wir ein einfaches Beispiel zur Bildklassifikation mit Keras und TensorFlow. Dieses Snippet zeigt, wie einfach es ist, ein Convolutional Neural Network (CNN) für eine grundlegende Aufgabe zu definieren und zu trainieren.

import tensorflow as tf

from tensorflow import keras

from tensorflow.keras import layers

# 1. Daten laden und vorbereiten (Beispiel: MNIST-Datensatz für Ziffernerkennung)

# MNIST ist ein Datensatz von handgeschriebenen Ziffern (0-9)

(x_train, y_train), (x_test, y_test) = keras.datasets.mnist.load_data()

# Daten normalisieren: Pixelwerte von [0, 255] auf [0, 1] skalieren

x_train = x_train.astype("float32") / 255.0

x_test = x_test.astype("float32") / 255.0

# Bilder auf das richtige Format für CNNs anpassen (Batch, Höhe, Breite, Kanäle)

# MNIST-Bilder sind 28x28 Graustufenbilder, also 1 Kanal

x_train = np.expand_dims(x_train, -1)

x_test = np.expand_dims(x_test, -1)

# 2. Modellarchitektur definieren (ein einfaches CNN)

model = keras.Sequential(

[

# Erste Faltungsschicht mit ReLU-Aktivierung und Max-Pooling

layers.Conv2D(32, kernel_size=(3, 3), activation="relu", input_shape=(28, 28, 1)),

layers.MaxPooling2D(pool_size=(2, 2)),

# Zweite Faltungsschicht

layers.Conv2D(64, kernel_size=(3, 3), activation="relu"),

layers.MaxPooling2D(pool_size=(2, 2)),

# Daten für die Dense-Schichten "flach" machen

layers.Flatten(),

# Vollständig verbundene (Dense) Schichten

layers.Dropout(0.5), # Regularisierung zur Vermeidung von Overfitting

layers.Dense(10, activation="softmax"), # Ausgabeschicht mit 10 Klassen (Ziffern 0-9)

]

)

# Modell kompilieren

model.compile(optimizer="adam", loss="sparse_categorical_crossentropy", metrics=["accuracy"])

# 3. Modell trainieren

print("nStarte Training des CNN-Modells...")

model.fit(x_train, y_train, batch_size=128, epochs=5, validation_split=0.1)

# 4. Modell evaluieren

print("nEvaluiere Modell auf Testdaten...")

score = model.evaluate(x_test, y_test, verbose=0)

print(f"Testverlust: {score[0]:.4f}")

print(f"Testgenauigkeit: {score[1]100:.2f}%")

# Beispiel einer Vorhersage

# index = 0

# plt.imshow(x_test[index].reshape(28, 28), cmap='gray')

# plt.title(f"Tatsächliche Ziffer: {y_test[index]}")

# plt.show()

# prediction = model.predict(np.expand_dims(x_test[index], axis=0))

# print(f"Vorhergesagte Ziffer: {np.argmax(prediction)}")

Dieses Keras-Beispiel demonstriert die Definition eines CNNs mit Faltungs- und Pooling-Schichten, gefolgt von vollständig verbundenen Schichten, um handgeschriebene Ziffern zu klassifizieren. Es ist ein klarer Beleg dafür, wie Deep Learning Frameworks Vergleich die Entwicklung komplexer KI-Modelle erheblich vereinfachen.

Ausblick und Weiterentwicklung von Deep Neural Networks

Deep Neural Networks haben sich als eine der mächtigsten Technologien unserer Zeit etabliert. Ihre Fähigkeit, aus komplexen und riesigen Datenmengen zu lernen und menschenähnliche Intelligenz in spezifischen Domänen zu demonstrieren, hat die Grenzen dessen, was wir von Computern erwarten können, neu definiert. Sie sind das Fundament für Fortschritte in der Bilderkennung, Sprachverarbeitung, personalisierten Empfehlungssystemen und der Automatisierung KI, die zunehmend in unseren Alltag integriert werden.

Die kontinuierliche Forschung und Entwicklung in diesem Bereich verspricht weitere bahnbrechende Innovationen, von effizienteren Trainingsmethoden bis hin zu noch komplexeren Architekturen. Für jeden, der sich für Technologie, Softwareentwicklung oder Ingenieurwesen begeistert, ist das Verständnis von Deep Neural Networks und Deep Learning unerlässlich, um die Zukunft mitzugestalten und die Möglichkeiten dieser spannenden Technologie voll auszuschöpfen. Entdecken Sie die spannende Welt der künstlichen Intelligenz und vertiefen Sie Ihr Wissen über Deep Learning Grundlagen und fortgeschrittene Anwendungen.

Möchten Sie tiefer in die Materie eintauchen und Ihre Fähigkeiten in diesem zukunftsweisenden Feld ausbauen? Dann laden wir Sie ein, sich weiter mit den Themen Künstliche Intelligenz für Entwickler und den praktischen Anwendungen von Mustererkennung Deep Learning zu beschäftigen. Ihr Feedback und Ihre Fragen sind uns wichtig – teilen Sie Ihre Gedanken in den Kommentaren oder erkunden Sie unsere anderen Expertenartikel.

Leave a Comment