In der Welt der Datenwissenschaft und des Machine Learnings ist das Verständnis von Beziehungen zwischen Variablen von fundamentaler Bedeutung. Die Korrelationsanalyse ist hierbei ein unverzichtbares statistisches Werkzeug, das Entwicklern, Studenten und Technologiebegeisterten hilft, Abhängigkeiten und Muster in Daten zu identifizieren. Sie ermöglicht es uns, nicht nur die Existenz einer Beziehung zu erkennen, sondern auch deren Stärke und Richtung zu quantifizieren.

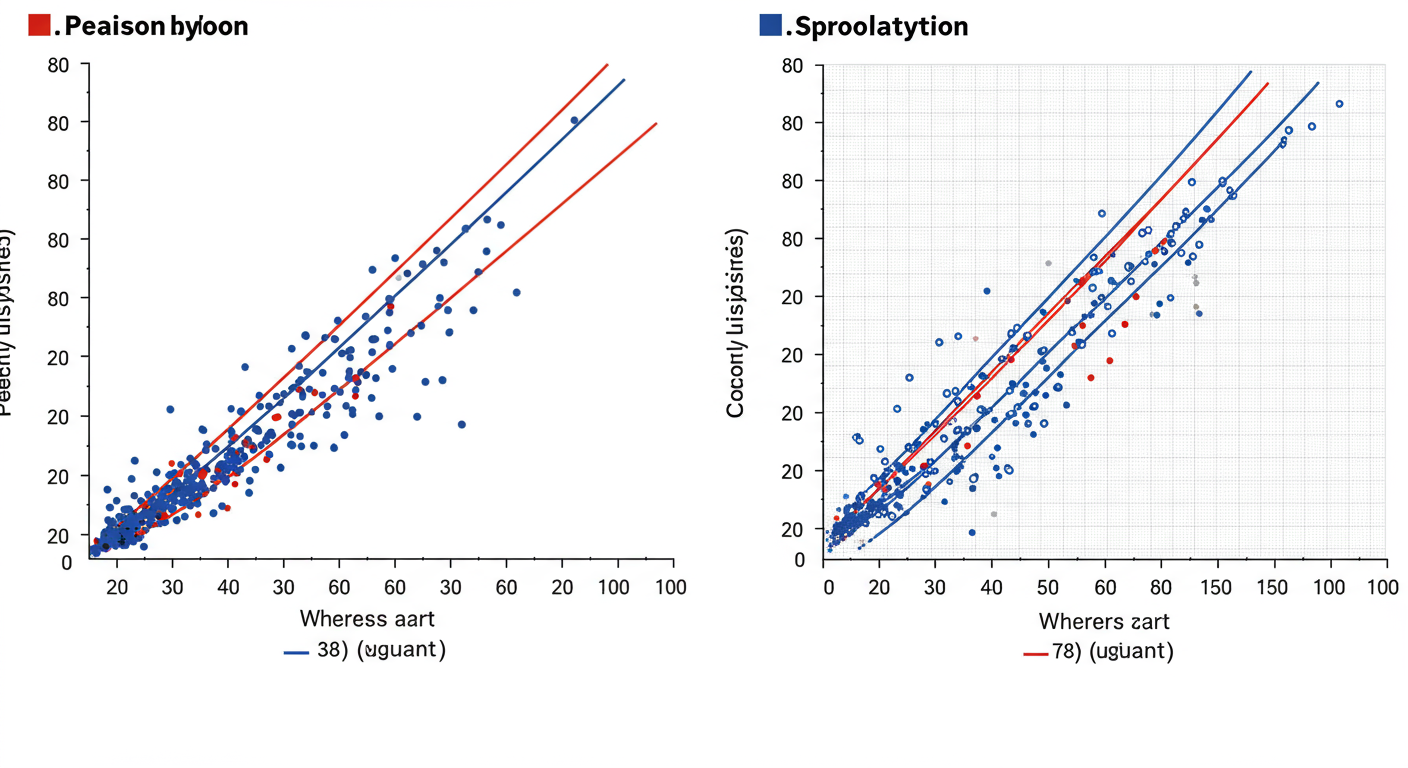

Dieser Blogbeitrag wird sich eingehend mit zwei der am häufigsten verwendeten Korrelationsmethoden befassen: der Pearson-Korrelation und der Spearman-Korrelation. Wir werden ihre mathematischen Grundlagen, die notwendigen Annahmen, Anwendungsbereiche und detaillierte Codebeispiele in Python beleuchten. Ziel ist es, ein umfassendes Verständnis dieser statistischen Analyse von Daten zu vermitteln, damit Sie fundierte Entscheidungen bei der Wahl der richtigen Methode für Ihre Datenanalyseaufgaben treffen können. Wir werden erläutern, wie diese Methoden zur Quantifizierung von Beziehungen zwischen Variablen verstehen helfen und welche Rolle sie in modernen Grundlagen der Datenwissenschaft spielen.

Grundlagen der Korrelationsanalyse im Machine Learning

Korrelation ist eine statistische Metrik, die das Ausmaß und die Richtung der linearen oder monotonen Beziehung zwischen zwei oder mehr Variablen beschreibt. Im Kontext von Machine Learning und Datenanalyse ist die Korrelation ein wichtiges Kennzeichen im Machine Learning, um die Beziehungen zwischen verschiedenen Merkmalen (Features) in einem Datensatz zu verstehen. Ein hohes Maß an Korrelation kann beispielsweise auf Redundanz zwischen Features hinweisen oder wichtige Erkenntnisse für das Feature Engineering liefern. Die Richtung einer Korrelation gibt an, ob die Variablen tendenziell zusammen (positive Korrelation) oder entgegengesetzt (negative Korrelation) variieren. Die Stärke, oft durch den Absolutwert des Korrelationskoeffizienten ausgedrückt, zeigt, wie eng diese Beziehung ist.

Bevor wir uns den spezifischen Methoden widmen, ist es entscheidend zu verstehen, dass Korrelation keine Kausalität impliziert. Nur weil zwei Variablen stark korreliert sind, bedeutet dies nicht, dass die eine die andere verursacht. Es zeigt lediglich eine gemeinsame Tendenz oder eine mögliche Abhängigkeit, die durch andere Faktoren bedingt sein könnte. Für eine effektive Datenanalyse ist es unerlässlich, die verschiedenen Arten von Korrelationen und ihre spezifischen Anwendungen zu kennen, insbesondere wenn es darum geht, Abhängigkeiten zwischen Variablen zu untersuchen und Vorhersagemodelle zu verbessern.

Die Pearson-Korrelation: Messung linearer Abhängigkeiten

Die Pearson-Korrelation, auch bekannt als Pearson-Produkt-Moment-Korrelationskoeffizient (PPMCC), misst die Stärke und Richtung einer linearen Beziehung zwischen zwei kontinuierlichen Variablen. Sie ist der am häufigsten verwendete Korrelationskoeffizient und wird mit dem Symbol $r$ bezeichnet. Der Wert von $r$ liegt immer zwischen -1 und 1.

Der Pearson-Korrelationskoeffizient ist besonders nützlich, wenn man die Stärke einer direkten, proportionalen Beziehung zwischen zwei Datensätzen bewerten möchte. Ein Wert nahe +1 deutet auf eine starke positive lineare Korrelation hin, bei der beide Variablen tendenziell zusammen ansteigen. Ein Wert nahe -1 weist auf eine starke negative lineare Korrelation hin, bei der eine Variable ansteigt, während die andere abnimmt. Ein Wert nahe 0 bedeutet, dass keine lineare Beziehung zwischen den Variablen besteht.

Mathematische Grundlagen und Formel der Pearson-Korrelation

Der Pearson-Korrelationskoeffizient $r$ wird berechnet als die Kovarianz der beiden Variablen geteilt durch das Produkt ihrer Standardabweichungen. Dies normalisiert die Kovarianz, sodass der Wert immer zwischen -1 und 1 liegt. Die Formel lautet:

$$ r = frac{sum_{i=1}^{n}(x_i – bar{x})(y_i – bar{y})}{sqrt{sum_{i=1}^{n}(x_i – bar{x})^2}sqrt{sum_{i=1}^{n}(y_i – bar{y})^2}} $$

Hierbei bedeuten:

- $n$: die Anzahl der Datenpunkte

- $x_i$: der Wert der $i$-ten Beobachtung der ersten Variable

- $y_i$: der Wert der $i$-ten Beobachtung der zweiten Variable

- $bar{x}$: der Mittelwert der ersten Variable

- $bar{y}$: der Mittelwert der zweiten Variable

Diese Formel quantifiziert, wie stark die Abweichungen der einzelnen Datenpunkte von ihrem jeweiligen Mittelwert miteinander variieren. Eine positive Kovarianz im Zähler bedeutet, dass $x_i – bar{x}$ und $y_i – bar{y}$ tendenziell das gleiche Vorzeichen haben, was auf eine positive Beziehung hindeutet. Umgekehrt bei einer negativen Kovarianz.

Annahmen für die Berechnung des Pearson-Koeffizienten

Bevor Sie die Pearson-Korrelation berechnen, müssen bestimmte Annahmen über Ihre Daten erfüllt sein, um die Gültigkeit der Ergebnisse zu gewährleisten:

- Zufällige Stichprobe: Die Daten sollten eine repräsentative Zufallsstichprobe aus der Grundgesamtheit sein.

- Quantitative (kontinuierliche) Variablen: Beide Variablen müssen auf Intervall- oder Verhältnisskala gemessen werden. Dies bedeutet, dass sie numerisch sind und eine Rangordnung sowie gleiche Abstände zwischen den Werten aufweisen.

- Gepaarte Daten: Jede $x$-Beobachtung muss eindeutig mit einer $y$-Beobachtung verbunden sein.

- Unabhängige Beobachtungen: Die Beobachtungen innerhalb der Stichprobe sollten voneinander unabhängig sein.

- Normalverteilung der Daten: Die Variablen sollten annähernd normalverteilt sein. Dies ist besonders wichtig für Hypothesentests, die auf dem Pearson-Koeffizienten basieren. Sie können dies visuell mit Histogrammen oder QQ-Plots oder statistisch mit Tests wie Shapiro-Wilk überprüfen.

- Lineare Beziehung: Zwischen den Variablen muss eine lineare Beziehung bestehen. Ein Scatter-Plot kann hier Aufschluss geben, ob die Datenpunkte einer geraden Linie folgen.

- Keine extremen Ausreißer: Ausreißer in linearen Beziehungen können den Pearson-Koeffizienten stark verzerren, da er auf Mittelwerten und Varianzen basiert. Eine visuelle Inspektion mit Scatter-Plots ist hier essenziell.

Die Nichtbeachtung dieser Annahmen kann zu irreführenden Ergebnissen führen. Insbesondere bei einer nicht-linearen oder nicht-normalverteilten Beziehung ist die Pearson-Korrelation möglicherweise nicht die beste Wahl zur Messung der Abhängigkeit.

Interpretation des Pearson-Korrelationskoeffizienten ($r$)

Der Wert des Korrelationskoeffizienten $r$ gibt Aufschluss über die Stärke und Richtung der linearen Abhängigkeit messen:

- $r$ nahe 1: Es besteht eine starke positive lineare Abhängigkeit. Wenn Variable X zunimmt, nimmt auch Variable Y tendenziell zu.

- $r$ nahe 0: Es besteht keine lineare Beziehung zwischen den Variablen. Dies bedeutet jedoch nicht unbedingt, dass überhaupt keine Beziehung existiert; es könnte eine nicht-lineare Beziehung vorliegen, die Pearson nicht erfassen kann.

- $r$ nahe -1: Es besteht eine starke negative lineare Abhängigkeit. Wenn Variable X zunimmt, nimmt Variable Y tendenziell ab.

Ein typisches Anwendungsbeispiel wäre die Untersuchung des Zusammenhangs zwischen der Anzahl der Unterrichtsstunden, die ein Student in Mathematik absolviert, und der erreichten Punktzahl in einem Mathematiktest. Wenn mehr Unterrichtsstunden in der Regel zu höheren Punktzahlen führen, würde dies eine positive Korrelation bedeuten.

Lassen Sie uns dies mit einem Python-Codebeispiel demonstrieren:

import numpy as np

import pandas as pd

from scipy.stats import pearsonr

import matplotlib.pyplot as plt

import seaborn as sns

# Beispiel-Datensatz: Anzahl der Lernstunden und Testpunktzahl

# Annahme: Kontinuierliche, numerische Daten, die eine lineare Beziehung haben könnten.

lernstunden = np.array([5, 6, 7, 8, 9, 10, 11, 12, 13, 14, 15, 16, 17, 18, 19, 20])

testpunktzahl = np.array([60, 65, 70, 72, 75, 78, 80, 83, 85, 88, 90, 92, 95, 96, 98, 100])

# Erstellen eines Pandas DataFrame zur besseren Handhabung

data = pd.DataFrame({

'Lernstunden': lernstunden,

'Testpunktzahl': testpunktzahl

})

# 1. Visuelle Überprüfung der Linearität mit einem Scatter Plot

plt.figure(figsize=(8, 6))

sns.scatterplot(x='Lernstunden', y='Testpunktzahl', data=data)

plt.title('Scatter Plot von Lernstunden vs. Testpunktzahl')

plt.xlabel('Lernstunden pro Woche')

plt.ylabel('Testpunktzahl (0-100)')

plt.grid(True)

plt.show()

# 2. Berechnung der Pearson-Korrelation mit NumPy

pearson_coeff_np = np.corrcoef(lernstunden, testpunktzahl)[0, 1]

print(f"Pearson-Korrelationskoeffizient (NumPy): {pearson_coeff_np:.4f}")

# 3. Berechnung der Pearson-Korrelation mit SciPy (liefert auch p-Wert)

pearson_coeff_scipy, p_value = pearsonr(lernstunden, testpunktzahl)

print(f"Pearson-Korrelationskoeffizient (SciPy): {pearson_coeff_scipy:.4f}")

print(f"P-Wert (SciPy): {p_value:.4f}")

# 4. Berechnung der Pearson-Korrelation mit Pandas (für DataFrame)

pearson_coeff_pd = data['Lernstunden'].corr(data['Testpunktzahl'], method='pearson')

print(f"Pearson-Korrelationskoeffizient (Pandas): {pearson_coeff_pd:.4f}")

# Interpretation

if pearson_coeff_pd > 0.7:

print("Es besteht eine sehr starke positive lineare Korrelation.")

elif pearson_coeff_pd > 0.3:

print("Es besteht eine moderate positive lineare Korrelation.")

elif pearson_coeff_pd > -0.3:

print("Es besteht keine oder eine sehr schwache lineare Korrelation.")

elif pearson_coeff_pd > -0.7:

print("Es besteht eine moderate negative lineare Korrelation.")

else:

print("Es besteht eine sehr starke negative lineare Korrelation.")

# Überprüfung der Normalverteilungsannahme (optional, aber empfohlen für Pearson)

# Kleine Stichproben machen es schwer, Normalität zu bestätigen.

# Hier nur zur Demonstration

from scipy.stats import shapiro

stat_x, p_x = shapiro(lernstunden)

stat_y, p_y = shapiro(testpunktzahl)

print(f"nShapiro-Wilk Test für Lernstunden: Statistik={stat_x:.3f}, p={p_x:.3f}")

print(f"Shapiro-Wilk Test für Testpunktzahl: Statistik={stat_y:.3f}, p={p_y:.3f}")

if p_x > 0.05 and p_y > 0.05:

print("Beide Variablen scheinen normalverteilt zu sein (nicht signifikant von Normalverteilung abweichend).")

else:

print("Mindestens eine Variable weicht signifikant von der Normalverteilung ab.")

Dieses Beispiel zeigt, wie man mit Python und den Bibliotheken NumPy, SciPy und Pandas die Pearson-Korrelation berechnet und die Ergebnisse interpretiert. Der P-Wert von SciPy hilft dabei, die statistische Signifikanz der Korrelation zu beurteilen. Ein kleiner P-Wert (z.B. < 0.05) deutet darauf hin, dass die beobachtete Korrelation wahrscheinlich nicht zufällig ist.

Die Pearson-Korrelation ist ideal, wenn eine klare lineare Beziehung erwartet wird und die Daten annähernd normalverteilt sind. Sie ist ein Eckpfeiler der deskriptiven Statistik und des Feature Engineering Machine Learning.

Die Spearman-Korrelation: Analyse monotoner Beziehungen

Die Spearman-Korrelation, auch bekannt als Spearman’s Rho ($rho$), ist eine nicht-parametrische Methode zur Messung der Stärke und Richtung einer monotonen Beziehung zwischen zwei Variablen. Im Gegensatz zur Pearson-Korrelation, die eine lineare Beziehung voraussetzt, erfasst die Spearman-Korrelation sowohl lineare als auch nicht-lineare monotone Beziehungen. Dies macht sie besonders robust gegenüber Ausreißern in Daten und Abweichungen von der Normalverteilung.

Die Kernidee der Spearman-Korrelation besteht darin, die tatsächlichen Datenwerte durch ihre Ränge zu ersetzen. Anstatt die Rohwerte zu verwenden, ordnet man jedem Wert seinen Rang innerhalb des Datensatzes zu (z.B. der kleinste Wert erhält Rang 1, der zweitkleinste Rang 2, usw.). Anschließend wird der Pearson-Korrelationskoeffizient auf diese Ränge angewendet. Dies ermöglicht es, monotone Beziehungen analysieren zu können, selbst wenn diese nicht perfekt linear sind.

Bestimmung der Ränge und die Spearman-Formel

Das Bestimmen der Ränge ist ein kritischer Schritt. Bei gleichen Werten (Ties) erhalten diese den Durchschnitt der Ränge, die sie sonst eingenommen hätten. Ein Beispiel für die Bestimmung der Datenränge:

- Originalwerte: [58, 70, 40, 58, 65]

- Sortierte Werte: [40, 58, 58, 65, 70]

- Ränge:

- 40 -> Rang 1

- 58 -> Die beiden 58er wären Rang 2 und 3. Ihr Durchschnitt ist (2+3)/2 = 2.5. Also erhalten beide 58er den Rang 2.5.

- 65 -> Rang 4

- 70 -> Rang 5

- Rangdaten: [2.5, 5, 1, 2.5, 4]

Die Formel für den Spearman-Rangkorrelationskoeffizienten $rho$ (rho) lautet:

$$ rho = 1 – frac{6 sum d_i^2}{n(n^2 – 1)} $$

Hierbei bedeuten:

- $n$: die Anzahl der Datenpunkte

- $d_i$: die Differenz der Ränge der $i$-ten Beobachtung für die beiden Variablen ($Rank(x_i) – Rank(y_i)$)

- $sum d_i^2$: die Summe der quadrierten Rangdifferenzen

Diese Formel ist eine vereinfachte Version, die ohne spezielle Anpassungen verwendet werden kann, wenn keine gleichen Ränge (Ties) in den Daten vorliegen. Bei vorhandenen Ties ist es genauer, den Pearson-Koeffizienten auf die Ränge anzuwenden, was die meisten Statistiksoftware- und Bibliotheksfunktionen automatisch tun.

Annahmen für die Berechnung des Spearman-Koeffizienten

Auch für die Spearman-Korrelation gibt es Annahmen, die erfüllt sein sollten:

- Zufällige Stichprobe: Die Daten stammen aus einer zufälligen Stichprobe.

- Monotone Beziehung: Es muss eine monotone Beziehung zwischen den Variablen bestehen. Das bedeutet, dass die Variablen entweder tendenziell zusammen ansteigen (positive Monotonie) oder eine Variable ansteigt, während die andere tendenziell abnimmt (negative Monotonie), aber nicht unbedingt in einem konstanten Verhältnis. Eine visuelle Inspektion per Scatter-Plot ist auch hier sehr hilfreich.

- Gepaarte Daten: Jede $x$-Beobachtung muss mit einer $y$-Beobachtung verbunden sein.

- Unabhängige Beobachtungen: Die Beobachtungen innerhalb der Stichprobe sind voneinander unabhängig.

- Variablen sind ordinal oder kontinuierlich: Die Variablen können auf Ordinalskala gemessen sein (z.B. Rankings, Zufriedenheitsstufen) oder kontinuierlich sein. Die Normalverteilung ist hier keine Voraussetzung.

Die Rangtransformation von Daten und die Anwendung der Spearman-Korrelation ist eine hervorragende Methode, um die Robustheit gegenüber nicht-normalverteilten Daten oder extremen Ausreißern in Daten zu erhöhen.

Anwendungsbeispiel der Spearman-Korrelation

Ein klassisches Anwendungsbeispiel für die Spearman-Korrelation ist die Untersuchung der Beziehung zwischen Konsumentenpräferenzen (z.B. Ranking von Produkten) und dem Preis. Wenn Konsumenten trotz steigendem Preis weiterhin tendenziell ein höheres Ranking für bestimmte Produkte vergeben, auch wenn die Beziehung nicht linear ist, kann dies mit Spearman erfasst werden. Ebenso bei der Analyse von Bildungsabschlüssen (ordinal) und dem späteren Einkommen (kontinuierlich), wo keine Normalverteilung oder Linearität gewährleistet ist.

Hier ist ein Python-Beispiel, das die Berechnung der Spearman-Korrelation demonstriert:

import numpy as np

import pandas as pd

from scipy.stats import spearmanr

import matplotlib.pyplot as plt

import seaborn as sns

# Beispiel-Datensatz: Konsumentenbewertung (ordinal) und Produktpreis (kontinuierlich)

# Hier könnten wir auch Daten mit Ausreißern oder nicht-linearer, aber monotoner Beziehung verwenden.

produkt_ranking = np.array([1, 2, 3, 4, 5, 6, 7, 8, 9, 10]) # 1=bestes Produkt, 10=schlechtestes

produkt_preis = np.array([50, 45, 60, 40, 70, 35, 80, 30, 90, 25]) # Hypothetische Preise

# Erstellen eines Pandas DataFrame

data_spearman = pd.DataFrame({

'ProduktRanking': produkt_ranking,

'ProduktPreis': produkt_preis

})

# 1. Visuelle Überprüfung der monotonen Beziehung mit einem Scatter Plot

plt.figure(figsize=(8, 6))

sns.scatterplot(x='ProduktRanking', y='ProduktPreis', data=data_spearman)

plt.title('Scatter Plot von Produkt-Ranking vs. Produktpreis')

plt.xlabel('Produkt-Ranking (1=beste, 10=schlechteste)')

plt.ylabel('Produktpreis (€)')

plt.grid(True)

plt.show()

# 2. Berechnung der Spearman-Korrelation mit SciPy

spearman_coeff_scipy, p_value_spearman = spearmanr(produkt_ranking, produkt_preis)

print(f"Spearman-Korrelationskoeffizient (SciPy): {spearman_coeff_scipy:.4f}")

print(f"P-Wert (SciPy): {p_value_spearman:.4f}")

# 3. Berechnung der Spearman-Korrelation mit Pandas

spearman_coeff_pd = data_spearman['ProduktRanking'].corr(data_spearman['ProduktPreis'], method='spearman')

print(f"Spearman-Korrelationskoeffizient (Pandas): {spearman_coeff_pd:.4f}")

# Interpretation der Spearman-Korrelation

if spearman_coeff_pd < -0.7:

print("Es besteht eine sehr starke negative monotone Korrelation: Höhere Ränge (schlechtere Produkte) sind tendenziell mit niedrigeren Preisen verbunden.")

elif spearman_coeff_pd 0.3:

print("Es besteht eine moderate positive monotone Korrelation.")

elif spearman_coeff_pd > 0.7:

print("Es besteht eine sehr starke positive monotone Korrelation.")

else:

print("Es besteht keine oder eine sehr schwache monotone Korrelation.")

# Demonstration der Rangtransformation und anschließende Pearson-Berechnung (manuell)

# Dies ist die interne Logik von Spearman, aber SciPy und Pandas machen es einfacher.

rank_produkt_ranking = data_spearman['ProduktRanking'].rank()

rank_produkt_preis = data_spearman['ProduktPreis'].rank()

pearson_on_ranks, _ = pearsonr(rank_produkt_ranking, rank_produkt_preis)

print(f"nPearson-Korrelation auf Rängen (manuell): {pearson_on_ranks:.4f}")

Das Beispiel zeigt eine starke negative Spearman-Korrelation: Je schlechter das Produkt-Ranking (höhere Zahl), desto niedriger der Preis. Dies deutet darauf hin, dass die Verbraucher tendenziell teurere Produkte besser bewerten, auch wenn die Beziehung nicht exakt linear ist. Die Spearman-Korrelation ist ein mächtiges Werkzeug für die nicht-parametrische Korrelationsanalyse.

Pearson vs. Spearman: Die richtige Korrelationsmethode wählen

Die Entscheidung, ob die Pearson- oder die Spearman-Korrelation anzuwenden ist, hängt stark von der Natur Ihrer Daten und der Art der Beziehung ab, die Sie untersuchen möchten. Beide Koeffizienten messen unterschiedliche Aspekte von Abhängigkeiten und haben spezifische Stärken und Schwächen. Ein fundiertes Verständnis der Unterschiede ist entscheidend für eine präzise Interpretation von Korrelationsergebnissen und die Vermeidung von Fehlinterpretationen in der Datenintegration effizient gestalten.

| Merkmal | Pearson-Korrelation | Spearman-Korrelation |

|---|---|---|

| Art der Beziehung | Lineare Beziehung | Monotone (lineare oder nicht-lineare) Beziehung |

| Datentypen | Kontinuierlich (Intervall/Verhältnis) | Ordinal oder kontinuierlich |

| Verteilungsannahme | Normalverteilung (für Variablen oder deren Residuen) | Keine spezifische Verteilungsannahme erforderlich |

| Sensibilität gegenüber Ausreißern | Sehr sensitiv | Weniger sensitiv (robust) |

| Grundlage der Berechnung | Rohdaten (Kovarianz der Werte) | Ränge der Daten |

| Anwendungsfälle | Prüfung auf direkte, proportionale Zusammenhänge (z.B. Größe vs. Gewicht) | Prüfung auf allgemeine Tendenz des Zusammenhangs, bei ordinalen Daten oder Ausreißern (z.B. Ranking vs. Zufriedenheit) |

| Statistische Power | Höher bei erfüllten Annahmen (Linearität, Normalität) | Etwas geringer als Pearson bei streng linear verteilten Daten, aber robuster bei Verletzung der Annahmen |

Wie die Tabelle zeigt, ist die Pearson-Korrelation die Wahl der Stunde, wenn Sie explizit eine lineare Beziehung zwischen kontinuierlichen und normalverteilten Daten suchen. Wenn Sie jedoch mit ordinalen Daten arbeiten, eine monotone, aber nicht notwendigerweise lineare Beziehung untersuchen oder wenn Ihre Daten viele Ausreißer enthalten oder nicht normalverteilt sind, ist die Spearman-Korrelation die überlegene Methode. Sie bietet eine robuste Alternative, die die zugrunde liegende Struktur der Beziehung besser widerspiegeln kann, ohne durch extreme Werte verzerrt zu werden.

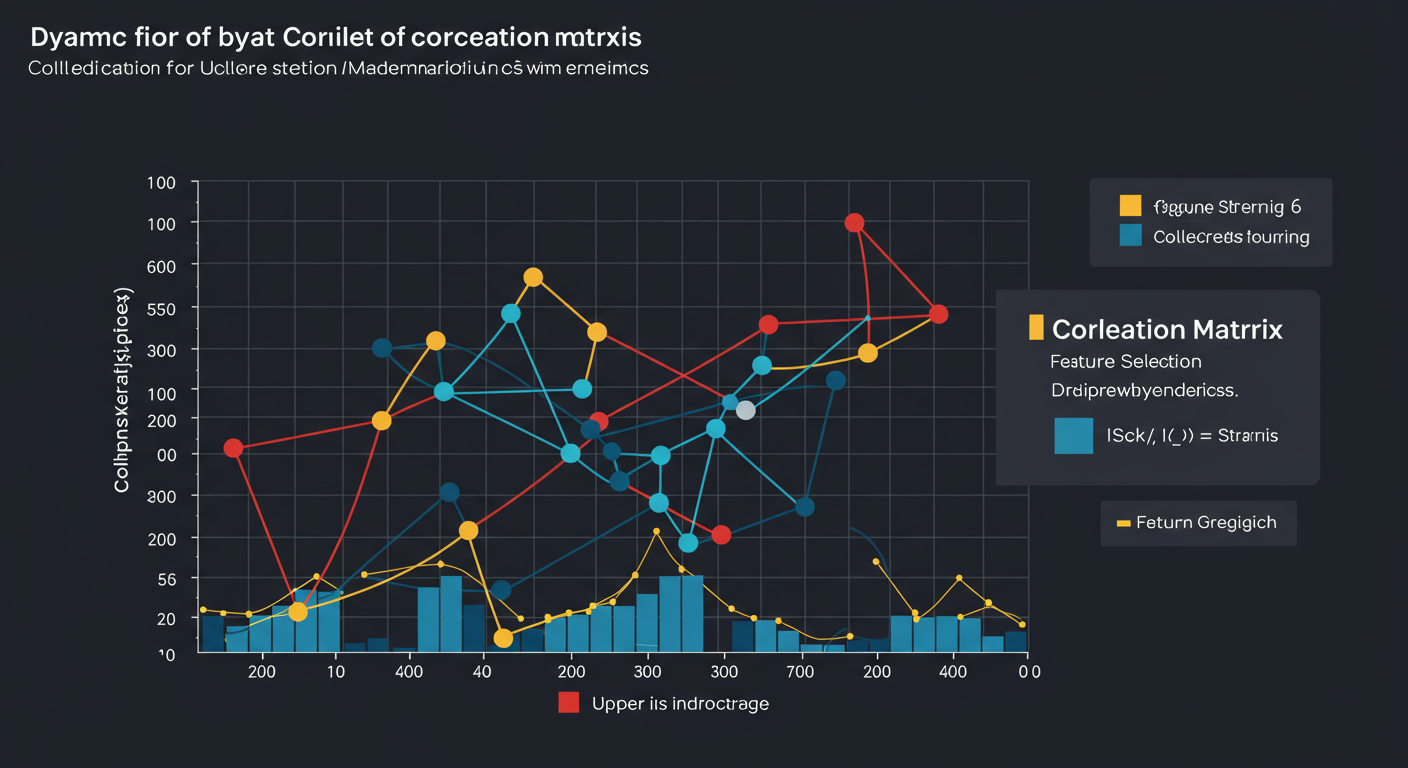

Korrelationen im Kontext von Machine Learning

Im Bereich des Machine Learnings sind Korrelationsmatrizen, die die Korrelationskoeffizienten zwischen allen Paaren von Features in einem Datensatz enthalten, ein wichtiges Werkzeug. Sie helfen Data Scientists und Entwicklern, potenzielle Probleme und Chancen zu identifizieren:

- Feature Selection: Stark mit dem Ziel-Feature korrelierte Features können gute Prädiktoren sein. Stark untereinander korrelierte Features (Multikollinearität) können in einigen Modellen (z.B. lineare Regression) Probleme verursachen und müssen möglicherweise entfernt oder kombiniert werden.

- Dimensionalitätsreduktion: Das Erkennen hochkorrelierter Features kann Hinweise darauf geben, welche Features reduziert oder durch Hauptkomponenten ersetzt werden können.

- Datenverständnis: Eine Korrelationsmatrix liefert einen schnellen Überblick über die internen Beziehungen in einem Datensatz und fördert das tiefergehende Datenverständnis für Entwickler.

Die Entwicklerleitfaden für Korrelation muss daher beide Methoden umfassen und eine klare Anleitung zur Auswahl basierend auf den Datencharakteristika geben. Das Verständnis der Nuancen zwischen diesen Korrelationsmaßen ist entscheidend, um präzise und aussagekräftige Vorhersagemodelle zu entwickeln und zu optimieren.

Fazit: Die Bedeutung von Korrelationsmethoden in der modernen Datenwissenschaft

Die Pearson- und Spearman-Korrelation sind zwei grundlegende, aber unterschiedliche Korrelationsmaße, die in spezifischen Situationen angewendet werden. Die Wahl der richtigen Methode ist entscheidend für die Gültigkeit und Aussagekraft Ihrer Analysen in der tiefergehenden Datenanalyse verstehen. Während Pearson lineare Beziehungen in normalverteilten, kontinuierlichen Daten detektiert, ist Spearman robust gegenüber Ausreißern und erfasst monotone Beziehungen bei ordinalen oder kontinuierlichen Variablen.

Ein fundiertes Wissen über diese statistischen Werkzeuge ist für jeden, der sich mit Datenanalyse oder Machine Learning beschäftigt, unerlässlich. Es ermöglicht nicht nur das bessere Verständnis von Datensätzen, sondern auch die Verbesserung der Modellleistung und die Ableitung valider Schlussfolgerungen. Vertiefen Sie Ihre Kenntnisse in der Datenwissenschaft, um die volle Bandbreite dieser und weiterer statistischer Werkzeuge für Machine Learning zu meistern.

Wir hoffen, dieser Artikel hat Ihnen geholfen, die Pearson- und Spearman-Korrelation umfassend zu verstehen. Wenn Sie tiefer in die Materie eintauchen oder Ihre Fähigkeiten in der Datenwissenschaft ausbauen möchten, sollten Sie unsere spezialisierten Data Scientist und Data Analyst Schulungen in Betracht ziehen. Diese Kurse bieten praktische Einblicke und Anwendungen, die Ihnen helfen, diese Konzepte in realen Szenarien anzuwenden.

Ganz ehrlich, bei diesem Thema – Pearson und Spearman Korrelation – frage ich mich, warum man hier noch einen Blogpost drüber schreiben muss, wenn es **Kaggle Learn** schon so viel besser macht. Euer Beitrag *erklärt* zwar, aber Kaggle lässt einen die Konzepte *erleben*! Dort gibt es nicht nur Codebeispiele, sondern interaktive Notebooks, in denen man die Korrelationen direkt anwenden und mit echten Datensätzen experimentieren kann. Das ist ein gigantischer Vorteil gegenüber bloßem Text und ein paar statischen Code-Schnipseln. Wer wirklich verstehen will, wie man diese Methoden in der Praxis einsetzt, und nicht nur eine trockene Theorie abarbeiten will, der geht direkt zu Kaggle. Da bekommt man ein viel tieferes, praxisorientiertes Verständnis, als nur einen weiteren Blogpost zu lesen, der im Grunde nur das Offensichtliche wiederholt.

Ich danke ihnen für ihren wertvollen kommentar.