Im Bereich der künstlichen Intelligenz und insbesondere des Natural Language Processing (NLP) hat die Veröffentlichung von BERT im Oktober 2018 durch Google AI einen Wendepunkt markiert. Dieses Deep-Learning-Modell, dessen Akronym für Bidirectional Encoder Representations from Transformers steht, revolutionierte die Art und Weise, wie Computer menschliche Sprache verstehen und verarbeiten. Seit seiner Einführung hat BERT als vortrainiertes Modell nicht nur die Aufmerksamkeit der Data-Science-Community auf sich gezogen, sondern auch „State-of-the-Art“-Ergebnisse für eine Vielzahl von NLP-Aufgaben geliefert. Es hat die Messlatte für die maschinelle Sprachverarbeitung höher gelegt und in vielen Bereichen menschliche Leistungen übertroffen.

Dieser detaillierte Blogbeitrag richtet sich an Entwickler, Studierende und Technologiebegeisterte, die ein tiefgehendes Verständnis für die Funktionsweise und die praktische Anwendung von BERT entwickeln möchten. Wir werden die evolutionären Schritte der Textsequenzanalyse vor BERT beleuchten, die bahnbrechenden Konzepte von BERT wie das Masked Language Model (MLM) und die Transformer-Architektur detailliert erläutern und praktische Codebeispiele zur Tokenisierung von Wörtern und zur Integration von BERT-Modellen bereitstellen. Zudem werden wir diskutieren, wie Transfer Learning in NLP durch BERT maßgeblich verbessert wurde und welche vielfältigen Anwendungsfälle es ermöglicht.

BERT verstehen: Eine Revolution in NLP

Die Fähigkeit von Computern, menschliche Sprache zu verstehen und zu interpretieren, ist eine der größten Herausforderungen und gleichzeitig ein zentrales Ziel der künstlichen Intelligenz. Das Feld des Natural Language Processing (NLP) befasst sich genau mit dieser Schnittstelle. Vor der Einführung von Modellen wie BERT waren viele Ansätze zur Sprachverarbeitung durch inhärente Einschränkungen gekennzeichnet, die vor allem das Verständnis des vollständigen Kontexts eines Satzes betrafen. BERT überwindet diese Limitierungen durch seine innovative Architektur und Lernmethode und stellt somit einen signifikanten Fortschritt dar.

Die Welt vor BERT: Unidirektionale Ansätze

Bevor BERT die Bühne betrat, waren traditionelle Sprachmodelle oft auf unidirektionale Ansätze beschränkt. Dies bedeutete, dass ein Modell Textsequenzen entweder von links nach rechts (vorwärts) oder von rechts nach links (rückwärts) verarbeitete, aber nicht beide Richtungen gleichzeitig berücksichtigen konnte. Beliebte Architekturen wie Rekurrente Neuronale Netze (RNNs) und Long Short-Term Memory (LSTMs) waren hier die Norm.

Nehmen wir das klassische Beispiel der Satzvervollständigung: „Die Person geht in den Supermarkt und kauft eine ____ mit Schuhen.“ Für einen Menschen ist die Lücke offensichtlich mit „Paar“ zu füllen, da der Kontext von „Schuhen“ das Wort „Paar“ impliziert. Ein unidirektionales Modell, das von links nach rechts liest, würde das Wort „Schuhe“ jedoch erst viel später in der Sequenz sehen. Es müsste das Wort in der Lücke allein auf der Basis der vorhergehenden Wörter „kauft eine“ vorhersagen. Dies führt oft zu weniger präzisen oder semantisch unpassenden Vorhersagen, wie „Caddie“ oder „Koffer“, die im weiteren Kontext von „Schuhen“ keinen Sinn ergeben.

Um die Funktionsweise zu verdeutlichen, hier ein stark vereinfachtes, konzeptuelles Beispiel, das die Limitation eines unidirektionalen Modells zur Wortvorhersage illustriert:

import numpy as np

# Ein sehr rudimentäres Vokabular und einfache Wahrscheinlichkeiten

vocabulary = {"Die": 0, "Person": 1, "geht": 2, "in": 3, "den": 4,

"Supermarkt": 5, "und": 6, "kauft": 7, "eine": 8,

"____": 9, "mit": 10, "Schuhen": 11, "Paar": 12,

"Tasche": 13, "Koffer": 14}

# Simulierte Wahrscheinlichkeiten basierend auf vorherigem Wort

# In Realität viel komplexer mit neuronalen Netzen

def predict_next_word_unidirectional(previous_word_index):

# Beispielhaft: nach "eine" könnten "Paar", "Tasche", "Koffer" folgen

if previous_word_index == vocabulary["eine"]:

# "Paar" ist am wahrscheinlichsten, aber andere sind auch möglich

probabilities = {"Paar": 0.7, "Tasche": 0.2, "Koffer": 0.1}

# Hier könnte ein Modell auch durch Zufall oder unzureichenden Kontext zu "Koffer" neigen

return np.random.choice(list(probabilities.keys()), p=list(probabilities.values()))

else:

return "unbekannt"

# Simulieren der Vorhersage für die Lücke

previous_word = "eine"

predicted_word = predict_next_word_unidirectional(vocabulary[previous_word])

print(f"Vorhersage für die Lücke nach '{previous_word}': {predicted_word}")

# Ohne den Kontext von "Schuhen" kann die Vorhersage variieren

# Auch wenn "Paar" die höchste Wahrscheinlichkeit hat, ist sie nicht garantiert korrekt

# und das Modell weiß nichts vom späteren Kontext.

Dieses Beispiel unterstreicht, dass das Fehlen eines ganzheitlichen Kontextverständnisses die Genauigkeit und Robustheit von Maschinelles Lernen Algorithmus in NLP-Anwendungen erheblich einschränkte.

Die innovative BERT-Methode: Bidirektionalität und Masked LM

BERT bricht mit dem unidirektionalen Paradigma, indem es einen bidirektionalen Ansatz verfolgt. Es steht für Bidirectional Encoder Representations from Transformers. Das Herzstück dieser Methode sind zwei primäre vortrainierte Aufgaben: das Masked Language Model (MLM) und die Next Sentence Prediction (NSP).

Das MLM ist der Schlüssel zum bidirektionalen Verständnis. Anstatt das nächste Wort in einer Sequenz vorherzusagen, maskiert BERT zufällig einen kleinen Prozentsatz der Wörter (üblicherweise 15%) im Eingabetext und versucht dann, diese maskierten Wörter auf der Grundlage ihres gesamten Kontexts – sowohl der Wörter links als auch der Wörter rechts vom maskierten Wort – vorherzusagen. Dieser Prozess zwingt das Modell, ein tiefes Verständnis für die Beziehungen zwischen den Wörtern und den gesamten Satzkontext zu entwickeln.

„Das revolutionäre an BERT ist seine Fähigkeit, den Kontext eines Wortes aus beiden Richtungen – links und rechts – gleichzeitig zu erfassen, was zu einem unübertroffenen Sprachverständnis führt.“

Die Next Sentence Prediction (NSP) ist die zweite wichtige vortrainierte Aufgabe. Sie hilft dem Modell, die Beziehung zwischen zwei Sätzen zu verstehen. Dem Modell werden zwei Sätze als Eingabe gegeben (Sentence A und Sentence B), und es muss vorhersagen, ob Sentence B tatsächlich der nächste Satz nach Sentence A im Originaltext ist oder ob es ein zufällig ausgewählter Satz ist. Diese Aufgabe ist entscheidend für Anwendungen wie Frage-Antwort-Systeme und Textzusammenfassungen, bei denen das Verständnis von Satzbeziehungen unerlässlich ist.

Um das Prinzip des Masked Language Model zu verdeutlichen, hier ein Python-Beispiel, das konzeptuell zeigt, wie Wörter maskiert werden:

import random

def apply_masking(sentence, mask_token="[MASK]", mask_probability=0.15):

words = sentence.split()

masked_words = list(words)

num_words_to_mask = max(1, int(len(words) mask_probability)) # Mindestens ein Wort maskieren

# Zufällige Indizes für die Maskierung auswählen

indices_to_mask = random.sample(range(len(words)), num_words_to_mask)

original_masked_words = []

for i in indices_to_mask:

original_masked_words.append(masked_words[i])

masked_words[i] = mask_token

return " ".join(masked_words), original_masked_words

# Beispielanwendung

original_sentence = "Die Person geht in den Supermarkt und kauft ein Paar mit Schuhen."

masked_sentence, masked_tokens = apply_masking(original_sentence)

print(f"Originalsatz: {original_sentence}")

print(f"Maskierter Satz: {masked_sentence}")

print(f"Maskierte Token (zum Vorhersagen): {masked_tokens}")

# Ein BERT-Modell würde dann versuchen, "[MASK]" basierend auf dem gesamten Kontext vorherzusagen.

Dieses bidirektionale Lernen ermöglicht es BERT, tiefere und kontextreichere Repräsentationen von Wörtern und Sätzen zu lernen, was es den traditionellen unidirektionalen Modellen weit überlegen macht.

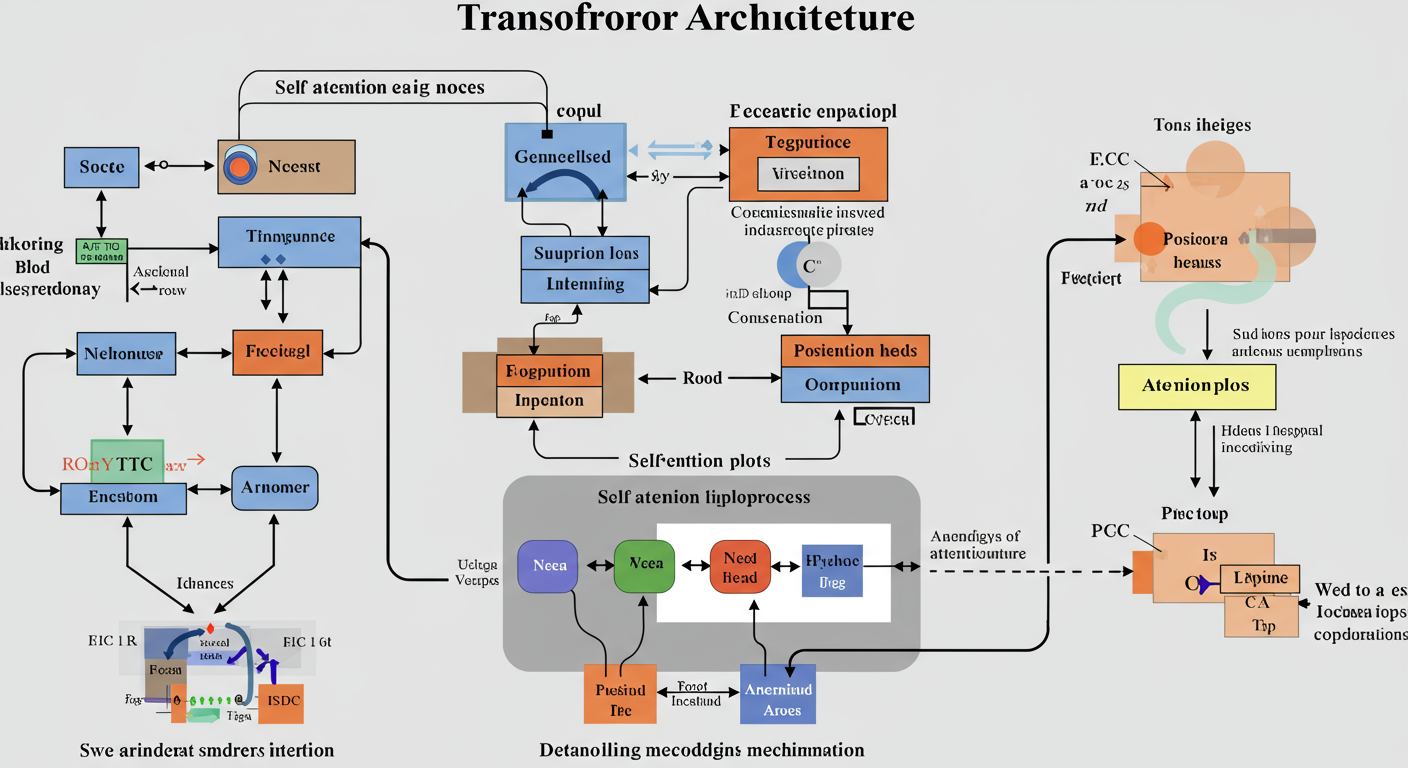

Technischer Aufbau: Transformer-Architektur und Self-Attention

Die Grundlage von BERT ist die revolutionäre Transformer-Architektur, die ursprünglich 2017 von Google in dem Papier „Attention Is All You Need“ vorgestellt wurde. Im Gegensatz zu RNNs und LSTMs, die sequentielle Verarbeitungswege nutzen, ermöglicht der Transformer eine parallele Verarbeitung von Worten in einer Sequenz, was zu einer erheblichen Beschleunigung des Trainings führt und längere Abhängigkeiten besser erfassen kann.

Ein Transformer besteht traditionell aus einem Encoder-Stack und einem Decoder-Stack. BERT jedoch beschränkt sich auf den Encoder-Teil des Transformers. Der Grund dafür ist, dass BERT primär darauf abzielt, ein robustes Sprachrepräsentationsmodell zu erstellen, das Sprache versteht, anstatt sie zu generieren (was die Aufgabe eines Decoders wäre). Der Encoder-Stack von BERT besteht aus mehreren identischen Schichten, die jeweils einen Multi-Head Self-Attention-Mechanismus und ein Feed-Forward-Netzwerk enthalten.

Der Kern des Transformers ist der Self-Attention Mechanismus. Er erlaubt es dem Modell, die Wichtigkeit verschiedener Wörter in einem Satz relativ zueinander zu gewichten, um die Bedeutung eines bestimmten Wortes zu erfassen. Nehmen wir den Satz: „Hast du eine neue Maus für deinen Computer?“ Um die Bedeutung von „Maus“ (das Objekt und nicht das Tier) korrekt zu interpretieren, wird der Self-Attention-Mechanismus dem Wort „Computer“ eine hohe Gewichtung geben, da es den entscheidenden Kontext liefert. Dieser Mechanismus berechnet drei Vektoren für jedes Wort: Query (Q), Key (K) und Value (V). Die Attention-Scores werden berechnet, indem Q mit K multipliziert wird, durch die Wurzel der Dimensionalität der Keys dividiert und Softmax angewendet wird, um Wahrscheinlichkeiten zu erhalten. Diese Wahrscheinlichkeiten werden dann mit V multipliziert.

Ein weiterer wichtiger Bestandteil ist das Positional Encoding. Da der Transformer keine Rekurrenz verwendet, verliert er die sequentielle Information der Wörter. Positional Encoding fügt den Worteinbettungen Informationen über die relative oder absolute Position der Token im Satz hinzu, sodass das Modell die Reihenfolge der Wörter verstehen kann.

Hier ist eine vereinfachte Tabelle, die die Kernkomponenten des BERT-Encoders hervorhebt:

| Komponente | Funktion |

|---|---|

| Input Embeddings | Token-Embeddings, Segment-Embeddings (für Satzpaare), Positional Embeddings |

| Transformer Encoder Block | Mehrere identische Schichten, die den Kern des Modells bilden |

| Multi-Head Self-Attention | Erfasst Beziehungen zwischen Wörtern im Satz, unabhängig von ihrer Position |

| Feed-Forward Network | Eine vollkontaktierte Neuronale Netwerk-Schicht, die nach der Attention-Schicht angewendet wird |

| Residual Connections & Layer Normalization | Stabilisiert das Training und verbessert die Informationsweitergabe |

Die Kombination dieser Elemente ermöglicht es BERT, hochkomplexe Sprachmuster zu erkennen und den Kontext auf eine Weise zu verarbeiten, die zuvor undenkbar war. Die Transformer-Architektur ist das Fundament für die überragende Leistungsfähigkeit von BERT bei vielen NLP-Aufgaben.

BERT in der Praxis anwenden

Die Stärke von BERT liegt nicht nur in seinem innovativen Design, sondern auch in seiner Benutzerfreundlichkeit für Entwickler. Dank Bibliotheken wie Hugging Face Transformers ist die Integration und Feinabstimmung von BERT-Modellen relativ geradlinig geworden. Bevor man jedoch mit der Feinabstimmung oder der Verwendung für Vorhersagen beginnen kann, sind bestimmte Schritte zur Datenaufbereitung und Modellintegration unerlässlich.

Datenaufbereitung für BERT

Die korrekte Vorbereitung der Eingabedaten ist entscheidend für die Leistungsfähigkeit eines BERT-Modells. Die Daten müssen in ein Format gebracht werden, das der Transformer-Architektur von BERT entspricht. Dies umfasst typischerweise drei Hauptschritte:

- Tokenisierung von Wörtern: Text wird in kleinere Einheiten, sogenannte Token, zerlegt. BERT verwendet eine WordPiece-Tokenisierung, die häufige Wörter als einzelne Token behandelt und seltenere Wörter in Subword-Einheiten aufteilt. Dies hilft, das Problem von Out-of-Vocabulary (OOV)-Wörtern zu reduzieren.

- Hinzufügen spezieller Tokens: Jeder Eingabesatz beginnt mit einem

[CLS](Classifier) Token, dessen Endzustand oft für Klassifikationsaufgaben verwendet wird. Jeder Satz endet mit einem[SEP](Separator) Token. Bei der Verarbeitung von Satzpaaren (z.B. für NSP) trennt ein weiteres[SEP]Token die beiden Sätze. - Segment Embeddings (Token Type IDs): Für Aufgaben, die mehrere Sätze umfassen, wird jedem Token eine Segment-ID zugewiesen (z.B. 0 für den ersten Satz, 1 für den zweiten), um dem Modell mitzuteilen, zu welchem Satz ein Token gehört.

- Positional Embeddings (Positions-IDs): Da BERT keine rekurrenten Mechanismen besitzt, werden Positions-Embeddings hinzugefügt, um die sequentielle Reihenfolge der Token im Satz zu kodieren.

All diese Informationen (Token-Embeddings, Segment-Embeddings, Positional-Embeddings) werden kombiniert und bilden die finale Eingaberepräsentation für das BERT-Modell.

Ein praktisches Beispiel für die Tokenisierung mit der Hugging Face Transformers-Bibliothek:

from transformers import BertTokenizer

# Initialisiere den Tokenizer für ein vortrainiertes BERT-Modell

# "bert-base-uncased" ist eine gängige englische Variante, für Deutsch gäbe es "bert-base-german-cased"

tokenizer = BertTokenizer.from_pretrained('bert-base-german-cased')

# Beispielsatz zur Tokenisierung

sentence = "BERT ist ein innovatives Tool zur Sprachverarbeitung."

# Tokenisierung und Hinzufügen spezieller Tokens

encoded_input = tokenizer(sentence,

padding='max_length',

truncation=True,

max_length=128,

return_tensors='pt') # 'pt' für PyTorch-Tensoren

print("Originalsatz:", sentence)

print("Token IDs:", encoded_input['input_ids'][0])

print("Attention Mask (zeigt, welche Token echt und welche Padding sind):", encoded_input['attention_mask'][0])

print("Token Type IDs (für einzelne Sätze sind diese meist alle 0):", encoded_input['token_type_ids'][0])

print("Decodierte Tokens:", tokenizer.convert_ids_to_tokens(encoded_input['input_ids'][0]))

# Die Decodierung zeigt die speziellen Tokens [CLS] und [SEP]

# sowie die Subword-Tokenisierung (z.B. "Sprach", "##ver", "##arbeitung")

Dieses Codebeispiel zeigt die typische Vorverarbeitung, die notwendig ist, um Textdaten für BERT vorzubereiten. Die `input_ids`, `attention_mask` und `token_type_ids` sind die direkten Eingaben für das BERT-Modell.

Auswahl und Integration von BERT-Modellen

Nach der Datenaufbereitung ist der nächste Schritt die Auswahl des passenden BERT-Modells. Es gibt verschiedene Varianten von BERT, die sich in Größe und Pre-Training-Daten unterscheiden:

- BERT-base: Eine kleinere Version mit 12 Encoderschichten, 768 versteckten Einheiten und 12 Attention-Heads (ca. 110 Millionen Parameter).

- BERT-large: Eine größere Version mit 24 Encoderschichten, 1024 versteckten Einheiten und 16 Attention-Heads (ca. 340 Millionen Parameter).

- DistilBERT: Eine destillierte, leichtere und schnellere Version von BERT, die dennoch einen Großteil der Leistung beibehält.

- Multilinguale und domänenspezifische BERT-Modelle: Modelle, die auf Texten in verschiedenen Sprachen oder in spezifischen Domänen (z.B. Medizin, Finanzen) vortrainiert wurden.

Die Wahl hängt von den spezifischen Anforderungen der Aufgabe, den verfügbaren Rechenressourcen und der Datengröße ab. Für die meisten Anwendungen wird ein vortrainiertes BERT-Modell geladen und dann auf einem spezifischen Datensatz für eine bestimmte Aufgabe feinabgestimmt (fine-tuning). Dieser Prozess des Transfer Learning ermöglicht es, das bereits gelernte Sprachverständnis von BERT auf neue, oft kleinere Datensätze anzuwenden, und dabei beeindruckende Ergebnisse zu erzielen.

Hier ein Codebeispiel für das Laden eines vortrainierten BERT-Modells:

from transformers import BertModel, BertForSequenceClassification

import torch

# Lade das vortrainierte BERT-Modell (nur den Encoder-Teil)

# Für Aufgaben ohne spezifische Klassifikationsebene

model = BertModel.from_pretrained('bert-base-german-cased')

# Wenn eine Klassifikationsaufgabe (z.B. Sentimentanalyse) vorliegt,

# wird oft ein Modell wie BertForSequenceClassification verwendet,

# das einen Klassifikationskopf oben auf dem BERT-Encoder hat.

# num_labels wäre hier die Anzahl der Klassen (z.B. 2 für positiv/negativ)

model_for_classification = BertForSequenceClassification.from_pretrained(

'bert-base-german-cased',

num_labels=2 # Beispiel: 2 Klassen für binäre Klassifikation

)

print("BERT Modell erfolgreich geladen.")

print("Anzahl der Parameter des Klassifikationsmodells:", sum(p.numel() for p in model_for_classification.parameters()))

# Man kann nun das Modell mit den vorbereiteten Input IDs, Attention Mask und Token Type IDs füttern

# Beispielhafter Forward-Pass (ohne eigentliches Training)

# inputs = encoded_input # Verwendet die vorher generierten encoded_input

# outputs = model_for_classification(inputs)

# logits = outputs.logits

# predicted_class = torch.argmax(logits, dim=1)

Dieses Vorgehen demonstriert die Einfachheit, mit der Entwickler auf die Leistungsfähigkeit von BERT zugreifen können, um ihre NLP-Anwendungen zu bauen und zu verbessern.

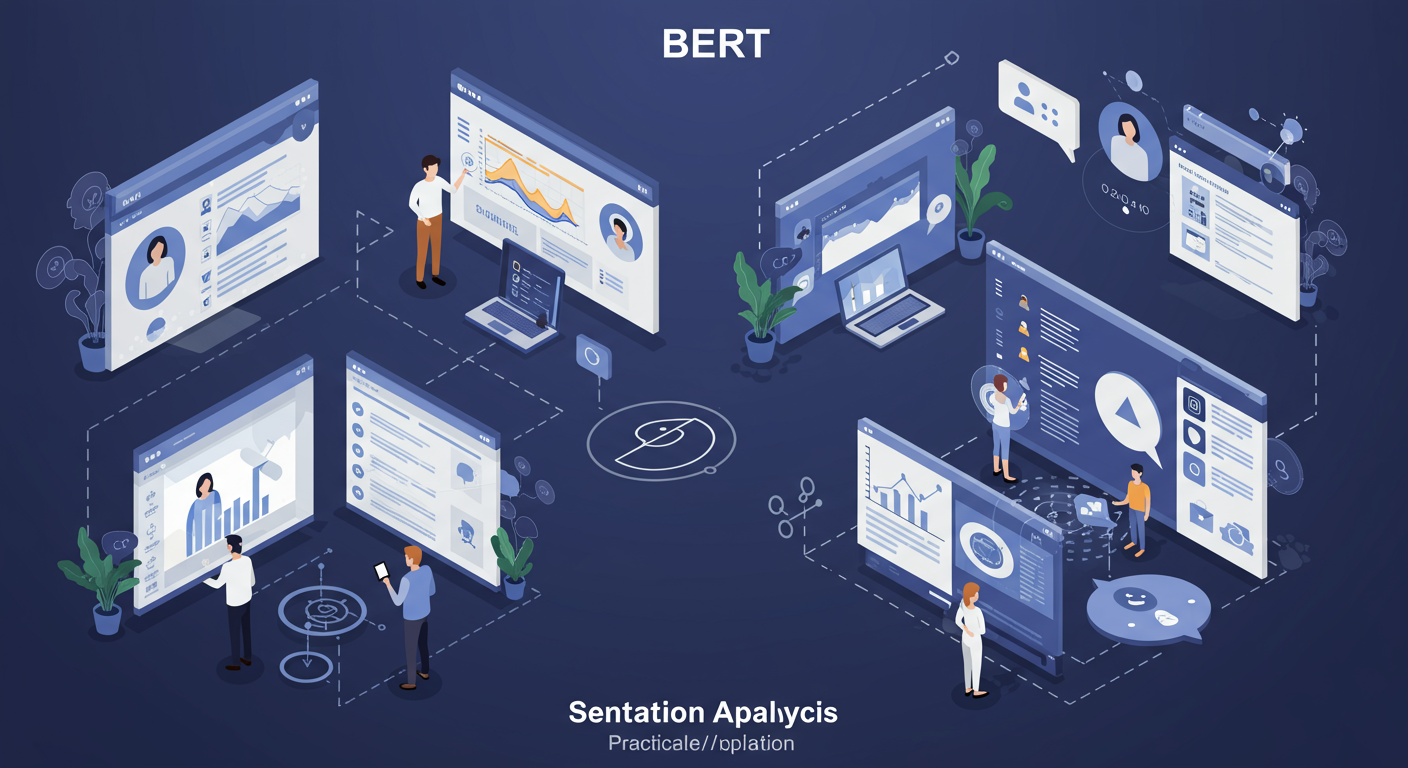

Anwendungsbeispiele und Transfer Learning

Die Vielseitigkeit von BERT hat es zu einem unverzichtbaren Werkzeug in einer breiten Palette von NLP-Anwendungen gemacht. Das Prinzip des Transfer Learning in NLP, bei dem ein auf einer großen Datenmenge vortrainiertes Modell für spezifische Downstream-Aufgaben feinabgestimmt wird, ist der Schlüssel zu diesem Erfolg. Hier sind einige der prominentesten Anwendungsfälle:

- Sentimentanalyse: Klassifizierung von Texten nach der darin ausgedrückten Stimmung (positiv, negativ, neutral). BERT kann Nuancen in der Sprache erkennen, die für die Stimmungsbewertung entscheidend sind.

- Frage-Antwort-Systeme: BERT kann Fragen zu einem gegebenen Textblock beantworten, indem es die Spanne im Text identifiziert, die die Antwort enthält. Dies ist ein Paradebeispiel für die Fähigkeiten des Modells, komplexe Satzbeziehungen zu verstehen.

- Textklassifikation: Zuweisung von Kategorien oder Labels zu Textdokumenten, z.B. Spam-Erkennung, Themenklassifizierung von Nachrichtenartikeln oder Kategorisierung von Kundenrezensionen.

- Named Entity Recognition (NER): Identifikation und Klassifizierung von benannten Entitäten im Text, wie Personen, Orte, Organisationen oder Daten.

- Textzusammenfassung: Obwohl BERT primär ein Encoder ist, kann es in Kombination mit einem Decoder-Modell oder durch extraktive Methoden zur Erstellung von Textzusammenfassungen beitragen.

Die Fähigkeit von BERT, ein tiefes, kontextuelles Verständnis der Sprache zu entwickeln, ermöglicht es, dass es mit relativ wenig aufgabenspezifischen Trainingsdaten (während des Fine-Tunings) eine hohe Leistung erzielen kann. Dies spart nicht nur Zeit und Rechenressourcen, sondern demokratisiert auch den Zugang zu fortschrittlichen NLP-Lösungen.

Ein konzeptuelles Beispiel für Sentimentanalyse mit BERT:

from transformers import pipeline

# Lade ein vortrainiertes Pipeline für Sentimentanalyse (z.B. auf Deutsch)

# 'sentiment-analysis' ist ein vordefinierter Task in Hugging Face

# Man könnte auch ein spezifisches feingetuntes Modell laden, z.B. für deutschsprachige Texte

# hier wird ein allgemeineres Modell verwendet, das oft gut funktioniert

sentiment_pipeline = pipeline('sentiment-analysis', model="oliverguhr/german-sentiment-bert")

# Texte zur Analyse

texts = [

"Dieses Produkt ist fantastisch und funktioniert einwandfrei.",

"Ich bin absolut enttäuscht von der Leistung.",

"Die Dokumentation ist in Ordnung, aber könnte besser sein."

]

# Führe die Sentimentanalyse durch

results = sentiment_pipeline(texts)

# Gebe die Ergebnisse aus

for text, result in zip(texts, results):

print(f"Text: '{text}'")

print(f"Sentiment: {result['label']}, Score: {result['score']:.4f}n")

# Die Anwendung von BERT für die Stimmungsanalyse demonstriert seine Fähigkeit,

# komplexe sprachliche Nuancen zu erfassen und präzise Klassifikationen vorzunehmen.

Dieses Beispiel verdeutlicht, wie einfach moderne NLP-Anwendungen mit BERT implementiert werden können, selbst für komplexe Aufgaben wie die Bewertung von Stimmungen in Texten.

BERT und die Zukunft der Sprachverarbeitung

BERT hat das Feld des Natural Language Processing nachhaltig verändert und einen neuen Standard für das Verständnis und die Verarbeitung menschlicher Sprache gesetzt. Seine bidirektionale Analyse von Textsequenzen und die robuste Transformer-Architektur ermöglichen es, kontextuelle Bedeutungen in einer Tiefe zu erfassen, die zuvor unerreichbar war.

Durch die Einführung von BERT und ähnlichen Deep-Learning-Modellen ist das Transfer Learning in NLP zu einem dominierenden Paradigma geworden, wodurch Entwickler und Forscher effizienter leistungsstarke Sprachmodelle für verschiedenste Anwendungen entwickeln können. Ob Sentimentanalyse mit BERT, komplexe Frage-Antwort-Systeme basierend auf BERT oder fortgeschrittene Textklassifikation mit BERT – die Einsatzmöglichkeiten sind vielfältig und expandieren stetig. Die kontinuierliche Forschung und Entwicklung auf Basis von BERT verspricht eine noch intelligentere und intuitivere Interaktion zwischen Mensch und Maschine, und öffnet Türen für Innovationen in Bereichen von virtuellen Assistenten bis hin zu automatisierten Inhaltsgenerierungssystemen.

Die Welt der Datenwissenschaft und des Machine Learnings entwickelt sich rasant. Wenn Sie Ihr Wissen im Bereich Natural Language Processing vertiefen oder eine Karriere in der Datenbranche anstreben möchten, gibt es zahlreiche Möglichkeiten zur Weiterbildung. Entdecken Sie Programme, die Ihnen helfen, die Funktionsweise von BERT und Transformer-Architekturen umfassend zu verstehen und praktisch anzuwenden. Lassen Sie sich inspirieren und tauchen Sie tiefer in die faszinierende Welt der Künstlichen Intelligenz ein!

BERT hat die Messlatte hochgelegt, keine Frage. Aber ganz ehrlich: Was wirklich fehlt, ist eine native, tiefgreifende Interpretierbarkeit! Wir wollen nicht nur wissen, *was* BERT versteht, sondern *wie* es zu seinen Schlüssen kommt. Eine Black Box ist heute nicht mehr genug.

Es wäre aber noch besser, wenn es eine deutlich schlankere, ressourcenschonendere Variante gäbe, die auch auf Edge-Geräten oder in Umgebungen mit begrenzter Rechenleistung performant läuft. Die reine Power ist beeindruckend, aber die Effizienz muss für breitere Anwendungsfälle noch massiv steigen.

Und apropos „revolutioniert“: Was ist mit echter, *nahtloser* Multilingualität? Separate Modelle für jede Sprache sind ein Workaround, keine finale Lösung. Es wäre aber noch besser, wenn BERT von Grund auf für echtes Cross-Lingual Transfer ohne Kompromisse konzipiert wäre, um die Sprachbarrieren endgültig zu sprengen.

Was wirklich fehlt, ist ein integriertes Toolset zur Erkennung und Mitigation von Bias. Bei der Macht, die diese Modelle haben, müssen wir sicherstellen, dass sie fair und unvoreingenommen agieren. Das ist keine Option, das ist eine Notwendigkeit!

Dieser Artikel feiert die Errungenschaften von 2018 – das ist schön und gut. Aber es wäre aber noch besser, wenn wir sofort einen Ausblick auf die *nächste Generation* bekämen. Was kommt *nach* BERT? Wo sind die nächsten Sprünge, um die verbleibenden Herausforderungen, wie echtes Commonsense Reasoning oder dynamisches Lernen, zu meistern? Wir brauchen nicht nur die Geschichte, sondern die Roadmap für die Zukunft.

Sie sprechen wichtige Punkte an, die die Grenzen aktueller Modelle wie BERT aufzeigen und die Richtung für zukünftige Forschung und Entwicklung vorgeben. Die Forderung nach tiefergehender Interpretierbarkeit ist absolut berechtigt. Es ist entscheidend zu verstehen, wie diese komplexen Systeme zu ihren Ergebnissen kommen, um Vertrauen aufzubauen und mögliche Fehlerquellen zu identifizieren. Auch der Wunsch nach effizienteren Modellen, die auf Edge-Geräten laufen können, ist ein zentrales Thema, da dies die Anwendungsbereiche erheblich erweitern würde.

Ihre Anmerkungen zur Multilingualität und zur Notwendigkeit integrierter Bias-Erkennung und -Minderung sind ebenfalls von großer Bedeutung. Echte sprachübergreifende Verständigung und faire Algorithmen sind für eine verantwortungsvolle KI-Entwicklung unerlässlich. Es ist in der Tat wichtig, nicht nur die Erfolge der Vergangenheit zu feiern, sondern auch den Blick nach vorne zu richten und die Herausforderungen der nächsten Generation von Sprachmodellen zu beleuchten. Vielen Dank für diesen ausführlichen und durchdachten Kommentar. Ich lade Sie ein, auch andere Artikel in meinem Profil oder meine weiteren Veröffentlichungen zu lesen.