Die digitale Ära wird maßgeblich durch eine exponentiell wachsende Menge an Daten definiert – das sogenannte Big Data. Diese riesigen Datensätze sind nicht nur eine Herausforderung, sondern auch eine immense Chance für Unternehmen weltweit. Um das volle Potenzial dieser Informationen auszuschöpfen, von der Datenanalyse bis zur Entwicklung von KI-Modellen, sind spezialisierte Fachkräfte unverzichtbar. Der Bedarf an Experten in Big Data Berufen steigt stetig, und eine Karriere im Bereich Big Data verspricht hervorragende Aussichten.

Dieser Artikel beleuchtet die vielfältigen und entscheidenden Rollen innerhalb der Big Data Branche. Wir werden tief in die spezifischen Big Data Jobs eintauchen, die erforderlichen Kompetenzen detailliert darlegen und aufzeigen, welche Technologien und Fähigkeiten Sie benötigen, um in diesem dynamischen Feld erfolgreich zu sein. Von der Architektur komplexer Dateninfrastrukturen bis zur präzisen Modellierung und Visualisierung – entdecken Sie die spannende Welt der Datenwissenschaft und Ingenieurkunst.

Die Bedeutung und Attraktivität von Big Data Berufen

Die rapide Entwicklung von Technologien und die Omnipräsenz digitaler Geräte führen zu einer unvorstellbaren Menge an generierten Daten. Diese Datensintflut, oft als Big Data bezeichnet, ist zu einem kritischen strategischen Asset für nahezu jede Branche geworden. Unternehmen, die in der Lage sind, diese Daten effektiv zu sammeln, zu verarbeiten, zu analysieren und daraus verwertbare Erkenntnisse zu gewinnen, verschaffen sich einen erheblichen Wettbewerbsvorteil. Dies hat zu einer enormen Nachfrage nach Fachkräften geführt, die diese komplexen Aufgaben beherrschen.

Die Big Data Berufe stehen in der IT-Branche ganz oben auf der Liste der gefragtesten Positionen. Insbesondere Big Data Architekten und Big Data Ingenieure sind heiß begehrt. Die Attraktivität dieser Karrierewege liegt nicht nur in der hohen Arbeitsplatzsicherheit und den ausgezeichneten Aufstiegschancen, sondern auch in den überdurchschnittlich hohen Gehältern. Spezialisten auf diesem Gebiet sind selten, und Unternehmen sind bereit, erheblich zu investieren, um die besten Talente zu gewinnen und zu halten. Das Feld ist zudem außerordentlich vielfältig und bietet eine breite Palette an Spezialisierungsmöglichkeiten, von technischer Infrastruktur bis hin zu datengetriebener Geschäftsstrategie.

Schlüsselrollen in der Big Data Landschaft

Die Welt der Big Data ist ein komplexes Ökosystem, in dem zahlreiche spezialisierte Rollen Hand in Hand arbeiten, um den Lebenszyklus von Daten zu verwalten – von der Erfassung und Speicherung bis zur Analyse und Präsentation. Für Einsteiger kann es schwierig sein, den Überblick zu behalten. Im Folgenden stellen wir die wichtigsten Big Data Rollen und ihre Aufgaben detailliert vor.

Data Analyst: Daten verstehen und interpretieren

Der Data Analyst ist der Übersetzer von Rohdaten in verständliche Informationen. Seine primäre Aufgabe ist es, Daten aus verschiedenen Quellen zu sammeln, zu bereinigen und zu analysieren, um Muster, Trends und Korrelationen zu identifizieren. Ziel ist es, durch die Gewinnung von „Insights“ die Geschäftsführung und andere Teams bei fundierten Entscheidungen zu unterstützen und konkrete Probleme des Unternehmens zu lösen. Dies erfordert nicht nur ein tiefes Verständnis für statistische Methoden, sondern auch ausgeprägte Fähigkeiten in der Datenvisualisierung, um komplexe Ergebnisse verständlich aufzubereiten.

Typische Aufgaben umfassen die Erstellung von Berichten und Dashboards, die Durchführung von A/B-Tests, Marktanalysen oder die Optimierung von Geschäftsprozessen. Ein Datenanalyst muss versiert sein im Umgang mit Datenbankabfragesprachen wie SQL und Tools für die Datenvisualisierung wie Tableau oder Microsoft Power BI. Auch Kenntnisse in Python oder R für statistische Analysen sind von Vorteil.

-- Beispiel SQL-Abfrage zur Aggregation und Analyse von Verkaufsdaten

-- Ziel: Gesamtumsatz und durchschnittliche Menge pro Produktkategorie ermitteln

SELECT

Produktkategorie, -- Die Kategorie des Produkts

SUM(Umsatz) AS Gesamtumsatz, -- Die Summe des Umsatzes für jede Kategorie

AVG(Menge) AS DurchschnittlicheVerkaufsmenge -- Die durchschnittliche Verkaufsmenge pro Kategorie

FROM

Verkaufsdaten -- Die Tabelle, die Verkaufsdaten enthält

WHERE

Verkaufsdatum BETWEEN '2023-01-01' AND '2023-12-31' -- Filtert Daten für ein spezifisches Jahr

GROUP BY

Produktkategorie -- Gruppiert die Ergebnisse nach Produktkategorie

ORDER BY

Gesamtumsatz DESC; -- Sortiert die Kategorien absteigend nach Gesamtumsatz

Data Scientist: Modelle entwickeln und Vorhersagen treffen

Der Data Scientist ist eine zentrale Figur im Big Data Ökosystem und erweitert die Aufgaben des Data Analysts um fortgeschrittene analytische Methoden. Neben der Sammlung und Analyse von Rohdaten konzentriert sich der Datenwissenschaftler auf die Entwicklung und Implementierung von Machine Learning Modellen und künstlicher Intelligenz. Diese Modelle ermöglichen nicht nur tiefere Einsichten, sondern auch die Automatisierung von Analysen und die Erstellung präziser Vorhersagen.

Ein Data Scientist entwirft und validiert statistische Modelle, führt prädiktive Analysen durch und entwickelt Algorithmen zur Lösung komplexer geschäftlicher Herausforderungen. Er benötigt ein exzellentes Verständnis für Mathematik, Statistik und Algorithmen, kombiniert mit tiefgreifenden Programmierkenntnissen in Sprachen wie Python oder R. Zudem sind Business-Kenntnisse entscheidend, um die Relevanz der Modelle für die Unternehmensziele sicherzustellen.

# Beispiel: Einfaches lineares Regressionsmodell in Python zur Vorhersage

import pandas as pd

from sklearn.model_selection import train_test_split

from sklearn.linear_model import LinearRegression

from sklearn.metrics import mean_squared_error

import numpy as np

# 1. Beispieldaten erstellen (simuliert Kundendaten oder ähnliches)

data = {

'Werbeausgaben': [100, 150, 200, 250, 300, 350, 400, 450, 500, 550],

'Umsatz': [120, 180, 230, 280, 330, 380, 420, 470, 520, 570]

}

df = pd.DataFrame(data)

# 2. Daten für Training und Test aufteilen

# 'Werbeausgaben' ist die unabhängige Variable (X), 'Umsatz' ist die abhängige Variable (y)

X = df[['Werbeausgaben']]

y = df['Umsatz']

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 3. Lineares Regressionsmodell initialisieren und trainieren

model = LinearRegression()

model.fit(X_train, y_train)

# 4. Vorhersagen auf den Testdaten treffen

y_pred = model.predict(X_test)

# 5. Modell evaluieren (z.B. mit Root Mean Squared Error)

rmse = np.sqrt(mean_squared_error(y_test, y_pred))

print(f"Root Mean Squared Error des Modells: {rmse:.2f}")

# 6. Beispielvorhersage für neue Daten (Was wäre der Umsatz bei 600€ Werbeausgaben?)

new_werbeausgaben = pd.DataFrame({'Werbeausgaben': [600, 650]})

predicted_umsatz = model.predict(new_werbeausgaben)

print(f"Vorhersage für Werbeausgaben von 600€: {predicted_umsatz[0]:.2f}€ Umsatz")

print(f"Vorhersage für Werbeausgaben von 650€: {predicted_umsatz[1]:.2f}€ Umsatz")

Big Data Architekt: Infrastruktur und Strategie gestalten

Der Big Data Architekt ist verantwortlich für das Design und die Implementierung der gesamten Big Data Infrastruktur eines Unternehmens. Er versteht die komplexen Abhängigkeiten zwischen Datenquellen, Speichersystemen, Verarbeitungseinheiten und Analyseplattformen. In enger Zusammenarbeit mit Data Engineers optimiert er die Leistung von Daten-Workflows und entwirft neue Datenbank-Prototypen, die den sich ständig ändernden Anforderungen gerecht werden.

Zu seinen Aufgaben gehört es, umfassende Datenarchitektur-Strategien für verschiedene Geschäftsbereiche zu entwickeln. Dies beinhaltet die Auswahl geeigneter Technologien (z. B. Hadoop, Spark, NoSQL-Datenbanken, Cloud-Dienste wie AWS S3, Azure Data Lake), die Sicherstellung der Skalierbarkeit und Sicherheit der Systeme sowie die Definition von Daten-Governance-Richtlinien. Fundierte Kenntnisse in verteilten Systemen, Cloud Computing und Programmiersprachen wie Java oder Scala sind für diese Rolle unerlässlich.

„Ein Big Data Architekt ist der Stadtplaner der Datenwelt; er entwirft die Autobahnen und Gebäude, auf und in denen Daten fließen und leben.“

Big Data Engineer: Datenpipelines bauen und pflegen

Der Big Data Engineer ist der Baumeister der Datenpipelines. Seine Hauptaufgabe ist es, robuste, skalierbare und effiziente Systeme zu entwickeln, die das Sammeln, Speichern, Verarbeiten und Umwandeln großer Datenmengen ermöglichen. Er identifiziert neue Datenquellen, bereinigt und transformiert die Daten (ETL/ELT-Prozesse), um sie für die Nutzung durch Data Analysts und Data Scientists vorzubereiten.

Diese Rolle erfordert starke Programmierkenntnisse in Sprachen wie Python, Scala oder Java sowie Expertise im Umgang mit verteilten Datenverarbeitungssystemen wie Apache Spark oder Hadoop. Er fungiert auch als Schnittstelle zwischen technischen Teams und der Unternehmensleitung, indem er sicherstellt, dass die Datenwissenschaftler die Geschäftsziele verstehen und die Dateninfrastruktur optimal darauf abgestimmt ist.

# Beispiel: Einfacher ETL-Prozess (Extract, Transform, Load) in Python mit Pandas

import pandas as pd

def extract_data(file_path):

"""

Extrahiert Daten aus einer CSV-Datei.

In einem realen Szenario könnten hier auch Daten aus Datenbanken, APIs etc. geladen werden.

"""

try:

df = pd.read_csv(file_path)

print(f"Daten erfolgreich extrahiert aus: {file_path}")

return df

except FileNotFoundError:

print(f"Fehler: Die Datei {file_path} wurde nicht gefunden.")

return None

except Exception as e:

print(f"Ein Fehler ist beim Extrahieren aufgetreten: {e}")

return None

def transform_data(dataframe):

"""

Transformiert die extrahierten Daten.

Beispiele für Transformationen: Spalten umbenennen, Datentypen konvertieren,

fehlende Werte behandeln, neue Spalten basierend auf vorhandenen erstellen.

"""

if dataframe is None:

return None

# Beispiel 1: Spalten umbenennen

dataframe = dataframe.rename(columns={'ProduktID': 'SKU', 'Menge': 'VerkaufteMenge'})

# Beispiel 2: Fehlende Werte in einer numerischen Spalte mit dem Median füllen

if 'Preis' in dataframe.columns:

dataframe['Preis'] = dataframe['Preis'].fillna(dataframe['Preis'].median())

# Beispiel 3: Neue Spalte 'Gesamtpreis' berechnen

if 'VerkaufteMenge' in dataframe.columns and 'Preis' in dataframe.columns:

dataframe['Gesamtpreis'] = dataframe['VerkaufteMenge'] dataframe['Preis']

# Beispiel 4: Datentypkonvertierung

if 'Datum' in dataframe.columns:

dataframe['Datum'] = pd.to_datetime(dataframe['Datum'])

print("Daten erfolgreich transformiert.")

return dataframe

def load_data(dataframe, output_path, format='csv'):

"""

Lädt die transformierten Daten in ein Zielsystem (hier: CSV-Datei).

Könnte auch eine Datenbank, ein Data Lake oder ein DWH sein.

"""

if dataframe is None:

print("Keine Daten zum Laden vorhanden.")

return

try:

if format == 'csv':

dataframe.to_csv(output_path, index=False)

print(f"Transformierte Daten erfolgreich gespeichert als CSV unter: {output_path}")

elif format == 'json':

dataframe.to_json(output_path, orient='records', indent=4)

print(f"Transformierte Daten erfolgreich gespeichert als JSON unter: {output_path}")

else:

print(f"Fehler: Nicht unterstütztes Ausgabeformat '{format}'.")

except Exception as e:

print(f"Ein Fehler ist beim Laden aufgetreten: {e}")

# --- Demonstrations-Workflow ---

if __name__ == "__main__":

# Schritt 0: Eine Dummy-Eingangsdatei erstellen für die Demonstration

dummy_data = {

'ProduktID': [101, 102, 103, 104, 105],

'Produktname': ['Laptop', 'Maus', 'Tastatur', 'Monitor', 'Webcam'],

'Menge': [2, 5, 3, 1, 4],

'Preis': [1200.50, 25.00, 75.99, 300.00, None], # Beispiel mit fehlendem Wert

'Datum': ['2023-01-15', '2023-01-16', '2023-01-17', '2023-01-18', '2023-01-19']

}

dummy_df = pd.DataFrame(dummy_data)

dummy_input_file = 'eingangsdaten_produkte.csv'

dummy_df.to_csv(dummy_input_file, index=False)

print(f"Dummy-Eingangsdatei '{dummy_input_file}' erstellt.n")

# Der eigentliche ETL-Prozess

extracted_df = extract_data(dummy_input_file)

transformed_df = transform_data(extracted_df)

load_data(transformed_df, 'ausgangsdaten_produkte_transformed.csv', format='csv')

print("nInhalt der transformierten Daten (erste 5 Zeilen):")

if transformed_df is not None:

print(transformed_df.head())

Machine Learning Engineer: Intelligente Systeme entwickeln

Der Machine Learning Engineer ist auf die Entwicklung, Implementierung und Skalierung von Algorithmen für maschinelles Lernen spezialisiert. Er überbrückt die Lücke zwischen der Forschung eines Data Scientists und der operativen Bereitstellung in der Produktion. Seine Aufgabe ist es, Prototypen in robuste, wartbare und skalierbare Softwarelösungen zu überführen, die eine automatisierte Datenanalyse ermöglichen.

Dies umfasst das Schreiben von effizientem Code, die Auswahl geeigneter Machine Learning Frameworks (z. B. TensorFlow, PyTorch, Scikit-learn), die Optimierung der Modellleistung und die Implementierung von MLOps-Praktiken für die Überwachung und Neu-Trainierung von Modellen. Ein tiefes Verständnis von Softwareentwicklung, Datenstrukturen und verteilten Systemen ist für diesen Beruf entscheidend.

Datenbankadministrator (DBA): Stabilität und Sicherheit gewährleisten

Der Datenbankadministrator, oder DBA, ist der Wächter der Unternehmensdaten. Er trägt die Verantwortung für die Installation, Konfiguration, Wartung und Überwachung von Datenbanken, um deren Verfügbarkeit, Performance und Sicherheit zu gewährleisten. Dies beinhaltet das Management von Zugriffsrechten, die Durchführung regelmäßiger Backups und die Entwicklung von Disaster-Recovery-Strategien. Auch die Implementierung von Änderungen an der Datenbankstruktur fällt in seinen Aufgabenbereich.

DBAs müssen proaktiv handeln, um potenzielle Probleme zu identifizieren und zu lösen, bevor sie die Geschäftsabläufe beeinträchtigen. Kenntnisse in verschiedenen Datenbankmanagement-Systemen (DBMS) wie MySQL, PostgreSQL, Oracle oder SQL Server sowie ein ausgeprägtes Bewusstsein für Datensicherheit und -integrität sind absolut unerlässlich. Dieser Beruf erfordert akribische Gründlichkeit und Wachsamkeit.

Business Analyst: Geschäftsprozesse optimieren

Obwohl der Business Analyst nicht immer direkt mit den technischen Aspekten von Big Data befasst ist, spielt er eine wichtige Brückenfunktion. Er ist darauf spezialisiert, Geschäftsanforderungen zu verstehen, Prozesse zu analysieren und datengestützte Lösungen vorzuschlagen, um die Produktivität und Effizienz zu steigern. Er agiert als Bindeglied zwischen den Fachabteilungen und den technischen Teams, übersetzt Geschäftsanforderungen in technische Spezifikationen und umgekehrt.

Ein Business Analyst verfügt oft über tiefes Domänenwissen in einer spezifischen Branche und nutzt Daten, um Strategien zu entwickeln und fundierte Entscheidungen zu ermöglichen. Kommunikationsstärke, die Fähigkeit zur Problemlösung und ein Verständnis für Business Intelligence sind Kernkompetenzen in dieser Rolle.

Big Data Visualizer: Daten verständlich darstellen

Der Big Data Visualizer, auch als Datenvisualisierungsexperte bekannt, ist darauf spezialisiert, komplexe Datensätze und Analyseergebnisse in visuell ansprechende und leicht verständliche Formate zu bringen. Er arbeitet eng mit Data Analysts und Data Scientists zusammen, um Dashboards, Infografiken und interaktive Visualisierungen zu erstellen, die Storys erzählen und Entscheidungsträgern schnelle Einblicke ermöglichen.

Diese Rolle erfordert nicht nur den souveränen Umgang mit Visualisierungs-Tools wie Tableau, Power BI oder D3.js, sondern auch ein Auge für Design, UX/UI-Prinzipien und die Fähigkeit, die Essenz der Daten auf den Punkt zu bringen. Er ist auch für die Beschaffung, Verwaltung und Dokumentation von Visualisierungsdaten zuständig.

Data Warehouse Manager: Datenlager verwalten

Der Data Warehouse Manager ist für die strategische Planung, Entwicklung und Verwaltung von Data Warehouses (DWH) oder Data Lakes verantwortlich. Seine Aufgabe ist es, alle Lösungen für das Informationsmanagement zu koordinieren, um eine effiziente Speicherung und Abrufbarkeit von Unternehmensdaten zu gewährleisten. Dies beinhaltet die Entwicklung neuer Strategien für das Datenmanagement, die Durchführung von Datenmigrationen sowie das Design und die Implementierung von DWH-Architekturen.

Diese Rolle erfordert ein tiefes Verständnis von ETL/ELT-Prozessen, Datenbank-Design-Prinzipien (z. B. Sternschema, Schneeflockenschema) und Kenntnisse über Cloud-Data-Warehouse-Lösungen wie Snowflake, Google BigQuery oder Amazon Redshift. Er muss auch die Qualität und Konsistenz der Daten im DWH sicherstellen.

Data Modeler: Datenstrukturen designen

Ein Data Modeler ist der Architekt der Datenstrukturen. Seine Kernaufgabe ist es, Datenmodelle zu entwerfen, die die Geschäftslogik abbilden und eine effiziente Speicherung und Abfrage von Daten ermöglichen. Er gewährleistet, dass die Codierungspraktiken innerhalb des Unternehmens über verschiedene Datenmodelle hinweg einheitlich sind und identifiziert Möglichkeiten zur Wiederverwendung von Modellen.

Dieser Spezialist entwickelt konzeptionelle, logische und physische Datenmodelle, die den Bedürfnissen und Standards des Unternehmens entsprechen. Er analysiert auch vorhandene Software, um deren Effizienz zu verbessern und die Leistung zu optimieren. Tools wie ER/Studio oder PowerDesigner sind dabei seine täglichen Begleiter. Verständnis für relationale und NoSQL-Datenbanken ist entscheidend.

| Modelltyp | Beschreibung | Anwendungsbereich |

|---|---|---|

| Konzeptionelles Datenmodell | Repräsentiert die Geschäftsanforderungen und -entitäten auf hoher Ebene, unabhängig von Technologie. | Initiales Stakeholder-Gespräch, Definition von Business-Requirements und Domänenbegriffen. |

| Logisches Datenmodell | Definiert die Datenstrukturen und Beziehungen zwischen Entitäten, unabhängig von einer spezifischen Datenbanktechnologie. Enthält Attribute und Schlüssel. | Datenbankdesign auf einer abstrakteren Ebene, Erstellung einer Blaupause für die Implementierung. |

| Physisches Datenmodell | Spezifiziert die tatsächliche Implementierung der Datenstrukturen in einer bestimmten Datenbank mit allen technischen Details wie Datentypen, Indizes und Partitionierung. | Direkte Implementierung in einem DBMS, Performance-Optimierung. |

| Dimensionales Datenmodell | Optimiert für Abfragen und Berichte in Data Warehouses und Business Intelligence Systemen (bestehend aus Fakten- und Dimensionstabellen). | OLAP-Systeme, schnelle und intuitive Analyse großer Datenmengen für Berichterstattung und Dashboards. |

Die rosige Zukunft der Big Data Berufe

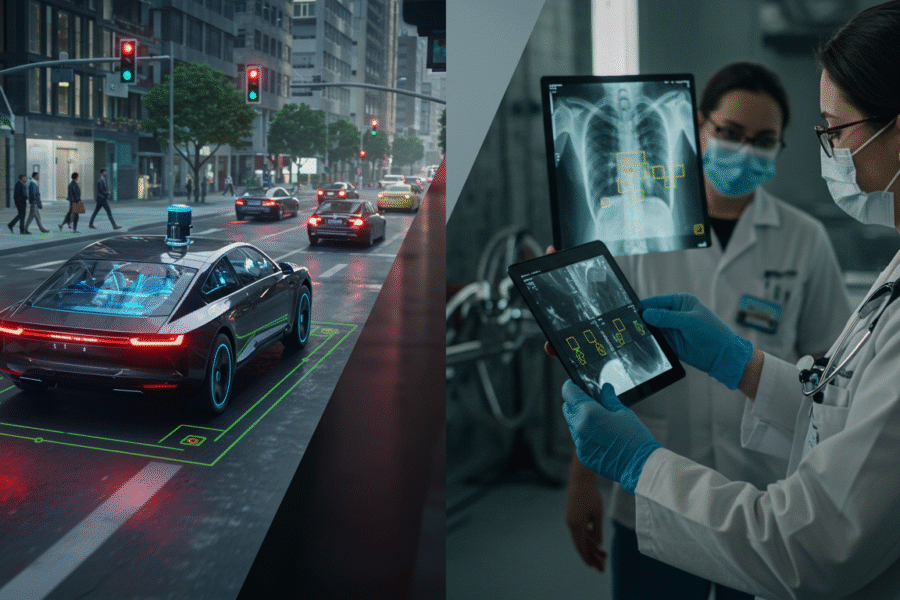

Das Big-Data-Zeitalter befindet sich noch in den Kinderschuhen, und die Zukunft dieser Berufsfelder verspricht ein anhaltendes, sogar beschleunigtes Wachstum. Die Haupttreiber dieser Entwicklung sind die explosionsartige Zunahme persönlicher und maschinengenerierter Daten – vor allem durch das Internet der Dinge (IoT), tragbare Endgeräte wie Smartwatches und die immer stärkere Vernetzung unserer Lebensbereiche. Diese Datenmenge wird in den kommenden Jahren noch weiter ansteigen und neue Herausforderungen sowie Chancen mit sich bringen.

Parallel dazu entstehen kontinuierlich neue Technologien zur Datenanalyse und -verarbeitung. Während SQL nach wie vor das Standardwerkzeug für relationale Datenbanken ist, entwickeln sich Alternativen wie Apache Spark rasant weiter und etablieren sich als ernstzunehmende Konkurrenten für die Verarbeitung riesiger, komplexer Datensätze. Das steigende Datenvolumen geht auch mit zunehmenden Anforderungen an die Sicherheit persönlicher Daten und strengeren Datenschutzgesetzen, wie der DSGVO in Europa, einher. Um all diesen vielschichtigen Problemen gerecht zu werden, werden Big Data Experten immer gefragter bleiben. Die Prognosen deuten daher auf eine äußerst rosige Zukunft für alle Berufe im Bereich Big Data hin.

Karrierewege und Kompetenzerwerb im Big Data Bereich

Der Einstieg in einen Big Data Beruf kann aufgrund der noch jungen und sich schnell entwickelnden Natur des Feldes zunächst verwirrend wirken. Berufsbezeichnungen sind oft fluid, und die Aufgaben desselben Titels können von Unternehmen zu Unternehmen stark variieren. Es ist daher ratsam, sich nicht zu stark an spezifischen Bezeichnungen festzuhalten, sondern sich auf die gewünschten Tätigkeiten und die Branchen, die Sie interessieren, zu konzentrieren. Eine klare Definition Ihrer Interessen wird Ihnen helfen, den passenden Big Data Karriereweg zu finden.

Ein Quereinstieg ist absolut möglich, erfordert aber den Aufbau solider technischer Fähigkeiten. Eine Spezialisierung auf einen bestimmten Wirtschaftszweig kann Ihre Chancen auf dem Arbeitsmarkt erheblich erhöhen, da Sie neben Ihren Data Science Kenntnissen auch branchenspezifisches Wissen mitbringen. Entscheidend ist jedoch die Aneignung von Kernkompetenzen, die eine breite Anpassungsfähigkeit an unterschiedliche Unternehmensanforderungen ermöglicht.

Essenzielle Kompetenzen für Big Data

Um in den Big Data Berufen erfolgreich zu sein, ist eine Kombination aus technischen Fähigkeiten und analytischem Denkvermögen erforderlich:

- Programmiersprachen: Python ist mit Bibliotheken wie Pandas, NumPy, Scikit-learn und TensorFlow/PyTorch die de facto Standardsprache. Auch R für statistische Analysen, Java und Scala (insbesondere für verteilte Systeme wie Spark) sind von großer Bedeutung.

- Datenbankkenntnisse: Ein tiefes Verständnis von relationalen Datenbanken und SQL ist unerlässlich. Zunehmend wichtig sind auch NoSQL-Datenbanken wie MongoDB, Cassandra oder Neo4j für unstrukturierte und semi-strukturierte Daten.

- Verteilte Systeme und Frameworks: Kenntnisse in Ökosystemen wie Hadoop (HDFS, YARN) und insbesondere Apache Spark für die schnelle Verarbeitung großer Datensätze sind von Vorteil. Apache Kafka für das Streaming von Daten spielt ebenfalls eine wichtige Rolle.

- Cloud-Plattformen: Da viele Big Data Infrastrukturen in der Cloud betrieben werden, sind Erfahrungen mit AWS (S3, EMR, Redshift), Microsoft Azure (Data Lake, Databricks) oder Google Cloud Platform (BigQuery, Dataflow) sehr gefragt.

- Mathematik und Statistik: Solide Grundlagen in linearer Algebra, Wahrscheinlichkeitsrechnung, deskriptiver und inferenzieller Statistik sowie Hypothesentests sind für die Datenanalyse und Modellentwicklung unerlässlich.

- Machine Learning & KI: Verständnis für verschiedene Machine Learning Algorithmen (Regression, Klassifikation, Clustering), Modellentwicklung, -validierung und -evaluierung.

- Datenvisualisierung: Die Fähigkeit, Daten aussagekräftig darzustellen, ist entscheidend. Tools wie Tableau, Power BI, Qlik Sense oder Bibliotheken wie Matplotlib und Seaborn in Python sind hier wichtige Werkzeuge.

- Soft Skills: Analytisches und kritisches Denkvermögen, Problemlösungskompetenz, Kommunikationsfähigkeit (um komplexe Ergebnisse auch Laien verständlich zu machen), Teamfähigkeit und ein ausgeprägter Geschäftssinn sind von großer Bedeutung.

Praktische Erfahrungen sammeln und sich weiterbilden

Neben formalen Qualifikationen sind praktische Erfahrungen entscheidend. Arbeiten Sie an eigenen Projekten, nehmen Sie an Hackathons teil oder absolvieren Sie relevante Online-Kurse und Zertifizierungen. Präsentieren Sie Ihre Arbeiten in einem Portfolio, um potenziellen Arbeitgebern Ihre Fähigkeiten und Ihre Leidenschaft für das Datenfeld zu demonstrieren. Bleiben Sie stets auf dem Laufenden, indem Sie Fachblogs, Artikel und wissenschaftliche Publikationen lesen, da sich das Gebiet der Big Data Technologie ständig weiterentwickelt.

Der Markt für Big Data Weiterbildung ist riesig, doch nicht alle Angebote sind gleichwertig. Achten Sie auf zertifizierte Programme, die einen praxisorientierten Ansatz verfolgen und Ihnen die von Unternehmen tatsächlich gefragten Kompetenzen vermitteln. Dies stellt sicher, dass Sie nicht nur theoretisches Wissen, sondern auch anwendbare Fähigkeiten erwerben, die Sie von der Masse abheben.

Abschließende Gedanken zur Karriere in Big Data

Die Welt der Big Data Berufe bietet vielfältige und zukunftssichere Karrieremöglichkeiten für Technologiebegeisterte mit den richtigen Fähigkeiten und der Bereitschaft zur ständigen Weiterentwicklung.

Die hohe Nachfrage nach Big Data Spezialisten wird in den kommenden Jahren ungebrochen bleiben. Nutzen Sie die hier vorgestellten Informationen, um Ihre eigenen Kompetenzen gezielt aufzubauen oder zu vertiefen. Entdecken Sie die spannenden Facetten der Big Data Technologie und beginnen Sie noch heute Ihre Reise in diesem dynamischen Feld. Ihre Expertise ist gefragt!

Ach, „Big Data Berufe“… ehrlich gesagt, klingt das alles wie alter Wein in neuen Schläuchen. Schon vor Jahrzehnten haben wir über „Business Intelligence“ und „Data Warehousing“ gesprochen, wo es im Kern auch darum ging, riesige Mengen an Daten zu sammeln, zu verarbeiten und daraus wertvolle Erkenntnisse zu ziehen. Der einzige Unterschied scheint zu sein, dass man heute mehr Buzzwords drumherum bastelt und die Wolke mit ins Spiel bringt. Im Grunde ist es dieselbe Suppe, nur heute mit mehr Hype. Gähn.

Ich verstehe ihren punkt, dass viele der konzepte rund um big data nicht gänzlich neu sind und parallelen zu früheren ansätzen wie business intelligence oder data warehousing aufweisen. es stimmt, dass die grundidee, aus daten erkenntnisse zu gewinnen, schon lange existiert. der wesentliche unterschied liegt jedoch in der schieren menge, geschwindigkeit und vielfalt der daten, mit denen wir es heute zu tun haben, sowie in den fortschritten bei den technologien, die diese verarbeitung überhaupt erst ermöglichen. die „wolke“ ist dabei nicht nur ein buzzword, sondern eine infrastruktur, die ganz neue skalierungsmöglichkeiten bietet, die früher undenkbar waren.

diese entwicklung hat auch zu spezialisierten rollen geführt, die sich auf bestimmte aspekte dieser komplexen datenlandschaft konzentrieren, von der datenarchitektur über die analyse bis hin zur visualisierung. es geht nicht nur um „mehr hype“, sondern um eine anpassung an die exponentielle zunahme von daten und die notwendigkeit, diese effizient zu nutzen. ich danke ihnen für ihren gedankenanstoß und lade sie ein, sich auch andere artikel in meinem profil oder meine weiteren veröffentlichungen anzusehen.

Als ich den Artikel über Big Data Berufe gelesen habe, musste es mich schmunzeln, weil es mich an meine eigene, sehr viel kleinere „Datenanalyse“ erinnert hat. Vor ein paar Jahren hatte ich eine Zimmerpflanze, eine Ficus lyrata, die einfach nicht gedeihen wollte. Ein echtes Sorgenkind. Ich hatte alles versucht, was ich in Büchern und im Internet gefunden hatte, aber nichts half wirklich. Irgendwann dachte ich mir: „Du musst das systematisch angehen!“

Ich habe angefangen, ein kleines Notizbuch zu führen. Wann hatte ich gegossen? Wie viel? Wie war das Licht an diesem Tag? Gab es einen Luftzug? Ich habe sogar die Feuchtigkeit der Erde mit einem kleinen Messgerät überprüft und die Ergebnisse notiert. Es war mein ganz persönliches „Big Data“-Projekt, wenn auch auf Mikro-Ebene.

Nach ein paar Wochen starrte ich auf meine Kritzeleien und plötzlich sah ich Muster. Es war nicht allein das Gießen, sondern das Gießen in Kombination mit der direkten Nachmittagssonne, die ihr zu schaffen machte. Und der Standortwechsel, den ich als „gut“ empfunden hatte, war in Wirklichkeit zu zugig gewesen. Es war kein Algorithmus, der mir die Erkenntnisse lieferte, sondern meine eigenen Augen und meine Ausdauer, die winzigen „Datenpunkte“ zu sammeln und zu vergleichen. Und siehe da, nachdem ich die Pflanze an einen anderen Ort gestellt und mein Gießverhalten angepasst hatte, erholte sie sich. Sie steht heute noch prächtig da.

Es hat mir damals gezeigt, dass es im Kern immer darum geht, Informationen zu sammeln, Muster zu erkennen und daraus Schlüsse zu ziehen – egal ob es um eine Ficus lyrata oder um Millionen von Kundendaten geht. Die Werkzeuge mögen komplexer sein, aber die grundlegende Neugier und der Wunsch nach Verständnis bleiben dieselben.

Vielen dank für diesen wunderbaren und detaillierten kommentar. es ist faszinierend zu lesen, wie sie das prinzip der datenanalyse auf so persönliche und anschauliche weise angewendet haben, um ihrer ficus lyrata zu helfen. ihre geschichte unterstreicht perfekt, dass die grundlagen der datenwissenschaft – das sammeln von informationen, das erkennen von mustern und das ziehen von schlüssen – in vielen bereichen unseres lebens relevant sind, unabhängig von der größe der datenmenge. es zeigt, dass die menschliche neugier und der wunsch nach verständnis die treibenden kräfte hinter jeder erfolgreichen analyse sind.

es ist großartig, dass ihre pflanze heute noch prächtig gedeiht, was ein schönes zeugnis für ihre ausdauer und ihren scharfsinn ist. ich freue mich sehr, dass mein artikel sie zu dieser reflexion angeregt hat. ich danke ihnen nochmals für ihren wertvollen beitrag und lade sie herzlich ein, sich auch andere artikel in meinem profil oder meine weiteren veröffentlichungen anzusehen.