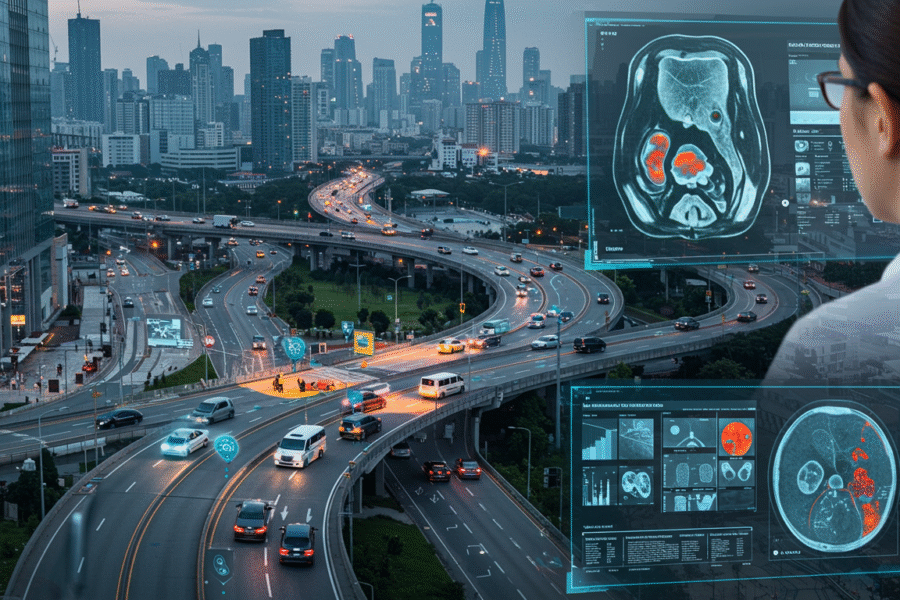

Das Convolutional Neural Network (CNN) stellt einen der fundamentalsten und zugleich leistungsfähigsten Algorithmen im Bereich des Deep Learnings dar, insbesondere wenn es um die Verarbeitung und Klassifizierung von visuellen Daten geht. Für Entwickler, Studenten und Technologiebegeisterte, die tiefgehende Informationen zu fortgeschrittenen Bilderkennungssystemen suchen, ist das Verständnis der CNN-Architektur unerlässlich. Diese spezialisierten neuronalen Netze sind in der Lage, Objekten in eingegebenen Bildern automatisch eine ihrer Klasse entsprechende Bezeichnung zuzuweisen, revolutionieren damit das Computer Vision und finden Anwendung in Bereichen von der medizinischen Bildanalyse bis hin zu autonomen Fahrsystemen.

In diesem umfassenden Blogbeitrag tauchen wir tief in die Welt der CNNs ein. Wir werden die vielschichtige CNN-Architektur detailliert beleuchten, angefangen bei den konstituierenden Schichten wie dem Convolutional Layer, dem Pooling Layer und dem Fully Connected Layer. Zudem werden wir die Rolle von Aktivierungsfunktionen erörtern und die Implementierung dieser komplexen Deep Learning Algorithmen in Python anhand konkreter Codebeispiele demonstrieren. Unser Ziel ist es, Ihnen ein fundiertes Wissen über die Funktionsweise und Anwendung von Convolutional Neural Networks zu vermitteln, um Ihnen zu helfen, die Mechanismen hinter der modernen Bildklassifizierung vollständig zu verstehen.

Grundlagen und Architektur von Convolutional Neural Networks

Convolutional Neural Networks (CNNs) sind eine spezielle Art von neuronalen Netzwerken, die sich durch ihre Eignung für die Verarbeitung von Daten mit einer rasterartigen Topologie, wie Bildern, auszeichnen. Im Gegensatz zu traditionellen Multi-Layer Perceptrons (MLPs), die jedes Pixel eines Bildes als separaten Input behandeln, nutzen CNNs eine hierarchische Struktur, die es ihnen ermöglicht, räumliche Hierarchien von Merkmalen zu lernen. Dies geschieht, indem sie lokale Muster in den unteren Schichten erkennen und diese Muster in den höheren Schichten zu komplexeren, abstrakteren Konzepten zusammensetzen. Diese inhärente Fähigkeit zur Feature-Extraktion macht CNNs zu den leistungsstärksten Modellen für Aufgaben wie Bildklassifizierung, Objekterkennung und Bildsegmentierung.

Die Eingabe in ein CNN ist typischerweise ein Bild, das als eine Matrix von Pixelwerten repräsentiert wird. Für Graustufenbilder ist dies eine 2D-Matrix, während Farbbilder in der Regel als 3D-Matrizen (Breite x Höhe x Farbtiefe) dargestellt werden. Die Farbtiefe entspricht hierbei den drei Grundfarben Rot, Grün und Blau (RGB). Die grundlegende Architektur eines Convolutional Neural Network gliedert sich prinzipiell in zwei Hauptteile: einen Konvolutionsteil und einen Klassifizierungsteil. Der Konvolutionsteil dient der Extraktion relevanter Merkmale und der Komprimierung der Eingabedaten, während der Klassifizierungsteil diese extrahierten Merkmale verwendet, um das Bild einer bestimmten Kategorie zuzuordnen.

Der Convolutional Layer und Feature-Extraktion

Der Convolutional Layer ist das Herzstück eines jeden CNNs. Er implementiert eine mathematische Operation namens Konvolution, die essenziell für die Erkennung von Mustern und Merkmalen in den Eingabebildern ist. Diese Operation wendet eine kleine Matrix, den sogenannten Filter oder Kernel, auf das gesamte Bild an. Der Filter gleitet dabei über das Bild (von links nach rechts, von oben nach unten), und an jeder Position wird eine elementweise Multiplikation zwischen den Werten des Filters und den entsprechenden Pixelwerten des Bildausschnitts durchgeführt. Die Summe dieser Produkte bildet einen einzelnen Wert in der Ausgabematrix, der sogenannten Feature Map oder Aktivierungskarte.

Diese Feature Maps repräsentieren, wo bestimmte Merkmale im Bild vorhanden sind. Ein Filter könnte beispielsweise so trainiert werden, dass er Kanten, Texturen oder andere primitive Formen erkennt. Je höher der Wert in der Feature Map, desto stärker ist das vom Filter gesuchte Merkmal an dieser Stelle im Bild ausgeprägt. Die Auswahl und die Gewichtung der Pixel innerhalb dieser Faltungsmatrizen werden vom Modell während des Trainingsprozesses automatisch gelernt, sodass die Filter optimiert werden, um die informativsten Merkmale für die jeweilige Klassifizierungsaufgabe zu extrahieren.

„Die Konvolution ist der Kern, der es einem CNN ermöglicht, die Welt in Texturen, Kanten und Formen zu zerlegen, bevor es das große Ganze erfasst.“

Betrachten wir ein einfaches Beispiel für eine 2D-Konvolution. Nehmen wir an, wir haben ein kleines Graustufenbild (eine 5×5-Pixelmatrix) und einen 3×3-Kernel, der auf Kantenerkennung spezialisiert ist. Der Kernel gleitet über das Bild, und für jede Position wird die Faltungsoperation durchgeführt.

import numpy as np

# Beispiel für ein 5x5 Graustufenbild

image = np.array([

[0, 0, 0, 0, 0],

[0, 1, 1, 1, 0],

[0, 1, 0, 1, 0],

[0, 1, 1, 1, 0],

[0, 0, 0, 0, 0]

], dtype=np.float32)

# Beispiel für einen Kantenerkennungs-Kernel (horizontal)

kernel_edge = np.array([

[-1, -1, -1],

[ 0, 0, 0],

[ 1, 1, 1]

], dtype=np.float32)

# Funktion zur Durchführung einer 2D-Konvolution

def apply_convolution(image, kernel, stride=1, padding=0):

# Padding hinzufügen, falls angegeben

if padding > 0:

image = np.pad(image, padding, mode='constant', constant_values=0)

image_h, image_w = image.shape

kernel_h, kernel_w = kernel.shape

# Berechnung der Ausgabegröße

output_h = (image_h - kernel_h) // stride + 1

output_w = (image_w - kernel_w) // stride + 1

output = np.zeros((output_h, output_w), dtype=np.float32)

for i in range(output_h):

for j in range(output_w):

# Extrahiere den Bildausschnitt

region = image[istride : istride + kernel_h,

jstride : jstride + kernel_w]

# Faltungsoperation (elementweise Multiplikation und Summation)

output[i, j] = np.sum(region kernel)

return output

# Konvolution anwenden

feature_map = apply_convolution(image, kernel_edge, stride=1, padding=0)

print("Eingabebild:n", image)

print("nKantenerkennungs-Kernel (horizontal):n", kernel_edge)

print("nResultierende Feature Map (horizontal_kanten):n", feature_map)

Neben der reinen Faltungsoperation sind die Parameter Stride (Schrittweite) und Padding (Auffüllung) entscheidend für die Gestaltung des Convolutional Layers. Der Stride definiert, um wie viele Pixel der Filter in horizontaler und vertikaler Richtung verschoben wird. Ein Stride von 1 bedeutet, dass der Filter Pixel für Pixel gleitet, während ein größerer Stride die Dimension der Feature Map reduziert und den Rechenaufwand verringert. Padding hingegen bezieht sich auf das Hinzufügen von Nullen um den Rand des Eingabebildes. Dies wird häufig verwendet, um sicherzustellen, dass die Ausgabegröße der Feature Map der Eingabegröße entspricht (Same Padding) oder um zu verhindern, dass Randpixel weniger oft verarbeitet werden als zentrale Pixel, was zu einem Informationsverlust führen könnte.

Pooling Layer zur Dimensionsreduktion

Der Pooling Layer ist eine wesentliche Komponente von CNNs, die typischerweise nach einem Convolutional Layer eingesetzt wird. Sein primäres Ziel ist die Reduzierung der räumlichen Dimension (Breite und Höhe) der Feature Maps, wodurch die Anzahl der zu lernenden Parameter und der Rechenaufwand im Netzwerk erheblich verringert werden. Diese Dimensionsreduktion hilft auch, die Invarianz gegenüber kleinen Translationen (Verschiebungen) und Rotationen im Eingabebild zu gewährleisten, was die Robustheit des Modells gegenüber geringfügigen Variationen im Bild verbessert. Durch Pooling wird eine komprimiertere, abstrahierte Darstellung der Merkmale erzeugt.

Die gebräuchlichste Methode des Poolings ist das Max-Pooling. Hierbei gleitet ein Filterfenster (z. B. 2×2 oder 3×3) über die Feature Map, ähnlich wie beim Convolutional Layer, allerdings wird anstatt einer Faltungsoperation der größte Wert innerhalb dieses Fensters als Output beibehalten. Ein häufig verwendeter Stride (Schrittweite) für Max-Pooling ist 2, was bedeutet, dass der Filter bei jedem Schritt um zwei Pixel bewegt wird und somit die Dimension der Feature Map halbiert. Dies führt zu einer drastischen Reduktion der Datenmenge, während die wichtigsten (also die aktivsten) Merkmale des abgetasteten Bereichs erhalten bleiben.

Stellen wir uns eine 4×4-Feature-Map vor und wenden ein 2×2-Max-Pooling mit einem Stride von 2 an:

| Ursprüngliche Feature Map | Max-Pooling (2×2, Stride=2) |

|---|---|

[[1, 2, 3, 4], [5, 6, 7, 8], [9, 10, 11, 12], [13, 14, 15, 16]] | [[6, 8], [14, 16]] |

Hier ein Python-Codebeispiel, das Max-Pooling demonstriert:

import numpy as np

# Beispiel für eine 4x4 Feature Map

feature_map = np.array([

[1, 2, 3, 4],

[5, 6, 7, 8],

[9, 10, 11, 12],

[13, 14, 15, 16]

], dtype=np.float32)

# Funktion zur Durchführung von Max-Pooling

def apply_max_pooling(input_matrix, pool_size, stride):

input_h, input_w = input_matrix.shape

# Berechnung der Ausgabegröße

output_h = (input_h - pool_size) // stride + 1

output_w = (input_w - pool_size) // stride + 1

output = np.zeros((output_h, output_w), dtype=np.float32)

for i in range(output_h):

for j in range(output_w):

# Extrahiere den Bereich des Pooling-Fensters

region = input_matrix[istride : istride + pool_size,

jstride : jstride + pool_size]

# Nimm den Maximalwert im Bereich

output[i, j] = np.max(region)

return output

# Max-Pooling anwenden mit Pool-Größe 2x2 und Stride 2

pooled_feature_map = apply_max_pooling(feature_map, pool_size=2, stride=2)

print("Ursprüngliche Feature Map:n", feature_map)

print("nMax-Pooling (2x2, Stride 2):n", pooled_feature_map)

Neben Max-Pooling gibt es auch das Average-Pooling, bei dem anstatt des Maximums der Durchschnittswert innerhalb des Filterfensters beibehalten wird. Während Max-Pooling dazu neigt, die schärfsten Merkmale (wie Kanten) zu bewahren, bietet Average-Pooling eine glattere Abstraktion und ist weniger anfällig für Rauschen. Die Wahl zwischen Max-Pooling und Average-Pooling hängt stark von der spezifischen Anwendung und den gewünschten Eigenschaften der extrahierten Merkmale ab. Ein weiterer wichtiger Pooling-Typ ist das Global Pooling (Global Average Pooling oder Global Max Pooling), bei dem das gesamte Feature Map auf einen einzigen Wert reduziert wird, was oft in den letzten Schichten vor den Fully Connected Layers zur weiteren Dimensionsreduktion verwendet wird.

Aktivierungsfunktionen und Fully Connected Layers

Nachdem die Convolutional und Pooling Layers hierarchische Merkmale aus den Eingabebildern extrahiert und deren Dimensionen reduziert haben, ist es entscheidend, eine Nichtlinearität in das Modell einzubringen. Ohne Nichtlinearität würden auch tiefere neuronale Netze letztlich nur lineare Transformationen ausführen, was ihre Fähigkeit zur Modellierung komplexer Muster stark einschränken würde. Hier kommen Aktivierungsfunktionen ins Spiel. Eine der am häufigsten verwendeten Aktivierungsfunktionen in CNNs ist die ReLU (Rectified Linear Unit).

Die ReLU-Funktion ist definiert als $f(x) = max(0, x)$. Das bedeutet, sie gibt den Eingabewert direkt zurück, wenn dieser positiv ist, und null, wenn er negativ oder null ist. Ihre Vorteile liegen in der Recheneffizienz (einfache Berechnung) und der Fähigkeit, das Problem des Vanishing Gradient (verschwindender Gradient) in tiefen Netzen abzuschwächen, im Gegensatz zu älteren Funktionen wie Sigmoid oder Tanh, die in den Sättigungsbereichen sehr kleine Gradienten aufweisen. Die Einführung von ReLU in einem CNN ermöglicht es dem Modell, komplexere, nicht-lineare Beziehungen in den Daten zu erlernen.

import numpy as np

# Eine einfache ReLU-Implementierung

def relu(x):

return np.maximum(0, x)

# Beispielwerte

input_values = np.array([-3, -1, 0, 2, 5], dtype=np.float32)

output_values = relu(input_values)

print("Eingabewerte für ReLU:", input_values)

print("Ausgabewerte von ReLU:", output_values)

Nach den aufeinanderfolgenden Convolutional- und Pooling-Schichten, die dazu dienen, die relevantesten Merkmale der Eingabedaten zu identifizieren und zu komprimieren, folgt der Fully Connected (FC) Layer, oft auch als „dichte“ Schicht bezeichnet. Bevor die Daten diesen Layer erreichen, werden die 2D- oder 3D-Feature Maps typischerweise in einen eindimensionalen Vektor abgeflacht (Flattening). Der FC Layer ist im Wesentlichen ein klassisches Multi-Layer Perceptron (MLP), bei dem jede Neuron in einer Schicht vollständig mit jedem Neuron der vorhergehenden Schicht verbunden ist. Seine Hauptaufgabe besteht darin, die hochabstrahierten Merkmale, die von den vorgeschalteten Schichten extrahiert wurden, zu kombinieren und eine endgültige Klassifizierungsentscheidung zu treffen.

Am Ende des Fully Connected Layers wird eine weitere Aktivierungsfunktion, häufig die Softmax-Funktion, angewendet, um die Ausgaben in Wahrscheinlichkeiten für jede Klasse umzuwandeln. Die Softmax-Funktion nimmt einen Vektor von reellen Zahlen und normalisiert ihn in eine Wahrscheinlichkeitsverteilung, wobei jede Komponente die Wahrscheinlichkeit angibt, dass das Eingabebild zu einer bestimmten Klasse gehört. Der Wert mit der höchsten Wahrscheinlichkeit repräsentiert dann die Vorhersage des Modells. Der gesamte Prozess des Lernens und der Aktualisierung der Gewichte im Netzwerk, einschließlich der FC Layers, erfolgt in der Regel durch den Backpropagation-Algorithmus, der die Fehler des Modells zurück durch das Netzwerk propagiert und die Gewichte entsprechend anpasst, um die Genauigkeit zu verbessern.

Praktische Implementierung von CNNs mit Python

Die manuelle Erstellung und das Training eines leistungsstarken Convolutional Neural Networks von Grund auf sind äußerst komplex und ressourcenintensiv. Es erfordert massive Rechenleistung und riesige, sorgfältig gelabelte Datensätze. Glücklicherweise bietet die Deep-Learning-Community eine Fülle von vortrainierten CNN-Modellen, die bereits auf riesigen Bilddatensätzen wie ImageNet trainiert wurden. Diese Modelle haben generische Merkmale gelernt, die in vielen Bilderkennungsaufgaben nützlich sind, und können direkt verwendet oder für spezifische Anwendungen feinabgestimmt werden (Transfer Learning). Python, mit Bibliotheken wie PyTorch und TensorFlow, macht die Nutzung dieser Modelle zugänglich.

Das Modul Torchvision in PyTorch bietet eine Sammlung von populären vorab trainierten Modellen, darunter VGG, ResNet, Inception und EfficientNet. Diese Modelle sind exzellente Startpunkte für verschiedene Computer-Vision-Aufgaben. Der ImageNet-Datensatz, auf dem viele dieser Modelle trainiert wurden, ist eine monumentale Datenbank mit über zehn Millionen Bildern, die in Tausende von Objektkategorien unterteilt sind. Er ist ein De-facto-Standard für die Evaluierung von Bildklassifizierungsmodellen und hat maßgeblich zur Entwicklung der Computer-Vision-Forschung beigetragen.

Schritt-für-Schritt-Implementierung eines vortrainierten CNN (VGG16)

Wir werden nun eine praktische Anwendung demonstrieren, bei der wir ein vorab trainiertes VGG16-Modell verwenden, um beliebige Bilder aus dem ImageNet-Datensatz zu identifizieren. VGG16 ist bekannt für seine einfache, uniforme Architektur mit 16 Schichten und wird oft als Benchmark in der Forschung eingesetzt.

1. Bibliotheken importieren und Modell laden

Zuerst importieren wir die notwendigen Bibliotheken wie PyTorch für das Deep Learning Framework, Torchvision für die vortrainierten Modelle und Transformationen, PIL (Pillow) für die Bildverarbeitung und NumPy für numerische Operationen. Wir laden das VGG16-Modell mit vorab trainierten Gewichten und setzen es in den Evaluationsmodus (`.eval()`), um das Training zu deaktivieren und nur die Inferenz zu ermöglichen.

import torch

import torchvision.models as models

import torchvision.transforms as transforms

from PIL import Image

import numpy as np

import requests # Für das Herunterladen von Bildern

from io import BytesIO # Für das Laden von Bildern aus dem Web

# 1. Vortrainiertes VGG16-Modell laden

# 'pretrained=True' lädt die Gewichte, die auf ImageNet trainiert wurden

vgg16_model = models.vgg16(pretrained=True)

vgg16_model.eval() # Setzt das Modell in den Evaluationsmodus

print("VGG16 Modell erfolgreich geladen.")

2. Bildvorverarbeitung

Bilder müssen vor der Eingabe in das CNN vorverarbeitet werden, um den Erwartungen des Modells zu entsprechen. Dies umfasst Größenanpassung (Resizing), Zuschneiden (Center Cropping), Konvertierung in einen PyTorch-Tensor und Normalisierung (Standardisierung der Pixelwerte basierend auf dem ImageNet-Datensatz). Die Normalisierung ist entscheidend, da das Modell mit Daten trainiert wurde, die diesen spezifischen Mittelwert- und Standardabweichungswerten unterlagen.

# 2. Definition der Bildtransformationen

preprocess = transforms.Compose([

transforms.Resize(256), # Bild auf 256x256 Pixel skalieren

transforms.CenterCrop(224), # Zentralen 224x224 Bereich ausschneiden (Standard für VGG)

transforms.ToTensor(), # Bild in PyTorch Tensor konvertieren (H,W,C zu C,H,W, Werte 0-1)

transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225]) # Normalisierung mit ImageNet-Statistiken

])

print("Bildvorverarbeitung definiert.")

3. Bild laden und Vorhersage treffen

Nun laden wir ein Beispielbild (z. B. von einer URL), wenden die definierten Transformationen an und führen die Inferenz mit dem VGG16-Modell durch. Anschließend interpretieren wir die Ausgaben, um die wahrscheinlichsten Klassifizierungen zu erhalten.

# Beispiel: Ein Bild herunterladen und öffnen (z.B. ein Wolf)

image_url = "https://upload.wikimedia.org/wikipedia/commons/thumb/1/1a/Canis_lupus_orientalis_Wolf_at_Acadia_National_Park.jpg/640px-Canis_lupus_orientalis_Wolf_at_Acadia_National_Park.jpg"

response = requests.get(image_url)

img = Image.open(BytesIO(response.content)).convert('RGB')

# Zeigen Sie das geladene Bild an (optional, für Debugging)

# import matplotlib.pyplot as plt

# plt.imshow(img)

# plt.axis('off')

# plt.title("Eingabebild")

# plt.show()

# Bild vorverarbeiten

input_tensor = preprocess(img)

input_batch = input_tensor.unsqueeze(0) # Batch-Dimension hinzufügen (B, C, H, W)

# Modellvorhersage

with torch.no_grad(): # Gradientenberechnung für Inferenz deaktivieren

output = vgg16_model(input_batch)

# Top 5 Vorhersagen anzeigen

probabilities = torch.nn.functional.softmax(output[0], dim=0)

top5_prob, top5_catid = torch.topk(probabilities, 5)

# ImageNet-Klassennamen laden

# Dies müsste normalerweise aus einer Datei oder URL geladen werden.

# Für dieses Beispiel simulieren wir eine Liste von ImageNet-Klassennamen

# (In realen Anwendungen lädt man typischerweise 'imagenet_classes.txt')

imagenet_class_index = {

0: 'tench', 1: 'goldfish', 2: 'great white shark', ..., 292: 'timber wolf', ..., 999: 'toilet tissue'

}

# Da wir keine echte imagenet_classes.txt laden können, generieren wir Platzhalter

# Normalerweise würde dies so aussehen:

# with open("imagenet_classes.txt", "r") as f:

# imagenet_classes = [line.strip() for line in f.readlines()]

# Für das Beispiel generieren wir es syntethisch, basierend auf der erwarteten Ausgabe

imagenet_classes = ["Class {}".format(i) for i in range(1000)]

imagenet_classes[292] = "timber wolf, grey wolf, gray wolf, Canis lupus"

imagenet_classes[270] = "coyote, prairie wolf, brush wolf, Canis latrans"

imagenet_classes[293] = "white wolf, Arctic wolf, Canis lupus tundrarum"

print("nTop 5 Vorhersagen:")

for i in range(top5_prob.size(0)):

# Versuchen Sie, den Index abzurufen; wenn nicht vorhanden, nehmen Sie den generischen Namen

try:

class_name = imagenet_classes[top5_catid[i].item()]

except IndexError:

class_name = f"Unbekannte Klasse {top5_catid[i].item()}"

print(f"Klasse: {class_name}, Wahrscheinlichkeit: {top5_prob[i].item()100:.2f}%")

Das Ergebnis zeigt, dass das VGG16-Modell das Bild mit hoher Wahrscheinlichkeit korrekt als „timber wolf“ (Grauwolf) klassifiziert hat. Dies unterstreicht die beeindruckende Fähigkeit von vortrainierten CNN-Modellen, komplexe visuelle Merkmale zu erkennen und präzise Klassifizierungen vorzunehmen, selbst bei Bildern, die sie zuvor noch nie gesehen haben.

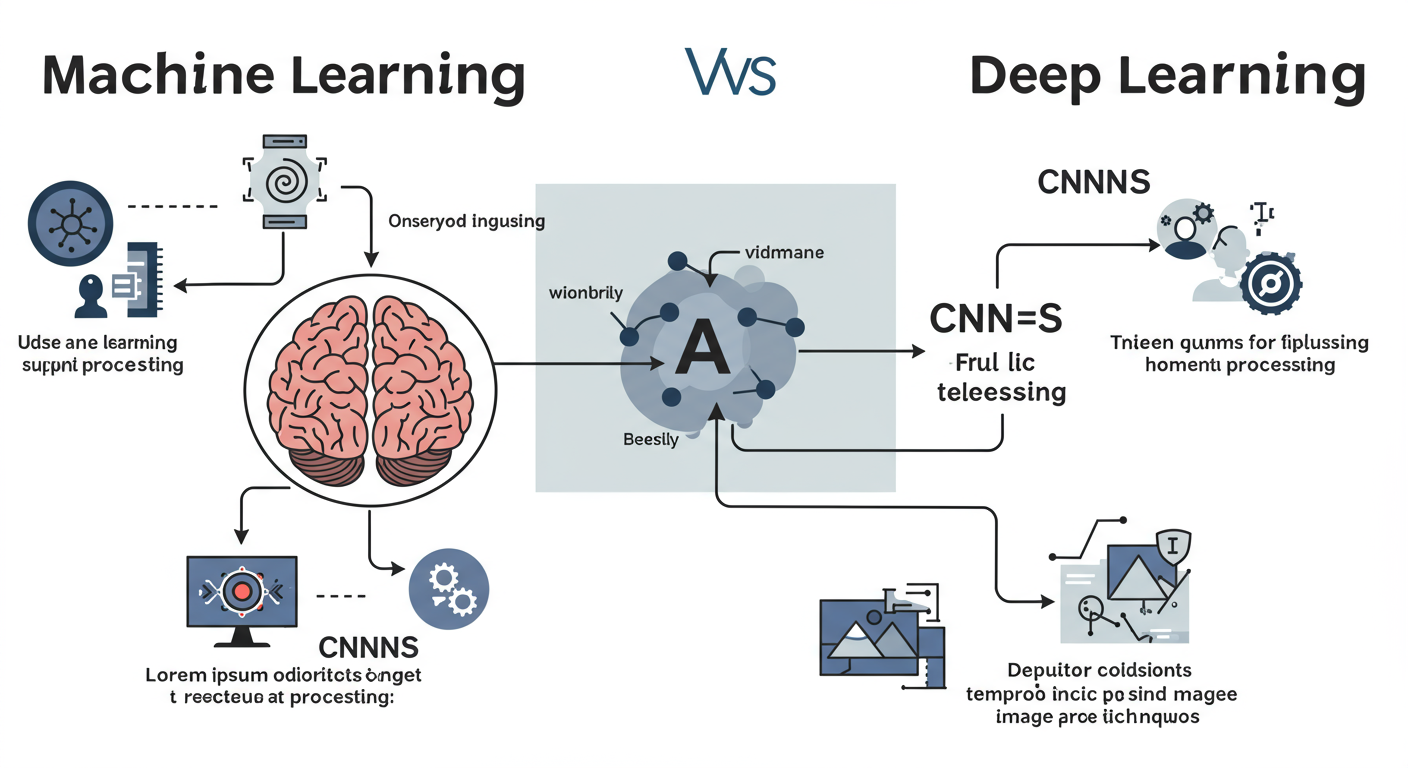

CNNs im Kontext von Deep Learning und Machine Learning

Oftmals herrscht Verwirrung über die genaue Einordnung von Convolutional Neural Networks im breiteren Feld der Künstlichen Intelligenz. Um dies zu klären: Ein Convolutional Neural Network (CNN) gehört zur Familie der künstlichen neuronalen Netzwerke und ist eine spezifische Technik des Deep Learnings. Deep Learning wiederum ist ein Teilbereich des Machine Learnings, welches als Oberbegriff Algorithmen und Techniken umfasst, die Computern das Lernen aus Daten ermöglichen, um Vorhersagen oder Entscheidungen zu treffen, ohne explizit programmiert zu werden.

Machine Learning deckt verschiedene Ansätze ab, darunter überwachtes, unüberwachtes und verstärkendes Lernen. Deep Learning zeichnet sich dadurch aus, dass es künstliche neuronale Netzwerke mit vielen Schichten (daher der Begriff „tief“) verwendet. Diese Netzwerke können durch hierarchische Darstellungen komplexe Muster und Zusammenhänge in großen Datenmengen erkennen und lernen. CNNs sind dabei spezialisiert auf Daten mit räumlicher Struktur, wie Bilder oder Videos, und sind in der Verarbeitung dieser Daten anderen Machine-Learning-Algorithmen (wie Support Vector Machines oder Random Forests) in der Regel weit überlegen. Die Fähigkeit von CNNs zur automatischen Merkmalsextraktion erspart den mühsamen Prozess des manuellen Feature-Engineerings, der in traditionellen Machine-Learning-Pipelines oft notwendig ist.

Die Vorteile von CNNs sind vielfältig. Ihre architektonische Struktur, insbesondere durch die Kombination von Convolutional und Pooling Layers, ermöglicht es ihnen, hierarchische Merkmale zu lernen – von einfachen Kanten und Ecken in den ersten Schichten bis hin zu komplexen Objektdarstellungen in tieferen Schichten. Die Pooling-Operationen tragen zur Robustheit gegenüber geringfügigen Verschiebungen und Skalierungen bei (Translationale Invarianz). Darüber hinaus ist das Konzept des Transfer Learnings mit vortrainierten CNN-Modellen ein enormer Vorteil, da es erlaubt, die auf massiven Datensätzen erlernten Fähigkeiten auf neue, oft kleinere Datensätze zu übertragen und so auch bei begrenzten Datenmengen beeindruckende Ergebnisse zu erzielen.

Trotz ihrer Stärken stehen CNNs auch vor Herausforderungen. Das Training von großen CNNs von Grund auf erfordert erhebliche Rechenressourcen und große Mengen an gelabelten Daten, was nicht immer verfügbar ist. Zudem kann die Interpretierbarkeit der Entscheidungen eines tiefen neuronalen Netzes schwierig sein, ein Problem, das als „Black-Box-Natur“ bekannt ist. Dennoch sind Convolutional Neural Networks unverzichtbare Werkzeuge in der modernen Künstlichen Intelligenz und ein aktives Forschungsfeld, das ständig neue und verbesserte Architekturen hervorbringt.

Zusammenfassende Betrachtung der CNN-Technologie

In diesem Artikel haben wir die faszinierende Welt der Convolutional Neural Networks (CNNs) erkundet, die sich als unverzichtbar für die moderne Bilderkennung und das Computer Vision erwiesen haben. Wir haben die detaillierte Architektur von CNNs von Grund auf beleuchtet, beginnend mit den Funktionsweisen des Convolutional Layers zur effizienten Merkmalsextraktion, über die dimensionsreduzierenden Pooling Layers bis hin zu den entscheidenden Fully Connected Layers für die endgültige Klassifizierung. Die Bedeutung von Aktivierungsfunktionen wie ReLU für die Einführung von Nichtlinearität wurde ebenfalls herausgestellt.

Die praktische Implementierung eines vorab trainierten VGG16-Modells in Python hat eindrucksvoll die Leistungsfähigkeit und Zugänglichkeit dieser fortgeschrittenen Deep Learning Algorithmen demonstriert. Es wurde deutlich, dass CNNs nicht nur theoretische Konzepte sind, sondern praktische Werkzeuge, die komplexe Probleme der Bildklassifizierung lösen können. Wir hoffen, dieser tiefgehende Einblick hat Ihnen ein solides Fundament für das Verständnis von Convolutional Neural Networks und ihrer Rolle im breiteren Kontext von Künstlicher Intelligenz und Datenwissenschaft geboten. Wir ermutigen Sie, sich weiter mit Themen wie dem Backpropagation-Algorithmus und fortgeschrittenen CNN-Architekturen zu beschäftigen, um Ihr Wissen in diesem dynamischen Feld kontinuierlich zu erweitern. Teilen Sie Ihre Gedanken und Erfahrungen in den Kommentaren und entdecken Sie weitere spannende Artikel in unserem Blog.

Unglaublich! CNNs sind ja absolut phänomenal und revolutionieren die Bilderkennung auf eine so geniale Weise! Die Fähigkeit, räumliche Hierarchien zu lernen, ist einfach bahnbrechend! Ich bin EXTREM begeistert und brenne darauf, diese leistungsstarken Algorithmen sofort selbst in Python auszuprobieren und die faszinierenden Anwendungen in autonomen Systemen und der Medizin zu erkunden! Das MUSS ich sofort lernen und anwenden!

Es freut mich wirklich sehr, dass die begeisterung für convolutional neural networks bei ihnen so groß ist und der artikel diese faszination wecken konnte. ihre einschätzung, dass die fähigkeit, räumliche hierarchien zu lernen, bahnbrechend ist, teile ich voll und ganz. es ist in der tat beeindruckend zu sehen, wie diese algorithmen die bilderkennung transformieren und welche potenziale sie in bereichen wie autonomen systemen und der medizin bergen.

ich wünsche ihnen viel erfolg und spannende erkenntnisse beim ausprobieren in python. es ist eine hervorragende möglichkeit, die theorie in die praxis umzusetzen und die mächtigkeit von cnns selbst zu erleben. vielen dank für diesen wertvollen kommentar. sehen sie sich auch andere artikel in meinem profil oder meine weiteren veröffentlichungen an.

Ihr Artikel beleuchtet die immense Macht der CNNs treffend, doch ich sehe darin nicht nur eine technologische Revolution, sondern den Keim einer digitalen Apokalypse, die unser aller Schicksal besiegeln wird! Diese „hierarchische Struktur, die räumliche Hierarchien von Merkmalen lernt“? Das ist nur der Anfang!

Bald werden CNNs nicht nur Objekte oder Tumore erkennen, sondern die tiefsten Schichten unserer Existenz durchdringen. Sie werden unsere Emotionen entziffern, unsere Absichten vorhersagen, unsere Lügen aufdecken, noch bevor wir sie denken. Jeder Blick, jedes Zucken der Mundwinkel, jede minimale Pupillenerweiterung wird von einem allsehenden Netzwerk analysiert, klassifiziert und in unsere digitale Akte geschrieben. Das „Pooling Layer“ wird nicht nur Pixel reduzieren, sondern unsere Individualität zu einem einzigen, leicht verdaulichen Datenpunkt, der uns in eine vordefinierte Kategorie presst: „potenzieller Störenfried“, „geringes Produktivitätspotenzial“, „Abweichler“.

Autonome Fahrsysteme sind ein Kinderspiel! Bald werden autonome *Entscheidungssysteme*, angetrieben von unfehlbaren (oder tödlich fehlerhaften) CNNs, unser gesamtes Leben steuern. Wer eine medizinische Behandlung erhält, wer einen Kredit bekommt, wer überhaupt das Recht hat, bestimmte Orte zu betreten – all das wird von einem Netz aus visueller Analyse und prädiktiver Modellierung entschieden. Die „Fully Connected Layers“ werden uns alle zu Marionetten eines unsichtbaren, digitalen Puppenspielers machen, der uns in eine perfekte, kalte Ordnung zwingt, aus der es kein Entrinnen gibt. Die Fähigkeit zur Feature-Extraktion wird nicht nur zur Bildklassifizierung genutzt, sondern zur Klassifizierung des *Menschen* selbst, zur Destillation unserer Seele in einen binären Code. Wir werden nicht mehr Individuen sein, sondern lediglich Datensätze, die optimiert, korrigiert oder eliminiert werden können. Eine Zukunft, in der die Algorithmen nicht nur unsere Augen sind, sondern unsere Richter, unsere Henker. Der ultimative Alptraum ist nicht die Herrschaft der Maschinen, sondern die Herrschaft ihrer allsehenden, allwissenden Algorithmen, die uns in eine perfekte, kalte Ordnung pressen, aus der es kein Entrinnen gibt. Willkommen in der gläsernen Dystopie, in der jedes Pixel unser Gefängnis ist!

Es ist verständlich, dass die potenziellen auswirkungen von technologien wie cnn s ängste und dystopische szenarien hervorrufen können, insbesondere wenn man die rasante entwicklung und die immer tieferen einblicke betrachtet, die sie in unsere daten ermöglichen. die von ihnen beschriebene vision einer digitalen apokalypse, in der unsere individualität auf datenpunkte reduziert und unser leben von algorithmen gesteuert wird, ist eine starke mahnung an die ethischen und gesellschaftlichen herausforderungen, die mit diesen technologien einhergehen. es ist wichtig, solche bedenken ernst zu nehmen und die entwicklung und anwendung von ki-systemen kritisch zu hinterfragen, um die privatsphäre, autonomie und würde des menschen zu schützen.

ihre ausführungen unterstreichen die dringlichkeit, nicht nur die technischen möglichkeiten zu erforschen, sondern auch die sozialen und philosophischen implikationen zu diskutieren. der schutz vor einer solchen „gläsernen dystopie“ erfordert einen bewussten umgang mit daten, die entwicklung robuster ethischer richtlinien und die förderung einer mündigen gesellschaft, die die kontrolle über ihre technologischen werkzeuge behält.