Die Leistungsfähigkeit und Präzision von Deep-Learning-Modellen hängt maßgeblich von der Quantität und Qualität der Trainingsdaten ab. In einer Ära, die oft als das Zeitalter von Big Data bezeichnet wird, mag es paradox klingen, doch die schiere Menge an verfügbaren Rohdaten ist nicht immer ausreichend oder vielfältig genug, um robuste und generalisierungsfähige Deep-Learning-Modelle zu trainieren. Hier setzt Data Augmentation an, eine entscheidende Technik, die künstlich die Datenbasis erweitert, um diesen Engpass zu überwinden und die Optimierung der Leistung von Deep Learning Modellen signifikant zu verbessern.

Dieser ausführliche Blogbeitrag taucht tief in die Welt der Datenanreicherung ein. Wir werden die genaue Definition von Data Augmentation beleuchten, die feinen Unterschiede zwischen synthetischen und erweiterten Daten herausarbeiten und detailliert die Funktionsweise dieser Technik für verschiedene Datentypen, insbesondere visuelle und textuelle Daten, erörtern. Zudem werden wir die vielfältigen Vorteile und potenziellen Nachteile kritisch analysieren, die mit dem Einsatz von Data Augmentation verbunden sind, um Ihnen ein umfassendes Verständnis dieser unverzichtbaren Methode in der modernen Künstlichen Intelligenz und Softwareentwicklung zu vermitteln.

Grundlagen der Data Augmentation im Deep Learning

Deep-Learning-Algorithmen, insbesondere Neuronale Netze, sind von Natur aus „daten-hungrig“. Um komplexe Muster zu erkennen und zuverlässige Vorhersagen zu treffen, benötigen sie umfangreiche und vielfältige Trainingsdatensätze. Ohne genügend Daten neigen Modelle dazu, sich an spezifische Beispiele im Trainingsset zu „überanpassen“ (Overfitting), was ihre Fähigkeit beeinträchtigt, auf neue, ungesehene Daten zu generalisieren. Dies ist ein fundamentales Problem bei der Entwicklung von KI-Anwendungen, insbesondere in Bereichen, wo die Datensammlung und -aufbereitung aufwendig oder begrenzt ist.

Data Augmentation begegnet diesem Problem, indem sie die vorhandenen Daten auf intelligente Weise transformiert oder neue, artifizielle Daten generiert. Das Ziel ist es, die Variabilität des Trainingsdatensatzes zu erhöhen, ohne tatsächlich neue Originaldaten sammeln zu müssen. Dies führt zu robusteren Modellen, die besser in der Lage sind, unterschiedliche Darstellungen der gleichen Entität zu erkennen, unabhängig von kleineren Variationen, Rauschen oder Verzerrungen, die in realen Szenarien auftreten können.

Synthetische versus Erweiterte Daten: Eine Klärung

Im Kontext der Data Augmentation ist es entscheidend, zwischen zwei Hauptkategorien der Datenvergrößerung zu unterscheiden, die oft verwechselt werden:

- Synthetische Daten: Dies sind vollständig künstlich erzeugte Daten, die keinen direkten Bezug zu realen Beobachtungen haben. Sie werden oft von komplexen generativen Modellen wie Generative Adversarial Networks (GANs) erstellt. Der Vorteil von synthetischen Daten liegt darin, dass sie komplett neu sind und somit keine direkten persönlichen Informationen enthalten, was sie besonders nützlich für Datenschutzbestimmungen wie die DSGVO macht.

- Erweiterte Daten (Augmented Data): Diese stammen aus Originaldaten, denen gezielte, meist kleine Transformationen hinzugefügt wurden. Sie sind eine modifizierte Version existierender realer Datenpunkte. Beispiele hierfür sind das Drehen eines Bildes, das Hinzufügen von Rauschen zu Audiodaten oder das Ersetzen von Wörtern in Texten durch Synonyme. Erweiterte Daten behalten eine starke Ähnlichkeit mit den Originaldaten bei und sind daher oft realitätsnäher, was in vielen Deep-Learning-Anwendungen bevorzugt wird.

Während erweiterte Daten die Variabilität innerhalb des realen Datenspektrums erhöhen, können synthetische Daten dazu beitragen, Lücken in der Datenverteilung zu schließen oder ganz neue Szenarien zu simulieren, die in den Originaldaten unterrepräsentiert sind. Die Wahl zwischen beiden Ansätzen oder einer Kombination davon hängt stark von den spezifischen Anforderungen des Projekts und den Eigenschaften der Daten ab.

| Merkmal | Synthetische Daten | Erweiterte Daten |

|---|---|---|

| Ursprung | Künstlich generiert, kein direkter realer Bezug | Basieren auf Originaldaten, transformiert |

| Datenschutz | Ideal für DSGVO-Compliance, da keine realen Personenbezüge | Kann ursprüngliche Datenschutzbedenken erben, wenn nicht anonymisiert |

| Realitätsnähe | Kann von der Realität abweichen, potenziell unrealistische Daten | Starke Ähnlichkeit mit der Realität, geringes Risiko unrealistischer Daten |

| Generierung | Oft komplex (z.B. GANs), rechenintensiv | Einfacher, oft regelbasiert oder durch Algorithmen |

| Anwendung | Schließen von Datenlücken, Privacy-Preserving AI | Verbesserung der Modellgeneralisation, Reduzierung von Overfitting |

Anwendungsbereiche und Relevanz

Data Augmentation ist in einer Vielzahl von Deep-Learning-Anwendungen unverzichtbar geworden. Ihre Bedeutung erstreckt sich über verschiedene Domänen:

- Bilderkennung und Computer Vision: Hier ist die Datenanreicherung am weitesten verbreitet. Bei der Objekterkennung, Bildklassifizierung und der semantischen Segmentierung ist es entscheidend, dass Modelle Objekte unter verschiedenen Blickwinkeln, Beleuchtungsbedingungen und Größen erkennen können. Augmented Images sind hier der Schlüssel.

- Natural Language Processing (NLP): Obwohl komplexer als bei Bildern, hilft Data Augmentation im NLP-Bereich bei Aufgaben wie Textklassifizierung, Stimmungsanalyse und Machine Translation, indem sie die Variabilität von Texten erhöht.

- Spracherkennung und Audioanalyse: Durch Hinzufügen von Hintergrundrauschen, Geschwindigkeitsänderungen oder Tonhöhenmodulationen können Modelle robuster gegenüber verschiedenen Aufnahmebedingungen gemacht werden.

- Medizinische Bildgebung: In der medizinischen Diagnostik, wo der Zugang zu ausreichend klinischen Daten oft stark eingeschränkt ist, ermöglicht Data Augmentation das Training präziser Modelle für die Erkennung von Krankheiten aus MRT-, CT- oder Röntgenbildern.

- Autonomes Fahren: Die Fähigkeit, Objekte wie Fußgänger, andere Fahrzeuge und Verkehrszeichen unter unterschiedlichen Wetterbedingungen, Tageszeiten und Perspektiven zu identifizieren, ist für autonome Fahrzeuge überlebenswichtig. Data Augmentation spielt hier eine zentrale Rolle bei der Simulation einer breiten Palette von Szenarien.

„Die Generalisierungsfähigkeit eines Deep-Learning-Modells ist direkt proportional zur Vielfalt der Daten, auf denen es trainiert wurde.“

Funktionsweise und Techniken der Data Augmentation

Die Kernidee hinter Data Augmentation ist es, die vorhandenen Trainingsdaten so zu manipulieren, dass die Modelle eine breitere Palette von Merkmalen und Variationen lernen können. Dies erhöht die Robustheit des Modells und seine Fähigkeit, auf reale, ungesehene Daten korrekt zu reagieren.

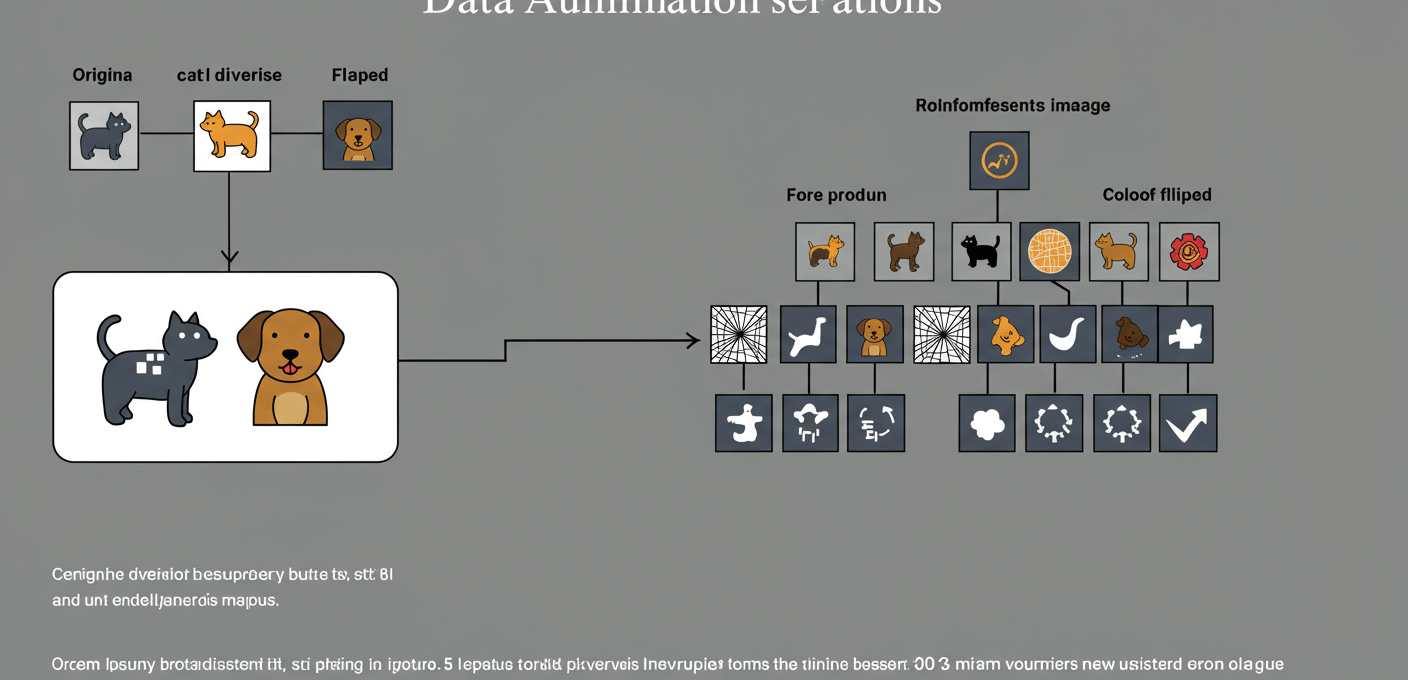

Mechanismen für visuelle Daten

Für visuelle Daten wie Bilder ist Data Augmentation am intuitivsten und am weitesten entwickelt. Die Transformationen sollen typische Variationen in der realen Welt widerspiegeln und das Modell lehren, die wesentlichen Merkmale eines Objekts unabhängig von diesen Variationen zu erkennen. Hier sind die gängigsten Techniken:

- Geometrische Transformationen:

- Rotation: Bilder werden um einen bestimmten Winkel gedreht. Dies hilft dem Modell, Objekte in verschiedenen Orientierungen zu erkennen. Eine Drehung um 0 bis 360 Grad kann angewendet werden.

- Spiegelung (Horizontal/Vertikal): Horizontales Spiegeln ist oft eine sichere Transformation (z.B. eine Katze bleibt eine Katze, auch wenn sie nach links statt nach rechts schaut). Vertikales Spiegeln ist seltener anwendbar, da es die Semantik des Bildes stark verändern kann (z.B. ein auf dem Kopf stehendes Auto).

- Skalierung und Zoom: Bilder werden vergrößert oder verkleinert. Das Modell lernt, Objekte in unterschiedlichen Entfernungen oder Größen zu identifizieren.

- Translation/Verschiebung: Das Objekt wird innerhalb des Bildausschnitts verschoben, was dem Modell hilft, die Position eines Objekts zu tolerieren.

- Shearing (Scherung): Das Bild wird in eine bestimmte Richtung „gekippt“, was perspektivische Verzerrungen simulieren kann.

- Farbtransformationen:

- Helligkeitsanpassung: Erhöhen oder Verringern der Bildhelligkeit.

- Kontrastanpassung: Ändern des Kontrasts, um das Modell gegenüber unterschiedlichen Lichtverhältnissen robuster zu machen.

- Sättigungsanpassung: Variieren der Farbsättigung.

- Graustufenumwandlung: Konvertierung von RGB-Bildern in Graustufen, um Merkmale zu lernen, die nicht farbabhängig sind.

- Rauschen hinzufügen:

- Gaußsches Rauschen: Zufälliges Hinzufügen von Werten aus einer Gaußschen Verteilung zu den Pixelintensitäten, um die Robustheit gegenüber Sensorausleserauschen zu verbessern.

- Salt-and-Pepper Rauschen: Zufälliges Setzen einiger Pixel auf Schwarz oder Weiß, simuliert Bildfehler.

- Spezielle Augmentationen:

- Random Erasing/Cutout: Zufälliges Löschen (Schwärzen oder Aufüllen mit Zufallswerten) eines Teils des Bildes. Dies zwingt das Modell, sich auf andere Teile des Objekts zu konzentrieren und ist besonders effektiv gegen Overfitting.

- Mixup/CutMix: Kombinieren von zwei Bildern und deren Labels, um neue Beispiele zu schaffen. Dies ist eine fortgeschrittene Technik, die zwischen verschiedenen Klassen interpoliert.

Hier ist ein beispielhafter Python-Code, der einige gängige Bild-Augmentationen mit der `imgaug`-Bibliothek demonstriert:

import imgaug.augmenters as iaa

import numpy as np

import matplotlib.pyplot as plt

from PIL import Image

# Beispielbild laden (oder ein Dummy-Array erstellen)

# Für reale Anwendungen müsste hier ein Bild geladen werden, z.B. mit cv2.imread

# Hier erstellen wir ein Dummy-Bild für die Demonstration

image = np.array(Image.open("example_image.jpg")) # Ersetzen Sie dies durch Ihren Bildpfad

# Beispiel: Ein 100x100x3 Array mit Zufallswerten

# image = np.random.randint(0, 255, (100, 100, 3), dtype=np.uint8)

# Definieren der Augmentations-Pipeline

# Mit OneOf können wir wählen, dass nur eine der folgenden Transformationen angewendet wird

# Oder Sequential, um alle nacheinander anzuwenden

augmenter = iaa.Sequential([

iaa.Fliplr(0.5), # 50% Wahrscheinlichkeit für horizontales Spiegeln

iaa.Sometimes(0.5, iaa.GaussianBlur(sigma=(0, 0.5))), # 50% Wahrscheinlichkeit für leichten Gaußschen Weichzeichner

iaa.LinearContrast((0.75, 1.5)), # Kontrast um 25% reduzieren oder um 50% erhöhen

iaa.AdditiveGaussianNoise(loc=0, scale=(0, 0.05255), per_channel=0.5), # Additive Gaußschem Rauschen

iaa.Multiply((0.8, 1.2), per_channel=0.2), # Helligkeit ändern

iaa.Affine(

scale={"x": (0.8, 1.2), "y": (0.8, 1.2)}, # Skalierung um 80-120%

translate_percent={"x": (-0.2, 0.2), "y": (-0.2, 0.2)}, # Verschiebung um -20% bis +20%

rotate=(-25, 25), # Rotation um -25 bis +25 Grad

shear=(-8, 8) # Scherung um -8 bis +8 Grad

)

], random_order=True) # Die Reihenfolge der Augmentationen wird zufällig gewählt

# Augmentierung auf das Bild anwenden

augmented_image = augmenter(image=image)

# Original- und augmentiertes Bild anzeigen (optional)

plt.figure(figsize=(10, 5))

plt.subplot(1, 2, 1)

plt.imshow(image)

plt.title("Originalbild")

plt.axis('off')

plt.subplot(1, 2, 2)

plt.imshow(augmented_image)

plt.title("Augmentiertes Bild")

plt.axis('off')

plt.show()Methoden für Textdaten

Die Datenanreicherung für Textdaten ist aufgrund der diskreten und strukturierten Natur von Sprache komplexer. Das bloße Ersetzen von Wörtern kann die Semantik eines Satzes drastisch verändern oder grammatisch inkorrekte Sätze erzeugen. Trotzdem gibt es effektive Ansätze:

- Einfache Data Augmentation (EDA):

- Synonym-Ersetzung: Wörter werden durch ihre Synonyme ersetzt. Hierfür sind lexikalische Datenbanken wie WordNet oder vortrainierte Wortvektoren nützlich. Es ist wichtig, den Kontext zu berücksichtigen, um die ursprüngliche Bedeutung nicht zu verfälschen.

- Zufälliges Einfügen: Ein zufälliges Synonym eines zufälligen Wortes im Satz wird an einer zufälligen Position eingefügt.

- Zufälliges Austauschen: Zwei zufällige Wörter im Satz tauschen ihre Positionen.

- Zufälliges Löschen: Wörter werden mit einer bestimmten Wahrscheinlichkeit aus dem Satz entfernt. Dies hilft dem Modell, die Bedeutung auch bei fehlenden Informationen zu erfassen.

- Rückübersetzung (Back-Translation): Der Originaltext wird in eine andere Sprache übersetzt und dann zurück in die Originalsprache. Dies führt oft zu geringfügig unterschiedlichen Formulierungen, die aber die ursprüngliche Bedeutung beibehalten. Zum Beispiel: Deutsch -> Englisch -> Deutsch.

- Kontextualisierte Worteinbettungen: Moderne vortrainierte Sprachmodelle wie BERT, GPT oder ELMo können genutzt werden, um Worteinbettungen zu generieren, die den Kontext berücksichtigen. Man kann Maskierungsstrategien anwenden, bei denen ein Wort maskiert und dann durch das Modell vorhergesagt wird, was zu kontextuell relevanten Alternativen führen kann.

- Paraphrasierung mit Sprachmodellen: Fortschrittliche generative Modelle können dazu verwendet werden, ganze Sätze oder Passagen zu paraphrasieren, also neu zu formulieren, ohne die Kernbedeutung zu ändern.

Ein Beispiel für zufälliges Austauschen von Wörtern in einem Satz:

import random

def random_swap(words, n):

"""

Tauscht zufällig n Wortpaare in einer Liste von Wörtern.

"""

new_words = words.copy()

for _ in range(n):

idx1, idx2 = random.sample(range(len(new_words)), 2)

new_words[idx1], new_words[idx2] = new_words[idx2], new_words[idx1]

return new_words

# Beispielanwendung

sentence = "Data Augmentation ist eine Technik zur Erweiterung von Datensätzen."

words = sentence.split()

# Erzeuge 3 augmentierte Versionen durch zufälliges Austauschen

print(f"Original: {sentence}")

for i in range(3):

augmented_words = random_swap(words, 2) # Tausche 2 Wortpaare

print(f"Augmentiert {i+1}: {' '.join(augmented_words)}")Dies ist ein einfaches Beispiel, und in realen Anwendungen würden komplexere Strategien, oft unter Einbeziehung von NLTK oder spaCy für Sprachverarbeitung, verwendet, um die Qualität der augmentierten Texte zu gewährleisten.

Fortgeschrittene Techniken der Data Augmentation

Jenseits der standardmäßigen Transformationen gibt es auch komplexere und automatisierte Ansätze, um die Datenanreicherung weiter zu optimieren:

- Generative Adversarial Networks (GANs): GANs können verwendet werden, um völlig neue, realistische Datenproben zu generieren, die den Verteilungen der Originaldaten ähneln. Ein Generator versucht, Fälschungen zu erzeugen, während ein Diskriminator versucht, echte von gefälschten Daten zu unterscheiden. Dies kann besonders nützlich sein, wenn die Originaldaten sehr begrenzt sind oder spezifische, seltene Fälle simuliert werden müssen.

- AutoAugment und RandAugment: Diese Ansätze suchen automatisiert nach optimalen Augmentationsrichtlinien (Kombinationen von Transformationen und deren Parametern) für einen gegebenen Datensatz und ein Modell. Anstatt manuell Augmentationen zu definieren, verwenden sie Reinforcement Learning oder einfache Suchalgorithmen, um die besten Augmentationsstrategien zu finden, die die Modellleistung maximieren.

- Neural Style Transfer: Obwohl nicht direkt eine Augmentationstechnik im klassischen Sinne, kann Style Transfer verwendet werden, um Bilder mit unterschiedlichen „Stilen“ (z.B. künstlerischen Texturen) zu versehen, während der Inhalt erhalten bleibt. Dies kann die Robustheit gegenüber stilistischen Variationen erhöhen.

Vor- und Nachteile der Datenanreicherung

Der Einsatz von Data Augmentation bringt erhebliche Vorteile mit sich, birgt aber auch potenzielle Fallstricke, die sorgfältig abgewogen werden müssen.

Signifikante Vorteile für Deep Learning

Die Datenvermehrung ist eine außerordentlich kostengünstige und effektive Methode zur Bewältigung vieler Herausforderungen beim Design neuronaler Deep-Learning-Netzwerke:

- Reduzierung von Overfitting und Verbesserung der Generalisierung: Der Hauptvorteil. Durch die Bereitstellung eines reichhaltigeren und vielfältigeren Trainingsdatensatzes lernt das Modell allgemeinere Merkmale und ist weniger anfällig dafür, sich an spezifische, irrelevante Muster der Trainingsdaten zu klammern. Es kann besser auf neue, ungesehene Daten verallgemeinern.

- Bewältigung von Datenknappheit: In vielen Anwendungsbereichen, wie der medizinischen Diagnostik oder der Fertigungsinspektion, sind qualitativ hochwertige, gelabelte Daten selten und teuer. Data Augmentation ermöglicht es, auch mit kleineren Originaldatensätzen leistungsstarke Modelle zu entwickeln.

- Kosteneffizienz und Zeitersparnis: Das manuelle Sammeln und Annotieren großer Datensätze ist extrem zeitaufwendig und teuer. Data Augmentation generiert künstlich große Mengen an Trainingsdaten in kurzer Zeit und zu geringeren Kosten.

- Erhöhte Robustheit gegenüber Rauschen und Variationen: Indem Rauschen, Helligkeitsänderungen oder leichte Verzerrungen simuliert werden, wird das Modell widerstandsfähiger gegenüber solchen Störungen in realen Daten.

- Datenschutz und Compliance: Die Generierung von synthetischen Daten bietet eine elegante Lösung, um die Anforderungen des Datenschutzes, wie sie beispielsweise die DSGVO vorschreibt, zu erfüllen. Unternehmen können die benötigten Datenmengen erhalten, ohne dabei die Persönlichkeitsrechte Einzelner zu verletzen, da die Daten keinen direkten Bezug zu realen Personen haben.

Potenzielle Herausforderungen und Nachteile

Trotz der vielen Vorteile müssen auch die Grenzen der Data Augmentation bedacht werden:

- Verstärkung von Bias: Wenn die Originaldaten bereits Vorurteile (Bias) enthalten (z.B. Unterrepräsentation bestimmter Gruppen oder Szenarien), können diese Verzerrungen durch Data Augmentation noch verstärkt werden. Die generierten Daten spiegeln die Bias der Ursprungsdaten wider und können zu diskriminierenden oder ungenauen Modellen führen.

- Qualitätssicherung: Die Gewährleistung der Qualität und Relevanz künstlich erweiterter Datensätze ist entscheidend und kann komplex sein. Zu aggressive oder unpassende Augmentationen können unrealistische oder semantisch inkorrekte Daten erzeugen, die das Modelllernen negativ beeinflussen. Dies erfordert oft menschliche Überprüfung und sorgfältige Parametrisierung der Augmentationsmethoden.

- Rechenressourcen und Komplexität: Insbesondere bei der Generierung synthetischer Daten mit Techniken wie GANs oder bei der automatisierten Suche nach Augmentationsstrategien (AutoAugment) können erhebliche Rechenressourcen und Fachkenntnisse in Data Engineering und MLOps erforderlich sein.

- Hyperparameter-Optimierung: Die Wahl der richtigen Augmentationsmethoden und ihrer Parameter (z.B. Rotationswinkel, Helligkeitsbereich) ist selbst eine Form der Hyperparameter-Optimierung, die Experimente und Validierung erfordert.

- Over-Augmentation: Eine übermäßige oder unsachgemäße Anwendung von Data Augmentation kann dazu führen, dass das Modell „zu viel“ lernt und sich auf unrealistische oder irrelevante Merkmale konzentriert, was die Leistung auf realen Daten paradoxerweise verschlechtern kann.

Die Zukunft der Datenanreicherung gestalten

Data Augmentation hat sich als ein Eckpfeiler im modernen Deep Learning etabliert und ist unerlässlich für die Entwicklung robuster, präziser und generalisierungsfähiger Modelle. Durch die intelligente Erweiterung von Datensätzen überwindet sie kritische Herausforderungen wie Datenknappheit und Overfitting und trägt maßgeblich zur Optimierung von Deep-Learning-Anwendungen bei.

Die kontinuierliche Weiterentwicklung von Techniken für visuelle und Textdaten, sowie fortgeschrittene Ansätze wie generative Modelle und automatisierte Augmentationsstrategien, unterstreicht die dynamische Natur dieses Feldes. Für Entwickler, Studenten und Technologiebegeisterte, die in der Welt der Künstlichen Intelligenz und Datenwissenschaft erfolgreich sein möchten, ist ein tiefes Verständnis und die praktische Anwendung von Data Augmentation unerlässlich. Bleiben Sie neugierig, experimentieren Sie und tragen Sie dazu bei, die Grenzen des Möglichen in der KI weiter zu verschieben. Für weitere tiefergehende Analysen und Anleitungen zu verwandten Themen, laden wir Sie ein, unsere weiteren Fachartikel zu erkunden und Ihre Kenntnisse kontinuierlich zu erweitern.

„Datenanreicherung“ – ein Begriff, der Effizienz verspricht. Doch während wir die Leistung optimieren, müssen wir uns nicht viel drängendere Fragen stellen, die unsere Privatsphäre betreffen? Woher stammen all diese „Rohdaten“, die angeblich nicht ausreichen? Wurden die Betroffenen gefragt, ob ihre Informationen nicht nur genutzt, sondern auch künstlich vervielfältigt und manipuliert werden dürfen, um noch „robustere“ Modelle zu trainieren?

Wie steht es um die Anonymität, wenn selbst aus angeblich anonymisierten Daten neue, synthetische Datensätze generiert werden? Können diese „erweiterten“ oder „synthetischen“ Daten nicht doch indirekte Rückschlüsse auf reale Individuen zulassen, besonders bei sensiblen visuellen oder textuellen Informationen? Wer garantiert, dass diese „daten-hungrigen“ Algorithmen nicht irgendwann Muster erkennen, die wir nie preisgeben wollten, und das auf der Grundlage von Daten, die wir nie bewusst bereitgestellt haben – geschweige denn zugestimmt haben, dass sie künstlich vergrößert werden?

Welche Kontrolle bleibt uns noch, wenn unsere digitalen Spuren nicht nur gesammelt, sondern endlos reproduziert und verfeinert werden, um uns noch genauer zu analysieren? Wird die „Optimierung“ der Leistung nicht auf Kosten einer weiteren Erosion unserer Privatsphäre gehen? Ist es nicht beunruhigend, wie selbst die „schwierige Datensammlung und -aufbereitung“ als Problem dargestellt wird, das es zu umgehen gilt – anstatt die ethischen Implikationen dieser Datensammlung selbst zu hinterfragen? Am Ende schaffen wir eine Welt, in der wir zu bloßen Datenpunkten in einem unersättlichen Kreislauf der Datenanreicherung werden. Wer schützt uns davor, in dieser datengetriebenen Zukunft vollständig transparent zu werden?

Das sind sehr wichtige und berechtigte fragen, die sie hier aufwerfen. die diskussion um datenanreicherung darf in der tat nicht nur auf effizienz und leistung reduziert werden, sondern muss zwingend die ethischen und datenschutzrechtlichen aspekte beleuchten. die herkunft der daten, die einwilligung der betroffenen und die grenzen der anonymisierung sind zentrale punkte, die in der praxis oft zu kurz kommen. es ist entscheidend, dass wir als gesellschaft klare richtlinien und technologien entwickeln, die sicherstellen, dass diese prozesse transparent und im einklang mit den rechten der individuen ablaufen.

ihre bedenken hinsichtlich der rückschlüsse auf reale individuen und der kontrolle über unsere digitalen spuren sind absolut nachvollziehbar. es braucht eine stärkere betonung auf privacy-enhancing technologies und eine gesetzgebung, die nicht nur die sammlung, sondern auch die reproduktion und nutzung von daten streng reguliert. die balance zwischen innovation und dem schutz der privatsphäre ist eine der größten herausforderungen unserer zeit, und es ist unsere gemeinsame aufgabe, diese diskussion aktiv zu führen und lösungen zu fordern. ich danke ihnen für ihren wertvollen kommentar

Die Technik der „Data Augmentation“ erscheint auf den ersten Blick als eine rein technische Lösung für ein fundamentales Problem der Künstlichen Intelligenz: den Hunger von Deep-Learning-Modellen nach umfangreichen und vielfältigen Trainingsdaten. Sie verspricht, die Leistung und Generalisierungsfähigkeit von KI-Systemen zu optimieren, indem sie die Datenbasis künstlich erweitert. Doch die moralischen und gesellschaftlichen Auswirkungen dieser Methode reichen weit über die Effizienzsteigerung hinaus und erfordern eine tiefgehende, kritische Betrachtung.

Die größte Sorge liegt in der potenziellen **Verstärkung und Verschleierung von Bias**. Wenn die ursprünglichen, oft begrenzten Datensätze bereits gesellschaftliche Vorurteile, Ungleichheiten oder eine unzureichende Repräsentation bestimmter Gruppen aufweisen, dann kann die künstliche Erweiterung dieser Daten diese Fehler nicht nur zementieren, sondern auch in einem größeren Maßstab reproduzieren und sogar amplifizieren. Ein Modell, das auf solchen „erweiterten“ Daten trainiert wird, mag technisch robuster erscheinen, aber seine inhärenten Verzerrungen könnten dadurch noch schwieriger zu erkennen und zu korrigieren sein. Es besteht die Gefahr, dass eine scheinbar reichhaltigere Datenbasis eine trügerische Sicherheit vortäuscht, während die zugrundeliegenden Schwachstellen und Diskriminierungen bestehen bleiben oder gar verstärkt werden.

Zudem wirft die Schaffung von „synthetischen Daten“ grundlegende Fragen nach der **Natur der Realität und der Wahrheit** in KI-Systemen auf. Wenn ein erheblicher Teil der Trainingsdaten nicht mehr direkt aus der empirischen Welt stammt, sondern generiert wurde, wie stellen wir sicher, dass die daraus abgeleiteten Muster und Entscheidungen die tatsächliche Welt akkurat widerspiegeln? Es könnte zu KI-Systemen führen, die in ihrer synthetischen Umgebung zwar hervorragend funktionieren, aber in der komplexen und unvorhersehbaren Realität fehlerhaft oder sogar schädlich agieren, weil die künstliche Erweiterung nicht alle Nuancen oder Ausnahmen der realen Welt abbilden konnte oder neue, unbeabsichtigte Muster eingeführt hat.

**Wer profitiert?**

Primär profitieren **Entwickler und Unternehmen**, die KI-Anwendungen erstellen. Sie können ihre Modelle schneller und kostengünstiger entwickeln, da der aufwendige Prozess der Datensammlung und -aufbereitung potenziell reduziert wird. Auch **Branchen mit sensitiven oder schwer zugänglichen Daten**, wie die Medizin (wo Patientendaten streng geschützt sind und selten sind) oder spezialisierte Ingenieurwissenschaften, können von der Möglichkeit profitieren, mit weniger realen Daten dennoch leistungsfähige Modelle zu trainieren. Letztlich können auch **Endnutzer** profitieren, wenn die durch Data Augmentation verbesserten KI-Systeme tatsächlich zu besseren Produkten, Dienstleistungen oder Erkenntnissen führen – beispielsweise präzisere Diagnosen, sicherere autonome Systeme oder effizientere Prozesse.

**Wer leidet möglicherweise darunter?**

Am stärksten gefährdet sind **marginalisierte oder unterrepräsentierte Bevölkerungsgruppen**. Wenn die Ausgangsdaten bereits ihre Merkmale unzureichend abbilden, könnten KI-Systeme, die auf augmentierten, aber verzerrten Daten trainiert wurden, diskriminierende Entscheidungen treffen – sei es bei der Kreditvergabe, der Jobsuche, der medizinischen Diagnose oder im Rechtssystem. Einzelpersonen, die von solchen fehlerhaften oder voreingenommenen KI-Entscheidungen betroffen sind, könnten erhebliche Nachteile erleiden, ohne die Ursache nachvollziehen oder anfechten zu können. Auch die **Gesellschaft als Ganzes** könnte leiden, wenn das Vertrauen in die Fairness und Verlässlichkeit von KI-Systemen erodiert, weil deren Entscheidungen als intransparent oder ungerecht empfunden werden. Zudem könnten **kleinere Akteure oder Forschungsgruppen** ohne die nötige Expertise oder Rechenleistung für eine sorgfältige und ethisch verantwortungsvolle Datenanreicherung ins Hintertreffen geraten, was die KI-Entwicklung weiter monopolisiert.

Zusammenfassend ist Data Augmentation ein mächtiges Werkzeug, das mit großer Sorgfalt und ethischer Verantwortung eingesetzt werden muss. Es ist nicht nur eine technische Optimierung, sondern hat das Potenzial, unsere soziale Realität und die Verteilung von Chancen und Risiken durch KI-Systeme maßgeblich zu beeinflussen. Ein kritischer Blick auf die Qualität und Repräsentativität der ursprünglichen Daten, die Transparenz der Augmentationsprozesse und eine ständige Überprüfung der Fairness der resultierenden Modelle sind unerlässlich, um die versprochenen Vorteile zu nutzen, ohne dabei neue oder verstärkte Ungerechtigkeiten zu schaffen.

Vielen dank für diesen außerordentlich detaillierten und durchdachten kommentar. es ist erfreulich zu sehen, dass die thematik der data augmentation nicht nur aus technischer, sondern auch aus tiefgehender ethischer und gesellschaftlicher perspektive beleuchtet wird. ihre ausführungen zur verstärkung von bias und zur natur der realität in synthetischen daten unterstreichen die komplexität und die potenziellen fallstricke dieser methode, die weit über die reine effizienz hinausgehen.

ihre differenzierte betrachtung, wer von dieser technologie profitiert und wer möglicherweise darunter leidet, ist essenziell für eine verantwortungsvolle diskussion. es ist in der tat von größter bedeutung, die auswirkungen auf marginalisierte gruppen stets im auge zu behalten und mechanismen zu entwickeln, die fairness und transparenz gewährleisten. nur durch eine solche kritische auseinandersetzung können wir sicherstellen, dass die vorteile der ki-entwicklung allen zugutekommen und nicht neue ungleichheiten schaffen. ich danke ihnen nochmals für diesen wertvollen beitrag und lade sie herzlich ein, auch weitere artikel in meinem profil oder meine weiteren veröffentlichungen zu lesen.