In der rasanten Welt der künstlichen Intelligenz (KI) nehmen Deep Neural Networks (DNNs) eine zentrale Stellung ein. Diese faszinierenden Architekturen, oft auch als tiefe neuronale Netze bezeichnet, sind das Herzstück vieler bahnbrechender Fortschritte, die wir in den letzten Jahren beobachten konnten. Von der Spracherkennung auf unseren Smartphones bis hin zu autonom fahrenden Fahrzeugen – die Funktionsweise eines Deep Neural Networks bildet die technologische Grundlage. Sie ahmen die neuronale Struktur und die Lernprozesse des menschlichen Gehirns nach, um komplexe Muster in riesigen Datenmengen zu erkennen und fundierte Entscheidungen zu treffen.

Dieser detaillierte Blogbeitrag beleuchtet die Grundlagen tiefer neuronaler Netze, ihre Architektur, Funktionsweise und die vielfältigen Anwendungsfälle, die sie in der modernen Technologie ermöglichen. Wir werden auch gängige Deep Learning Frameworks vorstellen und die fundamentalen Unterschiede zwischen Deep Learning und traditionellem Machine Learning herausarbeiten. Ziel ist es, Entwicklern, Studenten und Technologiebegeisterten ein tiefgehendes Verständnis für diese mächtige Technologie zu vermitteln, um die Grundlagen für eigene Projekte oder weiteres Studium zu legen.

Grundlagen Tiefer Neuronaler Netze (DNNs)

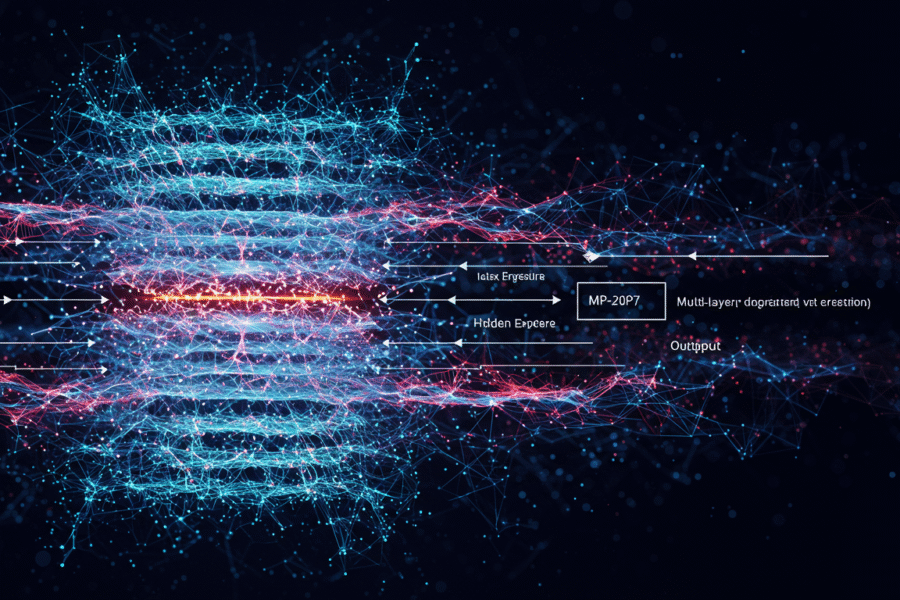

Ein Deep Neural Network (DNN) ist eine hochentwickelte Form eines künstlichen neuronalen Netzes (ANN), das sich durch eine besondere Eigenschaft auszeichnet: Es besitzt mehrere verborgene Schichten (engl. hidden layers) zwischen der Eingabeschicht (input layer) und der Ausgabeschicht (output layer). Während ein „flaches“ neuronales Netz typischerweise nur eine oder wenige Schichten aufweist, ermöglicht die „Tiefe“ eines DNNs die Modellierung und Extraktion hierarchischer Merkmale aus Daten, was zu einer erheblich verbesserten Fähigkeit führt, komplexe Muster zu lernen und zu repräsentieren. Diese Fähigkeit zur automatischen Merkmalsextraktion ist einer der Hauptgründe für die Überlegenheit von DNNs in vielen Anwendungsbereichen gegenüber traditionellen Machine-Learning-Methoden.

Die Inspiration für neuronale Netze stammt aus der Funktionsweise des menschlichen Gehirns. Analog zu den biologischen Neuronen und ihren Synapsen bestehen DNNs aus künstlichen Neuronen (Knoten), die in Schichten organisiert sind und über gewichtete Verbindungen miteinander kommunizieren. Jedes Neuron empfängt Eingaben, verarbeitet sie mithilfe einer Aktivierungsfunktion und leitet das Ergebnis an die Neuronen der nächsten Schicht weiter. Die „Tiefe“ des Netzwerks ermöglicht es, abstraktere und komplexere Merkmale in jeder aufeinanderfolgenden Schicht zu erkennen. Beispielsweise könnte eine erste Schicht Kanten in einem Bild erkennen, eine zweite Schicht Kombinationen von Kanten zu Formen und eine dritte Schicht Kombinationen von Formen zu Objekten. Dieses hierarchische Lernen ist entscheidend für die Leistungsfähigkeit von DNNs.

Die Architektur eines Deep Neural Networks verstehen

Die Architektur eines Deep Neural Networks ist entscheidend für seine Leistungsfähigkeit und seine Einsatzmöglichkeiten. Sie besteht aus mehreren Hauptkomponenten, die in einer spezifischen Reihenfolge angeordnet sind:

Die Eingabeschicht

Die Eingabeschicht ist der erste Teil des Netzwerks, der die Rohdaten empfängt. Jedes Neuron in dieser Schicht repräsentiert einen spezifischen Aspekt der Eingabedaten. Wenn es sich beispielsweise um ein Bild handelt, könnte jedes Neuron einem Pixelwert entsprechen. Bei Textdaten könnten die Eingaben Worteinbettungen sein. Es ist entscheidend, dass die Daten vor der Eingabe in das Netzwerk sorgfältig vorbereitet werden (Datenvorverarbeitung), um eine optimale Leistung zu gewährleisten. Dies beinhaltet oft Schritte wie Normalisierung, Standardisierung oder die Umwandlung in eine numerische Darstellung (z.B. One-Hot-Encoding oder Word Embeddings für Text).

Ein Beispiel für die Vorbereitung von Eingabedaten für ein einfaches neuronales Netz:

import numpy as np

# Beispiel: Rohdaten (Körpergröße in cm, Gewicht in kg)

roh_daten = np.array([

[175, 70],

[160, 55],

[190, 85],

[165, 60]

])

# Normalisierung der Daten auf den Bereich [0, 1]

# (min-max Skalierung)

min_vals = roh_daten.min(axis=0)

max_vals = roh_daten.max(axis=0)

normalisierte_daten = (roh_daten - min_vals) / (max_vals - min_vals)

print("Rohdaten:n", roh_daten)

print("nNormalisierte Daten (Eingabeschicht):n", normalisierte_daten)

Die verborgenen Schichten

Zwischen der Eingabe- und Ausgabeschicht liegen eine oder mehrere verborgene Schichten. Die Anzahl dieser Schichten bestimmt die „Tiefe“ des Netzwerks. Jede verborgene Schicht besteht aus einer Reihe von Neuronen, die über gewichtete Verbindungen mit den Neuronen der vorherigen Schicht verbunden sind. Diese Schichten sind dafür verantwortlich, abstrakte Merkmale aus den Eingabedaten zu extrahieren. Je tiefer die Schicht, desto komplexer und abstrakter sind in der Regel die Merkmale, die sie lernt. Zum Beispiel könnte eine frühe Schicht Kanten in einem Bild identifizieren, während eine tiefere Schicht komplexere Formen oder sogar Teile von Objekten (z.B. ein Auge, eine Nase) erkennen könnte.

Verschiedene Arten von Deep Neural Networks verwenden unterschiedliche Architekturen für ihre verborgenen Schichten, je nach Anwendungsfall:

- Feedforward Neural Networks (FNNs): Die einfachste Form, in der Informationen nur in eine Richtung fließen, von der Eingabe zur Ausgabe. Jedes Neuron in einer Schicht ist mit jedem Neuron der nächsten Schicht verbunden.

- Convolutional Neural Networks (CNNs): Spezialisiert auf die Verarbeitung von Gitter-ähnlichen Daten wie Bildern. Sie verwenden Faltungsschichten (Convolutional Layers), die lokale Muster (Features) in den Daten erkennen.

- Recurrent Neural Networks (RNNs): Geeignet für sequentielle Daten wie Text oder Zeitreihen, da sie interne Zustände (Gedächtnis) haben, die Informationen aus vorherigen Schritten speichern können.

- Generative Adversarial Networks (GANs): Bestehen aus zwei Netzwerken (Generator und Diskriminator), die im Wettbewerb miteinander lernen, um realistische Daten (z.B. Bilder) zu erzeugen.

Die Ausgabeschicht

Die Ausgabeschicht ist die letzte Schicht des DNNs und liefert das Endergebnis des Modells. Die Anzahl der Neuronen in dieser Schicht und die verwendete Aktivierungsfunktion hängen stark von der Art der zu lösenden Aufgabe ab. Bei einer Klassifikationsaufgabe (z.B. Bilderkennung, ob ein Bild eine Katze oder einen Hund zeigt) könnte die Ausgabeschicht so viele Neuronen haben, wie es Klassen gibt, und eine Softmax-Aktivierungsfunktion verwenden, um Wahrscheinlichkeiten für jede Klasse zu erzeugen. Bei einer Regressionsaufgabe (z.B. Vorhersage eines Immobilienpreises) könnte es ein einziges Neuron mit einer linearen Aktivierungsfunktion sein.

Die Wahl der richtigen Aktivierungsfunktionen im Deep Learning ist entscheidend für die Leistungsfähigkeit des Netzwerks. Diese nichtlinearen Funktionen ermöglichen es dem Netzwerk, komplexe Beziehungen in den Daten zu lernen. Ohne sie würde das Netzwerk nur lineare Transformationen ausführen, was seine Ausdruckskraft stark einschränken würde.

| Aktivierungsfunktion | Beschreibung | Anwendungsbereich |

|---|---|---|

| ReLU (Rectified Linear Unit) | f(x) = max(0, x). Führt Nichtlinearität ein, vermeidet das Verschwinden des Gradienten für positive Werte. | Verborgene Schichten in den meisten DNNs (Standardwahl). |

| Sigmoid | f(x) = 1 / (1 + e^-x). Komprimiert Werte zwischen 0 und 1. | Binäre Klassifikation (Ausgabeschicht), ältere Netze (verborgene Schichten). |

| Tanh (Hyperbolicus Tangens) | f(x) = (e^x - e^-x) / (e^x + e^-x). Komprimiert Werte zwischen -1 und 1. | Ähnlich wie Sigmoid, kann in verborgenen Schichten besser performen. |

| Softmax | Transformiert die Ausgaben so, dass sie als Wahrscheinlichkeitsverteilung interpretiert werden können (Summe = 1). | Multiklassen-Klassifikation (Ausgabeschicht). |

Neuronen und Konnektivität: Die Bausteine

Jedes Neuron, auch als Knoten bezeichnet, empfängt eine gewichtete Summe von Eingaben von den Neuronen der vorherigen Schicht. Zu dieser gewichteten Summe wird ein Bias-Wert addiert, und das Ergebnis wird dann durch eine Aktivierungsfunktion geleitet. Die Gewichte und Bias-Werte sind die Parameter des Modells, die während des Trainings gelernt werden. Sie bestimmen die Stärke und Richtung der Verbindungen und damit den Einfluss eines Eingangs auf die Ausgabe des Neurons.

„Das Wunder eines Deep Neural Networks liegt in seiner Fähigkeit, hierarchische Repräsentationen von Daten selbstständig zu entdecken und zu verfeinern – eine Eigenschaft, die es von herkömmlichen Algorithmen abhebt.“

Ein einfaches Beispiel für ein Neuron:

import numpy as np

def sigmoid(x):

return 1 / (1 + np.exp(-x))

def neuron_output(inputs, weights, bias):

"""

Berechnet die Ausgabe eines einzelnen Neurons.

inputs: Liste von Eingabewerten

weights: Liste von Gewichten für jede Eingabe

bias: Bias-Wert des Neurons

"""

weighted_sum = np.dot(inputs, weights) + bias

output = sigmoid(weighted_sum) # Beispiel mit Sigmoid-Aktivierungsfunktion

return output

# Beispielhafte Nutzung

inputs = np.array([0.5, 0.8, 0.2]) # Eingaben von vorheriger Schicht

weights = np.array([0.1, -0.3, 0.5]) # Gewichte für diese Verbindungen

bias = 0.2 # Bias für dieses Neuron

output_value = neuron_output(inputs, weights, bias)

print(f"Ausgabe des Neurons: {output_value:.4f}")

Funktionsweise: Von der Eingabe zur Ausgabe

Die Arbeitsweise eines Deep Neural Networks lässt sich in zwei Hauptphasen unterteilen: die Vorwärtsausbreitung (Forward Propagation) und die Rückwärtsausbreitung (Backward Propagation), die hauptsächlich während des Trainings zum Einsatz kommt.

Vorwärtsausbreitung (Forward Propagation)

Bei der Vorwärtsausbreitung durchlaufen die Eingabedaten das Netzwerk von der Eingabeschicht durch alle verborgenen Schichten bis zur Ausgabeschicht. In jeder Schicht werden die Ausgaben der vorherigen Schicht mit den Gewichten der aktuellen Schicht multipliziert, ein Bias addiert und das Ergebnis durch eine Aktivierungsfunktion geleitet. Dieser Prozess wiederholt sich Schicht für Schicht, bis das Netzwerk eine finale Ausgabe oder Vorhersage generiert.

Mathematisch kann die Aktivierung eines Neurons in einer Schicht als a = f(Wx + b) ausgedrückt werden, wobei x die Eingaben von der vorherigen Schicht, W die Gewichtsmatrix, b der Bias-Vektor und f die Aktivierungsfunktion ist. Die Vorwärtsausbreitung ist der Prozess, bei dem diese Berechnungen sequenziell für alle Neuronen und Schichten durchgeführt werden, um die Vorhersage des Modells zu erhalten.

Rückwärtsausbreitung (Backward Propagation) und Training

Die Phase des Trainings, oft als Training tiefer neuronaler Netze bezeichnet, ist der Kern des Deep Learning. Nachdem eine Vorhersage durch die Vorwärtsausbreitung gemacht wurde, wird diese mit dem tatsächlichen Zielwert verglichen, um den Fehler zu bestimmen. Dieser Fehler wird dann mithilfe der Rückwärtsausbreitung durch das Netzwerk zurückpropagiert. Das Ziel der Rückwärtsausbreitung ist es, die Gradienten der Fehlerfunktion bezüglich der Gewichte und Biase zu berechnen. Diese Gradienten geben an, in welche Richtung und wie stark die Gewichte und Biase angepasst werden müssen, um den Fehler zu minimieren.

Der Algorithmus des Gradientenabstiegs (oder einer seiner Varianten wie Adam, RMSprop oder SGD mit Momentum) nutzt diese Gradienten, um die Gewichte und Biase iterativ anzupassen. Dieser Prozess, bei dem das Netzwerk aus seinen Fehlern lernt und seine Parameter optimiert, ist das eigentliche „Lernen“. Über viele Trainingszyklen (Epochen) hinweg wird das Netzwerk immer besser darin, korrekte Vorhersagen zu treffen, bis es eine hohe Genauigkeit erreicht. Die Lernrate, ein Hyperparameter, steuert, wie stark die Gewichte bei jedem Schritt angepasst werden und ist entscheidend für einen effizienten Trainingsprozess.

Ein vereinfachtes Python-Beispiel zur Veranschaulichung eines Trainingsschritts:

import numpy as np

# Beispiel: Single-Neuron-Modell

# Eingabe, Gewicht, Bias, Zielwert

X = np.array([0.7])

y_true = np.array([0.9])

weight = np.array([0.5])

bias = np.array([0.1])

learning_rate = 0.1

def sigmoid(x):

return 1 / (1 + np.exp(-x))

def sigmoid_derivative(x):

return sigmoid(x) (1 - sigmoid(x))

# 1. Vorwärtsausbreitung

z = X weight + bias

y_pred = sigmoid(z)

# 2. Fehlerberechnung (Mean Squared Error)

error = (y_pred - y_true)2

print(f"Vorhersage: {y_pred:.4f}, Fehler: {error[0]:.4f}")

# 3. Rückwärtsausbreitung (Gradienten berechnen)

d_error = 2 (y_pred - y_true) # Ableitung des Fehlers nach y_pred

d_y_pred = sigmoid_derivative(z) # Ableitung von y_pred nach z

d_z = d_error d_y_pred # Gradient des Fehlers nach z

d_weight = d_z X # Gradient des Fehlers nach Gewicht

d_bias = d_z 1 # Gradient des Fehlers nach Bias (da bias direkt zu z addiert wird)

# 4. Gewichte aktualisieren (Gradientenabstieg)

new_weight = weight - learning_rate d_weight

new_bias = bias - learning_rate d_bias

print(f"Neues Gewicht: {new_weight[0]:.4f}, Neuer Bias: {new_bias[0]:.4f}")

# Ergebnis: Gewicht und Bias wurden leicht angepasst, um den Fehler zu reduzieren.

Bedeutung und Anwendungsfelder von Deep Neural Networks

Deep Neural Networks haben die Landschaft der künstlichen Intelligenz revolutioniert und sind heute unverzichtbar für eine Vielzahl von Technologien. Ihre Bedeutung liegt in der einzigartigen Fähigkeit, hochkomplexe Muster in großen, oft unstrukturierten Datensätzen zu erkennen, die für menschliche Analysten unerreichbar wären. Dies ermöglicht es ihnen, menschenähnliche oder sogar überlegene Leistungen in Bereichen zu erzielen, die traditionell als Domäne der menschlichen Kognition galten.

Die Vielseitigkeit von DNNs ist beeindruckend. Sie sind skalierbar, das heißt, ihre Leistung verbessert sich in der Regel mit der Menge der verfügbaren Daten und der Rechenleistung. Zudem sind sie in der Lage, Merkmale automatisch zu lernen (Feature Learning), was den Bedarf an manuellem Feature Engineering, einem oft zeitaufwändigen und fehleranfälligen Prozess im traditionellen Machine Learning, erheblich reduziert. Diese Fähigkeiten treiben Künstliche Intelligenz Entwicklung und Innovation in vielen Branchen voran.

Konkrete Anwendungsfälle für DNNs

Die Anwendungsfälle Deep Neural Network sind breit gefächert und nehmen stetig zu:

- Bild- und Objekterkennung: CNNs sind das Rückgrat der Bilderkennung und werden für Aufgaben wie Gesichtserkennung, Objektdetektion in autonomen Fahrzeugen, medizinische Bildanalyse zur Diagnose von Krankheiten (z.B. Tumoren) und die Kategorisierung von Bildern in sozialen Medien eingesetzt.

- Spracherkennung und Natural Language Processing (NLP): RNNs, insbesondere LSTM (Long Short-Term Memory) und GRU (Gated Recurrent Unit) Netzwerke, sowie moderne Transformer-Architekturen sind führend in der Spracherkennung, Übersetzung (z.B. Google Translate), Stimmungsanalyse, Chatbots und der automatischen Textzusammenfassung.

- Autonome Systeme: Selbstfahrende Autos und Drohnen nutzen DNNs, um ihre Umgebung wahrzunehmen, Objekte zu identifizieren, Entfernungen abzuschätzen und Fahrentscheidungen zu treffen.

- Medizinische Diagnostik und Arzneimittelforschung: DNNs analysieren medizinische Bilder, Gendaten und Patientenakten, um Krankheiten frühzeitig zu erkennen, personalisierte Behandlungspläne zu entwickeln und neue Medikamentenkandidaten zu identifizieren.

- Empfehlungssysteme: Plattformen wie Netflix, Amazon und Spotify verwenden DNNs, um personalisierte Empfehlungen für Filme, Produkte oder Musik basierend auf dem Nutzerverhalten zu generieren.

- Betrugserkennung: Im Finanzsektor helfen DNNs, betrügerische Transaktionen in Echtzeit zu identifizieren, indem sie ungewöhnliche Muster im Transaktionsverhalten erkennen.

- Robotik: Roboter nutzen DNNs für die Objekterkennung, die Navigation und die Steuerung komplexer Bewegungen.

Die fortlaufende Forschung und Entwicklung in diesem Bereich verspricht noch revolutionärere Anwendungen in der Zukunft.

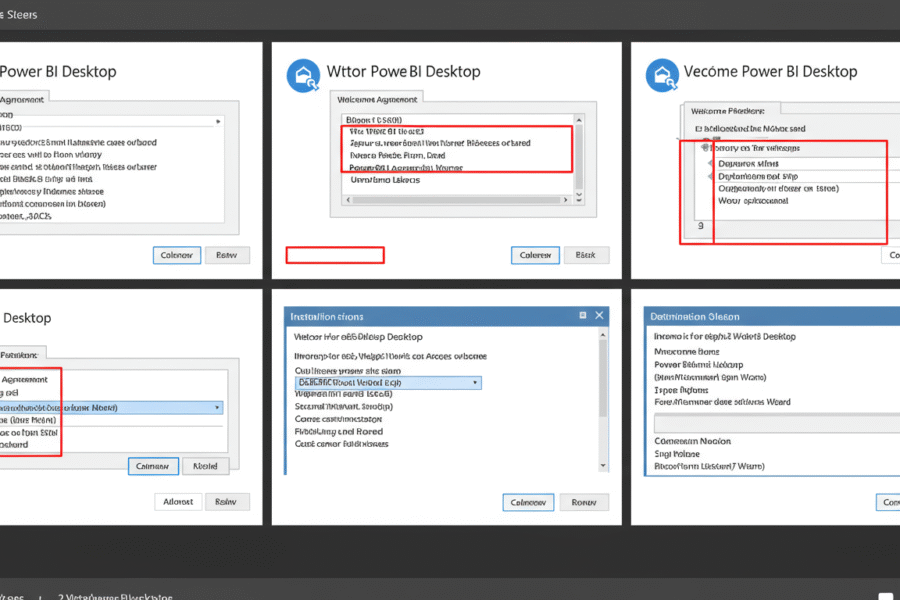

Populäre Deep Learning Frameworks und ihre Rolle

Um Deep Learning Frameworks Python zu entwickeln und anzuwenden, verlassen sich Entwickler auf spezialisierte Software-Bibliotheken und Frameworks. Diese Tools bieten Abstraktionsebenen, optimierte mathematische Operationen und vorgefertigte Module, die den Entwicklungsprozess erheblich vereinfachen. Die wichtigsten sind:

- TensorFlow: Entwickelt von Google, ist es eines der populärsten Open-Source-Frameworks. Es ist extrem flexibel, skalierbar und unterstützt sowohl die Forschung als auch die Produktion. Es bietet eine breite Palette an Werkzeugen, von High-Level-APIs wie Keras bis hin zu Low-Level-Operationen für feinste Kontrolle.

- PyTorch: Von Facebook entwickelt, hat PyTorch in der Forschungsgemeinschaft schnell an Beliebtheit gewonnen, dank seiner intuitiven API und seines dynamischen Berechnungsdiagramms, das das Debugging und die Modellentwicklung erleichtert. Es ist bekannt für seine Python-zentrische Schnittstelle.

- Keras: Eine High-Level-API, die auf TensorFlow, Theano oder CNTK läuft (am häufigsten auf TensorFlow). Keras ist für seine Benutzerfreundlichkeit und schnelle Prototypenentwicklung bekannt. Es ermöglicht das schnelle Bauen und Trainieren von neuronalen Netzen mit minimalem Code.

- Andere Frameworks: Dazu gehören MXNet (von Amazon Web Services unterstützt), Caffe (beliebt für Bildklassifikation) und Microsoft Cognitive Toolkit (CNTK). Jedes Framework hat seine Stärken und wird in spezifischen Anwendungsbereichen oder von bestimmten Gemeinschaften bevorzugt.

Ein einfaches Beispiel für die Definition eines DNN mit Keras:

from tensorflow import keras

from tensorflow.keras import layers

# Erstellen eines sequentiellen Modells (Layer-by-Layer)

model = keras.Sequential([

# Eingabeschicht und erste verborgene Schicht

layers.Dense(units=64, activation='relu', input_shape=(784,)), # 784 Neuronen in der Eingabe (z.B. 28x28 Bild)

# Zweite verborgene Schicht

layers.Dense(units=64, activation='relu'),

# Ausgabeschicht (z.B. 10 Klassen für Ziffernerkennung)

layers.Dense(units=10, activation='softmax')

])

# Modell kompilieren (Loss-Funktion, Optimierer, Metriken definieren)

model.compile(optimizer='adam',

loss='categorical_crossentropy',

metrics=['accuracy'])

# Zusammenfassung des Modells ausgeben

model.summary()

Deep Learning vs. Machine Learning: Ein detaillierter Vergleich

Obwohl Deep Learning eine Untergruppe des Machine Learnings ist, gibt es fundamentale Unterschiede in ihrer Architektur, Funktionsweise und den typischen Anwendungsbereichen. Das Verständnis dieser Unterschiede ist entscheidend, um die richtige Technologie für eine bestimmte Aufgabe auszuwählen und die Datenanalyse mit neuronalen Netzen effektiv zu gestalten.

| Aspekt | Deep Learning (DL) | Traditionelles Machine Learning (ML) |

|---|---|---|

| Architektur und Tiefe | Verwendet tiefe neuronale Netzwerke mit vielen Schichten (min. 2 verborgene Schichten). | Verwendet traditionelle Algorithmen (z.B. Support Vector Machines, Entscheidungsbäume) mit begrenzter oder keiner Tiefe. |

| Merkmalsextraktion | Kann relevante Merkmale (Features) aus den Rohdaten automatisch extrahieren und lernen (Feature Learning). | Benötigt oft manuelles Feature Engineering; Experten müssen relevante Merkmale vorab definieren. |

| Repräsentation der Daten | Kann unstrukturierte Daten (Bilder, Audio, Text, Video) direkt verarbeiten. | Arbeitet meist mit strukturierten Daten in tabellarischer Form; unstrukturierte Daten erfordern Vorverarbeitung. |

| Trainingsdaten und Skalierbarkeit | Profitiert stark von großen Datensätzen; Leistung skaliert gut mit mehr Daten. | Kann mit kleineren Datensätzen gute Ergebnisse erzielen; Leistung stagniert oft bei sehr großen Datenmengen. |

| Rechenleistung | Erfordert oft erhebliche Rechenleistung, insbesondere GPUs (Graphics Processing Units) oder TPUs (Tensor Processing Units). | Kann in der Regel auf Standard-Hardware ausgeführt werden; weniger rechenintensiv. |

| Komplexität der Aufgaben | Hervorragend bei komplexen Aufgaben wie Bild-/Spracherkennung, generativen Modellen, autonomen Systemen. | Effektiv bei einfacheren Klassifikations-, Regressions- oder Clustering-Aufgaben (z.B. Spam-Erkennung, Empfehlungssysteme, Betrugserkennung). |

| Interpretierbarkeit | Oft als „Black Box“ bezeichnet; die Entscheidungsfindung ist schwer zu interpretieren. | Viele Modelle sind relativ interpretierbar; die Wichtigkeit einzelner Features lässt sich oft nachvollziehen. |

| Entwicklungszeit | Initialer Aufbau kann komplex sein, aber Feature Engineering entfällt. | Feature Engineering kann zeitaufwändig sein, Modelltraining oft schneller. |

Die Tabelle verdeutlicht, dass Deep Learning insbesondere bei komplexen Aufgaben und großen, unstrukturierten Datensätzen seine Stärken ausspielt, während traditionelles Machine Learning oft eine gute Wahl für weniger komplexe Probleme mit strukturierten Daten ist. Die Wahl der Methode hängt von den spezifischen Anforderungen des Projekts, den verfügbaren Daten und den Rechenressourcen ab.

Fazit und Ausblick in die Welt der Deep Neural Networks

Deep Neural Networks sind zweifellos eine der transformativsten Technologien unserer Zeit, die das Potenzial haben, nahezu jeden Industriezweig zu verändern. Ihre Fähigkeit, durch tiefe Schichten hierarchische Merkmale selbstständig zu lernen, ermöglicht beispiellose Leistungen in Bereichen wie Bilderkennung, Sprachverarbeitung und vorausschauender Analytik.

Die kontinuierliche Weiterentwicklung von DNN-Architekturen, Optimierungsalgorithmen und Hardware wird die Grenzen dessen, was künstliche Intelligenz leisten kann, immer weiter verschieben. Für Entwickler, Studenten und Technologiebegeisterte bietet das Erlernen und Anwenden von tiefen neuronalen Netzen spannende Karrieremöglichkeiten und die Chance, an der Gestaltung der Zukunft mitzuwirken. Bleiben Sie neugierig, experimentieren Sie mit den vorgestellten Frameworks und vertiefen Sie Ihr Wissen in diesem dynamischen und faszinierenden Feld der KI. Wir freuen uns über Ihre Kommentare und Meinungen zu diesem Thema!

Dieser Artikel legt eine solide Basis und gibt einen hervorragenden Überblick über die Faszination und die grundlegende Funktionsweise von Deep Neural Networks. Die klare Abgrenzung und das Versprechen, Frameworks vorzustellen, sind definitiv Pluspunkte, um Entwickler und Studenten abzuholen.

**Es wäre aber noch besser, wenn es** nicht nur bei der Theorie bliebe, sondern konkrete, umsetzbare Code-Beispiele für die gängigen Frameworks (PyTorch, TensorFlow) enthalten wären. Ein ‚Hello World‘ für ein DNN, vielleicht sogar mit einem kleinen Datensatz, den man selbst nachvollziehen kann, würde den Lerneffekt enorm steigern und die Grundlagen für eigene Projekte wirklich legen.

**Was wirklich fehlt, ist** eine ehrliche Auseinandersetzung mit den Herausforderungen und Limitationen. DNNs sind mächtig, ja, aber der enorme Rechenaufwand, der Datenhunger und das berüchtigte ‚Black-Box‘-Problem sind entscheidende Punkte, die für angehende Entwickler unerlässlich sind. Eine Sektion zu Interpretierbarkeit (XAI) oder ethischen Aspekten wäre hier ein Muss.

**Es wäre aber noch besser, wenn es** über die ‚traditionellen‘ DNNs hinausginge und einen Ausblick auf die nächste Generation gäbe. Was ist mit Transformers, GNNs oder der Rolle von GANs? Die KI-Welt dreht sich schnell, und ein Blick in die Zukunft, vielleicht sogar mit einem Hauch von Quanten-KI, würde den Artikel von ‚gut‘ zu ‚wegweisend‘ machen.

**Was wirklich fehlt, ist** ein Abschnitt zu Optimierungsstrategien. Für Entwickler ist es nicht nur wichtig zu wissen, *was* ein DNN ist, sondern auch, *wie* man es effizient trainiert, Overfitting vermeidet und die Performance maximiert – Stichworte wie Hyperparameter-Tuning, Regularisierung oder Transfer Learning gehören hier einfach rein.

Dieser Artikel hat Potenzial, aber um wirklich als Produkt für die Zielgruppe zu glänzen, muss er von der reinen Beschreibung zur handlungsorientierten Anleitung und kritischen Reflexion übergehen.

Vielen dank für ihre ausführliche und konstruktive rückmeldung. es freut mich sehr, dass der artikel eine solide basis für das verständnis von deep neural networks legen konnte. ihre vorschläge, insbesondere bezüglich konkreter code-beispiele, der behandlung von herausforderungen wie rechenaufwand und dem black-box-problem, sowie einem ausblick auf neuere architekturtypen wie transformers und gans, sind äußerst wertvoll.

ich stimme ihnen vollkommen zu, dass eine tiefere beleuchtung von optimierungsstrategien und eine kritische reflexion der limitationen den artikel noch umfassender gestalten würden. diese punkte sind tatsächlich entscheidend für entwickler, die sich intensiver mit dem thema auseinandersetzen möchten. ich werde diese anregungen bei der überarbeitung und zukünftigen artikeln berücksichtigen, um eine noch handlungsorientiertere anleitung zu bieten. vielen dank nochmals für ihre gedanken. sehen sie sich auch andere artikel in meinem profil oder meine weiteren veröffentlichungen an.

Interessanter Überblick! Allerdings würde mich interessieren, auf welche konkreten Studien oder Daten sich die Aussage stützt, dass DNNs die „neuronale Struktur und die Lernprozesse des menschlichen Gehirns nachahmen“. Auch die Behauptung der „Überlegenheit von DNNs in vielen Anwendungsbereichen gegenüber traditionellen Machine-Learning-Methoden“ ist recht stark formuliert. Wäre es möglich, hierfür ein paar Benchmarks oder Fallstudien anzuführen, die diese Überlegenheit belegen, insbesondere in Kontexten, wo traditionelle Methoden nach wie vor ihre Stärken haben?

Vielen dank für ihre aufmerksamen fragen und das interesse an den details meiner ausführungen. es ist absolut richtig, dass solche aussagen einer soliden grundlage bedürfen. die nachahmung neuronaler strukturen und lernprozesse bezieht sich auf die architektur von tiefen neuronalen netzen, die von der schichtweisen verarbeitung im gehirn inspiriert ist, sowie auf lernmechanismen wie backpropagation, die eine analogie zu biologischen lernprozessen aufweisen, auch wenn es keine direkte eins-zu-eins-kopie ist. hierzu gibt es zahlreiche publikationen im bereich der computational neuroscience und des maschinellen lernens, die diese parallelen untersuchen.

bezüglich der überlegenheit in vielen anwendungsbereichen stütze ich mich auf die fortschritte, die in den letzten jahren in bilderkennung, natürlicher sprachverarbeitung und spieltheorie erzielt wurden. benchmarks wie imagenet für bildklassifikation oder gluescore für sprachmodelle zeigen oft signifikante leistungsverbesserungen durch dnn gegenüber klassischen methoden. für konkrete fallstudien, die diese überlegenheit belegen, könnten beispielsweise die ergebnisse von alphago im vergleich zu tradition