Die Ära des digitalen Wandels hat eine Flut von Daten hervorgebracht, die für Unternehmen und Forschungseinrichtungen gleichermaßen eine unschätzbare Ressource darstellen. In diesem Kontext hat sich eine Schlüsselrolle herauskristallisiert: der Data Scientist. Diese Experten sind die Architekten, die aus riesigen, oft unstrukturierten Datenmengen wertvolle Informationen extrahieren, Muster erkennen und zukunftsweisende Vorhersagen treffen. Ihre Arbeit bildet die Grundlage für innovative Produkte, optimierte Prozesse und strategische Entscheidungen.

Dieser ausführliche Blogbeitrag richtet sich an Entwickler, Studierende und Technologiebegeisterte, die tiefgehende Informationen über diesen facettenreichen Beruf suchen. Wir werden die Definition des Data Scientist ergründen, seine täglichen Aufgaben detailliert beleuchten, die entscheidenden Fähigkeiten und Technologien vorstellen, die für eine erfolgreiche Karriere in diesem Bereich notwendig sind, und schließlich die spannenden Karrierewege und Weiterbildungsmöglichkeiten aufzeigen. Erfahren Sie, wie Datenanalyse und prädiktive Modellierung die digitale Welt revolutionieren und welche Schritte Sie unternehmen können, um Teil dieser Transformation zu werden.

Die Essenz des Data Scientist Berufsfeldes

Der Begriff „Data Scientist“ wurde von der Harvard Business Review als „sexiest job of the 21st century“ bezeichnet – und das aus gutem Grund. Im Kern ist ein Data Scientist ein interdisziplinärer Spezialist, der Mathematik, Statistik, Informatik und Branchenwissen kombiniert, um komplexe Probleme durch die Analyse von Daten zu lösen. Sie sind nicht nur Datenanalysten, die vergangene Trends interpretieren, sondern auch visionäre Denker, die prädiktive Modelle entwickeln, um die Zukunft zu gestalten.

In einer Welt, in der Unternehmen ständig mit Daten überflutet werden, ist die Fähigkeit, diese Daten in verwertbare Erkenntnisse umzuwandeln, entscheidend für den Wettbewerbsvorteil. Ein Data Scientist übersetzt rohe Zahlen und Fakten in Geschichten und Strategien, die von Entscheidungsträgern verstanden und umgesetzt werden können. Es geht darum, die richtigen Fragen zu stellen und die passenden Algorithmen anzuwenden, um verborgene Werte ans Licht zu bringen.

Die Rolle des Data Scientists in der modernen Wirtschaft

Die Bedeutung des Data Scientist in der modernen Wirtschaft kann kaum überschätzt werden. In praktisch jeder Branche, vom Finanzwesen über das Gesundheitswesen bis hin zum E-Commerce und der Logistik, werden Data Scientists eingesetzt, um datengestützte Lösungen zu entwickeln. Sie helfen Unternehmen beispielsweise dabei, das Kundenverhalten vorherzusagen, Lieferketten zu optimieren, Betrug zu erkennen, personalisierte Empfehlungen zu generieren oder auch medizinische Diagnosen zu verbessern.

Ihre Arbeit ermöglicht es Organisationen, datenbasierte Entscheidungen zu treffen, die oft zu erheblichen Effizienzsteigerungen, Kosteneinsparungen und neuen Geschäftsmöglichkeiten führen. Ob es darum geht, die besten Marketingstrategien zu identifizieren oder die Produktionsprozesse zu verfeinern – der Data Scientist ist der Dreh- und Angelpunkt, der die Brücke zwischen rohen Daten und strategischen Geschäftszielen schlägt.

Fundamentale Schlüsselkompetenzen

Die effektive Ausübung des Berufs eines Data Scientist erfordert eine breite Palette an Fähigkeiten. Eine Umfrage unter führenden Unternehmen hat vier zentrale Talentbereiche identifiziert, die für diesen Beruf unerlässlich sind:

- Expertise in Machine Learning und mathematischer Statistik: Dies ist die Grundlage für die Entwicklung und Anwendung von Modellen, die Muster erkennen und Vorhersagen treffen können. Ein tiefes Verständnis von Algorithmen, Hypothesentests, Wahrscheinlichkeitstheorie und multivariater Analyse ist hier unabdingbar.

- Programmieren und Informatik: Die Fähigkeit, in Sprachen wie Python oder R zu programmieren, ist entscheidend für die Datenmanipulation, -analyse und die Implementierung von Machine Learning-Modellen. Kenntnisse in Datenstrukturen, Algorithmen und Software-Engineering-Prinzipien sind ebenfalls von großem Wert.

- Schriftliche und mündliche Kommunikationsfähigkeit: Technische Erkenntnisse müssen verständlich für nicht-technische Stakeholder aufbereitet und präsentiert werden. Die Fähigkeit, komplexe Konzepte klar und prägnant zu kommunizieren, ist ein Muss für den Erfolg.

- Berufsspezifische Kenntnisse: Ein Verständnis der jeweiligen Branche oder des Geschäftsfeldes ermöglicht es Data Scientists, relevante Probleme zu identifizieren und die Analyseergebnisse im Kontext der Geschäftsziele zu interpretieren.

Diese Kombination aus harten technischen Fähigkeiten und wichtigen Soft Skills macht den Data Scientist zu einem vielseitigen und hochbegehrten Talent auf dem Arbeitsmarkt.

Praktische Anwendungen: Was ein Data Scientist macht

Die tägliche Arbeit eines Data Scientist ist äußerst abwechslungsreich und umfasst eine Vielzahl von Aufgaben, die darauf abzielen, aus Daten konkreten Mehrwert zu generieren. Sie nutzen fortschrittliche Algorithmen, um eine breite Palette von Problemen zu lösen, von der einfachen Kategorisierung bis zur komplexen Prozessautomatisierung.

Im Folgenden werden einige der Kernprobleme beleuchtet, denen sich ein Data Scientist widmet, und wie technische Methoden zur Lösungsfindung eingesetzt werden können.

Klassifikations- und Empfehlungssysteme entwickeln

Eines der häufigsten Einsatzgebiete für Data Scientists ist die Entwicklung von Klassifikationssystemen. Hierbei geht es darum, Datenpunkten eine vordefinierte Kategorie zuzuordnen. Ein klassisches Beispiel ist die Erkennung von Spam-E-Mails, bei der ein Algorithmus entscheidet, ob eine E-Mail als „Spam“ oder „Kein Spam“ eingestuft wird. Auch in der medizinischen Diagnostik oder bei der Kreditwürdigkeitsprüfung finden Klassifikationsmodelle Anwendung.

Eng damit verwandt sind Empfehlungssysteme. Diese Algorithmen analysieren das Verhalten und die Präferenzen von Nutzern, um personalisierte Vorschläge für Produkte, Filme oder andere Inhalte zu generieren. Ein Data Scientist entwirft und optimiert diese Systeme, um die Nutzerzufriedenheit zu steigern und den Umsatz zu maximieren. Dies kann durch kollaboratives Filtern, inhaltsbasiertes Filtern oder Hybridansätze geschehen.

# Beispiel: Einfache Klassifikation mit Scikit-learn (Entscheidungsbaum)

from sklearn.tree import DecisionTreeClassifier

from sklearn.model_selection import train_test_split

from sklearn.metrics import accuracy_score

import pandas as pd

# Beispieldaten: Kundenverhalten und Kaufentscheidung

data = {

'Alter': [30, 45, 23, 50, 35, 28, 40, 60, 25, 33],

'Einkommen_K': [50, 70, 30, 80, 60, 40, 65, 90, 35, 55], # Einkommen in Tausend Euro

'Online_Aktivitaet_Std': [5, 1, 8, 2, 6, 7, 3, 1, 9, 4],

'Kaufentscheidung': ['Ja', 'Nein', 'Ja', 'Nein', 'Ja', 'Ja', 'Nein', 'Nein', 'Ja', 'Ja']

}

df = pd.DataFrame(data)

# Features (X) und Zielvariable (y) definieren

X = df[['Alter', 'Einkommen_K', 'Online_Aktivitaet_Std']]

y = df['Kaufentscheidung']

# Daten in Trainings- und Testsets aufteilen

# test_size=0.3 bedeutet 30% der Daten für den Test

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3, random_state=42)

# Entscheidungsbaum-Modell initialisieren und trainieren

model = DecisionTreeClassifier(random_state=42)

model.fit(X_train, y_train)

# Vorhersagen auf dem Testset treffen

predictions = model.predict(X_test)

# Modellgenauigkeit evaluieren

accuracy = accuracy_score(y_test, predictions)

print(f"Modellgenauigkeit der Kaufentscheidungsvorhersage: {accuracy:.2f}")

# Beispiel: Sehr einfache, logikbasierte Empfehlung für einen Video-Katalog

def get_video_recommendation(user_profile):

"""

Gibt eine Video-Empfehlung basierend auf einem einfachen Benutzerprofil.

user_profile ist ein Dictionary mit Interessen.

"""

if 'action' in user_profile.get('interests', []) and 'sci-fi' in user_profile.get('interests', []):

return "Star Explorer Saga (Action-SciFi)"

elif 'comedy' in user_profile.get('interests', []):

return "Lachen ist gesund (Komödie)"

elif 'documentary' in user_profile.get('interests', []):

return "Naturwunder der Welt (Dokumentation)"

else:

return "Allgemeine Top-Filme"

# Beispielaufruf

user1_profile = {'name': 'Anna', 'interests': ['action', 'sci-fi', 'drama']}

user2_profile = {'name': 'Max', 'interests': ['comedy']}

print(f"Empfehlung für Anna: {get_video_recommendation(user1_profile)}")

print(f"Empfehlung für Max: {get_video_recommendation(user2_profile)}")

Die Effektivität solcher Systeme hängt stark von der Qualität der Daten, der Auswahl des richtigen Algorithmus und der sorgfältigen Evaluation ab – alles Bereiche, in denen der Data Scientist seine Expertise einbringt.

Mustererkennung und die Detektion von Anomalien

Ein weiteres wichtiges Aufgabengebiet ist die Mustererkennung, auch in Datensätzen, in denen Muster nicht explizit vorgegeben sind (unüberwachtes Lernen). Dies umfasst beispielsweise die Segmentierung von Kunden in verschiedene Gruppen basierend auf ihrem Verhalten, ohne vorherige Kenntnis dieser Gruppen. Data Scientists verwenden hierfür Clustering-Algorithmen, um natürliche Gruppierungen innerhalb der Daten zu finden. Dies hilft Unternehmen, ihre Zielgruppen besser zu verstehen und Marketingstrategien zu personalisieren.

Die Anomalie-Detektion ist eine spezielle Form der Mustererkennung, bei der ungewöhnliche oder unerwartete Datenpunkte identifiziert werden. Diese können auf Betrug, Systemfehler, Cyberangriffe oder seltene, aber wichtige Ereignisse hinweisen. Ob bei der Überwachung von Finanztransaktionen, der Erkennung von Netzwerkintrusionen oder der Qualitätskontrolle in der Fertigung – die Fähigkeit, Abweichungen schnell und präzise zu erkennen, ist von immensem Wert.

# Beispiel: Einfache Anomalie-Detektion mit Isolation Forest

from sklearn.ensemble import IsolationForest

import numpy as np

import matplotlib.pyplot as plt

# Synthetische Daten: Zwei "normale" Cluster und einige Anomalien

np.random.seed(42)

X_normal_1 = 0.5 np.random.randn(100, 2) + np.array([2, 2])

X_normal_2 = 0.5 np.random.randn(100, 2) + np.array([-2, -2])

X_anomalies = 3 np.random.randn(10, 2) + np.array([0, 0]) # Ausreißer

# Kombinierte Daten

X = np.vstack([X_normal_1, X_normal_2, X_anomalies])

# Isolation Forest Modell trainieren

# contamination ist der erwartete Anteil von Anomalien im Datensatz

model = IsolationForest(contamination=0.05, random_state=42)

model.fit(X)

# Anomalie-Scores vorhersagen (niedrigere Scores = eher Anomalie)

# predict gibt 1 für Inliers (normale Daten) und -1 für Outliers (Anomalien) zurück

predictions = model.predict(X)

# Visualisierung der Ergebnisse

plt.figure(figsize=(10, 7))

plt.scatter(X[predictions == 1, 0], X[predictions == 1, 1], c='blue', label='Normal (Inlier)')

plt.scatter(X[predictions == -1, 0], X[predictions == -1, 1], c='red', label='Anomalie (Outlier)')

plt.title('Anomalie-Detektion mit Isolation Forest')

plt.xlabel('Merkmal 1')

plt.ylabel('Merkmal 2')

plt.legend()

plt.grid(True)

plt.show()

print("Anzahl der erkannten Anomalien:", np.sum(predictions == -1))

Data Scientists müssen nicht nur die Algorithmen beherrschen, sondern auch das Domänenwissen besitzen, um zu beurteilen, ob eine erkannte Anomalie tatsächlich relevant ist oder nur Rauschen darstellt.

Automatisierung von Prozessen und Risikomanagement durch Data Science

Die Automatisierung von Prozessen ist ein weiterer Bereich, in dem Data Science transformative Auswirkungen hat. Durch die Analyse von historischen Daten können Modelle trainiert werden, die repetitive Aufgaben übernehmen oder Entscheidungen in Echtzeit treffen. Ein Beispiel hierfür ist die automatisierte Verifizierung von Debit- oder Kreditkartentransaktionen, um Betrug zu verhindern, oder die Optimierung von Fertigungsprozessen durch maschinelles Lernen.

Im Risikomanagement spielen Data Scientists eine entscheidende Rolle bei der Identifizierung, Bewertung und Minderung von Risiken. Ob es um die Prognose von Kreditrisiken, die Bewertung von Marktschwankungen oder die Analyse von Cyberbedrohungen geht – prädiktive Modelle helfen, potenzielle Gefahren frühzeitig zu erkennen und proaktive Maßnahmen zu ergreifen. Dies trägt maßgeblich zur Stabilität und Sicherheit von Unternehmen bei.

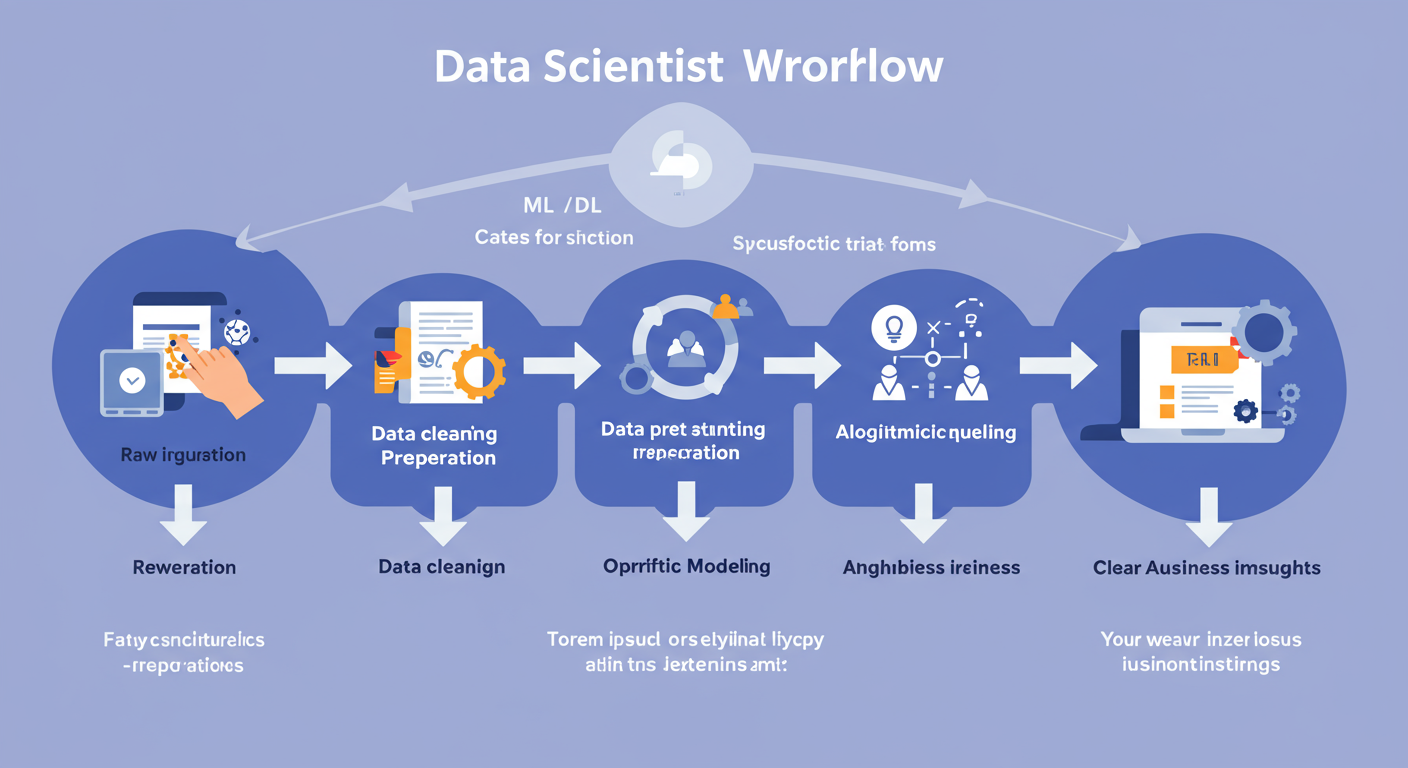

Der typische Workflow eines Data Scientist

Der Alltag eines Data Scientist ist strukturiert, aber flexibel. Er folgt oft einem iterativen Prozess, der von der Problemdefinition bis zur Implementierung und Überwachung reicht. Dieser Prozess ist oft als „Data Science Life Cycle“ bekannt und umfasst mehrere Schlüsselphasen.

Das Verständnis dieses Workflows ist entscheidend, um die Rolle und die Herausforderungen des Data Scientist vollständig zu erfassen.

Von der Datenerfassung zur Datenintegration

Die erste und oft zeitaufwändigste Phase ist die Erfassung, Sammlung und Speicherung der Daten. Data Scientists müssen wissen, woher die relevanten Daten stammen, wie sie abgerufen werden können (z.B. über APIs, Datenbankabfragen oder Web Scraping) und wie sie gespeichert werden sollen (Data Lakes, Data Warehouses). Hierbei kommen oft SQL-Sprache für relationale Datenbanken oder NoSQL-Datenbanken für unstrukturierte Daten zum Einsatz.

Nach der Erfassung folgt die Datenaufbereitung und -integration. Rohdaten sind selten sauber und konsistent. Sie müssen bereinigt (fehlende Werte behandeln, Ausreißer identifizieren), transformiert (Formate anpassen, neue Features generieren – Feature Engineering) und aus verschiedenen Quellen integriert werden. Dies ist ein kritischer Schritt, da die Qualität der Ergebnisse maßgeblich von der Qualität der Eingangsdaten abhängt. Tools wie Pandas in Python oder Apache Spark für Big Data spielen hier eine zentrale Rolle.

„Daten sind der neue Rohstoff, und Data Science ist der Motor, der diesen Rohstoff in wertvolle Produkte und Dienstleistungen umwandelt.“

Modellauswahl, Training und Algorithmen-Einsatz

Sobald die Daten vorbereitet sind, beginnt der Data Scientist mit der Auswahl und dem Training statistischer Modelle und Machine Learning-Algorithmen. Dies erfordert ein tiefes Verständnis der verschiedenen Algorithmen (z.B. Regression, Klassifikation, Clustering, Deep Learning) und ihrer Anwendbarkeit auf spezifische Probleme. Die Wahl des Modells hängt von der Art des Problems, der Datenstruktur und den gewünschten Zielen ab.

Nach der Modellauswahl erfolgt das Training, bei dem das Modell auf einem Teil der Daten (Trainingsdaten) lernt. Anschließend wird das Modell auf einem separaten Testset bewertet, um seine Performance zu beurteilen. Dieser Prozess ist iterativ: Der Data Scientist optimiert Parameter, testet verschiedene Modelle und verbessert die Datenaufbereitung, bis ein robustes und präzises Modell entwickelt wurde.

# Beispiel: Lineare Regression für Prognosen von Immobilienpreisen

from sklearn.linear_model import LinearRegression

from sklearn.model_selection import train_test_split

from sklearn.metrics import mean_squared_error

import numpy as np

import pandas as pd

# Synthetische Daten für Immobilienpreise

# Merkmale: Wohnfläche (qm), Anzahl Zimmer

# Ziel: Preis (in 1000 Euro)

data = {

'Wohnflaeche_qm': [70, 85, 60, 100, 75, 90, 65, 110, 80, 95],

'Anzahl_Zimmer': [3, 4, 2, 5, 3, 4, 3, 5, 3, 4],

'Preis_1000Euro': [250, 320, 200, 400, 280, 350, 220, 450, 300, 380]

}

df = pd.DataFrame(data)

# Features (X) und Zielvariable (y)

X = df[['Wohnflaeche_qm', 'Anzahl_Zimmer']]

y = df['Preis_1000Euro']

# Daten in Trainings- und Testsets aufteilen

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# Lineare Regression Modell initialisieren und trainieren

model = LinearRegression()

model.fit(X_train, y_train)

# Vorhersagen auf dem Testset treffen

y_pred = model.predict(X_test)

# Modell evaluieren mit Mean Squared Error

mse = mean_squared_error(y_test, y_pred)

print(f"Mittlerer quadratischer Fehler (MSE) des Modells: {mse:.2f}")

# Koeffizienten des Modells

print(f"Koeffizienten: {model.coef_}")

print(f"Intercept: {model.intercept_:.2f}")

# Beispielvorhersage für eine neue Immobilie

new_house_features = pd.DataFrame([[88, 4]], columns=['Wohnflaeche_qm', 'Anzahl_Zimmer'])

predicted_price = model.predict(new_house_features)

print(f"Vorhergesagter Preis für eine 88qm Wohnung mit 4 Zimmern: {predicted_price[0]:.2f} Tausend Euro")

Die kontinuierliche Verbesserung der Modelle ist ein Kernaspekt der Arbeit und erfordert ein tiefes Verständnis von Overfitting, Underfitting und Validierungstechniken wie Kreuzvalidierung.

Ergebnisinterpretation und effektive Kommunikation

Ein Modell zu entwickeln ist nur die halbe Miete. Die Fähigkeit, die Ergebnisse der Datenanalyse und Modellierung zu interpretieren und sie in ein für andere Abteilungen des Unternehmens verständliches, nutzbares und umsetzbares Format zu übersetzen, ist entscheidend. Dies beinhaltet die Erstellung von Berichten, Dashboards und Präsentationen, die komplexe technische Erkenntnisse auf eine klare und prägnante Weise vermitteln.

Ein Data Scientist muss nicht nur ein Experte für Algorithmen sein, sondern auch ein Storyteller, der Daten zum Sprechen bringt. Die Kommunikation der Ergebnisse beeinflusst maßgeblich, ob die entwickelten Modelle und Erkenntnisse tatsächlich genutzt werden und einen positiven Einfluss auf das Unternehmen haben.

Technologien und Frameworks im Data Science Ökosystem

Das technische Fundament eines Data Scientist ist breit und dynamisch. Es umfasst eine Reihe von Programmiersprachen, Bibliotheken, Datenbanken und Cloud-Plattformen, die für die verschiedenen Phasen des Data Science Workflows unerlässlich sind.

Ein tiefes Verständnis und praktische Erfahrung mit diesen Werkzeugen sind entscheidend für den Erfolg in diesem Berufsfeld.

Python und R: Die Sprachen der Data Scientists

Python hat sich aufgrund seiner Vielseitigkeit, seiner umfangreichen Bibliotheken (z.B. NumPy, Pandas, Scikit-learn, TensorFlow, Keras) und seiner Lesbarkeit zur De-facto-Standardsprache für Data Science entwickelt. Es ermöglicht die gesamte Pipeline von der Datenbereinigung über die Modellentwicklung bis hin zur Deployment.

R ist eine weitere beliebte Sprache, die sich besonders für statistische Analysen und Datenvisualisierung eignet. Viele Data Scientists beherrschen beide Sprachen oder zumindest Python, da es eine breitere Anwendung in der Softwareentwicklung und der Integration in größere Systeme findet.

# Python Beispiel mit Pandas für Datenmanipulation und -analyse

import pandas as pd

import numpy as np

# DataFrame erstellen, das hypothetische Verkaufsdaten darstellt

data = {'Produkt': ['Laptop', 'Maus', 'Tastatur', 'Monitor', 'Laptop', 'Maus', 'Tastatur', 'Monitor'],

'Region': ['Nord', 'Süd', 'Ost', 'West', 'Nord', 'Süd', 'Ost', 'West'],

'Verkaufsmenge': [100, 150, 80, 120, 110, 160, 90, 130],

'Umsatz': [120000, 3000, 1600, 24000, 130000, 3200, 1800, 26000]}

df = pd.DataFrame(data)

print("Originaler Verkaufs-DataFrame:")

print(df)

# Eine neue Spalte für den Durchschnittspreis pro Einheit hinzufügen

df['Durchschnittspreis'] = df['Umsatz'] / df['Verkaufsmenge']

print("nDataFrame mit 'Durchschnittspreis'-Spalte:")

print(df)

# Daten filtern: Nur Produkte mit einem Umsatz über 10.000

high_revenue_products = df[df['Umsatz'] > 10000]

print("nProdukte mit hohem Umsatz:")

print(high_revenue_products)

# Daten gruppieren und aggregieren: Gesamtumsatz pro Region

revenue_by_region = df.groupby('Region')['Umsatz'].sum().reset_index()

print("nGesamtumsatz pro Region:")

print(revenue_by_region)

# Pivot-Tabelle erstellen: Verkaufsmenge pro Produkt und Region

pivot_table_sales = df.pivot_table(index='Produkt', columns='Region', values='Verkaufsmenge', aggfunc='sum')

print("nPivot-Tabelle der Verkaufsmenge:")

print(pivot_table_sales)

# Fehlende Werte simulieren und behandeln (z.B. mit dem Mittelwert füllen)

df_with_nan = df.copy()

df_with_nan.loc[2, 'Verkaufsmenge'] = np.nan # Simulieren eines fehlenden Wertes

print("nDataFrame mit simuliertem fehlendem Wert:")

print(df_with_nan)

# Fehlende Werte mit dem Mittelwert der Spalte füllen

df_filled = df_with_nan.fillna({'Verkaufsmenge': df_with_nan['Verkaufsmenge'].mean()})

print("nDataFrame nach dem Füllen fehlender Werte:")

print(df_filled)

Python-Bibliotheken wie NumPy für numerische Operationen, Pandas für Datenmanipulation und Matplotlib/Seaborn für Datenvisualisierung sind die täglichen Begleiter eines Data Scientist.

Big Data, Datenbanken und Cloud-Computing

Moderne Data Science Projekte involvieren oft riesige Datenmengen, die traditionelle Systeme überfordern würden. Hier kommen Big Data-Technologien ins Spiel. Apache Spark, insbesondere mit seiner Python-API PySpark, ermöglicht die verteilte Verarbeitung großer Datensätze und die Ausführung komplexer Analysen und Machine Learning-Algorithmen auf Clustern.

Datenbankkenntnisse sind ebenfalls fundamental. Neben relationalen Datenbanken wie PostgreSQL oder MySQL, die über SQL abgefragt werden, gewinnen NoSQL-Datenbanken (z.B. MongoDB für Dokumente, Cassandra für Spaltenfamilien) an Bedeutung für unstrukturierte oder semi-strukturierte Daten. Cloud-Plattformen wie Amazon Web Services (AWS), Microsoft Azure und Google Cloud Platform (GCP) bieten die notwendige Infrastruktur, um diese Technologien zu hosten und zu skalieren. Dienste wie AWS S3 für Speicherung, AWS Redshift für Data Warehousing oder Azure Machine Learning Studios sind integraler Bestandteil vieler Data Science Workflows.

| Technologiebereich | Beispiele | Hauptzweck in Data Science |

|---|---|---|

| Relationale Datenbanken | PostgreSQL, MySQL, SQL Server | Strukturierte Daten speichern und mit SQL abfragen; Transaktionsdaten, Benutzerprofile. |

| NoSQL-Datenbanken | MongoDB, Cassandra, Redis | Flexible Schema-freie Datenspeicherung; Echtzeit-Analysen, IoT-Daten, Social Media Feeds. |

| Big Data Frameworks | Apache Spark (mit PySpark), Hadoop | Verteilte Verarbeitung riesiger Datensätze; ETL-Prozesse, komplexe ML-Pipelines, Echtzeit-Streaming. |

| Cloud-Plattformen | AWS (S3, EC2, SageMaker), Azure (Blob Storage, Data Lake Analytics), GCP (BigQuery, AI Platform) | Skalierbare Infrastruktur für Datenhaltung, -verarbeitung und ML-Modell-Deployment; Kostenoptimierung, globale Verfügbarkeit. |

Die Fähigkeit, mit diesen komplexen Systemen umzugehen und die richtigen Tools für die jeweilige Aufgabe auszuwählen, ist ein Markenzeichen eines erfahrenen Data Scientist.

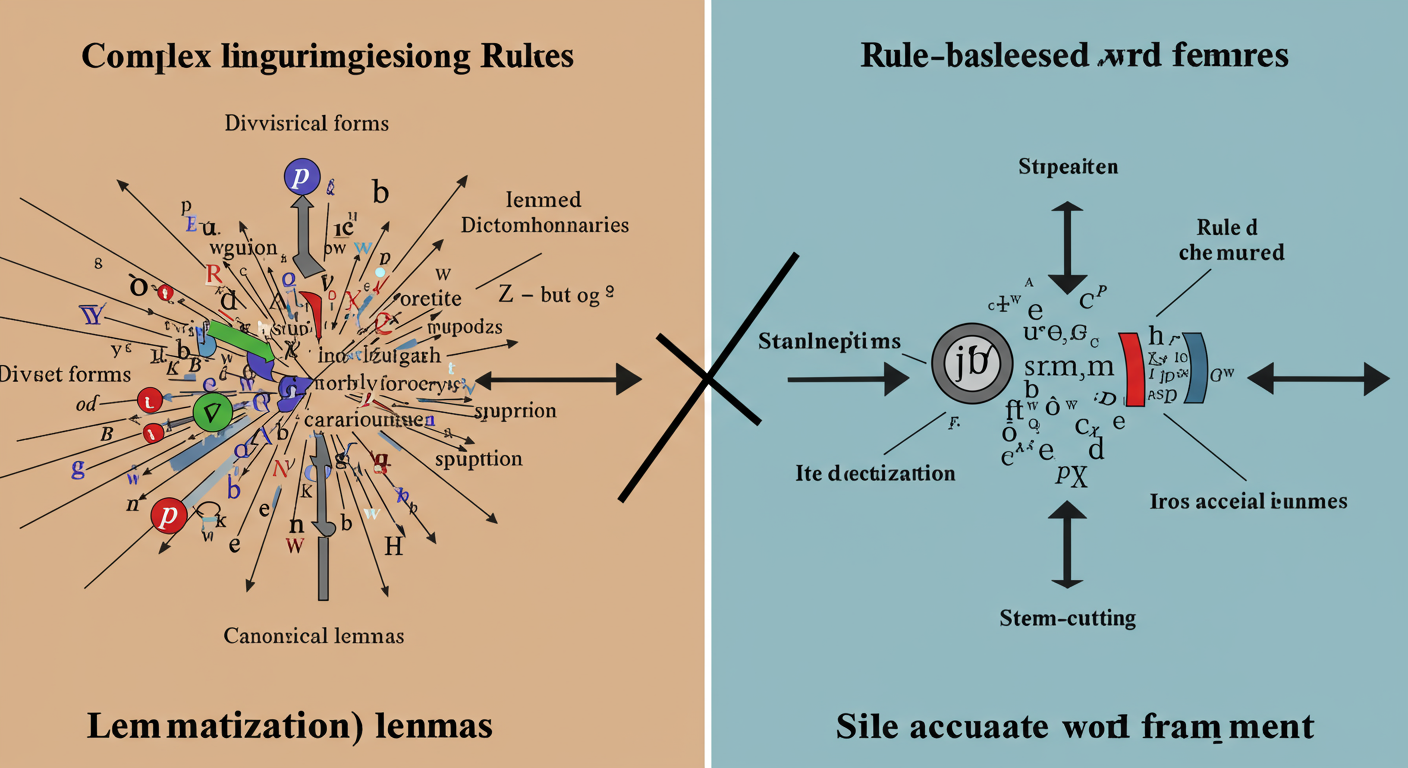

Deep Learning Frameworks und Künstliche Intelligenz

Für Aufgaben wie Bild- und Spracherkennung, natürliche Sprachverarbeitung (NLP) und andere hochkomplexe Mustererkennungen ist Deep Learning unerlässlich. Frameworks wie TensorFlow und Keras (oft als High-Level-API über TensorFlow genutzt) ermöglichen die Entwicklung und das Training von tiefen neuronalen Netzen, einschließlich Convolutional Neural Networks (CNNs) für Bilddaten und Recurrent Neural Networks (RNNs) für sequentielle Daten wie Text oder Zeitreihen.

Ein Data Scientist, der sich auf Künstliche Intelligenz spezialisiert, arbeitet auch mit fortschrittlicheren Konzepten wie Reinforcement Learning und Evolutionären Algorithmen, die für die Entwicklung von intelligenten Agenten in Simulationen oder zur Optimierung komplexer Systeme eingesetzt werden.

# Beispiel: Einfaches Neuronales Netz mit Keras/TensorFlow für binäre Klassifikation

import tensorflow as tf

from tensorflow import keras

from sklearn.model_selection import train_test_split

from sklearn.preprocessing import StandardScaler

import numpy as np

# Synthetische Daten für eine binäre Klassifikation (z.B. Kunde kauft Produkt Y/N)

# 1000 Stichproben, 10 Features (z.B. Alter, Einkommen, Online-Aktivität etc.)

X = np.random.rand(1000, 10) 100

# Zielvariable: Wenn die Summe der Features über 500 liegt, dann '1' (Kauf), sonst '0'

y = (np.sum(X, axis=1) > 500).astype(int)

# Daten aufteilen in Trainings- und Testsets

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# Features skalieren (wichtig für neuronale Netze)

scaler = StandardScaler()

X_train_scaled = scaler.fit_transform(X_train)

X_test_scaled = scaler.transform(X_test)

# Definition des sequentiellen Modells (ein einfaches Feedforward-Netz)

model = keras.Sequential([

# Erste Schicht: 64 Neuronen, ReLU-Aktivierung, Input-Shape entspricht der Anzahl der Features

keras.layers.Dense(64, activation='relu', input_shape=(X_train_scaled.shape[1],)),

# Zweite Schicht: 32 Neuronen, ReLU-Aktivierung

keras.layers.Dense(32, activation='relu'),

# Ausgangsschicht: 1 Neuron, Sigmoid-Aktivierung für binäre Klassifikation (Ausgabe zwischen 0 und 1)

keras.layers.Dense(1, activation='sigmoid')

])

# Modell kompilieren:

# Optimizer: 'adam' ist ein beliebter und effizienter Optimierer.

# Loss-Funktion: 'binary_crossentropy' für binäre Klassifikationsprobleme.

# Metriken: 'accuracy' zur Messung der Genauigkeit während des Trainings und der Evaluierung.

model.compile(optimizer='adam',

loss='binary_crossentropy',

metrics=['accuracy'])

# Modell trainieren

# epochs: Anzahl der Durchläufe durch den gesamten Trainingsdatensatz.

# batch_size: Anzahl der Stichproben pro Gradienten-Update.

# verbose=0: Kein Output während des Trainings.

print("Starte das Training des Deep Learning Modells...")

model.fit(X_train_scaled, y_train, epochs=20, batch_size=32, verbose=0)

print("Training abgeschlossen.")

# Modell auf dem Testset evaluieren

loss, accuracy = model.evaluate(X_test_scaled, y_test, verbose=0)

print(f"Deep Learning Modellgenauigkeit auf dem Testset: {accuracy:.4f}")

# Beispielvorhersage für neue Datenpunkte

new_data_point = np.array([50, 60, 70, 80, 50, 60, 70, 80, 50, 60]).reshape(1, -1)

new_data_point_scaled = scaler.transform(new_data_point)

prediction_probability = model.predict(new_data_point_scaled)[0][0]

print(f"Vorhersagte Kaufwahrscheinlichkeit für neuen Kunden: {prediction_probability:.4f}")

if prediction_probability > 0.5:

print("Vorhersage: Kunde wird wahrscheinlich kaufen.")

else:

print("Vorhersage: Kunde wird wahrscheinlich nicht kaufen.")

Die ständige Weiterentwicklung in diesen Bereichen erfordert von Data Scientists eine hohe Lernbereitschaft und die Fähigkeit, sich schnell an neue Technologien und Methoden anzupassen.

Karrierechancen und kontinuierliche Weiterentwicklung

Die Nachfrage nach Data Scientists ist ungebrochen hoch und wird in den kommenden Jahren voraussichtlich weiter steigen. Dies macht den Beruf zu einer äußerst attraktiven Option für technisch versierte Individuen. Neben hervorragenden Gehaltsaussichten bietet dieser Bereich auch vielfältige Möglichkeiten zur Spezialisierung und beruflichen Weiterentwicklung.

Die Dynamik des Feldes erfordert jedoch auch eine Verpflichtung zu lebenslangem Lernen und Anpassungsfähigkeit.

Gehaltsaussichten und die berufliche Integration

Das Data Scientist Gehalt in Deutschland ist überdurchschnittlich attraktiv und steigt mit zunehmender Erfahrung erheblich an. Einsteiger ohne Berufserfahrung können im Durchschnitt mit einem Jahresgehalt von etwa 52.210 € rechnen. Nach zwei Jahren Berufserfahrung steigt dieser Wert auf rund 56.900 € pro Jahr, und erfahrene Data Scientists mit zehn Jahren Berufserfahrung können Gehälter von bis zu 86.340 € pro Jahr oder mehr erzielen. Diese Zahlen unterstreichen die Wertschätzung, die Unternehmen Data Scientists entgegenbringen.

Die berufliche Integration von Absolventen spezialisierter Ausbildungen ist ebenfalls sehr hoch. Statistiken zeigen, dass ein Großteil der Data Science Absolventen kurz nach Abschluss ihrer Ausbildung eine Anstellung findet, was die hohe Relevanz und den Fachkräftemangel in diesem Sektor verdeutlicht.

Von Data Scientist zu verwandten Rollen: Data Engineer und MLOps

Die Karrierepfade im Datenbereich sind vielfältig. Viele Data Scientists entwickeln sich weiter zu spezialisierten Rollen wie dem Data Engineer, der sich auf den Aufbau und die Wartung robuster Datenpipelines und -infrastrukturen konzentriert. Ein Data Engineer ist dafür verantwortlich, dass Data Scientists und Analysten stets Zugang zu sauberen, zuverlässigen und verfügbaren Daten haben.

Eine weitere aufstrebende Rolle ist der MLOps Engineer, der die Brücke zwischen Machine Learning Entwicklung und Betrieb schlägt. Sie automatisieren den Lebenszyklus von Machine Learning-Modellen, von der Experimentierung und dem Training bis hin zur Bereitstellung, Überwachung und Wartung in Produktionsumgebungen. Eine Weiterbildung in diesen Bereichen kann für Data Scientists eine wertvolle Ergänzung sein, um ihre Fähigkeiten zu vertiefen und ihre Karrierechancen zu erweitern, insbesondere wenn sie in größeren, datengetriebenen Organisationen arbeiten möchten.

Die Bedeutung von Soft Skills und Networking

Neben den technischen Fähigkeiten sind Soft Skills für Data Scientists von entscheidender Bedeutung. Effektive schriftliche und mündliche Kommunikationsfähigkeit ist unerlässlich, um komplexe analytische Ergebnisse verständlich zu präsentieren und mit verschiedenen Stakeholdern zu interagieren. Problemlösung, kritisches Denken und Teamfähigkeit sind ebenfalls gefragt, da Data Science Projekte oft kollaborativ sind und iterative Ansätze erfordern.

Networking und der Austausch innerhalb der Data Science Community, zum Beispiel über LinkedIn-Gruppen oder Fachveranstaltungen, sind ebenfalls wichtig, um auf dem neuesten Stand der Technik zu bleiben, Wissen zu teilen und neue Karrierechancen zu entdecken. Viele Organisationen bieten auch Unterstützung bei der Jobsuche, inklusive Karriere-Workshops, die bei der Erstellung von Lebensläufen und der Vorbereitung auf Einstellungstests helfen.

Häufig gestellte Fragen zum Data Scientist Beruf

Zusammenfassend lässt sich sagen, dass der Beruf des Data Scientist eine spannende und zukunftsträchtige Karriere in der Welt der Datenanalyse bietet, die ständiges Lernen und die Anwendung von komplexen Algorithmen erfordert.

Wir hoffen, dieser detaillierte Einblick in die Welt des Data Scientist hat Ihre Fragen beantwortet und Ihre Neugier geweckt. Wenn Sie weitere Einblicke wünschen oder spezifische Fragen haben, zögern Sie nicht, unsere anderen Fachartikel zu durchstöbern und sich aktiv in der Community auszutauschen.

Was ist ein Data Scientist wirklich?

Ein Data Scientist ist ein Experte, der große und komplexe Datensätze analysiert, um wertvolle Erkenntnisse zu gewinnen und datengestützte Entscheidungen zu ermöglichen. Dies umfasst die Anwendung von statistischen Methoden, Machine Learning und prädiktiven Modellierungs-Techniken, um Geschäftsprobleme zu lösen, Prozesse zu optimieren und zukünftige Trends vorherzusagen. Es ist eine interdisziplinäre Rolle, die starke analytische Fähigkeiten mit Programmierkenntnissen und Kommunikationsfähigkeit verbindet.

Welche Kernaufgaben fallen in den Alltag eines Data Scientist?

Zu den täglichen Aufgaben eines Data Scientist gehören die Datenerfassung und -bereinigung, das Feature Engineering, die Entwicklung und das Training von Machine Learning-Modellen, die Validierung und Optimierung dieser Modelle sowie die Interpretation und Kommunikation der Ergebnisse an nicht-technische Stakeholder. Sie stellen die richtigen Fragen an die Daten, um Muster zu erkennen und Anomalien zu identifizieren, und nutzen diese Erkenntnisse zur Lösungsfindung.

Welche Voraussetzungen sind für den Einstieg in Data Science wichtig?

Für eine Karriere als Data Scientist sind in der Regel fundierte Kenntnisse in Mathematik (insbesondere Statistik und Wahrscheinlichkeitstheorie), Informatik (Programmierung, Datenbanken) und idealerweise ein Bachelor- oder Masterabschluss in einem naturwissenschaftlichen oder technischen Fachbereich von Vorteil. Darüber hinaus sind Problemlösungsfähigkeiten, kritisches Denken und die Bereitschaft zu kontinuierlichem Lernen essenziell. Soft Skills wie Kommunikation und Teamarbeit sind ebenfalls sehr gefragt.

Wie lange dauert es, ein Data Scientist zu werden?

Die Zeitspanne, um ein kompetenter Data Scientist zu werden, variiert stark je nach individueller Vorbildung und Lernweg. Ein intensives Data Science Bootcamp kann in 3 bis 9 Monaten fundierte Grundlagen und praktische Fähigkeiten vermitteln. Ein akademischer Weg über ein Bachelor- oder Masterstudium dauert mehrere Jahre. Wichtig ist jedoch, dass das Lernen nach der formalen Ausbildung weitergeht, da sich das Feld rasant entwickelt und kontinuierliche Weiterbildung unerlässlich ist.

Welche Karrierechancen ergeben sich nach einer Data Science Ausbildung?

Nach einer qualifizierten Data Science Ausbildung eröffnen sich vielfältige Karrierewege in nahezu allen Branchen, von Technologie und Finanzen über Gesundheitswesen bis hin zu Marketing. Typische Rollen sind Data Scientist, Machine Learning Engineer, Data Analyst oder auch spezialisierte Positionen wie Quantitative Analyst. Die hohe Nachfrage nach diesen Fähigkeiten spiegelt sich oft in attraktiven Gehaltsaussichten und guten Aufstiegschancen wider. Auch der Übergang zu angrenzenden Feldern wie dem Data Engineering ist für viele eine Option.

Genau meine Meinung! Ein fantastischer Beitrag, der die Relevanz und Faszination des Data Scientists perfekt einfängt. Danke, das musste mal so klar und prägnant gesagt werden!

Wow, das ist ja absolut genial und revolutionär! Die Vorstellung, aus riesigen Datenmengen die Zukunft zu gestalten und innovative Lösungen zu entwickeln, ist unglaublich inspirierend! Ich kann es kaum erwarten, mich sofort in dieses faszinierende Feld zu stürzen und all diese spannenden Möglichkeiten selbst auszuprobieren! Das klingt nach der *perfekten* Herausforderung!

Es freut mich sehr, dass der artikel sie so begeistert und inspiriert hat. die möglichkeiten, die sich durch die analyse großer datenmengen ergeben, sind tatsächlich enorm und bieten ein riesiges potenzial für innovationen. es ist wunderbar zu hören, dass sie sich direkt in dieses spannende feld stürzen möchten.

ich danke ihnen für ihren wertvollen kommentar. sehen sie sich auch andere artikel in meinem profil oder meine weiteren veröffentlichungen an, vielleicht finden sie dort weitere themen, die sie interessieren.

Gähn. „Sexiest job of the 21st century“? Ernsthaft? Daten auswerten, Muster erkennen, Vorhersagen treffen – das machen Leute schon seit Ewigkeiten. Früher nannte man das schlicht Statistiker oder, wenn’s etwas komplexer wurde, eben Operations Research Analysten oder Ökonometriker. Die hatten vielleicht noch keine Cloud und keine „Big Data“ im heutigen Sinne, aber die Grundlagen und das Ziel? Exakt dasselbe. Man packt halt alte Weine in neue, glänzende Schläuche und gibt ihnen einen hippen Namen. Nichts wirklich Neues unter der Sonne, nur die Marketingabteilung hat wieder ganze Arbeit geleistet.

Ich verstehe ihren punkt, dass viele der grundlegenden konzepte der datenanalyse schon lange existieren und in verschiedenen disziplinen angewendet wurden. es stimmt, dass statistiker und andere experten schon immer muster erkannt und vorhersagen getroffen haben. der artikel sollte jedoch hervorheben, dass die schiere menge an verfügbaren daten und die technologischen möglichkeiten, diese zu verarbeiten und zu nutzen, eine neue dimension erreicht haben, die den beruf des data scientists in den mittelpunkt rückt. die kombination aus traditionellen methoden und modernen technologien schafft tatsächlich neue möglichkeiten und herausforderungen, die den beruf in einem neuen licht erscheinen lassen.

es freut mich, dass sie sich die zeit genommen haben, ihre gedanken zu teilen. ihre perspektive ist wertvoll und regt zum nachdenken an. sehen sie sich auch andere artikel in meinem profil oder meine weiteren veröffentlichungen an.