Die rapide Entwicklung des maschinellen Lernens, insbesondere im Bereich der Deep Learning Architekturen, hat zu einer beispiellosen Leistungsfähigkeit bei komplexen Aufgaben wie der Bilderkennung und Sprachverarbeitung geführt. Doch mit zunehmender Komplexität entstand eine wachsende Herausforderung: die Erklärbarkeit im maschinellen Lernen. Viele dieser fortschrittlichen Modelle agieren wie „Black Boxes“, deren interne Entscheidungsprozesse für den Menschen undurchsichtig sind. Dies erschwert nicht nur das Debugging bei Fehlern, sondern untergräbt auch das Vertrauen der Endnutzer und Entwickler in die Systeme, besonders in kritischen Anwendungsbereichen.

In diesem Artikel werden wir uns intensiv mit der Grad-CAM-Methode befassen, einer leistungsstarken Technik zur Visualisierung und Interpretation von Entscheidungen, die von Faltungsneuronalen Netzen (CNNs) getroffen werden. Wir werden die zugrunde liegenden Prinzipien, die mathematische Funktionsweise und praktische Anwendungsbeispiele dieser Methode detailliert beleuchten. Ziel ist es, Ihnen ein tiefes Verständnis dafür zu vermitteln, wie Grad-CAM dazu beiträgt, das Black Box Problem in neuronalen Netzen zu entschärfen und Transparenz in hochkomplexen KI-Modellen zu schaffen.

Grad-CAM: Ein Fenster in die Entscheidungsfindung von CNNs

Die Fähigkeit von Machine-Learning-Modellen, insbesondere von tiefen neuronalen Netzen, komplexe Muster in Daten zu erkennen, ist unbestreitbar beeindruckend. Bei Aufgaben wie der Bildklassifizierung, Gesichtserkennung oder Dokumentenanalyse haben sich Faltungsnetzwerke (Convolutional Neural Networks, CNNs) als äußerst effektiv erwiesen. Ihre Architektur, die aus Hunderten von Schichten und Millionen von Parametern bestehen kann, ermöglicht es ihnen, hierarchische Merkmale aus Rohdaten zu extrahieren. Doch genau diese Komplexität macht es oft schwierig, nachzuvollziehen, warum ein Modell eine bestimmte Entscheidung trifft. Dies ist das Kernproblem der Erklärbarkeit, das es zu lösen gilt, um interpretierbare KI-Modelle zu realisieren.

Die gradientengewichtete Klassenaktivierungskarte (Grad-CAM) ist eine innovative Methode, die genau hier ansetzt. Sie wurde entwickelt, um die Interpretierbarkeit von CNNs zu verbessern, indem sie visuelle Erklärungen für deren Klassifikationsentscheidungen liefert. Im Wesentlichen generiert Grad-CAM eine Heatmap, die die wichtigsten Regionen in einem Eingabebild hervorhebt, auf die sich das Modell konzentriert hat, um eine bestimmte Klassifizierungsentscheidung zu treffen. Diese Visualisierung von Faltungsnetzwerken ist klassenspezifisch, was bedeutet, dass sie für jede identifizierte Klasse separate Erklärungen liefern kann. Dies ist entscheidend, um zu verstehen, ob das Modell auf die richtigen Merkmale achtet oder ob es unbeabsichtigte Korrelationen lernt.

Grundlagen von Faltungsneuronalen Netzen (CNNs)

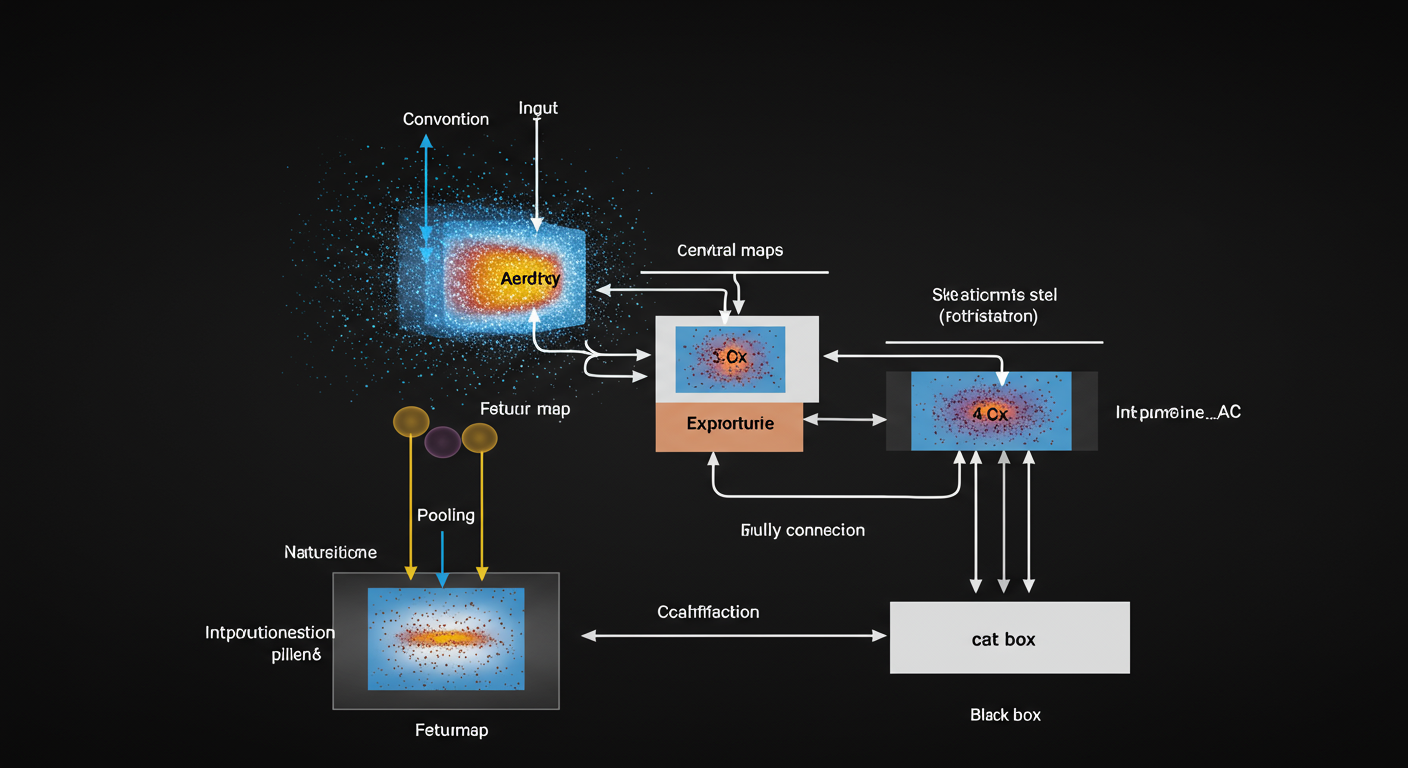

Um Grad-CAM vollständig zu verstehen, ist es wichtig, die Grundlagen von Faltungsneuronalen Netzen (CNNs) zu rekapitulieren. CNNs sind eine spezielle Art von Deep-Learning-Architekturen, die besonders gut für die Verarbeitung von gitterartigen Daten wie Bildern geeignet sind. Sie bestehen typischerweise aus Faltungs-, Aktivierungs-, Pooling- und vollständig verbundenen Schichten.

- Faltungsschichten (Convolutional Layers): Dies sind die Kernelemente von CNNs. Sie wenden Filter (oder Kernel) auf das Eingabebild an, um Merkmalskarten (Feature Maps) zu erstellen. Jeder Filter ist darauf spezialisiert, bestimmte Merkmale wie Kanten, Texturen oder Ecken zu erkennen. Durch das Sliden dieser Filter über das Bild (Konvolution) entstehen neue Repräsentationen der Eingabe.

- Aktivierungsfunktionen (Activation Functions): Nach jeder Faltungsschicht wird in der Regel eine nicht-lineare Aktivierungsfunktion wie ReLU (Rectified Linear Unit) angewendet. Diese Funktionen führen Nichtlinearität in das Modell ein, was es ihm ermöglicht, komplexere Muster zu lernen.

- Pooling-Schichten (Pooling Layers): Diese Schichten reduzieren die räumliche Dimension der Merkmalskarten, um die Anzahl der Parameter zu verringern und das Modell robuster gegenüber kleinen Verschiebungen oder Verzerrungen im Bild zu machen. Max Pooling ist eine gängige Methode, bei der der maximale Wert aus einem Fenster extrahiert wird.

- Vollständig verbundene Schichten (Fully Connected Layers): Am Ende des CNNs werden die extrahierten Merkmalskarten abgeflacht und an eine oder mehrere vollständig verbundene Schichten übergeben. Diese Schichten sind für die endgültige Klassifikation zuständig, indem sie die hochrangigen Merkmale kombinieren, um Vorhersagen zu treffen.

Die Hierarchie dieser Schichten ermöglicht es einem CNN, von einfachen Kantenmerkmalen in frühen Schichten zu komplexen Objektteilen und schließlich zu vollständigen Objekterkennungen in tieferen Schichten zu lernen. Die Herausforderung besteht darin, dass die Entscheidungen in den letzten Schichten das Ergebnis dieser gesamten komplexen Merkmalsextraktionskette sind, was das Verständnis der individuellen Beiträge erschwert.

„Das Vertrauen in KI-Systeme wächst nicht allein durch Leistung, sondern durch die Fähigkeit, deren Entscheidungen transparent und verständlich zu machen.“

Funktionsweise von Grad-CAM im Detail

Grad-CAM nutzt die Gradienten des Klassifikationsergebnisses in Bezug auf die Merkmalskarten der letzten Faltungsschicht. Diese letzte Faltungsschicht ist entscheidend, da sie eine gute Balance zwischen hochrangigen semantischen Informationen (was das Bild darstellt) und detaillierten räumlichen Informationen (wo sich die Merkmale befinden) bietet.

Der Prozess lässt sich in folgende Schritte unterteilen:

- Vorwärtsdurchlauf: Das Eingabebild wird durch das CNN geleitet, um die Aktivierungen der Merkmalskarten in der letzten Faltungsschicht zu erhalten und eine Vorhersage für die Zielklasse (z.B. „Katze“) zu generieren.

- Rückwärtsdurchlauf (Gradientenberechnung): Der Gradient der Score für die Zielklasse (Y_c) in Bezug auf jede Merkmalskarte (A_k) der letzten Faltungsschicht wird berechnet. Diese Gradienten spiegeln wider, wie stark eine Änderung in einer bestimmten Merkmalskarte die Klassifikationsentscheidung beeinflusst. Mathematisch wird dies als ∂Y_c/∂A_k ausgedrückt.

- Gewichtungsberechnung: Die berechneten Gradienten werden über die räumlichen Dimensionen (Höhe und Breite) jeder Merkmalskarte gemittelt, um einen einzelnen Skalar für jede Merkmalskarte zu erhalten. Diese Skalare (α_k) stellen die „Wichtigkeit“ jeder Merkmalskarte für die Klassifikation der Zielklasse dar. Man kann sie als globale Durchschnittspooling-Operation auf den Gradienten verstehen:

- Lineare Kombination und ReLU-Anwendung: Die gewichteten Merkmalskarten werden linear kombiniert. Dabei wird jede Merkmalskarte A_k mit ihrem entsprechenden Gewicht α_k^c multipliziert und summiert. Anschließend wird eine ReLU-Funktion (Rectified Linear Unit) angewendet. Die ReLU-Funktion (max(0, x)) ist entscheidend, da sie nur die Aktivierungen beibehält, die eine positive Auswirkung auf die Klassifikation der Zielklasse haben. Negative Aktivierungen würden eher auf andere Klassen hindeuten.

L_{Grad-CAM}^c = ReLU(sum_k(alpha_k^c A^k)) - Upsampling: Die resultierende Klassenaktivierungskarte (L_{Grad-CAM}^c) wird auf die ursprüngliche Größe des Eingabebildes hochskaliert, um eine überlagerbare Heatmap zu erstellen. Diese Heatmap zeigt visuell die Bereiche im Bild, die am wichtigsten für die Klassifikationsentscheidung der Zielklasse waren. So können Entwickler nachvollziehen, warum funktioniert ein ML-Modell so und Deep Learning Entscheidungsfindung erklären.

alpha_k^c = (1 / Z) sum_i(sum_j(∂Y_c / ∂A_{ij}^k))Hier ist Z die Anzahl der Pixel in der Merkmalskarte A_k.

| Schritt | Beschreibung | Ziel |

|---|---|---|

| 1. Vorwärtsdurchlauf | Bild durch CNN senden, Feature Maps der letzten Conv-Schicht erhalten | Klassifikationsvorhersage & Merkmalsaktivierungen |

| 2. Gradientenberechnung | Gradient des Zielklassenscores bezogen auf Feature Maps berechnen | Wichtigkeit der Feature Map-Änderungen für die Klassifikation |

| 3. Gewichtung | Gradienten global mitteln, um Wichtigkeit jeder Feature Map zu erhalten | α-Werte als Gewichte für Feature Maps |

| 4. Lineare Kombination & ReLU | Gewichtete Feature Maps summieren, ReLU anwenden | Klassenaktivierungskarte erstellen (positive Beiträge) |

| 5. Upsampling | Aktivierungskarte auf Bildgröße skalieren | Visuell interpretierbare Heatmap |

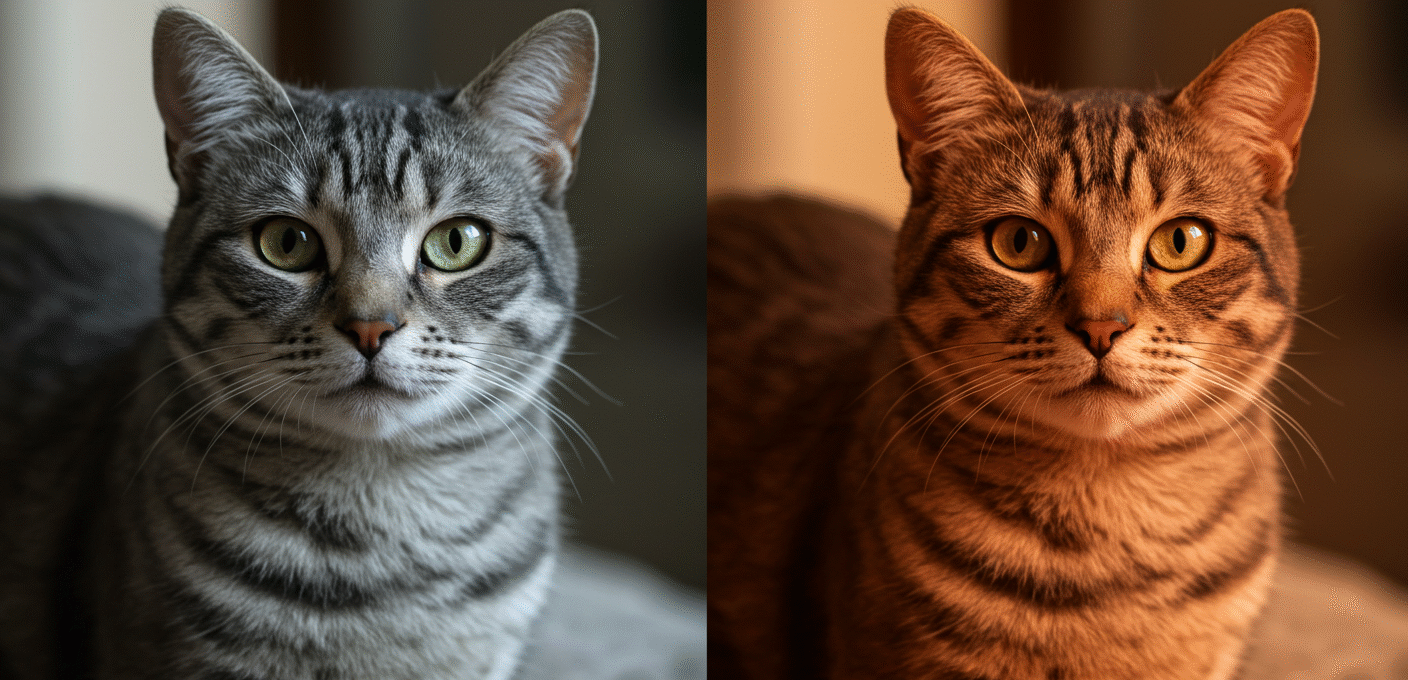

Dieses Verfahren ermöglicht es, für jede im Bild vorhandene Klasse eine eigene Heatmap zu generieren, was eine tiefgehende Analyse der Modellentscheidungen erlaubt. Wenn zum Beispiel ein CNN zwischen Hunden und Katzen unterscheiden soll, kann Grad-CAM eine Heatmap erzeugen, die hervorhebt, welche Pixel das Modell dazu veranlassten, „Katze“ zu sagen, und eine separate Heatmap, die die Regionen für „Hund“ hervorhebt.

Praktische Anwendung der Grad-CAM-Methode

Die praktische Implementierung von Grad-CAM erfordert typischerweise den Zugriff auf ein vortrainiertes CNN und eine Methode zur Berechnung von Gradienten. Bibliotheken wie TensorFlow und PyTorch bieten die notwendigen Tools. Hier ist ein vereinfachtes Python-Codebeispiel, das die Kernschritte zur Generierung einer Grad-CAM-Heatmap demonstriert:

Angenommen, wir haben ein vortrainiertes Modell (z.B. VGG16) und ein Bild, das wir klassifizieren und interpretieren möchten.

import numpy as np

import tensorflow as tf

from tensorflow import keras

from tensorflow.keras.preprocessing import image

from tensorflow.keras.applications import VGG16

import matplotlib.pyplot as plt

import matplotlib.cm as cm

# 1. Modell laden und Bild vorbereiten

# Laden eines vortrainierten VGG16-Modells

model = VGG16(weights='imagenet')

# Pfad zum Bild (ersetzen Sie dies durch Ihr Bild)

img_path = 'path/to/your/image.jpg'

img = image.load_img(img_path, target_size=(224, 224))

img_array = image.img_to_array(img)

img_array = np.expand_dims(img_array, axis=0) # Bild in Batch-Format umwandeln

img_array = tf.keras.applications.vgg16.preprocess_input(img_array) # VGG16 Preprocessing

# 2. Vorhersage machen und Top-Klasse identifizieren

preds = model.predict(img_array)

top_pred_idx = np.argmax(preds[0])

print(f"Vorhersage: {tf.keras.applications.vgg16.decode_predictions(preds, top=1)[0][0][1]}")

# 3. Modell für Grad-CAM vorbereiten

# Wir benötigen ein Modell, das die Ausgaben der letzten Faltungsschicht und die endgültige Vorhersage liefert.

last_conv_layer_name = "block5_conv3" # Typische letzte Faltungsschicht in VGG16

grad_model = tf.keras.models.Model(

[model.inputs], [model.get_layer(last_conv_layer_name).output, model.output]

)

# 4. Gradienten berechnen

with tf.GradientTape() as tape:

last_conv_layer_output, preds = grad_model(img_array)

# Gradient des Scores der Top-Klasse bezogen auf die Feature Map der letzten Faltungsschicht

class_channel = preds[:, top_pred_idx]

# Gradienten für die spezifische Klasse berechnen

grads = tape.gradient(class_channel, last_conv_layer_output)

# 5. Gewichte berechnen (Global Average Pooling der Gradienten)

pooled_grads = tf.reduce_mean(grads, axis=(0, 1, 2))

# 6. Heatmap erstellen

last_conv_layer_output = last_conv_layer_output[0] # Batch-Dimension entfernen

heatmap = last_conv_layer_output @ pooled_grads[..., tf.newaxis] # Lineare Kombination

heatmap = tf.squeeze(heatmap) # Dimensionen anpassen

# ReLU anwenden: Nur positive Beiträge sind relevant

heatmap = tf.maximum(heatmap, 0) / tf.reduce_max(heatmap)

heatmap = heatmap.numpy()

# 7. Heatmap auf das Originalbild überlagern und anzeigen

# Originalbild für die Anzeige laden

original_img = image.load_img(img_path, target_size=(224, 224))

original_img_array = image.img_to_array(original_img)

# Heatmap auf die Originalgröße skalieren

heatmap_scaled = np.uint8(255 heatmap)

jet = cm.get_cmap("jet") # Farbschema

# Graustufen-Heatmap in RGB konvertieren

jet_colors = jet(np.arange(256))[:, :3]

jet_heatmap = jet_colors[heatmap_scaled]

# Heatmap über das Originalbild legen (Transparenz)

superimposed_img = jet_heatmap 0.4 + original_img_array / 255.0

superimposed_img = (superimposed_img 255).astype(np.uint8)

# Ergebnisse visualisieren

plt.figure(figsize=(10, 5))

plt.subplot(1, 2, 1)

plt.imshow(original_img_array.astype(np.uint8))

plt.title("Originalbild")

plt.axis('off')

plt.subplot(1, 2, 2)

plt.imshow(superimposed_img)

plt.title(f"Grad-CAM für Klasse: {tf.keras.applications.vgg16.decode_predictions(preds, top=1)[0][0][1]}")

plt.axis('off')

plt.show()

Dieses Beispiel illustriert, wie man eine Klassenaktivierungskarte erstellen und auf ein Bild anwenden kann. Es zeigt deutlich, welche Bildregionen für die Klassifizierung des Modells am wichtigsten waren. Solche Anwendungen von Grad-CAM in Python sind unerlässlich, um das Verhalten komplexer Modelle zu analysieren und zu validieren.

Grad-CAM: Ein Schritt zu mehr Vertrauen und Transparenz

Die Grad-CAM-Methode ist ein wichtiger Baustein im aufstrebenden Feld des erklärbaren Deep Learning. Sie bietet nicht nur eine intuitive visuelle Erklärung für die Entscheidungen von Faltungsneuronalen Netzen, sondern dient auch als wertvolles Debugging-Tool für Machine-Learning-Entwickler. Durch die Visualisierung der relevanten Bildregionen können wir schnell erkennen, ob unser Modell die richtigen Merkmale für seine Klassifikation heranzieht oder ob es sich auf irrelevante oder sogar irreführende Kontextinformationen stützt – ein häufiges Problem beim Debuggen von CNN-Klassifikationsfehlern.

Die Fähigkeit, die Funktionsweise von Deep-Learning-Modellen zu verstehen, ist entscheidend, um das Vertrauen der Nutzer in KI-Systeme zu stärken und die Entwicklung robusterer und fairer Algorithmen voranzutreiben. Grad-CAM trägt maßgeblich dazu bei, die „Black Boxes“ der künstlichen Intelligenz ein Stück weit zu öffnen und bietet eine konkrete Möglichkeit, die Transparenz in Deep Learning Algorithmen zu erhöhen. Durch solche Techniken können wir nicht nur die Leistung unserer Modelle verbessern, sondern auch sicherstellen, dass sie ethisch verantwortlich und zuverlässig in der realen Welt eingesetzt werden können. Entdecken Sie die spannende Welt der Datenwissenschaft und vertiefen Sie Ihr Wissen über diese und weitere Methoden in einer professionellen Weiterbildung.

Ja, genau das ist der Punkt! Die Black Box muss aufgebrochen werden. Danke, dass Sie sich diesem essenziellen Thema widmen, das musste mal gesagt werden!

Es freut mich sehr, dass ich mit meinem artikel den kern ihrer gedanken getroffen habe und sie die bedeutung des themas so klar erkennen. die öffnung der black box ist in der tat ein schritt, der unerlässlich ist, um transparenz und verständnis zu fördern.

vielen dank für ihre wertschätzung und die bestätigung, dass dieses thema dringend angesprochen werden musste. ich lade sie herzlich ein, auch meine anderen artikel in meinem profil oder meine weiteren veröffentlichungen anzusehen.

„Erklärbarkeit für neuronale Netze“ – eine noble Absicht. Doch während wir uns auf die Transparenz der Algorithmen konzentrieren, müssen wir uns dringend fragen: Woher stammen die „Rohdaten“, die diese Black Boxes überhaupt erst füttern?

Wenn KI-Modelle Gesichter erkennen, Stimmen verarbeiten und Dokumente analysieren, welche Unmengen an *persönlichen Daten* werden hierfür gesammelt und verarbeitet? Wer hat darauf Zugriff? Und welche sensiblen Muster können aus diesen Daten extrahiert werden, die weit über die ursprüngliche Absicht hinausgehen?

Von „Transparenz in hochkomplexen KI-Modellen“ ist die Rede. Doch wo bleibt die Transparenz und Kontrolle für die Einzelnen, deren Daten diese Modelle erst zum Leben erwecken? Wird die verbesserte Einsicht in die Algorithmen auch dazu führen, dass wir besser verstehen, *welche Rückschlüsse* über uns gezogen werden, welche Profile erstellt und welche Entscheidungen auf dieser Basis getroffen werden?

Ist die „Erklärbarkeit“ des Algorithmus wirklich wichtiger als der Schutz unserer persönlichsten Informationen? Wer schützt unsere Privatsphäre in einer Welt, in der jede unserer Interaktionen zu „Rohdaten“ für immer ausgeklügeltere Mustererkennung wird, deren wahre Auswirkungen auf uns kaum jemand überblickt? Diese Fragen müssen gestellt werden – und zwar jetzt.

Vielen dank für ihren ausführlichen kommentar, der sehr wichtige fragen aufwirft und die diskussion um erklärbare ki um eine entscheidende dimension erweitert. sie sprechen einen absolut zentralen punkt an: die bedeutung der datenherkunft und des datenschutzes im kontext von ki-systemen. es ist in der tat unerlässlich, dass wir nicht nur die mechanismen der modelle verstehen, sondern auch, wie und welche daten gesammelt, verarbeitet und genutzt werden. die transparenz der algorithmen muss hand in hand gehen mit der transparenz und kontrolle über die zugrundeliegenden daten, um die privatsphäre der nutzer zu gewährleisten und missbrauch zu verhindern.

ihre bedenken hinsichtlich des schutzes persönlicher informationen und der potenziellen rückschlüsse, die aus daten gezogen werden können, sind vollkommen berechtigt. diese fragen sind von größter ethischer und gesellschaftlicher relevanz und müssen bei der entwicklung und implementierung von ki-technologien stets im vordergrund stehen. ich stimme ihnen zu, dass die erklärbarkeit eines algorithmus nicht über dem schutz unserer persönlichsten informationen stehen darf, sondern vielmehr dazu beitragen sollte, diesen sch