Im dynamischen Feld des Machine Learning (ML) und der Künstlichen Intelligenz (KI) ist die Qualität und Repräsentation von Daten entscheidend für den Erfolg von Vorhersagemodellen. Ein Begriff, der in diesem Kontext immer wieder auftaucht und dessen Bedeutung kaum zu überschätzen ist, ist Feature Engineering. Es ist die Kunst und Wissenschaft, rohe Daten in aussagekräftige Merkmale umzuwandeln, die Algorithmen nutzen können, um Muster zu erkennen und präzise Vorhersagen zu treffen.

Dieser ausführliche Blogbeitrag taucht tief in die Definition, die verschiedenen Ansätze und die entscheidende Rolle des Merkmalsengineerings in der Entwicklung prädiktiver Machine-Learning-Modelle ein. Wir werden untersuchen, warum gute Merkmale oft wichtiger sind als komplexe Modelle, welche Methoden zur Verfügung stehen und wie dieser iterative Prozess die Leistungsfähigkeit und Interpretierbarkeit von KI-Systemen maßgeblich beeinflusst. Von der Merkmalsextraktion bis zur Automatisierung – erfahren Sie, wie Sie Ihre Daten optimal für Machine-Learning-Anwendungen aufbereiten können.

Grundlagen des Feature Engineering in Machine Learning

Feature Engineering, auch bekannt als Merkmalsengineering, ist ein fundamentaler Schritt in der Entwicklung von Machine-Learning-Modellen. Es geht darum, aus den vorhandenen Rohdaten neue Variablen zu erstellen oder bestehende zu transformieren, die es einem Algorithmus ermöglichen, die zugrunde liegenden Muster des Problems besser zu erfassen. Die Qualität der Eingabedaten hat einen direkten und oft dominierenden Einfluss auf die Leistungsfähigkeit eines Modells. Selbst der fortschrittlichste Algorithmus kann mit schlecht aufbereiteten oder unzureichenden Merkmalen keine optimalen Ergebnisse liefern. Hier gilt der Grundsatz: „Garbage In, Garbage Out“.

Die Bedeutung von Feature Engineering erstreckt sich über die reine Modellgenauigkeit hinaus. Gut konstruierte Merkmale können die Komplexität eines Modells reduzieren, die Trainingszeit verkürzen und die Interpretierbarkeit der Ergebnisse verbessern. Ein einfaches lineares Modell mit exzellenten Merkmalen kann oft ein komplexes Deep-Learning-Modell mit rohen oder schlecht aufbereiteten Daten übertreffen. Es ist eine kreative und datengetriebene Tätigkeit, die tiefes Domänenwissen und ein Verständnis für die Funktionsweise von Machine-Learning-Algorithmen erfordert. Entwickler und Data Scientists, die das Merkmalsengineering für Machine Learning beherrschen, sind in der Lage, robuste und leistungsstarke KI-Systeme zu entwickeln.

Was ist ein „Feature“ im Kontext von ML?

Im Kern des Feature Engineering steht der Begriff „Feature“ oder „Merkmal“. Ein Feature ist eine individuelle, messbare Eigenschaft oder Attribut eines Phänomens, das man zu modellieren versucht. In tabellarischen Daten repräsentiert jede Spalte, die einen Aspekt einer Beobachtung beschreibt, potenziell ein Merkmal. Wenn wir beispielsweise Daten über Häuser haben, könnten Merkmale die Anzahl der Zimmer, die Wohnfläche, das Baujahr oder die Entfernung zur nächsten Schule sein.

Ein Feature unterscheidet sich von einem einfachen Attribut dadurch, dass es im Kontext eines spezifischen Machine-Learning-Problems relevant und nützlich ist. Es liefert dem Modell Informationen, um eine Vorhersage zu treffen oder eine Klassifikation durchzuführen. Die Auswahl und Konstruktion der richtigen Merkmale ist entscheidend, da sie die „Sprache“ darstellen, die das Modell versteht. Ohne relevante Merkmale kann ein Modell die Struktur der Daten nicht lernen. Betrachten wir einige Beispiele für Features in verschiedenen Domänen:

- Computervision: Bei der Bilderkennung könnte ein Bild die Beobachtung sein. Merkmale könnten hier Linien, Kanten, Farbinformationen oder Texturen sein, die aus den Rohpixeln extrahiert wurden.

- Natürliche Sprachverarbeitung (NLP): Ein Dokument oder ein Satz ist eine Beobachtung. Merkmale könnten die Häufigkeit bestimmter Wörter (TF-IDF), die Länge des Satzes, die Anzahl der Verben oder die Verwendung von Negationen sein.

- Zeitreihenanalyse: Eine Beobachtung ist ein Zeitpunkt. Merkmale könnten hier der Wert zum Zeitpunkt t-1, der gleitende Durchschnitt der letzten N Werte oder saisonale Indikatoren (z.B. Monat, Wochentag) sein.

Die Transformation von Rohdaten in aussagekräftige Features ist oft der anspruchsvollste und zeitaufwändigste Teil des Machine-Learning-Workflows, aber auch der, der den größten Hebel für die Modellperformance bietet.

“Die Auswahl der Features ist von grundlegender Bedeutung. Indem man gut auswählt, was man dem System beibringt, kann man das System in die Lage versetzen, mit viel weniger Daten oder mit viel einfacheren Algorithmen zu lernen.” – Andrew Ng

Verschiedene Ansätze des Feature Engineering

Feature Engineering ist kein monolithischer Prozess, sondern umfasst eine Reihe von Techniken und Ansätzen, die je nach Datentyp und Problemstellung variieren. Die Wahl des richtigen Ansatzes erfordert Erfahrung und ein tiefes Verständnis der Daten. Hier sind die wichtigsten Methoden im Detail:

Feature Importance (Merkmalspriorität)

Bevor man neue Merkmale erstellt oder bestehende transformiert, ist es oft hilfreich zu verstehen, welche der vorhandenen Merkmale bereits einen signifikanten Einfluss auf die Zielvariable haben. Bei der Feature Importance wird der Nutzen eines Merkmals objektiv bewertet. Dies hilft nicht nur bei der Auswahl relevanter Merkmale, sondern kann auch als Inspiration für die Konstruktion neuer, ähnlicher Merkmale dienen.

Typische Methoden zur Bewertung der Merkmalsbedeutung umfassen:

- Korrelationskoeffizienten: Messen die lineare Beziehung zwischen einem Merkmal und der Zielvariablen. Hohe Korrelationen deuten auf relevante Merkmale hin.

- Tree-basierte Methoden: Algorithmen wie Random Forests oder Gradient Boosting Trees können die Bedeutung von Merkmalen basierend darauf schätzen, wie oft sie zur Aufteilung von Knoten verwendet werden und wie stark sie die Reinheit der Knoten erhöhen (z.B. Gini-Importance oder Mean Decrease Impurity).

- Permutation Importance: Misst, wie stark die Modellleistung abnimmt, wenn die Werte eines einzelnen Merkmals zufällig permutiert werden. Ein großer Leistungsabfall deutet auf ein wichtiges Merkmal hin.

- Statistische Tests: Für kategoriale Merkmale können Chi-Quadrat-Tests verwendet werden, für numerische Merkmale in Bezug auf kategoriale Ziele ANOVA.

Ein Python-Beispiel zur Ermittlung der Feature Importance mit einem Random Forest Classifier:

import pandas as pd

from sklearn.ensemble import RandomForestClassifier

from sklearn.datasets import load_iris

# Beispiel-Datensatz laden

iris = load_iris()

X = pd.DataFrame(iris.data, columns=iris.feature_names)

y = iris.target

# Modell trainieren

model = RandomForestClassifier(random_state=42)

model.fit(X, y)

# Feature Importances abrufen

feature_importances = pd.Series(model.feature_importances_, index=X.columns)

print("Feature Importances:")

print(feature_importances.sort_values(ascending=False))

# Ausgabe könnte sein:

# Feature Importances:

# petal width (cm) 0.454955

# petal length (cm) 0.435773

# sepal length (cm) 0.081878

# sepal width (cm) 0.027394

# dtype: float64

Feature Extraction (Merkmalsextraktion)

Die Merkmalsextraktion zielt darauf ab, aus hochdimensionalen Rohdaten automatisch neue, kompaktere Merkmale zu konstruieren. Dies ist besonders nützlich, wenn die ursprünglichen Beobachtungen zu umfangreich oder zu komplex sind, um direkt von prädiktiven Algorithmen modelliert zu werden (z.B. Bilder, Audio, Text). Das Hauptziel ist die Dimensionsreduktion, d.h. die Umwandlung der Daten in einen Raum mit weniger Dimensionen, während so viel relevante Information wie möglich erhalten bleibt.

Gängige Techniken sind:

- Principal Component Analysis (PCA): Eine lineare Methode, die die Daten auf eine neue Achsenkoordinatenbasis projiziert, die die größte Varianz in den Daten erfassen.

- Linear Discriminant Analysis (LDA): Ähnlich wie PCA, aber für Klassifikationsprobleme optimiert, da sie versucht, die Trennbarkeit zwischen Klassen zu maximieren.

- t-Distributed Stochastic Neighbor Embedding (t-SNE): Eine nicht-lineare Technik zur Dimensionsreduktion, die sich besonders gut für die Visualisierung hochdimensionaler Daten in 2D oder 3D eignet.

- Textbasierte Merkmalsextraktion: Techniken wie TF-IDF (Term Frequency-Inverse Document Frequency) oder Word Embeddings (Word2Vec, GloVe) wandeln Text in numerische Vektoren um.

- Bildbasierte Merkmalsextraktion: Algorithmen wie HOG (Histogram of Oriented Gradients) oder SIFT (Scale-Invariant Feature Transform) extrahieren charakteristische Muster aus Bildern.

Beispiel für PCA in Python:

import pandas as pd

from sklearn.decomposition import PCA

from sklearn.preprocessing import StandardScaler

from sklearn.datasets import load_wine

# Beispiel-Datensatz laden

wine = load_wine()

X = pd.DataFrame(wine.data, columns=wine.feature_names)

# Daten skalieren (wichtig für PCA)

scaler = StandardScaler()

X_scaled = scaler.fit_transform(X)

# PCA anwenden, um auf 2 Hauptkomponenten zu reduzieren

pca = PCA(n_components=2)

X_pca = pca.fit_transform(X_scaled)

print("Original-Dimensionen:", X.shape)

print("Reduzierte Dimensionen (PCA):", X_pca.shape)

print("Erklärte Varianz pro Komponente:", pca.explained_variance_ratio_)

# Ausgabe könnte sein:

# Original-Dimensionen: (178, 13)

# Reduzierte Dimensionen (PCA): (178, 2)

# Erklärte Varianz pro Komponente: [0.36187319 0.19368175]

Feature Selection (Merkmalsauswahl)

Im Gegensatz zur Extraktion, bei der neue Merkmale konstruiert werden, konzentriert sich die Merkmalsauswahl darauf, eine Teilmenge der bestehenden Attribute zu identifizieren, die am relevantesten für das zu lösende Problem sind. Dies eliminiert redundante, irrelevante oder verrauschte Merkmale, was zu einfacheren Modellen, schnellerem Training und verbesserter Generalisierungsfähigkeit führen kann.

Methoden der Feature Selection werden in drei Hauptkategorien unterteilt:

- Filter-Methoden: Bewerten Merkmale basierend auf statistischen Maßen (z.B. Korrelation, Chi-Quadrat, Information Gain) unabhängig vom Machine-Learning-Modell. Sie „filtern“ die besten Merkmale heraus.

- Wrapper-Methoden: Verwenden die Performance eines spezifischen Machine-Learning-Modells, um die Qualität einer Merkmals-Teilmenge zu bewerten. Beispiele sind Forward Selection, Backward Elimination und Rekursive Feature-Eliminierung (RFE).

- Embedded-Methoden: Führen die Merkmalsauswahl als Teil des Modelltrainingsprozesses durch. Algorithmen wie Lasso (L1-Regularisierung) oder Entscheidungsbäume wählen automatisch die wichtigsten Merkmale aus oder geben ihnen höhere Gewichte.

Beispiel für Feature Selection mit `SelectKBest` (Filter-Methode) in Python:

import pandas as pd

from sklearn.feature_selection import SelectKBest, f_classif

from sklearn.datasets import load_iris

# Beispiel-Datensatz laden

iris = load_iris()

X = pd.DataFrame(iris.data, columns=iris.feature_names)

y = iris.target

# Die besten 2 Features mit F-Score-Statistik auswählen

selector = SelectKBest(score_func=f_classif, k=2)

X_selected = selector.fit_transform(X, y)

print("Originale Feature-Namen:", X.columns.tolist())

print("Ausgewählte Features (Indizes):", selector.get_support(indices=True))

print("Ausgewählte Feature-Namen:", X.columns[selector.get_support()].tolist())

# Ausgabe könnte sein:

# Originale Feature-Namen: ['sepal length (cm)', 'sepal width (cm)', 'petal length (cm)', 'petal width (cm)']

# Ausgewählte Features (Indizes): [2 3]

# Ausgewählte Feature-Namen: ['petal length (cm)', 'petal width (cm)']

Feature Construction (Merkmalskonstruktion)

Bei der Merkmalskonstruktion werden neue Merkmale manuell aus den Rohdaten erstellt, oft durch die Kombination oder Transformation bestehender Merkmale. Dies erfordert ein tiefes Domänenwissen und Kreativität, um Hypothesen über verborgene Beziehungen in den Daten aufzustellen. Obwohl zeitaufwändig, kann dies den größten Sprung in der Modellperformance bedeuten.

Häufige Techniken für die Merkmalskonstruktion sind:

- Numerische Transformationen:

- Polynomiale Features: Erstellung von Potenzen (x^2, x^3) oder Interaktionstermen (xy) aus bestehenden numerischen Merkmalen, um nicht-lineare Beziehungen zu erfassen.

- Binning/Diskretisierung: Umwandlung kontinuierlicher numerischer Merkmale in kategoriale Intervalle (z.B. Alter in Altersgruppen).

- Logarithmische Transformationen: Anwenden von log(), sqrt() auf schiefe Verteilungen, um sie normaler zu gestalten.

- Kategoriale Transformationen:

- One-Hot Encoding: Umwandlung kategorialer Variablen in binäre Merkmale.

- Label Encoding: Zuweisung einer numerischen ID zu jeder Kategorie.

- Frequenz-Encoding: Ersetzen von Kategorien durch ihre Häufigkeit im Datensatz.

- Datum- und Zeit-Features: Zerlegung von Datum/Zeitstempeln in spezifische Komponenten wie Jahr, Monat, Tag, Wochentag, Stunde, ist Werktag/Wochenende, Zeit seit Ereignis, etc.

- Aggregierte Features: Berechnung von Summen, Durchschnitten, Minima, Maxima, Zählungen über Gruppen von Daten.

Beispiel für polynomiale Features und Datum-Features in Python:

import pandas as pd

from sklearn.preprocessing import PolynomialFeatures

# Beispiel für polynomiale Features

data = {'feature1': [1, 2, 3, 4], 'feature2': [5, 6, 7, 8]}

df = pd.DataFrame(data)

# Erstellen von polynomialen Features bis Grad 2 (inkl. Interaktionen)

poly = PolynomialFeatures(degree=2, include_bias=False)

poly_features = poly.fit_transform(df)

df_poly = pd.DataFrame(poly_features, columns=poly.get_feature_names_out(df.columns))

print("Original DataFrame:")

print(df)

print("nDataFrame mit polynomialen Features:")

print(df_poly)

# Beispiel für Datum- und Zeit-Features

df_time = pd.DataFrame({'timestamp': pd.to_datetime(['2023-01-01 10:00:00', '2023-01-02 14:30:00'])})

df_time['jahr'] = df_time['timestamp'].dt.year

df_time['monat'] = df_time['timestamp'].dt.month

df_time['wochentag'] = df_time['timestamp'].dt.dayofweek # Montag=0, Sonntag=6

df_time['stunde'] = df_time['timestamp'].dt.hour

df_time['ist_wochenende'] = (df_time['timestamp'].dt.dayofweek >= 5).astype(int)

print("nDataFrame mit Datum-Features:")

print(df_time)

Feature Learning (Merkmalslernen)

Der fortschrittlichste Ansatz ist das Feature Learning, bei dem das Machine-Learning-Modell selbst in der Lage ist, optimale Merkmalsrepräsentationen aus den Rohdaten automatisch zu identifizieren und zu lernen. Dies wird hauptsächlich durch moderne Deep-Learning-Methoden ermöglicht.

Technologien wie Convolutional Neural Networks (CNNs) für Bilder, Recurrent Neural Networks (RNNs) oder Transformer-Modelle für Text verarbeiten Rohdaten (z.B. Pixelwerte oder Wort-Token) und lernen in ihren tiefen Schichten hierarchisch immer abstraktere und relevantere Merkmale. Autoencoder oder Restricted Boltzmann Machines sind weitere Beispiele für unüberwachte Lernverfahren, die komprimierte, latente Merkmalsdarstellungen erzeugen können.

Der große Vorteil des Feature Learning ist die Automatisierung und die Fähigkeit, komplexe, nicht-lineare Beziehungen zu erfassen, die manuell kaum zu entdecken wären. Der Nachteil ist oft die „Blackbox“-Natur dieser Modelle, die es schwierig macht, zu verstehen, welche spezifischen Merkmale gelernt wurden und wie sie zu den Vorhersagen beitragen. Dies kann die Interpretierbarkeit des Modells einschränken, was in kritischen Anwendungsbereichen problematisch sein kann.

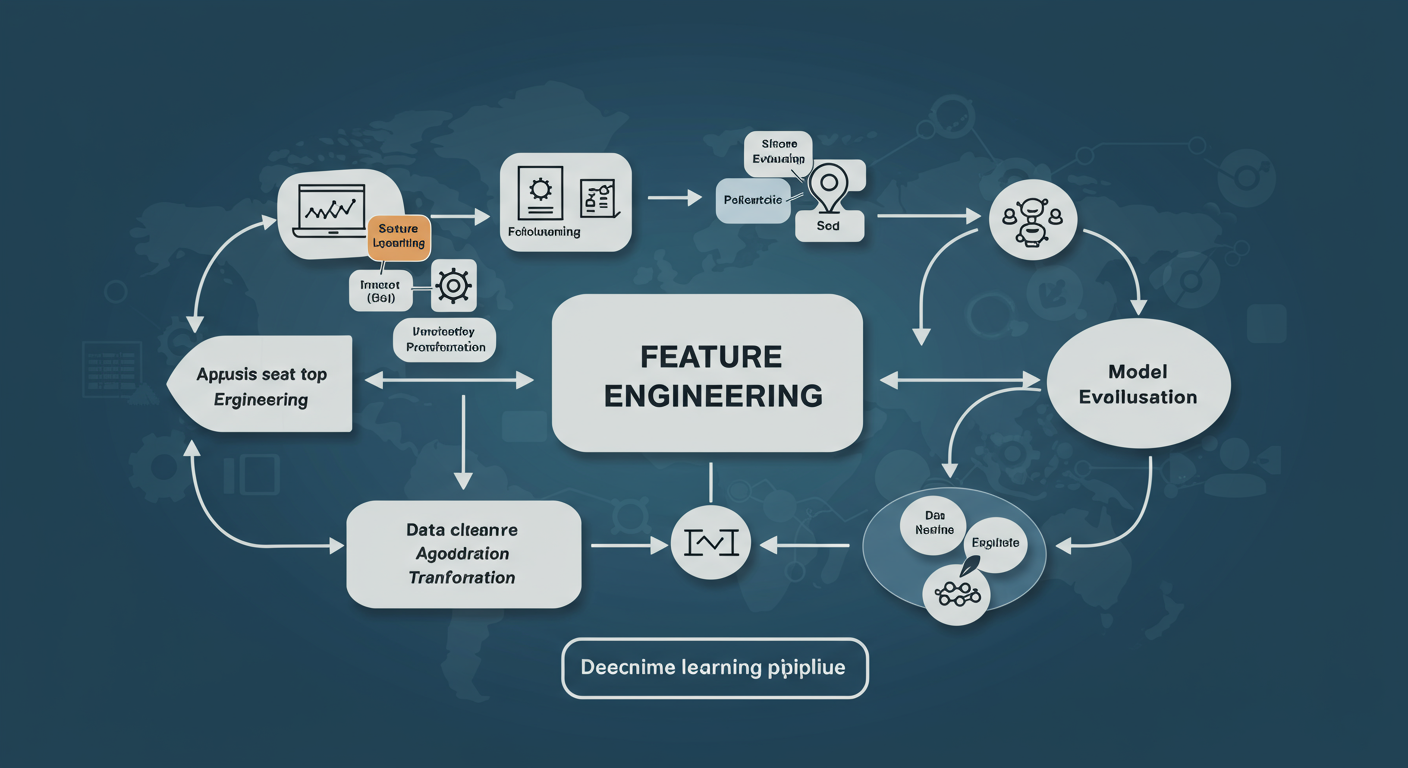

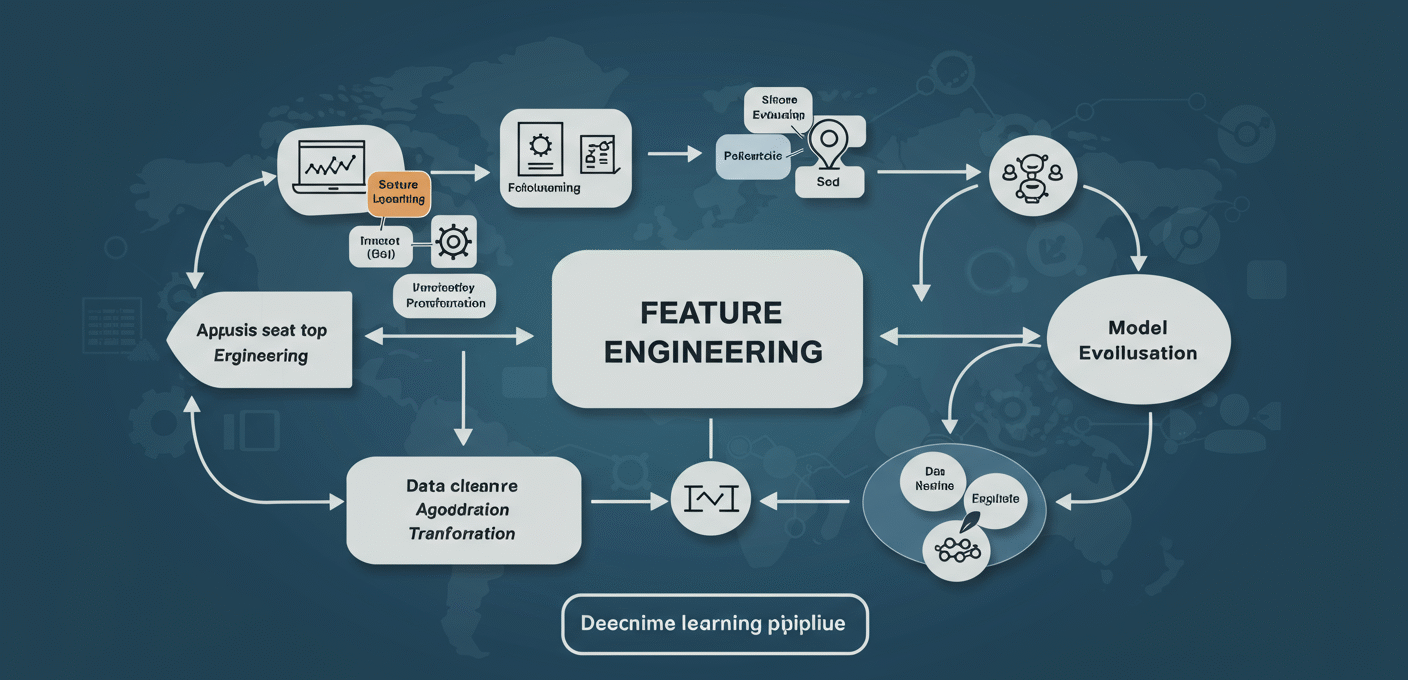

Der iterative Prozess des Feature Engineering

Feature Engineering ist kein einmaliger Schritt, sondern ein integraler, iterativer Bestandteil der gesamten Machine-Learning-Pipeline. Es fügt sich nahtlos in den Prozess der Datenwissenschaft ein, der typischerweise mit der Problemdefinition beginnt und über die Datenerfassung, -bereinigung, -exploration, -modellierung, -bewertung bis zur Bereitstellung reicht.

Innerhalb dieses Workflows findet das Merkmalsengineering für die Datenvorbereitung statt, nachdem die Rohdaten gesammelt und grundlegend bereinigt wurden. Es geht darum, die Daten in ein Format zu überführen, das für die spezifischen Anforderungen des gewählten Machine-Learning-Algorithmus optimal ist. Der Prozess kann wie folgt dargestellt werden:

- Problemdefinition: Klares Verständnis dessen, was vorhergesagt werden soll.

- Datenerfassung & -bereinigung: Sammeln von Rohdaten, Handhabung fehlender Werte, Umgang mit Ausreißern.

- Datenexploration & Analyse: Verstehen der Datenstruktur, Identifizierung potenzieller Beziehungen und Merkmale.

- Feature Engineering: Anwendung der oben genannten Ansätze (Extraction, Selection, Construction) zur Erstellung und Transformation von Merkmalen.

- Modellauswahl & Training: Auswahl eines passenden Algorithmus und Training des Modells mit den aufbereiteten Features.

- Modellbewertung: Evaluierung der Modellleistung anhand relevanter Metriken (z.B. Genauigkeit, Präzision, Recall, F1-Score).

- Rückmeldung & Iteration: Wenn die Modellleistung unzureichend ist oder neue Erkenntnisse gewonnen werden, kehrt man zum Feature Engineering oder sogar zu früheren Schritten zurück. Man testet neue Feature-Sets, überarbeitet bestehende oder probiert andere Transformationen aus. Dieser Feedback-Loop ist entscheidend für die Optimierung.

Dieser iterative Zyklus stellt sicher, dass die Modelle kontinuierlich verbessert werden und sich optimal an die Daten anpassen. Es ist ein Experimentierfeld, in dem Hypothesen über Datenbeziehungen formuliert und durch Modellperformance validiert werden.

Anwendungsbereiche und die Kraft des Feature Engineering

Die Anwendung von Feature Engineering ist weitreichend und essenziell für den Erfolg von Machine-Learning-Projekten in fast jeder Branche. Durch geschicktes Feature Engineering in Machine Learning Projekten können komplexe Probleme oft mit überraschend einfachen Modellen gelöst werden. Die Fähigkeit, die intrinsische Struktur der Daten zu entschlüsseln und in einer für den Algorithmus verständlichen Weise darzustellen, ist ein Game Changer.

Historische Beispiele unterstreichen dies eindrucksvoll:

- KDD Cup 2010 (Schülerleistungsvorhersage): Bei diesem Wettbewerb mussten die Teilnehmer die zukünftige Leistung von Schülern in Algebra vorhersagen. Das Gewinnerteam der National Taiwan University dominierte den Wettbewerb, indem es Millionen von binären Merkmalen aus den Rohdaten generierte. Sie reduzierten nicht-lineare Elemente wie Zeitlichkeit auf einfache binäre Indikatoren. Dies ermöglichte es ihnen, hochleistungsfähige Vorhersagemodelle mit relativ einfachen linearen Methoden zu erstellen. Die Macht der Binärisierung und Aggregation von Features wurde hier eindrucksvoll demonstriert.

- Heritage Health Prize (Krankenhaus-Wiederaufnahme-Vorhersage): Dieser Wettbewerb mit einem Preisgeld von drei Millionen US-Dollar zielte darauf ab, vorherzusagen, welche Patienten im nächsten Jahr wieder ins Krankenhaus eingeliefert werden. Auch hier spielten innovative Feature-Engineering-Techniken eine Schlüsselrolle für die besten Teams, die komplexe Patientenhistorien in aussagekräftige Merkmale umwandelten.

Darüber hinaus findet Feature Engineering breite Anwendung in Bereichen wie:

- Betrugserkennung: Erstellung von Merkmalen wie die Häufigkeit von Transaktionen innerhalb kurzer Zeit, der Durchschnittswert von Transaktionen in einer bestimmten Kategorie oder Vergleiche mit historischen Transaktionsmustern, um anomales Verhalten zu identifizieren.

- Empfehlungssysteme: Ableitung von Merkmalen wie die durchschnittliche Bewertung eines Nutzers, die Anzahl der angesehenen Artikel in einer Kategorie oder die Ähnlichkeit zwischen Benutzern/Artikeln.

- Predictive Maintenance: Umwandlung von Sensordaten (Temperatur, Vibration, Druck) in rollierende Durchschnitte, Varianzen, Frequenzdomänenmerkmale (mittels FFT), um den Verschleiß von Maschinen vorherzusagen.

- Kreditrisikobewertung: Generierung von Features wie Schuld-Einkommen-Verhältnis, Historie der Kreditkartennutzung oder Anzahl der ausstehenden Kredite.

In all diesen Fällen ermöglicht das Feature Engineering, die verborgene Intelligenz in den Daten zu entfesseln und in eine Form zu bringen, die für Machine-Learning-Algorithmen optimal nutzbar ist.

Automatisierung des Feature Engineering: Der Weg zur Effizienz

Trotz seiner immensen Bedeutung ist Feature Engineering ein zeitaufwändiger, ressourcenintensiver und hochspezialisierter Prozess. Er erfordert nicht nur technisches Fachwissen in Statistik, Programmierung und Machine Learning, sondern auch tiefes Domänenwissen, um relevante Hypothesen zu formulieren. Für Data-Science-Teams bedeutet dies oft monatelange Arbeit und viele manuelle Iterationen.

Die Automatisierung des Feature Engineering hat daher das Potenzial, die Data Science grundlegend zu revolutionieren. Die Vorteile liegen auf der Hand:

- Erhöhte Effizienz: Was manuell Tage oder Wochen dauern würde, kann automatisiert in Stunden erledigt werden. Millionen von potenziellen Hypothesen und Merkmalskombinationen können schnell evaluiert werden.

- Reduzierter manueller Aufwand: Weniger manuelle SQL-Abfragen, Skripte und Trial-and-Error-Versuche.

- Zugänglichkeit: Demokratisierung des Machine Learning, indem es auch Personen ohne tiefgehende Programmier- oder Statistikkenntnisse ermöglicht wird, effektive Modelle zu entwickeln.

- Bessere Performance: Automatisierte Tools können oft Merkmale entdecken, die menschliche Experten übersehen würden.

Produkte und Frameworks im Bereich AutoML (Automated Machine Learning) haben in den letzten Jahren erhebliche Fortschritte gemacht, um das Feature Engineering zu automatisieren. Diese Tools können automatisch Hunderte oder Tausende von Features generieren, verschiedene Transformationen anwenden (z.B. One-Hot Encoding, Normalisierung, polynomiale Expansion) und die besten Merkmalssets für ein gegebenes Problem auswählen.

Einige AutoML-Plattformen können den gesamten Zyklus von den Rohdaten bis zur Bereitstellung des Modells in einem Bruchteil der Zeit abwickeln, die für manuelle Prozesse erforderlich wäre. Dies versetzt Data-Science-Teams in die Lage, viel mehr Machine-Learning-Modelle zu liefern und sich auf höherwertige Aufgaben wie die Problemdefinition und die Interpretation von Ergebnissen zu konzentrieren. Die Entwicklung von automatisiertem Feature Engineering ist ein zentraler Trend in der Datenwissenschaft.

Feature Engineering beherrschen und die Zukunft der KI gestalten

Feature Engineering ist unbestreitbar das Herzstück der modernen Data Science und des Machine Learning. Es ist die Brücke zwischen rohen Daten und leistungsstarken, intelligenten Systemen. Wer diese Disziplin beherrscht, besitzt einen entscheidenden Vorteil in der Entwicklung präziser und effektiver KI-Lösungen. Um das Feature Engineering zu lernen und zu meistern, ist eine Kombination aus theoretischem Wissen und praktischer Erfahrung unerlässlich. Dazu gehören ein tiefes Verständnis von Python-Programmierung, Statistik, Datenstrukturen und den mathematischen Grundlagen von Machine-Learning-Algorithmen. Praxisorientierte Projekte und das Studium von Fallstudien sind dabei von unschätzbarem Wert.

Für all jene, die eine Karriere in den Datenwissenschaften anstreben oder ihre bestehenden Fähigkeiten vertiefen möchten, ist die kontinuierliche Weiterbildung im Bereich effektives Feature Engineering von größter Bedeutung. Es ist nicht nur eine technische Fähigkeit, sondern eine Denkweise, die es ermöglicht, die verborgenen Geschichten und Muster in den Daten zu entschlüsseln und sie für predictive Analytics nutzbar zu machen. Bleiben Sie neugierig, experimentieren Sie und tragen Sie dazu bei, die Grenzen dessen zu erweitern, was mit Machine Learning möglich ist.

Wenn Sie Ihre Fähigkeiten weiterentwickeln möchten, können Sie hier einen Blick auf passende Lernressourcen und Praxisprojekte werfen, um Ihr Verständnis für Data Science und Machine Learning zu vertiefen. Die Welt der Daten wartet darauf, von Ihnen entschlüsselt zu werden.

Entschuldigen Sie bitte die vielleicht dumme Frage, aber ich bin ganz neu in diesem Bereich: Wenn Sie von „Rohdaten in aussagekräftige Merkmale umwandeln“ sprechen, könnte man das vielleicht ganz einfach an einem winzigen Beispiel erklären, damit ich mir das besser vorstellen kann? Ich verstehe noch nicht ganz, was diese „Merkmale“ dann genau sind.

Vielen dank für ihre sehr gute frage. es gibt keine dummen fragen, besonders wenn man neu in einem gebiet ist. stellen sie sich vor, sie haben rohdaten über die größe und das gewicht von menschen. diese sind erst einmal nur zahlen. ein „aussagekräftiges merkmal“ könnte dann zum beispiel der body-mass-index bmi sein, der aus diesen beiden rohdaten berechnet wird. der bmi ist ein einziges merkmal, das uns viel mehr über den gesundheitszustand einer person verrät als die größe oder das gewicht allein.

solche merkmale sind im grunde neue informationen, die wir aus den vorhandenen rohdaten ableiten, um ein tieferes verständnis zu gewinnen oder ein problem besser lösen zu können. sie sind die bausteine, mit denen wir dann analysen durchführen oder modelle erstellen. ich hoffe, dieses kleine beispiel hilft ihnen, sich das besser vorzustellen. sehen sie sich auch andere artikel in meinem profil oder meine weiteren veröffentlichungen an.