Die Fähigkeit, die Unterschiede und Ähnlichkeiten zwischen Datenverteilungen präzise zu quantifizieren, ist ein Eckpfeiler moderner Datenanalyse und maschinellen Lernens. Ein fundamentales Konzept, das in diesem Bereich unentbehrlich ist, ist die Kullback-Leibler-Divergenz, oft auch als KL-Divergenz oder relative Entropie bezeichnet. Sie bietet ein leistungsstarkes Ähnlichkeitsmaß in der Data Science, um zu verstehen, wie stark zwei Wahrscheinlichkeitsverteilungen vergleichen. Dieses tiefergehende Verständnis der Beziehungen zwischen Datensätzen ist entscheidend für die Modellbewertung, Anomalieerkennung und die Entwicklung intelligenter Systeme.

In diesem umfassenden Blogbeitrag tauchen wir tief in die Welt der Kullback-Leibler-Divergenz ein. Wir beleuchten ihre historischen Wurzeln, ihre exakte mathematische Definition für diskrete und kontinuierliche Verteilungen und ihre vielfältigen praktischen Anwendungen. Für Entwickler, Studenten und Technologiebegeisterte, die tiefgehende Informationen zur Kullback-Leibler-Divergenz suchen, bieten wir detaillierte Erklärungen, intuitive Interpretationen und praktische Python-Codebeispiele, um dieses mächtige statistische Werkzeug greifbar zu machen und es in der statistischen Analyse von Daten effektiv einsetzen zu können.

Die Ursprünge der Kullback-Leibler-Divergenz und ihre Bedeutung

Die Geschichte der Kullback-Leibler-Divergenz beginnt in den frühen 1950er Jahren und ist eng mit der Entwicklung der Informationstheorie verbunden. Zwei brillante amerikanische Statistiker, Solomon Kullback und Richard Leibler, suchten nach einer Methode, um den „Abstand“ oder die „Unähnlichkeit“ zwischen zwei Wahrscheinlichkeitsverteilungen zu messen. Solomon Kullback, geboren 1907 in Polen, leistete bedeutende Beiträge zur statistischen Analyse und zur Informationstheorie, nachdem er an der University of Michigan in Mathematik promovierte. Richard Leibler, geboren 1926 in New York, ebenfalls promoviert in Statistik an der Columbia University, arbeitete an der Entwicklung statistischer Methoden, insbesondere für biologische Anwendungen.

Im Jahr 1951 veröffentlichte Kullback einen wegweisenden Artikel mit dem Titel „On Information and Sufficiency“, in dem er das Konzept der relativen Entropie einführte, das heute als Kullback-Leibler-Divergenz bekannt ist. Dieses Maß war eine natürliche Erweiterung von Claude Shannons Konzept der Entropie, das die Unsicherheit einer einzelnen Wahrscheinlichkeitsverteilung quantifiziert. Die KL-Divergenz erweitert dies, indem sie misst, wie viel zusätzliche Information erforderlich ist, um eine Verteilung Q zu verwenden, um eine andere Verteilung P zu repräsentieren. Es quantifiziert den Informationsverlust, wenn Q anstelle von P zur Beschreibung der Daten verwendet wird. Dieses fundamentale Konzept hat den Bereich der Informationstheorie Grundlagen und der statistischen Analyse nachhaltig geprägt und ist bis heute ein unverzichtbares Werkzeug in der Datenwissenschaft.

Mathematische Grundlagen der Kullback-Leibler-Divergenz

Definition für diskrete Wahrscheinlichkeitsverteilungen

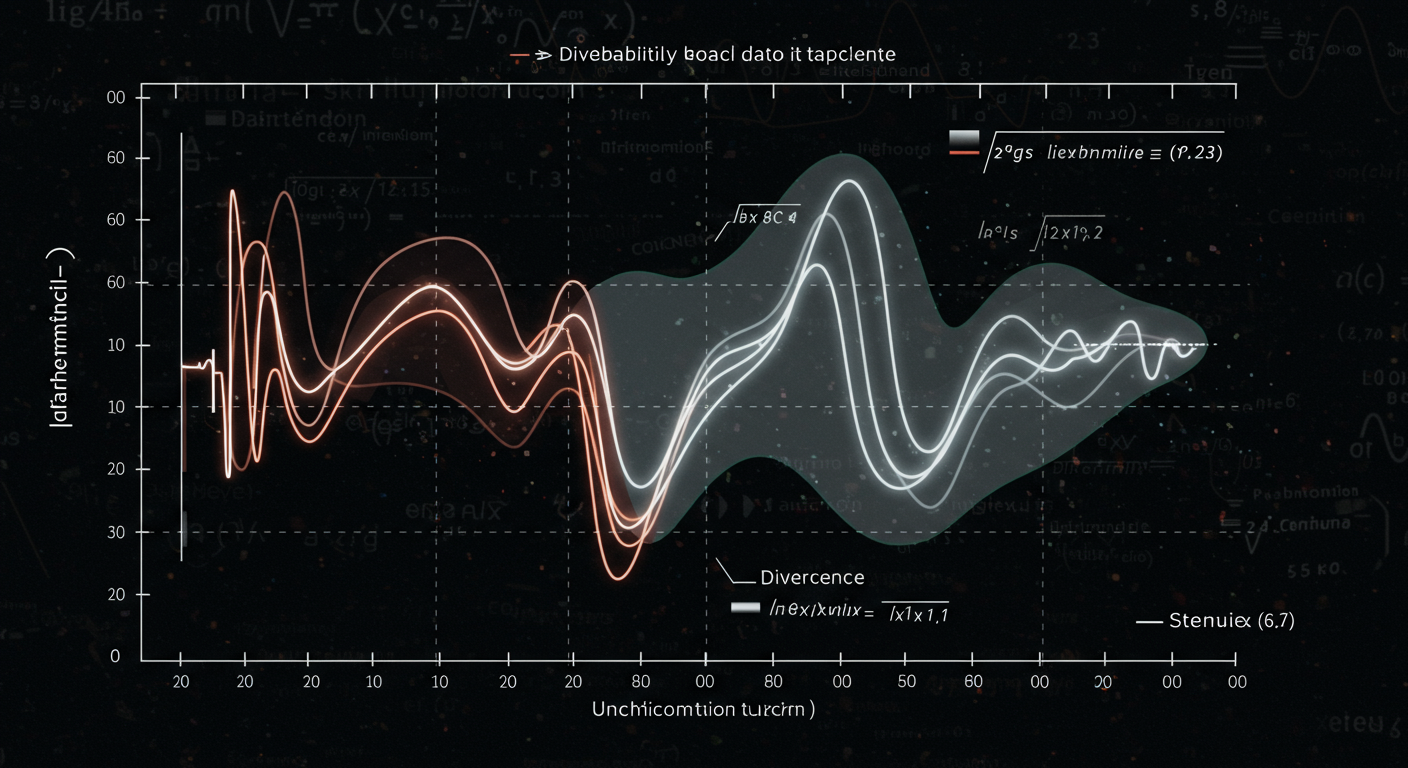

Die Kullback-Leibler-Divergenz ist ein Maß für die Differenz zwischen zwei Wahrscheinlichkeitsverteilungen P und Q. Für den Fall diskreter Wahrscheinlichkeitsverteilungen, bei denen wir eine endliche oder abzählbar unendliche Anzahl von Ereignissen haben, ist die Formel präzise definiert. Angenommen, wir haben zwei diskrete Wahrscheinlichkeitsverteilungen P und Q über denselben Ereignisraum X, wobei X = {x₁, x₂, …, xn}. Die diskrete Wahrscheinlichkeitsverteilungen Formel der KL-Divergenz von Q von P (oft als D(P||Q) geschrieben) ist:

D(P||Q) = Σ P(xi) log(P(xi) / Q(xi))

Hierbei ist die Summe über alle möglichen Ereignisse xi im Ereignisraum X zu bilden. P(xi) ist die Wahrscheinlichkeit des Ereignisses xi unter der Verteilung P, und Q(xi) ist die Wahrscheinlichkeit des Ereignisses xi unter der Verteilung Q. Der Logarithmus wird üblicherweise zur Basis 2 oder zur natürlichen Basis (e) genommen; in der Informationstheorie ist oft Basis 2 üblich, während in Machine Learning-Kontexten oft der natürliche Logarithmus verwendet wird. Wichtig ist, dass Q(xi) niemals Null sein darf, wenn P(xi) ungleich Null ist, da der Logarithmus von Null undefiniert ist.

Die KL-Divergenz D(P||Q) misst den Informationsgewinn, wenn man von einem Modell Q, das P approximieren soll, zu einem Modell P übergeht. Es ist die erwartete zusätzliche Anzahl von Bits, die benötigt werden, um Daten mit Q zu kodieren, wenn die wahre Verteilung P ist.

Ein höherer Wert von D(P||Q) zeigt eine größere Diskrepanz zwischen P und Q an. Ein Wert von Null tritt nur auf, wenn P und Q identisch sind. Es ist wichtig zu beachten, dass die KL-Divergenz nicht symmetrisch ist, d.h., D(P||Q) ist im Allgemeinen nicht gleich D(Q||P), und sie erfüllt auch nicht die Dreiecksungleichung, weshalb sie streng genommen keine Metrik im mathematischen Sinne ist, sondern eine Divergenz.

Hier ist ein Python-Beispiel zur Berechnung der KL-Divergenz für diskrete Verteilungen:

import numpy as np

from scipy.special import rel_entr

def kullback_leibler_divergence_discrete(p, q):

"""

Berechnet die Kullback-Leibler-Divergenz D(P||Q) für diskrete Verteilungen.

Args:

p (np.array): Wahrscheinlichkeitsverteilung P (echte Verteilung).

q (np.array): Wahrscheinlichkeitsverteilung Q (approximierende Verteilung).

Returns:

float: Der Wert der KL-Divergenz.

"""

# Sicherstellen, dass die Verteilungen summiert zu 1

p = np.asarray(p, dtype=np.float64)

q = np.asarray(q, dtype=np.float64)

# Normalisierung, falls nicht bereits geschehen

p = p / np.sum(p)

q = q / np.sum(q)

# Sicherstellen, dass Q(i) > 0, wo P(i) > 0, um Log(0) zu vermeiden

# Eine kleine Konstante (epsilon) kann hinzugefügt werden, um Division durch Null zu verhindern,

# besonders wenn Q(i) Nullen enthält, wo P(i) ungleich Null ist.

# Dies ist eine übliche Praxis, um numerische Stabilität zu gewährleisten.

epsilon = 1e-10

q = np.maximum(q, epsilon) # Ersetzt alle Werte <= epsilon durch epsilon

# Berechnung P(i) log(P(i) / Q(i))

# rel_entr aus scipy.special berechnet P log(P/Q) elementweise

return np.sum(rel_entr(p, q))

# Beispiel 1: Identische Verteilungen (Divergenz sollte 0 sein)

P1 = [0.2, 0.3, 0.5]

Q1 = [0.2, 0.3, 0.5]

print(f"KL-Divergenz D(P1||Q1) (identisch): {kullback_leibler_divergence_discrete(P1, Q1):.4f}")

# Beispiel 2: Unterschiedliche Verteilungen

P2 = [0.1, 0.2, 0.7]

Q2 = [0.3, 0.4, 0.3]

print(f"KL-Divergenz D(P2||Q2) (unterschiedlich): {kullback_leibler_divergence_discrete(P2, Q2):.4f}")

# Beispiel 3: Starke Unterschiede, um Asymmetrie zu zeigen

P3 = [0.9, 0.05, 0.05]

Q3 = [0.05, 0.05, 0.9]

print(f"KL-Divergenz D(P3||Q3): {kullback_leibler_divergence_discrete(P3, Q3):.4f}")

print(f"KL-Divergenz D(Q3||P3): {kullback_leibler_divergence_discrete(Q3, P3):.4f}")

Definition für kontinuierliche Wahrscheinlichkeitsverteilungen

Wenn wir mit kontinuierlichen Wahrscheinlichkeitsverteilungen arbeiten, ändern sich die mathematischen Operationen von Summen zu Integralen, aber das zugrunde liegende Prinzip der KL-Divergenz bleibt dasselbe. Für zwei kontinuierliche Wahrscheinlichkeitsdichtefunktionen (WDF) P(x) und Q(x) über eine kontinuierliche Variable x ist die kontinuierliche Wahrscheinlichkeitsverteilungen Anwendung der KL-Divergenz D(P||Q) definiert als:

D(P||Q) = ∫ P(x) log(P(x) / Q(x)) dx

Das Integral wird über den gesamten Bereich von x berechnet, wo P(x) und Q(x) definiert sind. Ähnlich wie bei diskreten Verteilungen muss Q(x) ungleich Null sein, wenn P(x) ungleich Null ist. Die Interpretation ist analog: Die Divergenz misst, wie viel Information verloren geht, wenn Q zur Approximation von P verwendet wird. Die praktische Berechnung dieses Integrals kann komplex sein, insbesondere wenn P(x) und Q(x) keine analytisch leicht integrierbaren Formen haben. Oft werden Schätzungen basierend auf Stichproben oder numerische Integrationstechniken verwendet.

Eine gängige Strategie in der Praxis ist die Approximation der kontinuierlichen Verteilungen durch diskrete Histogramme, oder die Verwendung von Parametern bekannter Verteilungsfamilien (z.B. Normalverteilungen). Wenn P und Q beispielsweise Normalverteilungen sind, gibt es geschlossene Formeln zur Berechnung der KL-Divergenz. Diese Formeln sind besonders nützlich im Bereich des maschinellen Lernens, beispielsweise bei Variational Autoencodern (VAEs).

Hier ein konzeptionelles Python-Beispiel, das die KL-Divergenz zwischen zwei Normalverteilungen veranschaulicht, unter Verwendung einer bekannten geschlossenen Formel:

import numpy as np

from scipy.stats import norm

def kullback_leibler_divergence_normal(mu1, sigma1, mu2, sigma2):

"""

Berechnet die KL-Divergenz D(P||Q) zwischen zwei Normalverteilungen.

P ~ N(mu1, sigma1^2) und Q ~ N(mu2, sigma2^2).

Args:

mu1 (float): Mittelwert der Verteilung P.

sigma1 (float): Standardabweichung der Verteilung P.

mu2 (float): Mittelwert der Verteilung Q.

sigma2 (float): Standardabweichung der Verteilung Q.

Returns:

float: Der Wert der KL-Divergenz.

"""

# Die Formel für KL-Divergenz zwischen zwei Normalverteilungen

# D(P||Q) = log(sigma2/sigma1) + (sigma1^2 + (mu1-mu2)^2) / (2sigma2^2) - 0.5

term1 = np.log(sigma2 / sigma1)

term2 = (sigma12 + (mu1 - mu2)2) / (2 sigma22)

term3 = 0.5

return term1 + term2 - term3

# Beispiel 1: Zwei identische Normalverteilungen

mu_p1, sigma_p1 = 0, 1

mu_q1, sigma_q1 = 0, 1

print(f"KL-Divergenz N({mu_p1},{sigma_p1})||N({mu_q1},{sigma_q1}) (identisch): {kullback_leibler_divergence_normal(mu_p1, sigma_p1, mu_q1, sigma_q1):.4f}")

# Beispiel 2: Zwei unterschiedliche Normalverteilungen

mu_p2, sigma_p2 = 0, 1

mu_q2, sigma_q2 = 2, 1.5

print(f"KL-Divergenz N({mu_p2},{sigma_p2})||N({mu_q2},{sigma_q2}) (unterschiedlich): {kullback_leibler_divergence_normal(mu_p2, sigma_p2, mu_q2, sigma_q2):.4f}")

# Beispiel 3: Asymmetrie-Beispiel

mu_p3, sigma_p3 = 1, 0.5

mu_q3, sigma_q3 = 1, 2

print(f"KL-Divergenz N({mu_p3},{sigma_p3})||N({mu_q3},{sigma_q3}): {kullback_leibler_divergence_normal(mu_p3, sigma_p3, mu_q3, sigma_q3):.4f}")

print(f"KL-Divergenz N({mu_q3},{sigma_q3})||N({mu_p3},{sigma_p3}): {kullback_leibler_divergence_normal(mu_q3, sigma_q3, mu_p3, sigma_p3):.4f}")

Eigenschaften und Interpretation der KL-Divergenz

Die Kullback-Leibler-Divergenz besitzt einige charakteristische Eigenschaften, die ihr Verständnis und ihre Anwendung erleichtern:

- Nicht-Negativität: Die KL-Divergenz ist immer größer oder gleich Null. D(P||Q) ≥ 0. Sie ist genau dann Null, wenn die beiden Verteilungen P und Q identisch sind. Das bedeutet, dass es keinen Informationsverlust gibt, wenn Q zur Beschreibung von P verwendet wird, weil Q bereits P ist.

- Asymmetrie: D(P||Q) ist im Allgemeinen nicht gleich D(Q||P). Dies ist ein wichtiger Unterschied zu echten Metriken wie dem Euklidischen Abstand. Die Asymmetrie spiegelt wider, dass der „Informationsverlust“ beim Approximieren von P durch Q anders sein kann als der Verlust beim Approximieren von Q durch P. Eine fehlerhafte Annahme über die Verteilung P kann zu einem hohen Informationsverlust führen, während eine fehlerhafte Annahme über Q, die P approximieren soll, einen anderen Informationsverlust bedeutet.

- Keine Metrik: Aufgrund ihrer Asymmetrie und der fehlenden Eigenschaft der Dreiecksungleichung ist die KL-Divergenz keine mathematische Metrik oder Distanzfunktion im strengen Sinne. Sie ist besser als „Maß der Unähnlichkeit“ oder „Divergenz von Wahrscheinlichkeitsmaßen“ zu verstehen.

Die Interpretation der KL-Divergenz ist direkt proportional zu ihrer Größe: Je größer der Wert der KL-Divergenz, desto größer ist der Unterschied zwischen den beiden Wahrscheinlichkeitsverteilungen. Umgekehrt deuten kleine Werte auf eine hohe Ähnlichkeit hin. Dies macht sie zu einem wertvollen Werkzeug, um die Qualität von Modellen zu bewerten oder um Veränderungen in Datenmustern zu identifizieren.

Praktische Anwendungen der Kullback-Leibler-Divergenz in der Technologie

Die Kullback-Leibler-Divergenz findet in einer Vielzahl von technologischen und wissenschaftlichen Bereichen Anwendung, insbesondere in der Datenanalyse, dem maschinellen Lernen und der Informationsverarbeitung. Ihre Fähigkeit, die Unähnlichkeit zwischen Wahrscheinlichkeitsverteilungen zu quantifizieren, macht sie zu einem mächtigen Werkzeug für zahlreiche Aufgaben.

Modellbewertung und -auswahl im Machine Learning

Eine der häufigsten und wichtigsten Anwendungen der KL-Divergenz ist die Bewertung der Qualität von Machine-Learning-Modellen. Insbesondere in Klassifizierungs- und Generierungsaufgaben ist es entscheidend, wie gut ein Modell die zugrunde liegende Datenverteilung oder die Zielverteilung approximieren kann. Die KL-Divergenz ermöglicht es, die vom Modell vorhergesagte Verteilung (Q) mit der tatsächlichen Verteilung der Daten (P) zu vergleichen. Ein niedriger KL-Divergenzwert bedeutet, dass das Modell eine gute Repräsentation der Realität liefert.

- Klassifikationsmodelle: Bei der Bewertung von Klassifikatoren kann die KL-Divergenz verwendet werden, um die Diskrepanz zwischen der vorhergesagten Wahrscheinlichkeitsverteilung der Klassen und der tatsächlichen Klassenverteilung zu messen.

- Generative Modelle: Bei Modellen wie Generative Adversarial Networks (GANs) oder Variational Autoencoders (VAEs) ist die KL-Divergenz ein zentraler Bestandteil der Verlustfunktion. Sie wird verwendet, um sicherzustellen, dass die generierten Datenverteilungen den echten Datenverteilungen so nahe wie möglich kommen. Bei VAEs wird die KL-Divergenz beispielsweise verwendet, um die vom Encoder ausgegebene latente Raumverteilung nahe an einer einfachen A-priori-Verteilung (oft eine Standardnormalverteilung) zu halten.

- Modellauswahl: Bei der Auswahl des besten Modells aus mehreren Kandidaten kann die KL-Divergenz als Kriterium dienen. Das Modell mit der geringsten Divergenz zur echten Datenverteilung wird als das überlegenste angesehen, da es die Modellqualität messen Machine Learning kann und die Daten am genauesten repräsentiert. Dies ist besonders relevant für Klassifizierungs- und Vorhersageprobleme lösen.

Hier ein Python-Beispiel zur Anwendung der KL-Divergenz in der Modellbewertung:

import numpy as np

from scipy.special import rel_entr

def evaluate_model_with_kl_divergence(true_probabilities, predicted_probabilities):

"""

Bewertet ein Modell anhand der KL-Divergenz zwischen wahren und vorhergesagten Wahrscheinlichkeiten.

Args:

true_probabilities (np.array): Die wahre Wahrscheinlichkeitsverteilung der Daten.

predicted_probabilities (np.array): Die vom Modell vorhergesagte Wahrscheinlichkeitsverteilung.

Returns:

float: Die KL-Divergenz D(true_probabilities||predicted_probabilities).

"""

# Sicherstellen, dass die Arrays NumPy-Arrays sind und summiert zu 1

p_true = np.asarray(true_probabilities, dtype=np.float64)

p_pred = np.asarray(predicted_probabilities, dtype=np.float64)

p_true = p_true / np.sum(p_true)

p_pred = p_pred / np.sum(p_pred)

# Handhabung von Nullwahrscheinlichkeiten in p_pred

# Eine kleine Konstante (epsilon) hinzufügen, um Log(0) zu vermeiden.

epsilon = 1e-10

p_pred = np.maximum(p_pred, epsilon)

return np.sum(rel_entr(p_true, p_pred))

# Szenario: Ein Klassifikationsproblem mit 3 Klassen

# Wahre Verteilung der Klassen in einem Datensatz (z.B. 10% Klasse A, 40% Klasse B, 50% Klasse C)

true_dist = [0.1, 0.4, 0.5]

# Modell 1: Gute Vorhersagen

predicted_dist_model1 = [0.12, 0.38, 0.50]

kl_model1 = evaluate_model_with_kl_divergence(true_dist, predicted_dist_model1)

print(f"KL-Divergenz für Modell 1 (gut): {kl_model1:.4f}")

# Modell 2: Weniger gute Vorhersagen

predicted_dist_model2 = [0.05, 0.25, 0.70]

kl_model2 = evaluate_model_with_kl_divergence(true_dist, predicted_dist_model2)

print(f"KL-Divergenz für Modell 2 (weniger gut): {kl_model2:.4f}")

# Modell 3: Schlechte Vorhersagen

predicted_dist_model3 = [0.5, 0.3, 0.2]

kl_model3 = evaluate_model_with_kl_divergence(true_dist, predicted_dist_model3)

print(f"KL-Divergenz für Modell 3 (schlecht): {kl_model3:.4f}")

# Interpretation: Modell 1 hat die niedrigste KL-Divergenz und ist somit das beste Modell.

Anomalieerkennung und Veränderungsanalyse

Die KL-Divergenz ist ein exzellentes Werkzeug zur Erkennung von Veränderungen in Datenströmen oder Zeitreihen. Indem man die Wahrscheinlichkeitsverteilung der Daten zu einem bestimmten Zeitpunkt mit einer Referenzverteilung vergleicht, können signifikante Abweichungen, die auf Anomalien oder interessante Ereignisse hindeuten, identifiziert werden. Diese Methode ist in verschiedenen Bereichen von großem Wert:

- Netzwerksicherheit: Erkennung von ungewöhnlichem Netzwerkverkehr, der auf Angriffe oder Malware hindeuten könnte, indem die aktuelle Traffic-Verteilung mit einer normalen Baseline verglichen wird.

- Systemüberwachung: Überwachung von Systemmetriken (CPU-Auslastung, Speicherverbrauch) und Erkennung von Leistungsanomalien oder Ausfällen.

- Betrugserkennung: Identifizierung von ungewöhnlichen Transaktionsmustern, die auf betrügerische Aktivitäten hinweisen.

- Umweltüberwachung: Erkennung von Veränderungen in Umweltdaten (z.B. Wetterbedingungen, Schadstoffkonzentrationen), die auf Umweltprobleme hindeuten. Dies hilft, Veränderungen in Zeitreihen erkennen und schnell darauf zu reagieren.

Das Konzept ist, eine „normale“ oder „gesunde“ Verteilung P zu definieren und dann die Divergenz D(P||Q) zu einer aktuellen Beobachtungsverteilung Q zu berechnen. Überschreitet D(P||Q) einen bestimmten Schwellenwert, wird eine Anomalie gemeldet.

Ein Beispiel zur Anomalieerkennung in simulierten Sensordaten mit Python:

import numpy as np

from scipy.special import rel_entr

from scipy.stats import gaussian_kde # Für kontinuierliche Dichteschätzung

def calculate_kl_divergence_kde(data_p, data_q):

"""

Berechnet die KL-Divergenz zwischen zwei kontinuierlichen Datensätzen

mithilfe von Kernel-Dichteschätzung (KDE) zur Approximation der WDF.

Args:

data_p (np.array): Referenzdatensatz (normale Bedingung).

data_q (np.array): Aktueller Datensatz (zu prüfende Bedingung).

Returns:

float: Die KL-Divergenz D(P||Q).

"""

# Erstelle ein feines Gitter für die Auswertung der Dichten

min_val = min(np.min(data_p), np.min(data_q))

max_val = max(np.max(data_p), np.max(data_q))

x = np.linspace(min_val, max_val, 1000)

# Schätze die Wahrscheinlichkeitsdichtefunktionen (WDF) mit KDE

kde_p = gaussian_kde(data_p)

kde_q = gaussian_kde(data_q)

pdf_p = kde_p(x)

pdf_q = kde_q(x)

# Normalisiere die PDF-Werte, um gültige Wahrscheinlichkeiten zu erhalten (diskretisierte Version)

# Und handhabe Nullwerte in pdf_q

epsilon = 1e-10

pdf_p = pdf_p / np.sum(pdf_p)

pdf_q = np.maximum(pdf_q / np.sum(pdf_q), epsilon)

# Berechne die KL-Divergenz der diskretisierten Dichten

return np.sum(rel_entr(pdf_p, pdf_q))

# Referenzdatensatz (normale Bedingungen)

np.random.seed(42)

normal_data = np.random.normal(loc=10, scale=1, size=1000)

# Aktueller Datensatz (normale Bedingungen, sollte geringe Divergenz haben)

current_data_normal = np.random.normal(loc=10.1, scale=1.05, size=1000)

kl_normal = calculate_kl_divergence_kde(normal_data, current_data_normal)

print(f"KL-Divergenz (normal vs. normal): {kl_normal:.4f}")

# Aktueller Datensatz (Anomalie: Mittelwertverschiebung)

anomaly_data_shift = np.random.normal(loc=13, scale=1, size=1000)

kl_anomaly_shift = calculate_kl_divergence_kde(normal_data, anomaly_data_shift)

print(f"KL-Divergenz (normal vs. Anomalie (Shift)): {kl_anomaly_shift:.4f}")

# Aktueller Datensatz (Anomalie: Varianzänderung)

anomaly_data_variance = np.random.normal(loc=10, scale=3, size=1000)

kl_anomaly_variance = calculate_kl_divergence_kde(normal_data, anomaly_data_variance)

print(f"KL-Divergenz (normal vs. Anomalie (Varianz)): {kl_anomaly_variance:.4f}")

# Schwellenwert für Anomalieerkennung (Beispielwert)

threshold = 0.5

print(f"nSchwellenwert für Anomalie: {threshold:.4f}")

print(f"Normalfall: {'Anomalie erkannt' if kl_normal > threshold else 'Normal'}")

print(f"Anomalie (Shift): {'Anomalie erkannt' if kl_anomaly_shift > threshold else 'Normal'}")

print(f"Anomalie (Varianz): {'Anomalie erkannt' if kl_anomaly_variance > threshold else 'Normal'}")

Informationssuche und Textanalyse

Im Bereich der Informationssuche und Textanalyse spielt die KL-Divergenz eine wichtige Rolle bei der Messung der Ähnlichkeit von Dokumenten, Themen oder Begriffen. Sie ermöglicht es, die Verteilung von Begriffen in einem Dokument mit der Verteilung in einer Suchanfrage oder einer anderen Textsammlung zu vergleichen. Dadurch kann die Relevanz von Dokumenten für eine bestimmte Anfrage oder die Ähnlichkeit von Textkorpora bewertet werden.

- Relevanzranking: Bei Suchmaschinen kann die KL-Divergenz verwendet werden, um zu beurteilen, wie relevant ein Dokument für eine Suchanfrage ist, indem die Begriffswahrscheinlichkeitsverteilung der Anfrage mit der des Dokuments verglichen wird.

- Themenmodellierung: In Methoden wie Latent Dirichlet Allocation (LDA) werden Themen als Wahrscheinlichkeitsverteilungen über Wörter dargestellt. Die KL-Divergenz kann verwendet werden, um die Ähnlichkeit zwischen diesen Themenverteilungen zu messen oder um die Divergenz zwischen der Wortverteilung eines Dokuments und einem bestimmten Thema zu berechnen.

- Dokumentenklassifikation und -clustering: Dokumente, die ähnliche Wortverteilungen aufweisen, haben eine geringere KL-Divergenz zueinander und können entsprechend gruppiert oder klassifiziert werden. Dies hilft, empirische Verteilungen vergleichen zu können und Erkenntnisse aus unstrukturierten Daten zu gewinnen. Der Einsatz in der Informationssuche wird so optimiert.

Ein grundlegendes Python-Beispiel zur Textähnlichkeit mit KL-Divergenz:

import numpy as np

from scipy.special import rel_entr

from collections import Counter

def create_term_distribution(text_tokens, vocabulary):

"""

Erstellt eine Wahrscheinlichkeitsverteilung von Begriffen aus einer Liste von Token.

Args:

text_tokens (list): Eine Liste von Token (Wörtern) aus einem Text.

vocabulary (list): Eine Liste aller bekannten Begriffe im Korpus.

Returns:

np.array: Wahrscheinlichkeitsverteilung der Begriffe.

"""

term_counts = Counter(text_tokens)

distribution = np.zeros(len(vocabulary))

total_tokens = len(text_tokens)

for i, term in enumerate(vocabulary):

if total_tokens > 0:

distribution[i] = term_counts[term] / total_tokens

return distribution

def calculate_text_kl_divergence(text_tokens_p, text_tokens_q, vocabulary):

"""

Berechnet die KL-Divergenz zwischen zwei Texten basierend auf ihren Begriffswahrscheinlichkeiten.

Args:

text_tokens_p (list): Token des ersten Textes (Referenz).

text_tokens_q (list): Token des zweiten Textes (zu vergleichen).

vocabulary (list): Gemeinsames Vokabular.

Returns:

float: KL-Divergenz D(P||Q).

"""

dist_p = create_term_distribution(text_tokens_p, vocabulary)

dist_q = create_term_distribution(text_tokens_q, vocabulary)

# Addiere einen kleinen Epsilon-Wert, um Log(0) zu vermeiden

epsilon = 1e-10

dist_p = np.maximum(dist_p, epsilon)

dist_q = np.maximum(dist_q, epsilon)

return np.sum(rel_entr(dist_p, dist_q))

# Beispiel-Vokabular

vocabulary = ['daten', 'analyse', 'maschine', 'lernen', 'software', 'entwickler', 'ki', 'algorithmus']

# Text A (Referenz)

text_a_tokens = ['daten', 'analyse', 'lernen', 'maschine', 'lernen', 'algorithmus']

# Text B (Ähnlich zu A)

text_b_tokens = ['daten', 'analyse', 'lernen', 'algorithmus', 'software']

# Text C (Weniger ähnlich zu A)

text_c_tokens = ['ki', 'entwickler', 'software', 'maschine']

# Berechnung der KL-Divergenz

kl_ab = calculate_text_kl_divergence(text_a_tokens, text_b_tokens, vocabulary)

kl_ac = calculate_text_kl_divergence(text_a_tokens, text_c_tokens, vocabulary)

print(f"KL-Divergenz D(Text A||Text B): {kl_ab:.4f} (Texte sind relativ ähnlich)")

print(f"KL-Divergenz D(Text A||Text C): {kl_ac:.4f} (Texte sind weniger ähnlich)")

# Der niedrigere Wert zeigt eine höhere Ähnlichkeit an.

Die unverzichtbare Rolle der KL-Divergenz in modernen Datenprojekten

Die Kullback-Leibler-Divergenz ist weit mehr als nur eine abstrakte mathematische Formel. Sie ist ein fundamentales, vielseitiges und unverzichtbares Werkzeug für jeden, der mit Daten arbeitet und deren verborgene Muster entschlüsseln möchte. Ihre Anwendung reicht von der robusten statistischen Analyse von Daten und der präzisen Modellbewertung im maschinellen Lernen bis hin zur sensiblen Anomalieerkennung und der effektiven Informationssuche. Das Verständnis, wie man Wahrscheinlichkeitsverteilungen vergleichen und die „Informationskosten“ einer Annäherung quantifiziert, ist entscheidend, um fundierte Entscheidungen zu treffen und innovative Lösungen in komplexen Datenumgebungen zu entwickeln.

Für Entwickler, Datenwissenschaftler und Technologieenthusiasten bietet die Beherrschung der KL-Divergenz eine tiefere Einsicht in die Struktur und Dynamik von Daten. Sie ermöglicht es, Algorithmen zu optimieren, Modellfehler zu diagnostizieren und neue Wege zur Extraktion von Wissen aus großen Datensätzen zu finden. Erkunden Sie die vorgestellten Konzepte und Codebeispiele in Ihren eigenen Projekten. Experimentieren Sie mit verschiedenen Datenverteilungen und Anwendungsfällen, um Ihr Verständnis weiter zu vertiefen. Die Welt der Data Science ist riesig und voller Möglichkeiten; die Kullback-Leibler-Divergenz ist dabei ein Kompass, der Ihnen hilft, sich darin zu orientieren und wertvolle Erkenntnisse zu gewinnen.

Interessanter Überblick zum Thema KL-Divergenz. Ich frage mich jedoch, ob der Anspruch, sie sei ein „unentbehrlicher Eckpfeiler“ und „fundamentales Konzept“, nicht etwas zu absolut ist. Es gibt ja auch andere leistungsstarke Ähnlichkeitsmaße wie die Jensen-Shannon-Divergenz oder die Wasserstein-Distanz, die in bestimmten Anwendungsfällen ihre Berechtigung haben oder sogar bevorzugt werden. Wäre es nicht hilfreich, wenn der Artikel diese Abgrenzung klarer darlegen und vielleicht mit konkreten Beispielen oder Daten untermauern würde, wann die KL-Divergenz *die* optimale Wahl ist und wann andere Metriken vorzuziehen wären?

Vielen dank für ihren durchdachten kommentar. es ist absolut richtig, dass die wahl des geeigneten ähnlichkeitsmaßes stark vom spezifischen anwendungsfall abhängt und es eine vielzahl leistungsstarker alternativen zur kl-divergenz gibt, wie sie zu recht anmerken. die bezeichnung als „unentbehrlicher eckpfeiler“ zielte eher darauf ab, ihre fundamentale bedeutung in vielen theoretischen und praktischen bereichen hervorzuheben, insbesondere dort, wo es um informationsgewinn oder die relative entropie geht.

ihr vorschlag, die abgrenzung zu anderen metriken wie der jensen-shannon-divergenz oder der wasserstein-distanz klarer darzulegen und dies mit konkreten beispielen zu untermauern, ist sehr wertvoll. dies würde den artikel zweifellos bereichern und den lesern eine noch präzisere orientierungshilfe bieten, wann die kl-divergenz *die* optimale wahl ist und wann andere metriken ihre stärken ausspielen können. ich werde dies für zukünftige überarbeitungen oder folgeartikel berücksichtigen. ich danke ihnen nochmals für ihren wertvollen beitrag und l

Ach, KL-Divergenz. Ja, ja. Als ob das eine bahnbrechende „neue“ Idee wäre, die „unentbehrlich“ für die „moderne“ Datenanalyse ist. Die „Geschichte“ fängt *selbst* in den frühen 50ern an – das ist über 70 Jahre her! Ich bin mir ziemlich sicher, dass die Statistiker damals auch schon wussten, wie man die „Unähnlichkeit“ zwischen Verteilungen misst. Nichts Neues unter der Sonne, nur alter Wein in neuen Schläuchen, wie immer. Gähn.

Ich danke ihnen für ihren wertvollen kommentar.