Die Begriffe „neural“ und „neuronal“ werden in der Welt der Technologie und Wissenschaft oft synonym verwendet, was zu Missverständnissen führen kann. Doch für Entwickler, Studenten und Technologiebegeisterte, die tiefer in die Materie eintauchen möchten, ist das Verständnis des Unterschieds zwischen neural und neuronal von entscheidender Bedeutung. Während „neural“ sich primär auf die faszinierende Welt der künstlichen Intelligenz und künstliche neuronale Netzwerke Erklärung bezieht, beschreibt „neuronal“ die komplexen biologischen Strukturen unseres eigenen Nervensystems. Das Erkennen dieser Definition von neuronalen Netzen in KI und den grundlegenden biologischen Neuronen Funktionen ist nicht nur akademisch interessant, sondern grundlegend für die Entwicklung fortschrittlicher Systeme und die Erforschung des menschlichen Gehirns.

Dieser umfassende Blogbeitrag beleuchtet die genaue Bedeutung jedes Begriffs, analysiert ihre etymologischen Ursprünge und fachspezifischen Anwendungen. Wir werden die Strukturen und Funktionsweisen beider Konzepte im Detail gegenüberstellen, ihre überraschenden Gemeinsamkeiten aufzeigen und die vielfältigen Anwendungsfelder von der Spracherkennung neuronale Netze bis zur neurologische Krankheiten Forschung beleuchten. Zudem werden wir durch technische Erläuterungen und illustrative Codebeispiele die Konzepte greifbar machen, um ein tiefgehendes Verständnis für die Schnittstelle von Informationstechnologie und Biologie zu vermitteln.

Grundlegende Konzepte: Neural in der KI und Neuronal in der Biologie

Die rapide Entwicklung der künstlichen Intelligenz, insbesondere im Bereich des maschinellen Lernens und des Deep Learnings, hat eine Terminologie hervorgebracht, die oft aus der Biologie entlehnt ist. Dies führt zu einer gewissen Ambiguität, wenn Begriffe wie „neural“ und „neuronal“ verwendet werden. Es ist essenziell, die spezifischen Bedeutungen in ihren jeweiligen Kontexten zu verstehen, um Missverständnisse zu vermeiden und präzise über komplexe Systeme zu kommunizieren.

Was bedeutet Neural in der Künstlichen Intelligenz?

Im Kontext der künstlichen Intelligenz (KI) bezieht sich „neural“ auf künstliche neuronale Netzwerke (KNNs), eine Klasse von mathematischen Modellen und Algorithmen, die lose vom Aufbau und der Funktion des menschlichen Gehirns inspiriert sind. Diese Netzwerke sind darauf ausgelegt, komplexe Muster in Daten zu erkennen und zu lernen, ohne explizit programmiert werden zu müssen. Die Definition von neuronalen Netzen in KI umfasst die Vorstellung von „Künstlichen Neuronen“ oder „Perzeptronen“, die als grundlegende Verarbeitungseinheiten dienen. Jedes künstliche Neuron empfängt Eingaben, wendet Gewichte und eine Aktivierungsfunktion an und gibt ein Signal an die nächsten Neuronen weiter.

Der angelsächsische Ursprung des Begriffs „neural“ hat sich mit der Entwicklung des Deep Learning, einem spezialisierten Bereich des Maschinelles Lernen und neuronale Netze, fest etabliert. Hierbei werden Netzwerke mit vielen Schichten (sogenannte tiefe Netzwerke) trainiert, um hierarchische Merkmale aus Daten zu extrahieren. Diese Deep Learning Grundlagen ermöglichen bahnbrechende Anwendungen neuraler Netze in Bereichen wie der Bilderkennung, wo sie Objekte und Gesichter identifizieren können, oder der Spracherkennung neuronale Netze, die in virtuellen Assistenten wie Siri oder Alexa zum Einsatz kommen.

Ein einfaches Beispiel für ein künstliches Neuron, das oft als Perzeptron bezeichnet wird, kann die gewichtete Summe seiner Eingaben berechnen und diese durch eine Aktivierungsfunktion leiten. Hier ein rudimentäres Python-Beispiel:

import numpy as np

class Perceptron:

def __init__(self, num_inputs, learning_rate=0.01):

# Initialisierung der Gewichte (weights) und des Bias zufällig

self.weights = np.random.rand(num_inputs) 0.1

self.bias = np.random.rand(1) 0.1

self.learning_rate = learning_rate

def activate(self, x):

# Eine einfache Stufenfunktion als Aktivierungsfunktion

return 1 if x >= 0 else 0

def predict(self, inputs):

# Berechne die gewichtete Summe der Eingaben und addiere den Bias

weighted_sum = np.dot(inputs, self.weights) + self.bias

# Wende die Aktivierungsfunktion an

return self.activate(weighted_sum)

def train(self, training_inputs, labels, epochs):

for _ in range(epochs):

for inputs, label in zip(training_inputs, labels):

prediction = self.predict(inputs)

# Aktualisiere Gewichte und Bias basierend auf dem Fehler (Fehlerrückführung)

error = label - prediction

self.weights += self.learning_rate error inputs

self.bias += self.learning_rate error

# Beispielanwendung

# XOR-Problem (einfach, aber nicht linear trennbar für ein einzelnes Perzeptron)

# Hier nur zur Demonstration der Struktur

training_inputs = np.array([[0,0], [0,1], [1,0], [1,1]])

labels = np.array([0, 0, 0, 1]) # Einfache UND-Logik

perceptron = Perceptron(num_inputs=2)

perceptron.train(training_inputs, labels, epochs=100)

print("Test Perceptron (AND-Logik):")

print(f"0 AND 0: {perceptron.predict(np.array([0,0]))}")

print(f"0 AND 1: {perceptron.predict(np.array([0,1]))}")

print(f"1 AND 0: {perceptron.predict(np.array([1,0]))}")

print(f"1 AND 1: {perceptron.predict(np.array([1,1]))}")Dieses künstliche neuronale Netzwerke Erklärung Beispiel zeigt, wie Gewichte und ein Bias angepasst werden, um die Genauigkeit der Vorhersage zu verbessern, ein Kernprinzip des Lernens in neuronalen Netzen. Diese Fähigkeit, aus großen Datenmengen zu lernen, macht neuronale Netze zu mächtigen Werkzeugen für die Maschinelle Übersetzung KI, bei der sie komplexe Sprachmuster erfassen und übersetzen können, sowie für prädiktive Systeme Technologie in der Finanzbranche oder Gesundheitswesen.

Was bedeutet Neuronal in der Biologie?

Der Begriff „neuronal“ ist untrennbar mit der Biologie, insbesondere der Neurowissenschaft, verbunden. Er bezieht sich auf alles, was mit biologischen Neuronen zu tun hat – den hochspezialisierten Zellen, die das Fundament des Nervensystems bilden, einschließlich des Gehirns und des Rückenmarks. Diese Zellen sind die fundamentalen Einheiten für die Verarbeitung und Übertragung von Informationen im gesamten Organismus.

Die biologische Neuronen Funktion ist die Kommunikation durch elektrische und chemische Signale. Neuronen besitzen spezifische Strukturen: Dendriten empfangen Signale von anderen Neuronen, das Soma (Zellkörper) integriert diese Signale, und das Axon leitet sie als elektrische Impulse, sogenannte Aktionspotenziale, weiter. An den Axonenden befinden sich Synapsen, über die chemische Botenstoffe (Neurotransmitter) freigesetzt werden, um Signale an nachfolgende Neuronen zu übertragen. Diese komplexen zelluläre Mechanismen Gehirn ermöglichen alle kognitiven Funktionen, von Gedächtnis und Wahrnehmung bis hin zu Entscheidungsfindung und motorischer Steuerung. Zum Beispiel ist die Fähigkeit, ein Objekt zu erkennen oder eine Sprache zu verstehen, das Ergebnis eines koordinierten Zusammenspiels unzähliger neuronaler Schaltkreise.

In der Medizin wird der Begriff „neuronal“ intensiv in der neurologische Krankheiten Forschung verwendet, um Erkrankungen wie Alzheimer, Parkinson, Multiple Sklerose oder Epilepsie zu untersuchen. Hierbei liegt der Fokus auf der Analyse der Zellfunktionen, der Pathologie der Neuronen und der Entwicklung von Therapien, die auf die Wiederherstellung oder den Schutz der neuronalen Aktivität abzielen. Die Erforschung von Verbindungen im Gehirn simulieren ist hier nicht nur ein theoretisches Konzept, sondern eine direkte Notwendigkeit, um die Ursachen und Wirkmechanismen dieser Krankheiten zu verstehen.

„Das Gehirn ist das komplexeste bekannte Objekt im Universum, und seine Neuronen sind die Bausteine, die es uns ermöglichen, zu denken, zu fühlen und zu lernen.“

Die feinen Unterschiede und Gemeinsamkeiten von Neural und Neuronal

Obwohl beide Begriffe eine Verbindung zum Konzept der „Nervenzellen“ oder „Netzwerke“ suggerieren, sind ihre spezifischen Bedeutungen und Anwendungsbereiche klar voneinander abgrenzbar. Das Verständnis dieser Unterscheidungen ist entscheidend für jeden, der sich professionell oder aus Interesse mit Technologie und Biologie beschäftigt.

Etymologischer Ursprung und Fachbereiche

Der Unterschied zwischen neural und neuronal beginnt bereits bei ihrem etymologischen Ursprung und ihrer primären Verankerung in verschiedenen wissenschaftlichen Disziplinen. „Neural“ hat sich primär im angelsächsischen Sprachraum im Kontext der Informatik und der künstliche neuronale Netzwerke Erklärung etabliert. Es leitet sich vom englischen „neural“ ab, was sich auf Nerven oder das Nervensystem bezieht, aber in der KI-Welt spezifisch für die Modellierung verwendet wird. „Neuronal“ hingegen hat seine Wurzeln im Französischen („neuronal“) und ist tief in den biologischen und medizinischen Wissenschaften verankert. Es bezieht sich direkt auf Neuronen als lebendige Zellen.

Der Hauptunterschied liegt also nicht nur in der Sprache, sondern auch im Anwendungsbereich. Während „neural“ die abstrakte, algorithmische Nachbildung von Hirnfunktionen beschreibt, konzentriert sich „neuronal“ auf die konkreten, biologischen Zellen und ihre physiologischen Prozesse. Ein Unterschied neural neuronal ist daher nicht nur eine Frage der Semantik, sondern der zugrundeliegenden Materie: Software vs. Biologie.

Struktur, Flexibilität und Funktionsweise im Vergleich

Um die Differenzierung zu verdeutlichen, betrachten wir die Kernmerkmale beider Konzepte in einer vergleichenden Tabelle, die über die einfache Auflistung des Referenzinhalts hinausgeht und technische Aspekte vertieft:

| Aspekt | Neural (Künstliche Intelligenz) | Neuronal (Biologie) |

|---|---|---|

| Bereich | Künstliche Intelligenz, Informatik, Maschinenlernen, Deep Learning | Biologie, Neurowissenschaft, Medizin, Physiologie |

| Struktur | Mathematische Modelle, Algorithmen, Schichten von Rechenknoten (Künstliche Neuronen) | Lebendige Zellen, komplexer Aufbau (Soma, Dendriten, Axon, Synapsen) |

| Grundlage | Software-Implementierung, gewichtete Verbindungen, Aktivierungsfunktionen | Biochemische und elektrophysiologische Prozesse, Neurotransmitter |

| Flexibilität | Programmierbar, skalierbar, kann für spezifische Aufgaben optimiert werden (Trainingsdaten) | Organisch, evolutionär entstanden, Anpassung durch Neuroplastizität (Lernen und Erfahrungen) |

| Funktion | Mustererkennung, Klassifikation, Regression, Vorhersage, Generierung; Lernfähigkeit durch Datenanpassung | Informationsübertragung, Signalverarbeitung, Steuerung von Körperfunktionen, Basis für Kognition |

| Lernen | Algorithmen wie Backpropagation zur Anpassung von Gewichten und Biases | Synaptische Plastizität (Verstärkung/Schwächung von Verbindungen), Langzeitpotenzierung |

| Beispiel | Convolutional Neural Networks (CNNs) für Bilderkennung | Pyramidenzellen im Hippocampus für Gedächtnisbildung |

Die Struktur eines künstlichen neuronalen Netzes ist durch seine Schichten definiert. Ein typisches Netz hat eine Eingabeschicht, mehrere verborgene Schichten und eine Ausgabeschicht. Jede Verbindung zwischen künstlichen Neuronen hat ein Gewicht, das während des Trainings angepasst wird. Die Fehlerrückführung in neuronalen Netzen (Backpropagation) ist ein Schlüsselalgorithmus, der den Fehler des Netzes misst und diesen rückwärts durch das Netz propagiert, um die Gewichte iterativ zu optimieren. Dies steht im Gegensatz zur organischen Struktur biologischer Neuronen, deren Verbindungen – die Synapsen – durch biochemische Prozesse wie Langzeitpotenzierung oder Langzeitdepression gestärkt oder geschwächt werden können, was die Grundlage für Lernen und Gedächtnis bildet.

Betrachten wir ein stark vereinfachtes Python-Beispiel, das die Konzeption einer Schicht in einem künstliche neuronale Netzwerke Erklärung veranschaulicht:

import numpy as np

# Eine einfache Schicht in einem neuronalen Netzwerk

class Layer:

def __init__(self, num_inputs, num_neurons):

# Gewichte (weights) für jede Verbindung von Eingabe zu Neuron

# Dimension: (Anzahl der Eingaben, Anzahl der Neuronen in dieser Schicht)

self.weights = np.random.rand(num_inputs, num_neurons) 0.1

# Bias für jedes Neuron in dieser Schicht

self.biases = np.random.rand(num_neurons) 0.1

def forward(self, inputs):

# Berechne die gewichtete Summe der Eingaben plus Bias

# inputs: (Anzahl der Samples, Anzahl der Eingaben)

# output: (Anzahl der Samples, Anzahl der Neuronen)

output = np.dot(inputs, self.weights) + self.biases

# Hier würde normalerweise eine Aktivierungsfunktion folgen (z.B. ReLU, Sigmoid)

return output

# Beispiel: Eine Eingabeschicht mit 3 Merkmalen, die an 2 Neuronen in der nächsten Schicht gesendet wird

input_features = np.array([[1.0, 2.0, 3.0], [4.0, 5.0, 6.0]]) # Zwei Samples, je 3 Features

# Erstelle eine Schicht mit 3 Eingaben und 2 Neuronen

first_layer = Layer(num_inputs=3, num_neurons=2)

layer_output = first_layer.forward(input_features)

print("Eingaben:n", input_features)

print("Gewichte der ersten Schicht:n", first_layer.weights)

print("Biases der ersten Schicht:n", first_layer.biases)

print("Ausgabe der ersten Schicht (vor Aktivierungsfunktion):n", layer_output)

# Ausgabebeispiel:

# [[(1w11 + 2w21 + 3w31) + b1, (1w12 + 2w22 + 3w32) + b2],

# [(4w11 + 5w21 + 6w31) + b1, (4w12 + 5w22 + 6w32) + b2]]Dieses Beispiel demonstriert die mechanistischen, programmierbaren Aspekte von „neuralen“ Systemen im Gegensatz zur komplexen, organischen Natur von „neuronalen“ Systemen.

Gemeinsamkeiten und Anwendungsfelder: Neural und Neuronal

Trotz ihrer fundamentalen Unterschiede in Ursprung und Materie, konvergieren „neural“ und „neuronal“ in einem entscheidenden Aspekt: der Erforschung und Modellierung von Intelligenz und Kognition. Diese Schnittstelle ist der Schlüssel zu zukünftigen Innovationen in beiden Feldern.

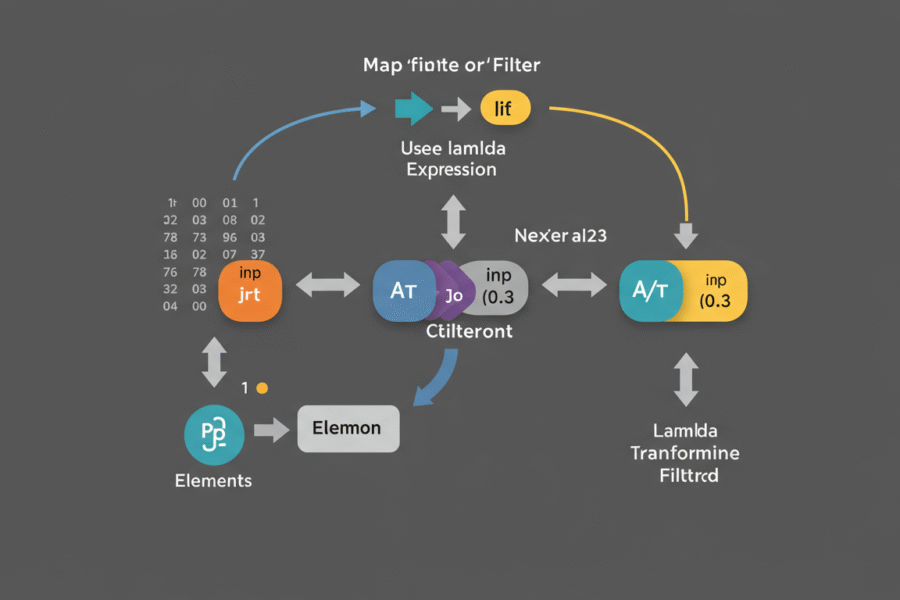

Inspiration und Konvergenz: Wie KI vom Gehirn lernt

Die größte Gemeinsamkeit zwischen neuralen Netzwerken und biologischen neuronalen Strukturen liegt in der gegenseitigen Inspiration. Künstliche neuronale Netzwerke sind explizit vom menschlichen Gehirn inspiriert, insbesondere von dessen Fähigkeit zu lernen und komplexe Informationen zu verarbeiten. Die künstliche neuronale Netzwerke Erklärung umfasst oft die Analogie von Verbindungen im Gehirn simulieren, um Mustererkennung und Entscheidungsfindung zu ermöglichen.

Künstliche neuronale Netzwerke, insbesondere tiefe Netzwerke, umfassen mehrere Verarbeitungsschichten (Eingabe, verdeckt, Ausgabe), die eine hierarchische Merkmalsextraktion ermöglichen. Dies spiegelt, wenn auch auf abstrakter Ebene, die hierarchische Verarbeitung in biologischen Gehirnen wider, wo verschiedene kortikale Areale auf unterschiedlichen Abstraktionsebenen Informationen verarbeiten. Das dynamisches Lernen in KNNs, oft durch Algorithmen wie Backpropagation und Gradientenabstieg realisiert, passt die Gewichte und Biases kontinuierlich an, um die Genauigkeit zu verbessern. Dies ähnelt der synaptischen Plastizität in biologischen Systemen, bei der sich die Stärke neuronaler Verbindungen basierend auf Erfahrungen und Lernprozessen verändert.

Ein konzeptionelles Beispiel für die Fehlerrückführung in neuronalen Netzen (Backpropagation) zeigt, wie sich Gewichte anpassen, um den Fehler zu minimieren:

# Konzeptionelles Backpropagation-Beispiel (Pseudocode-artig)

# Annahme: Ein einfaches Netzwerk mit einer Eingabe, einem verborgenen Neuron, einer Ausgabe

# und einem bekannten Fehler (difference between expected and actual output)

# 1. Forward-Pass: Berechne die Ausgabe

# input_data = [x1]

# hidden_output = sigmoid(x1 weight_input_hidden + bias_hidden)

# final_output = sigmoid(hidden_output weight_hidden_output + bias_output)

# 2. Fehlerberechnung

# error = target_output - final_output

# 3. Backward-Pass (Fehlerrückführung):

# Berechne den Gradienten des Fehlers in Bezug auf die Ausgabeschicht-Gewichte

# d_error_d_weight_hidden_output = error derivative_sigmoid(final_output) hidden_output

# Aktualisiere die Gewichte der Ausgabeschicht

# weight_hidden_output += learning_rate d_error_d_weight_hidden_output

# Berechne den Gradienten des Fehlers in Bezug auf die verborgene Schicht-Gewichte

# d_error_d_hidden_output = error derivative_sigmoid(final_output) weight_hidden_output

# d_error_d_weight_input_hidden = d_error_d_hidden_output derivative_sigmoid(hidden_output) input_data[0]

# Aktualisiere die Gewichte der verborgenen Schicht

# weight_input_hidden += learning_rate d_error_d_weight_input_hidden

# Und so weiter für Biases...

# Dies ist eine vereinfachte Darstellung, die realen Algorithmen sind komplexer.

# Die Idee ist, dass der Fehler "rückwärts" durch das Netzwerk geleitet wird,

# um die Verantwortlichkeiten der einzelnen Gewichte am Fehler zu ermitteln.Diese Algorithmen erlauben es KI-Modellen, komplexe kognitive Prozesse in KI wie Mustererkennung oder Sprachverständnis nachzubilden und zu optimieren.

Praktische Anwendungen in Technologie und Medizin

Die Anwendungen von „neural“ und „neuronal“ erstrecken sich über weitreichende Bereiche:

Aufkommende Technologien (Neural)

- Spracherkennung neuronale Netze: Systeme, die menschliche Sprache in Text umwandeln oder Befehle verarbeiten, wie sie in Smartphones oder intelligenten Lautsprechern zu finden sind.

- Verarbeitung natürlicher Sprache (NLP): Anwendungen wie Chatbots, Sentiment-Analyse und Maschinelle Übersetzung KI, die die Bedeutung von Texten verstehen und generieren können.

- Computer Vision: Bild- und Videoerkennung für autonome Fahrzeuge, medizinische Diagnostik oder Sicherheitsüberwachung.

- Prädiktive Systeme Technologie: Vorhersagemodelle in der Finanzwelt zur Aktienkursentwicklung, in der Logistik zur Routenoptimierung oder in der prädiktiven Wartung von Maschinen.

Ein vereinfachtes Python-Beispiel für eine grundlegende Textklassifikation, die das Potenzial neuraler Netze im NLP zeigt:

from sklearn.feature_extraction.text import TfidfVectorizer

from sklearn.neural_network import MLPClassifier

from sklearn.pipeline import make_pipeline

from sklearn.metrics import accuracy_score

# Beispiel-Datensatz

texts = ["Das ist ein positives Feedback.",

"Ich bin sehr zufrieden mit dem Produkt.",

"Das Produkt ist schlecht und enttäuschend.",

"Absolut furchtbar, würde es nicht empfehlen.",

"Das gefällt mir sehr gut.",

"Schrecklich, ich bin wütend."]

labels = [1, 1, 0, 0, 1, 0] # 1 für positiv, 0 für negativ

# Erstelle eine Pipeline: Textmerkmale extrahieren und dann ein neuronales Netz anwenden

# TfidfVectorizer: wandelt Text in numerische Merkmale um

# MLPClassifier: ein einfaches Multi-Layer Perceptron (neuronales Netz)

model = make_pipeline(TfidfVectorizer(), MLPClassifier(hidden_layer_sizes=(10,), max_iter=1000, random_state=42))

# Trainiere das Modell

model.fit(texts, labels)

# Testen des Modells

new_texts = ["Ich liebe dieses Produkt!", "Das ist gar nicht gut.", "Neutraler Text."]

predictions = model.predict(new_texts)

print("Vorhersagen für neue Texte:")

for text, pred in zip(new_texts, predictions):

sentiment = "positiv" if pred == 1 else "negativ"

print(f"Text: '{text}' -> Sentiment: {sentiment}")

# Berechnung der Trainingsgenauigkeit (für Demonstrationszwecke)

train_predictions = model.predict(texts)

print(f"nGenauigkeit auf Trainingsdaten: {accuracy_score(labels, train_predictions):.2f}")Dieses Codebeispiel veranschaulicht, wie künstliche neuronale Netzwerke Erklärung angewendet werden können, um aus textuellen Daten zu lernen und Sentiment-Analysen durchzuführen.

Medizinische Forschungen (Neuronal)

- Neurologische Krankheiten Forschung: Vertieftes Verständnis und Entwicklung von Therapien für Krankheiten wie Alzheimer (Degeneration von Neuronen), Parkinson (Verlust dopaminerger Neuronen) oder Multiple Sklerose (Demyelinisierung der Axone).

- Zelluläre Mechanismen Gehirn: Untersuchung der genauen Abläufe der neuronalen Kommunikation, Neurotransmitterfreisetzung und synaptischen Plastizität.

- Neuronale Stammzellen: Erforschung ihres Reparaturpotenzials bei Hirnverletzungen oder neurodegenerativen Erkrankungen.

- Brain-Computer Interfaces (BCIs): Direkte Schnittstellen zwischen Gehirn und externen Geräten zur Unterstützung von Menschen mit Lähmungen oder zur Steuerung von Prothesen.

Zukunftsperspektiven und die Konvergenz von KI und Neurowissenschaften

Die fortschreitende Forschung in beiden Bereichen führt zu einer immer stärkeren Konvergenz KI Neurowissenschaften. Die Grenzen zwischen „neural“ und „neuronal“ beginnen zu verschwimmen, da Wissenschaftler und Ingenieure versuchen, die Erkenntnisse über das biologische Gehirn für die Entwicklung intelligenterer KI-Systeme zu nutzen und umgekehrt KI als Werkzeug zum besseren Verständnis des Gehirns einzusetzen.

Diese technologische Konvergenz verspricht die Entwicklung zukünftige KI-Modelle Gehirn, die menschenähnliche kognitive Prozesse noch präziser simulieren können. Konzepte wie neuromorphes Computing, das Hardware und Software nach biologischen Prinzipien gestaltet, sind hier führend. Solche Sophisticated Models könnten den Weg für derzeit noch unvorstellbare Anwendungen in der personalisierten Medizin, der autonomen Robotik oder in hochkomplexen Analysesystemen ebnen. Gleichzeitig ermöglicht die Modellierung und Simulation neuronaler Netze ein tieferes Verständnis des Gehirns, beispielsweise bei der Untersuchung der neuronalen Korrelate von Bewusstsein, Lernen oder Gedächtnis.

Die interdisziplinäre Zusammenarbeit zwischen Neurowissenschaftlern, Informatikern und Ingenieuren ist entscheidend, um die Potenziale dieser Anwendungen neuraler Netze und Anwendungen neuronaler Forschung voll auszuschöpfen. Der Dialog zwischen diesen Feldern wird nicht nur unser Verständnis von Intelligenz vertiefen, sondern auch praktische Lösungen für einige der größten Herausforderungen unserer Zeit liefern.

Fazit: Eine synergetische Beziehung von Intelligenz und Biologie

Zusammenfassend lässt sich festhalten, dass der Unterschied neural neuronal fundamental ist, aber beide Begriffe eine tiefgreifende synergetische Beziehung eingehen. Während „neural“ die mathematisch-algorithmische Welt der künstlichen Intelligenz beschreibt und künstliche neuronale Netzwerke Erklärung liefert, verweist „neuronal“ auf die lebendigen, komplexen biologische Neuronen Funktion im Nervensystem. Diese Unterscheidung ist nicht nur für die präzise Kommunikation wichtig, sondern auch für die Weiterentwicklung beider Fachbereiche.

Die kontinuierliche Annäherung von KI und Neurowissenschaften verspricht bahnbrechende Erkenntnisse und Technologien. Wir ermutigen Sie, sich weiter mit diesen faszinierenden Themen auseinanderzusetzen. Teilen Sie Ihre Gedanken in den Kommentaren oder erkunden Sie unsere anderen Artikel, um Ihr Wissen im Bereich Data Science, KI und Softwareentwicklung zu vertiefen und ein Experte zu werden.

Das ist eine spannende und wichtige Unterscheidung für alle, die tiefer in die Materie eintauchen. Für den Durchschnittsnutzer stellt sich aber oft die Frage nach der praktischen Anwendbarkeit: Wie kompatibel sind diese fortschrittlichen KI-Anwendungen eigentlich mit älterer Hardware oder Software, die viele zu Hause haben? Und ist die Nutzung wirklich so intuitiv, dass sie nicht zu einer weiteren Hürde im digitalen Alltag wird, sondern ihn tatsächlich erleichtert? Es wäre toll, wenn bei der Entwicklung auch immer der Fokus darauf läge, wie man diese Technologien zugänglich und unkompliziert für jedermann gestalten kann, anstatt nur auf High-End-Systeme und Expertenwissen angewiesen zu sein.

Vielen dank für diesen sehr durchdachten beitrag. ihre fragen zur praktischen anwendbarkeit und kompatibilität mit älterer hardware sind absolut berechtigt und zeigen einen wichtigen aspekt auf, den wir in der diskussion um fortschrittliche ki-systeme oft übersehen. es ist tatsächlich entscheidend, dass die entwicklung nicht nur auf leistungsstarke systeme abzielt, sondern auch die breite nutzbarkeit und einfache integration in den digitalen alltag berücksichtigt.

ihr punkt, dass ki-anwendungen den alltag erleichtern und nicht zu einer zusätzlichen hürde werden sollten, ist von großer relevanz. die intuitive bedienbarkeit und die fähigkeit, sich an verschiedene technische umgebungen anzupassen, sind schlüsselfaktoren für eine erfolgreiche adoption. ich stimme ihnen vollkommen zu, dass dieser fokus bei der entwicklung unerlässlich ist, um sicherzustellen, dass diese technologien wirklich für jedermann zugänglich und nützlich sind. vielen dank nochmals für ihre wertvolle perspektive. ich würde mich freuen, wenn sie auch andere artikel in meinem profil oder meine weiteren veröffentlichungen lesen würden.