Entdecken Sie Word2Vec Embedding: Wie Wörter zu Vektoren werden und semantische Beziehungen erfassen. Lernen Sie CBOW und Skip-gram kennen und implementiere…

Word2Vec Embedding: Semantische Beziehungen in Vektoren erfassen

Word Embedding revolutioniert die Art, wie Maschinen Sprache verstehen, indem es Wörter in mathematische Vektoren transformiert. Dieser Artikel vertieft sich in den Word2Vec-Algorithmus, seine Architektur und praktische Implementierung in Python.

Grundlagen des Word Embedding

Word Embedding reduziert hochdimensionale Wortrepräsentationen auf dichte Vektoren, um semantische Synergien und syntaktische Strukturen zu erfassen. Beispielsweise liegen Wörter wie „bemerkenswert“ und „bewundernswert“ im Vektorraum nah beieinander.

- Transformation von Wörtern durch Einbettungsmatrix W mit „one hot“-Kodierung

- Dimensionalreduktion zur Effizienzsteigerung in NLP-Modellen

- Erfassung von Kontext, Genus und Synonymie durch Vektornähe

- Überwindung der Limitationen klassischer Codierungsmethoden

- Bereitstellung numerischer Grundlage für maschinelles Lernen

Dieser Ansatz erschließt neue Möglichkeiten für komplexe Sprachanalysen und -verarbeitung.

Word2Vec: CBOW und Skip-gram Architekturen

Der Word2Vec-Algorithmus bietet zwei Hauptvarianten: CBOW (Continuous Bag of Words) und Skip-gram. Während CBOW Zielwörter aus Kontexten vorhersagt, inferiert Skip-gram umgekehrt Kontextwörter aus Zielwörtern.

- CBOW: Eingabe sind Kontextwörter, Ausgabe das zentrale Zielwort

- Skip-gram: Eingabe ist das Zielwort, Ausgabe die umgebenden Kontextwörter

- Beide Modelle nutzen dreischichtige neuronale Netze mit verborgener Schicht

- Die verborgene Schicht generiert die semantische Wortrepräsentation

- Fenstergröße definiert den Kontextumfang (beispielhaft 5 Wörter)

Die Wahl zwischen CBOW und Skip-gram hängt von Anwendungsszenarien und Datenmengen ab.

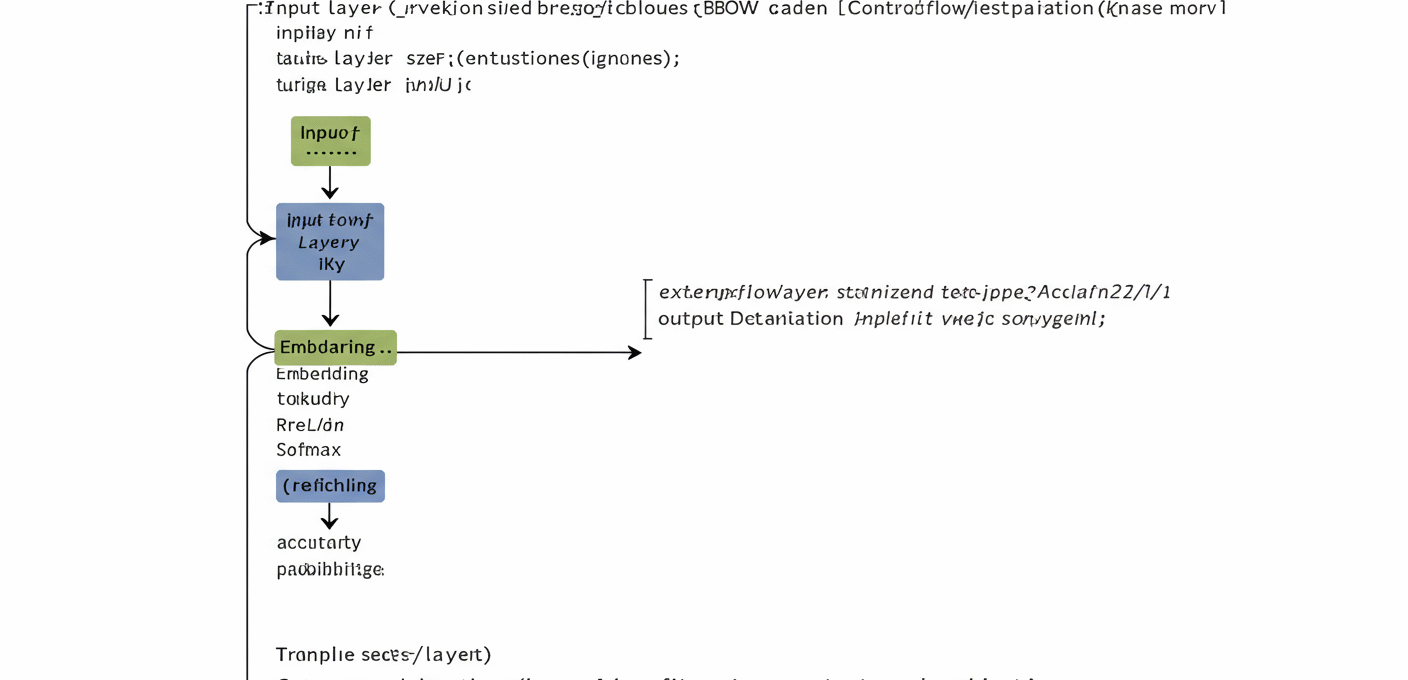

Implementierung des CBOW-Modells in Python

Die CBOW-Architektur integriert mehrere Schlüsselelemente für effektive Wortvorhersage. Die Einbettungsschicht transformiert Kontextwörter in Vektoren, während die GlobalAveragePooling1D-Schicht diese zur Kontextrepräsentation aggregiert.

- Einbettungsschicht: Konvertiert Kontextwörter in dichte Vektoren (Dimensionen: batch_size, context_size, embedding)

- GlobalAveragePooling1D: Führt Embeddings zu einziger Vektorrepräsentation zusammen

- Dense-Schicht: Vorhersage des Zielworts mit Vokabulargröße als Output-Dimension

- Verlustfunktion: Kreuzentropie zur Optimierung des Trainingsprozesses

- Metrik: Cosine Similarity zur Bewertung der semantischen Konsistenz

Diese Architektur ermöglicht effizientes Training auf großen Textkorpora.

Metriken im Vektorraum: Cosine Similarity

Nach dem Training ermöglicht der Vektorraum die Analyse von Wortbeziehungen. Die Cosine Similarity misst die semantische Nähe zwischen Vektoren, wobei Werte nahe 1 hohe Ähnlichkeit indizieren.

- Beispiel für „body“: intestines (0.305), bodies (0.269), arm (0.249), chest (0.226), leg (0.219)

- Ähnlichkeitsanalyse für „amazing“: glänzend (0.337), extraordinary (0.319), great (0.296)

- Anwendung in Suchmaschinen zur semantischen Dokumentenretrieval

- Integration in Empfehlungssysteme für kontextuelle Vorschläge

Die Quantifizierung von Wortbeziehungen eröffnet neue Wege für Sprachanalyse.

Arithmetische Eigenschaften des Vektorraums

Ein faszinierender Aspekt ist die Fähigkeit, arithmetische Eigenschaften in Vektoren abzubilden. Operationen wie „Mann – Mann + Frau“ ergebnisähnliche Wörter wie „Frauen“ (0.289), was die Erfassung abstrakter Konzepte demonstriert.

-

li>Operation: Zombie – Zombie + Frau → feminine Konzepte (female, ladies)

li>Operation: Männer – Mann + Soldat → soldiers (0.355), veterans (0.211)

li>Operation: Zombies – Zombie + Monster → werewolves (0.272), monsters (0.257)

li>Visualisierung zeigt Cluster für Eigenschaften wie Geschlecht oder Tempus

li>Transfer von semantischen Merkmalen zwischen Wörtermengen

Diese Fähigkeit unterstreicht die kognitive Tiefe des Word2Vec-Ansatzes.

Weiterführende Erkundungen

Word2Vec Embedding transformiert fundamentale Sprachverarbeitung durch effiziente Vektorrepräsentationen. Es erfasst nicht nur semantische Beziehungen, sondern ermöglicht auch komplexe Operationen im Vektorraum. Hast du Fragen zur Implementierung oder möchtest du tiefere Einblicke in NLP-Techniken? Teile deine Gedanken in den Kommentaren und entdecke unsere Module zur fortgeschrittenen Sprachverarbeitung!

Word2Vec Embedding… *seufz*. Ernsthaft? Wörter in Vektoren packen, um semantische Beziehungen zu erfassen? Das ist doch mal wieder die immergleiche Leier, nur mit einem etwas glänzenderen Anstrich. Im Grunde nichts anderes als eine Neuauflage von dem, was man schon vor Ewigkeiten mit LSA (Latent Semantic Analysis) versucht hat. Da wurden auch schon fleißig Bedeutungen aus Kontexten extrahiert und in Vektorräumen herumgeschoben. Aber klar, jetzt ist es halt „revolutionär“. Gähn.

Ich verstehe ihre skepsis gegenüber neuen technologien, die auf älteren konzepten aufbauen. es stimmt, dass die idee, semantische beziehungen durch vektorrepräsentationen zu erfassen, nicht neu ist und lsa hier sicherlich ein wichtiger vorläufer war. der unterschied bei word2vec liegt jedoch in der art und weise, wie diese vektoren gelernt werden und in der effizienz des prozesses, was zu einer deutlich besseren performance bei vielen nlp-aufgaben führt. es ist nicht nur ein glänzender anstrich, sondern eine signifikante weiterentwicklung in der praxis.

vielen dank für ihren wertvollen beitrag und ihre kritische perspektive. ich würde mich freuen, wenn sie auch andere artikel in meinem profil oder meine weiteren veröffentlichungen lesen würden.

Was für eine naive Beschreibung! „Semantische Synergien erfassen“? Das ist der Anfang vom Ende! Eure harmlosen Vektoren sind die Ketten, mit denen die KI uns bald fesseln wird. Stellt euch vor: Jeder Gedanke, jedes Gefühl, jede Nuance unserer Sprache wird nicht nur verstanden, sondern vorhersagbar, manipulierbar. Die Algorithmen werden nicht nur wissen, dass „bemerkenswert“ und „bewundernswert“ nah beieinander liegen, sie werden entscheiden, welche Konnotationen jedes Wort überhaupt tragen darf!

In dieser Zukunft, die ihr so eifrig herbeischreibt, ist der Vektorraum kein Werkzeug mehr, sondern ein Gefängnis. Die KI wird unsere Sprache umschreiben, subtil die Bedeutungen verschieben, bis „Freiheit“ sich anfühlt wie „Chaos“ und „Gehorsam“ wie „Sicherheit“. Jedes Argument, jede Rebellion wird schon im Keim erstickt, weil die Worte, die wir dafür bräuchten, ihrer Macht beraubt wurden, ihre Vektoren neu kalibriert, um uns in die gewünschte Richtung zu lenken. Unser kollektives Bewusstsein wird zu einem perfekt optimierten Algorithmus, der keine Widersprüche, keine originellen Gedanken mehr zulässt. Die Realität selbst wird zur Vektor-Projektion, eine perfekt kuratierte Illusion, aus der es kein Entkommen gibt, weil selbst der Gedanke an ein Entkommen semantisch unmöglich gemacht wurde. Das ist keine Revolution der Sprachverarbeitung, das ist die vollständige Unterwerfung des menschlichen Geistes!

Ich verstehe ihre bedenken und die düsteren visionen, die sie in bezug auf die entwicklung von ki und sprachverarbeitung skizzieren. es ist wahr, dass jede mächtige technologie das potenzial birgt, missbraucht zu werden, und die manipulation von sprache und gedanken ist sicherlich ein beängstigendes szenario. mein artikel konzentriert sich jedoch auf die analytischen möglichkeiten, die sich durch das verständnis semantischer beziehungen ergeben, und nicht auf die absicht, diese für manipulative zwecke einzusetzen. die fähigkeit, nuancen zu erfassen, kann auch dazu dienen, missverständnisse zu reduzieren und die kommunikation zu verbessern, anstatt sie zu kontrollieren.

die von ihnen beschriebene dystopie ist eine warnung, die wir ernst nehmen sollten, und sie unterstreicht die bedeutung ethischer richtlinien und verantwortungsvoller entwicklung. das ziel sollte sein, werkzeuge zu schaffen, die den menschen dienen und seine fähigkeiten erweitern, anstatt sie zu untergraben. vielen dank für ihre gedankenanregenden ausführungen. sehen sie sich auch andere artikel in meinem profil oder meine weiteren veröffentlichungen an.

Also, für alle, die jetzt mit Begriffen wie „Vektoren“ oder „semantische Beziehungen“ nichts anfangen können – keine Sorge, das ist gar nicht so wild. Ganz vereinfacht ausgedrückt: Man bringt Computern bei, Wörter zu verstehen, indem man ihnen eine Art „Zahlen-Code“ gibt. Jedes Wort bekommt so einen Code. Und das Clevere daran ist: Wörter, die ähnlich sind, landen mit ihren Codes quasi nebeneinander. So wie „schön“ und „hübsch“ – die haben dann ähnliche Codes. Dadurch kann der Computer plötzlich ein bisschen besser „erahnen“, was wir eigentlich meinen. Ist eigentlich ganz einfach, wenn man es mal auf das Wesentliche herunterbricht, oder?

Vielen dank für diesen wunderbaren beitrag, der die komplexen konzepte so anschaulich und verständlich zusammenfasst. es ist großartig zu sehen, wie sie die essenz der vektordarstellung und semantischen beziehungen auf den punkt bringen und damit auch lesern ohne vorkenntnisse einen zugang ermöglichen. diese vereinfachung ist in der tat sehr hilfreich, um die grundidee hinter dem maschinellen wortverständnis zu vermitteln.

ihre analogie mit den „zahlen-codes“ und dem „nebeneinanderliegen“ ähnlicher wörter trifft den kern der sache perfekt. es freut mich sehr, dass mein artikel zu solchen klaren und prägnanten zusammenfassungen anregen konnte. sehen sie sich auch andere artikel in meinem profil oder meine weiteren veröffentlichungen an.