In der heutigen digitalen Welt, in der Daten das Lebenselixier nahezu jeder Anwendung und jedes Systems sind, spielt das Verständnis und die Implementierung eines Datenkodierungsschemas eine absolut zentrale Rolle. Es ist die unsichtbare Architektur, die es Computern ermöglicht, Informationen zu interpretieren, zu speichern und zu übermitteln. Ohne ein präzises Datenkodierungsschema wären moderne Computer, Internetkommunikation und Multimedia-Technologien undenkbar. Dieses fundamentale Konzept ist entscheidend, um die Effizienz der Datenübertragung zu optimieren, die Integrität von Daten zu gewährleisten und gleichzeitig die Speicherung von Informationen zu maximieren.

Dieser ausführliche Blogbeitrag taucht tief in die Welt der Datenkodierung ein. Wir werden die grundlegenden Konzepte erläutern, die verschiedenen Arten von Kodierungsschemata – von verlustfreien bis hin zu verlustbehafteten Verfahren – detailliert beleuchten und ihre weitreichenden Anwendungen in Branchen wie Telekommunikation, Multimedia, Datenbanken und Cybersicherheit untersuchen. Durch präzise Erklärungen und praxisnahe Codebeispiele werden wir zeigen, wie diese Schemata die Grundlage für eine robuste und performante Datenverarbeitung bilden und welche entscheidende Rolle sie für Entwickler, Studenten und Technologiebegeisterte spielen, die sich mit der Gestaltung zukünftiger digitaler Infrastrukturen befassen.

Grundlagen des Datenkodierungsschemas

Ein Datenkodierungsschema ist im Wesentlichen ein Regelwerk, das festlegt, wie Daten in einem bestimmten Format dargestellt werden, damit Computersysteme sie korrekt interpretieren und verarbeiten können. Sein Hauptziel ist es, die effiziente Speicherung und Übertragung von Daten zu ermöglichen, während gleichzeitig die Integrität und Genauigkeit der Informationen bewahrt wird. Dies ist entscheidend, da Rohdaten, wie wir sie wahrnehmen (Texte, Bilder, Töne), für Maschinen in ihrer ursprünglichen Form nicht direkt nutzbar sind. Sie müssen in eine maschinenlesbare Form umgewandelt werden, meist in binäre Darstellungen, die aus Nullen und Einsen bestehen.

Es ist wichtig, das Datenkodierungsschema klar von der Datenkompression abzugrenzen, obwohl sie oft Hand in Hand gehen und manchmal verwechselt werden. Kodierung wandelt Informationen in ein neues Format um, zum Beispiel von einer Dezimalzahl in ihre binäre Entsprechung. Kompression hingegen zielt darauf ab, das Volumen der Daten zu reduzieren, indem Redundanzen eliminiert werden, um Speicherplatz zu sparen oder die Bandbreitennutzung zu minimieren. Ein effizientes Kodierungsschema kann auch die Datensicherheit durch Verschlüsselung verbessern, indem es Informationen in ein unlesbares Format umwandelt, das nur mit dem richtigen Schlüssel entschlüsselt werden kann.

Die Rolle der Datenstrukturierung für die Interpretation

Die Strukturierung von Daten durch ein Kodierungsschema ist der Schlüssel zur Interoperabilität und zum korrekten Verständnis durch verschiedene Softwaresysteme. Es standardisiert, wie Informationen organisiert und formatiert werden, von der einfachsten Textdatei bis zu komplexen Datenbankeinträgen. Diese Standardisierung sorgt dafür, dass Daten konsistent gelesen, geschrieben und ausgetauscht werden können, unabhängig von der zugrundeliegenden Hardware oder Software. Ohne eine definierte Struktur wäre die Kommunikation zwischen Systemen chaotisch und fehleranfällig.

Betrachten wir beispielsweise die einfache Darstellung eines Zahlenwerts. Ein Mensch versteht „123“ sofort als die Zahl einhundertdreiundzwanzig. Für einen Computer muss diese Zahl jedoch nach einem spezifischen Schema kodiert werden, um sie zu speichern und Berechnungen damit durchzuführen. Dies kann eine direkte binäre Umwandlung sein oder komplexere Schemata wie BCD, die für bestimmte Anwendungen Vorteile bieten.

Hier ist ein einfaches Python-Beispiel, das die binäre Kodierung einer Ganzzahl und eines Zeichens zeigt:

# Beispiel: Binäre Kodierung einer Ganzzahl

dezimalzahl = 42

binärdarstellung = bin(dezimalzahl)

print(f"Die Dezimalzahl {dezimalzahl} in Binär: {binärdarstellung}")

# Beispiel: Binäre Kodierung eines Zeichens (ASCII/UTF-8)

zeichen = 'A'

bytes_darstellung = zeichen.encode('utf-8')

print(f"Das Zeichen '{zeichen}' (UTF-8) in Bytes: {bytes_darstellung}")

for byte_val in bytes_darstellung:

print(f" Binär (Byte): {bin(byte_val)}")

# Eine einfache Textkodierung nach UTF-8

text = "Hallo Welt!"

# Kodieren des Textes in Bytes unter Verwendung von UTF-8

kodierte_bytes = text.encode('utf-8')

print(f"Originaltext: '{text}'")

print(f"Kodierte Bytes (UTF-8): {kodierte_bytes}")

# Dekodieren der Bytes zurück in Text

dekodierter_text = kodierte_bytes.decode('utf-8')

print(f"Dekodierter Text: '{dekodierter_text}'")Dieses Beispiel demonstriert, wie eine Dezimalzahl in ihre binäre Form umgewandelt wird und wie ein Textzeichen in seine Byte-Darstellung gemäß dem UTF-8-Kodierungsschema übersetzt wird. Diese grundlegende Umwandlung ist der erste Schritt, um Daten für die maschinelle Verarbeitung zugänglich zu machen und die Datenintegrität bei der Übertragung sicherzustellen.

Verlustfreie und Verlustbehaftete Kodierungsverfahren

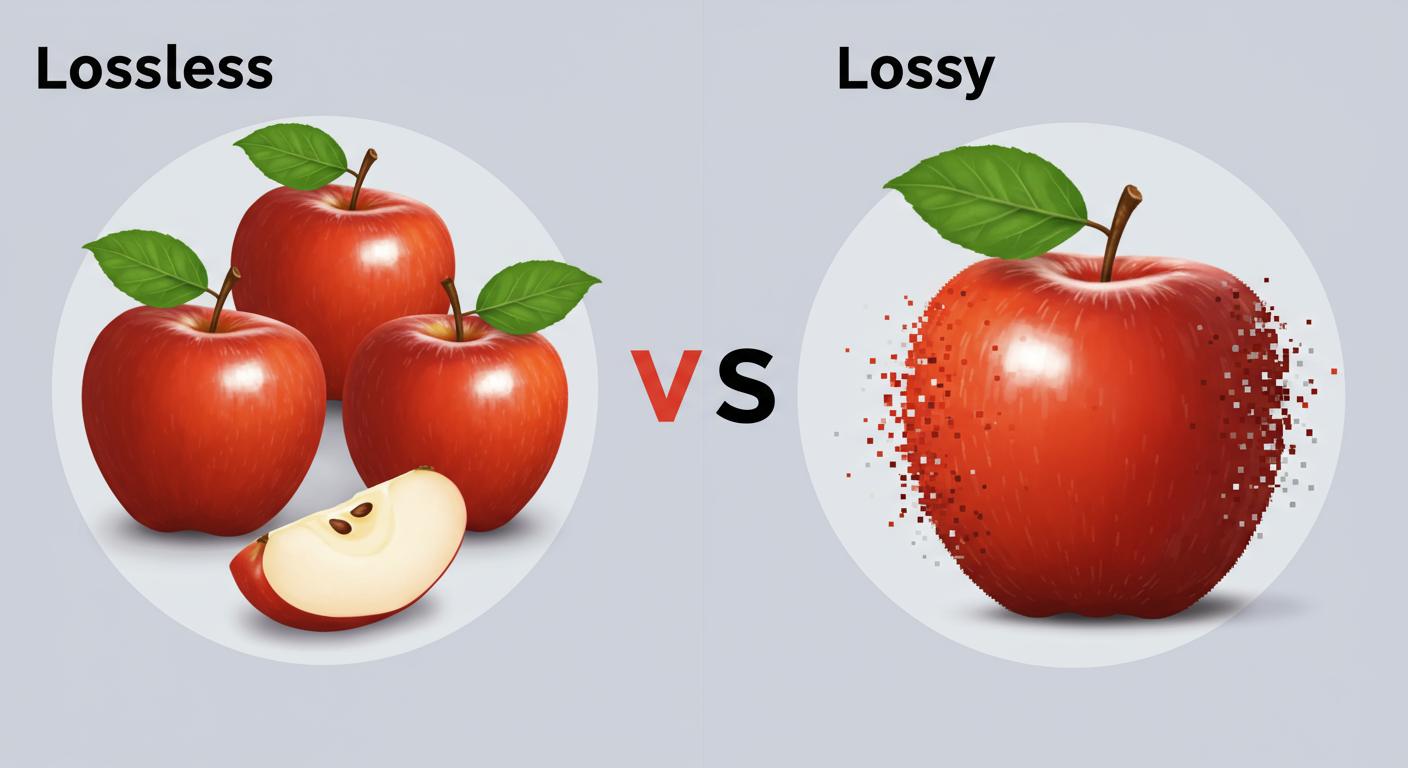

Datenkodierungsschemata lassen sich grob in zwei Hauptkategorien unterteilen: verlustfreie und verlustbehaftete Kodierung. Die Wahl zwischen diesen hängt stark vom Anwendungsfall ab und davon, ob die vollständige Originaltreue der Daten zwingend erforderlich ist oder ob eine gewisse Datenreduktion zugunsten von Effizienz und Speicherplatz toleriert werden kann.

Verlustfreie Kodierung: Datenintegrität Priorität

Bei der verlustfreien Kodierung kann die ursprüngliche Datenmenge vollständig und exakt aus der kodierten Form wiederhergestellt werden. Dies bedeutet, dass kein einziges Bit der Information während des Kodierungs- und Dekodierungsprozesses verloren geht. Diese Art der Kodierung ist unerlässlich in Bereichen, wo die absolute Datenintegrität von höchster Bedeutung ist, beispielsweise bei Textdokumenten, Quellcode, Datenbanken, medizinischen Bildern oder finanziellen Transaktionsdaten. Häufig wird dies durch die Identifizierung und Entfernung von Redundanzen erreicht.

Bekannte Beispiele für verlustfreie Kodierungsverfahren sind:

- Run-Length Encoding (RLE): Ersetzt Sequenzen wiederholter Datenwerte durch einen einzelnen Datenwert und die Anzahl seiner Wiederholungen. Ideal für Daten mit langen, wiederkehrenden Mustern.

- Huffman-Kodierung: Eine variable Längen-Kodierung, die häufig vorkommenden Symbolen kürzere Binärcodes und seltenen Symbolen längere Binärcodes zuweist. Dadurch wird die durchschnittliche Codelänge minimiert.

- Lempel-Ziv-Welch (LZW): Baut ein Wörterbuch aus gefundenen Datenmustern auf und ersetzt diese Muster durch kürzere Codes. Wird unter anderem in GIF-Bildern und ZIP-Archiven verwendet.

- DEFLATE: Eine Kombination aus LZW-ähnlicher Kompression und Huffman-Kodierung, die in ZIP, PNG und GZIP weit verbreitet ist.

Hier ist ein einfaches Python-Beispiel für Run-Length Encoding (RLE), um das Prinzip der verlustfreien Kodierung zu verdeutlichen:

def rle_encode(data):

"""

Führt eine Run-Length Encoding auf einer Liste von Zeichen aus.

Beispiel: "AAABBC" -> [('A', 3), ('B', 2), ('C', 1)]

"""

if not data:

return []

encoded_data = []

count = 1

current_char = data[0]

for i in range(1, len(data)):

if data[i] == current_char:

count += 1

else:

encoded_data.append((current_char, count))

current_char = data[i]

count = 1

encoded_data.append((current_char, count)) # Letzte Sequenz hinzufügen

return encoded_data

def rle_decode(encoded_data):

"""

Dekodiert Daten, die mit Run-Length Encoding kodiert wurden.

Beispiel: [('A', 3), ('B', 2), ('C', 1)] -> "AAABBC"

"""

decoded_data = []

for char, count in encoded_data:

decoded_data.extend([char] count)

return "".join(decoded_data)

# Test des RLE-Verfahrens

original_string = "AAAABBBCCDAA"

print(f"Originalstring: {original_string}")

kodiert = rle_encode(list(original_string))

print(f"Kodiert: {kodiert}")

dekodiert = rle_decode(kodiert)

print(f"Dekodiert: {dekodiert}")

# Überprüfung der Datenintegrität

assert original_string == dekodiert

print("Datenintegrität bei verlustfreier Kodierung bestätigt.")Dieses Beispiel zeigt, wie RLE Redundanzen reduziert, ohne Informationen zu verlieren, was typisch für verlustfreie Kodierungsverfahren ist. Solche Techniken sind entscheidend für die effiziente Datenarchivierung und die zuverlässige Übermittlung sensibler Inhalte.

„Bei der verlustfreien Kodierung ist jedes Bit des Originals heilig; die vollständige Rekonstruktion ist das unantastbare Gebot.“

Verlustbehaftete Kodierung: Effizienz durch Informationsreduktion

Im Gegensatz dazu opfert die verlustbehaftete Kodierung bewusst einen Teil der Daten, um eine wesentlich stärkere Kompression zu erreichen. Dabei werden Informationen entfernt, die als redundant oder für die menschliche Wahrnehmung als unwesentlich gelten. Diese Methode wird vor allem in Multimedia-Anwendungen eingesetzt, wo eine geringfügige Qualitätsminderung oft tolerierbar ist, um die Dateigröße drastisch zu reduzieren. Dies ermöglicht schnelleres Streaming und spart erheblich Speicherplatz.

Gängige Beispiele hierfür sind:

- JPEG (Joint Photographic Experts Group): Für Bilder. Nutzt die Diskrete Kosinustransformation (DCT), um Bilddaten in Frequenzkomponenten zu zerlegen und weniger wichtige Hochfrequenzinformationen (die für Details verantwortlich sind) zu verwerfen.

- MP3 (MPEG-1 Audio Layer III): Für Audio. Basiert auf psychoakustischen Modellen, die Frequenzen oder Lautstärken eliminieren, die vom menschlichen Ohr nicht oder kaum wahrgenommen werden können (Maskierungseffekte).

- MPEG (Moving Picture Experts Group): Für Video. Komprimiert Videos, indem es temporale und räumliche Redundanzen nutzt (z. B. nur die Änderungen zwischen aufeinanderfolgenden Bildern speichert und ähnliche Kompressionsprinzipien wie JPEG auf Einzelbilder anwendet).

- H.264/H.265 (AVC/HEVC): Moderne Videokompressionsstandards, die noch effizienter sind und die Grundlage für Streaming-Dienste und hochauflösende Videos bilden.

Obwohl eine vollständige Implementierung eines verlustbehafteten Codecs in einem einfachen Codebeispiel zu komplex wäre, können wir das Konzept der Informationsreduktion veranschaulichen, indem wir eine sehr simple „Quantisierung“ von numerischen Daten simulieren. Dies ist ein Kernprinzip vieler verlustbehafteter Algorithmen.

import numpy as np

def simple_lossy_quantization(data_array, quantization_level):

"""

Simuliert eine einfache verlustbehaftete Quantisierung.

Rundet Daten auf ein Vielfaches von 'quantization_level'.

"""

# Daten werden auf das nächste Vielfache des Quantisierungslevels gerundet.

# Dies führt zu Informationsverlust, da die ursprünglichen Feinheiten verloren gehen.

quantized_data = np.round(data_array / quantization_level) quantization_level

return quantized_data

# Beispiel: Originaldaten (z.B. Pixelwerte oder Audiosamples)

original_data = np.array([25.3, 27.8, 30.1, 32.7, 35.5, 37.9, 40.2, 42.6])

quantization_level = 5 # Wir quantisieren auf Vielfache von 5

print(f"Originaldaten: {original_data}")

# Daten verlustbehaftet kodieren (quantisieren)

lossy_encoded_data = simple_lossy_quantization(original_data, quantization_level)

print(f"Verlustbehaftet kodierte Daten (Quantisierung auf {quantization_level}): {lossy_encoded_data}")

# Der Versuch, die Originaldaten wiederherzustellen, zeigt den Verlust

# In der Realität würde man nur die quantisierten Werte speichern.

# Hier ist der Verlust sichtbar, da die dekodierten Werte nicht exakt den Originalen entsprechen.

print(f"Abweichung: {original_data - lossy_encoded_data}")

Dieses Python-Beispiel demonstriert, wie durch eine einfache Quantisierung Informationen unwiederbringlich verloren gehen, was das Kernprinzip der verlustbehafteten Kodierung ist. Für Entwickler und Data Scientists ist das Verständnis dieser Kompromisse zwischen Dateigröße und Datenqualität entscheidend, um optimale Lösungen für ihre Projekte zu entwerfen.

Arten von Datenkodierungsschemata im Detail

Neben der Unterscheidung in verlustfrei und verlustbehaftet gibt es spezifische Kodierungsschemata, die sich auf die Art der zu kodierenden Daten konzentrieren: Binär, Textuell und Numerisch. Diese bilden die Bausteine, auf denen alle komplexeren Datenstrukturen und Dateiformate aufbauen.

Binäre Kodierung: Die Sprache der Computer

Die binäre Kodierung ist das fundamentalste aller Schemata und die native Sprache von Computern. Jedes Datenelement, sei es ein Buchstabe, eine Zahl, ein Pixel oder ein Ton, wird letztendlich in eine Sequenz von Bits umgewandelt – 0en und 1en. Ein Bit repräsentiert den Zustand eines elektronischen Schalters (ein/aus, Strom/kein Strom). Durch das Kombinieren von Bits zu Bytes (typischerweise 8 Bits) können komplexere Informationen dargestellt werden.

Ein einzelnes Bit kann zwei Zustände annehmen (0 oder 1). Mit 8 Bits (ein Byte) können 28 = 256 verschiedene Zustände dargestellt werden. Diese Zustände können dann bestimmten Zeichen, Zahlen oder Farben zugeordnet werden. Diese low-level Darstellung ist die Grundlage für alle Operationen, die ein Computer ausführt, von der Prozessorausführung bis zur Datenspeicherung auf einer Festplatte. Das tiefergehende Verständnis der binären Datenrepräsentation ist für jeden Softwareentwickler unerlässlich.

Hier sind Python-Beispiele für die binäre Darstellung verschiedener Datentypen und Bitmanipulationen:

# Binäre Darstellung von Ganzzahlen

zahl_dezimal = 77

print(f"Dezimal {zahl_dezimal} ist binär {bin(zahl_dezimal)}") # Präfix 0b für binär

# Binäre Darstellung von Floating-Point-Zahlen (komplexer, IEEE 754 Standard)

# Python bietet keine direkte binäre Darstellung für Floats. Man muss auf die Bit-Ebene zugreifen.

import struct

float_val = 3.14159

# '!' bedeutet Netzwerk-Byte-Reihenfolge (big-endian), 'f' für float

packed_float = struct.pack('!f', float_val)

print(f"Float {float_val} in Bytes: {packed_float}")

print(f"Float {float_val} in Binär (IEEE 754 Single Precision): {''.join(f'{byte:08b}' for byte in packed_float)}")

# Bitweise Operationen (fundamental für Low-Level-Kodierung)

a = 0b1010 # Dezimal 10

b = 0b0110 # Dezimal 6

# Bitweises UND

print(f"Binär {bin(a)} UND {bin(b)} = {bin(a & b)}") # Erwartet: 0b0010 (Dezimal 2)

# Bitweises ODER

print(f"Binär {bin(a)} ODER {bin(b)} = {bin(a | b)}") # Erwartet: 0b1110 (Dezimal 14)

# Bitweises XOR

print(f"Binär {bin(a)} XOR {bin(b)} = {bin(a ^ b)}") # Erwartet: 0b1100 (Dezimal 12)

# Linksshift (Multiplikation mit 2^n)

print(f"Binär {bin(a)} << 1 = {bin(a <> 1 = {bin(a >> 1)}") # Erwartet: 0b101 (Dezimal 5)Textuelle Kodierung: Zeichen für Zeichen verstanden

Die textuelle Kodierung befasst sich damit, wie geschriebene Zeichen – Buchstaben, Zahlen, Satzzeichen und Symbole – in numerische Codes umgewandelt werden, die von einem Computer verstanden werden können. Dies ist entscheidend für die Darstellung und Verarbeitung von Text in jeder Softwareanwendung. Die Entwicklung von Textkodierungsschemata ist ein Paradebeispiel für die Notwendigkeit, sich an die wachsenden Anforderungen der globalen Kommunikation anzupassen.

Historisch gesehen war ASCII (American Standard Code for Information Interchange) einer der ersten und am weitesten verbreiteten Standards. Er verwendete 7 Bit, um 128 Zeichen darzustellen, hauptsächlich englische Buchstaben, Zahlen und grundlegende Symbole. Dies reichte für die englischsprachige Welt aus, stieß aber schnell an seine Grenzen, als andere Sprachen mit Akzenten und Sonderzeichen unterstützt werden mussten.

Daraufhin entstanden verschiedene erweiterte ASCII-Standards (z.B. ISO-8859-1 für Westeuropa), die 8 Bit nutzten, um 256 Zeichen abzubilden. Doch auch diese waren Insellösungen, die zu Kompatibilitätsproblemen führten (Mojibake), wenn Texte in verschiedenen Kodierungen ausgetauscht wurden.

Die Lösung für dieses Problem kam in Form von Unicode. Unicode ist ein internationaler Standard, der darauf abzielt, jedes Zeichen jeder bekannten Sprache der Welt einen eindeutigen numerischen Code zuzuweisen. Anstatt eine feste Bit-Anzahl pro Zeichen zu verwenden, definiert Unicode einen riesigen Zeichensatz (Code Points). Die tatsächliche Kodierung dieser Code Points in Bytes übernehmen verschiedene Unicode-Kodierungsformen wie:

- UTF-8 (Unicode Transformation Format – 8-bit): Der heute am weitesten verbreitete Standard. Er ist variabel lang (1 bis 4 Bytes pro Zeichen), rückwärtskompatibel mit ASCII und sehr effizient für westliche Sprachen.

- UTF-16: Verwendet 2 oder 4 Bytes pro Zeichen. Häufig in Windows-Systemen und Java verwendet.

- UTF-32: Verwendet 4 Bytes pro Zeichen. Einfach, aber speicherineffizient, da jedes Zeichen 4 Bytes belegt, selbst wenn weniger benötigt würden.

Das Verständnis von Unicode und UTF-8 ist für die Entwicklung internationaler Software, die globale Textverarbeitung und die Vermeidung von Zeichenkodierungsfehlern unerlässlich.

Ein Python-Beispiel, das die Kodierung und Dekodierung von Zeichen in UTF-8 und die Probleme bei falschen Kodierungen demonstriert:

# Textuelles Kodierungsschema: UTF-8 Beispiel

text_deutsch = "Grüße aus München!"

text_japanisch = "こんにちは世界!" # Konnichiwa Sekai! (Hello World!)

# Kodierung in UTF-8

kodiert_deutsch_utf8 = text_deutsch.encode('utf-8')

kodiert_japanisch_utf8 = text_japanisch.encode('utf-8')

print(f"Original Deutsch: '{text_deutsch}'")

print(f"UTF-8 Bytes Deutsch: {kodiert_deutsch_utf8}")

print(f"Original Japanisch: '{text_japanisch}'")

print(f"UTF-8 Bytes Japanisch: {kodiert_japanisch_utf8}")

# Dekodierung aus UTF-8

dekodiert_deutsch = kodiert_deutsch_utf8.decode('utf-8')

dekodiert_japanisch = kodiert_japanisch_utf8.decode('utf-8')

print(f"Dekodiert Deutsch: '{dekodiert_deutsch}'")

print(f"Dekodiert Japanisch: '{dekodiert_japanisch}'")

# Beispiel für Fehler bei falscher Dekodierung (Mojibake)

# Nehmen wir an, die UTF-8-Bytes werden fälschlicherweise als 'latin-1' (ISO-8859-1) interpretiert

try:

falsch_dekodiert = kodiert_deutsch_utf8.decode('latin-1')

print(f"Falsch dekodiert (latin-1): '{falsch_dekodiert}'")

except UnicodeDecodeError as e:

print(f"Fehler bei falscher Dekodierung: {e}")

print("Das zeigt, wie wichtig die korrekte Angabe des Kodierungsschemas ist!")

Numerische Kodierung: Zahlen präzise darstellen

Die numerische Kodierung befasst sich mit der Darstellung von Zahlen in binären Systemen. Während eine einfache Ganzzahl oft direkt in Binär umgewandelt wird, gibt es spezielle Schemata für bestimmte Anforderungen an Präzision, Fehlererkennung oder Hardwareeffizienz.

- BCD (Binary-Coded Decimal): Bei BCD wird jede Dezimalziffer einer Zahl einzeln in ihre 4-Bit-Binärentsprechung umgewandelt. Zum Beispiel wird die Dezimalzahl 123 als 0001 0010 0011 (BCD) anstatt als 01111011 (reines Binär) dargestellt. BCD wird häufig in Finanzanwendungen oder Uhren verwendet, wo präzise Dezimalarithmetik ohne Rundungsfehler wichtig ist.

- Gray Code: Ein sogenannter „Unit-Distance Code“. Bei diesem Schema unterscheiden sich zwei aufeinanderfolgende Zahlen immer nur in genau einem Bit. Dies ist besonders nützlich in mechanischen oder rotierenden Positionssensoren (z.B. optische Encoder), um Lesefehler zu vermeiden, die auftreten könnten, wenn sich mehrere Bits gleichzeitig ändern.

- Festkomma- und Gleitkommazahlen (IEEE 754): Für die Darstellung von Zahlen mit Brüchen und sehr großen oder sehr kleinen Werten werden spezielle Formate verwendet. Der IEEE 754-Standard definiert, wie Gleitkommazahlen (Floats und Doubles) in Binär gespeichert werden, einschließlich eines Vorzeichenbits, eines Exponenten und einer Mantisse. Dies ermöglicht einen großen Dynamikbereich, bringt aber auch die Herausforderung von Rundungsfehlern mit sich.

Das Verständnis dieser unterschiedlichen numerischen Kodierungsschemata ist entscheidend für Ingenieure und Entwickler, die Hardware-nahe Anwendungen, finanzielle Systeme oder wissenschaftliche Berechnungen entwickeln, bei denen die Genauigkeit der Zahlendarstellung kritisch ist.

Hier ist ein Codebeispiel, das BCD-Kodierung und eine einfache Generierung von Gray Code zeigt:

def decimal_to_bcd(decimal_num):

"""

Konvertiert eine Dezimalzahl in BCD-Darstellung.

Jede Dezimalziffer wird in 4 Bits umgewandelt.

"""

if not isinstance(decimal_num, int) or decimal_num < 0:

raise ValueError("Eingabe muss eine nicht-negative Ganzzahl sein.")

bcd_str = ""

for digit in str(decimal_num):

bcd_str += format(int(digit), '04b') # Format zu 4 Bits

return bcd_str

def binary_to_gray(binary_str):

"""

Konvertiert eine Binärzahl (als String) in Gray Code.

"""

gray_code = binary_str[0] # Das erste Bit ist dasselbe

for i in range(1, len(binary_str)):

# XOR das aktuelle Bit mit dem vorherigen Bit

gray_code += str(int(binary_str[i-1]) ^ int(binary_str[i]))

return gray_code

def gray_to_binary(gray_str):

"""

Konvertiert Gray Code (als String) zurück in Binär.

"""

binary_code = gray_str[0] # Das erste Bit ist dasselbe

for i in range(1, len(gray_str)):

# XOR das aktuelle Gray-Bit mit dem vorherigen Binär-Bit

binary_code += str(int(gray_str[i]) ^ int(binary_code[i-1]))

return binary_code

# Beispiel für BCD

dezimalzahl_bcd = 1234

bcd_result = decimal_to_bcd(dezimalzahl_bcd)

print(f"Dezimal {dezimalzahl_bcd} in BCD: {bcd_result}")

# Beispiel für Gray Code

dezimalzahl_gray = 10

binär_gray = bin(dezimalzahl_gray)[2:] # Binäre Darstellung ohne '0b'

gray_result = binary_to_gray(binär_gray)

print(f"Dezimal {dezimalzahl_gray} ist Binär {binär_gray}")

print(f"Binär {binär_gray} in Gray Code: {gray_result}")

# Rückkonvertierung zur Überprüfung

binary_from_gray = gray_to_binary(gray_result)

print(f"Gray Code {gray_result} zurück in Binär: {binary_from_gray}")

assert binär_gray == binary_from_gray

print("Gray Code Konvertierung bestätigt.")

Praxisanwendungen von Datenkodierungsschemata

Die Bedeutung von Datenkodierungsschemata erstreckt sich über nahezu alle Bereiche der modernen Technologie. Sie sind die unsichtbaren Helden, die die Funktionsweise unserer vernetzten Welt ermöglichen. Von der Übertragung von Nachrichten bis zur Speicherung riesiger Datenmengen spielen sie eine unverzichtbare Rolle.

Telekommunikation und Netzwerkprotokolle

Im Bereich der Telekommunikation sind Datenkodierungsschemata unerlässlich, um digitale Signale über große Distanzen zuverlässig zu übertragen und die Netzwerkkommunikation zu optimieren. Die Herausforderungen hierbei sind Rauschen, Interferenzen und Paketverluste, die die Datenintegrität beeinträchtigen können.

- Fehlererkennungs- und Fehlerkorrekturcodes: Diese Kodierungstechniken (z.B. Cyclic Redundancy Check (CRC), Hamming-Codes, Reed-Solomon-Codes) fügen den Daten redundante Informationen hinzu. Dadurch können Empfänger Fehler in den übertragenen Daten erkennen und in vielen Fällen sogar automatisch korrigieren, ohne eine Neuübertragung anfordern zu müssen.

- Kanalcodierung und Modulation: Daten werden nicht direkt als Bits über Funk oder Kabel gesendet, sondern in analoge Signale moduliert. Techniken wie Quadraturamplitudenmodulation (QAM) oder Phasenumtastung (PSK) kodieren mehrere Bits pro Signaländerung, um die Bandbreiteneffizienz zu maximieren und mehr Daten pro Zeiteinheit zu übertragen.

- Netzwerkprotokolle: Header und Payloads in Protokollen wie TCP/IP sind ebenfalls nach strikten Kodierungsschemata strukturiert, um eine korrekte Adressierung, Routing und Segmentierung der Datenpakete zu gewährleisten.

Multimedia: Kompression und Streaming

Ohne fortschrittliche Kodierungsschemata wäre der Konsum von hochauflösenden Videos, qualitativ hochwertigem Audio und detaillierten Bildern im Internet schlichtweg unmöglich. Hierbei kommen vor allem verlustbehaftete Verfahren zum Einsatz, die ein ausgewogenes Verhältnis zwischen Dateigröße und wahrgenommener Qualität bieten.

- Bildkodierung (JPEG, PNG, WebP): JPEG nutzt wie erwähnt DCT, um visuelle Redundanzen zu entfernen. PNG bietet verlustfreie Kompression für Grafiken mit scharfen Kanten und Transparenz. WebP ist ein moderneres Format, das sowohl verlustbehaftete als auch verlustfreie Kompression für Webbilder bietet.

- Audiokodierung (MP3, AAC, Ogg Vorbis, FLAC): MP3 und AAC verwenden psychoakustische Modelle zur Reduktion von Audiodaten. Formate wie FLAC hingegen bieten verlustfreie Audiokompression für höchste Klangtreue.

- Videokodierung (H.264/AVC, H.265/HEVC, VP9, AV1): Diese Standards sind entscheidend für Video-Streaming, Blu-rays und Videokonferenzen. Sie nutzen komplexe Algorithmen, um sowohl räumliche (innerhalb eines Bildes) als auch temporale (zwischen Bildern) Redundanzen zu eliminieren, was eine enorme Kompressionsrate ermöglicht.

- Adaptive Bitrate Streaming: Hierbei werden verschiedene kodierte Versionen eines Videos mit unterschiedlicher Qualität und Bitrate vorgehalten. Das System wählt dynamisch die beste Version basierend auf der aktuellen Netzwerkbandbreite des Nutzers, um ein reibungsloses Wiedergabeerlebnis zu gewährleisten.

Datenbanken, Big Data und Datenintegration

In Umgebungen mit riesigen Datenmengen – von relationalen Datenbanken bis hin zu verteilten Big Data-Systemen – sind Kodierungsschemata entscheidend für die Optimierung von Speicherplatz, die Beschleunigung von Abfragen und die Sicherstellung der Datenintegrität in Big Data Architekturen.

- Spaltenorientierte Speicherung: Datenbanken wie Apache Parquet oder Apache ORC nutzen spaltenorientierte Kodierung und Kompression, um Daten effizienter zu speichern und analytische Abfragen zu beschleunigen, da nur die relevanten Spalten gelesen werden müssen.

- Datenindizierung: Spezielle Kodierungsschemata werden verwendet, um Indizes auf Daten zu erstellen. Dies ermöglicht extrem schnelle Suchvorgänge und den Zugriff auf spezifische Datensätze in großen Datasets.

- Serialisierungsformate: Für den effizienten Austausch von Daten zwischen verschiedenen Systemen oder Diensten werden Serialisierungsformate wie JSON, XML, Protocol Buffers (Protobuf) oder Apache Avro verwendet. Diese kodieren Datenstrukturen in ein übertragbares Format. Protobuf und Avro sind binär und daher oft effizienter als textbasierte Formate wie JSON für optimierte Datenübertragung und Speicherung.

- ETL/ELT-Prozesse: Bei der Extraktion, Transformation und dem Laden (ETL) oder Extrahieren, Laden und Transformieren (ELT) von Daten spielen Kodierungsschemata eine Rolle bei der Gewährleistung der Kompatibilität und Effizienz der Datenpipeline.

Hier ist eine Tabelle, die die Vor- und Nachteile einiger gängiger Serialisierungsformate für die effiziente Datenintegration vergleicht:

| Merkmal | JSON | XML | Protocol Buffers (Protobuf) | Apache Avro |

|---|---|---|---|---|

| Lesbarkeit | Hoch (menschlich) | Hoch (menschlich) | Niedrig (binär) | Niedrig (binär) |

| Dateigröße | Mittel | Groß | Sehr klein | Sehr klein |

| Schema | Optional, lose | Strikt (XSD) | Strikt (.proto Datei) | Strikt (JSON Schema) |

| Performance | Mittel | Niedrig | Sehr hoch | Sehr hoch |

| Anwendungsfall | Web-APIs, Konfiguration | Dokumente, Konfiguration | RPC, Microservices, IoT | Big Data, Messaging |

| Sprachübergreifend | Ja | Ja | Ja | Ja |

Cybersicherheit: Verschlüsselung und Datenschutz

Im Bereich der Cybersicherheit sind kryptografische Kodierungsschemata das Rückgrat des Datenschutzes und der sicheren Kommunikation. Sie transformieren Informationen in ein unlesbares Format, das ohne den richtigen Schlüssel oder Algorithmus nicht entschlüsselt werden kann.

- Symmetrische Verschlüsselung: Verfahren wie AES (Advanced Encryption Standard) verwenden denselben Schlüssel zum Ver- und Entschlüsseln von Daten. Sie sind schnell und effizient für die Verschlüsselung großer Datenmengen (z.B. Festplattenverschlüsselung, geschützte Dokumente).

- Asymmetrische Verschlüsselung (Public-Key-Kryptografie): Algorithmen wie RSA oder ECC (Elliptic Curve Cryptography) verwenden ein Schlüsselpaar – einen öffentlichen Schlüssel zum Verschlüsseln und einen privaten Schlüssel zum Entschlüsseln. Dies ermöglicht sichere Schlüsselverteilung und digitale Signaturen (z.B. TLS/SSL für sichere Webverbindungen, E-Mail-Verschlüsselung).

- Hashing: Hash-Funktionen (z.B. SHA-256) erzeugen aus beliebigen Daten einen festen, kurzen Wert (Hash-Wert). Sie sind deterministisch und kryptografisch sicher (kleine Änderung in den Eingangsdaten führt zu einem völlig anderen Hash-Wert). Hashes werden verwendet, um die Datenintegrität zu überprüfen (z.B. Software-Downloads) und Passwörter sicher zu speichern.

- Digitale Signaturen: Kombinieren asymmetrische Kryptografie und Hashing, um die Authentizität und Integrität von Dokumenten oder Nachrichten zu gewährleisten.

Diese kryptografischen Datenkodierungsschemata sind unverzichtbar für den Schutz sensibler Informationen, die Authentifizierung von Benutzern und Systemen sowie die Gewährleistung vertraulicher Kommunikation in einer zunehmend vernetzten Welt.

Ein vereinfachtes Python-Beispiel, das die grundlegenden Schritte der AES-Verschlüsselung (mit einer externen Bibliothek) zeigt:

from cryptography.fernet import Fernet

def generate_key():

"""Generiert einen neuen AES-Schlüssel."""

return Fernet.generate_key()

def encrypt_message(message, key):

"""Verschlüsselt eine Nachricht mit dem gegebenen Schlüssel."""

f = Fernet(key)

encrypted_message = f.encrypt(message.encode())

return encrypted_message

def decrypt_message(encrypted_message, key):

"""Entschlüsselt eine Nachricht mit dem gegebenen Schlüssel."""

f = Fernet(key)

decrypted_message = f.decrypt(encrypted_message).decode()

return decrypted_message

# Erstellen eines Schlüssels

key = generate_key()

print(f"Generierter AES-Schlüssel: {key.decode()}")

# Originalnachricht

original_message = "Dies ist eine hochsensible Nachricht, die verschlüsselt werden muss."

print(f"Originalnachricht: {original_message}")

# Nachricht verschlüsseln

encrypted_msg = encrypt_message(original_message, key)

print(f"Verschlüsselte Nachricht: {encrypted_msg}")

# Nachricht entschlüsseln

decrypted_msg = decrypt_message(encrypted_msg, key)

print(f"Entschlüsselte Nachricht: {decrypted_msg}")

# Überprüfung der Integrität nach Ver-/Entschlüsselung

assert original_message == decrypted_msg

print("Verschlüsselung und Entschlüsselung erfolgreich, Datenintegrität gewahrt.")Datenkodierung: Eine unverzichtbare Säule der modernen Informationsverarbeitung

Das Datenkodierungsschema ist weit mehr als ein technisches Detail; es ist ein Eckpfeiler der modernen digitalen Welt. Durch die effiziente Strukturierung, Komprimierung und Sicherung von Daten ermöglicht es uns, die immensen Herausforderungen der Informationsverarbeitung und -speicherung im Zeitalter von Big Data zu meistern. Für Entwickler, Ingenieure und Technologiebegeisterte ist ein tiefes Verständnis dieser Konzepte unerlässlich, um robuste, skalierbare und sichere Systeme zu entwerfen.

Die ständige Evolution der Technologie bringt neue Anforderungen und Algorithmen mit sich, aber die grundlegenden Prinzipien der Datenkodierung bleiben bestehen. Wir hoffen, dieser Artikel hat Ihnen einen umfassenden Einblick in die vielfältigen Facetten der Datenkodierung gegeben und Sie dazu angeregt, die Bedeutung hinter den Nullen und Einsen noch weiter zu ergründen. Wenn Sie dieses Wissen vertiefen möchten oder Fragen haben, laden wir Sie herzlich ein, die Kommentarfunktion zu nutzen oder unsere weiteren Fachartikel zum Thema Datenmanagement und Softwareentwicklung zu erkunden.

Der Artikel beschreibt Datenkodierungsschemata als das unsichtbare, fundamentale Rückgrat unserer digitalen Welt – unverzichtbar für Effizienz, Integrität und die schiere Möglichkeit, Daten zu speichern und zu übermitteln. Diese technische Notwendigkeit ist unbestreitbar und hat immense Vorteile für Kommunikation, Wissenschaft und Wirtschaft mit sich gebracht.

Doch gerade weil diese Technologie so grundlegend und allgegenwärtig ist, müssen wir ihre moralischen und gesellschaftlichen Implikationen kritisch hinterfragen. Wer profitiert tatsächlich von dieser Effizienz, und wer könnte möglicherweise darunter leiden?

Eindeutig profitieren all jene, die die Infrastruktur entwickeln, besitzen und verwalten: große Technologieunternehmen, Regierungen und Konzerne. Für sie bedeuten effiziente Kodierungsschemata die Fähigkeit, gigantische Datenmengen zu verarbeiten, zu speichern und zu übermitteln. Dies ermöglicht nicht nur Innovation und wirtschaftliches Wachstum, sondern auch eine beispiellose Kontrolle und Macht über Informationen und damit über die Gesellschaft. Die Optimierung der Datenübertragung und -speicherung ist die technische Voraussetzung für datengesteuerte Geschäftsmodelle, künstliche Intelligenz und – ein Aspekt, der nicht unerwähnt bleiben darf – auch für massenhafte Überwachungssysteme.

Die Schattenseiten zeigen sich dort, wo diese Macht missbraucht oder ungleich verteilt wird. Leidtragende könnten sein:

* **Bürger und Individuen:** Die Transparenz leidet. Da die Kodierung eine „unsichtbare Architektur“ ist, verstehen Laien kaum, wie ihre Daten tatsächlich verarbeitet, genutzt oder gar manipuliert werden. Dies untergräbt die digitale Souveränität des Einzelnen und kann das Vertrauen in digitale Systeme erschüttern. Die schiere Effizienz der Datenverarbeitung ermöglicht zudem die schnelle Verbreitung von Desinformation und die Schaffung von Filterblasen, deren Mechanismen nur schwer durchschaubar sind.

* **Die Gesellschaft als Ganzes:** Die Fähigkeit, Daten effizient zu verarbeiten, ist neutral. Doch sie bildet die Grundlage für die Implementierung von Algorithmen, die unbeabsichtigte oder beabsichtigte Diskriminierung verstärken können, wenn die zugrundeliegenden Daten oder Algorithmen voreingenommen sind. Die schiere Menge und Geschwindigkeit der Datenverarbeitung erschwert zudem eine kritische Auseinandersetzung und die notwendige politische und ethische Reflexion.

* **Randgruppen oder Entwicklungsländer:** Die digitale Kluft könnte sich vertiefen. Wer keinen Zugang zu den modernsten und effizientesten Kodierungs- und Verarbeitungstechnologien hat, könnte im globalen Wettbewerb oder bei der Teilhabe an der Informationsgesellschaft weiter ins Hintertreffen geraten.

* **Individuen im Kontext von Cybersicherheit:** Obwohl Kodierung die Datenintegrität gewährleisten soll, sind Schwachstellen in diesen Schemata oder ihrer Implementierung Einfallstore für Cyberangriffe, die zu massiven Datenlecks oder -manipulationen führen können, mit weitreichenden Folgen für Einzelpersonen und Organisationen.

Zusammenfassend lässt sich sagen, dass Datenkodierungsschemata ein mächtiges, ja, unverzichtbares Werkzeug sind. Ihre inhärente Effizienz birgt jedoch das Potenzial, Macht zu konsolidieren und die Komplexität der digitalen Welt für den Einzelnen zu erhöhen. Die moralische und gesellschaftliche Herausforderung besteht darin, diese grundlegende Technologie so zu gestalten und einzusetzen, dass sie dem Wohl aller dient und nicht nur einigen Wenigen, und dass die notwendige Transparenz und Rechenschaftspflicht gewahrt bleiben, auch wenn die Architektur unsichtbar bleibt.

Es ist sehr aufschlussreich, dass Sie die moralischen und gesellschaftlichen Implikationen von Datenkodierungsschemata so detailliert beleuchten. Sie haben völlig recht, dass die unsichtbare Natur dieser grundlegenden Technologie eine kritische Auseinandersetzung mit den Machtstrukturen und potenziellen Nachteilen erfordert, die sich daraus ergeben können, insbesondere im Hinblick auf Transparenz, digitale Souveränität und die Gefahr von Diskriminierung oder der Vertiefung digitaler Ungleichheiten. Ihre Punkte zur Verantwortung derjenigen, die diese Infrastruktur entwickeln und verwalten, sind von immenser Bedeutung für eine gerechte digitale Zukunft.

Ihre differenzierte Betrachtung der Schattenseiten, die sich für Bürger, die Gesellschaft als Ganzes, Randgruppen und im Bereich der Cybersicherheit zeigen können, unterstreicht die Notwendigkeit, über die reine technische Effizienz hinauszudenken. Es ist entscheidend, dass wir als Gesellschaft Wege finden, diese mächtigen Werkzeuge so einzusetzen, dass sie dem Wohl aller dienen und nicht nur einigen Wenigen, und dass wir die Transparenz und Rechenschaftspflicht wahren, auch wenn die technische Architektur unsichtbar bleibt. Vielen Dank für diesen wert

Ich musste gerade schmunzeln, als ich den Artikel gelesen habe, denn er hat mich direkt zurück in meine frühen Tage mit Computern katapultiert, als das alles noch ein großes Mysterium für mich war. Ich muss so um die zehn Jahre alt gewesen sein, und ein Freund hatte mir eine Diskette mit irgendeinem „coolen“ Programm oder Spiel mitgegeben. Ich war total aufgeregt, schob die Diskette in den Rechner und fand dann eine Datei, die ich für eine Art Anleitung hielt. Voller Tatendrang öffnete ich sie mit dem Standard-Texteditor, den ich kannte – es war wohl Notepad oder so etwas Ähnliches.

Was dann auf dem Bildschirm erschien, war alles andere als eine verständliche Anleitung. Es war ein wildes Durcheinander aus seltsamen Symbolen, kryptischen Zeichen, Hieroglyphen und manchmal ein paar zufällig erscheinenden Buchstaben, die aber keinen Sinn ergaben. Ein einziges großes Chaos, das sich über den ganzen Bildschirm zog. Ich saß da, völlig ratlos. War die Datei kaputt? War mein Computer kaputt? Oder war das eine Geheimbotschaft, die ich nicht entschlüsseln konnte?

Ich rief meinen Freund an, ziemlich frustriert. Er hörte sich meine Beschreibung an und begann zu lachen. „Ach, du hast versucht, eine EXE-Datei mit dem Texteditor zu öffnen!“, sagte er. „Das ist wie wenn du versuchst, ein Buch in einer Sprache zu lesen, die du nicht sprichst, ohne das richtige Wörterbuch. Der Computer weiß nicht, wie er das übersetzen soll, also zeigt er dir einfach alles, was er sieht.“ In meinem Fall war es wohl eine ausführbare Datei, keine Textdatei. Aber selbst wenn es eine komprimierte Textdatei gewesen wäre, hätte das gleiche Prinzip gegolten.

In diesem Moment, als Zehnjähriger, hat es bei mir Klick gemacht. Es ging nicht nur darum, dass Daten da waren, sondern darum, dass sie in einer ganz bestimmten Art und Weise „verpackt“ und „angesprochen“ werden mussten, damit sie Sinn ergaben. Man brauchte den richtigen „Schlüssel“ oder „Übersetzer“. Es war eine einfache Lektion, aber sie hat mir damals die Augen geöffnet für die unsichtbare Welt hinter den Bildschirmen – die Welt, in der alles seine eigene Sprache und seine eigenen Regeln hat, um verstanden zu werden. Und genau darum geht es ja auch im Artikel, nur eben viel, viel technischer ausgedrückt.

Es freut mich sehr, dass mein artikel solche erinnerungen bei ihnen geweckt hat und sie schmunzeln mussten. ihre geschichte ist ein wunderbares beispiel dafür, wie wir alle in unseren anfängen mit der digitalen welt zu kämpfen hatten und wie prägend solche kleinen aha-momente sein können. die analogie mit dem buch in einer fremden sprache und dem fehlenden wörterbuch trifft es perfekt und fasst den kern des artikels auf eine sehr anschauliche weise zusammen.

es ist faszinierend zu sehen, wie diese grundlegenden erkenntnisse, die wir als kinder gemacht haben, die basis für ein viel tieferes verständnis der komplexen datenverarbeitung bilden, wie sie in meinem artikel beschrieben wird. diese unsichtbare welt der daten, die richtig verpackt und angesprochen werden müssen, ist tatsächlich der schlüssel zum verständnis vieler technischer prozesse. vielen dank für diesen wertvollen kommentar und dafür, dass sie ihre persönliche erfahrung geteilt haben. ich würde mich freuen, wenn sie auch andere artikel in meinem profil oder meine weiteren veröffentlichungen ansehen.