Die rasante Entwicklung generativer künstlicher Intelligenz (KI) wie ChatGPT, DALL-E und MidJourney hat die Art und Weise, wie wir mit Technologie interagieren, revolutioniert. Diese leistungsstarken Werkzeuge können beeindruckende Inhalte – von Texten über Bilder bis hin zu komplexem Computercode – auf Basis einfacher Sprachbefehle, sogenannter Prompts, erzeugen. Doch die wahre Kunst liegt darin, diese Prompts so präzise und detailliert zu formulieren, dass die KI exakt die gewünschten Ergebnisse liefert. Dies erfordert oft multiple Iterationen und eine tiefgreifende Kenntnis des Prompt-Engineerings.

In diesem umfassenden Blogbeitrag tauchen wir tief in das Konzept der KI-Promptbibliothek ein. Wir werden nicht nur die Grundlagen des Prompt-Engineerings erläutern, sondern auch die enormen Vorteile einer gut organisierten Prompt Library für Entwickler, Datenwissenschaftler und Technologiebegeisterte beleuchten. Von der Analyse der besten existierenden Bibliotheken bis hin zu einer Schritt-für-Schritt-Anleitung, wie Sie Ihre eigene, maßgeschneiderte Prompt-Sammlung erstellen können, deckt dieser Artikel alle wichtigen Aspekte ab, um Ihre Interaktion mit generativen KI-Modellen auf ein neues Niveau zu heben und die Optimierung von KI-Output zu meistern.

Grundlagen des Prompt-Engineerings und die Macht der Anweisung

Ein Prompt ist die primäre Schnittstelle zwischen Mensch und einem großen Sprachmodell (LLM) oder einem generativen KI-Modell. Es ist im Wesentlichen eine Anweisung oder Frage in natürlicher Sprache, die das Modell dazu anregt, eine bestimmte Ausgabe zu generieren. Die Komplexität eines Prompts kann stark variieren: Ein einzelnes Wort wie „Baum“ kann ein einfaches Bild erzeugen, während ein detaillierter Absatz eine komplexe Erzählung oder eine spezifische Codefunktion initiieren kann. Der Erfolg der KI-Interaktion hängt maßgeblich von der Qualität und Spezifität des Prompts ab.

Prompt-Engineering, auch als Prompt-Entwicklung bekannt, ist die Disziplin, diese Anfragen so zu gestalten, dass die gewünschten, präzisen und relevanten Ergebnisse erzielt werden. Es geht darum, die Nuancen des Modells zu verstehen und es gezielt durch die Formulierung zu lenken. Dies beinhaltet die Angabe von Kontext, Format, Ton, Zielgruppe, Länge und sogar Stilrichtlinien. Ohne effektives Prompt-Engineering kann selbst die fortschrittlichste KI vage oder unerwünschte Ergebnisse liefern. Eine solide Basis in diesem Bereich ist entscheidend, um das volle Potenzial generativer KIs auszuschöpfen und die effiziente KI-Interaktion zu gewährleisten.

Die Mechanik der KI-Inferenz durch Prompts

Wenn ein KI-Modell einen Prompt erhält, führt es einen Prozess namens Inferenz durch. Dabei greift das Modell auf das umfangreiche Wissen zurück, das es während seines Trainings auf riesigen Datensätzen gelernt hat. Es analysiert den Prompt, um Kontext, Absicht und Schlüsselinformationen zu extrahieren. Anschließend berechnet es Wahrscheinlichkeiten und Korrelationen zwischen verschiedenen Wortsequenzen (im Falle von Textgenerierung) oder Mustern (im Falle von Bildgenerierung), um eine kohärente und kontextrelevante Antwort zu konstruieren.

Dieser Prozess kann durch verschiedene Prompt-Techniken beeinflusst werden:

- Zero-Shot Prompting: Die KI erhält einen Prompt und muss ohne vorherige Beispiele eine Antwort generieren. Sie stützt sich dabei ausschließlich auf ihr internes Wissen.

- Few-Shot Prompting: Im Prompt werden einige Beispiele für Eingaben und die erwarteten Ausgaben bereitgestellt, um der KI zu zeigen, wie sie eine Aufgabe lösen soll.

- Chain-of-Thought (CoT) Prompting: Hierbei wird die KI angewiesen, ihre Gedankengänge oder Zwischenschritte zu verbalisieren, bevor sie die endgültige Antwort gibt. Dies ist besonders nützlich für komplexe Aufgaben, die logisches Denken erfordern.

# Beispiel für einen Zero-Shot Prompt (Python-Konzept)

prompt_zero_shot = "Schreibe einen kurzen Absatz über die Vorteile von erneuerbaren Energien."

# Beispiel für einen Few-Shot Prompt (Python-Konzept)

prompt_few_shot = """

# Aufgabe: Übersetze den folgenden Satz ins Deutsche.

# Beispiel 1:

# Englisch: "Hello, how are you?"

# Deutsch: "Hallo, wie geht es dir?"

# Beispiel 2:

# Englisch: "Artificial Intelligence is fascinating."

# Deutsch: "Künstliche Intelligenz ist faszinierend."

# Satz zum Übersetzen:

# Englisch: "The sun is shining today."

# Deutsch:

"""

# Beispiel für einen Chain-of-Thought Prompt (Python-Konzept)

prompt_cot = """

# Aufgabe: Berechne das Ergebnis der folgenden Rechenaufgabe Schritt für Schritt.

# Frage: Wie viel ist (5 + 3) 2 - 4?

# Denke Schritt für Schritt:

"""

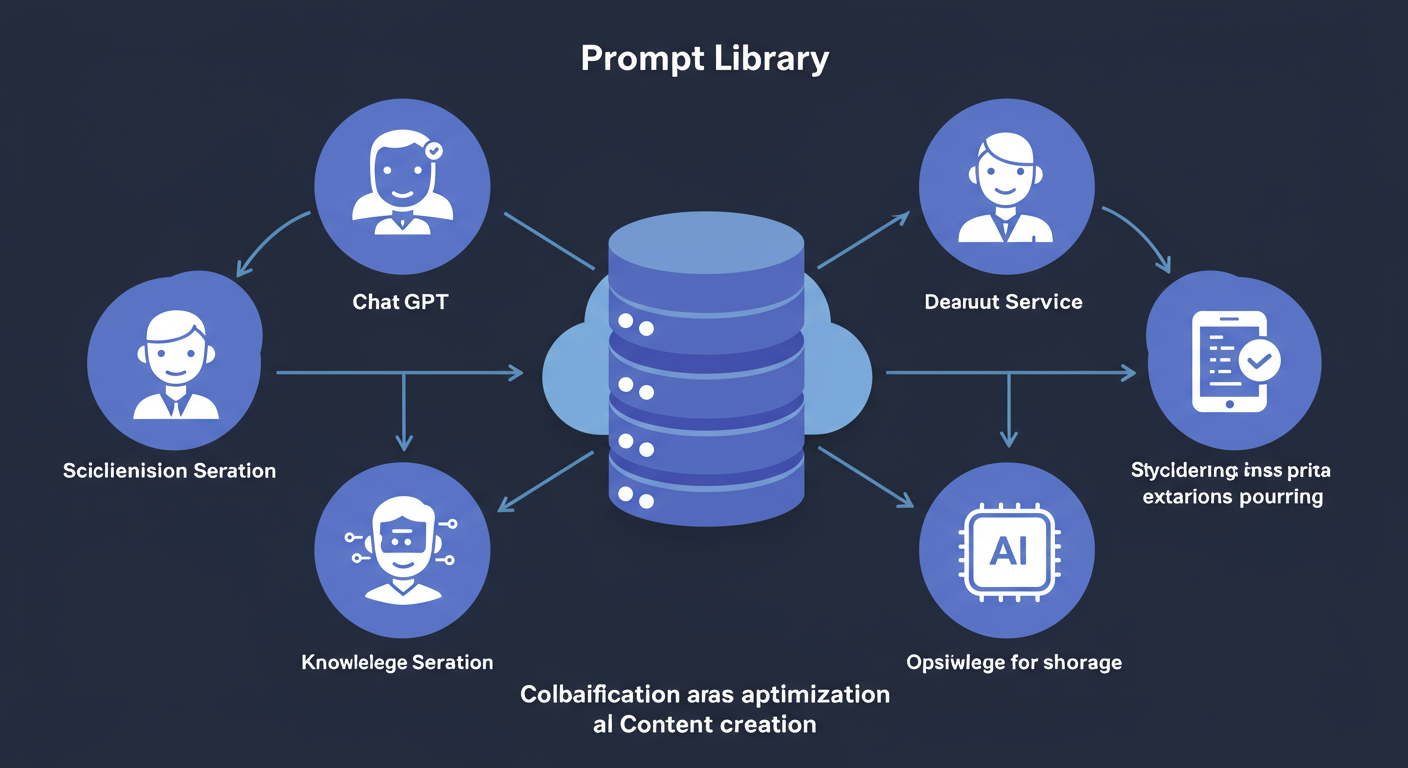

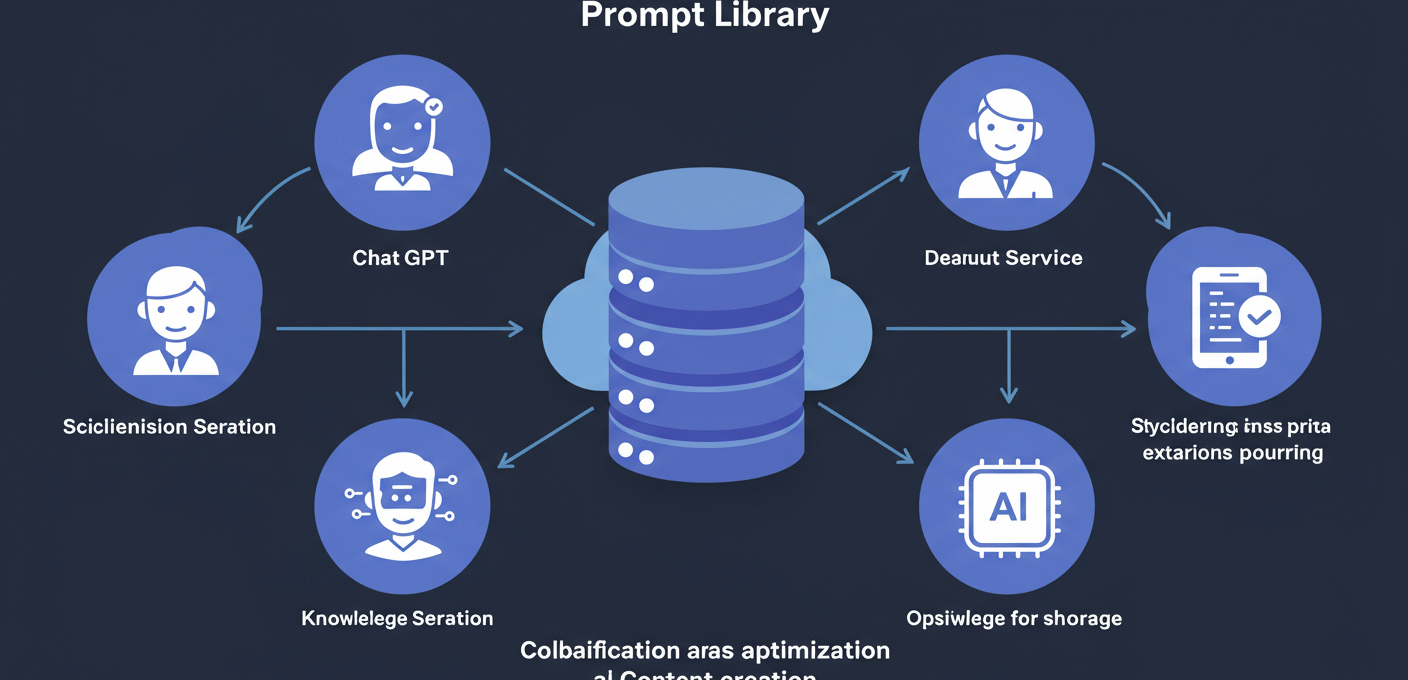

Die Prompt Library: Ein organisierter Katalog für generative KI

Eine Prompt Library ist eine zentrale, digitale Sammlung von hochwertigen und sofort einsatzbereiten Prompts. Sie dient als Repository, das Nutzer befähigt, ihre besten Prompts für verschiedene KI-Tools mit anderen zu teilen, zu verwalten oder sogar zu handeln. Der Hauptnutzen liegt darin, bei jeder neuen Anfrage nicht bei Null anfangen zu müssen, sondern auf bewährte Formulierungen zurückgreifen zu können, um die besten Ergebnisse zu erzielen.

Diese Bibliotheken reichen von privaten Sammlungen für den persönlichen Gebrauch bis hin zu öffentlichen Plattformen, auf denen Experten ihre Kreationen anbieten. Für Einsteiger im Prompt Engineering bieten sie eine hervorragende Gelegenheit, von der Erfahrung anderer zu lernen und die Prinzipien der Prompt-Entwicklung zu verstehen. Für erfahrene Anwender ermöglichen sie die Skalierung der KI-Nutzung, indem sie den Prozess der Prompt-Erstellung standardisieren und beschleunigen.

Umfassende Vorteile einer Prompt Library

Die Implementierung und Nutzung einer Prompt Library bringt eine Vielzahl von Vorteilen mit sich, die die Effizienz und Qualität der Arbeit mit generativen KIs erheblich steigern:

- Konsistenz und Wiederholbarkeit: Eine sorgfältig kuratierte Sammlung von Prompts gewährleistet, dass die Ergebnisse der KI über verschiedene Anfragen hinweg konsistent bleiben. Dies ist entscheidend für Projekte, die ein einheitliches Markenbild, einen spezifischen Schreibstil oder reproduzierbare Datenanalysen erfordern. Durch die Verwendung derselben optimierten Prompts erhalten Sie jedes Mal vergleichbare Ausgaben, was die Qualität der generierten Inhalte erheblich verbessert.

- Effizienz und Zeitersparnis: Anstatt jedes Mal neue Prompts von Grund auf neu zu formulieren und mehrere Iterationen durchzuführen, können Benutzer auf bewährte Vorlagen zurückgreifen. Dies beschleunigt den Prozess des Prompt-Engineerings erheblich und reduziert den Zeitaufwand für die Generierung von Inhalten. Entwickler können sich so auf komplexere Problemstellungen konzentrieren, während Routineaufgaben automatisiert werden.

- Leistungsoptimierung: Prompts in einer Bibliothek sind oft bereits optimiert für spezifische Anwendungsfälle oder KI-Modelle. Sie wurden getestet und verfeinert, um die bestmöglichen Ergebnisse zu liefern. Dies verbessert nicht nur die Relevanz und Genauigkeit der generierten Inhalte, sondern kann auch die Interpretationsfähigkeit der KI für komplexe Aufgaben steigern.

- Fehlerreduzierung: Durch die Verwendung vorab getesteter Prompts wird das Risiko menschlicher Fehler bei der Formulierung von Anfragen minimiert. Dies führt zu präziseren Ausgaben und vermeidet zeitraubende Korrekturen oder Neugenerierungen.

- Wissensmanagement und Kollaboration: Eine Prompt Library dient als zentrale Wissensbasis, in der Best Practices und effektive Prompt-Strategien geteilt werden können. Teams können Prompts gemeinsam entwickeln und verbessern, was den Wissensaustausch fördert und die Einarbeitung neuer Mitarbeiter in die KI-Nutzung erleichtert. Dies ist besonders wertvoll in größeren Entwicklungsteams oder Forschungsgruppen.

- Skalierbarkeit: Für umfangreiche Projekte, die eine große Anzahl von KI-generierten Elementen erfordern, ermöglicht eine Bibliothek die systematische und skalierbare Produktion von Inhalten. Dies ist essenziell für die Automatisierung von Prozessen oder die Erstellung großer Datensätze durch KI.

Bekannte Prompt Libraries und ihre Spezialisierungen

Der Markt für generative KI-Tools wächst rasant, und damit auch die Zahl der Plattformen, die Prompt Libraries anbieten. Diese Bibliotheken erleichtern den Zugang zu optimierten Prompts und ermöglichen es Nutzern, von der Expertise der Community zu profitieren. Hier sind einige der bekanntesten Beispiele:

PromptHero: Diese Plattform ist eine der führenden Ressourcen für Prompts, insbesondere für Bildgeneratoren wie MidJourney, Stable Diffusion und DALL-E. Benutzer können hier nicht nur Prompts finden, sondern auch die zugrunde liegenden Parameter wie die Anzahl der Schritte, Sampling-Methoden und andere technische Details einsehen, die zu den geteilten Ergebnissen geführt haben. Dies macht PromptHero zu einer exzellenten Lernressource für die Bildgenerierung KI.

PromptBase: PromptBase ist eine einzigartige Plattform, die den Handel mit Prompts ermöglicht. Nutzer können hier ihre selbst erstellten Prompts für verschiedene führende KI-Modelle wie DALL-E, GPT-Reihen, Stable Diffusion und MidJourney kaufen und verkaufen. Die Preise variieren, und die Plattform nimmt eine Provision auf jeden Verkauf. Dies schafft einen Anreiz für Prompt-Ingenieure, hochwertige und nützliche Prompts zu entwickeln und zu monetarisieren, und bietet Käufern Zugang zu professionell erstellten Anweisungen.

FlowGPT: FlowGPT konzentriert sich ausschließlich auf Prompts für ChatGPT und andere große Sprachmodelle. Ein besonderes Merkmal ist die Möglichkeit, Prompts direkt auf der Website zu testen, um deren Ergebnisse in Echtzeit zu überprüfen. Ein großer Teil des Katalogs wird kostenlos angeboten, was FlowGPT zu einer hervorragenden Anlaufstelle für alle macht, die ihre ChatGPT Prompts verbessern oder neue Anwendungsfälle entdecken möchten.

Diese Plattformen sind nur einige Beispiele; mit der Weiterentwicklung der generativen KI werden zweifellos viele weitere spezialisierte Prompt Libraries entstehen, die sich auf bestimmte Nischen oder KI-Technologien konzentrieren.

| Prompt Library | Spezialisierung | Funktionen |

|---|---|---|

| PromptHero | Bildgeneratoren (MidJourney, Stable Diffusion, DALL-E) | Community-Prompts, Parameter-Transparenz, Lernressource |

| PromptBase | Diverse KI-Modelle (DALL-E, GPT, Stable Diffusion, MidJourney) | Marktplatz für Prompts (Kauf/Verkauf), Monetarisierung |

| FlowGPT | ChatGPT und LLMs | Direkte Testmöglichkeit, kostenlose Prompts, Community-Fokus |

Die eigene Prompt Library konzipieren und erstellen

Während öffentliche Prompt Libraries einen hervorragenden Ausgangspunkt bieten, ist die Erstellung einer eigenen, maßgeschneiderten Prompt Library oft der nächste logische Schritt für Entwickler und Unternehmen, die spezifische Anforderungen oder sensible Daten haben. Eine personalisierte Sammlung ermöglicht ein höheres Maß an Individualität, Kontrolle und Anpassung an interne Workflows.

Schritt-für-Schritt-Anleitung zur Erstellung

Die Entwicklung einer effektiven privaten Prompt Library erfordert Planung und Struktur. Folgen Sie diesen Schritten, um Ihre eigene Sammlung aufzubauen:

1. Zweck und Umfang definieren

Beginnen Sie mit der Klärung des Hauptziels Ihrer Prompt Library. Welchen Projekten oder Anwendungsfällen soll sie dienen?

- Textgenerierung: Benötigen Sie Prompts für Blogbeiträge, E-Mails, Produktbeschreibungen oder Code-Snippets?

- Bildgenerierung: Suchen Sie nach Anweisungen für Logos, Illustrationen oder Texturen?

- Datenanalyse: Werden Prompts zur Abfrage von Daten, Erstellung von Berichten oder Generierung von Code für Datenmodelle benötigt?

2. Auswahl der Speichertools und Strukturierung

Die Wahl des richtigen Tools zur Speicherung Ihrer Prompts ist entscheidend für deren Zugänglichkeit und Verwaltung. Einfache Lösungen sind Tabellenkalkulationsprogramme wie Excel oder Google Sheets, die grundlegende Such- und Sortierfunktionen bieten. Für komplexere Anforderungen können dedizierte Datenbanken, Versionskontrollsysteme wie Git oder sogar spezialisierte Prompt-Management-Software in Betracht gezogen werden. Die Struktur sollte eine einfache Wiederfindung und Anpassung ermöglichen.

Empfohlene Felder für jeden Prompt-Eintrag könnten sein:

- Prompt-Name: Eine eindeutige und beschreibende Bezeichnung.

- Prompt-Text: Der eigentliche Prompt.

- KI-Modell: Für welches Modell ist der Prompt optimiert (z.B. „ChatGPT 4“, „MidJourney v6“).

- Anwendungsfall/Kategorie: Eine oder mehrere Kategorien zur schnellen Filterung (z.B. „Marketing Text“, „Python Code“, „Landschaftsbild“).

- Erwartetes Ergebnis: Kurze Beschreibung, was der Prompt generieren soll.

- Beispiel-Output: Ein Beispiel des besten Ergebnisses (Screenshot, Textauszug).

- Erstellungsdatum / Letzte Änderung: Zur Nachverfolgung.

- Tags/Keywords: Zusätzliche Schlagwörter für die Suche (z.B. „SEO“, „Fantasy“, „Refactoring“).

- Anmerkungen: Spezielle Hinweise oder Optimierungstipps.

# Beispiel: Struktur einer Prompt Library in Python (als JSON-Datei)

import json

prompt_library = [

{

"prompt_name": "Blogbeitrag Entwurf SEO",

"prompt_text": "Schreibe einen detaillierten Blogbeitrag über die besten SEO-Strategien für Tech-Startups im Jahr 2024. Der Ton soll informativ und autoritär sein, die Zielgruppe sind Entwickler und Tech-Gründer. Fokus auf Long-Tail-Keywords und technisches SEO. Länge ca. 800 Wörter.",

"ai_model": "ChatGPT 4",

"category": "Content-Marketing, SEO",

"expected_output": "Strukturierter Blogbeitrag mit Einleitung, Hauptteil, Schluss und konkreten Tipps.",

"example_output_excerpt": "...",

"tags": ["SEO", "Content Marketing", "Tech-Startup", "2024", "Deep Dive"],

"notes": "Achten Sie auf aktuelle Trends und vermeiden Sie Buzzwords ohne Erklärung."

},

{

"prompt_name": "Python Funktion für API-Aufruf",

"prompt_text": "Schreibe eine Python-Funktion, die einen GET-Request an 'https://api.example.com/data' sendet und die JSON-Antwort parst. Füge Fehlerbehandlung für Netzwerkfehler und ungültige JSON-Antworten hinzu. Kommentiere den Code ausführlich.",

"ai_model": "GitHub Copilot / GPT 4",

"category": "Softwareentwicklung, API",

"expected_output": "Voll funktionsfähige, kommentierte Python-Funktion.",

"example_output_excerpt": "...",

"tags": ["Python", "API", "Requests", "JSON", "Fehlerbehandlung"],

"notes": "Verwenden Sie die 'requests'-Bibliothek. Timeout von 5 Sekunden."

}

]

# Speichern der Bibliothek in einer JSON-Datei

with open("prompt_library.json", "w", encoding="utf-8") as f:

json.dump(prompt_library, f, indent=4)

print("Prompt Library erfolgreich in prompt_library.json gespeichert.")

3. Prompt-Design und Kategorisierung

Sobald die Struktur steht, geht es an das Hinzufügen der Prompts. Sie können eigene Prompts schreiben, die Sie im Laufe der Zeit entwickelt und optimiert haben, oder Inspiration aus öffentlichen Bibliotheken und bestehenden Projekten sammeln. Wichtig ist, jeden Prompt so zu gestalten, dass er präzise, klar und umfassend ist. Nutzen Sie Tags und Kategorien, um die spätere Suche und Filterung zu erleichtern.

- Präzise formulieren: Vermeiden Sie vage Formulierungen. Je spezifischer der Prompt, desto besser die Ausgabe.

- Kontext geben: Stellen Sie alle notwendigen Hintergrundinformationen bereit, die die KI benötigt.

- Format definieren: Geben Sie an, in welchem Format die Antwort erwartet wird (z.B. „als Liste“, „im Markdown-Format“, „als Python-Codeblock“).

- Constraint auferlegen: Setzen Sie Limits für Länge, Stil oder die Verwendung bestimmter Begriffe.

- Iterieren und verfeinern: Selten ist der erste Prompt perfekt. Testen Sie, passen Sie an und verbessern Sie Ihre Prompts kontinuierlich.

4. Wartung und Evolution

Eine Prompt Library ist kein statisches Archiv, sondern ein lebendiges Werkzeug. KI-Modelle entwickeln sich ständig weiter, und damit auch die besten Praktiken für Prompts. Überprüfen Sie regelmäßig Ihre Sammlung, aktualisieren Sie veraltete Prompts, fügen Sie neue hinzu und entfernen Sie solche, die nicht mehr relevant sind. Eine gepflegte Bibliothek bleibt eine wertvolle Ressource, die die Qualität von KI-Ergebnissen nachhaltig sichert.

„Ein gut formulierter Prompt ist der Schlüssel, der die Türen zu den unendlichen Möglichkeiten der generativen KI aufschließt.“

Zukunft der KI-Interaktion und die Rolle von Prompt Libraries

Die KI-Promptbibliothek hat sich als unverzichtbares Werkzeug für jeden etabliert, der generative KI professionell nutzt. Sie transformiert den Prozess der KI-Interaktion von einem mühsamen Trial-and-Error-Verfahren in eine strukturierte, effiziente und reproduzierbare Aufgabe. Durch die Zentralisierung von optimierten Anweisungen sparen Prompt-Ingenieure wertvolle Zeit, erhöhen die Konsistenz der Ergebnisse und können das volle Potenzial von Modellen wie ChatGPT, DALL-E und MidJourney ausschöpfen. Ob für die schnelle Codeerzeugung KI oder die Erstellung kreativer Marketingtexte – eine gut geführte Bibliothek ist eine wahre Fundgrube für Innovation.

Es gibt bereits zahlreiche öffentliche Plattformen, die einen reichen Katalog an Prompts bieten und als Inspiration dienen können. Doch die wahre Meisterschaft im Umgang mit KI zeigt sich oft in der Fähigkeit, eine eigene, maßgeschneiderte Bibliothek zu entwickeln und zu pflegen, die perfekt auf individuelle Bedürfnisse und Projekte zugeschnitten ist. Diese personalisierten Sammlungen bieten ein Höchstmaß an Kontrolle und Effizienz. Die kontinuierliche Verbesserung und Anpassung von Prompts an die sich schnell entwickelnde KI-Landschaft wird auch in Zukunft eine zentrale Rolle spielen. Bleiben Sie am Ball, experimentieren Sie und nutzen Sie die Macht einer gut organisierten Prompt Library, um Ihre KI-gestützte Texterstellung oder andere kreative Aufgaben zu optimieren. Machen Sie sich bereit, die Zukunft der Mensch-KI-Kollaboration aktiv mitzugestalten.

Die Idee einer KI-Promptbibliothek ist absolut entscheidend für die effiziente Nutzung generativer KI, keine Frage. Aber als „Produktvorstellung“ bleibt der Artikel noch zu sehr an der Oberfläche dessen, was wirklich benötigt wird.

Es wäre aber noch besser, wenn es eine *tiefgreifende Versionierung* der Prompts gäbe. Wie soll ich sonst nachvollziehen, welche Iteration zu welchem Ergebnis führte? Was wirklich fehlt, ist eine Funktion, die nicht nur den Prompt speichert, sondern auch das *verwendete KI-Modell*, die genauen Parameter und vor allem das *erzielte Ergebnis* – idealerweise sogar mit einer visuellen Vorschau bei Bild-Prompts, die direkt mit dem Prompt verknüpft ist.

Was wirklich fehlt, ist zudem ein integriertes *Performance-Tracking* und A/B-Testing. Es reicht nicht, Prompts nur zu sammeln; ich muss wissen, welcher Prompt unter welchen Bedingungen die besten Ergebnisse liefert. Eine Funktion, die verschiedene Prompt-Varianten gegeneinander antreten lässt und Erfolgsquoten misst, wäre revolutionär und ein echter Game-Changer.

Es wäre aber noch besser, wenn es nahtlose *Kollaborationsfunktionen* gäbe. Teams müssen Prompts gemeinsam entwickeln, teilen und iterieren können. Eine integrierte Kommentarfunktion, granulare Zugriffsrechte und die Möglichkeit, Prompts privat oder öffentlich zu teilen, sind unerlässlich.

Und um wirklich „auf ein neues Niveau“ zu heben: Was wirklich fehlt, ist eine *KI-gestützte Suggestion Engine* für die Prompt-Optimierung. Nachdem ich einen Prompt eingegeben und ein Ergebnis erhalten habe, sollte die Bibliothek Vorschläge machen können, wie ich den Prompt verbessern könnte – basierend auf Best Practices, meinen bisherigen Erfolgen und Misserfolgen sowie dem spezifischen KI-Modell. Das wäre nicht nur eine Bibliothek, sondern ein aktiver Prompt-Coach! Eine direkte Integration in gängige KI-Tools über ein API wäre natürlich auch ein Muss, um Prompts direkt im Workflow nutzen zu können.

Vielen dank für ihre ausführlichen und sehr wertvollen anregungen. es ist absolut richtig, dass eine reine sammlung von prompts nur der erste schritt ist. die von ihnen genannten punkte wie tiefgreifende versionierung, das speichern von modellparametern und ergebnissen sowie performance-tracking und kollaborationsfunktionen sind essenziell, um eine prompt-bibliothek wirklich zu einem mächtigen werkzeug zu machen. besonders die idee einer ki-gestützten suggestion engine als prompt-coach finde ich faszinierend und sie würde den nutzen immens steigern.

ihre gedanken zeigen, wie viel potenzial noch in diesem bereich steckt und geben uns wichtige impulse für die weiterentwicklung solcher konzepte. ich danke ihnen für diese konstruktive kritik und hoffe, dass sie auch weiterhin meine anderen artikel in meinem profil oder meine weiteren veröffentlichungen lesen werden.

Eine „KI-Promptbibliothek“? Ernsthaft? Da sammelt man also effektive Befehle, um sie wiederzuverwenden und zu optimieren. Gähn. Das ist doch exakt dasselbe Prinzip, das wir seit Ewigkeiten mit Code-Snippets, Makros oder sogar einfachen Vorlagen in jeder Software anwenden. Nur weil jetzt „KI“ davor steht, ist es noch lange keine Revolution. Nichts als alter Wein in neuen Schläuchen, wie immer.

Ich verstehe ihre skepsis und den vergleich mit etablierten methoden wie code-snippets oder makros. in der tat mag das grundprinzip des wiederverwendens und optimierens von befehlen vertraut erscheinen. der reiz einer ki-promptbibliothek liegt jedoch nicht nur im sammeln, sondern in der spezifischen anpassung und verfeinerung für die interaktion mit generativen ki-modellen, deren verständnis und reaktion oft nuancierter sind als bei herkömmlichen software-vorlagen. die komplexität der sprache und die vielzahl möglicher ausgaben erfordern eine andere art der kuratierung und des experimentierens, um wirklich effektive ergebnisse zu erzielen.

vielen dank für ihren wertvollen beitrag, der eine wichtige perspektive auf die entwicklung im bereich der ki-anwendungen beleuchtet. ich lade sie herzlich ein, auch meine anderen artikel in meinem profil oder meine weiteren veröffentlichungen anzusehen, um weitere gedanken und diskussionen zu diesem und ähnlichen themen zu finden.