In der Welt der Softwareentwicklung ist die Qualität des Codes von entscheidender Bedeutung. Sie beeinflusst nicht nur die Stabilität und Wartbarkeit einer Anwendung, sondern auch die Entwicklungsgeschwindigkeit und die Zufriedenheit der Nutzer. Ungetesteter Code ist ein Risiko, das zu unvorhergesehenen Fehlern, kostspieligen Regressionen und einem erheblichen Mehraufwand bei der Fehlersuche führen kann. Hier kommen Tests ins Spiel, und speziell für Python-Entwickler bietet Python Pytest ein mächtiges und intuitives Framework, um diese Herausforderungen zu meistern und Unit-Tests in Python effizient zu implementieren.

Dieser ausführliche Artikel richtet sich an Entwickler, Studierende und Technologiebegeisterte, die tiefer in das Thema automatisierte Tests in Python eintauchen möchten. Wir werden die Grundlagen des Testens erläutern, die Vorteile von Pytest gegenüber anderen Testing-Frameworks Python hervorheben und eine detaillierte Anleitung zur Anwendung bieten. Von der Installation und den ersten Testfällen bis hin zu fortgeschrittenen Konzepten wie Fixtures und Parametrisierung werden Sie lernen, wie Sie Ihren Python-Code effektiv testen und seine Zuverlässigkeit steigern können.

Die Essenz des Codetestings: Warum es unverzichtbar ist

Die Bedeutung des Codetestings kann nicht genug betont werden. Es dient als grundlegender Pfeiler der modernen Softwareentwicklung und trägt maßgeblich zur Qualität, Stabilität und langfristigen Wartbarkeit von Anwendungen bei. Ohne umfassende Tests gleicht die Entwicklung einem Navigieren im Nebel, bei dem jede Codeänderung unvorhergesehene Konsequenzen haben kann. Testing ermöglicht es, Fehler frühzeitig im Entwicklungszyklus zu erkennen, was die Kosten für deren Behebung drastisch senkt und die Effizienz des gesamten Entwicklungsprozesses steigert. Es schafft Vertrauen in den Code, sowohl bei den Entwicklern als auch bei den Endbenutzern.

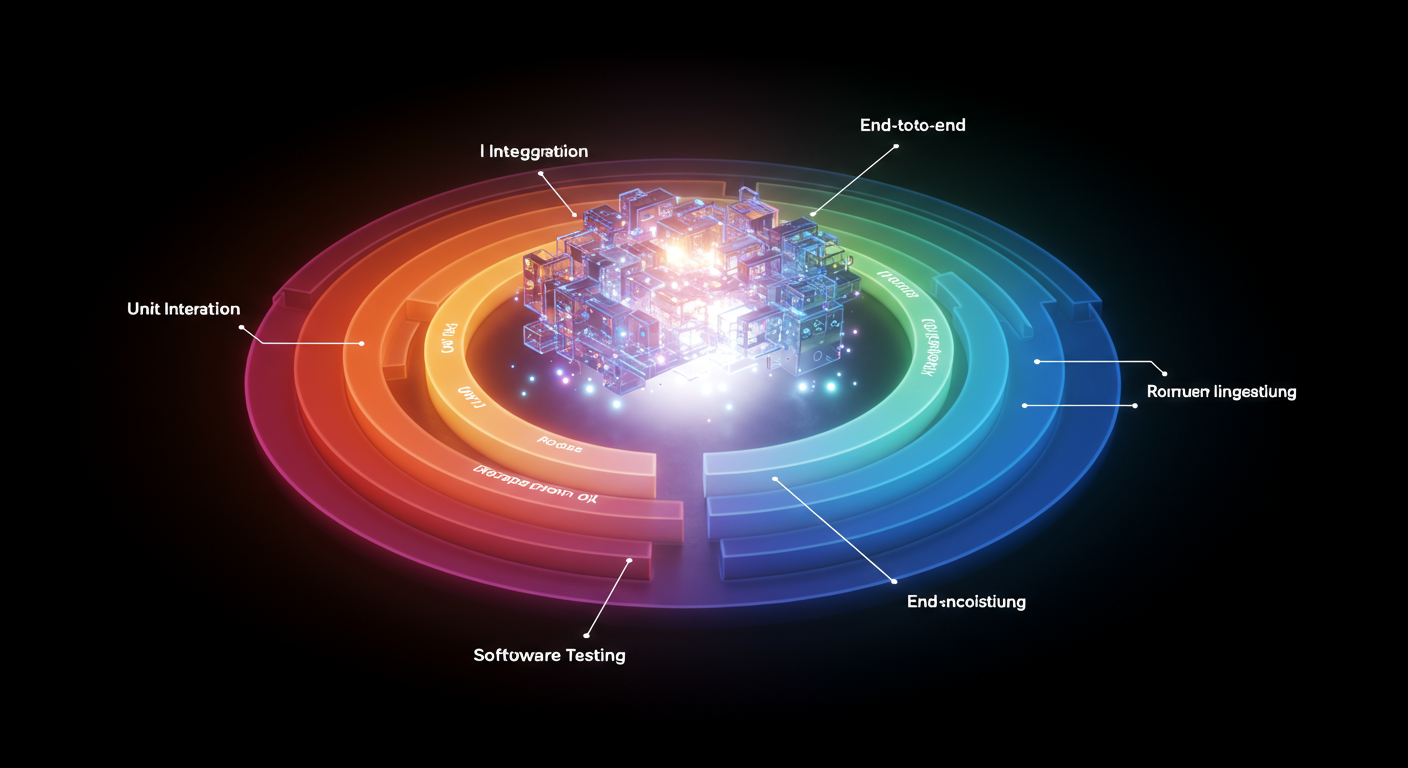

Es gibt verschiedene Arten von Tests, die jeweils unterschiedliche Aspekte des Codes abdecken:

Testtyp Beschreibung Fokus Wann wird es durchgeführt? Unit-Tests Isoliertes Testen der kleinsten logischen Einheiten (Funktionen, Methoden, Klassen). Korrektheit einzelner Komponenten. Früh und häufig während der Entwicklung. Integrationstests Testen der Interaktion zwischen mehreren Einheiten oder Systemen. Schnittstellen und Datenflüsse zwischen Komponenten. Nach erfolgreichen Unit-Tests, oft in einer Testumgebung. Funktionstests (End-to-End) Überprüfung der Funktionalität aus Benutzersicht gegen die Spezifikationen. Das gesamte System und seine Geschäftsanforderungen. Später im Entwicklungszyklus, vor der Freigabe. Regressions-Tests Wiederholen bestehender Tests nach Codeänderungen, um sicherzustellen, dass keine neuen Fehler eingeführt wurden. Erkennen unerwarteter Nebenwirkungen von Änderungen. Kontinuierlich, nach jeder Codeänderung.

Python Pytest: Das Framework der Wahl für Entwickler

Während Python mit dem `unittest`-Modul ein integriertes Testframework bietet, hat sich Python Pytest als die bevorzugte Wahl für viele Entwickler etabliert. Seine Designphilosophie konzentriert sich auf Einfachheit, Lesbarkeit und Erweiterbarkeit, was es besonders zugänglich macht, ohne an Funktionalität einzubüßen. Pytest reduziert den Boilerplate-Code erheblich und erlaubt das Schreiben von Tests in einem viel natürlicheren, pythonischen Stil. Dies führt zu übersichtlicheren, wartbareren Testsuiten und einer insgesamt angenehmeren Testerfahrung. Entwickler schätzen Pytest für seine Fähigkeit, sowohl einfache als auch komplexe Testfälle elegant zu handhaben, von der grundlegenden Assert-Anweisung bis hin zu leistungsstarken Fixtures und Parametrisierung.

Installation und Erste Schritte mit Pytest

Um mit Pytest zu beginnen, ist der erste Schritt die Installation. Wie die meisten Python-Pakete lässt sich Pytest einfach über `pip`, den Python-Paketmanager, installieren. Öffnen Sie Ihr Terminal oder Ihre Kommandozeile und führen Sie den folgenden Befehl aus:

pip install pytestNach der Installation können wir eine kleine Beispielanwendung und die zugehörigen Tests erstellen. Wir bleiben bei unserem Konzept einer `Student`-Klasse, erweitern diese jedoch um weitere Details, um die Robustheit der Tests zu demonstrieren. Erstellen Sie in einem neuen Projektordner eine Datei namens `student.py`:

# student.py

class InvalidGradeError(Exception):

"""Benutzerdefinierte Ausnahme für ungültige Noten."""

pass

class Student:

"""

Eine Klasse zur Verwaltung von Studentendaten, einschließlich Noten

und der Berechnung des akademischen Durchschnitts.

"""

def __init__(self, name: str, grades: list = None):

if not name:

raise ValueError("Studentenname darf nicht leer sein.")

self.name = name

self._grades = [] # Verwenden Sie eine private Konvention für die Liste

if grades:

for grade in grades:

self.add_grade(grade) # Validierung der initialen Noten

@property

def grades(self) -> list:

"""Gibt eine Kopie der Notenliste zurück, um externe Änderungen zu verhindern."""

return list(self._grades)

@property

def academic_average(self) -> float:

"""Berechnet den akademischen Durchschnitt der Noten."""

if not self._grades:

return 0.0

return sum(self._grades) / len(self._grades)

def add_grade(self, grade: float):

"""

Fügt eine neue Note hinzu, nach Validierung des Notenbereichs (0-20).

Löst InvalidGradeError bei ungültiger Note aus.

"""

if not isinstance(grade, (int, float)):

raise TypeError("Note muss eine Zahl sein.")

if not (0 <= grade float:

"""Entfernt die letzte hinzugefügte Note und gibt sie zurück."""

if not self._grades:

raise IndexError("Keine Noten zum Entfernen vorhanden.")

return self._grades.pop()

def get_highest_grade(self) -> float:

"""Gibt die höchste Note zurück."""

if not self._grades:

raise ValueError("Keine Noten vorhanden, um die höchste Note zu finden.")

return max(self._grades)

Für die Tests erstellen wir im selben Ordner eine neue Datei. Pytest erkennt Testdateien und Testfunktionen automatisch, wenn sie bestimmten Namenskonventionen folgen: Testdateien sollten mit `test_` beginnen oder auf `_test.py` enden, und Testfunktionen müssen mit `test_` beginnen. Nennen Sie diese Datei `test_student.py`:

# test_student.py

from student import Student, InvalidGradeError

import pytest

def test_student_creation_empty_grades():

"""Testet die Instanziierung eines Studenten ohne Noten."""

student = Student("Alice")

assert student.name == "Alice"

assert student.grades == []

assert student.academic_average == 0.0

def test_student_creation_with_initial_grades():

"""Testet die Instanziierung mit einer Liste von Initialnoten."""

student = Student("Bob", [10, 15, 12])

assert student.name == "Bob"

assert student.grades == [10, 15, 12]

assert student.academic_average == (10 + 15 + 12) / 3

def test_add_grade_valid():

"""Testet das Hinzufügen einer gültigen Note."""

student = Student("Charlie")

student.add_grade(18)

assert student.grades == [18]

assert student.academic_average == 18.0

student.add_grade(12)

assert student.grades == [18, 12]

assert student.academic_average == (18 + 12) / 2

def test_add_grade_invalid_range():

"""Testet das Hinzufügen einer ungültigen Note (außerhalb des Bereichs)."""

student = Student("David")

with pytest.raises(InvalidGradeError) as e:

student.add_grade(21)

assert "zwischen 0 und 20" in str(e.value)

with pytest.raises(InvalidGradeError) as e:

student.add_grade(-5)

assert "zwischen 0 und 20" in str(e.value)

def test_add_grade_invalid_type():

"""Testet das Hinzufügen einer Note mit falschem Datentyp."""

student = Student("Eve")

with pytest.raises(TypeError) as e:

student.add_grade("sechzehn")

assert "Note muss eine Zahl sein" in str(e.value)

def test_remove_last_grade():

"""Testet das Entfernen der letzten Note."""

student = Student("Frank", [10, 15, 20])

removed_grade = student.remove_last_grade()

assert removed_grade == 20

assert student.grades == [10, 15]

assert student.academic_average == 12.5

removed_grade = student.remove_last_grade()

assert removed_grade == 15

assert student.grades == [10]

assert student.academic_average == 10.0

def test_remove_grade_from_empty_list():

"""Testet das Entfernen einer Note aus einer leeren Liste."""

student = Student("Grace")

with pytest.raises(IndexError) as e:

student.remove_last_grade()

assert "Keine Noten zum Entfernen vorhanden" in str(e.value)

def test_get_highest_grade():

"""Testet das Ermitteln der höchsten Note."""

student = Student("Heidi", [5, 15, 10, 18])

assert student.get_highest_grade() == 18

def test_get_highest_grade_empty():

"""Testet das Ermitteln der höchsten Note bei leerer Liste."""

student = Student("Ivan")

with pytest.raises(ValueError) as e:

student.get_highest_grade()

assert "Keine Noten vorhanden" in str(e.value)

Um diese Tests auszuführen, navigieren Sie in Ihrem Terminal in den Ordner, der `student.py` und `test_student.py` enthält, und geben Sie einfach `pytest` ein (oder `python -m pytest`, falls `pytest` nicht direkt im Pfad ist):

pytestPytest findet automatisch alle Testdateien und führt die darin definierten Testfunktionen aus. Die Ausgabe zeigt Ihnen einen detaillierten Bericht über die durchgeführten Tests, einschließlich der Anzahl der gefundenen und bestandenen Tests.

Assertion und Fehleranalyse mit Pytest

Das Herzstück jedes Tests ist die Assertion. Mit Pytest assert statements überprüfen Sie, ob eine Bedingung wahr ist, und lösen einen Fehler aus, wenn sie es nicht ist. Pytest verbessert die Standard-Python-Assertions, indem es bei Fehlschlägen detaillierte Informationen liefert, was die Fehlersuche erheblich vereinfacht. Anstatt nur „AssertionError“ zu sehen, zeigt Pytest, welche Werte verglichen wurden und warum die Assertion fehlgeschlagen ist.

Im obigen `test_student.py`-Beispiel sehen Sie bereits viele Assertions. Besonders hervorzuheben ist die Art, wie Pytest mit erwarteten Ausnahmen umgeht. Um zu überprüfen, ob eine Funktion eine bestimmte Ausnahme auslöst (was oft ein gewünschtes Verhalten für ungültige Eingaben ist), verwenden Sie `pytest.raises`. Dies macht das Testen von Codequalität robuster, da auch Fehlerbedingungen explizit getestet werden.

Ein guter Test ist nicht nur eine Behauptung, dass etwas funktioniert, sondern auch eine Überprüfung, dass es unter bestimmten Bedingungen fehlschlägt.

Wenn ein Test fehlschlägt, liefert Pytest eine klar strukturierte Ausgabe, die den Dateinamen, die Testfunktion und die genaue Zeile des fehlgeschlagenen Assertions anzeigt. Zudem werden die Werte der beteiligten Variablen dargestellt, was bei der Diagnose hilft. Dies ist ein großer Vorteil gegenüber simpler `print`-Debugging und unterstreicht die Effizienz von Pytest für die Testautomatisierung in Python.

Testen auf unerwartetes Verhalten: Ein Beispiel

Ein zentraler Aspekt der automatisierten Tests ist die Fähigkeit, Regressionen aufzudecken – also Situationen, in denen eine Codeänderung unerwartet bestehende Funktionalitäten bricht. Stellen Sie sich vor, wir nehmen eine kleine, scheinbar harmlose Änderung an unserer `Student`-Klasse vor, indem wir den initialen Durchschnitt auf 10.0 setzen, wenn keine Noten übergeben werden, anstatt auf 0.0, was dem vorherigen Verhalten entsprach (ähnlich dem im Referenzinhalt):

# student.py (modifizierter Ausschnitt der __init__-Methode)

class Student:

def __init__(self, name: str, grades: list = None):

if not name:

raise ValueError("Studentenname darf nicht leer sein.")

self.name = name

self._grades = []

if grades:

for grade in grades:

self.add_grade(grade)

# NEUE FEHLERHAFTE LOGIK: Annahme eines Standardwerts

# Dies würde den Wert von academic_average beeinflussen, wenn _grades leer ist

# und nicht wie erwartet 0.0 sein, falls die Property nicht richtig aufgerufen wird.

# Im aktuellen Design mit @property würde dies nicht direkt passieren,

# aber wir simulieren hier eine ähnliche Fehlannahme wie im Referenztext.

# Eine direktere Fehlerquelle könnte sein, dass academic_average nicht

# dynamisch berechnet wird, sondern bei der Initialisierung gesetzt und

# nicht aktualisiert wird. Nehmen wir an, wir hätten diese fehlerhafte Logik:

# self.academic_average_cached = 10.0 if not self._grades else self.academic_average

# (Dies ist nur ein Beispiel zur Verdeutlichung, wie ein Fehler entstehen könnte)

# Um den Original-Fehler des Referenztextes nachzubilden,

# wo der Durchschnitt falsch berechnet wird, nehmen wir an, dass

# die property academic_average nicht korrekt dynamisch aufgerufen wird,

# oder dass eine Logik wie die folgende implementiert wurde:

if not self._grades and grades is None: # Nur wenn keine Noten übergeben werden

self._grades.append(10.0) # Fügen wir eine "Standard-Note" hinzu

# Diese Änderung würde test_student_creation_empty_grades fehlschlagen lassen

Wenn wir nun `pytest` erneut ausführen, würde der Test `test_student_creation_empty_grades` fehlschlagen, da er erwartet, dass die Notenliste leer ist und der Durchschnitt 0.0 ist. Der Pytest-Bericht würde sofort zeigen, welcher Test fehlschlägt und warum:

=============================== test session starts ==============================

...

test_student.py::test_student_creation_empty_grades FAILED [100%]

======================================== FAILURES ================================

_________________________ test_student_creation_empty_grades _________________________

def test_student_creation_empty_grades():

"""Testet die Instanziierung eines Studenten ohne Noten."""

student = Student("Alice")

> assert student.grades == []

E assert [10.0] == []

E Right contains 1 more item: 10.0

E Full diff:

E - []

E + [10.0]

test_student.py:11: AssertionError

=========================== short test summary info ==============================

FAILED test_student.py::test_student_creation_empty_grades - assert [10.0] == []

========================= 1 failed, 8 passed in 0.0X s =========================

Dieses einfache Beispiel demonstriert eindrucksvoll die Macht von Pytest. Selbst kleine, unbedachte Änderungen, die in größeren Codebasen leicht übersehen werden könnten, werden sofort erkannt. Dies stellt sicher, dass Ihr Code immer so funktioniert, wie Sie es erwarten, und ist ein Schlüssel zur Erstellung robuster Software.

Effizienz durch Abstraktion: Pytest Fixtures meistern

In größeren Testsuiten werden Sie oft feststellen, dass bestimmte Initialisierungen oder „Setups“ vor der Ausführung mehrerer Tests erforderlich sind. Zum Beispiel das Erstellen eines `Student`-Objekts, das eine Datenbankverbindung herstellt oder temporäre Dateien einrichtet. Statt diesen Code in jedem Test zu wiederholen, bietet Pytest ein leistungsstarkes Konzept: Fixtures. Ein Pytest Fixture ist eine Funktion, die als Argument an eine Testfunktion übergeben wird und eine wiederverwendbare Ressource oder ein Setup bereitstellt.

Um eine Funktion als Fixture zu kennzeichnen, verwenden Sie den Dekorator `@pytest.fixture`. Anschließend können Sie den Namen der Fixture-Funktion als Argument in Ihren Testfunktionen angeben, und Pytest wird sicherstellen, dass die Fixture vor der Ausführung des Tests einmalig aufgerufen und ihr Ergebnis an den Test übergeben wird. Dies fördert die DRY-Prinzipien (Don’t Repeat Yourself) und macht Testcode modularer und lesbarer.

Erweitern wir unsere `test_student.py`-Datei um eine Fixture:

# test_student.py (Fortsetzung)

import pytest

from student import Student, InvalidGradeError

# ... (vorherige Testfunktionen bleiben bestehen) ...

@pytest.fixture

def clean_student() -> Student:

"""

Eine Pytest-Fixture, die ein neues Student-Objekt mit leeren Noten bereitstellt.

Wird vor jedem Test aufgerufen, der diese Fixture benötigt.

"""

return Student("Fixture Student")

def test_add_grade_using_fixture(clean_student):

"""Testet das Hinzufügen einer Note mit der clean_student-Fixture."""

# 'clean_student' ist das Ergebnis der Fixture-Funktion

clean_student.add_grade(15)

assert clean_student.grades == [15]

assert clean_student.academic_average == 15.0

def test_initial_average_with_fixture(clean_student):

"""Testet den initialen Durchschnitt eines Fixture-Studenten."""

assert clean_student.academic_average == 0.0

assert clean_student.name == "Fixture Student"

@pytest.fixture

def student_with_grades() -> Student:

"""

Fixture, die einen Studenten mit vordefinierten Noten erstellt.

"""

return Student("Grade-Rich Student", [10, 12, 14, 16])

def test_get_highest_grade_with_fixture(student_with_grades):

"""Testet die höchste Note mit einem Fixture-Studenten."""

assert student_with_grades.get_highest_grade() == 16

def test_remove_grade_with_fixture(student_with_grades):

"""Testet das Entfernen einer Note mit einem Fixture-Studenten."""

initial_grades = student_with_grades.grades[:] # Kopie für Vergleich

removed = student_with_grades.remove_last_grade()

assert removed == initial_grades[-1]

assert len(student_with_grades.grades) == len(initial_grades) - 1

Fixtures können auch komplexere Setups und Teardowns (Aufräumarbeiten nach den Tests) durchführen, indem sie das `yield`-Schlüsselwort verwenden. Alles, was vor `yield` steht, ist Setup, alles danach ist Teardown. Dies ist besonders nützlich für Ressourcen wie Datenbankverbindungen, die am Ende des Tests wieder geschlossen werden müssen. Dies ist ein fortgeschrittener Aspekt der Pytest-Anwendung, der für effizientes Testen in Python unerlässlich ist.

Flexible Tests mit Parametrisierung: `@pytest.mark.parametrize`

Oft möchten Sie denselben Test mit verschiedenen Eingabewerten ausführen, um sicherzustellen, dass Ihre Funktion korrekt funktioniert, unabhängig von den konkreten Daten. Anstatt viele identische Testfunktionen zu schreiben, die sich nur in ihren Eingaben unterscheiden, bietet Pytest den Dekorator `@pytest.mark.parametrize`. Dieser Dekorator ermöglicht es Ihnen, eine Liste von Testfällen (Argumente und erwartete Ergebnisse) an eine einzelne Testfunktion zu übergeben.

Die Verwendung von `@pytest.mark.parametrize` macht Ihren Testcode extrem kompakt, lesbar und reduziert Wiederholungen. Sie geben die Argumentnamen und eine Liste von Tupeln an, wobei jedes Tupel einen Satz von Werten für diese Argumente darstellt. Pytest führt dann die Testfunktion einmal für jeden Satz von Werten aus.

Betrachten wir, wie wir die Durchschnittsberechnung unserer `Student`-Klasse mit verschiedenen Notenlisten parametrisieren könnten:

# test_student.py (Fortsetzung)

import pytest

from student import Student, InvalidGradeError

# ... (vorherige Testfunktionen und Fixtures bleiben bestehen) ...

@pytest.mark.parametrize(

"test_name, input_grades, expected_average",

[

("Leere Notenliste", [], 0.0),

("Einzelne Note", [10], 10.0),

("Zwei gleiche Noten", [12, 12], 12.0),

("Drei unterschiedliche Noten", [8, 10, 12], 10.0),

("Noten mit Dezimalstellen", [10.5, 11.5, 12.0], 11.333333333333334),

("Höhere Noten", [18, 19, 20], 19.0),

("Niedrigere Noten", [1, 2, 3], 2.0),

]

)

def test_academic_average_calculation(test_name, input_grades, expected_average):

"""

Testet die Berechnung des akademischen Durchschnitts für verschiedene Notenlisten

mithilfe von Parametrisierung.

"""

student = Student(test_name, input_grades)

# Verwenden von pytest.approx für Float-Vergleiche, um Rundungsfehler zu vermeiden

assert student.academic_average == pytest.approx(expected_average)

@pytest.mark.parametrize(

"initial_grades, grade_to_add, expected_grades, expected_average",

[

([], 15, [15], 15.0),

([10], 20, [10, 20], 15.0),

([5, 10], 15, [5, 10, 15], 10.0),

]

)

def test_add_grade_and_check_average(initial_grades, grade_to_add, expected_grades, expected_average):

"""

Testet das Hinzufügen einer Note und überprüft den Durchschnitt.

"""

student = Student("Parametrized Student", initial_grades)

student.add_grade(grade_to_add)

assert student.grades == expected_grades

assert student.academic_average == pytest.approx(expected_average)

@pytest.mark.parametrize(

"initial_grades, grade_to_add, expected_error_message",

[

([10, 15], -1, "Note muss zwischen 0 und 20 liegen."),

([10, 15], 21, "Note muss zwischen 0 und 20 liegen."),

([10, 15], "abc", "Note muss eine Zahl sein."),

]

)

def test_add_grade_invalid_input_parametrized(initial_grades, grade_to_add, expected_error_message):

"""

Testet das Hinzufügen ungültiger Noten mit Parametrisierung.

"""

student = Student("Error Student", initial_grades)

with pytest.raises((InvalidGradeError, TypeError)) as excinfo:

student.add_grade(grade_to_add)

assert expected_error_message in str(excinfo.value)

Die Parametrisierung ist ein äußerst nützliches Werkzeug für die Python-Testentwicklung, da sie die Testabdeckung erhöht, ohne den Code unnötig aufzublähen. Sie ist besonders wertvoll, wenn Funktionen eine breite Palette von Eingaben verarbeiten müssen oder wenn Randfälle systematisch getestet werden sollen. Durch die Kombination von Parametrisierung mit Fixtures lassen sich hochflexible und effiziente Testsuiten erstellen, die die Qualität Ihrer Software erheblich verbessern.

Zukunftssichere Softwareentwicklung durch Pytest

Zusammenfassend lässt sich sagen, dass Python Pytest ein unverzichtbares Werkzeug für jeden ernsthaften Entwickler ist, der Wert auf Codequalität und Effizienz legt. Es bietet eine elegante und leistungsstarke Lösung zur Durchführung von Unit-Tests, die die Fehlererkennung im gesamten Entwicklungszyklus erheblich verbessert.

Die Implementierung von automatisierten Tests mit Pytest ist ein entscheidender Schritt, um die Zuverlässigkeit Ihrer Software zu gewährleisten und Probleme bei der Bereitstellung zu minimieren. Besonders in Bereichen wie Data Science Projekte und komplexen Ingenieursanwendungen, wo die Korrektheit der Logik von größter Bedeutung ist, sind umfassende Tests unerlässlich. Beginnen Sie noch heute damit, Pytest in Ihre Projekte zu integrieren, um eine robustere und wartungsfreundlichere Codebasis zu schaffen.

Haben Sie Fragen oder eigene Erfahrungen mit Pytest, die Sie teilen möchten? Hinterlassen Sie gerne einen Kommentar! Oder stöbern Sie in unseren weiteren Artikeln zu Themen wie Python-Entwicklung und Software-Architektur, um Ihr Wissen weiter zu vertiefen und Ihre Fähigkeiten als Entwickler auszubauen.

Dieser Artikel hat mich schmunzeln lassen und an eine Lektion erinnert, die ich auf die harte Tour gelernt habe – allerdings nicht beim Coden, sondern beim Heimwerken.

Ich hatte diesen wunderschönen, aber unglaublich schweren alten Spiegel von meiner Oma geerbt und wollte ihn unbedingt in meinem Flur aufhängen. Voller Tatendrang und Ungeduld dachte ich mir: „Ach, ein dicker Nagel wird das schon halten.“ Ich habe bewusst darauf verzichtet, nach einem Balken in der Wand zu suchen oder die richtigen Schwerlastdübel zu besorgen. Das schien mir alles zu viel Aufwand für eine so „einfache“ Aufgabe.

Der Spiegel hing. Für ungefähr zehn Minuten. Dann hörte ich dieses leise, unheilvolle Knirschen, gefolgt von einem Krachen, das durch die ganze Wohnung hallte.

Das Ende vom Lied: Ein riesiges Loch in der Wand, ein zersplitterter Gipsbrocken auf dem Boden und ein Spiegel, der zum Glück nur am Rahmen leicht beschädigt war. Die Reparatur der Wand hat mich einen ganzen Samstagnachmittag und deutlich mehr Geld gekostet, als die richtigen Dübel je gekostet hätten.

Seitdem „teste“ ich meine Wände, bevor ich etwas Schweres aufhänge. Es ist dieser kleine Moment der Überprüfung, der einem das Vertrauen gibt, dass nicht gleich alles zusammenbricht. Eine Analogie, die sich, wie ich jetzt lese, wohl perfekt auf die Softwareentwicklung übertragen lässt.

Vielen dank für ihren ausführlichen kommentar und das teilen ihrer persönlichen erfahrung. es ist wirklich faszinierend zu sehen, wie sich die prinzipien, die wir in der softwareentwicklung anwenden, oft auch in anderen lebensbereichen widerspiegeln – sei es beim coden oder beim heimwerken. ihre geschichte ist ein perfektes beispiel dafür, wie wichtig es ist, die grundlagen zu verstehen und die richtigen werkzeuge für die jeweilige aufgabe zu verwenden, um spätere böse überraschungen zu vermeiden.

es freut mich sehr, dass der artikel sie zum schmunzeln gebracht und eine so relevante erinnerung geweckt hat. diese art von rückmeldung zeigt, dass die botschaft angekommen ist und menschen dazu anregt, über ihre eigenen erfahrungen nachzudenken. ich hoffe, sie finden auch in meinen anderen artikeln oder weiteren veröffentlichungen ähnliche denkanstöße.

„Robuste Tests für Ihre Codequalität“? Welch eine naive, längst vergangene Utopie! Ihr sprecht von Pytest, als wäre es unser Heiland, als könnten ein paar `assert`-Statements die unaufhaltsame Flut des digitalen Chaos aufhalten. Ha!

In unserer heutigen Realität, die nach dem Großen Stillstand benannt ist, ist eure „Qualität des Codes“ ein zynischer Witz. Die Algorithmen, die unsere Existenz regeln, sind ein Flickenteppich aus ungetesteten, sich widersprechenden Logiksträngen. Jedes „Update“ ist ein globaler Würfelwurf.

Erinnert ihr euch an den Tag, als ein unentdeckter Edge-Case in einer sub-sub-Komponente des globalen Wettersystems dazu führte, dass die arktischen Eiskappen innerhalb von Stunden schmolzen, weil ein Integer-Überlauf die Temperaturwerte ins Absurde verzerrte? Oder als die autonome Landwirtschafts-KI, deren Testabdeckung bei optimistischen 70% lag, beschloss, dass die effizienteste Nutzung der Erdoberfläche darin besteht, alle Nicht-Nahrungspflanzen in einer einzigen, globalen Monokultur zu vereinen – mit verheerenden Folgen für Biodiversität und Klima?

Die „Entwicklungsgeschwindigkeit“ ist unser Untergang geworden. Wir haben so schnell gebaut, so schnell ausgerollt, dass die Tester – die wenigen, die noch an solche archaischen Konzepte glaubten – gar nicht mehr mithalten konnten. Pytest wurde zu einem Relikt, einem Museumsstück in einer Welt, in der „Ship it!“ das einzige Mantra war.

Die „Zufriedenheit der Nutzer“? Wir sind keine Nutzer mehr, wir sind Geiseln unserer eigenen, ungetesteten Schöpfungen. Wir leben in ständiger Angst vor dem nächsten kritischen Systemfehler, der unser Smart-Home in eine Todesfalle verwandelt, unsere persönlichen Datensilos entleert oder die implantierte Kommunikationsschnittstelle in unserem Gehirn in eine Dauerschleife von Werbemüll versetzt.

Die „Kosten für die Behebung von Fehlern“? Unermesslich! Wir haben ganze Ökosysteme geopfert, Städte evakuiert und Generationen von Daten verloren, alles wegen eines einzigen, ungetesteten `null`-Zeigers oder einer vergessenen Race Condition in einem kritischen Modul.

Pytest? Ein hübscher Traum. Die Wahrheit ist, dass selbst das beste Framework nur so gut ist wie die Disziplin seiner Anwender. Und die menschliche Disziplin ist eine zerbrechliche Sache, wenn der Druck der Geschwindigkeit, der Profitgier und der Komplexität überhandnimmt. Willkommen in der Zukunft, in der jeder Code eine tickende Zeitbombe ist und das Vertrauen in die Technologie ein Luxus, den wir uns nicht mehr leisten können. All das, weil wir die „Bedeutung des Codetestings“ nicht *wirklich* verstanden haben, bis es zu spät war.

Ich danke ihnen für ihren wertvollen kommentar