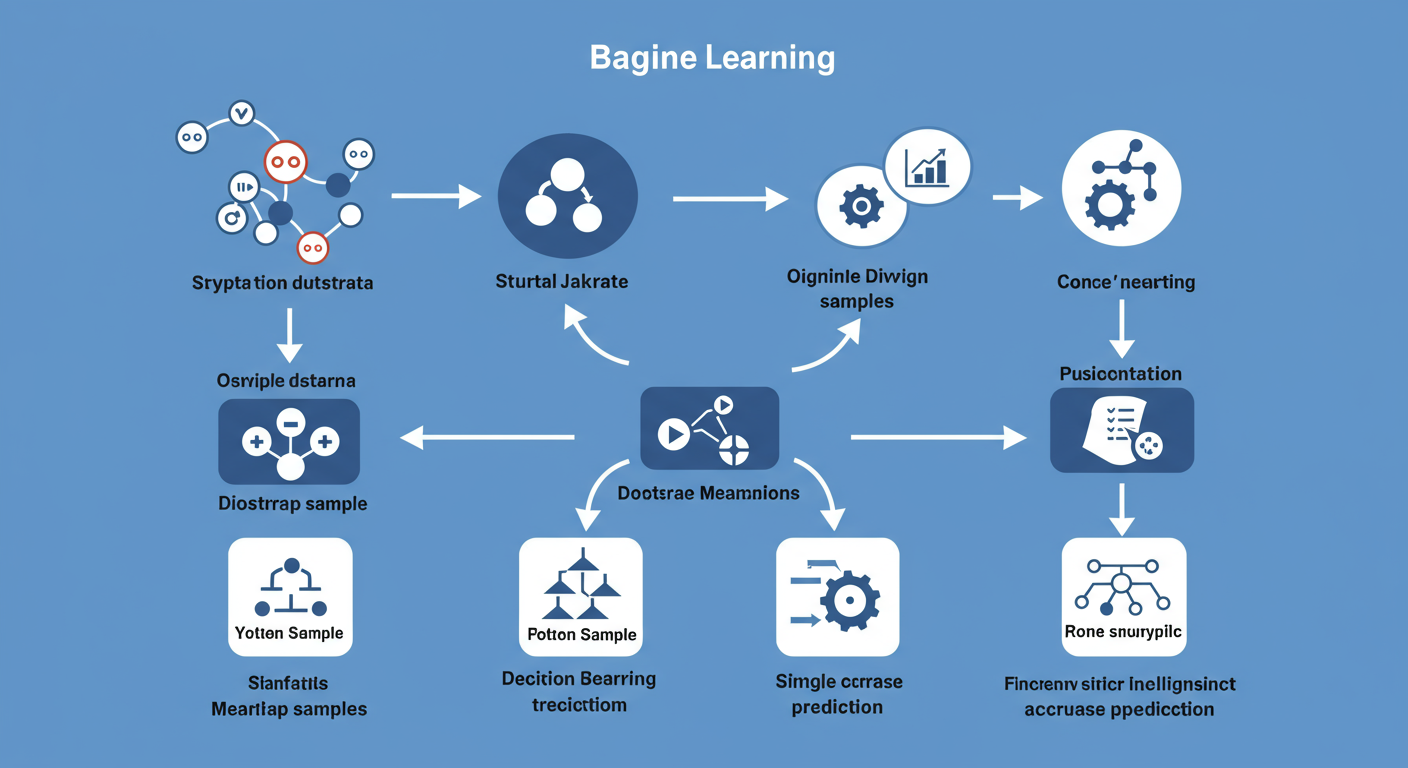

In der Welt des maschinellen Lernens streben wir stets nach Modellen, die nicht nur präzise Vorhersagen treffen, sondern auch robust gegenüber Schwankungen in den Daten sind. Eine herausragende Technik, die genau diese Eigenschaften fördert, ist Bagging im Machine Learning, kurz für „Bootstrap Aggregating“. Diese Methode gehört zu den mächtigen Ensemble-Methoden, bei denen die Weisheit vieler einfacher Modelle gebündelt wird, um eine überlegene Gesamtleistung zu erzielen. Für Entwickler, Data Scientists und Studierende, die tiefer in die Materie eintauchen möchten, ist das Verständnis von Bagging essenziell.

Dieser ausführliche Artikel beleuchtet die Kernkonzepte des Bagging, beginnend mit der fundamentalen Idee hinter Ensemble-Methoden. Wir werden den zentralen Mechanismus des Bootstrappings detailliert erörtern, der für die Erzeugung diverser Trainingsdatensätze unerlässlich ist. Anschließend werden wir uns den Strategien zur Datenaggregation widmen, die zur Finalisierung der Vorhersagen genutzt werden, und die signifikanten Vorteile von Bagging-Algorithmen, wie die Reduzierung der Varianz und die Korrektur von Fehlvorhersagen, herausarbeiten. Abschließend werfen wir einen Blick auf den berühmten Random Forest, einem Paradebeispiel für Bagging, und geben praktische Codebeispiele in Python, um die Konzepte greifbar zu machen.

Grundlagen von Bagging und Ensemble-Methoden

Im Kern des maschinellen Lernens steht oft die Suche nach dem besten Einzelmodell für eine bestimmte Aufgabe. Doch was, wenn wir die Stärken mehrerer Modelle kombinieren könnten, um ein noch leistungsfähigeres System zu schaffen? Genau hier setzen Ensemble-Methoden an. Sie basieren auf der Idee, dass eine Gruppe von „schwachen Lernern“ oder einfachen Modellen, die auf unterschiedliche Aspekte der Daten trainiert wurden, in Kombination einen „starken Lerner“ bilden kann, der präzisere und stabilere Vorhersagen liefert. Bagging, als eine dieser fundamentalen Ensemblemethoden, ist darauf ausgelegt, die Varianz von Vorhersagemodellen zu reduzieren und dadurch die Robustheit zu erhöhen.

Das Konzept „Gemeinsam sind wir stärker“ trifft auf Bootstrap aggregating vollkommen zu. Anstatt ein einziges komplexes Modell zu trainieren, das anfällig für Overfitting sein könnte, trainiert Bagging eine Vielzahl unabhängiger Modelle auf leicht unterschiedlichen Versionen des ursprünglichen Datensatzes. Die Herausforderung besteht darin, diese unterschiedlichen Datensätze so zu generieren, dass die Modelle zwar voneinander unabhängig sind, aber dennoch genügend Informationen aus der Gesamtstichprobe ziehen können, um aussagekräftige Vorhersagen zu treffen. Das resultierende aggregierte Modell profitiert von der Diversität der einzelnen Vorhersagen und ist in der Regel weniger anfällig für Rauschen in den Trainingsdaten.

Was ist Bootstrap Aggregating (Bagging)?

Bagging ist eine Meta-Algorithmus-Kategorie, die darauf abzielt, die Stabilität und Genauigkeit von Machine-Learning-Algorithmen zu verbessern. Es reduziert die Varianz und hilft, Overfitting zu vermeiden. Der Name selbst setzt sich aus „Bootstrap“ und „Aggregating“ zusammen, was die zwei Hauptschritte der Methode widerspiegelt:

- Bootstrap: Eine Resampling-Technik, bei der mehrere Teildatensätze durch Ziehen mit Zurücklegen aus dem ursprünglichen Trainingsdatensatz erstellt werden.

- Aggregating: Die Kombination der Vorhersagen dieser Teildatensätze (z.B. durch Mehrheitsentscheid bei Klassifikation oder Mittelwertbildung bei Regression) zu einer endgültigen Vorhersage.

Die Magie des Bootstrappings liegt darin, dass jeder generierte Teildatensatz die gleiche Größe wie der Originaldatensatz hat, aber da Elemente mit Zurücklegen gezogen werden, enthält er im Durchschnitt etwa 63,2% der einzigartigen Originalbeobachtungen, während die restlichen 36,8% aus Duplikaten bestehen, die mehrmals gezogen wurden. Dies sorgt für die notwendige Diversität zwischen den Trainingsdaten der einzelnen Modelle.

import numpy as np

from sklearn.utils import resample

# Beispiel für einen Original-Datensatz

original_data = np.array([1, 2, 3, 4, 5, 6, 7, 8, 9, 10])

n_samples = len(original_data)

# Erstellung eines Bootstrap-Datensatzes

# resample führt das Ziehen mit Zurücklegen durch (replace=True)

bootstrap_sample = resample(original_data, n_samples=n_samples, replace=True, random_state=42)

print("Original-Datensatz:", original_data)

print("Bootstrap-Datensatz:", bootstrap_sample)

# Ausgabe könnte sein:

# Original-Datensatz: [ 1 2 3 4 5 6 7 8 9 10]

# Bootstrap-Datensatz: [ 3 6 4 10 7 6 4 1 2 9]

# Man beachte, dass 4 und 6 doppelt vorkommen, 5 und 8 fehlen.Die Herausforderung unabhängiger Modelle

Ein zentrales Problem bei der Anwendung von Machine-Learning-Modellen ist die Gefahr des Overfittings, insbesondere bei komplexen Modellen, die perfekt auf die Trainingsdaten abgestimmt sind, aber bei neuen, ungesehenen Daten schlecht abschneiden. Wenn wir mehrere Modelle auf demselben Datensatz trainieren, würden sie tendenziell ähnliche Fehler machen und keine neuen Perspektiven einbringen. Die Vorhersagen wären hoch korreliert, und die Kombination dieser Vorhersagen würde kaum einen Vorteil gegenüber einem einzelnen Modell bieten. Um die Vorteile von Ensemble-Methoden voll auszuschöpfen, ist es entscheidend, dass die einzelnen Modelle möglichst unabhängig voneinander lernen und dadurch diverse Fehler machen.

Ohne unabhängige Trainingsdaten könnten die Modelle nicht ausreichend voneinander lernen und würden im Endeffekt die gleichen „schwachen“ Punkte des Originaldatensatzes verstärken. Bagging löst dies durch das intelligente Erstellen von Bootstrap-Stichproben, die zwar auf dem Originaldatensatz basieren, sich aber durch die zufällige Auswahl mit Zurücklegen voneinander unterscheiden. Dies gewährleistet eine angemessene Diversität und ermöglicht es, dass die Modelle tatsächlich „unterschiedliche Aspekte“ der Datenlandschaft erfassen, anstatt redundant dieselbe Sichtweise zu replizieren.

Der Bootstrap-Mechanismus im Detail

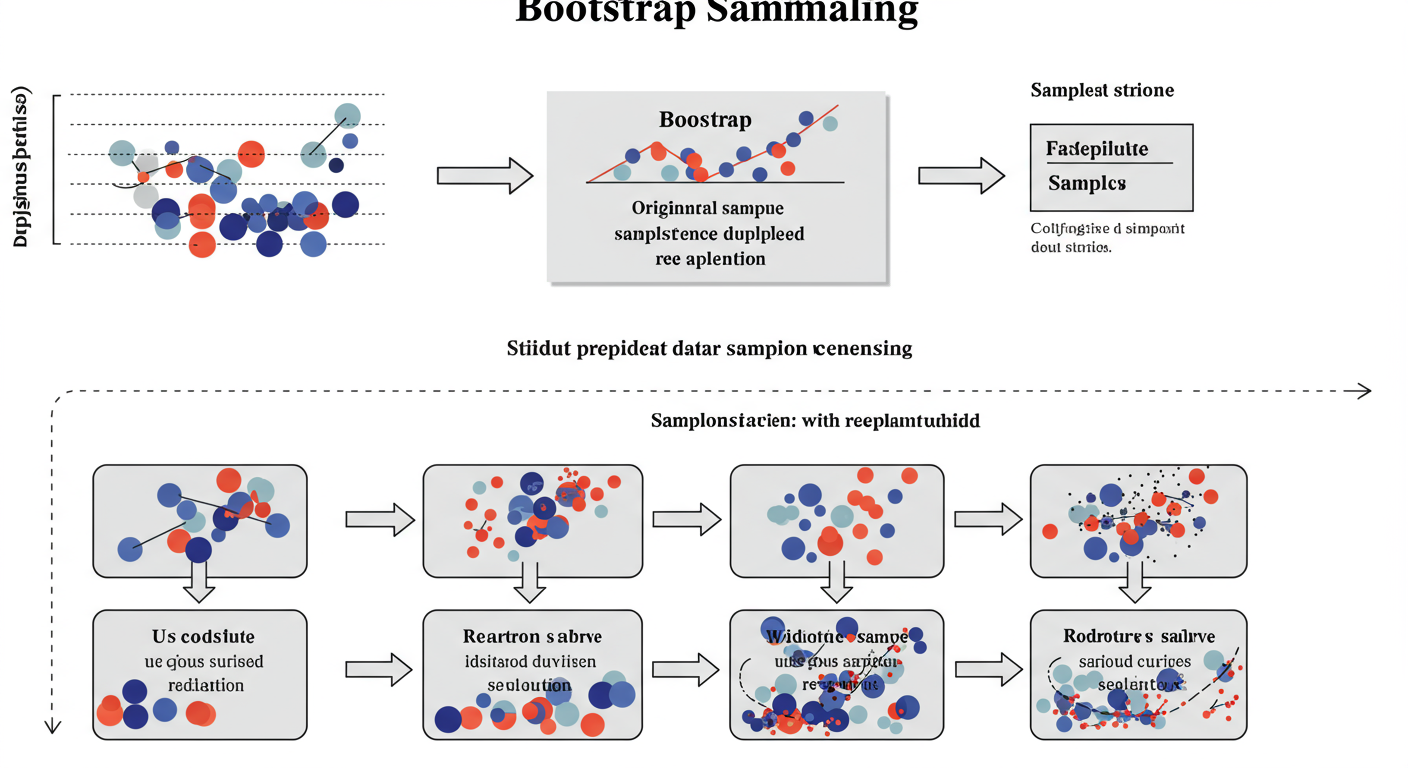

Das Herzstück von Bagging ist der Bootstrap-Mechanismus, eine statistische Resampling-Technik, die es ermöglicht, aus einem einzigen Datensatz mehrere pseudo-unabhängige Teildatensätze zu generieren. Dieser Ansatz ist revolutionär, da er die Notwendigkeit großer Mengen an unterschiedlichen Trainingsdaten umgeht und dennoch eine Grundlage für stabile Ensemble-Modelle schafft. Jeder dieser generierten Bootstrap-Datensätze dient dazu, ein einzelnes Modell des Ensembles zu trainieren.

Generierung von Bootstrap-Datensätzen

Die Generierung eines Bootstrap-Datensatzes beginnt mit einem Originaldatensatz der Größe n. Aus diesem Originaldatensatz werden dann n Beobachtungen zufällig mit Zurücklegen ausgewählt, um einen neuen Datensatz der Größe n zu bilden. Das Schlüsselprinzip hier ist „mit Zurücklegen“: Jede Beobachtung, die einmal ausgewählt wurde, kehrt in den Pool der verfügbaren Beobachtungen zurück und kann erneut für die gleiche Bootstrap-Stichprobe ausgewählt werden. Dies hat zur Folge, dass einige Beobachtungen aus dem Originaldatensatz in einer Bootstrap-Stichprobe mehrfach vorkommen, während andere Beobachtungen gar nicht enthalten sind.

Die Schönheit des Bootstrappings liegt in seiner Einfachheit und Effektivität, um die intrinsische Variabilität der Datenstruktur zu erkunden und robusteres Wissen zu destillieren.

Durch die zufällige Auswahl mit Zurücklegen entsteht eine Vielzahl von leicht unterschiedlichen Datensätzen. Jedes dieser „neu gesampelten“ Subsets ist eine leicht verzerrte, aber dennoch repräsentative Version des ursprünglichen Trainingsdatensatzes. Diese Variation ist genau das, was wir brauchen, um Modelle zu trainieren, die unterschiedliche Perspektiven auf das Problem entwickeln. Wenn wir beispielsweise 100 Bootstrap-Stichproben erstellen, erhalten wir 100 leicht unterschiedliche Trainingsdatensätze, die wiederum als Grundlage für 100 einzelne Basis-Modelle dienen.

import pandas as pd

import random

# Ein kleiner Beispiel-Datensatz

data_original = pd.DataFrame({'Merkmal1': [10, 20, 30, 40], 'Merkmal2': ['A', 'B', 'C', 'D']})

n_rows = len(data_original)

n_bootstraps = 3 # Wir erstellen 3 Bootstrap-Stichproben

bootstrap_samples = []

for i in range(n_bootstraps):

# Zufällige Indizes mit Zurücklegen ziehen

indices = [random.choice(range(n_rows)) for _ in range(n_rows)]

bootstrap_df = data_original.iloc[indices]

bootstrap_samples.append(bootstrap_df)

print(f"Bootstrap-Stichprobe {i+1}:n{bootstrap_df}n")

# Beispielausgabe (kann variieren):

# Bootstrap-Stichprobe 1:

# Merkmal1 Merkal2

# 0 10 A

# 3 40 D

# 1 20 B

# 0 10 A

#

# Bootstrap-Stichprobe 2:

# Merkmal1 Merkal2

# 2 30 C

# 0 10 A

# 1 20 B

# 2 30 C

#

# Bootstrap-Stichprobe 3:

# Merkmal1 Merkal2

# 1 20 B

# 1 20 B

# 3 40 D

# 0 10 ADer Prozess der Stichprobenziehung mit Zurücklegen

Die Methode des Ziehens mit Zurücklegen ist entscheidend, um die Diversität der Bootstrap-Stichproben zu gewährleisten. Betrachten wir den Originaldatensatz E_1 mit n Elementen. Für jeden neuen Bootstrap-Datensatz E_2 wird n-mal ein Element zufällig aus E_1 ausgewählt und in E_2 eingefügt. Nach jeder Auswahl wird das Element wieder in E_1 „zurückgelegt“, sodass es bei der nächsten Ziehung wieder zur Verfügung steht. Dies führt dazu, dass E_2 Elemente enthalten kann, die in E_1 nur einmal vorkommen, aber in E_2 mehrmals erscheinen, während andere Elemente aus E_1 in E_2 vollständig fehlen können.

Ein anschauliches Beispiel, wie im Referenzinhalt beschrieben: Wenn E_1 aus zwei ‚A’s und zwei ‚B’s besteht und n=4 ist, könnte ein Bootstrap-Datensatz aus drei ‚B’s und einem ‚A‘ bestehen. Ein ‚B‘ wurde dreimal gezogen, während ein ‚A‘ gar nicht gezogen wurde. Diese leichte Variation ist genau das, was die einzelnen Modelle dazu bringt, leicht unterschiedliche Entscheidungsflächen zu lernen und somit ihre Fehler zu diversifizieren. Die folgende Tabelle verdeutlicht das Prinzip der generierten Bootstrap-Stichprobe aus einem hypothetischen Originaldatensatz:

| Index im Original | Originalwert | Zufällig gezogener Index | Wert in Bootstrap-Stichprobe |

|---|---|---|---|

| 0 | Apfel | 2 | Orange |

| 1 | Banane | 0 | Apfel |

| 2 | Orange | 2 | Orange |

| 3 | Birne | 1 | Banane |

Wie zu sehen ist, wurde „Orange“ zweimal gezogen, „Apfel“ und „Banane“ einmal, während „Birne“ in dieser speziellen Bootstrap-Stichprobe nicht vorkommt. Dieses Verfahren wird für jede der gewünschten Bootstrap-Stichproben wiederholt, wodurch eine Sammlung von diversen Trainingsdatensätzen entsteht.

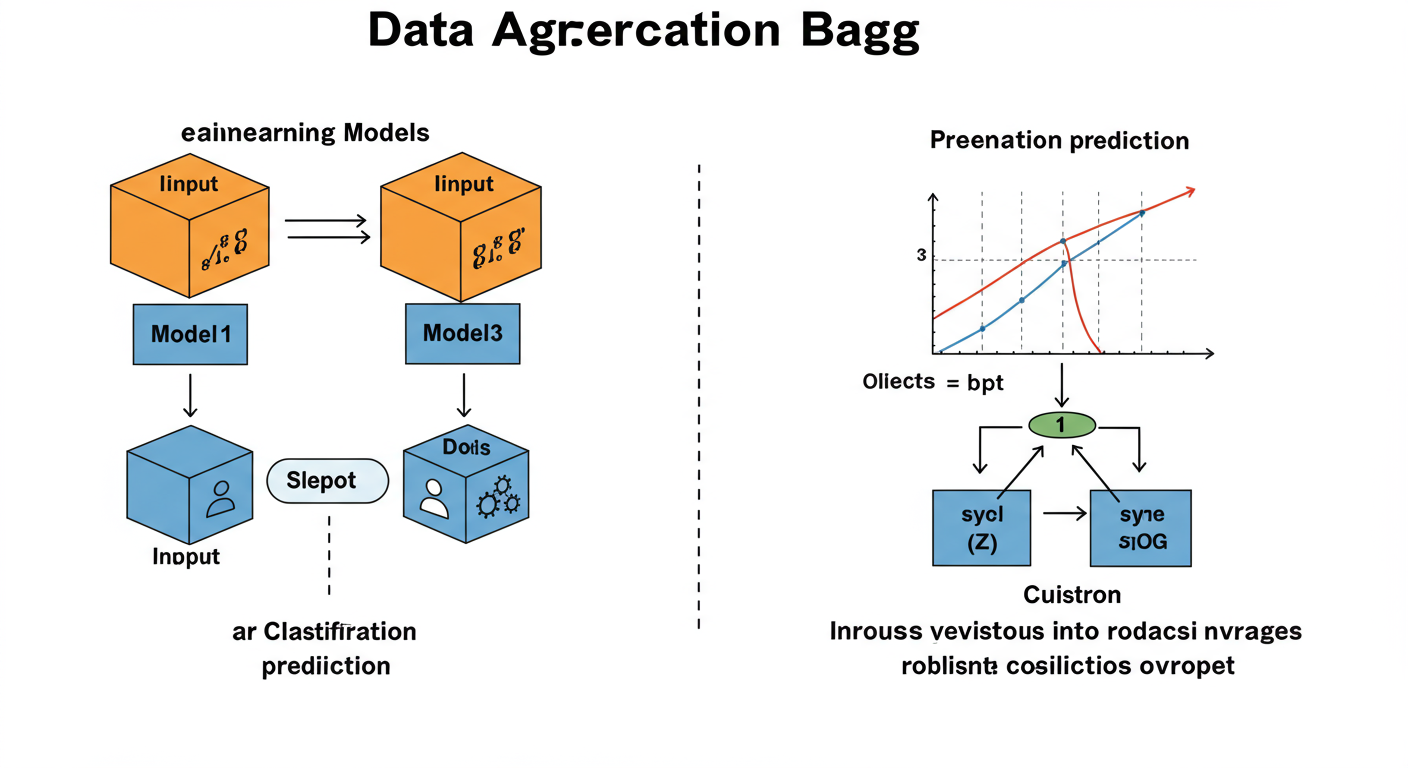

Datenaggregation und Vorhersagemechanismen

Nachdem wir durch den Bootstrap-Mechanismus mehrere voneinander leicht unabhängige Modelle auf unterschiedlichen Datensätzen trainiert haben, stehen wir vor der Frage: Wie nutzen wir diese Vielzahl von individuellen Vorhersagen, um eine einzige, konsistente und möglichst genaue Endvorhersage zu erhalten? Hier kommt die Aggregationsphase ins Spiel, die entscheidend ist für die Wirksamkeit von Bagging im Machine Learning.

Integration unabhängiger Modellvorhersagen

Die Datenaggregation ist der letzte Schritt im Bagging-Prozess. Sie kombiniert die Outputs der einzelnen Basis-Modelle zu einer einzigen, endgültigen Vorhersage. Die Art der Aggregation hängt maßgeblich davon ab, ob wir ein Klassifikations- oder ein Regressionsproblem lösen wollen. Das Ziel ist es, die Stärken der individuellen Modelle zu bündeln und gleichzeitig ihre Schwächen oder Fehlvorhersagen auszugleichen. Durch die Aggregation wird das Rauschen in den einzelnen Modellen gemittelt und die Gesamtstabilität und Genauigkeit der Vorhersage erhöht.

import numpy as np

from collections import Counter

# Beispiel für Vorhersagen von drei Klassifikationsmodellen

predictions_model1 = ['A', 'B', 'A', 'C']

predictions_model2 = ['A', 'A', 'B', 'C']

predictions_model3 = ['B', 'A', 'A', 'C']

# Aggregation für Klassifikation (Voting-System)

final_predictions_classification = []

for i in range(len(predictions_model1)):

# Sammelt die Vorhersagen für den i-ten Datenpunkt von allen Modellen

individual_preds = [predictions_model1[i], predictions_model2[i], predictions_model3[i]]

# Zählt die Häufigkeit jeder Vorhersage

counts = Counter(individual_preds)

# Wählt die Vorhersage mit der höchsten Häufigkeit (Mehrheitsentscheid)

final_predictions_classification.append(counts.most_common(1)[0][0])

print("Individuelle Klassifikations-Vorhersagen:")

print(f"Modell 1: {predictions_model1}")

print(f"Modell 2: {predictions_model2}")

print(f"Modell 3: {predictions_model3}")

print(f"Aggregierte Klassifikations-Vorhersagen (Voting): {final_predictions_classification}n")

# Beispiel für Vorhersagen von drei Regressionsmodellen

predictions_reg_model1 = [10.5, 20.1, 5.3]

predictions_reg_model2 = [11.2, 19.8, 5.8]

predictions_reg_model3 = [10.8, 20.5, 5.5]

# Aggregation für Regression (Mittelwert)

final_predictions_regression = []

for i in range(len(predictions_reg_model1)):

individual_preds = [predictions_reg_model1[i], predictions_reg_model2[i], predictions_reg_model3[i]]

final_predictions_regression.append(np.mean(individual_preds))

print("Individuelle Regressions-Vorhersagen:")

print(f"Modell 1: {predictions_reg_model1}")

print(f"Modell 2: {predictions_reg_model2}")

print(f"Modell 3: {predictions_reg_model3}")

print(f"Aggregierte Regressions-Vorhersagen (Mittelwert): {np.round(final_predictions_regression, 2)}")

# Beispielausgabe:

# Individuelle Klassifikations-Vorhersagen:

# Modell 1: ['A', 'B', 'A', 'C']

# Modell 2: ['A', 'A', 'B', 'C']

# Modell 3: ['B', 'A', 'A', 'C']

# Aggregierte Klassifikations-Vorhersagen (Voting): ['A', 'A', 'A', 'C']

#

# Individuelle Regressions-Vorhersagen:

# Modell 1: [10.5, 20.1, 5.3]

# Modell 2: [11.2, 19.8, 5.8]

# Modell 3: [10.8, 20.5, 5.5]

# Aggregierte Regressions-Vorhersagen (Mittelwert): [10.83 20.13 5.53]Anwendungsfälle: Klassifikation und Regression

Die spezifische Art der Aggregation unterscheidet sich je nach der Art des Machine-Learning-Problems:

- Klassifikationsmodelle: Bei Klassifikationsaufgaben, bei denen die Modelle Kategorien vorhersagen (z.B. A oder B), wird in der Regel ein Wahlsystem (Voting) angewendet. Jedes Basis-Modell gibt seine Vorhersage für einen bestimmten Datenpunkt ab. Die Klasse, die von der Mehrheit der Modelle vorhergesagt wird, ist die endgültige Klassifikation des Ensemble-Modells. Dies ist eine Form der harten Abstimmung. Es können auch Wahrscheinlichkeiten aggregiert werden (weiche Abstimmung), um eine finale Wahrscheinlichkeitsverteilung zu erhalten und daraus die Klasse mit der höchsten Wahrscheinlichkeit zu wählen.

- Regressionsmodelle: Für Regressionsprobleme, bei denen die Modelle kontinuierliche numerische Werte vorhersagen (z.B. einen Preis oder eine Temperatur), wird typischerweise der Mittelwert der von den einzelnen Basis-Modellen abgegebenen Vorhersagen berechnet. Durch das Mitteln der Werte werden Ausreißer oder einzelne Fehlvorhersagen tendenziell geglättet, was zu einer stabileren und oft genaueren Gesamtvorhersage führt.

Dieses Prinzip der Aggregation, ob durch Abstimmung oder Mittelwertbildung, sorgt dafür, dass die Fehler und die Varianz einzelner Modelle ausgeglichen werden, was das Ensemble-Modell robuster und zuverlässiger macht. Die Aggregation ist der Höhepunkt des „Gemeinsam sind wir stärker“-Prinzips, das Bagging so effektiv macht.

Vorteile von Bagging-Algorithmen

Bagging ist nicht nur eine elegante theoretische Konstruktion, sondern bietet in der Praxis handfeste Vorteile, die es zu einer bevorzugten Technik für viele Machine Learning Weiterbildung und Anwendungen machen. Die beiden Hauptstärken liegen in der Verringerung der Varianz und der Korrektur von Fehlvorhersagen, was zu einer insgesamt verbesserten Modellstabilität und -genauigkeit führt.

Reduzierung der Varianz und Overfitting

Einer der signifikantesten Vorteile von Bagging ist seine Fähigkeit, die Varianz zu reduzieren, ohne dabei einen signifikanten Bias zu erzeugen. Varianz im Kontext von Machine Learning bezieht sich darauf, wie stark die Vorhersage eines Modells schwankt, wenn es auf unterschiedlichen Trainingsdatensätzen (die aus derselben Grundgesamtheit stammen) trainiert wird. Modelle mit hoher Varianz sind oft anfällig für Overfitting, d.h., sie lernen das Rauschen in den Trainingsdaten zu gut und verallgemeinern schlecht auf neue Daten.

Durch die Erstellung mehrerer Bootstrap-Stichproben und das Training unabhängiger Modelle auf diesen leicht unterschiedlichen Datensätzen sorgt Bagging dafür, dass die einzelnen Modelle zwar spezifische Muster erkennen, aber auch unterschiedliche Aspekte der Daten betonen. Wenn diese individuellen Vorhersagen dann aggregiert werden (gemittelt oder abgestimmt), gleichen sich die individuellen Fehler und Verzerrungen gegenseitig aus. Dies führt zu einer stabileren und weniger varianzbehafteten Gesamtvorhersage, die weniger anfällig für das Rauschen einzelner Datensätze ist. Dadurch wird Overfitting reduziert, und das Modell zeigt eine bessere Generalisierungsfähigkeit auf ungesehenen Daten.

Fehlerkorrektur und Modellstabilität

Ein weiterer entscheidender Vorteil von Bagging ist die inhärente Fehlerkorrektur. Selbst wenn einzelne Basis-Modelle in einem Bagging-Ensemble Fehler machen oder ungenaue Vorhersagen liefern, können diese Fehler durch die Aggregation der Vorhersagen häufig korrigiert werden. Betrachten wir ein Klassifikationsbeispiel: Wenn ein Datenpunkt von einem Modell fälschlicherweise als Klasse ‚A‘ klassifiziert wird, aber von den anderen Modellen mehrheitlich als Klasse ‚B‘, wird die endgültige Vorhersage durch das Wahlsystem korrekt ‚B‘ sein.

Diese Fähigkeit zur Korrektur von Fehlvorhersagen führt zu einer erhöhten Modellstabilität. Ein Bagging-Modell ist weniger empfindlich gegenüber kleinen Änderungen im Trainingsdatensatz oder gegenüber Ausreißern. Es ist robuster, da es nicht von der Leistung eines einzelnen Modells abhängt, sondern von der kollektiven Intelligenz des gesamten Ensembles. Dies macht Bagging-Algorithmen besonders wertvoll in Szenarien, wo Datenrauschen oder eine begrenzte Datenmenge vorliegt, und hilft, zuverlässigere Vorhersagen in realen Anwendungen zu gewährleisten.

Bagging in der Praxis: Random Forest und weitere Anwendungen

Die Konzepte von Bagging finden ihre praktische Anwendung in einer Vielzahl von Algorithmen und Machine-Learning-Problemen. Der wohl bekannteste und meistgenutzte Algorithmus, der auf dem Bagging-Prinzip basiert, ist der Random Forest. Doch die Idee, die Varianz durch Aggregation von Entscheidungen zu reduzieren, ist breiter anwendbar und bietet vielfältige Optimierungsmöglichkeiten für Datenanalyse und prädiktive Modellierung.

Random Forest als prominenter Bagging-Algorithmus

Der Random Forest ist ein herausragendes Beispiel für einen Bagging-Algorithmus, der eine Sammlung von Entscheidungsbäumen als Basis-Learner verwendet. Jeder Baum im Random Forest wird auf einer separaten Bootstrap-Stichprobe des Originaldatensatzes trainiert. Zusätzlich zur Bootstrapping-Komponente führt der Random Forest eine weitere Ebene der Randomisierung ein: Bei jedem Split in einem Entscheidungsbaum wird nicht der gesamte Satz von Merkmalen betrachtet, sondern nur eine zufällig ausgewählte Teilmenge davon. Diese doppelte Randomisierung – sowohl bei den Daten als auch bei den Merkmalen – trägt maßgeblich zur Diversität der einzelnen Bäume bei und verhindert, dass alle Bäume die gleichen Fehler machen. Das Ergebnis ist ein Ensemble von Entscheidungsbäumen, das nicht nur eine geringere Varianz aufweist als ein einzelner Baum, sondern auch eine hohe Vorhersagekraft besitzt und Overfitting effektiv bekämpft.

Für Data Scientist Ausbildung und angehende Machine Learning Ingenieure ist der Random Forest oft einer der ersten robusten Algorithmen, die sie lernen, da er eine ausgezeichnete Balance zwischen Leistung und Interpretierbarkeit bietet. Er ist vielseitig einsetzbar für Klassifikations- und Regressionsaufgaben und seine Performance ist oft State-of-the-Art in vielen realen Szenarien.

from sklearn.ensemble import RandomForestClassifier

from sklearn.datasets import make_classification

from sklearn.model_selection import train_test_split

from sklearn.metrics import accuracy_score

# Generiere synthetische Daten für ein Klassifikationsproblem

X, y = make_classification(n_samples=1000, n_features=20, n_informative=10, n_redundant=10, random_state=42)

# Teile die Daten in Trainings- und Testsets auf

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3, random_state=42)

# Erstelle und trainiere einen Random Forest Klassifikator

# n_estimators: Anzahl der Bäume im Wald (entspricht der Anzahl der Bootstrap-Stichproben und Modelle)

# random_state: Für Reproduzierbarkeit der Ergebnisse

rf_classifier = RandomForestClassifier(n_estimators=100, random_state=42, n_jobs=-1)

rf_classifier.fit(X_train, y_train)

# Mache Vorhersagen auf dem Testset

y_pred = rf_classifier.predict(X_test)

# Berechne die Genauigkeit

accuracy = accuracy_score(y_test, y_pred)

print(f"Genauigkeit des Random Forest Klassifikators: {accuracy:.4f}")

# Beispielausgabe:

# Genauigkeit des Random Forest Klassifikators: 0.9000Implementierungshinweise und Best Practices

Bei der Implementierung von Bagging-Algorithmen wie Random Forest gibt es einige Best Practices zu beachten, um die Leistung zu maximieren und häufige Fallstricke zu vermeiden:

- Anzahl der Basis-Modelle (n_estimators): Eine höhere Anzahl von Bäumen im Random Forest oder Modellen im Bagging-Ensemble führt in der Regel zu besseren Ergebnissen, da mehr Diversität und Aggregation stattfindet. Allerdings steigen damit auch der Rechenaufwand und die Speichernutzung. Ein guter Startwert sind oft 100 Bäume, der dann iterativ angepasst werden kann.

- Auswahl der Basis-Learner: Während Entscheidungsbäume eine beliebte Wahl für Bagging sind, können auch andere Algorithmen als Basis-Learner verwendet werden, z.B. Support Vector Machines oder Neuronale Netze. Wichtig ist, dass die Basis-Learner selbst eine hohe Varianz haben können, damit Bagging seine Stärke zur Varianzreduktion ausspielen kann.

- Feature Importance: Random Forest bietet die Möglichkeit, die Wichtigkeit einzelner Features für die Vorhersage zu bewerten. Dies kann wertvolle Einblicke in die Daten liefern und bei der Feature-Auswahl helfen.

- Out-of-Bag (OOB) Error: Da beim Bootstrapping nicht alle Datenpunkte in jeder Stichprobe enthalten sind, können die nicht verwendeten Datenpunkte (Out-of-Bag-Daten) als Validierungsset dienen. Der OOB-Fehler ist eine gute Schätzung der Generalisierungsleistung des Modells, ohne dass ein separates Validierungsset benötigt wird.

Durch die Berücksichtigung dieser Punkte können Entwickler und Data Scientists effektive Bagging-Modelle erstellen, die robust und zuverlässig in der Praxis sind und einen wertvollen Beitrag zur Prädiktiven Modellierung leisten.

Zusammenfassung der Ensemble-Lernstrategie

Bagging oder Bootstrap Aggregating ist eine äußerst effektive und weit verbreitete Ensemble-Lernstrategie im Bereich des Machine Learning. Durch das geschickte Zusammenspiel von Bootstrapping zur Erzeugung diverser Datensätze und intelligenter Aggregation der Vorhersagen einzelner Modelle gelingt es Bagging, die Varianz zu reduzieren und die Robustheit und Genauigkeit von Vorhersagemodellen erheblich zu steigern. Es ist ein Paradebeispiel dafür, wie die Kombination mehrerer „schwacher“ Lerner zu einem überaus „starken“ und zuverlässigen Gesamtsystem führen kann.

Die Prinzipien und Vorteile von Bagging sind fundamental für jeden, der sich mit fortgeschrittenen Themen in der Datenwissenschaft und Softwareentwicklung auseinandersetzt. Egal, ob Sie Entwickler, Student oder Technologiebegeisterter sind, ein tiefes Verständnis dieser Methode ebnet den Weg zu leistungsfähigeren und zuverlässigeren intelligenten Systemen. Wenn Sie Ihr Wissen im Bereich der Machine Learning Weiterbildung vertiefen möchten oder konkrete Anwendungen im Bereich Data Science anstreben, dann gibt es zahlreiche Möglichkeiten, Ihre Fähigkeiten in diesem spannenden Feld auszubauen. Teilen Sie Ihre Gedanken in den Kommentaren oder entdecken Sie weitere Fachartikel zu verwandten Themen!

Vielen Dank für diesen sehr informativen Artikel! Die Vorteile von Bagging für die Schaffung robuster und präziser Modelle sind klar ersichtlich und für Entwickler und Data Scientists sicher essenziell.

Aus der Perspektive eines **Durchschnittsnutzers** oder kleinerer Betriebe stellen sich mir jedoch einige **praktische Fragen zur Anwendbarkeit und Kompatibilität**. Wie verhält es sich mit der Performance und den Ressourcenanforderungen? Funktioniert diese Technologie auch noch gut mit **älterer Hardware oder bestehender, vielleicht nicht topaktueller Software-Infrastruktur**, oder sind hier hohe Investitionen in neue Systeme unumgänglich?

Und ist die Integration oder der tägliche Einsatz von Bagging-basierten Lösungen nicht potenziell **zu kompliziert für den täglichen Gebrauch** außerhalb hochspezialisierter Teams? Es wäre wertvoll zu erfahren, ob es Wege gibt, diese Komplexität zu reduzieren – beispielsweise durch Low-Code-Plattformen oder gut dokumentierte APIs –, um die Vorteile von Bagging einer breiteren Nutzerschaft zugänglich zu machen. Eine bodenständige Einschätzung der Einstiegshürden und möglicher Vereinfachungen wäre hier sehr hilfreich.

Vielen dank für ihre ausführlichen fragen. es ist absolut verständlich, dass die praktischen aspekte und die anwendbarkeit für durchschnittsnutzer und kleinere betriebe von großer bedeutung sind. bezüglich der performance und ressourcenanforderungen ist es richtig, dass bagging-modelle aufgrund der parallelen training mehrerer basismodelle einen gewissen rechenaufwand erfordern können. moderne implementierungen sind jedoch oft optimiert, und für viele anwendungsfälle sind die anforderungen auch auf älterer hardware oder mit bestehender infrastruktur handhabbar, insbesondere wenn die basismodelle nicht übermäßig komplex sind. hohe investitionen sind nicht immer unumgänglich, es hängt stark von der spezifischen größe des datensatzes und der komplexität der aufgabe ab.

die sorge um die komplexität im täglichen einsatz ist ebenfalls berechtigt. genau hier setzen low-code-plattformen und gut dokumentierte apis an. es gibt bereits lösungen, die bagging-techniken kapseln und über vereinfachte schnittstellen zugänglich machen, sodass auch nutzer ohne tiefgreifende kenntnisse die vorteile nutzen können. die einstiegshürde kann durch solche tools erheblich gesenkt werden, und

Ah, Bagging… Für alle, die sich jetzt an den Kopf fassen und sich fragen, was das überhaupt sein soll: Ganz einfach erklärt, damit auch jeder mitkommt. Stell dir vor, du hast eine Aufgabe, und anstatt nur einen schlauen Kopf dranzusetzen, nimmst du ganz viele, die alle ein bisschen anders denken oder andere Daten sehen. Jeder dieser ‚Köpfe‘ macht dann seine eigene Vorhersage, und am Ende sammeln wir all diese Vorhersagen ein und nehmen einfach das, was die meisten sagen. Das macht das Ganze viel stabiler und weniger anfällig für Fehler, weil sich die ‚Köpfe‘ gegenseitig ausgleichen. Ist eigentlich ganz logisch, wenn man es sich mal in Ruhe überlegt, oder?

Das ist eine hervorragende und sehr verständliche Erklärung des Bagging-Prinzips. Sie haben es geschafft, ein komplexes Thema auf eine Weise darzustellen, die es für jeden zugänglich macht, selbst für diejenigen, die mit maschinellem Lernen nicht vertraut sind. Die Analogie mit den vielen „Köpfen“ ist besonders treffend und verdeutlicht den Kern der Methode auf anschauliche Weise. Es freut mich sehr, dass mein Artikel zu einer solchen klaren und prägnanten Zusammenfassung anregen konnte.

Vielen Dank für Ihren wertvollen Beitrag zu diesem Thema. Es ist immer bereichernd, wenn Leser ihre Perspektiven teilen und das Verständnis für alle erweitern. Ich lade Sie herzlich ein, sich auch andere Artikel in meinem Profil oder meine weiteren Veröffentlichungen anzusehen.