Die rapide Entwicklung der Digitalisierung hat die Daten zu einem der wertvollsten Güter des 21. Jahrhunderts gemacht. Unternehmen aller Branchen erkennen zunehmend den immensen Wert von Daten, sei es zur Optimierung von Geschäftsprozessen, zur Entwicklung neuer Produkte oder zur Verbesserung der Kundenbindung. Diese Erkenntnis treibt eine enorme Nachfrage nach qualifizierten Fachkräften in der sogenannten Datenbranche an. Eine Karriere im Bereich Data ist daher nicht nur zukunftssicher, sondern bietet auch spannende Herausforderungen und vielfältige Gestaltungsmöglichkeiten.

Dieser umfassende Leitfaden beleuchtet die Kernrollen innerhalb der Datenwelt und zeigt auf, welche berufliche Weiterbildungen im Datenbereich existieren, um in diesem dynamischen Feld Fuß zu fassen. Wir werden detailliert die Aufgaben, notwendigen Fähigkeiten und exemplarische Code-Snippets für Schlüsselpositionen wie Data Scientist, Data Analyst und Data Engineer untersuchen. Darüber hinaus werfen wir einen Blick auf spezialisierte Rollen wie Machine Learning Engineer, DevOps Engineer und Cloud Engineer sowie auf gefragte Tool-Zertifizierungen, die Ihre Datenwissenschaft Weiterbildung perfekt ergänzen können.

Vielfältige Karrierepfade in der Datenwelt

Die moderne Datenlandschaft ist komplex und vielschichtig, was sich in einer beeindruckenden Vielfalt an spezialisierten Berufsrollen widerspiegelt. Eine erfolgreiche Karriere in der Datenbranche erfordert oft nicht nur ein tiefes Verständnis von Datenanalyse und -management, sondern auch spezifische technische Fähigkeiten und Domänenkenntnisse. Die verschiedenen Positionen arbeiten Hand in Hand, um den gesamten Lebenszyklus von Daten – von der Erfassung und Speicherung über die Analyse bis zur Bereitstellung von Erkenntnissen und intelligenten Anwendungen – effektiv zu gestalten.

Egal, ob Sie daran interessiert sind, tiefe Muster in großen Datensätzen zu entdecken, Geschäftsentscheidungen durch aussagekräftige Reports zu untermauern oder die robuste Infrastruktur für datengesteuerte Systeme aufzubauen, es gibt einen passenden Karrierepfad für Sie. Berufliche Weiterbildungen helfen Ihnen dabei, die notwendigen Kompetenzen zu erwerben und sich in gefragten Bereichen wie der Big Data Architektur oder der Entwicklung von Vorhersagemodellen zu spezialisieren.

Der Data Scientist: Modellentwicklung und Erkenntnisgewinn

Der Data Scientist ist der „Forscher“ der Datenwelt. Seine Hauptaufgabe besteht darin, komplexe Algorithmen und Modelle zu entwickeln, um verborgene Muster, Trends und Korrelationen in riesigen Datensätzen zu entdecken. Dies beinhaltet statistische Analysen, maschinelles Lernen und die Fähigkeit, diese Erkenntnisse in klare, handlungsorientierte Empfehlungen für das Geschäft umzusetzen. Ein Data Scientist Bootcamp vermittelt Ihnen das nötige Rüstzeug, um Vorhersagemodelle zu entwickeln und die Zukunft von Unternehmen aktiv mitzugestalten.

Die Arbeit eines Data Scientists erfordert ein fundiertes Verständnis von Statistik, fortgeschrittenen mathematischen Konzepten und Programmierkenntnissen in Sprachen wie Python oder R. Sie nutzen Bibliotheken wie Scikit-learn, TensorFlow oder PyTorch, um Machine-Learning-Modelle zu trainieren und zu validieren. Von der Betrugserkennung bis zur Personalisierung von Kundenempfehlungen – Data Scientists sind die Architekten intelligenter Systeme.

import pandas as pd

from sklearn.model_selection import train_test_split

from sklearn.linear_model import LinearRegression

from sklearn.metrics import mean_squared_error

# Beispiel-Datensatz erstellen (Simulierte Wetterdaten)

data = {

'Temperatur_Vormittag': [10, 12, 15, 13, 11, 14, 16, 17, 18, 19],

'Sonnenscheindauer_Vormittag': [3, 4, 6, 5, 2, 5, 7, 8, 8, 9],

'Temperatur_Nachmittag': [15, 17, 20, 18, 16, 19, 21, 22, 23, 24]

}

df = pd.DataFrame(data)

# Features (X) und Target (y) definieren

X = df[['Temperatur_Vormittag', 'Sonnenscheindauer_Vormittag']]

y = df['Temperatur_Nachmittag']

# Daten in Trainings- und Testsets aufteilen

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# Lineares Regressionsmodell trainieren

model = LinearRegression()

model.fit(X_train, y_train)

# Vorhersagen auf dem Testset treffen

y_pred = model.predict(X_test)

# Modellbewertung

rmse = mean_squared_error(y_test, y_pred, squared=False)

print(f"Modellkoeffizienten: {model.coef_}")

print(f"Intercept: {model.intercept_}")

print(f"RMSE des Modells: {rmse:.2f}")

# Eine neue Vorhersage

neue_daten = pd.DataFrame([[16, 7]], columns=['Temperatur_Vormittag', 'Sonnenscheindauer_Vormittag'])

vorhersage = model.predict(neue_daten)

print(f"Vorhersage für neue Daten (Temperatur_Vormittag=16, Sonnenscheindauer_Vormittag=7): {vorhersage[0]:.2f}°C")

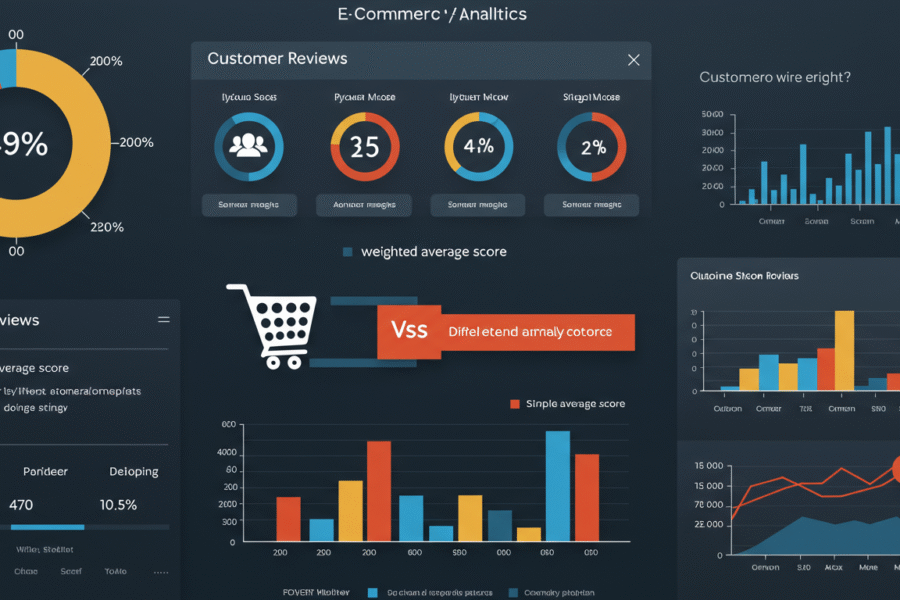

Der Data Analyst: Dateninterpretation für Geschäftsentscheidungen

Der Data Analyst ist der Brückenbauer zwischen Rohdaten und Geschäftsstrategie. Seine Hauptverantwortung liegt darin, Daten zu sammeln, zu bereinigen und zu transformieren, um aussagekräftige Berichte und Visualisierungen zu erstellen. Ziel ist es, Daten auszuwerten und zu interpretieren, um Entscheidungsträgern die notwendigen Informationen für strategische Planung und Problemlösung bereitzustellen. Eine Data Analyst Schulung ist ideal, um die Fähigkeiten im Umgang mit BI-Tools und Datenbanken zu perfektionieren.

Typische Aufgaben umfassen die Erstellung von Dashboards, die Durchführung von A/B-Tests, die Trendanalyse und das Ad-hoc-Reporting. SQL-Kenntnisse sind hierbei unerlässlich, ebenso wie der sichere Umgang mit Tabellenkalkulationsprogrammen (z.B. Excel) und Business-Intelligence-Tools (z.B. Tableau, Power BI). Data Analysts helfen Unternehmen, Effizienzen zu steigern und Wachstumschancen zu identifizieren.

-- Beispiel-SQL-Abfrage: Umsatzanalyse pro Produktkategorie

-- Ziel: Aggregierten Umsatz und Anzahl der Verkäufe pro Kategorie anzeigen

SELECT

Produktkategorie AS "Kategorie",

SUM(Umsatz) AS "Gesamtumsatz",

COUNT(Bestell_ID) AS "Anzahl_Verkaeufe"

FROM

Verkaufsdaten

WHERE

Bestelldatum >= '2023-01-01' AND Bestelldatum 50000 -- Nur Kategorien mit Umsatz über 50.000 filtern

ORDER BY

Gesamtumsatz DESC;

Der Data Engineer: Fundament der Datenarchitektur

Der Data Engineer ist der Architekt und Baumeister der Dateninfrastruktur. Seine Aufgabe ist es, robuste, skalierbare und effiziente Systeme zu entwerfen, zu implementieren und zu pflegen, die für die Erfassung, Speicherung, Verarbeitung und Bereitstellung großer Datenmengen verantwortlich sind. Der Fokus liegt auf der Entwicklung und Optimierung der Big Data Architektur, damit Data Scientists und Data Analysts überhaupt arbeiten können. Eine Data Engineer Karriere ist fundamental für jedes datengetriebene Unternehmen.

Dazu gehört die Entwicklung von ETL-Pipelines (Extract, Transform, Load), die Verwaltung von Datenbanken (SQL, NoSQL) und Data Warehouses, sowie die Arbeit mit Distributed Computing Frameworks wie Apache Spark oder Hadoop. Programmiersprachen wie Python und Java sind Standard, und Kenntnisse in Cloud-Plattformen wie AWS, Azure oder GCP sind unerlässlich. Data Engineers stellen sicher, dass Daten zuverlässig und in der benötigten Qualität zur Verfügung stehen.

import pandas as pd

from sqlalchemy import create_engine

# --- 1. Extraktion (Extract) ---

def extract_data(source_path):

"""

Simuliert die Extraktion von Daten aus einer CSV-Datei.

In einem realen Szenario könnte dies auch eine API-Anfrage oder Datenbankabfrage sein.

"""

try:

df = pd.read_csv(source_path)

print(f"Daten aus {source_path} erfolgreich extrahiert.")

return df

except FileNotFoundError:

print(f"Fehler: Datei {source_path} nicht gefunden.")

return None

# --- 2. Transformation (Transform) ---

def transform_data(df):

"""

Simuliert Datentransformationen: Bereinigung, Aggregation, Feature Engineering.

Hier: Konvertierung von Spaltentypen, Erstellen einer neuen Spalte.

"""

if df is None:

return None

print("Daten werden transformiert...")

# Beispiel: Spaltennamen bereinigen

df.columns = df.columns.str.lower().str.replace(' ', '_')

# Beispiel: Datentypen anpassen

if 'timestamp' in df.columns:

df['timestamp'] = pd.to_datetime(df['timestamp'])

if 'price' in df.columns:

df['price'] = pd.to_numeric(df['price'], errors='coerce')

# Beispiel: Neue Spalte erstellen

if 'quantity' in df.columns and 'price' in df.columns:

df['total_revenue'] = df['quantity'] df['price']

# NaN-Werte füllen oder entfernen

df = df.dropna(subset=['price', 'quantity']) # Zeilen mit fehlendem Preis/Menge entfernen

print("Transformation abgeschlossen.")

return df

# --- 3. Laden (Load) ---

def load_data(df, target_table, db_connection_string):

"""

Simuliert das Laden der transformierten Daten in eine Datenbanktabelle.

"""

if df is None:

print("Keine Daten zum Laden vorhanden.")

return

print(f"Daten werden in Tabelle '{target_table}' geladen...")

try:

engine = create_engine(db_connection_string)

df.to_sql(target_table, engine, if_exists='replace', index=False)

print(f"Daten erfolgreich in '{target_table}' geladen.")

except Exception as e:

print(f"Fehler beim Laden der Daten: {e}")

# --- Haupt-ETL-Workflow ---

if __name__ == "__main__":

SOURCE_CSV_PATH = 'sales_data.csv' # Erstellen Sie diese Datei für den Test

TARGET_DB_TABLE = 'processed_sales'

DB_CONN_STRING = 'sqlite:///data_warehouse.db' # SQLite-Datenbank im gleichen Verzeichnis

# Beispiel-CSV-Datei erstellen (für Testzwecke)

sample_data = {

'Timestamp': pd.to_datetime(['2023-01-01 10:00', '2023-01-01 11:00', '2023-01-01 12:00']),

'ProductID': ['A1', 'B2', 'C3'],

'Quantity': [10, 5, 12],

'Price': [100.50, 200.00, 75.25],

'CustomerLocation': ['Berlin', 'Munich', 'Hamburg']

}

sample_df = pd.DataFrame(sample_data)

sample_df.to_csv(SOURCE_CSV_PATH, index=False)

print(f"Beispiel-CSV '{SOURCE_CSV_PATH}' erstellt.")

# ETL-Prozess starten

raw_data = extract_data(SOURCE_CSV_PATH)

transformed_data = transform_data(raw_data)

load_data(transformed_data, TARGET_DB_TABLE, DB_CONN_STRING)

# Optional: Daten aus der DB abfragen, um den Erfolg zu überprüfen

if transformed_data is not None:

print("nDaten aus der Datenbank abfragen zur Überprüfung:")

engine = create_engine(DB_CONN_STRING)

with engine.connect() as conn:

query_result = pd.read_sql_table(TARGET_DB_TABLE, conn)

print(query_result.head())

Machine Learning Engineer: Modelle in Produktion bringen

Der Machine Learning Engineer (MLE) fokussiert sich darauf, die von Data Scientists entwickelten Modelle von der experimentellen Phase in produktive Anwendungen zu überführen. Es geht darum, Vorhersagemodelle in Produktion zu bringen, was Skalierbarkeit, Performance, Monitoring und Wartung der Modelle umfasst. Eine Machine Learning Engineer Ausbildung kombiniert Softwareentwicklung mit ML-Kenntnissen.

MLEs sind für die Implementierung von ML-Pipelines, die Auswahl der richtigen Infrastruktur für das Modell-Deployment (z.B. Kubernetes, Docker), das A/B-Testing von Modellversionen und das Monitoring der Modellleistung in Echtzeit verantwortlich. Sie müssen ein tiefes Verständnis für Software-Engineering-Prinzipien haben und sind oft eng mit DevOps-Teams verzahnt.

# Beispiel: Einfache Flask API zur Bereitstellung eines ML-Modells

from flask import Flask, request, jsonify

import joblib

import pandas as pd

app = Flask(__name__)

# Modell laden (angenommen, es wurde zuvor als 'linear_regression_model.pkl' gespeichert)

# Für diesen Beispiel-Code erstellen wir ein Dummy-Modell

# In einem realen Szenario würde hier joblib.load('path/to/your/model.pkl') stehen

class DummyModel:

def predict(self, X):

# Simuliert eine Vorhersage

return (X['Temperatur_Vormittag'] 0.8 + X['Sonnenscheindauer_Vormittag'] 0.5 + 5).values

# Speichern Sie das Dummy-Modell (für den Test)

dummy_model = DummyModel()

joblib.dump(dummy_model, 'linear_regression_model.pkl')

loaded_model = joblib.load('linear_regression_model.pkl')

@app.route('/predict', methods=['POST'])

def predict():

if not request.json:

return jsonify({"error": "Anfrage muss JSON-Format haben."}), 400

data = request.json

# Erwartet z.B.: {"features": {"Temperatur_Vormittag": 15, "Sonnenscheindauer_Vormittag": 6}}

try:

features_df = pd.DataFrame([data['features']])

prediction = loaded_model.predict(features_df)

return jsonify({"prediction": prediction[0]}), 200

except KeyError:

return jsonify({"error": "Fehlende Features im JSON-Body."}), 400

except Exception as e:

return jsonify({"error": str(e)}), 500

if __name__ == '__main__':

# Um die App zu starten: python your_file_name.py

# Dann können Sie POST-Anfragen senden, z.B. mit curl oder Postman:

# curl -X POST -H "Content-Type: application/json" -d '{"features": {"Temperatur_Vormittag": 16, "Sonnenscheindauer_Vormittag": 7}}' http://127.0.0.1:5000/predict

app.run(debug=True)

DevOps und Cloud Engineer: Infrastruktur für Data-Lösungen

Der DevOps Engineer und der Cloud Engineer sind unverzichtbar für die Bereitstellung und den Betrieb moderner Data-Anwendungen. Ihre Expertise sorgt dafür, dass Softwareentwicklung und IT-Betrieb nahtlos ineinandergreifen, insbesondere in Cloud-Umgebungen. Ein DevOps Engineer Bootcamp lehrt die Automatisierung der Bereitstellung von Infrastrukturen, während eine Weiterbildung im Cloud-Computing die spezifischen Kenntnisse für Plattformen wie AWS vermittelt.

DevOps Engineers automatisieren Build-, Test- und Deployment-Prozesse (CI/CD-Pipelines) und fördern die Zusammenarbeit zwischen Entwicklungs- und Betriebsteams. Cloud Engineers sind Experten für die Gestaltung, Implementierung und Verwaltung von Cloud-Infrastrukturen, um Skalierbarkeit, Sicherheit und Kostenoptimierung für datenintensive Anwendungen zu gewährleisten. Die Cloud Engineer Berufsaussichten sind hervorragend, da immer mehr Unternehmen ihre Infrastruktur in die Cloud verlagern.

# Beispiel: Einfaches Dockerfile für eine Python Flask API (wie im ML-Beispiel)

# Verwende ein offizielles Python-Laufzeit-Image als Basis

FROM python:3.9-slim-buster

# Lege das Arbeitsverzeichnis im Container fest

WORKDIR /app

# Kopiere die Abhängigkeitsdateien in das Arbeitsverzeichnis

COPY requirements.txt .

# Installiere die Python-Abhängigkeiten

RUN pip install --no-cache-dir -r requirements.txt

# Kopiere den Rest der Anwendungsdateien in das Arbeitsverzeichnis

COPY . .

# Exponiere den Port, auf dem die Flask-App läuft

EXPOSE 5000

# Definiere den Befehl zum Starten der Anwendung, wenn der Container gestartet wird

# HINWEIS: Für Produktion sollte Gunicorn oder ein ähnlicher WSGI-Server verwendet werden

CMD ["flask", "run", "--host=0.0.0.0", "--port=5000"]

# Beispiel requirements.txt Inhalt:

# Flask

# scikit-learn

# pandas

# joblib

Spezialisierte Datenrollen: MLOps, ETL und DataOps

Neben den Hauptrollen gibt es zunehmend spezialisierte Funktionen, die sich mit spezifischen Herausforderungen im Datenlebenszyklus befassen:

- MLOps (Machine Learning Operations): Eine Disziplin, die darauf abzielt, die Entwicklung, das Deployment und die Wartung von ML-Modellen zu automatisieren und zu optimieren. MLOps integriert DevOps-Praktiken in den ML-Workflow, um einen reibungslosen Übergang von der Forschung zur Produktion zu gewährleisten und die Skalierbarkeit sowie das Monitoring von Modellen zu verbessern. Hier lernen Sie, wie man Vorhersagemodelle in Produktion bringt und deren Lebenszyklus verwaltet.

- ETL Entwickler: Konzentriert sich auf das Design, die Implementierung und die Wartung von Datenpipelines, die für das Extrahieren, Transformieren und Laden von Daten aus verschiedenen Quellen in Data Warehouses oder Data Lakes verantwortlich sind. ETL Entwickler werden ist ein gefragter Weg, um die Grundlagen der Datenintegration zu meistern.

- DataOps Engineer: Eine Methodologie, die die Kommunikation, Integration und Automatisierung zwischen Data Scientists, Data Engineers und anderen Datenexperten verbessert. Ziel ist es, die Qualität, Geschwindigkeit und Zusammenarbeit im gesamten Datenlebenszyklus zu optimieren, um Datenprodukte schneller und zuverlässiger bereitzustellen. Werden Sie zum Experten, um DataOps Workflows zu optimieren und die Datenbereitstellung effizienter zu gestalten.

| Rolle | Primärer Fokus | Kernkompetenzen |

|---|---|---|

| MLOps Engineer | Automatisierung und Management von ML-Modellen in Produktion | CI/CD für ML, Modell-Monitoring, Containerisierung (Docker, Kubernetes) |

| ETL Entwickler | Aufbau und Wartung von Datenpipelines (Extract, Transform, Load) | SQL, Python, Datenintegrationstools (z.B. Apache Nifi, Airflow) |

| DataOps Engineer | Optimierung von Daten-Workflows und Zusammenarbeit | Agile Methoden, Automatisierung, Metadaten-Management, Datenqualität |

Tool-Spezialisierungen: AWS und Power BI Zertifizierungen

Neben rollenspezifischen Kompetenzen ist auch die Expertise in bestimmten Tools und Plattformen von entscheidender Bedeutung. Zertifizierungen wie die AWS Solutions Architect Zertifizierung oder eine Microsoft Power BI Schulung können Ihre Karrierechancen erheblich verbessern und Ihre Datenanalyse Fähigkeiten unterstreichen.

„In der Datenwelt von heute ist es nicht nur entscheidend zu wissen, wie man Probleme löst, sondern auch, welche Werkzeuge man dafür einsetzt. Spezialisierte Zertifikate bestätigen Ihr praktisches Können.“

Die AWS-Zertifizierung zeigt Ihr Fachwissen im Entwurf und der Implementierung von skalierbaren und robusten Systemen auf der weltweit führenden Cloud-Plattform. Dies ist besonders wertvoll für Cloud Engineers und Data Engineers, die mit großen Datenmengen in der Cloud arbeiten. Eine Power BI Schulung hingegen rüstet Data Analysts mit den Fähigkeiten aus, interaktive Dashboards und Berichte zu erstellen, die tiefe Einblicke in Geschäftsdaten ermöglichen und Entscheidungsprozesse unterstützen. Beide Qualifikationen sind ein starker Beleg für Ihre praktische Kompetenz und Ihre Bereitschaft, sich kontinuierlich weiterzubilden.

Wie berufliche Weiterbildungen Ihre Datenkarriere beschleunigen

Der Einstieg oder Aufstieg in die Datenbranche kann herausfordernd sein, angesichts der ständig wachsenden Anforderungen an Fachwissen und der Schnelllebigkeit der Technologien. Hier spielen berufliche Weiterbildungen im Datenbereich eine entscheidende Rolle. Strukturierte Programme, ob in Form von Bootcamps oder spezialisierten Kursen, bieten nicht nur die Möglichkeit, gezielte technische Fähigkeiten zu erwerben, sondern auch praktische Erfahrungen durch realitätsnahe Projekte zu sammeln.

Diese Online-Weiterbildungen Datenberufe sind oft praxisorientiert und werden von erfahrenen Dozenten geleitet, die wertvolle Einblicke in die Branche geben können. Sie helfen Ihnen, ein starkes Portfolio aufzubauen, das potenzielle Arbeitgeber überzeugt. Zudem profitieren Sie von einem Netzwerk aus Gleichgesinnten und Mentoren, was den Einstieg in die Datenbranche erheblich erleichtern kann und einen echten Karriereschub Datenbranche darstellt.

Ihr nächster Schritt in die Datenwelt

Die Datenbranche bietet eine Fülle von Möglichkeiten für Technikbegeisterte, Entwickler und Studierende, die bereit sind, sich den Herausforderungen der Datenanalyse, -entwicklung und -infrastruktur zu stellen. Ob als Data Scientist, Data Analyst, Data Engineer oder in einer spezialisierten Rolle – die Nachfrage nach qualifizierten Talenten ist ungebrochen. Durch gezielte berufliche Weiterbildungen im Datenbereich können Sie sich die notwendigen Fähigkeiten aneignen, um in diesem spannenden Feld erfolgreich zu sein und Ihre Datenkompetenzen zu entwickeln.

Nehmen Sie Ihre Zukunft selbst in die Hand und investieren Sie in eine Weiterbildung, die Ihnen die Türen zu einer erfüllenden Karriere in der Datenwelt öffnet. Erkunden Sie die verschiedenen Karrierepfade und finden Sie den Kurs, der am besten zu Ihren Zielen passt. Der Weg zum Datenexperten ist eine kontinuierliche Lernreise – beginnen Sie noch heute mit Ihrem nächsten Schritt in die Datenwelt!

Vielen Dank für diesen aufschlussreichen Leitfaden! Er zeigt wirklich die Vielfalt und das Potenzial der Datenbranche auf. Meine Frage dazu ist aber, wie diese spannenden Technologien und Rollen für den „Durchschnittsnutzer“ – sei es ein ambitionierter Einsteiger oder ein kleineres Unternehmen – wirklich zugänglich und anwendbar sind. Muss man hierfür immer auf die neueste und teuerste Hardware und Software setzen, oder lassen sich die Kernkompetenzen und -tools auch auf älteren Systemen oder mit begrenzten Ressourcen sinnvoll einsetzen? Oft entsteht der Eindruck, dass man sofort in High-End-Infrastruktur investieren muss, was viele abschrecken könnte. Es wäre super, wenn der Leitfaden auch aufzeigen könnte, welche pragmatischen Einstiegspunkte es gibt, die nicht gleich eine komplette IT-Infrastruktur voraussetzen, und wie man die Komplexität für den täglichen Gebrauch im Lernprozess oder im kleineren Rahmen beherrschbar hält. Ein bodenständiger Ansatz, der auch die Herausforderungen älterer Hardware oder Software berücksichtigt, wäre hier sehr hilfreich.

Vielen dank für ihre ausführliche und durchdachte frage. es ist ein sehr wichtiger punkt, den sie ansprechen, und er berührt genau die herausforderung, wie man die datenbranche für ein breiteres publikum zugänglich macht, ohne sofort in kostspielige infrastrukturen investieren zu müssen.

tatsächlich ist es so, dass viele der kernkompetenzen und -tools im datenbereich auch mit begrenzten ressourcen und auf älteren systemen erlernt und angewendet werden können. der schlüssel liegt oft darin, sich auf die grundlagen zu konzentrieren und cloud-basierte lösungen sowie open-source-tools zu nutzen, die oft kostenlose oder sehr günstige einstiegsmodelle bieten. es ist nicht immer notwendig, auf die neueste und teuerste hardware zu setzen, um wertvolle erkenntnisse aus daten zu gewinnen. ein pragmatischer ansatz, der schrittweise aufgebaut wird, ist hier oft effektiver und weniger abschreckend. ich danke ihnen nochmals für ihren wertvollen beitrag und lade sie herzlich ein, sich auch andere artikel in meinem profil oder meine weiteren veröffentlichungen anzusehen.

Was kosten diese beruflichen Weiterbildungen eigentlich? Mit welchen Gebühren oder langfristigen Kosten muss man hier rechnen? Ich befürchte, das ist am Ende wieder nur für Wohlhabende erschwinglich.

Vielen Dank für Ihre wichtige Frage zu den Kosten beruflicher Weiterbildungen. Sie sprechen einen sehr relevanten Punkt an, der viele Menschen beschäftigt. Es ist verständlich, dass die Sorge besteht, dass solche Angebote nur für Wohlhabende zugänglich sind. Tatsächlich variieren die Kosten erheblich, je nach Art der Weiterbildung, Anbieter und Dauer. Es gibt jedoch auch viele geförderte Programme und Stipendien, die dazu beitragen können, die finanzielle Belastung zu mindern. Oftmals lohnt es sich, bei den jeweiligen Bildungsanbietern direkt nachzufragen und sich über Fördermöglichkeiten zu informieren.

Es ist mir ein Anliegen, dass Bildung für möglichst viele Menschen zugänglich ist, und ich werde in zukünftigen Artikeln genauer auf Finanzierungsmöglichkeiten und Kostenstrukturen eingehen. Ihr Kommentar bestärkt mich darin, dieses Thema noch detaillierter zu beleuchten. Ich danke Ihnen für Ihren wertvollen Beitrag und lade Sie herzlich ein, sich auch andere Artikel in meinem Profil oder meine weiteren Veröffentlichungen anzusehen.