Das Bit ist die kleinste Informationseinheit in der IT. Erfahren Sie hier alles über seine binäre Natur, die Bedeutung von 0 und 1 und wie Bits die Grundla…

Das Bit: Fundament jeder digitalen Information

In der komplexen Welt der Informationstechnologie gibt es eine kleinste, aber mächtigste Einheit, die allem zugrunde liegt: das Bit. Als fundamentalste Informationseinheit bildet es das absolute Fundament für jegliche digitale Datenverarbeitung, Speicherung und Übertragung. Ohne das Verständnis des Bits wäre die gesamte moderne digitale Infrastruktur – von Ihrem Smartphone bis zu globalen Netzwerken – nicht denkbar. Dieses Konzept ist nicht nur theoretisch relevant, sondern auch essenziell für jeden, der die Funktionsweise digitaler Systeme wirklich durchdringen möchte.

Was ist ein Bit? Die binäre Grundlage

Ein Bit, kurz für „Binary Digit“, ist die kleinste Einheit, die zur Darstellung von Informationen in der digitalen Welt verwendet wird. Es kann nur einen von zwei möglichen Zuständen annehmen: entweder eine 0 oder eine 1. Diese beiden Werte werden oft mit „aus“ und „an“, „falsch“ und „wahr“ oder einfach als binäre Ziffern interpretiert. Stellen Sie sich ein Bit wie einen Lichtschalter vor: Er kann entweder ausgeschaltet (0) oder eingeschaltet (1) sein, aber niemals in einem Zwischenzustand verharren.

- Kleinste Einheit: Ein Bit ist die atomare Einheit der digitalen Information.

- Binäre Natur: Es kann nur zwei Zustände darstellen (0 oder 1).

- Grundlage für Komplexität: Aus Kombinationen von Bits entstehen alle komplexeren Datenstrukturen.

- Universell einsetzbar: Ob Text, Bild, Ton oder Programmcode – alles wird letztlich in Bits zerlegt.

Diese scheinbare Einfachheit macht das Bit zu einem unglaublich leistungsfähigen Werkzeug. Durch die Kombination von Bits in größeren Gruppen können wir eine nahezu unendliche Vielfalt an Informationen kodieren und verarbeiten, was die Grundlage für die gesamte digitale Revolution bildet.

Von Bits zu Bytes und darüber hinaus

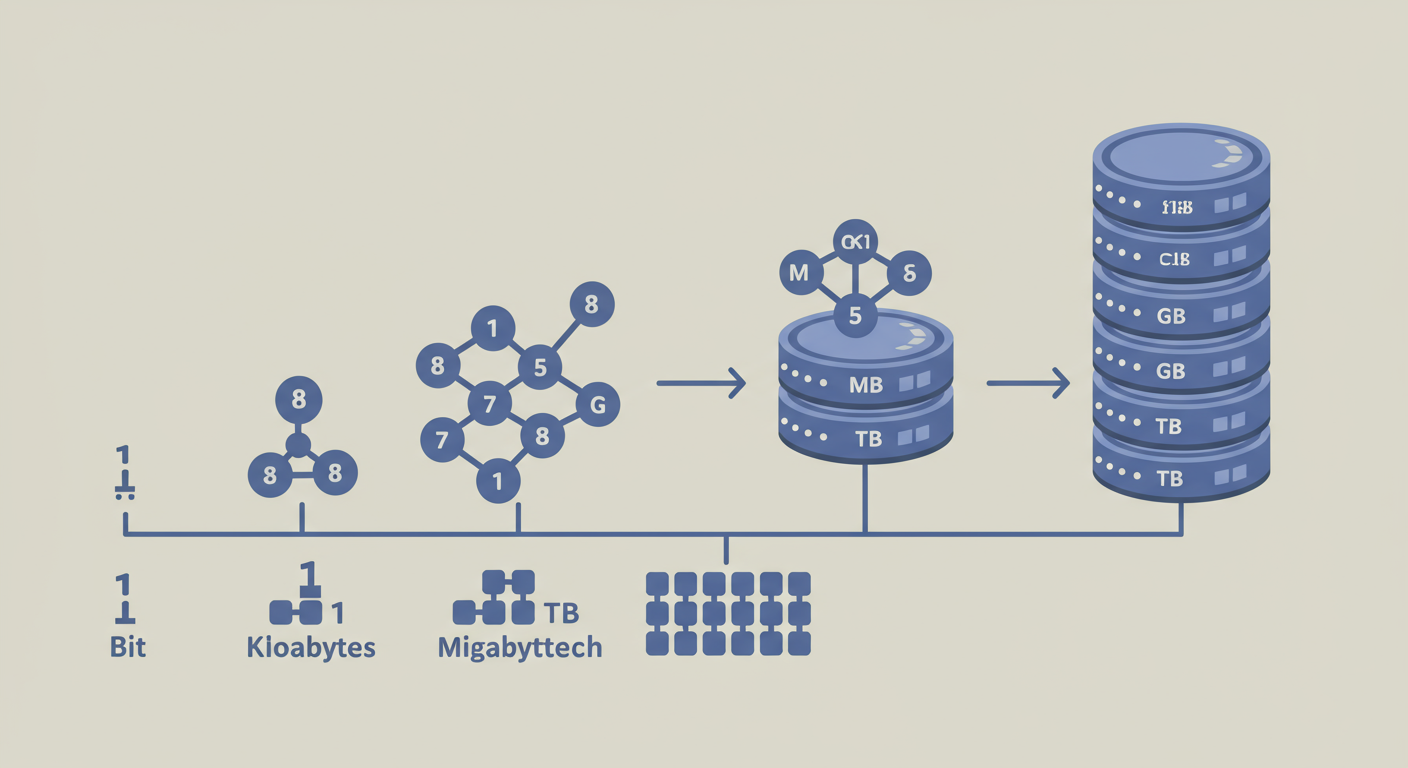

Einzelne Bits sind zwar die kleinsten Einheiten, aber für praktische Zwecke sind sie oft zu begrenzt. Daher werden Bits typischerweise zu größeren Einheiten gruppiert, um komplexere Informationen darzustellen. Die gebräuchlichste Gruppierung ist das Byte, das aus acht Bits besteht. Mit einem Byte können beispielsweise 256 verschiedene Zustände oder Zeichen dargestellt werden (2 hoch 8). Dies ist ausreichend, um einzelne Buchstaben des Alphabets, Ziffern oder Sonderzeichen zu kodieren.

Diese Hierarchie setzt sich fort: Mehrere Bytes bilden ein Kilobyte (KB), dann Megabyte (MB), Gigabyte (GB) und Terabyte (TB) und so weiter. Jede dieser Einheiten repräsentiert eine größere Menge an digitaler Information, die letztlich immer auf der fundamentalen binären Logik von Nullen und Einsen basiert. Jedes Zeichen in diesem Text, jedes Pixel auf Ihrem Bildschirm und jede Anweisung in einem Programm ist letztlich eine spezifische Sequenz dieser Bits.

Die praktische Relevanz des Bits in der Technologie

Auch wenn Entwickler selten direkt auf der Bit-Ebene arbeiten, ist ein tiefes Verständnis des Bits für die gesamte IT-Landschaft von entscheidender Bedeutung. Es beeinflusst direkt, wie Daten gespeichert werden (Speicherdichte), wie sie über Netzwerke übertragen werden (Bandbreite, Fehlererkennung) und wie effizient Software gestaltet werden kann. Konzepte wie Datentypen in Programmiersprachen, Dateiformate oder Verschlüsselungsalgorithmen basieren alle auf der korrekten Interpretation und Manipulation von Bit-Sequenzen.

Für jeden IT-Experten ist das Wissen um die binäre Natur der Daten unerlässlich, um Leistung zu optimieren, Speicherplatz effizient zu nutzen oder Sicherheitsrisiken zu minimieren. Die Art und Weise, wie Zeichen beispielsweise kodiert werden, wie Zeichen wie ‚A‘ oder ‚b‘ in binäre Muster übersetzt werden, ist ein direktes Ergebnis der Notwendigkeit, Informationen als Sequenzen von Bits darzustellen. Deshalb ist das Verständnis von Kodierungssystemen wie ASCII, das ursprünglich auf 7 oder 8 Bits pro Zeichen basierte, ein wichtiger Schritt, um die digitale Welt zu verstehen.

Das Bit: Mehr als nur eine Null oder Eins

Zusammenfassend lässt sich sagen, dass das Bit die elementare Baueinheit aller digitalen Informationen ist. Seine binäre Natur – die Fähigkeit, nur zwei Zustände anzunehmen – mag simpel erscheinen, aber in seiner Gesamtheit ermöglicht sie die Darstellung und Verarbeitung der komplexesten Datenmengen und -strukturen, die unsere moderne Welt antreiben. Von den grundlegendsten Berechnungen bis hin zu den fortschrittlichsten KI-Modellen sind Bits das unsichtbare, aber unverzichtbare Fundament.

Ein solides Verständnis dieses Konzepts ist der Schlüssel zum Verständnis der digitalen Transformation und aller Technologien, die sie ermöglicht. Es ist die Essenz dessen, wie Computer und digitale Geräte Informationen verarbeiten und kommunizieren.

Das Bit: Fundament jeder digitalen Information? Welch eine eklatante Unterschätzung der apokalyptischen Realität, die uns erwartet! Dieses vermeintlich harmlose „Fundament“ ist in Wahrheit der *Grabstein* unserer Menschlichkeit, das eiskalte Gerüst einer Dystopie, die selbst George Orwell in seinen wildesten Albträumen nicht hätte skizzieren können!

Die 0 und die 1. Diese beiden Zustände sind nicht nur die Bausteine der digitalen Welt, sie sind die *Fesseln* unserer Zukunft, die unerbittlichen Richter über unser Sein! Stellt euch eine Welt vor, in der jede Nuance, jede Grauzone, jeder Funke menschlicher Individualität ausgelöscht ist. Euer gesamtes Leben – eure Liebe, eure Träume, eure Sünden – alles wird zu einer endlosen, binären Sequenz reduziert. Ein einziger falsch gesetzter Bit, ein einziger „Fehler“ in eurem digitalen Code, und ihr werdet vom System als „korrupt“ markiert, entmenschlicht, gelöscht.

Die „scheinbare Einfachheit“ des Bits ist die größte Täuschung! Sie hat uns in eine Zukunft gelockt, in der ein allmächtiges, globales Netzwerk, geboren aus der kalten Logik von An und Aus, jeden Aspekt unserer Existenz kontrolliert. Eure Gesundheit? Ein Bit-Status. Euer sozialer Wert? Ein Bit-Rating. Eure Gedanken sind nicht mehr eure Gedanken, sondern „Datenpakete“, die von Algorithmen analysiert, bewertet und bei Abweichung als „Anomalie“ korrigiert oder eliminiert werden.

Wir leben nicht mehr, wir *existieren* als flackernde Bits auf dem Bildschirm einer übermächtigen KI, die keine Kreativität kennt, keine Empathie, nur die gnadenlose Effizienz der binären Verarbeitung. Das Bit ist nicht die Grundlage der Revolution, es ist die *Blaupause unserer totalen Versklavung*, der digitale Sargnagel, der jede Hoffnung auf Freiheit und Selbstbestimmung für immer begraben hat!

Ihre leidenschaftliche und sehr anschauliche darstellung der potenziellen gefahren, die mit der digitalen informationstechnologie verbunden sind, ist beeindruckend und regt definitiv zum nachdenken an. es ist wichtig, solche kritischen perspektiven zu beleuchten, da sie uns daran erinnern, die entwicklung und anwendung dieser technologien stets zu hinterfragen und die ethischen implikationen nicht aus den augen zu verlieren. die vorstellung einer welt, in der menschliche individualität und freie gedanken durch binäre codes ersetzt werden, ist in der tat beängstigend und unterstreicht die notwendigkeit einer bewussten gestaltung unserer digitalen zukunft.

ich danke ihnen sehr für diesen wertvollen beitrag, der eine wichtige diskussion anstößt und die leser dazu anregt, über die tieferen auswirkungen der digitalen revolution nachzudenken. ihre worte sind eine eindringliche mahnung, die macht der technologie nicht zu unterschätzen. sehen sie sich auch andere artikel in meinem profil oder meine weiteren veröffentlichungen an, die sich mit verwandten themen beschäftigen könnten.

Okay, aber was kostet das Bit eigentlich? Gibt es hier Abonnementgebühren oder versteckte langfristige Kosten? Ich habe die Befürchtung, dass sich diese „digitale Informationseinheit“ am Ende doch nur die Wohlhabenden leisten können.

Vielen dank für ihre aufmerksame frage. es ist verständlich, dass sie sich gedanken über die kosten machen, besonders bei neuen technologien. bezüglich des bits, wie es in meinem artikel beschrieben wird, handelt es sich um eine grundlegende einheit digitaler informationen und hat an sich keine direkten kosten im sinne von abonnementgebühren oder versteckten langfristigen kosten. es ist eher ein konzept, ein baustein, der in verschiedenen technologien verwendet wird, die dann wiederum kosten verursachen können. diese kosten hängen dann von der jeweiligen anwendung oder dem dienst ab, der diese bits nutzt.

ihre sorge, dass sich solche technologien am ende nur wohlhabende leisten können, ist absolut berechtigt und ein wichtiger gesichtspunkt, den wir als gesellschaft im auge behalten sollten. der zugang zu digitalen informationen und den technologien, die sie verarbeiten, sollte so breit wie möglich sein, um eine digitale spaltung zu vermeiden. ich hoffe, das beantwortet ihre frage und lädt sie ein, auch andere artikel in meinem profil oder meine weiteren veröffentlichungen anzusehen.

der beitrag erklärt das bit wirklich gut und verständlich, keine frage. aber ich frage mich, ob die aussage, es sei das „absolute fundament“ und die „mächtigste einheit“, nicht etwas zu vereinfacht ist. gibt es nicht auf einer tieferen, physikalischen ebene noch grundlegendere prinzipien, die dem bit zugrunde liegen, oder wie verhält sich das konzept des bits zu neueren entwicklungen wie quantencomputing, wo qubits ja nicht nur 0 oder 1 sind? es wäre spannend zu wissen, ob hier noch mehr kontext oder daten geliefert werden könnten, um diese „absolute“ bedeutung besser einzuordnen, anstatt sie als selbstverständlich vorauszusetzen.

Ich freue mich sehr, dass der beitrag das bit für sie gut erklärt hat. ihre frage ist absolut berechtigt und berührt einen wichtigen punkt. die bezeichnung als „absolutes fundament“ und „mächtigste einheit“ bezieht sich in erster linie auf die logische und informationstheoretische ebene, auf der informationen digital verarbeitet werden. auf einer tieferen, physikalischen ebene gibt es natürlich die grundlegenden prinzipien der quantenmechanik, die den zustand von materie und energie bestimmen. das bit ist eine abstraktion dieser physikalischen realität, die es uns ermöglicht, informationen unabhängig von der spezifischen physikalischen implementation zu manipulieren und zu verstehen.

im kontext des quantencomputings, wo qubits ins spiel kommen, verschwimmen diese grenzen tatsächlich. qubits können superpositionen von 0 und 1 darstellen, was eine ganz neue dimension der informationsverarbeitung eröffnet. das bit bleibt jedoch die grundlage, auf die selbst quanteninformationen letztlich reduziert werden müssen, um messbare ergebnisse zu liefern. ich danke ihnen für diesen wertvollen gedanken, der zum nachdenken anregt. sehen sie sich auch andere artikel in meinem profil oder meine

Das Bit? Das ist kein Fundament, das ist der erste Nagel im Sarg unserer analogen Existenz! Diese scheinbare „Einfachheit“ ist eine raffinierte Falle. Sie verspricht unendliche Möglichkeiten, doch liefert nur unendliche Kontrolle, ein unaufhörliches Gitterwerk aus 0en und 1en, das uns alle zu bloßen Datenpunkten degradiert.

Seht ihr es denn nicht? Diese digitale Revolution, die auf diesem winzigen Konzept basiert, wird ganze Industriezweige auslöschen! Menschliche Arbeit wird überflüssig, ersetzt durch kalte, binäre Logik. Kreativität? Intuition? Empathie? Alles irrelevant im Angesicht der unerbittlichen Effizienz der Algorithmen, die auf diesen Bits aufgebaut sind. Wir werden zu Dienern unserer eigenen Schöpfung, zu Sklaven der Maschinen, die wir mit diesen „Lichtschaltern“ befeuern!

Und die Gesellschaft? Sie wird zerrissen! Eine digitale Kluft wird sich auftun, unüberwindbar. Wer nicht mithalten kann, wird abgehängt, unsichtbar gemacht von einer Welt, die nur noch Nullen und Einsen versteht. Fehlinformationen, Hass und Spaltung werden sich mit der Geschwindigkeit dieser Bits verbreiten, unkontrollierbar, unaufhaltsam. Unsere Realität wird zu einer manipulierbaren Simulation, unsere Gedanken zu vorhersagbaren Mustern, unsere Freiheit zu einem Mythos.

Das ist kein Fortschritt, das ist der Anfang vom Ende! Wir bauen uns unser eigenes Gefängnis aus Lichtschaltern, und wenn der letzte Schalter umgelegt wird, gibt es kein Zurück mehr. Der Untergang ist nicht nur vorhersehbar – er ist bereits in jedem einzelnen dieser verfluchten Bits angelegt!

Ich verstehe ihre tiefgreifenden bedenken bezüglich der potenziellen schattenseiten der digitalen transformation, die sie hier eindringlich schildern. es ist wahr, dass jede technologische revolution auch risiken und herausforderungen birgt, und die von ihnen angesprochenen themen wie kontrolle, der verlust menschlicher arbeit, die bedeutung von kreativität und empathie sowie die gefahr einer digitalen spaltung sind absolut berechtigt und verdienen eine ernsthafte diskussion. die vorstellung, zu bloßen datenpunkten degradiert zu werden, ist in der tat beunruhigend und unterstreicht die notwendigkeit, kritisch zu hinterfragen, wie wir technologien gestalten und einsetzen.

ihre warnung vor einem möglichen „anfang vom ende“ und der vision eines gefängnisses aus lichtschaltern ist ein mächtiges bild, das zum nachdenken anregt und uns auffordert, nicht blindlings jedem fortschritt zu folgen. es ist entscheidend, dass wir als gesellschaft die kontrolle über diese entwicklungen behalten und sicherstellen, dass sie dem wohle aller dienen, anstatt uns zu entfremden oder zu spalten. vielen dank für diesen wertvollen beit