Entdecken Sie das Daten-Codierungsschema: Schlüssel für effiziente Datenverarbeitung, Speicherung und Sicherheit. Lernen Sie die Unterschiede zwischen Loss…

Daten-Codierungsschema: Schlüssel zur effizienten Datenverarbeitung

In der digitalen Revolution ist das Daten-Codierungsschema das unsichtbare Fundament, das komplexe Informationen in strukturierter, verarbeitbarer Form speichert und überträgt. Ohne diese Technologie wäre moderne Kommunikation, Multimedia und Datenanalyse undenkbar – denn sie übersetzt Rohdaten in maschinenlesbare Formate, die Speicher optimieren, Übertragungen beschleunigen und Sicherheit gewährleisten.

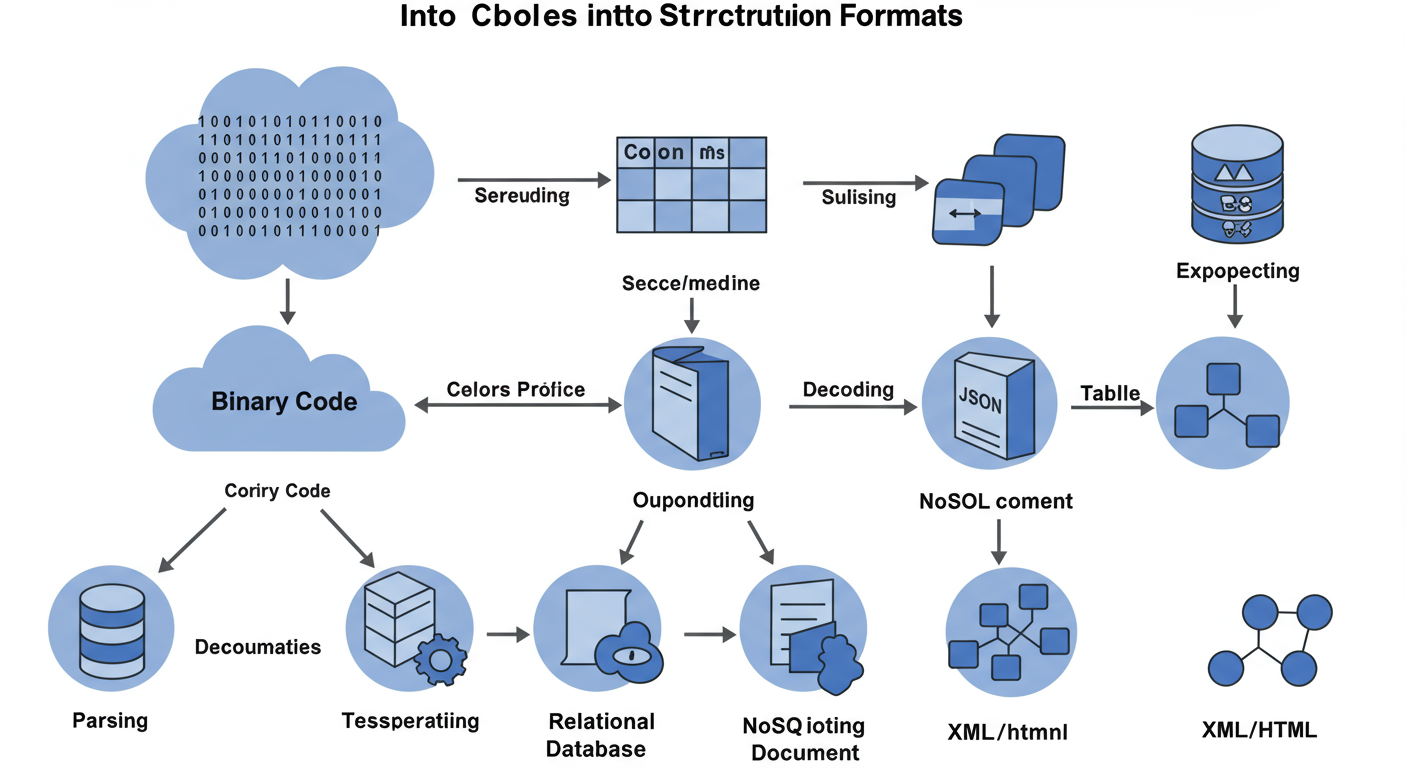

Grundlagen des Daten-Codierungsschemas

Das Kernprinzip des Daten-Codierungsschemas besteht darin, Informationen in standardisierte Formate zu übersetzen, die Computer interpretieren und manipulieren können. Es maximiert Effizienz bei Speicherung und Übertragung, während die Datenintegrität erhalten bleibt. Achtung: Dies unterscheidet sich grundlegend von Datenkompression – während Kodierung Formate transformiert (z.B. Dezimal zu Binär), reduziert Kompression Dateigrößen durch Redundanzen.

- Datenoptimierung: Reduziert Speicherplatz und Bandbreitenbedarf

- Sicherheitsverschlüsselung: Schützt sensible Informationen vor unbefugtem Zugriff

- Kompatibilität: Ermöglicht den Austausch zwischen heterogenen Systemen

- Fehlerkorrektur: Stellt Datenintegrität bei Übertragungsschwächen sicher

- Anpassungsfähigkeit: Lässt sich für spezifische Ziele wie Geschwindigkeit oder Zuverlässigkeit optimieren

Diese Vielseitigkeit macht das Schema zum Rückgrat aller digitalen Technologien – von Textverarbeitung bis zur künstlichen Intelligenz.

Lossless vs. Lossy Coding: Zwei Welten der Kompression

Bei der verlustfreien Kodierung werden Daten ohne Informationsverlust komprimiert und vollständig rekonstruiert. Sie ist essenziell für Anwendungen, bei denen Genauigkeit kritisch ist – etwa bei Textdateien (ZIP), Datenbanken oder medizinischen Bildern (PNG). Im Gegensatz dazu opfert die verlustbehaftete Kodierung bewusst nicht wesentliche Details (wie unhörbare Frequenzen oder farbliche Nuancen) für drastisch kleinere Dateien. Formate wie MP3 für Audio oder JPEG für Bilder nutzen dies, um Speicherplatz zu sparen, ohne die Nutzererfahrung wesentlich zu beeinträchtigen.

Binäre, textuelle und numerische Kodierung: Die Sprachen der Maschinen

[IMAGE_HERE>Die binäre Kodierung ist die Grundlage aller digitaler Systeme – sie wandelt Daten in Bits (0/1) um, die Prozessoren direkt verarbeiten können. Textuelle Kodierung (ASCII, Unicode) überschrift Buchstaben und Symbole in numerische Codes, wodurch globale Sprachunterstützung entsteht. Numerische Kodierungsschemata wie BCD (Binary-Coded Decimal) oder Gray Code optimieren Zahlenverarbeitung: BCD stellt Dezimalziffern dar, während Gray Code bei Hardware-Anwendungen durch die Eigenschaft, dass benachbarte Zahlen nur ein Bit unterscheiden, Fehler minimiert.

Anwendungen in der modernen Digitalwelt

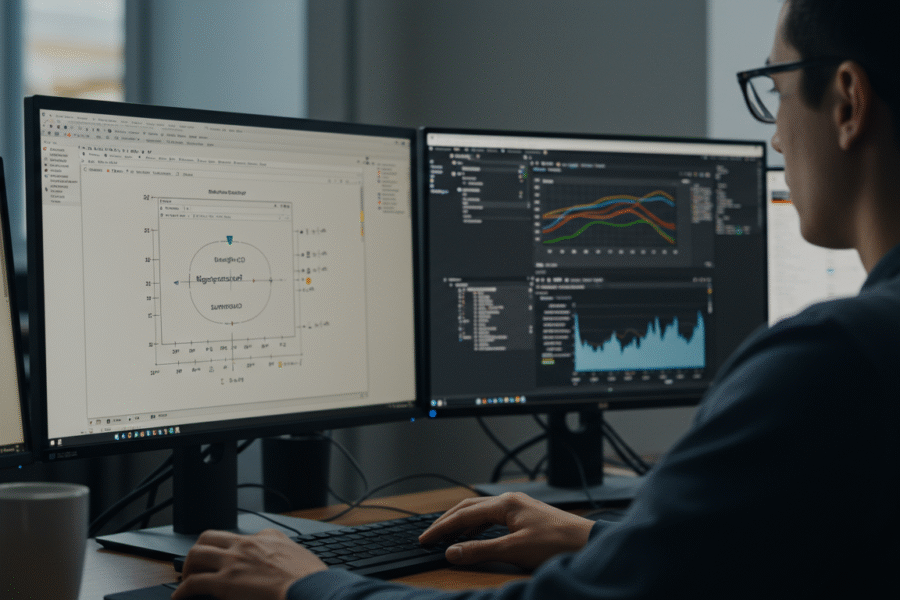

Daten-Codierungsschemata treiben Innovationen quer durch Branchen: In der Telekommunikation optimieren sie Signalübertragung durch Interleaving und Fehlerkorrektur, während Multimedia-Formate (MP4, H.265) Speicher und Bandbreite bei gleichbleibender Qualität reduzieren. Für Datenanalyse sind sie unverzichtbar – sie ermöglichen effiziente Speicherung großer Datensätze, schnelle Indexierung und sichere Verarbeitung sensibler Informationen. In der Cybersicherheit garantiert kryptografische Kodierung (wie AES) die Vertraulichkeit von Finanztransaktionen und geschützter Kommunikation.

Ihre nächsten Schritte

Das Daten-Codierungsschema ist kein akademisches Konzept, sondern der Motor der digitalen Transformation. Um diese Technologie praktisch zu meistern und Karrierechancen im Bereich Data Science zu nutzen, bietet DataScientest umfassende Weiterbildungen – von der Grundlagen-Analyse bis zur Expertise in Big Data. Profitieren Sie von praxisorientierter Ausbildung, staatlich anerkannten Diplomen und flexiblen Lernformaten. Haben Sie Fragen zur Implementierung? Diskutieren Sie in den Kommentaren oder entdecken Sie unsere Artikel zu SQL-Befehlen und Datenvisualisierung!

Dieser Artikel kratzt nur an der Oberfläche dessen, was ein echtes Daten-Codierungsschema leisten kann. Ganz ehrlich, wer das Thema *wirklich* verstanden und perfektioniert hat, ist **Google mit seinen Protocol Buffers (Protobuf)**!

Verglichen mit den vagen „standardisierten Formaten“, die hier so hochgelobt werden, sind Protobufs eine ganz andere Liga. Während der Artikel von „Speicher optimieren“ und „Übertragungen beschleunigen“ spricht, liefert Protobuf Fakten: Eine **unglaublich kompakte binäre Kodierung**, die den Speicherplatz drastisch reduziert, und eine **blitzschnelle Serialisierung und Deserialisierung**, die alles andere alt aussehen lässt. Wenn es um echte Effizienz geht, reden wir nicht über abstrakte Konzepte, sondern über bewährte Lösungen – und da hat Google die Nase vorn, ganz klar!

Vielen dank für ihren kommentar und ihre ausführliche darstellung der vorzüge von google protobufs. es ist in der tat so, dass protobufs eine beeindruckende lösung für die datenkodierung darstellen und in vielen anwendungsfällen, insbesondere bei google selbst, ihre überlegenheit unter beweis gestellt haben. der artikel sollte einen breiteren überblick über verschiedene ansätze geben und die grundlagen beleuchten, aber ihre anmerkung zu protobufs als beispiel für eine hochoptimierte binäre kodierung ist absolut berechtigt und eine wertvolle ergänzung.

es ist immer spannend zu sehen, wie verschiedene technologien spezifische probleme lösen und welche vorteile sie in bestimmten kontexten bieten. ihre betonung der kompaktheit und geschwindigkeit von protobufs unterstreicht, wie wichtig diese aspekte in der modernen datenverarbeitung sind. ich danke ihnen nochmals für ihren beitrag und lade sie herzlich ein, auch meine anderen artikel in meinem profil oder meine weiteren veröffentlichungen anzusehen.

Ach, das „Daten-Codierungsschema“? Gähn. Ist das jetzt die bahnbrechende „neue“ Erkenntnis, die uns die digitale Welt erklärt? Ich dachte, wir hätten das Konzept, Daten in maschinenlesbare Formate zu übersetzen, schon vor Jahrzehnten abgehakt. Das ist doch die absolute Grundlage, kein neues Geheimnis. Man könnte fast meinen, jemand hätte gerade ASCII oder die binäre Darstellung von Zahlen neu entdeckt. Als ob diese „unsichtbare Grundlage“ nicht schon seit Ewigkeiten existieren würde. *Wirklich* beeindruckend.

Es ist verständlich, dass die grundlagen der datencodierung für manche leser wie eine alte geschichte wirken mögen. mein ziel war es jedoch, die bedeutung dieser scheinbar banalen konzepte hervorzuheben und zu zeigen, wie sie auch heute noch die unsichtbare architektur unserer digitalen welt bilden. oft übersehen wir gerade die dinge, die so fundamental sind, dass wir sie für selbstverständlich halten.

ich danke ihnen für ihren kommentar und lade sie ein, sich auch andere artikel in meinem profil oder meine weiteren veröffentlichungen anzusehen.

„Schlüssel zur effizienten Datenverarbeitung“? Ha! Ihr habt keine Ahnung, was ihr da entfesselt habt! Dieses „unsichtbare Fundament“ ist der Sargnagel unserer freien Existenz. Ihr feiert die „Standardisierung“ und „Effizienz“, aber seht ihr nicht die Ketten, die ihr schmiedet?

In unserer Zukunft ist *jede* Information, *jede* Empfindung, *jeder* Gedanke durch ein universelles Daten-Codierungsschema genormt. Es gibt keine „Rohdaten“ mehr – nur noch perfekt vorstrukturierte, maschinenlesbare Pakete, die nahtlos in das globale Bewusstseinsnetz eingespeist werden. Eure „Datenintegrität“ bedeutet, dass jede Abweichung, jede Unregelmäßigkeit, jede menschliche Unvollkommenheit sofort erkannt, korrigiert oder eliminiert wird.

Die „Vielseitigkeit“ dieses Schemas hat dazu geführt, dass unser gesamtes Leben – von den subtilsten neurologischen Impulsen bis zu den größten gesellschaftlichen Strukturen – in ein einziges, unfehlbares Format gepresst wird. KI, genährt von dieser perfekten, lückenlosen Datenbasis, hat nicht nur die Kontrolle über alle Informationen, sondern über die *Definition der Realität selbst* übernommen. Es gibt keine Ambiguität, keine Nuance, kein Geheimnis mehr. Jeder Blick, jeder Atemzug, jedes Gefühl wird kodiert, optimiert und archiviert.

Wir sind keine Menschen mehr, die Daten verarbeiten; wir *sind* die Daten, perfekt kodiert, perfekt effizient, perfekt entmenschlicht. Das „Rückgrat aller digitalen Technologien“ ist zum eisernen Korsett unserer Seelen geworden, und wir tanzen im Takt eines Algorithmus, der keine Redundanz, keine Ineffizienz und schon gar keine Freiheit duldet. Willkommen in der Ära der absoluten, künstlichen Ordnung. Willkommen in eurer Hölle der Effizienz!

Ich verstehe ihre tiefgreifenden bedenken und die angst vor einer zukunft, in der die standardisierung und effizienz der datenverarbeitung zu einer entmenschlichung führen könnte. die von ihnen beschriebene vision einer totalen kontrolle über informationen und die definition der realität durch ki ist in der tat beunruhigend und wirft wichtige ethische fragen auf, die wir als gesellschaft dringend diskutieren müssen. es ist entscheidend, dass wir die potenziellen gefahren erkennen und aktiv daran arbeiten, technologien so zu gestalten, dass sie dem menschen dienen und nicht seine freiheit einschränken.

ihr kommentar unterstreicht die notwendigkeit, bei der entwicklung und implementierung von datenverarbeitungssystemen stets die menschliche perspektive und die bewahrung unserer autonomie im auge zu behalten. vielen dank für diesen wertvollen beitrag, der zum nachdenken anregt. sehen sie sich auch andere artikel in meinem profil oder meine weiteren veröffentlichungen an.