In der rasanten Landschaft der modernen Softwareentwicklung sind Container zu einem Eckpfeiler geworden, um die Portabilität, Konsistenz und Reproduzierbarkeit von Anwendungen sicherzustellen. Sie kapseln eine Anwendung mitsamt all ihren Abhängigkeiten in einer leichtgewichtigen, isolierten Umgebung, die unabhängig von der zugrunde liegenden Infrastruktur konsistent funktioniert. Dieser Ansatz ist für Entwickler und DevOps-Teams gleichermaßen von unschätzbarem Wert, da er die Verwaltung von Entwicklungs-, Test- und Produktionsumgebungen erheblich vereinfacht und beschleunigt. Doch wie werden diese wertvollen Container-Pakete verwaltet und geteilt? Hier kommt Docker Hub ins Spiel – die zentrale Plattform zur Speicherung von Docker-Images.

Dieser ausführliche Blogbeitrag beleuchtet die Funktionen, Vorteile und die strategische Bedeutung von Docker Hub. Wir tauchen tief in die Konzepte von Docker Images und Repositories ein, untersuchen die leistungsstarken Automatisierungsoptionen wie Automated Builds und Webhooks, und vergleichen Docker Hub mit anderen führenden Container-Registries. Ziel ist es, Entwicklern, Studierenden und Technologiebegeisterten ein umfassendes Verständnis für dieses fundamentale Werkzeug zu vermitteln, angereichert mit praktischen Erklärungen und Codebeispielen zur effizienten Verteilung containerisierter Anwendungen.

Die Rolle von Docker Hub in der Container-Welt

Seit seiner Einführung im Jahr 2013 hat sich Docker Hub als die führende Speicher- und Austauschplattform für Docker Images etabliert. Im Kern ist Docker Hub eine Cloud-basierte Registry, die es Benutzern ermöglicht, Docker Images zu veröffentlichen, zu finden und zu verwalten. Es dient als zentraler Katalog, über den sowohl offizielle, von Docker validierte Images als auch von der Gemeinschaft oder Unternehmen erstellte Container-Images sicher verwalten und zugänglich gemacht werden können. Die Plattform hat maßgeblich dazu beigetragen, die Verbreitung und Standardisierung von Container-Technologien voranzutreiben, indem sie eine reibungslose kontinuierliche Integration (CI) und Bereitstellung (CD) unterstützt.

Die zentrale Verwaltung von Containern durch Docker Hub vereinfacht den Workflow für Teams erheblich. Anstatt sich um die lokale Speicherung und manuelle Verteilung von Image-Dateien kümmern zu müssen, können Entwickler und Operateure auf eine weltweit zugängliche Quelle zugreifen. Dies fördert die Kollaboration, da alle Teammitglieder jederzeit Zugriff auf die gleichen, versionierten Anwendungsbilder haben, was Konsistenz über verschiedene Entwicklungs-, Test- und Produktionsumgebungen hinweg gewährleistet und das „Neuerfinden des Rades“ überflüssig macht.

Grundlagen von Docker Images und Repositories

Ein Docker Image ist eine leichtgewichtige, eigenständige und ausführbare Paketvorlage, die alles enthält, was eine Softwareanwendung zum Ausführen benötigt: den Code, eine Laufzeitumgebung, Systemwerkzeuge, Systembibliotheken und Einstellungen. Images sind schreibgeschützt und bestehen aus mehreren Ebenen (Layers), die übereinander gestapelt sind. Jede Ebene stellt eine Änderung am darunterliegenden Layer dar, was Speichereffizienz und schnelle Builds ermöglicht. Eine Docker Registry ist ein Speichersystem für diese Images. Docker Hub ist die bekannteste öffentliche Registry.

Innerhalb von Docker Hub werden Images in Repositories organisiert. Ein Repository ist eine Sammlung von Docker Images mit demselben Namen, aber unterschiedlichen Tags, die verschiedene Versionen oder Varianten des Images kennzeichnen (z.B. my-app:latest, my-app:v1.0, my-app:develop). Man unterscheidet grundsätzlich zwischen zwei Arten von Repositories:

- Öffentliche Repositories: Diese sind für jeden zugänglich und sichtbar. Sie eignen sich hervorragend zum Teilen von Open-Source-Projekten, Basis-Images oder nützlichen Tools mit der breiten Entwicklergemeinschaft. Millionen von öffentliche Docker Repositories stehen zur Verfügung, von Betriebssystemen wie Ubuntu bis hin zu Datenbanken wie PostgreSQL oder Webservern wie Nginx.

- Private Repositories: Diese bieten eingeschränkten Zugriff und sind nur für autorisierte Benutzer oder Teams sichtbar. Sie sind unerlässlich für die Entwicklung proprietärer Anwendungen oder interner Unternehmensprojekte, die Vertraulichkeit erfordern. Durch Zugriffskontrollen kann genau festgelegt werden, wer welche Images sehen oder herunterladen darf.

Ein Beispiel, wie man ein Image von Docker Hub herunterlädt und ein eigenes hochlädt:

# 1. Ein offizielles Nginx-Image von Docker Hub herunterladen (pull)

docker pull nginx:latest

# 2. Eine einfache Webanwendung in ein Docker Image packen

# Erstelle eine Datei namens Dockerfile in einem neuen Verzeichnis:

# --- Dockerfile ---

# FROM alpine:latest

# LABEL author="Your Name"

# LABEL version="1.0"

# RUN apk add --no-cache nginx

# COPY index.html /var/www/localhost/htdocs/

# EXPOSE 80

# CMD ["nginx", "-g", "daemon off;"]

# --- End Dockerfile ---

# Erstelle eine index.html im selben Verzeichnis

# --- index.html ---

# <h1>Hallo von meinem Docker Container!</h1>

# --- End index.html ---

# 3. Das Image bauen (Tagging mit Repository-Name und Tag)

# Ersetze 'yourusername' durch deinen Docker Hub Benutzernamen

docker build -t yourusername/my-web-app:v1.0 .

# 4. Sich bei Docker Hub anmelden (falls noch nicht geschehen)

docker login

# 5. Das selbst erstellte Image auf Docker Hub hochladen (push)

docker push yourusername/my-web-app:v1.0

Dieser einfache Workflow zeigt die grundlegende Interaktion mit Docker Hub: Images beziehen, eigene erstellen und sie für andere freigeben.

Offizielle Images und Community-Beiträge

Die Bibliothek von Docker Hub ist riesig und bietet eine Fülle von Images. Ein besonderes Merkmal sind die „Offiziellen Images“. Diese werden von Docker selbst oder in enger Zusammenarbeit mit den Originalentwicklern der jeweiligen Software gepflegt und sind strengen Prüfungen unterzogen, um ihre Qualität, Sicherheit und Konsistenz zu gewährleisten. Sie dienen oft als vertrauenswürdige Basiselemente, auf denen Entwickler ihre eigenen Anwendungen aufbauen können, und minimieren das Risiko von Schwachstellen durch unzuverlässige Abhängigkeiten.

„Offizielle Docker Images sind die Goldstandards für Reproduzierbarkeit und Sicherheit, die eine robuste Basis für jede containerisierte Anwendung bilden.“

Neben den offiziellen Images gibt es eine enorme Anzahl von Community-Images, die von einzelnen Entwicklern oder Organisationen bereitgestellt werden. Diese können eine breite Palette von spezifischen Anwendungsfällen abdecken und sind oft ein Zeugnis der Innovationskraft der Docker-Community. Bei der Verwendung von Community-Images ist jedoch Vorsicht geboten: Es ist ratsam, die Herkunft, die Popularität, die Anzahl der Downloads und die Aktualität des Images zu überprüfen, um potenzielle Sicherheitsrisiken oder Inkompatibilitäten zu vermeiden. Oftmals bieten die Repository-Seiten auf Docker Hub Informationen zu Dockerfiles und Build-Prozessen, die eine transparente Einschätzung ermöglichen.

Ein einfaches Dockerfile, das ein offizielles Image als Basis verwendet:

# Verwende das offizielle Python 3.9 Slim Image als Basis

FROM python:3.9-slim-buster

# Lege das Arbeitsverzeichnis im Container fest

WORKDIR /app

# Kopiere die Abhängigkeitsdatei in das Arbeitsverzeichnis

COPY requirements.txt .

# Installiere die Python-Abhängigkeiten

RUN pip install --no-cache-dir -r requirements.txt

# Kopiere den Rest der Anwendung in das Arbeitsverzeichnis

COPY . .

# Definiere den Port, auf dem die Anwendung lauschen wird

EXPOSE 8000

# Definiere den Befehl, der beim Starten des Containers ausgeführt werden soll

CMD ["python", "app.py"]

Dieses Beispiel zeigt, wie man ein vertrauenswürdiges Basis-Image nutzt, um eine Python-Anwendung zu containerisieren. Es ist eine bewährte Praxis, schlanke Basis-Images (wie -slim oder alpine-Varianten) zu wählen, um die Image-Größe zu minimieren und die Angriffsfläche zu reduzieren.

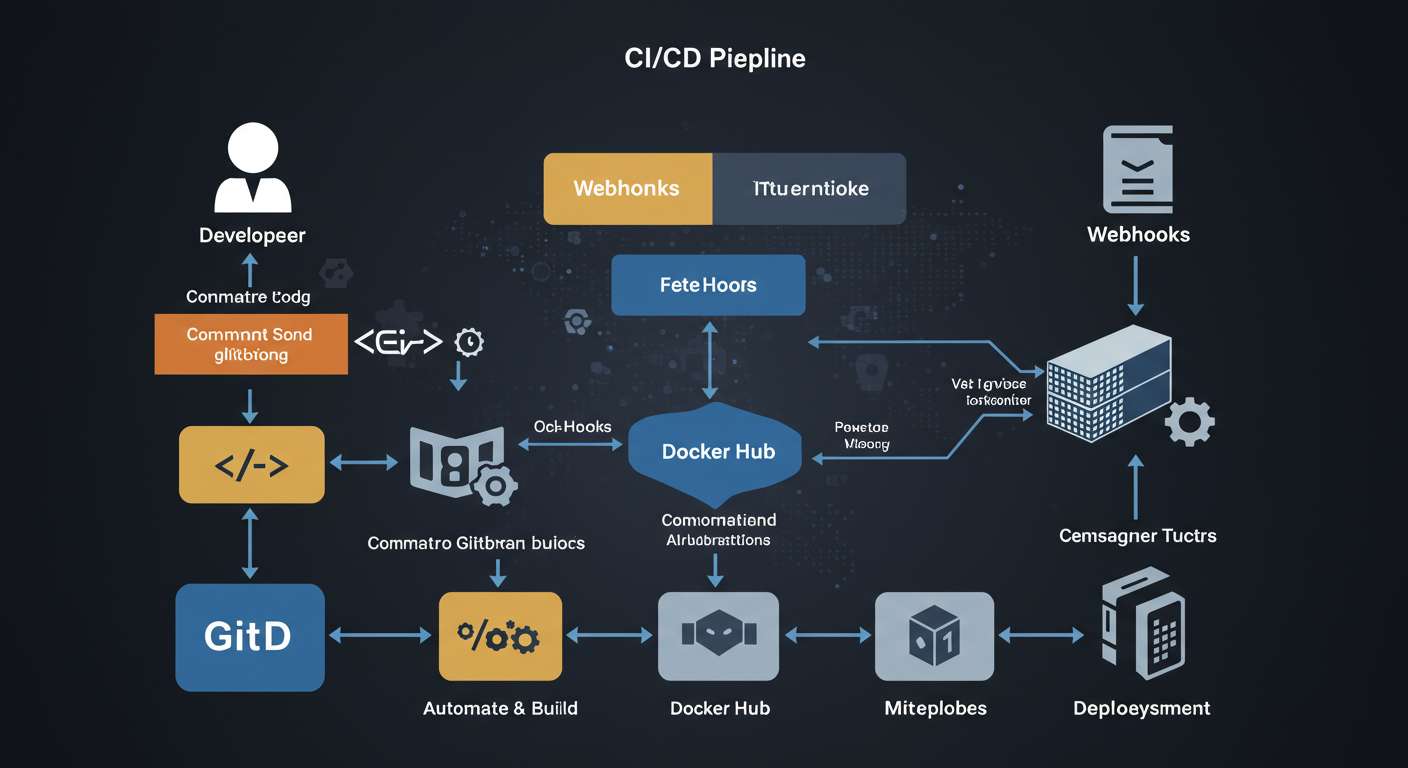

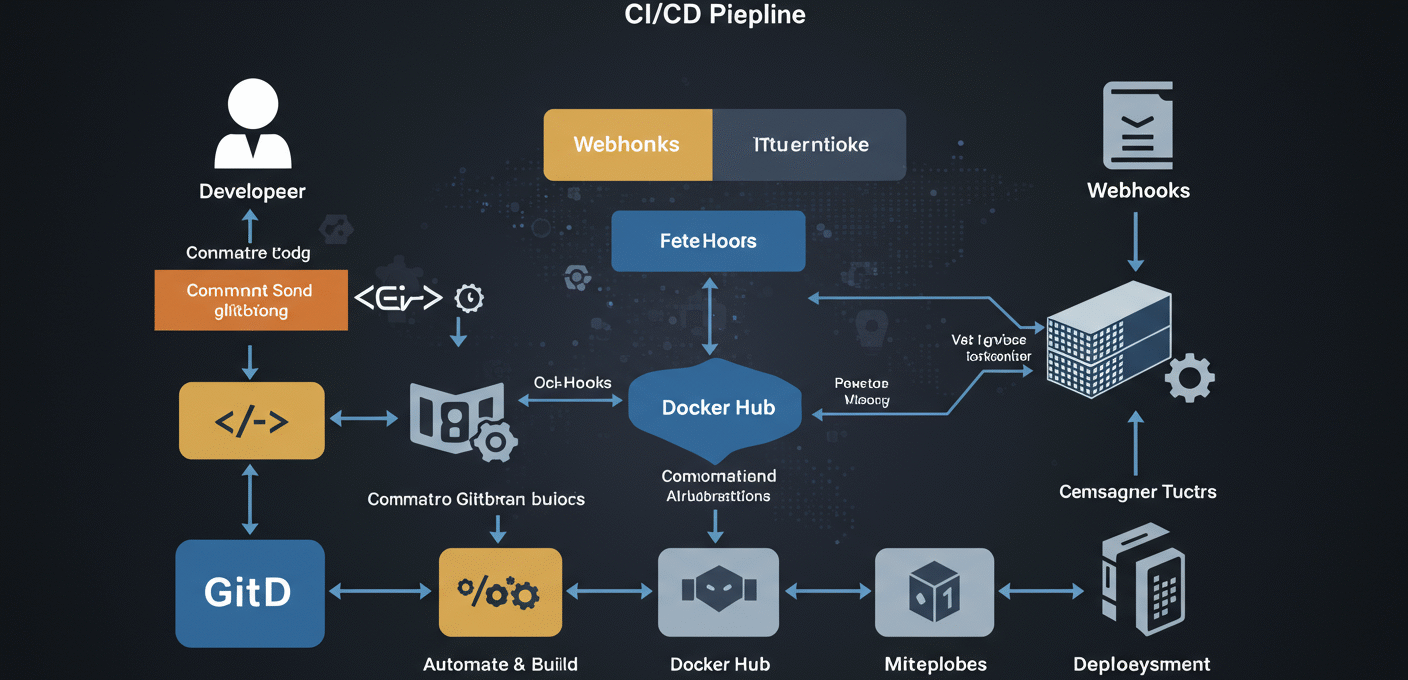

Automatisierung und Integration mit Docker Hub

Eines der mächtigsten Merkmale von Docker Hub ist seine Fähigkeit zur Automatisierung, die es zu einem integralen Bestandteil moderner CI/CD-Pipelines mit Docker Hub macht. Diese Automatisierungsoptionen vereinfachen den Build-, Test- und Deployment-Prozess erheblich, indem sie manuelle Schritte eliminieren und die Konsistenz sicherstellen.

Automated Builds und Dockerfile-Integration

Der Automated Build, oft auch „Autobuild“ genannt, ist eine Funktion, die Docker Hub direkt mit Versionskontrollsystemen wie GitHub, GitLab oder BitBucket verbindet. Wenn diese Integration eingerichtet ist, kann Docker Hub ein spezifisches Code-Repository überwachen. Sobald eine Änderung am Dockerfile oder dem damit verknüpften Code in diesem Repository festgestellt wird (z.B. ein Commit oder ein Merge auf einen bestimmten Branch), wird automatisch ein neues Docker Image auf Docker Hub erstellt und getaggt. Dies stellt sicher, dass die Container-Images immer aktuell sind und die neuesten Codeänderungen widerspiegeln.

Die Vorteile des Automatischer Docker Image Build sind vielfältig:

- Konsistenz: Eliminierung menschlicher Fehler bei manuellen Builds.

- Aktualität: Images sind immer auf dem neuesten Stand des Quellcodes.

- Transparenz: Der Build-Prozess ist nachvollziehbar und reproduzierbar.

- Effizienz: Beschleunigt den Entwicklungszyklus, da Builds im Hintergrund ablaufen.

So könnte ein vereinfachter Dockerfile für einen Automated Build aussehen, der bei jeder Änderung im Git-Repository ein neues Image erzeugt:

# Dockerfile in deinem Git-Repository

# Basierend auf einem stabilen Node.js Image

FROM node:18-alpine

# Setze das Arbeitsverzeichnis

WORKDIR /app

# Kopiere package.json und package-lock.json

COPY package.json ./

# Installiere Abhängigkeiten

RUN npm install

# Kopiere den Rest der Anwendung

COPY . .

# Baue die Frontend-Anwendung (falls vorhanden)

RUN npm run build

# Exponiere den Port

EXPOSE 3000

# Starte die Anwendung

CMD ["npm", "start"]

Durch die Konfiguration auf Docker Hub wird dieses Dockerfile genutzt, um ein Image zu erstellen, sobald Änderungen in deinem verbundenen Git-Repository gepusht werden. Die Tags für die Images können dabei dynamisch anhand von Git-Tags oder Branch-Namen festgelegt werden.

Webhooks für CI/CD-Workflows

Webhooks sind ein weiterer leistungsstarker Mechanismus zur Automatisierung von Aktionen. Sie ermöglichen es Docker Hub, externe Systeme zu benachrichtigen, sobald bestimmte Ereignisse eintreten – beispielsweise wenn ein Image erfolgreich gebaut oder ein neues Image in einem Repository hochgeladen wurde. Diese Benachrichtigungen erfolgen in Form von HTTP-POST-Anfragen an eine konfigurierte URL und enthalten detaillierte Informationen über das Ereignis.

Durch die Nutzung von Webhooks können DevOps-Teams eine nahtlose Integration in ihre CI/CD-Pipelines erreichen. Ein typisches Szenario ist:

- Ein Entwickler pusht Codeänderungen in ein Git-Repository.

- Docker Hub führt einen Automated Build durch und erstellt ein neues Image.

- Nach erfolgreichem Build sendet Docker Hub einen Webhook an ein CI/CD-System (z.B. Jenkins, GitLab CI, CircleCI).

- Das CI/CD-System empfängt den Webhook und löst automatisch weitere Schritte aus, wie z.B. das Ausführen von Integrationstests mit dem neuen Image, das Scannen des Images auf Schwachstellen oder das Deployment des neuen Containers in eine Staging- oder Produktionsumgebung.

Ein Beispiel für eine vereinfachte GitLab CI/CD Konfiguration, die auf Docker Hub-Events reagieren könnte (vereinfacht, da die direkte Reaktion auf eingehende Webhooks oft einen dazwischengeschalteten Service erfordert):

# .gitlab-ci.yml

stages:

- build

- test

- deploy

variables:

DOCKER_IMAGE_NAME: $CI_REGISTRY_IMAGE/my-app # Beispiel für GitLab Registry

build_image:

stage: build

script:

- docker login -u $DOCKER_HUB_USERNAME -p $DOCKER_HUB_PASSWORD

- docker build -t $DOCKER_HUB_USERNAME/my-app:$CI_COMMIT_SHA .

- docker push $DOCKER_HUB_USERNAME/my-app:$CI_COMMIT_SHA

only:

- master

test_image:

stage: test

script:

- docker pull $DOCKER_HUB_USERNAME/my-app:$CI_COMMIT_SHA

- docker run $DOCKER_HUB_USERNAME/my-app:$CI_COMMIT_SHA /bin/test_suite.sh # Führe Tests im Container aus

needs: ["build_image"]

deploy_production:

stage: deploy

script:

- echo "Deploying $DOCKER_HUB_USERNAME/my-app:$CI_COMMIT_SHA to production..."

- # Hier würden Befehle für das Deployment in die Produktion stehen,

- # z.B. kubectl apply -f kubernetes-config.yml

environment:

name: production

only:

- master

when: manual # Manuelles Deployment nach erfolgreichen Tests

Dieses Beispiel zeigt, wie Docker Hub als zentraler Speicherpunkt fungiert, von dem aus die CI/CD-Pipeline getriggert wird oder Images abruft. Webhooks würden in diesem Fall direkt auf Docker Hub konfiguriert, um GitLab (oder einen anderen CI-Service) zu benachrichtigen, anstatt dass GitLab selbst den Build initiiert.

Vorteile und Anwendungsbereiche von Docker Hub

Die Nutzung von Docker Hub bietet eine Vielzahl von Vorteilen, die es zu einem unverzichtbaren Werkzeug für Einzelentwickler bis hin zu großen Unternehmen machen, die auf Container-Technologien setzen.

Zentrale Verwaltung und globale Zugänglichkeit

Einer der größten Vorteile ist die Fähigkeit, alle verwendeten Docker Images zentral an einem Ort zu speichern und zu verwalten. Anstatt Images auf verschiedenen lokalen Servern, Entwickler-Workstations oder in verteilten Dateisystemen zu speichern, bietet Docker Hub eine einzige Quelle der Wahrheit. Dies ermöglicht es DevOps-Teams, schnell und zuverlässig auf die gleichen, versionierten Ressourcen zuzugreifen, was die Zusammenarbeit erheblich vereinfacht und Synchronisationsprobleme vermeidet.

Die globale Zugänglichkeit ist ein weiterer entscheidender Faktor. Entwickler können von jedem Ort der Welt aus über das Internet auf die verfügbaren Images zugreifen und diese herunterladen. Dies unterstützt Remote-Arbeit und verteiltes Engineering effektiv und sorgt für Kontinuität in der Anwendungsentwicklung. Egal ob ein Teammitglied in Berlin, New York oder Bangalore sitzt, jeder kann auf die exakt gleichen standardisierten Umgebungen zugreifen. Dies reduziert Fehler, die durch lokale Konfigurationsunterschiede entstehen könnten, und gewährleistet, dass eine Anwendung auf jedem System, das Docker ausführen kann, identisch funktioniert.

Beschleunigtes Anwendungs-Deployment

Die Bereitstellung (Deployment) von Anwendungen ist oft ein zeitaufwändiger und fehleranfälliger Prozess. Docker Hub beschleunigt diesen Prozess massiv. Anstatt jede Umgebung manuell konfigurieren oder schwere Installationspakete von einem Server auf einen anderen verschieben zu müssen, können die auf Docker Hub gespeicherten Container-Images schnell heruntergeladen und sofort ausgeführt werden. Dies reduziert die Integrations- und Produktionsverzögerungen erheblich.

Im Kontext von CI/CD-Pipelines ermöglicht Docker Hub eine automatisierte, schnelle Bereitstellung. Sobald ein neues Image gebaut und getestet wurde, kann es mit minimalem Aufwand in Staging- oder Produktionsumgebungen ausgerollt werden. Dieser „Build once, run anywhere“-Ansatz ist das Herzstück der Containerisierung und wird durch eine zentrale Image-Registry wie Docker Hub optimal unterstützt. Es ermöglicht Unternehmen, schneller auf Marktbedürfnisse zu reagieren und Software-Updates effizienter bereitzustellen.

Docker Hub im Ökosystem der Container-Registries

Obwohl Docker Hub oft als die Standard-Registry wahrgenommen wird, ist es bei weitem nicht die einzige Option auf dem Markt. Es existieren zahlreiche andere Container-Registries, die jeweils unterschiedliche Schwerpunkte und Integrationsgrade mit Cloud-Ökosystemen oder spezifischen Sicherheitsanforderungen bieten. Ein Docker Registry Lösungen vergleichen hilft dabei, die beste Wahl für die jeweiligen Projektanforderungen zu treffen.

Vergleich der wichtigsten Docker Registry Lösungen

Um die Stärken und Schwächen von Docker Hub im Vergleich zu seinen Mitbewerbern zu verdeutlichen, betrachten wir eine Auswahl populärer Alternativen:

| Merkmal | Docker Hub | GitHub Container Registry (GHCR) | Amazon ECR | Quay.io |

|---|---|---|---|---|

| Primäre Nutzung | Allgemeine Public/Private Registry | GitHub-integrierte Registry | AWS-integrierte Registry | Sicherheitsorientierte Registry |

| Öffentliche Images | Sehr umfangreiche Bibliothek (Offizielle Images, Community) | Begrenzt, Fokus auf GitHub-Projekte | Keine öffentliche Bibliothek im klassischen Sinne | Gute Public Library, oft mit Red Hat Fokus |

| Private Images | Verfügbar, tierbasierte Preisgestaltung | Nahtlos mit GitHub Packages integriert | Tief in AWS IAM integriert | Starke Fokus auf Sicherheit und Audit |

| Integration | Native Docker-Integration, viele CI/CD-Tools | Eng mit GitHub Actions und GitHub-Ökosystem | Tief in AWS-Services (ECS, EKS, Lambda) | Breite CI/CD-Integration, OpenShift/Kubernetes |

| Sicherheitsfeatures | Basis-Scans (optional), Trust Images | GH-Sicherheitsfeatures (CodeQL), Dependabot | Tief integrierte IAM-Kontrollen, Image-Scanning | Integrierte Schwachstellenanalyse, Image-Signierung, Notar |

| Benutzerfreundlichkeit | Sehr hoch, ideal für Anfänger und kleine Teams | Gute Integration für GitHub-Nutzer | Für AWS-Nutzer gut, sonst Lernkurve | Etwas komplexer, aber mächtig |

| Preismodell | Kostenlos für Einzelpersonen (begrenzt), Abonnements | Teilweise kostenlos, dann basierend auf Nutzung | Pay-as-you-go, basierend auf Speicher und Datentransfer | Kostenlos für Open Source, Abonnements |

Docker Hub zeichnet sich durch seine enorme öffentliche Image-Bibliothek und seine einfache Handhabung aus. Es ist oft die erste Anlaufstelle für Entwickler und kleinere Teams und bietet eine gute Balance zwischen Benutzerfreundlichkeit und Funktionalität. Die breite Akzeptanz und die große Community sind ebenfalls große Vorteile.

GitHub Container Registry (GHCR) ist ideal für Teams, die bereits stark im GitHub-Ökosystem verankert sind. Sie ermöglicht es, Container-Images direkt neben dem Quellcode zu speichern, was die Versionsverwaltung und die Automatisierung von Entwicklungspipelines über GitHub Actions erleichtert. Es ist eine logische Wahl für GitHub-zentrierte Workflows.

Amazon ECR (Elastic Container Registry) ist tief in das AWS-Ökosystem integriert und daher die präferierte Wahl für Unternehmen, die ihre Infrastruktur bereits auf AWS betreiben. Es profitiert von der robusten Sicherheit und Skalierbarkeit von AWS, einschließlich detaillierter Zugriffskontrollen über IAM und integrierten Image-Scanning-Funktionen.

Quay.io (von Red Hat) legt einen besonders starken Fokus auf Sicherheit und Compliance. Es bietet erweiterte Funktionen wie integrierte Schwachstellenanalysen, geografische Replikation und umfangreiche Audit-Protokolle. Quay.io wird oft von Unternehmen mit strengen Sicherheits- und Compliance-Anforderungen gewählt.

Auswahlkriterien für die richtige Registry

Die Wahl der richtigen Container-Registry hängt von verschiedenen Faktoren ab:

- Ecosystem-Integration: Passt die Registry zu deiner vorhandenen Cloud-Infrastruktur (AWS, Azure, GCP) oder deinem Versionskontrollsystem (GitHub, GitLab)?

- Sicherheitsanforderungen: Wie kritisch sind Funktionen wie Schwachstellenanalyse, Image-Signierung oder feingranulare Zugriffskontrollen?

- Budget: Die Preismodelle variieren erheblich, insbesondere bei Speichervolumen und Datentransfer.

- Teamgröße und -erfahrung: Für Anfänger oder kleine Teams ist eine benutzerfreundliche Oberfläche wie die von Docker Hub oft vorteilhafter.

- Art der Images: Benötigst du Zugang zu einer großen öffentlichen Bibliothek oder hauptsächlich private Repositories?

- Compliance: Gibt es spezifische regulatorische Anforderungen, die bestimmte Sicherheits- oder Audit-Funktionen vorschreiben?

Für viele Projekte, insbesondere im Start-up-Bereich oder bei Open-Source-Initiativen, bleibt Docker Hub aufgrund seiner Einfachheit, Verbreitung und der umfassenden öffentlichen Bibliothek eine ausgezeichnete Wahl. Für größere Unternehmen mit spezifischen Cloud-Strategien oder extrem hohen Sicherheitsanforderungen könnten spezialisierte Lösungen wie ECR oder Quay.io besser geeignet sein. Der Schlüssel ist eine fundierte Entscheidung, die auf den individuellen Bedürfnissen und Prioritäten basiert, um Docker Images entwickeln und teilen zu können.

Best Practices und zukünftige Entwicklungen

Um die Vorteile von Docker Hub maximal auszuschöpfen und potenzielle Fallstricke zu vermeiden, ist die Einhaltung bewährter Methoden unerlässlich. Zudem entwickelt sich die Container-Landschaft ständig weiter, was ein Auge auf zukünftige Trends erfordert.

Sicherheitsaspekte und Image-Hygiene

Sicherheit ist bei der Verwendung von Container-Images von größter Bedeutung. Ein kompromittiertes Image kann ein Einfallstor für Angriffe auf die gesamte Anwendungsinfrastruktur sein. Hier sind einige Best Practices:

- Verwende vertrauenswürdige Basis-Images: Bevorzuge offizielle Images oder solche von bekannten, seriösen Anbietern als Grundlage für deine Builds.

- Minimale Images: Nutze alpine- oder slim-Varianten von Basis-Images, um die Angriffsfläche zu reduzieren. Weniger Software bedeutet weniger potenzielle Schwachstellen.

- Multi-Stage Builds: Trenne den Build-Prozess von der Laufzeitumgebung, um Entwicklungswerkzeuge und unnötige Abhängigkeiten aus dem finalen Image zu entfernen.

- Image-Scanning: Scanne deine Images regelmäßig auf bekannte Schwachstellen. Tools wie Trivy, Clair oder integrierte Scanner von Registries (wie ECR, Quay.io) können hierbei helfen. Docker Hub bietet grundlegendes Scanning, aber externe Tools bieten oft tiefere Analysen.

- Regelmäßige Updates: Halte deine Basis-Images und die darauf aufbauende Software stets aktuell, um Patches für Sicherheitslücken zu erhalten.

- Secrets Management: Speichere niemals sensible Daten (API-Schlüssel, Passwörter) direkt in einem Docker Image. Nutze stattdessen Secret Management-Systeme (z.B. Docker Secrets, Kubernetes Secrets, HashiCorp Vault) zur Laufzeit.

Ein Beispiel für einen Multi-Stage Build, der die Image-Größe und somit die Angriffsfläche minimiert:

# Stage 1: Build-Umgebung

FROM node:18-alpine AS builder

WORKDIR /app

COPY package.json ./

RUN npm install

COPY . .

RUN npm run build --prod

# Stage 2: Produktions-Umgebung (sehr schlank)

FROM alpine:latest

WORKDIR /app

# Installiere Nginx für das Serving der statischen Dateien

RUN apk add --no-cache nginx

# Kopiere die gebauten Artefakte aus dem Builder-Stage

COPY --from=builder /app/dist /var/www/localhost/htdocs/

# Konfiguriere Nginx

COPY nginx.conf /etc/nginx/nginx.conf

EXPOSE 80

CMD ["nginx", "-g", "daemon off;"]

Dieses Dockerfile erzeugt ein wesentlich kleineres und sichereres Produktions-Image, da es nur die finalen Artefakte und den Webserver enthält, nicht aber die Entwicklungsabhängigkeiten und Build-Tools.

Strategien für effiziente Image-Verwaltung

Eine durchdachte Strategie zur Image-Verwaltung ist entscheidend für die Effizienz von DevOps-Teams:

- Konsistente Tagging-Strategien: Verwende aussagekräftige Tags, um Images zu versionieren (z.B. SemVer:

v1.2.3, oder Git-SHA für Entwicklungs-Builds). Derlatest-Tag sollte nur für stabile, produktionsreife Versionen oder als Zeiger auf die neueste stabile Version verwendet werden. - Regelmäßige Bereinigung: Entferne alte, nicht mehr benötigte Images aus deinen Repositories. Dies spart Speicherplatz und reduziert die Verwirrung. Docker Hub bietet Tools zur Verwaltung von Repository-Tags, einschließlich der automatischen Entfernung nach einer bestimmten Zeit oder Anzahl von Versionen.

- Nutze Webhooks und Automated Builds optimal: Integriere Docker Hub vollständig in deine CI/CD-Pipelines, um manuelle Schritte zu eliminieren und den Workflow zu beschleunigen.

- Dokumentation: Dokumentiere klar, welche Images wofür verwendet werden, welche Abhängigkeiten sie haben und wie sie zu bauen sind.

Fazit und Ausblick auf die Container-Zukunft

Docker Hub hat sich als unbestreitbar zentrales Werkzeug in der modernen Softwareentwicklung etabliert. Es ist die Anlaufstelle für die zentrale Verwaltung, Speicherung und Verteilung containerisierter Anwendungen und ein Katalysator für effiziente DevOps-Praktiken. Trotz der Herausforderungen in Bezug auf Sicherheit, Kostenmanagement und Abhängigkeit von einer stabilen Internetverbindung überwiegen seine Vorteile bei weitem, insbesondere durch die enorme Bibliothek offizieller und Community-Images sowie die leistungsstarken Automatisierungsfunktionen.

Die Fähigkeit, Docker Images entwickeln und teilen zu können, hat die Art und Weise, wie Software bereitgestellt wird, revolutioniert. Für Entwickler, Studenten und Technologiebegeisterte, die tiefgehende Informationen zu Container-Technologien suchen, ist das Verständnis von Docker Hub unerlässlich. Es bildet die Grundlage für skalierbare, portable und konsistente Anwendungsumgebungen, die in der Cloud-nativen Welt von heute und morgen unverzichtbar sind. Die besten Praktiken für Image-Hygiene und effiziente Verwaltung werden weiterhin entscheidend sein, um das volle Potenzial dieser Plattform auszuschöpfen und die Sicherheit und Leistungsfähigkeit von Anwendungen zu gewährleisten.

Wir hoffen, dieser umfassende Einblick in Docker Hub hat Ihnen wertvolle Erkenntnisse geliefert. Teilen Sie Ihre Gedanken und Erfahrungen in den Kommentaren unten! Für weitere Artikel zu ähnlichen Themen rund um Softwareentwicklung und DevOps, schauen Sie sich gerne unsere anderen Beiträge an und bleiben Sie mit den neuesten Entwicklungen in der Technologiebranche auf dem Laufenden.

Häufig gestellte Fragen zu Docker Hub

Was ist der Hauptzweck von Docker Hub?

Der Hauptzweck von Docker Hub ist es, als zentrale Cloud-Registry für Docker Images zu dienen. Es ermöglicht Entwicklern und DevOps-Teams, Docker Images zu speichern, zu verwalten, zu finden und zu teilen. Dadurch wird die Verteilung containerisierter Anwendungen standardisiert und vereinfacht, was die Portabilität und Reproduzierbarkeit von Softwareumgebungen sicherstellt.

Kann ich private Images auf Docker Hub hosten?

Ja, Docker Hub bietet die Möglichkeit, private Repositories zu erstellen. Diese privaten Container-Images sind nur für Sie oder von Ihnen autorisierte Benutzer und Teams zugänglich. Dies ist besonders nützlich für proprietäre Projekte oder sensible interne Entwicklungen, die ein hohes Maß an Vertraulichkeit erfordern und eine zentrale Verwaltung von Containern mit eingeschränktem Zugriff ermöglichen.

Wie unterscheidet sich Docker Hub von GitHub Container Registry?

Docker Hub ist eine eigenständige, weit verbreitete Registry mit einer sehr großen Bibliothek an öffentlichen Images. GitHub Container Registry (GHCR) ist hingegen tief in das GitHub-Ökosystem integriert. Während Docker Hub oft als allgemeine Lösung dient, ist GHCR ideal für Projekte, die ihren Quellcode und ihre Container-Images im selben GitHub-Repository verwalten und GitHub Actions für CI/CD nutzen. Der wesentliche Unterschied liegt also in der primären Integration und der Zielgruppe.

Ist Docker Hub kostenlos nutzbar?

Docker Hub bietet einen kostenlosen Tarif für Einzelpersonen, der eine begrenzte Anzahl von privaten Repositories und Pull-Anfragen pro Stunde oder Tag beinhaltet. Für Teams oder Unternehmen mit höheren Anforderungen an private Repositories, Pull-Limits, Automatisierungsfunktionen oder erweiterte Sicherheitsfunktionen sind kostenpflichtige Abonnementmodelle verfügbar. Es ist wichtig, die verschiedenen Tarife zu prüfen, um die beste Option für Ihre Plattform zur Speicherung von Docker-Images zu finden.

Wenn Docker Hub als die „zentrale Plattform zur Speicherung von Docker-Images“ fungiert, welche Daten werden dort *tatsächlich* gesammelt? Geht es nur um die Images selbst, oder werden auch detaillierte Metadaten über deren Nutzung, Ersteller und Abhängigkeiten erfasst und analysiert? Wer hat Zugriff auf diese „Cloud-basierte Registry“ und die darin enthaltenen Informationen – nicht nur Docker selbst, sondern auch unbekannte Dritte, die möglicherweise ganz andere Interessen verfolgen?

Was geschieht mit den potenziell sensiblen Daten, die unwissentlich in einem hochgeladenen Image landen könnten? Wer garantiert, dass versehentlich exponierte API-Schlüssel, Konfigurationsdateien oder proprietärer Code nicht in einem öffentlichen oder sogar privaten Repository dauerhaft gespeichert und kompromittiert werden? Ein „zentraler Katalog“ mag effizient sein, aber ist er nicht auch ein einzigartiges Ziel für Datenlecks und weitreichende Überwachung?

Und am beunruhigendsten: Wer profitiert letztlich von der zentralen Sammlung all dieser Entwicklungsdaten, unserer Arbeitsabläufe und unseres geistigen Eigentums? Zu welchem Preis opfern wir unsere Datensouveränität und die Privatsphäre unserer Projekte auf diesem Altar der Bequemlichkeit?

Das sind in der Tat sehr wichtige und berechtigte Fragen, die Sie hier aufwerfen. Es ist entscheidend, sich über die Implikationen einer zentralisierten Plattform wie Docker Hub im Klaren zu sein, insbesondere wenn es um Datensicherheit und -souveränität geht. Die Erfassung von Metadaten über die Nutzung, Ersteller und Abhängigkeiten ist ein komplexes Thema, das von den Nutzungsbedingungen und Datenschutzrichtlinien des Anbieters abhängt. Es ist immer ratsam, diese genau zu prüfen, um zu verstehen, welche Informationen gesammelt und wie sie verwendet werden.

Die Sorge um potenziell sensible Daten, die unwissentlich in einem hochgeladenen Image landen könnten, ist absolut verständlich. Dies unterstreicht die Notwendigkeit für Entwickler, äußerste Sorgfalt walten zu lassen und sicherzustellen, dass keine vertraulichen Informationen in ihren Images enthalten sind, bevor sie diese hochladen. Die Frage nach dem Zugriff und der Sicherheit ist zentral, und hier spielen sowohl die technischen Sicherheitsmaßnahmen des Anbieters als auch die vertraglichen Vereinbarungen eine entscheidende Rolle. Vielen Dank für diesen wertvollen Kommentar, der eine wichtige Diskussion anstößt. Sehen Sie sich auch andere Artikel in

Interessanter Überblick über Docker Hub. Allerdings frage ich mich, ob die Behauptung, es sei „die führende Speicher- und Austauschplattform“, noch ganz zutrifft, besonders im Hinblick auf die zunehmende Nutzung von alternativen Registries wie Quay.io, GitHub Container Registry oder cloud-spezifischen Lösungen wie ECR und GCR. Gibt es aktuelle Marktanteilszahlen oder Daten, die diese Führungsposition untermauern, oder bezieht sich das eher auf die historische Rolle?

Vielen dank für ihren durchdachten kommentar und die berechtigte frage bezüglich der führenden position von docker hub. sie haben vollkommen recht, der markt für container-registries hat sich in den letzten jahren erheblich weiterentwickelt und diversifiziert. meine aussage bezog sich in erster linie auf die historische bedeutung und die immer noch sehr breite nutzung von docker hub, insbesondere für öffentliche images und als standard-anlaufstelle für viele entwickler.

es ist absolut richtig, dass alternativen wie quay.io, github container registry und die cloud-spezifischen lösungen wie ecr und gcr immer mehr an bedeutung gewinnen, besonders in unternehmensumgebungen mit spezifischen sicherheits- und integrationsanforderungen. detaillierte, aktuelle marktanteilszahlen sind oft schwer zu bekommen und variieren je nach definition und fokus der studie. ich werde diesen aspekt in zukünftigen artikeln sicherlich noch genauer beleuchten und die entwicklung der landschaft der container-registries weiterhin verfolgen. ich danke ihnen nochmals für ihren wertvollen input und lade sie ein, sich auch andere artikel in meinem profil oder meine weiteren veröffentlichungen anzusehen.