Erfahren Sie, was Echtzeit-Anwendungen sind und warum sie kritisch sind. Entdecken Sie Architekturen, Herausforderungen und Best Practices für garantierte L…

Echtzeit-Anwendungen: Schnelle Reaktionen in der digitalen Welt

In der heutigen schnelllebigen digitalen Landschaft sind Echtzeit-Anwendungen kein Luxus mehr, sondern oft eine absolute Notwendigkeit. Sie sind das Rückgrat vieler kritischer Systeme, von der Finanzwelt über industrielle Automatisierung bis hin zu interaktiven Online-Erlebnissen. Eine Echtzeit-Anwendung ist darauf ausgelegt, Daten zu verarbeiten und darauf zu reagieren, sodass die Antwort innerhalb eines streng definierten Zeitrahmens erfolgt. Dies unterscheidet sie grundlegend von herkömmlichen Anwendungen, bei denen Verzögerungen tolerierbar sind. Das Verständnis ihrer Funktionsweise, ihrer Architekturen und der damit verbundenen Herausforderungen ist entscheidend für Entwickler und Systemarchitekten, die auf zuverlässige und sofortige Systemantworten angewiesen sind.

Das Wesen von Echtzeit-Systemen

Das Kernmerkmal einer Echtzeit-Anwendung ist ihre Fähigkeit, Aufgaben innerhalb garantierter Zeitgrenzen (Deadlines) zu erfüllen. Diese Zeitgrenzen sind nicht nur wünschenswert, sondern essenziell für die korrekte Funktion des Systems. Je nach Kritikalität unterscheidet man verschiedene Arten von Echtzeitsystemen, die alle spezifische Anforderungen an Design und Implementierung stellen und tiefgreifendes technisches Verständnis voraussetzen. Die präzise Einhaltung dieser Zeitvorgaben erfordert sorgfältige Planung auf allen Ebenen, von der Hardware bis zur Software-Architektur.

- Hard Real-Time Systeme: Verpassen einer Deadline führt zu katastrophalen Systemausfällen oder schweren Schäden. Beispiele hierfür sind Flugsteuerungssysteme, lebenserhaltende medizinische Geräte oder Steuerungssysteme in kritischen industriellen Anlagen.

- Soft Real-Time Systeme: Das Verpassen einer Deadline führt zu einer Verschlechterung der Dienstqualität, aber nicht zu einem vollständigen Systemversagen. Streaming-Dienste, VoIP-Anwendungen oder Online-Spiele fallen oft in diese Kategorie, bei denen eine leichte Verzögerung die Benutzererfahrung beeinträchtigt, aber keine kritischen Folgen hat.

- Firm Real-Time Systeme: Das Verpassen einer Deadline macht das Ergebnis nutzlos, aber ein einzelner Fehler ist nicht katastrophal. Beispiele könnten Batch-Verarbeitungssysteme sein, bei denen Ergebnisse nach einer bestimmten Zeit nicht mehr relevant sind oder für die weitere Verarbeitung zu spät kommen.

Diese Unterscheidung ist fundamental, da sie die Komplexität und die Risiken bei der Entwicklung und dem Testen solcher Systeme maßgeblich beeinflusst.

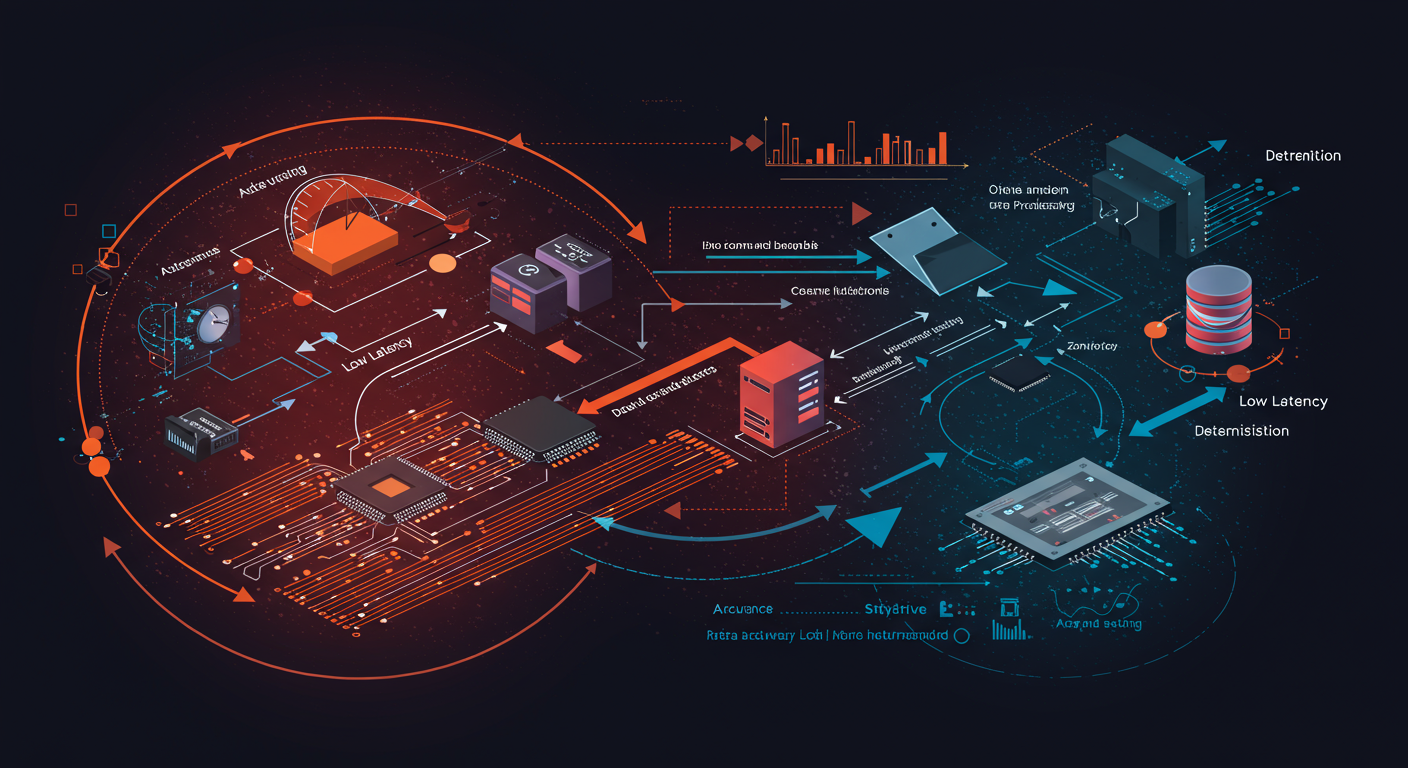

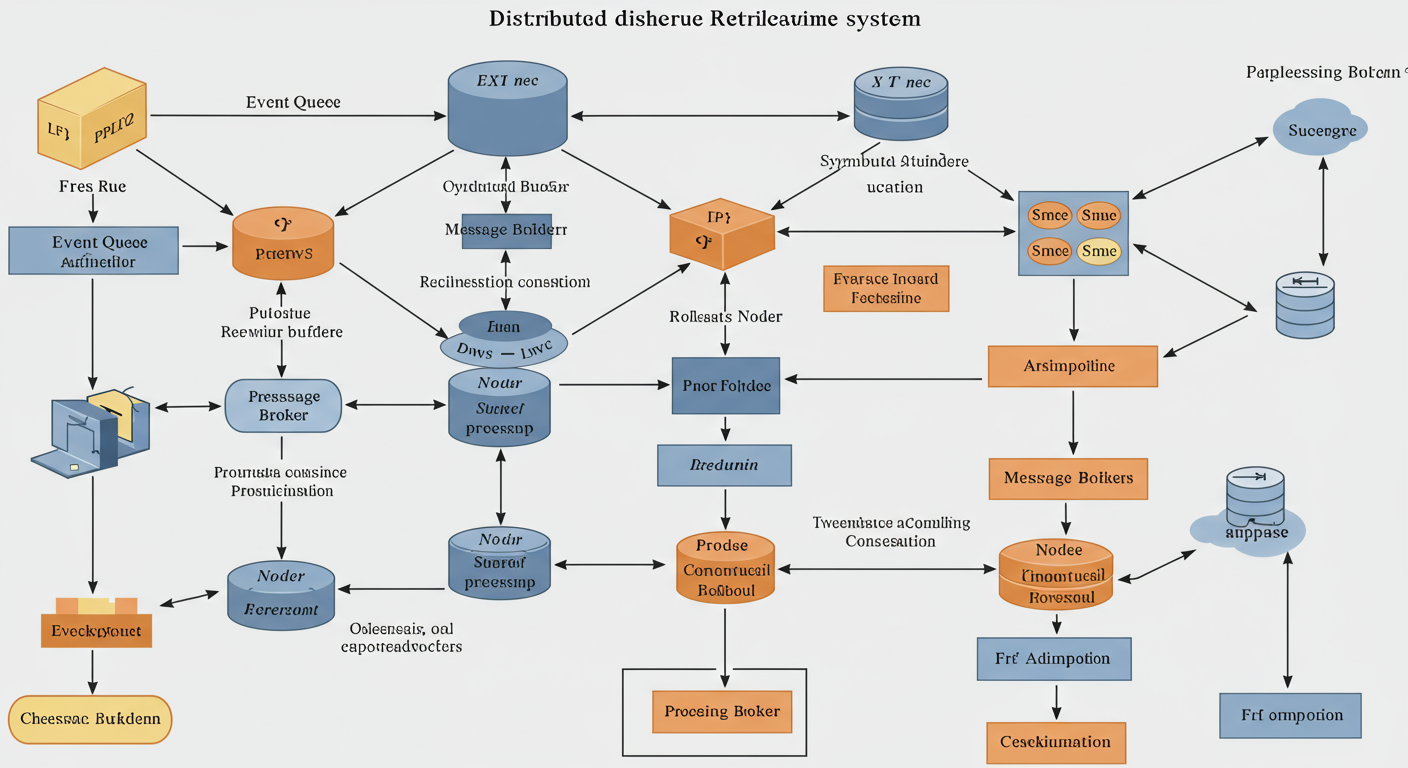

Architektonische Herausforderungen bei Echtzeit-Systemen

Die Entwicklung von Echtzeit-Anwendungen stellt Architekten vor einzigartige Herausforderungen. Im Gegensatz zu Systemen, die auf maximale Durchsatzleistung optimiert sind, müssen Echtzeit-Systeme oft auf minimale Latenz und Vorhersagbarkeit ausgelegt sein. Dies erfordert oft verteilte Architekturen, die eine schnelle und zuverlässige Kommunikation zwischen verschiedenen Komponenten ermöglichen. Der Einsatz von Event-Driven Architectures (EDA) und robusten Messaging-Systemen wie Kafka oder RabbitMQ ist hierbei von zentraler Bedeutung, um sicherzustellen, dass Ereignisse zeitnah verarbeitet werden und keine kritischen Informationen verloren gehen.

Eine weitere wichtige Komponente ist das Task-Scheduling. In Echtzeit-Betriebssystemen (RTOS) kommen oft deterministische Scheduling-Algorithmen zum Einsatz, die sicherstellen, dass die wichtigsten Tasks mit der höchsten Priorität stets zuerst ausgeführt werden. Dies ist entscheidend, um garantierte Antwortzeiten zu erreichen, insbesondere in Systemen mit vielen konkurrierenden Prozessen, wo eine Millisekunde über Erfolg oder Misserfolg entscheiden kann.

Leistungsoptimierung und garantierte Latenz

Die Gewährleistung einer konstanten, niedrigen Latenz ist das A und O bei Echtzeit-Anwendungen. Aus meiner Erfahrung in der Entwicklung komplexer Systeme hat sich gezeigt, dass dies oft einen tiefen Einblick in die Hardware-Ressourcen, das Betriebssystem und die zugrundeliegenden Netzwerkprotokolle erfordert. Techniken wie effizientes Caching, optimierte Datenstrukturen, die Minimierung von Kontextwechseln auf Betriebssystemebene und die Vermeidung von Blocking-Operationen sind unerlässlich. Dies erfordert oft ein tiefes Verständnis von Betriebssystemkonzepten wie Interrupt-Handling und Speicherverwaltung.

Für die Kommunikation zwischen verteilten Komponenten sind oft Low-Latency-Messaging-Queues oder dedizierte Protokolle wie gRPC oder Message Queuing Telemetry Transport (MQTT) für IoT-Szenarien die erste Wahl. Ein typisches Muster in der Praxis ist die Implementierung eines event-basierten Modells, bei dem ein bestimmtes Ereignis eine sofortige Reaktion auslöst. Stellen Sie sich beispielsweise ein System zur Überwachung von Maschinendaten vor: Ein ungewöhnlicher Sensorwert löst sofort eine Benachrichtigung aus, anstatt darauf zu warten, bis ein periodischer Scan durchgeführt wird. Die Herausforderung liegt darin, dies deterministisch zu gestalten.

Beispiel (Konzeptionell, Pseudocode):

// Pseudocode für eine Echtzeit-Ereignisverarbeitungsschleife mit Deadline-PrüfungLOOP UNTIL SHUTDOWN:

// Warte auf ein eingehendes Ereignis, mit maximaler Latenz als Timeout

EVENT = WAIT_FOR_EVENT(timeout=MAX_LATENCY);

IF EVENT IS NOT NULL:

START_TIMER();

PROCESS_EVENT(EVENT);

END_TIMER();

// Prüfe, ob die Verarbeitung die definierte Zeit überschritten hat

IF PROCESSING_TIME > MAX_PROCESSING_TIME:

LOG_ERROR("Deadline missed! Processing took too long.");

TRIGGER_CRITICAL_FAILURE_PROTOCOL(); // Beispielhafte Reaktion

ELSE:

// Kein Ereignis innerhalb des Zeitfensters erhalten

LOG_WARNING("No event received within latency window.");END LOOP

Diese Darstellung verdeutlicht das Prinzip, auf Ereignisse innerhalb eines definierten Zeitfensters zu reagieren und Fehler zu protokollieren, wenn die Fristen nicht eingehalten werden können. Die tatsächliche Implementierung erfordert oft komplexere Mechanismen zur Priorisierung, Fehlerbehandlung und Ressourcenverwaltung, um die geforderte deterministische Leistung zu erreichen. Die Integration von Echtzeitkommunikation, wie sie in vielen modernen Anwendungen benötigt wird, ist ein Schlüsselbereich, der spezielle Bibliotheken und Protokolle erfordert.

Fazit: Die Zukunft Echtzeit-gesteuerter Systeme

Echtzeit-Anwendungen sind mehr als nur schnelle Systeme; sie sind das Fundament für Zuverlässigkeit und Funktionalität in kritischen und interaktiven Umgebungen. Die Fähigkeit, mit garantierter Geschwindigkeit auf Ereignisse zu reagieren, wird mit der zunehmenden Vernetzung und Automatisierung unserer Welt immer wichtiger. Von der autonomen Mobilität über die Industrie 4.0 bis hin zu fortschrittlichen Finanzhandelsplattformen – die Prinzipien der Echtzeitverarbeitung sind und bleiben ein Eckpfeiler moderner Technologie. Die kontinuierliche Weiterentwicklung von Hardware, Betriebssystemen und Netzwerktechnologien verspricht noch leistungsfähigere und reaktionsschnellere Systeme für die Zukunft, die nahtlose Echtzeitkommunikation und deterministische Leistung vereinen.

Haben Sie Erfahrungen mit der Entwicklung oder dem Betrieb von Echtzeit-Anwendungen gesammelt? Teilen Sie Ihre Gedanken und Herausforderungen gerne in den Kommentaren!

Entschuldigung, wenn das vielleicht eine sehr einfache Frage ist und ich das noch nicht ganz verstehe, aber ich trau mich kaum zu fragen: Ist der Hauptunterschied wirklich nur die Geschwindigkeit, oder geht es da noch um etwas anderes, das so wichtig ist, dass man es „Echtzeit“ nennen muss?

Vielen dank für ihre aufmerksame frage. sie haben einen sehr wichtigen punkt angesprochen. während geschwindigkeit sicherlich ein entscheidender faktor ist, geht es bei „echtzeit“ tatsächlich um mehr als nur die reine geschwindigkeit. es bezieht sich auf die fähigkeit eines systems, informationen zu verarbeiten und darauf zu reagieren, während die ereignisse stattfinden, und zwar innerhalb eines zeitrahmens, der für den jeweiligen prozess als sofortig oder kritisch gilt. das bedeutet, dass die reaktionszeit nicht nur schnell sein muss, sondern auch vorhersehbar und garantiert, damit das system zuverlässig funktioniert und die integrität der daten oder des prozesses gewährleistet ist.

es ist diese garantierte und sofortige reaktion, die den begriff „echtzeit“ so bedeutsam macht und ihn von bloßer schnelligkeit unterscheidet. ich hoffe, das klärt ihre frage etwas besser. ich würde mich freuen, wenn sie auch meine anderen veröffentlichungen und artikel lesen würden.

Echtzeit-Anwendungen… Ja, klar. Und als Nächstes erzählt uns jemand, dass das Rad eine bahnbrechende Erfindung ist. Ganz ehrlich, dieses „neue“ Konzept der „schnellen Reaktionen in der digitalen Welt“ ist doch nur eine Neuverpackung von etwas, das wir seit Jahrzehnten haben.

Man denke nur an die Flugzeugsteuerung in den 70ern oder selbst an die ersten industriellen Prozessleitsysteme. Da waren Deadlines, garantierte Zeitgrenzen und „sofortige Systemantworten“ auch schon absolut kritisch und keine verhandelbare Option. Nur nannte man es damals eben „Echtzeitsystem“ und nicht „absolut notwendigen Luxus in der heutigen schnelllebigen digitalen Landschaft“. Wenigstens hat man es damals nicht so aufgeblasen.

Ich verstehe ihren punkt vollkommen und es ist richtig, dass die grundlagen von echtzeitsystemen schon lange existieren und in vielen kritischen bereichen unerlässlich waren. die entwicklung der siebzigerjahre, sei es in der luftfahrt oder in der industrie, hat hier tatsächlich den weg geebnet.

was sich jedoch verändert hat, ist die allgegenwärtigkeit und die breite anwendung dieser prinzipien in unserem täglichen digitalen leben, oft ohne dass es uns bewusst ist. die technologischen fortschritte haben es ermöglicht, diese reaktionszeiten nicht nur in hochspezialisierten systemen, sondern auch in verbraucherorientierten anwendungen zu realisieren, die wiederum neue erwartungen an geschwindigkeit und nahtlose interaktion geschaffen haben. danke für ihren wertvollen beitrag, sehen sie sich auch andere artikel in meinem profil oder meine weiteren veröffentlichungen an.

Echtzeit-Anwendungen – das klingt nach Effizienz und Geschwindigkeit. Aber was bedeutet das für unsere Privatsphäre? Wenn Daten in Echtzeit verarbeitet und darauf reagiert werden, welche Daten sind das genau? Werden hier nicht ununterbrochen und unbemerkt tiefgreifende Profile erstellt, die unser Verhalten, unsere Vorlieben, ja sogar unsere Schwachstellen in Millisekunden analysieren? Welche Informationen werden da Sekunde für Sekunde über uns gesammelt, nur um ’schnell reagieren‘ zu können? Und wer hat wirklich Zugriff auf diese ständig aktualisierten, hochsensiblen Datensätze? Können wir bei dieser Geschwindigkeit überhaupt noch nachvollziehen, was mit unseren Informationen geschieht, geschweige denn unsere Rechte auf Datenschutz effektiv wahrnehmen? Ist die garantierte Zeitgrenze für die Systemantwort wichtiger als die garantierte Zeitgrenze für den Schutz unserer persönlichen Daten? Oder opfern wir hier unwissentlich unsere digitale Souveränität auf dem Altar der sofortigen Reaktion?

Das sind sehr wichtige und berechtigte Fragen, die Sie hier aufwerfen. Es ist absolut entscheidend, dass wir uns nicht nur mit den Vorteilen der Echtzeit-Verarbeitung auseinandersetzen, sondern auch kritisch hinterfragen, welche Implikationen dies für den Datenschutz hat. Die Sorge um die Erstellung detaillierter Profile und den unbemerkten Zugriff auf sensible Daten ist in der Tat ein zentraler Punkt, der bei der Entwicklung und Implementierung solcher Systeme stets berücksichtigt werden muss. Es geht darum, Transparenz zu schaffen, welche Daten erfasst werden, zu welchem Zweck und wer Zugriff darauf hat, um die digitale Souveränität jedes Einzelnen zu gewährleisten.

Ihre Bedenken hinsichtlich der Nachvollziehbarkeit und der effektiven Wahrnehmung von Datenschutzrechten bei der Geschwindigkeit von Echtzeit-Anwendungen sind von großer Bedeutung. Es ist eine Gratwanderung, die Balance zwischen Effizienz und dem Schutz der Privatsphäre zu finden. Der Gesetzgeber und die Entwickler sind hier gleichermaßen gefordert, Mechanismen zu schaffen, die es Nutzern ermöglichen, ihre Daten zu kontrollieren und informierte Entscheidungen zu treffen. Vielen Dank für diesen wertvollen Kommentar, der die Diskussion um Echt

interessanter überblick, aber ich frage mich, ob der artikel nicht etwas zu pauschal argumentiert. es wird von ‚absoluter notwendigkeit‘ und ‚garantierten zeitgrenzen‘ gesprochen, aber mir fehlen hier konkrete belege oder daten, die das untermauern. könnten sie vielleicht ein paar fallstudien anführen oder quellen nennen, die zeigen, wo echtzeit-anwendungen *tatsächlich* das rückgrat kritischer systeme bilden und welche spezifischen zeitrahmen dabei eingehalten werden müssen? auch die erwähnung ‚verschiedener arten von echtzeitsystemen‘ ohne sie zu benennen, lässt fragen offen, die für ein tieferes verständnis wichtig wären.

Vielen dank für ihren durchdachten kommentar und die wertvollen fragen. sie haben recht, der artikel könnte an einigen stellen von einer tieferen detaillierung profitieren, insbesondere was konkrete belege und die benennung verschiedener systemtypen angeht. mein ziel war es zunächst, einen überblick über die bedeutung von echtzeit-anwendungen zu geben.

ihre anregung, fallstudien oder spezifische zeitrahmen zu nennen, ist sehr hilfreich und ich werde dies für zukünftige artikel berücksichtigen. für ein tieferes verständnis der verschiedenen arten von echtzeitsystemen und ihrer anwendungen empfehle ich ihnen, sich auch andere artikel in meinem profil oder meine weiteren veröffentlichungen anzusehen. dort finden sie weitere informationen zu diesem komplexen thema.

Genau meine Meinung! Danke, das musste mal gesagt werden. Echtzeit-Anwendungen sind in der Tat das unverzichtbare Rückgrat unserer digitalen Welt – perfekt auf den Punkt gebracht!

Es freut mich sehr, dass ich ihre meinung so gut getroffen habe und der artikel ihnen gefallen hat. es ist mir wichtig, solche themen anzusprechen, da sie oft übersehen werden, aber einen so großen einfluss auf unser tägliches leben haben.

vielen dank für ihre anerkennenden worte. es motiviert mich sehr, wenn meine leser den kern meiner aussagen so klar erkennen. ich lade sie herzlich ein, auch meine anderen veröffentlichungen anzusehen, vielleicht finden sie dort noch weitere interessante gedanken.

„Echtzeit-Anwendungen: Schnelle Reaktionen in der digitalen Welt“ – klingt verlockend effizient. Doch was bedeutet diese Forderung nach *sofortiger* Datenverarbeitung und -reaktion wirklich für unsere Privatsphäre und den Schutz unserer Daten? Müssen hier nicht unzählige Datenströme *permanent* fließen, um diese Millisekunden-Reaktionen zu ermöglichen? Welche persönlichen Informationen werden dabei ununterbrochen gesammelt, analysiert und verknüpft, oft ohne dass wir es überhaupt bemerken?

Wer garantiert, dass diese „garantierten Zeitgrenzen“ nicht auch für die Speicherung und Nutzung unserer sensibelsten Daten gelten, die dann potenziell für immer verfügbar sind? Werden wir hier nicht zu transparenten Objekten, deren jede Interaktion, jede Bewegung, jede Entscheidung in Echtzeit erfasst und ausgewertet wird? Und welche echten Kontrollmöglichkeiten bleiben uns als Nutzern, wenn die Verarbeitung so schnell und komplex ist, dass Transparenz zur Illusion wird? Ist dies nicht der Weg in eine permanente Überwachung, in der unsere digitale Identität zum jederzeit abrufbaren und manipulierbaren Datensatz wird, alles im Namen der „sofortigen Systemantwort“? Das Risiko für unsere informationelle Selbstbestimmung ist immens.

Das sind sehr wichtige und berechtigte Fragen, die Sie aufwerfen. Die Balance zwischen der Effizienz von Echtzeit-Anwendungen und dem Schutz der Privatsphäre ist tatsächlich eine der größten Herausforderungen unserer digitalen Zeit. Es stimmt, dass für viele dieser Anwendungen ein kontinuierlicher Datenfluss notwendig ist, und die Frage, welche Daten dabei gesammelt und wie sie verarbeitet werden, ist zentral.

Die von Ihnen angesprochenen Risiken bezüglich der Speicherung, Nutzung und der potenziellen Überwachung sind ernst zu nehmen. Es ist entscheidend, dass wir als Nutzer uns dieser Mechanismen bewusst sind und aktiv nach Transparenz und Kontrollmöglichkeiten suchen. Technische Lösungen wie Anonymisierung und Verschlüsselung spielen eine Rolle, aber auch rechtliche Rahmenbedingungen und eine informierte Öffentlichkeit sind unerlässlich, um unsere informationelle Selbstbestimmung zu wahren. Vielen Dank für diesen wertvollen Kommentar. Ich lade Sie herzlich ein, sich auch andere Artikel in meinem Profil oder meine weiteren Veröffentlichungen anzusehen.