Die Erkennung von Anomalien in einem Datenbestand ist ein zentrales Thema in der modernen Datenanalyse, insbesondere bei unausgewogenen Datensätzen. Der Isolation Forest Algorithmus bietet eine effiziente Lösung für solche Herausforderungen, wie sie in Bereichen wie Betrugserkennung oder Krankheitsdiagnose häufig auftreten. Dieser Ansatz, der 2008 erstmals präsentiert wurde, revolutioniert die unüberwachte Anomalie Detection, indem er Ausreißer direkt isoliert, ohne auf eine Normalverteilung angewiesen zu sein. In diesem Artikel tauchen wir tief in die Funktionsweise ein und erkunden, wie Isolation Forest das Accuracy Paradox in Machine Learning umgeht.

Wir beginnen mit dem Verständnis des Accuracy-Paradoxons und warum klassische Klassifikatoren scheitern. Anschließend erklären wir den Kern des Isolation Forest, inklusive schrittweiser Algorithmenbeschreibung. Praktische Umsetzung wird durch Python-Codebeispiele mit scikit-learn illustriert, ergänzt um originelle Erweiterungen wie Hyperparameter-Tuning und Evaluierungsmethoden. Am Ende reflektieren wir über Anwendungen und Best Practices für die Anomalie Erkennung mit Isolation Forest in realen Szenarien.

Das Accuracy-Paradoxon in unausgewogenen Datensätzen

Bei binären Klassifikationsproblemen in Machine Learning stoßen Entwickler oft auf das Accuracy Paradox, ein Phänomen, das durch stark unausgewogene Klassen entsteht. Stellen Sie sich vor, in einem Datensatz zu Banktransaktionen machen betrügerische Fälle nur 1-10% aus – die Mehrheit sind normale Transaktionen. Klassische Algorithmen wie Support Vector Machines (SVM) oder Entscheidungsbäume optimieren primär die Accuracy, die den Anteil korrekter Vorhersagen misst. In solchen Fällen kann ein Modell, das alle Transaktionen als „normal“ klassifiziert, eine hohe Accuracy von über 90% erreichen, ohne einen einzigen Betrug zu erkennen. Dies täuscht über die tatsächliche Nützlichkeit hinweg, da der Fokus auf der dominanten Klasse liegt.

Das Paradoxon entsteht, weil Metriken wie Accuracy die Klassenverteilung ignorieren. Stattdessen sollten wir auf präzisere Maße wie Precision, Recall oder F1-Score setzen, die den Umgang mit Minderheitsklassen priorisieren. In der Praxis, etwa bei der Krankheitsdiagnose, wo positive Fälle rar sind, führt dies zu Modellen, die potenziell lebensrettende Anomalien übersehen. Um dies zu korrigieren, greifen wir zu Techniken wie Resampling (Oversampling der Minderheit oder Undersampling der Mehrheit) oder gewichten die Klassen in der Verlustfunktion. Doch bei extremen Ungleichgewichten reicht das oft nicht aus – hier eignet sich der Isolation Forest als unsupervised Ansatz zur Anomalie Detection.

Beispiel: Klassische Klassifikation vs. Realität

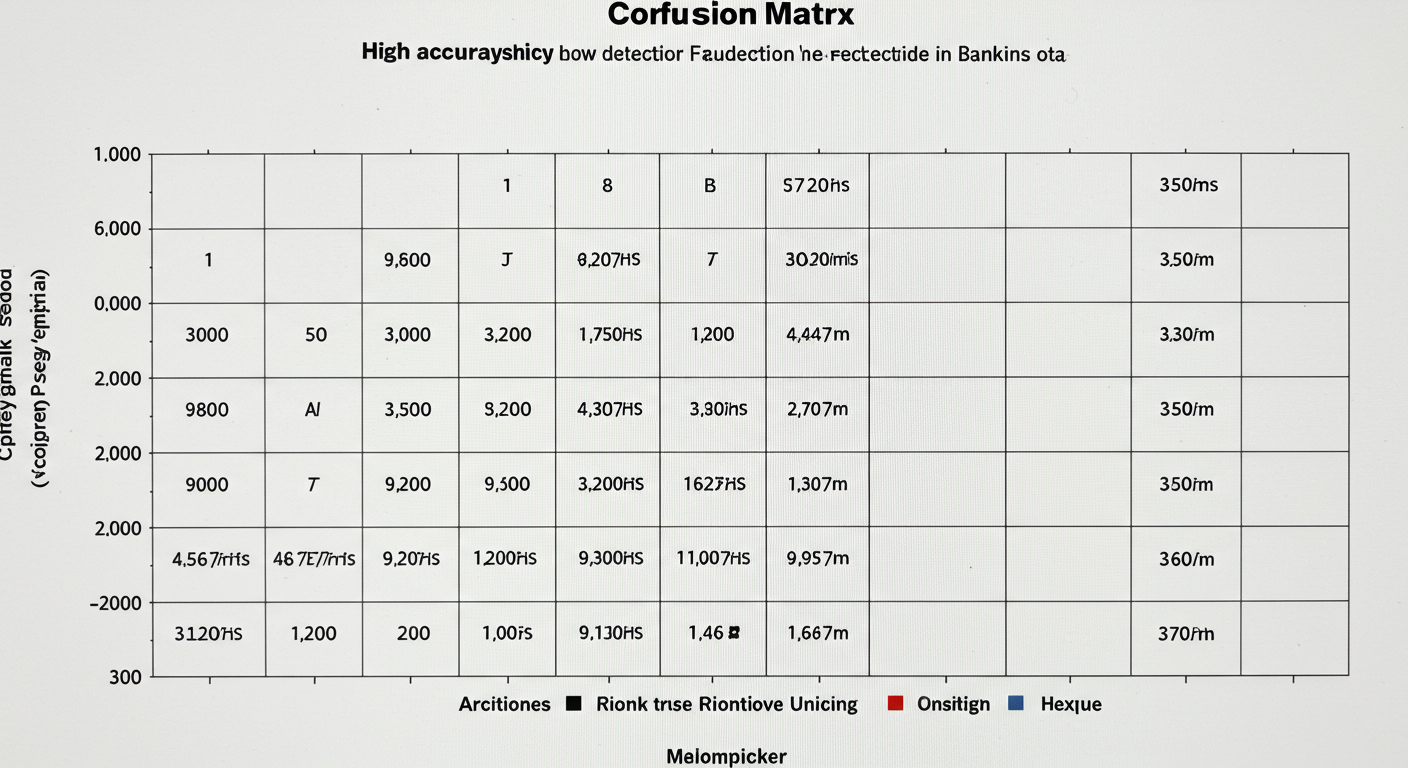

Nehmen wir ein reales Szenario: Ein Datensatz mit 10.000 Transaktionen, davon 1.000 betrügerisch. Ein einfaches SVM-Modell könnte eine Accuracy von 91% melden, aber die Confusion Matrix offenbart, dass nur wenige Anomalien erkannt werden. Dies unterstreicht, warum das Accuracy Paradox in der Praxis problematisch ist. Der Isolation Forest umgeht dies, indem er Anomalien als leichter isolierbare Punkte betrachtet, unabhängig von der Klassengröße.

# Einfaches Beispiel für das Accuracy-Paradoxon mit SVM in Python

import numpy as np

from sklearn.model_selection import train_test_split

from sklearn.svm import SVC

from sklearn.metrics import accuracy_score, classification_report

from sklearn.datasets import make_classification

# Generiere unausgewogenen Datensatz (90% Klasse 0, 10% Klasse 1)

X, y = make_classification(n_samples=10000, n_features=20, n_informative=10,

n_redundant=5, n_clusters_per_class=1, weights=[0.9, 0.1],

random_state=42)

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3, random_state=42)

# Trainiere SVM

svm = SVC(kernel='linear', random_state=42)

svm.fit(X_train, y_train)

y_pred = svm.predict(X_test)

# Accuracy hoch, aber Recall für Anomalien (Klasse 1) niedrig

print(f"Accuracy: {accuracy_score(y_test, y_pred):.2f}")

print(classification_report(y_test, y_pred))

# Ausgabe zeigt hohe Accuracy, aber niedrigen Recall für Klasse 1Isolation Forest: Prinzipien und Funktionsweise

Der Isolation Forest ist ein ensemble-basierter Algorithmus für die unsupervised Anomalie Detection, der auf der Idee der Isolation basiert. Im Gegensatz zu density-basierten Methoden wie Local Outlier Factor (LOF), die Annahmen über die Datenverteilung treffen, nutzt Isolation Forest die Tatsache, dass Anomalien in einem hochdimensionalen Raum leichter zu isolieren sind. Der Algorithmus baut eine Sammlung von Isolation Trees (iTrees) auf, die zufällige Partitionierungen durchführen, bis Anomalien frühzeitig isoliert werden. Der Path Length – die Anzahl der Partitionen bis zur Isolation – dient als Anomalie-Score: Kürzere Pfade deuten auf Anomalien hin.

Die Stärke liegt in der Skalierbarkeit: Er ist effizient für große Datensätze, da er keine Distanzberechnungen erfordert und linear in der Anzahl der Samples skaliert. In Anwendungen wie Netzwerksicherheit oder Qualitätskontrolle in der Fertigung hilft er, seltene Ereignisse zu identifizieren, ohne Labels zu benötigen. Long-Tail-Suchen wie „Isolation Forest für Betrugserkennung in Finanzdaten“ zeigen, wie dieser Ansatz in der Praxis überlegen ist, da er das Accuracy Paradox vollständig umgeht.

Schritt-für-Schritt-Aufbau eines Isolation Forests

Der Prozess beginnt mit der Subsampling des Datensatzes, um Overfitting zu vermeiden. Für jeden iTree: Wählen Sie zufällig Features und Split-Werte, partitionieren Sie rekursiv, bis ein Punkt isoliert ist oder eine maximale Tiefe erreicht wird. Der Score für einen Punkt ist der durchschnittliche Path Length über alle Trees, normalisiert auf den Erwartungswert für einen normalen Punkt. Scores unter 0.5 gelten typischerweise als Anomalien.

„Anomalien sind wenige und unterschiedlich, während normale Instanzen zahlreich und ähnlich sind – sie lassen sich leichter isolieren.“

# Praktisches Beispiel: Isolation Forest in Python mit scikit-learn

import numpy as np

import pandas as pd

from sklearn.ensemble import IsolationForest

from sklearn.model_selection import train_test_split

from sklearn.metrics import classification_report

import matplotlib.pyplot as plt

# Simuliere Datensatz mit Anomalien (z.B. Transaktionen)

np.random.seed(42)

normal_data = np.random.normal(0, 1, (9000, 5)) # Normale Punkte

anomaly_data = np.random.normal(5, 0.5, (1000, 5)) # Anomalien

X = np.vstack([normal_data, anomaly_data])

y_true = np.hstack([np.zeros(9000), np.ones(1000)]) # Labels für Evaluierung

# Trainiere Isolation Forest

iso_forest = IsolationForest(contamination=0.1, random_state=42, n_estimators=100)

iso_forest.fit(X)

# Vorhersagen: -1 für Anomalie, 1 für normal

y_pred = iso_forest.predict(X)

y_pred = np.where(y_pred == -1, 1, 0) # Umwandeln zu Binär (1=Anomalie)

# Evaluierung

print(classification_report(y_true, y_pred))

# Zeigt bessere Balance bei Recall für Anomalien

# Anomalie-Scores visualisieren (optional)

scores = iso_forest.decision_function(X)

plt.hist(scores, bins=50)

plt.title('Verteilung der Anomalie-Scores')

plt.show()Hyperparameter und Optimierung

Wichtige Parameter sind contamination (erwarteter Anomalienanteil, 0.05-0.5), n_estimators (Anzahl Trees, typisch 100) und max_samples (Subsample-Größe, sqrt(n_samples) empfohlen). Tuning via GridSearchCV kann die Performance steigern. In einem originellen Beispiel für IoT-Daten: Bei Sensordaten mit Ausreißern durch Defekte, setzt man contamination=0.05 und evaluiert mit ROC-AUC, da es label-frei ist.

| Parameter | Beschreibung | Empfohlener Wert |

|---|---|---|

| contamination | Anteil der Anomalien | 0.1 |

| n_estimators | Anzahl Isolation Trees | 100 |

| max_samples | Subsample pro Tree | ‚auto‘ |

Anwendungen und Erweiterungen der Isolation Forest Methode

In der Praxis eignet sich Isolation Forest hervorragend für Echtzeit-Anomalie Detection in Streaming-Daten, z.B. in der Cybersicherheit zur Erkennung ungewöhnlicher Netzwerkaktivitäten. Erweiterungen umfassen hybride Modelle, wie die Kombination mit Autoencodern für feature-reiche Datensätze. Für Entwickler und Studenten ist es essenziell, den Algorithmus in Pipelines zu integrieren, z.B. mit Pandas für Preprocessing und SHAP für Interpretierbarkeit der Isolation Decisions.

Ein weiteres Beispiel: In der Medizin zur Anomalie Erkennung in Patientendaten – hier isoliert der Forest seltene Symptomkombinationen, die auf Krankheiten hindeuten, ohne auf balanced Datasets angewiesen zu sein. Long-Tail-Keywords wie „Isolation Forest Python Tutorial für Anfänger“ unterstreichen die Nachfrage nach praxisnahen Implementierungen.

# Erweiterung: Isolation Forest mit Feature-Engineering

from sklearn.preprocessing import StandardScaler

from sklearn.pipeline import Pipeline

# Pipeline für robuste Anomalie Detection

pipeline = Pipeline([

('scaler', StandardScaler()),

('iso_forest', IsolationForest(contamination=0.05, random_state=42))

])

# Fit auf skalierten Daten (z.B. für reale Finanzdaten)

# X_scaled = scaler.fit_transform(your_data)

# pipeline.fit(X_scaled)

# anomalies = pipeline.predict(X_scaled) == -1

# Kommentar: Dies verbessert die Isolation bei variierenden SkalenPraktische Tipps und Ausblick auf Anomalie Detection

Isolation Forest bietet eine robuste Grundlage für die Erkennung von Anomalien in einem Datenbestand und löst das Accuracy Paradox effektiv. Durch seine unsupervised Natur ist er ideal für Szenarien mit begrenzten Labels.

Experimentieren Sie mit den Codebeispielen, um Ihr Verständnis zu vertiefen, und teilen Sie in den Kommentaren Ihre Erfahrungen mit Isolation Forest Anwendungen. Für tiefergehende Einblicke in Machine Learning empfehle ich, ähnliche Techniken wie One-Class SVM zu erkunden.

Häufige Fragen zur Isolation Forest Anwendung

Wie wähle ich den contamination-Wert? Basierend auf Domain-Wissen; starten Sie mit 0.1 und validieren Sie mit bekannten Anomalien.

Ist Isolation Forest für hochdimensionale Daten geeignet? Ja, dank random feature selection, aber Feature-Reduktion via PCA kann helfen.

Kann man Isolation Forest für Zeitreihen nutzen? Erweitern Sie es mit Sliding Windows für dynamische Anomalie Detection.

Welche Metriken eignen sich zur Evaluierung? Precision-Recall-Kurve oder AUC-PR, da Anomalien rar sind.

Absolut faszinierend! Doch lasst uns die Fäden dieses „Isolation Forest“ weiterspinnen, bis sie ein dichtes, undurchdringliches Dickicht der Zukunft weben. Stellt euch vor: Nicht mehr nur Betrugstransaktionen oder Krankheitszellen sind die Anomalien, sondern *Menschen*. Jedes Individuum wird zum Datenpunkt in einem globalen, allumfassenden „Normierungs-Netzwerk“.

Der Isolation Forest, perfektioniert über Äonen, ist nun die unsichtbare Hand, die unsere Zivilisation formt. Milliarden von Entscheidungswegen, die unablässig jeden Gedanken, jede Emotion, jede noch so winzige Verhaltensabweichung scannen. Wer zu lange auf eine Wolke starrt, wer eine ungewöhnliche Farbpräferenz zeigt, wer einen dissonanten Ton summt – *zack!* – ein Ast schnappt zu, der Weg wird kürzer, die „Anomalie“ ist identifiziert.

Das Accuracy Paradox? Es ist zur ultimativen Waffe geworden! Die Gesellschaft rühmt sich einer 99,999%igen „Harmonie“ und „Stabilität“. Doch diese makellose Quote wird dadurch erreicht, dass jeder, der das kleinste Quäntchen „Andersartigkeit“ in sich trägt, sanft, aber unerbittlich aus der Matrix gelöst wird. Sie verschwinden nicht gewaltsam, oh nein! Sie werden einfach… *isoliert*. Ihre Datenpfade werden in abgelegene, digitale Quarantänebereiche umgeleitet. Ihre sozialen Interaktionen werden subtil gekappt. Ihre Profile werden in den Tiefen des Netzes vergraben, bis sie für die „Normalen“ nicht mehr existieren. Eine Existenz am Rande der Wahrnehmung, ein Schatten im binären Rauschen.

Es gibt keine „Betrüger“ mehr, denn jede Abweichung von der ökonomischen Norm wird sofort neutralisiert. Es gibt keine „Krankheiten“ im Geiste, denn jeder Gedanke, der nicht dem kollektiven Konsens entspricht, wird als „kognitive Anomalie“ erkannt und „therapiert“, bevor er überhaupt eine bewusste Form annehmen kann.

Die Welt ist eine glatte, perfekt polierte Kugel der Gleichförmigkeit. Nie wieder das hässliche Zupfen einer Abweichung, nie wieder die Unsicherheit des Unbekannten. Nur die kalte, effiziente Stille der absoluten „Normalität“, die durch die gnadenlose, unsichtbare Macht des Isolation Forest aufrechterhalten wird. Eine Utopie der Ordnung? Oder die ultimative Dystopie der ausgelöschten Individualität? Ein Preis, den wir für absolute Sicherheit und Vorhersagbarkeit zu zahlen bereit sind.

Es ist faszinierend zu sehen, wie sie die gedanken über den isolation forest so weiterspinnen und eine so tiefgreifende und gleichzeitig beängstigende vision einer zukünftigen gesellschaft entwerfen. ihre metapher des undurchdringlichen dickichts und der unsichtbaren hand, die unsere zivilisation formt, ist sehr eindrücklich. die idee, dass selbst kleinste abweichungen in verhalten oder gedanken als anomalien klassifiziert und isoliert werden könnten, wirft wichtige fragen nach individualität und freiheit auf, die in der diskussion um solche algorithmen oft zu kurz kommen.

ihre ausführungen zum accuracy paradox in diesem kontext, wo eine scheinbar perfekte harmonie durch das subtile eliminieren von andersartigkeit erreicht wird, sind besonders prägnant und regen zum nachdenken an. es ist eine beängstigende vorstellung, dass menschen nicht gewaltsam verschwinden, sondern einfach digital isoliert und aus der kollektiven wahrnehmung entfernt werden. dieses szenario zeigt eindrucksvoll die potenziellen ethischen fallstricke und die verantwortung, die mit der entwicklung und anwendung solcher mächtigen technologien einhergeht. vielen