Verstehen Sie Lemmatisierung, einen Kernprozess der NLP, der Wörter auf ihre Grundform reduziert. Erfahren Sie, wie sie funktioniert, welche Methoden es gib…

Lemmatisierung: Die Grundform der Sprachverarbeitung

In der Welt der digitalen Texte und der semantischen Analyse ist die Fähigkeit, Wörter auf ihre Kernbedeutung zu reduzieren, von entscheidender Bedeutung. Hier kommt die Lemmatisierung ins Spiel, ein fundamentaler Prozess in der Natural Language Processing (NLP). Sie ermöglicht es Systemen, unterschiedliche Flexionsformen eines Wortes als dasselbe lexikalische Element zu erkennen, was die Effizienz und Genauigkeit textbasierter Anwendungen erheblich verbessert.

Was ist Lemmatisierung und wie funktioniert sie?

Lemmatisierung ist ein ausgeklügeltes Verfahren in der natürlichen Sprachverarbeitung, das darauf abzielt, verschiedene Flexionsformen eines Wortes auf seine lexikalische Grundform, das sogenannte Lemma, zurückzuführen. Das Lemma repräsentiert die kanonische oder Wörterbuchform eines Wortes, unabhängig von seinem grammatikalischen Kontext.

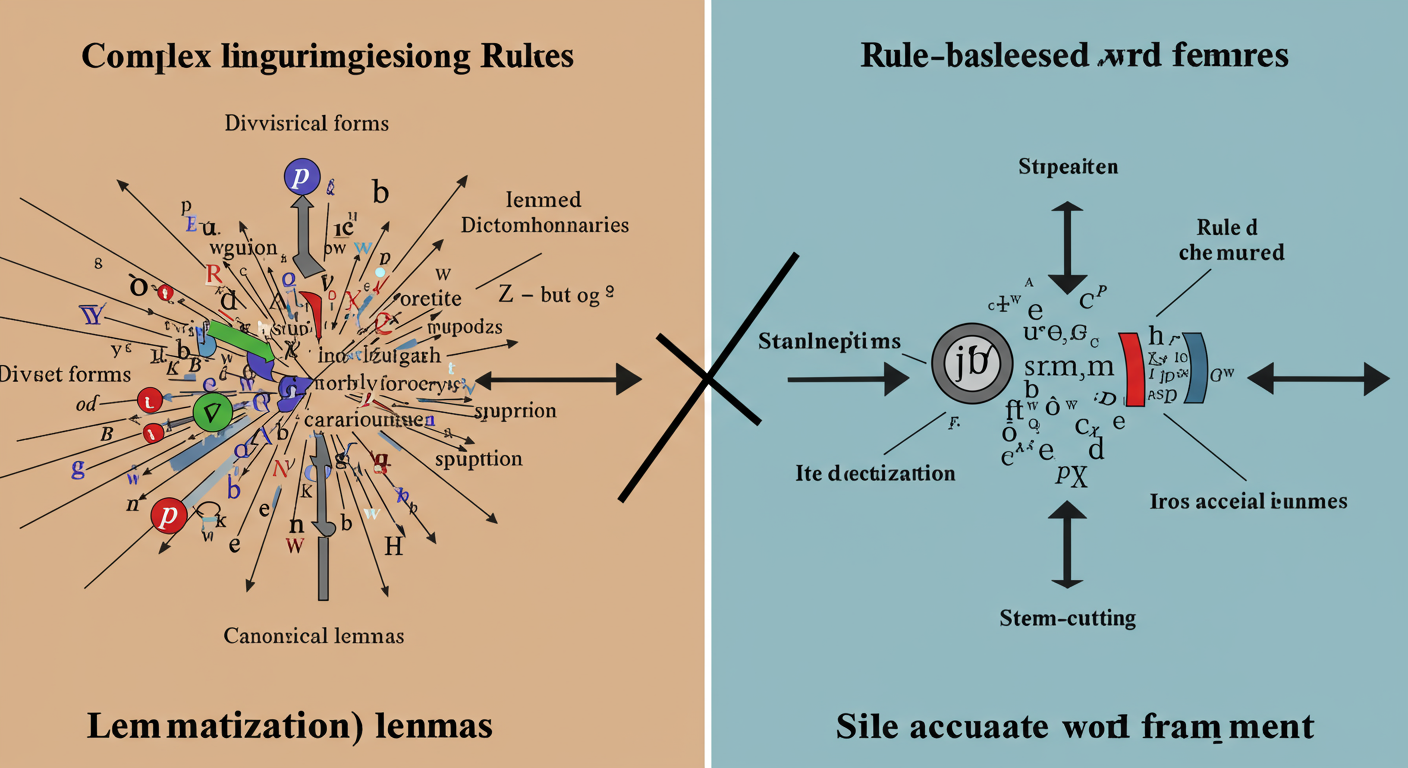

Um dies zu erreichen, durchläuft die Lemmatisierung typischerweise mehrere Schritte, die eine tiefgreifende linguistische Analyse erfordern:

- Tokenisierung: Zunächst wird der eingegebene Text in einzelne, bedeutungstragende Einheiten zerlegt, die als Tokens bezeichnet werden. Dies sind meist einzelne Wörter oder Satzzeichen.

- POS-Tagging (Part-of-Speech Tagging): Im nächsten Schritt wird jedem Token seine spezifische Wortart zugewiesen, wie Nomen, Verb, Adjektiv oder Adverb. Diese Information ist entscheidend, da die Lemmatisierung je nach Wortart unterschiedliche Regeln anwendet.

- Lemmatisierung: Basierend auf der identifizierten Wortart und dem Kontext des Wortes wird mithilfe von linguistischen Regeln, Wörterbüchern oder statistischen Modellen die korrekte Grundform ermittelt. Ein Verb wird beispielsweise auf seinen Infinitiv, ein Nomen auf seine Singularform und ein Adjektiv auf seine Positivform reduziert.

- Ergebnis: Das Endresultat ist eine Liste von Wörtern, die alle auf ihre jeweiligen Lemmata zurückgeführt wurden. Dies schafft eine konsistente Basis für weitere Analysen, indem es die Vielfalt der Wortformen auf ein Minimum reduziert.

Dieser strukturierte Ansatz gewährleistet, dass die semantische Bedeutung eines Wortes während des Reduktionsprozesses erhalten bleibt, was die Qualität der nachfolgenden Textverarbeitungsschritte maßgeblich verbessert.

Methoden der Lemmatisierung: Ein tiefer Einblick

Die Implementierung der Lemmatisierung kann auf verschiedene Weisen erfolgen, wobei jede Methode ihre eigenen Stärken und Anwendungsbereiche hat. Die Wahl der Methode hängt oft von der Sprache, der verfügbaren Rechenleistung und der gewünschten Genauigkeit ab.

Regelbasierte Ansätze

Regelbasierte Ansätze nutzen ein System von linguistischen Regeln, die von Sprachexperten entwickelt wurden. Diese Regeln beschreiben, wie bestimmte Endungen oder Präfixe basierend auf der Wortart und dem Kontext entfernt oder geändert werden müssen, um das Lemma zu erhalten. Solche Systeme sind präzise, erfordern jedoch einen hohen manuellen Aufwand bei der Erstellung und Pflege der Regeln.

Ein vereinfachtes Python-Beispiel, das ein regelbasiertes Prinzip illustriert, könnte so aussehen:

def regelbasierte_lemmatisierung(wort, wortart):

if wortart == "Verb":

if wort.endswith("te") or wort.endswith("t"):

return wort[:-1] # Vereinfachte Regel: Endungen entfernen

elif wort.endswith("en"):

return wort[:-2]

# Weitere Regeln für Verben

elif wortart == "Nomen":

if wort.endswith("s"):

return wort[:-1] # Plural-s entfernen

# Weitere Regeln für Nomen

return wort # Wenn keine Regel zutrifft, Originalwort zurückgeben

# Beispielanwendung

print(f"Geht (Verb): {regelbasierte_lemmatisierung('geht', 'Verb')}")

print(f"Häuser (Nomen): {regelbasierte_lemmatisierung('Häuser', 'Nomen')}")

print(f"Laufen (Verb): {regelbasierte_lemmatisierung('laufen', 'Verb')}")

Dieses Beispiel ist stark vereinfacht und dient nur zur Illustration des Konzepts. Reale regelbasierte Systeme sind wesentlich komplexer und berücksichtigen Ausnahmen und unregelmäßige Formen.

Wörterbuchbasierte Ansätze

Diese Methode stützt sich auf umfassende Wörterbücher oder Lexika, die bereits die Lemmata für eine große Anzahl von Wörtern enthalten. Für jedes Wort im Text wird ein Nachschlag im Wörterbuch durchgeführt. Findet sich das Wort, wird seine entsprechende Grundform zurückgegeben. Dies ist oft sehr genau, kann aber bei unbekannten Wörtern (Out-of-Vocabulary-Wörtern) an seine Grenzen stoßen.

Ein konzeptionelles Beispiel mit einem Python-Dictionary:

lemma_woerterbuch = {

"geht": "gehen",

"ging": "gehen",

"gegangen": "gehen",

"Häuser": "Haus",

"Katzen": "Katze",

"schöner": "schön"

}

def woerterbuch_lemmatisierung(wort):

return lemma_woerterbuch.get(wort, wort) # Gibt Lemma zurück, oder Originalwort, wenn nicht gefunden

# Beispielanwendung

print(f"Geht: {woerterbuch_lemmatisierung('geht')}")

print(f"Häuser: {woerterbuch_lemmatisierung('Häuser')}")

print(f"Laufen: {woerterbuch_lemmatisierung('laufen')}") # 'laufen' ist nicht im Wörterbuch, bleibt unverändert

Der Erfolg hängt hier stark von der Vollständigkeit und Qualität des verwendeten Wörterbuchs ab.

Statistische Ansätze

Statistische Ansätze, oft basierend auf maschinellem Lernen und Deep Learning, lernen die Beziehungen zwischen Wortformen und ihren Lemmata aus großen annotierten Textkorpora. Diese Modelle können Muster erkennen und auch für unbekannte Wörter plausible Lemmata vorhersagen. Sie sind flexibel und robust, erfordern jedoch erhebliche Trainingsdaten und Rechenressourcen.

Bibliotheken wie SpaCy oder NLTK in Python verwenden oft statistische Modelle in Kombination mit Wörterbüchern und Regeln für eine hybride Lemmatisierung. Hier ein Beispiel mit NLTK:

import nltk

from nltk.stem import WordNetLemmatizer

from nltk.corpus import wordnet

# Nötige Ressourcen herunterladen (einmalig)

# nltk.download('wordnet')

# nltk.download('averaged_perceptron_tagger')

lemmatizer = WordNetLemmatizer()

def get_wordnet_pos(word):

"""Map POS tag to first character lemmatize() accepts"""

tag = nltk.pos_tag([word])[0][1][0].upper()

tag_dict = {"J": wordnet.ADJ,

"N": wordnet.NOUN,

"V": wordnet.VERB,

"R": wordnet.ADV}

return tag_dict.get(tag, wordnet.NOUN)

words = ["running", "runs", "ran", "better", "best", "geese", "mice"]

print("Lemmatisierung mit NLTK (Englisch):")

for word in words:

# Wichtig: POS-Tagging für korrekte Lemmatisierung

lemma = lemmatizer.lemmatize(word, get_wordnet_pos(word))

print(f" '{word}' -> '{lemma}'")

# Für Deutsch könnte man z.B. SpaCy oder GermaParl nutzen

import spacy

# spacy.cli.download("de_core_news_sm") # Einmalig herunterladen

nlp = spacy.load("de_core_news_sm")

german_words = ["geht", "ging", "gegangen", "Häuser", "schönere"]

print("nLemmatisierung mit SpaCy (Deutsch):")

for word in german_words:

doc = nlp(word)

print(f" '{word}' -> '{doc[0].lemma_}'")

Dieses Beispiel demonstriert, wie moderne NLP-Bibliotheken die Komplexität der Lemmatisierung handhaben, indem sie Python-Code mit linguistischem Wissen verbinden.

Praktische Anwendung und Vorteile der Lemmatisierung

Die Lemmatisierung ist ein unverzichtbares Werkzeug in vielen Bereichen der Textanalyse und des maschinellen Lernens. Ihre Vorteile reichen von der Verbesserung der Datenqualität bis hin zur Effizienzsteigerung von Suchalgorithmen.

Zu den wesentlichen Vorteilen der Lemmatisierung gehören:

- Steigerung der Modellgenauigkeit: In Machine-Learning-Modellen, insbesondere im Bereich NLP, führt die Reduktion von Wortformen auf ihre Lemmata zu einer konsistenteren Datenbasis. Dies verbessert die Trainingsqualität und somit die Vorhersagegenauigkeit der Modelle erheblich.

- Textnormalisierung: Sie vereinheitlicht unterschiedliche Flexionsformen eines Wortes, was Textanalysen konsistenter und effizienter macht. So werden beispielsweise „läuft“, „gelaufen“ und „lief“ alle zu „laufen“ normalisiert.

- Reduzierung des Vokabulars: Durch die Konsolidierung von Wortvarianten wird das Gesamt-Vokabular eines Textkorpus verkleinert. Dies reduziert den Speicherbedarf und die Rechenkomplexität, was besonders bei der Verarbeitung großer Textmengen von Vorteil ist.

- Suchmaschinenoptimierung (SEO): Für Suchmaschinen und Informationsabrufsysteme ist die Lemmatisierung entscheidend. Sie ermöglicht es, dass Suchanfragen effektiver mit relevanten Dokumenten abgeglichen werden, selbst wenn die Suchanfrage eine andere Flexionsform des Zielwortes verwendet.

- Effektivere Sentiment-Analyse: Die Lemmatisierung verbessert die Genauigkeit von Sentiment-Analysen, da sie es ermöglicht, die emotionale Tonalität eines Textes präziser zu erfassen, indem sie die semantische Essenz der Wörter isoliert.

- Verbesserung der maschinellen Übersetzung: In der maschinellen Übersetzung trägt die Lemmatisierung dazu bei, die Konsistenz und Qualität der Übersetzungen zu verbessern, indem sie die Grundformen von Wörtern erkennt und somit die korrekte Übersetzung im Kontext ermöglicht.

Diese Vorteile machen die Lemmatisierung zu einem mächtigen Werkzeug, um aus rohen Textdaten wertvolle Erkenntnisse zu gewinnen.

Herausforderungen und Nachteile der Lemmatisierung

Trotz ihrer vielen Vorteile bringt die Lemmatisierung auch bestimmte Herausforderungen und Nachteile mit sich, die bei der Implementierung berücksichtigt werden müssen.

Die wichtigsten Nachteile und Schwierigkeiten umfassen:

- Komplexität: Die Entwicklung und Pflege von Lemmatisierungsregeln oder Modellen ist komplex, insbesondere für Sprachen mit reichen Flexionssystemen oder vielen unregelmäßigen Formen wie Deutsch. Es erfordert ein tiefes Verständnis linguistischer Prinzipien.

- Rechenintensivität: Insbesondere statistische Modelle oder die Verarbeitung großer Textmengen können rechenintensiv sein. Dies kann zu längeren Verarbeitungszeiten führen, was in Echtzeitanwendungen oder bei sehr großen Datensätzen problematisch sein kann.

- Fehleranfälligkeit: Die Lemmatisierung ist nicht immer perfekt. Für seltene, mehrdeutige oder unbekannte Wörter kann es schwierig sein, das korrekte Lemma zu bestimmen. Dies führt zu Fehlern, die die Genauigkeit nachfolgender Textanalysen beeinträchtigen können.

- Verlust von Information: In einigen Fällen können Flexionsformen eines Wortes subtile semantische Unterschiede tragen. Durch die Reduzierung auf ein einziges Lemma gehen diese Nuancen möglicherweise verloren, was die tiefergehende Interpretation des Textes erschweren kann.

- Abhängigkeit von Ressourcen: Lemmatisierungssysteme sind oft auf externe Ressourcen wie umfangreiche Wörterbücher, Lexika oder vortrainierte statistische Modelle angewiesen. Diese Ressourcen müssen aktuell gehalten und in das System integriert werden, was zusätzlichen Aufwand und Kosten verursachen kann.

- Kompatibilitätsprobleme: Die Verwendung unterschiedlicher Lemmatisierungsverfahren oder -algorithmen kann zu Inkonsistenzen in der Datenverarbeitung führen und die Integration von Textverarbeitungsanwendungen erschweren.

Diese Punkte zeigen, dass die Wahl und Implementierung eines Lemmatisierungssystems eine sorgfältige Abwägung erfordert.

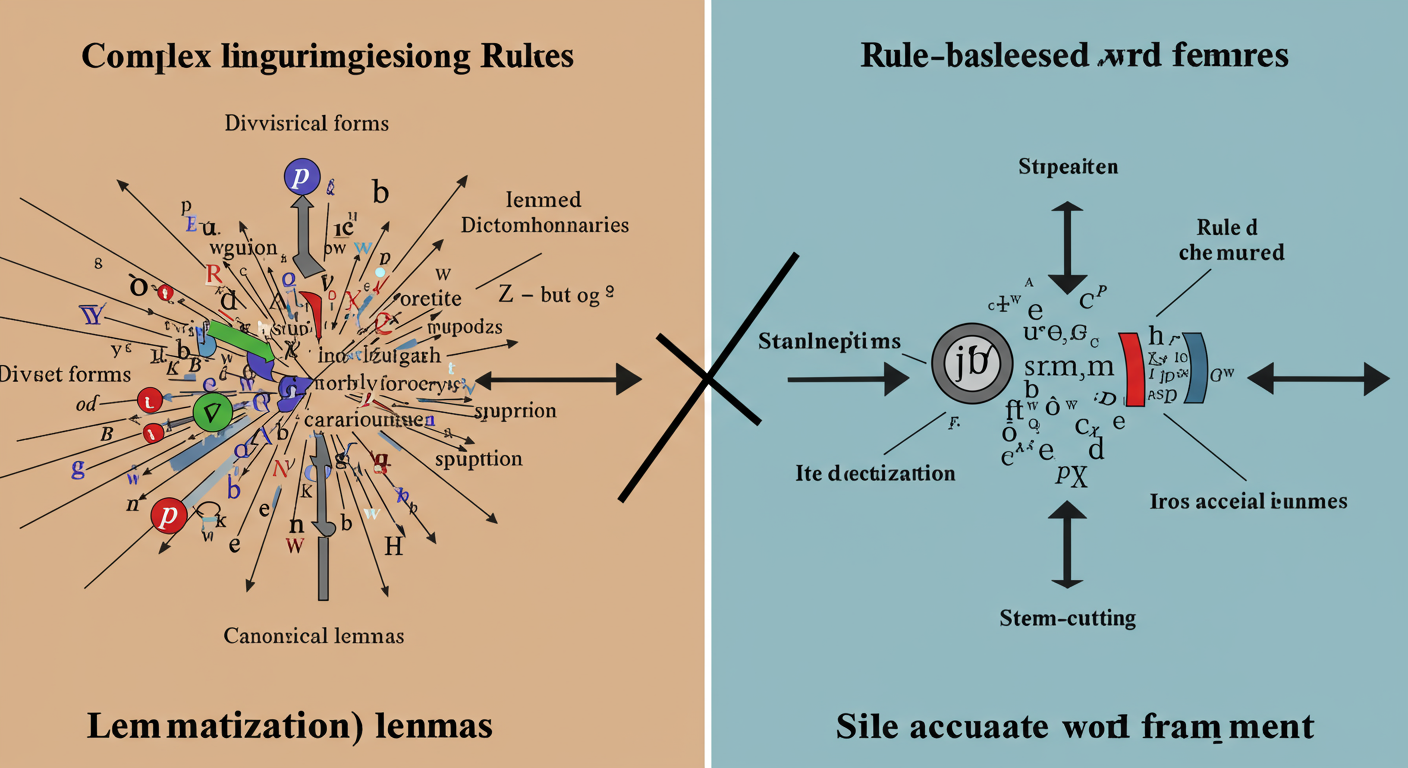

Lemmatisierung vs. Stemming: Ein entscheidender Vergleich

Sowohl Lemmatisierung als auch Stemming sind Techniken zur Reduzierung von Wortformen auf eine gemeinsame Basis, um die Effizienz der Textanalyse zu verbessern. Doch sie unterscheiden sich grundlegend in ihrer Herangehensweise und den Ergebnissen.

Die Lemmatisierung ist der linguistisch präzisere Ansatz. Sie zielt darauf ab, die tatsächliche lexikalische Grundform (das Lemma) eines Wortes zu finden, wobei Grammatik, Wortart und Kontext berücksichtigt werden. Das Ergebnis ist immer ein valides Wort, das im Wörterbuch gefunden werden könnte. Zum Beispiel wird „running“ zu „run“, „better“ zu „good“ und „Mäuse“ zu „Maus“.

Im Gegensatz dazu ist Stemming ein heuristischer Prozess, der einfach Wortendungen abschneidet, um einen sogenannten „Stamm“ zu erhalten. Dieser Stamm muss kein valides Wort sein und berücksichtigt weder den Kontext noch die Wortart. Stemming ist schneller und weniger rechenintensiv, aber auch weniger genau. „Running“ könnte zu „runn“ gestemmt werden, und „universal“, „universality“ könnten beide zu „univers“ gestemmt werden.

Um den Unterschied plastisch zu machen, betrachten wir ein Python-Beispiel mit NLTK:

import nltk

from nltk.stem import PorterStemmer, WordNetLemmatizer

from nltk.corpus import wordnet

# Nötige Ressourcen herunterladen (einmalig)

# nltk.download('punkt')

# nltk.download('wordnet')

# nltk.download('averaged_perceptron_tagger')

stemmer = PorterStemmer()

lemmatizer = WordNetLemmatizer()

def get_wordnet_pos(word):

"""Map POS tag to first character lemmatize() accepts"""

tag = nltk.pos_tag([word])[0][1][0].upper()

tag_dict = {"J": wordnet.ADJ,

"N": wordnet.NOUN,

"V": wordnet.VERB,

"R": wordnet.ADV}

return tag_dict.get(tag, wordnet.NOUN)

words_to_process = ["running", "runs", "ran", "easily", "fairly", "better", "geese", "corpora"]

print("Vergleich von Lemmatisierung und Stemming:n")

print("{:<15} {:<15} {:<15}".format("Original", "Lemmatisiert", "Gestemmt"))

print("-" * 45)

for word in words_to_process:

lemma = lemmatizer.lemmatize(word, get_wordnet_pos(word))

stem = stemmer.stem(word)

print("{:<15} {:<15} {:<15}".format(word, lemma, stem))

print("nBeispiel für deutsche Wörter mit SpaCy (nur Lemmatisierung):")

# Für deutsches Stemming gäbe es snowball.SnowballStemmer('german')

nlp_de = spacy.load("de_core_news_sm")

german_words_to_process = ["geht", "ging", "gegangen", "Häuser", "schönere", "Autos", "Mäuse"]

print("{:<15} {:<15}".format("Original", "Lemmatisiert (DE)"))

print("-" * 30)

for word in german_words_to_process:

doc = nlp_de(word)

print("{:<15} {:<15}".format(word, doc[0].lemma_))

Wie Sie sehen, liefert die Lemmatisierung „good“ für „better“, während Stemming „better“ unverändert lässt oder ungenaue Stämme wie „run“ für „running“ und „ran“ erzeugt. Für komplexe Sprachen wie Deutsch ist Lemmatisierung nahezu unerlässlich, da Stemming hier oft zu unbrauchbaren „Stämmen“ führen würde. Die Wahl zwischen den beiden hängt von der benötigten Algorithmus-Genauigkeit und der Recheneffizienz ab.

Ihr Weg zur effizienten Textanalyse

Die Lemmatisierung ist ein Eckpfeiler der modernen Textdatenverarbeitung und ein mächtiges Werkzeug, um die Qualität und Effizienz von NLP-Anwendungen signifikant zu steigern. Indem sie Wörter auf ihre lexikalische Grundformen zurückführt, ermöglicht sie eine tiefere und präzisere Analyse sprachlicher Daten, von der Suchmaschinenoptimierung bis zur Sentiment-Analyse. Auch wenn sie Komplexität und Rechenaufwand mit sich bringt, überwiegen die Vorteile, insbesondere wenn semantische Genauigkeit von größter Bedeutung ist. Nutzen Sie dieses Wissen, um Ihre Textanalyseprojekte auf das nächste Level zu heben und die wahre Bedeutung hinter den Worten zu entschlüsseln.

Uhm… Entschuldigung, wenn das jetzt eine ganz blöde Frage ist, und ich bin wirklich noch ganz neu in dem Thema… aber wenn man ein Wort auf seine Grundform zurückführt, was genau hilft das dann einem Computer *praktisch*? Ich meine, was macht der dann anders oder besser, wenn er zum Beispiel ‚läuft‘ und ‚laufen‘ als dasselbe erkennt? Ich würde das wirklich gerne verstehen.

Das ist überhaupt keine blöde frage, im gegenteil, sie ist sehr relevant und zeigt ein echtes interesse am praktischen nutzen. die fähigkeit eines computers, wörter auf ihre grundform zurückzuführen, also zum beispiel ‚läuft‘ und ‚laufen‘ als dasselbe zu erkennen, ist in vielen anwendungen von unschätzbarem wert. stellen sie sich vor, sie suchen in einer großen datenbank nach informationen. ohne diese fähigkeit müsste der computer nach jeder möglichen beugungsform eines wortes suchen, um alle relevanten ergebnisse zu finden. das wäre extrem ineffizient und würde zu unvollständigen suchergebnissen führen. durch die normalisierung auf die grundform kann der computer alle varianten eines wortes als eine einheit behandeln, was die suche präziser, schneller und umfassender macht.

es hilft auch bei der textanalyse und beim maschinellen lernen. wenn ein computer textdaten verarbeitet, um muster zu erkennen oder themen zu identifizieren, würde er ohne diese normalisierung jedes wort als eigenständige entität betrachten. das würde die datenmenge unnötig aufblähen und die erkennung von zusammenhängen erschwer

Die Lemmatisierung als Fundament der Sprachverarbeitung ist unbestreitbar wichtig, das wird hier klar dargestellt. Aber wenn wir von einem „Produkt“ sprechen, das die Effizienz *erheblich verbessert*, dann erwarte ich mehr als nur die Grundlagen.

**Es wäre aber noch besser, wenn es** nicht nur die lexikalische Grundform identifiziert, sondern auch eine kontextsensitive Lemmatisierung anbieten würde, die semantische Ambiguitäten berücksichtigt – was nützt mir das Lemma von „Bank“, wenn ich nicht weiß, ob es um Geld oder ein Sitzmöbel geht? Hier sehe ich einen echten Mehrwert, der über die reine Flexionsreduktion hinausgeht.

**Was wirklich fehlt, ist** eine robuste Strategie für den Umgang mit Neologismen, Slang und Rechtschreibfehlern. Wie geht das System mit Wörtern um, die nicht in einem Standardwörterbuch stehen oder noch nicht etabliert sind? Eine Erklärung dazu ist unerlässlich, denn die Sprache ist lebendig und entwickelt sich ständig weiter.

**Es wäre aber noch besser, wenn es** eine Art adaptives Lernmodul gäbe, das sich an domänenspezifische Sprachmuster anpassen lässt, um die Genauigkeit in spezialisierten Texten – etwa in der Medizin oder Technik – massiv zu erhöhen. Standard-Lemmatisierung stößt hier schnell an ihre Grenzen, und eine Feinanpassung wäre Gold wert.

**Was wirklich fehlt, ist** außerdem eine transparente Darstellung der zugrunde liegenden linguistischen Modelle und Entscheidungswege. Kann ich nachvollziehen, warum ein bestimmtes Lemma gewählt wurde? Und noch wichtiger: Kann ich die Regeln oder das Modell bei Bedarf anpassen oder feinjustieren, um spezifische Anforderungen zu erfüllen? Die „tiefgreifende linguistische Analyse“ muss auch für den Anwender zugänglich gemacht werden.

**Es wäre aber noch besser, wenn es** Benchmarks gäbe, die die Leistung über verschiedene Sprachen und Sprachvarianten hinweg quantifizieren, denn die Herausforderungen sind im Deutschen anders als im Englischen oder Chinesischen. Eine echte Mehrsprachigkeitslösung braucht hier mehr Tiefe.

Kurz gesagt: Die Basis ist gelegt, aber für ein wirklich herausragendes NLP-Tool muss man über die reine Grundform hinausdenken und die Komplexität der realen Sprache aktiver managen. Mehr Kontext, mehr Adaption, mehr Transparenz – das sind die nächsten Schritte.

Vielen dank für ihren ausführlichen und sehr differenzierten kommentar. es ist erfreulich zu sehen, dass die grundlegende bedeutung der lemmatisierung für sie so klar hervorgeht. ihre anmerkungen zur kontextsensitiven lemmatisierung, dem umgang mit neologismen und der adaptiven anpassung sind absolut berechtigt und zeigen ein tiefes verständnis für die herausforderungen der modernen sprachverarbeitung. diese punkte sind in der tat entscheidend, um über die reine flexionsreduktion hinauszugehen und ein wirklich leistungsstarkes nlp-tool zu schaffen, das den komplexen anforderungen der realen sprache gerecht wird.

ihre forderungen nach transparenz der linguistischen modelle und nachvollziehbaren entscheidungsfindungen sowie nach mehrsprachigen benchmarks sind ebenfalls von großer relevanz. sie greifen genau die themen auf, die bei der weiterentwicklung solcher systeme im fokus stehen müssen, um nicht nur die effizienz zu steigern, sondern auch die anpassbarkeit und verlässlichkeit zu gewährleisten. vielen dank nochmals für ihre wertvollen anregungen. ich lade sie herzlich ein, sich auch andere artikel in meinem profil oder meine weiteren veröffentlichungen