Das Perzeptron ist ein fundamentaler Baustein in der Welt der künstlichen Intelligenz, insbesondere im Bereich der neuronalen Netze und des Deep Learning. Es bildet die Grundlage für das Verständnis, wie Maschinen lernen, Muster zu erkennen und Entscheidungen zu treffen. Für Entwickler, Studenten und Technologiebegeisterte, die nach tiefgehenden Informationen zu diesem Thema suchen, ist das Perzeptron der ideale Ausgangspunkt, um die Komplexität moderner KI-Systeme zu entschlüsseln. Dieser Artikel wird die Funktionsweise, die zugrunde liegende Mathematik und die historische Entwicklung dieses revolutionären Algorithmus detailliert beleuchten.

In den folgenden Abschnitten werden wir zunächst die Biologie hinter den künstlichen Neuronen betrachten, bevor wir uns dem Kern des Perzeptrons zuwenden: seiner mathematischen Definition, der Perzeptron-Lernregel und der Art und Weise, wie Gewichtungskoeffizienten angepasst werden, um genaue Vorhersagen zu ermöglichen. Wir werden auch die Unterschiede zwischen Single-Layer- und Multi-Layer-Perzeptronen erörtern und praktische Python-Codebeispiele bereitstellen, um die Konzepte greifbar zu machen. Dieses Verständnis ist unerlässlich für jeden, der die Grundlagen des maschinellen Lernens und die Funktionsweise von binären Klassifizierern meistern möchte.

Die Grundlagen neuronaler Netze verstehen

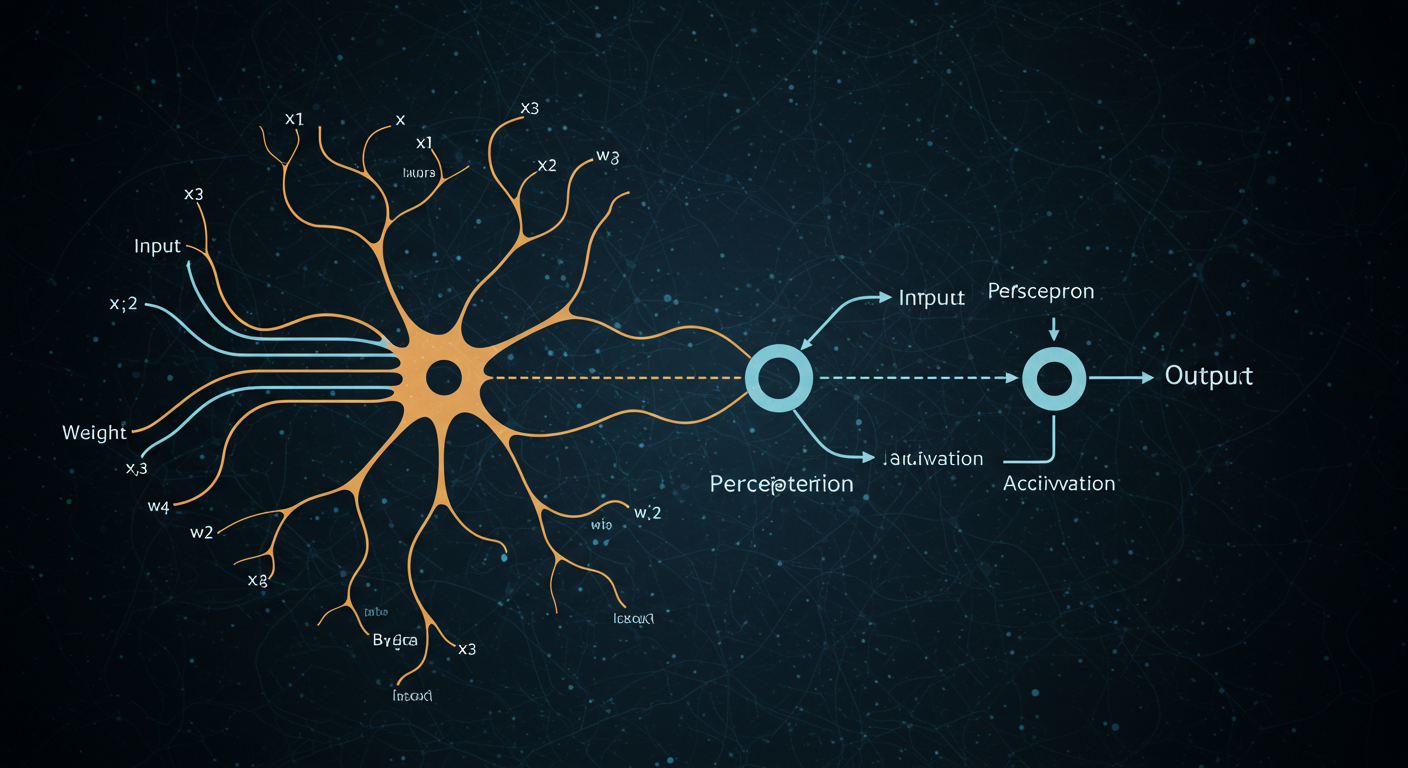

Um das Konzept eines Perzeptrons vollständig zu erfassen, ist es unerlässlich, zunächst die Inspiration dahinter zu verstehen: das biologische Neuron und seine Nachbildung als künstliches Neuron. Das menschliche Gehirn, ein Wunderwerk der Evolution, besteht aus Milliarden von Neuronen, die über komplexe Verbindungen chemische und elektrische Signale verarbeiten und übertragen. Diese Nervenzellen sind über Dendriten miteinander verbunden, die Informationen empfangen, über den Zellkern verarbeiten und über Synapsen an andere Neuronen weitergeben.

Künstliche Neuronen versuchen, diese beeindruckende Funktionsweise zu simulieren. Sie sind im Wesentlichen mathematische Funktionen, die darauf ausgelegt sind, Daten zu empfangen, diese zu gewichten, zu summieren und dann ein Ergebnis über eine Aktivierungsfunktion zu generieren. Ein künstliches neuronales Netz wiederum ist eine Ansammlung solcher miteinander verbundener künstlicher Neuronen, die in Schichten organisiert sind: einer Eingabeschicht, mehreren versteckten Schichten und einer Ausgabeschicht. Informationen fließen von einer Schicht zur nächsten, wobei jedes Neuron einen internen Zustand – das Aktivierungssignal – beibehält.

Biologische versus künstliche Neuronen: Eine Analogie

Die Analogie zwischen biologischen und künstlichen Neuronen ist der Schlüssel zum Verständnis der grundlegenden Architektur neuronaler Netze. Ein biologisches Neuron empfängt über seine Dendriten Signale, verarbeitet diese im Zellkörper und sendet bei Überschreiten eines Schwellenwerts ein Signal über sein Axon und die Synapsen an nachfolgende Neuronen. Dieser Prozess der Informationsverarbeitung und -weiterleitung wird im künstlichen Neuron abstrahiert.

Ein künstliches Neuron empfängt mehrere Eingaben (x₁,… xₙ), die jeweils mit einem spezifischen Gewicht (w₁,… wₙ) multipliziert werden. Diese Gewichte repräsentieren die Stärke der Verbindung, ähnlich wie die Effizienz einer Synapse. Eine Summierungsfunktion addiert alle gewichteten Eingaben sowie einen zusätzlichen Bias-Term, der die Aktivierungsschwelle des Neurons darstellt. Das Ergebnis dieser Summation wird dann durch eine Aktivierungsfunktion geleitet, die entscheidet, ob das Neuron „feuert“ oder nicht.

Aufbau eines einfachen künstlichen Neurons

Ein einzelnes künstliches Neuron lässt sich mathematisch wie folgt beschreiben. Die gewichtete Summe der Eingaben plus Bias wird berechnet. Anschließend wird eine Aktivierungsfunktion auf dieses Ergebnis angewendet, um die Ausgabe des Neurons zu bestimmen.

import numpy as np

def simple_neuron(inputs, weights, bias):

"""

Simuliert die Funktion eines einfachen künstlichen Neurons.

Args:

inputs (list or numpy array): Die Eingabewerte des Neurons.

weights (list or numpy array): Die Gewichtungskoeffizienten für jede Eingabe.

bias (float): Der Bias-Wert, der zur gewichteten Summe addiert wird.

Returns:

float: Das Ergebnis nach der Summation und Anwendung einer einfachen Schwellenwertfunktion.

"""

# Schritt 1: Berechnung der gewichteten Summe

# Jede Eingabe wird mit ihrem entsprechenden Gewicht multipliziert

weighted_sum = np.dot(inputs, weights) + bias

# Schritt 2: Anwendung einer Aktivierungsfunktion (hier: einfacher Schwellenwert)

# Das Neuron "feuert", wenn die gewichtete Summe >= 0 ist

output = 1 if weighted_sum >= 0 else 0

return output

# Beispielhafte Nutzung des einfachen Neurons

inputs_example = [0.7, 0.9] # Beispiel-Eingaben

weights_example = [0.5, 0.8] # Beispiel-Gewichtungen

bias_example = -0.5 # Beispiel-Bias

result = simple_neuron(inputs_example, weights_example, bias_example)

print(f"Ausgabe des einfachen Neurons: {result}")

Das Perzeptron: Ein fundamentales Bauelement der KI

Das Perzeptron wurde 1957 von Frank Rosenblatt am Cornell Aeronautical Laboratory erfunden und markierte einen Wendepunkt in der Geschichte der künstlichen Intelligenz. Rosenblatt schlug aufbauend auf den ersten Ideen künstlicher Neuronen die „Perzeptron-Lernregel“ vor. Ein Perzeptron ist somit ein künstliches Neuron und die grundlegende Einheit eines neuronalen Netzes. Seine primäre Aufgabe ist es, Berechnungen durchzuführen, um Merkmale oder Trends in den eingegebenen Daten zu erkennen und diese zu klassifizieren.

Es handelt sich um einen Algorithmus des überwachten Lernens, der speziell für binäre Klassifizierer konzipiert wurde. Dies bedeutet, dass das Perzeptron in der Lage ist, Datensätze zu lernen und zu verarbeiten, um sie in zwei Kategorien einzuteilen. Es spielt eine entscheidende Rolle in Machine-Learning-Projekten, insbesondere bei Aufgaben, die eine klare Trennung von Datenpunkten erfordern. Durch die genaue Anpassung seiner Parameter kann das Perzeptron effektiv zur Klassifizierung eingesetzt werden, indem es die Lernfähigkeit von binären Klassifizierern vereinfacht oder überwacht.

Die Geburt des Perzeptrons und seine historische Bedeutung

Die Erfindung des Perzeptrons durch Frank Rosenblatt im Jahr 1957 war ein Meilenstein in der frühen KI-Forschung. Es war eines der ersten Modelle, das zeigte, wie ein Computer „lernen“ konnte, indem er Muster in Daten erkannte. Rosenblatt’s Perzeptron basierte auf dem Konzept eines einzigen künstlichen Neurons, das in der Lage war, aus Beispielen zu lernen und Entscheidungen zu treffen. Es wurde mit großer Begeisterung aufgenommen und löste eine Welle der Forschung in der künstlichen Intelligenz aus.

Obwohl das initiale Perzeptron später durch seine Unfähigkeit, nicht-linear trennbare Probleme zu lösen, in Kritik geriet (insbesondere durch Minsky und Papert’s Buch „Perceptrons“ von 1969), legte es den Grundstein für alle nachfolgenden Entwicklungen in neuronalen Netzen. Es etablierte die Konzepte von Gewichtungen, Aktivierungsfunktionen und Lernregeln, die auch heute noch Kernbestandteile des Deep Learning sind. Ohne das Perzeptron wäre die Entwicklung der modernen KI in ihrer heutigen Form undenkbar gewesen.

Aufbau und Funktionsweise eines einfachen Perzeptrons

Die Funktionsweise eines Perzeptrons ist im Grunde eine einfache mathematische Operation. Es empfängt eine Reihe von Eingabewerten (x₁, x₂, …, xₙ), die mit entsprechenden Gewichtungskoeffizienten (w₁, w₂, …, wₙ) multipliziert werden. Diese gewichteten Eingaben werden summiert und ein Bias-Wert (b) wird hinzugefügt. Das Ergebnis dieser Summe wird dann einer Aktivierungsfunktion übergeben, die eine binäre Ausgabe (0 oder 1) erzeugt. Diese Ausgabe entscheidet, in welche der beiden Kategorien der Eingabedatensatz klassifiziert wird.

Mathematisch lässt sich der Prozess wie folgt darstellen: Die gewichtete Summe (z) wird berechnet als (z = sum_{i=1}^{n} (x_i cdot w_i) + b). Anschließend wird eine Aktivierungsfunktion (f) auf (z) angewendet, um die endgültige Ausgabe (hat{y}) zu erhalten: (hat{y} = f(z)). Für ein einfaches Perzeptron ist die Aktivierungsfunktion oft eine Stufenfunktion, die 1 ausgibt, wenn (z) einen bestimmten Schwellenwert überschreitet (meist 0), und 0 sonst.

Das Perzeptron fungiert als eine digitale Weiche: Erst wenn die gebündelte Stärke der eingehenden Signale einen kritischen Punkt überschreitet, wird es aktiv und gibt ein Signal aus.

import numpy as np

class Perceptron:

"""

Eine einfache Implementierung des Perzeptrons-Algorithmus.

Dient zur binären Klassifizierung von Daten.

"""

def __init__(self, num_inputs, learning_rate=0.01, epochs=100):

"""

Initialisiert das Perzeptron.

Args:

num_inputs (int): Anzahl der Eingangsmerkmale.

learning_rate (float): Die Lernrate, steuert die Anpassungsgröße der Gewichte.

epochs (int): Anzahl der Iterationen über den Trainingsdatensatz.

"""

# Zufällige Initialisierung der Gewichte und des Bias

# Gewichte werden für jede Eingabe benötigt

self.weights = np.random.rand(num_inputs) 0.1 - 0.05 # Kleine Zufallswerte

self.bias = np.random.rand(1) 0.1 - 0.05 # Kleiner Zufallswert

self.learning_rate = learning_rate

self.epochs = epochs

def activate(self, summation):

"""

Die Aktivierungsfunktion des Perzeptrons (Stufenfunktion).

Args:

summation (float): Die gewichtete Summe der Eingaben plus Bias.

Returns:

int: 1, wenn die Summe >= 0 ist, sonst 0.

"""

return 1 if summation >= 0 else 0

def predict(self, inputs):

"""

Macht eine Vorhersage für einen gegebenen Satz von Eingaben.

Args:

inputs (numpy array): Die Eingabewerte.

Returns:

int: Die vorhergesagte Klasse (0 oder 1).

"""

# Berechnung der gewichteten Summe

summation = np.dot(inputs, self.weights) + self.bias

# Anwendung der Aktivierungsfunktion

return self.activate(summation)

def train(self, training_inputs, labels):

"""

Trainiert das Perzeptron anhand des Trainingsdatensatzes.

Args:

training_inputs (numpy array): Die Eingabedaten für das Training.

labels (numpy array): Die zugehörigen korrekten Labels (0 oder 1).

"""

print("Beginne Training des Perzeptrons...")

for epoch in range(self.epochs):

total_error = 0

for inputs, label in zip(training_inputs, labels):

prediction = self.predict(inputs)

error = label - prediction # Berechnung des Fehlers

total_error += abs(error)

# Anpassung der Gewichte und des Bias

# Die Lernrate multipliziert mit dem Fehler und den Eingaben

self.weights += self.learning_rate error inputs

self.bias += self.learning_rate error

# Optional: Fortschritt pro Epoche anzeigen

if (epoch + 1) % 10 == 0:

print(f"Epoche {epoch+1}/{self.epochs}, Gesamtfehler: {total_error}")

print("Training abgeschlossen.")

# Beispiel: Training eines Perzeptrons für ein logisches AND-Gatter

# Eingaben: [x1, x2], Ausgaben: [y]

training_inputs = np.array([

[0, 0],

[0, 1],

[1, 0],

[1, 1]

])

labels = np.array([0, 0, 0, 1]) # AND-Gatter Logik

# Perzeptron initialisieren und trainieren

perceptron = Perceptron(num_inputs=2, learning_rate=0.1, epochs=10)

perceptron.train(training_inputs, labels)

# Testen des trainierten Perzeptrons

print("nTestergebnisse nach dem Training:")

for inputs, label in zip(training_inputs, labels):

prediction = perceptron.predict(inputs)

print(f"Eingaben: {inputs}, Erwartet: {label}, Vorhersage: {prediction}")

# Eigene Eingaben testen

custom_input = np.array([1, 0])

print(f"Benutzerdefinierte Eingabe {custom_input}: Vorhersage {perceptron.predict(custom_input)}")

Die Perzeptron-Lernregel im Detail

Die Perzeptron-Lernregel ist ein Algorithmus zum Anpassen der Gewichtungskoeffizienten und des Bias eines Perzeptrons, um korrekte Vorhersagen zu treffen. Sie gehört zu den Algorithmen des überwachten Lernens, bei denen dem Modell Paare von Eingaben und den zugehörigen korrekten Ausgaben (Labels) präsentiert werden. Ziel ist es, die Gewichte so anzupassen, dass die Vorhersagen des Perzeptrons möglichst gut mit den tatsächlichen Labels übereinstimmen.

Der Lernprozess verläuft iterativ: Für jeden Trainingsdatensatz wird eine Vorhersage getroffen. Stimmt die Vorhersage nicht mit dem tatsächlichen Label überein, wird der Fehler berechnet. Dieser Fehler wird dann verwendet, um die Gewichte und den Bias des Perzeptrons anzupassen. Die Anpassung erfolgt proportional zum Fehler und zur Eingabe, multipliziert mit einer Lernrate, die die Schrittgröße der Anpassung steuert. Diese Anpassungsmechanismen ermöglichen es dem Perzeptron, im Laufe der Zeit zu „lernen“ und seine Entscheidungsflächen zu optimieren.

# Update-Regeln für Gewichte und Bias

# delta_w_i = learning_rate (expected_output - actual_output) input_i

# delta_b = learning_rate (expected_output - actual_output)

# Pseudocode für die Gewichtsaktualisierung

# For each training example (inputs, label):

# prediction = predict(inputs)

# error = label - prediction

# For each weight w_i and input x_i:

# w_i = w_i + learning_rate error x_i

# bias = bias + learning_rate error

Aktivierungsfunktionen im Kontext des Perzeptrons

Die Aktivierungsfunktion ist ein entscheidendes Element im Perzeptron, da sie die finale Ausgabe des Neurons bestimmt. Sie führt eine Nichtlinearität in das Modell ein (obwohl das klassische Perzeptron selbst nur linear trennbare Probleme lösen kann). Für ein einfaches Perzeptron werden in der Regel Schwellenwertfunktionen verwendet, die eine binäre Ausgabe erzeugen. Die bekanntesten sind die Stufenfunktion (Heaviside-Funktion) und die Signum-Funktion.

- Stufenfunktion (Unit Step Function): Gibt 1 aus, wenn die gewichtete Summe größer oder gleich Null ist, und 0 sonst. Mathematisch: (f(z) = 1 text{ if } z ge 0 text{ else } 0).

- Signum-Funktion: Ähnlich der Stufenfunktion, gibt aber -1 anstelle von 0 für negative Werte aus. Mathematisch: (f(z) = 1 text{ if } z ge 0 text{ else } -1).

Diese Funktionen sind einfach und effizient für binäre Klassifikationsprobleme. Es ist jedoch wichtig zu beachten, dass sie nur eine „Entscheidung“ treffen können und keine Information über die „Sicherheit“ dieser Entscheidung liefern. Für komplexere neuronale Netze kommen differenzierbare Aktivierungsfunktionen wie Sigmoid, ReLU oder Tanh zum Einsatz, die ein Gradienten-basiertes Lernen (z.B. Backpropagation) ermöglichen.

| Aktivierungsfunktion | Beschreibung | Anwendungsbereich im Perzeptron |

|---|---|---|

| Stufenfunktion | Gibt 1 für positive Eingaben, 0 für negative Eingaben. | Klassisches Perzeptron für binäre Ausgabe. |

| Signum-Funktion | Gibt 1 für positive, -1 für negative Eingaben, 0 für Null. | Alternative für binäre Klassifikation mit Ausgaben im Bereich {-1, 1}. |

| (Sigmoid/ReLU/Tanh) | (Nicht für klassische Perzeptrons geeignet, aber in MLPs) | (Ermöglicht Differenzierbarkeit für Backpropagation in komplexeren Netzen.) |

Einschränkungen und Weiterentwicklungen: Single-Layer vs. Multi-Layer Perceptron

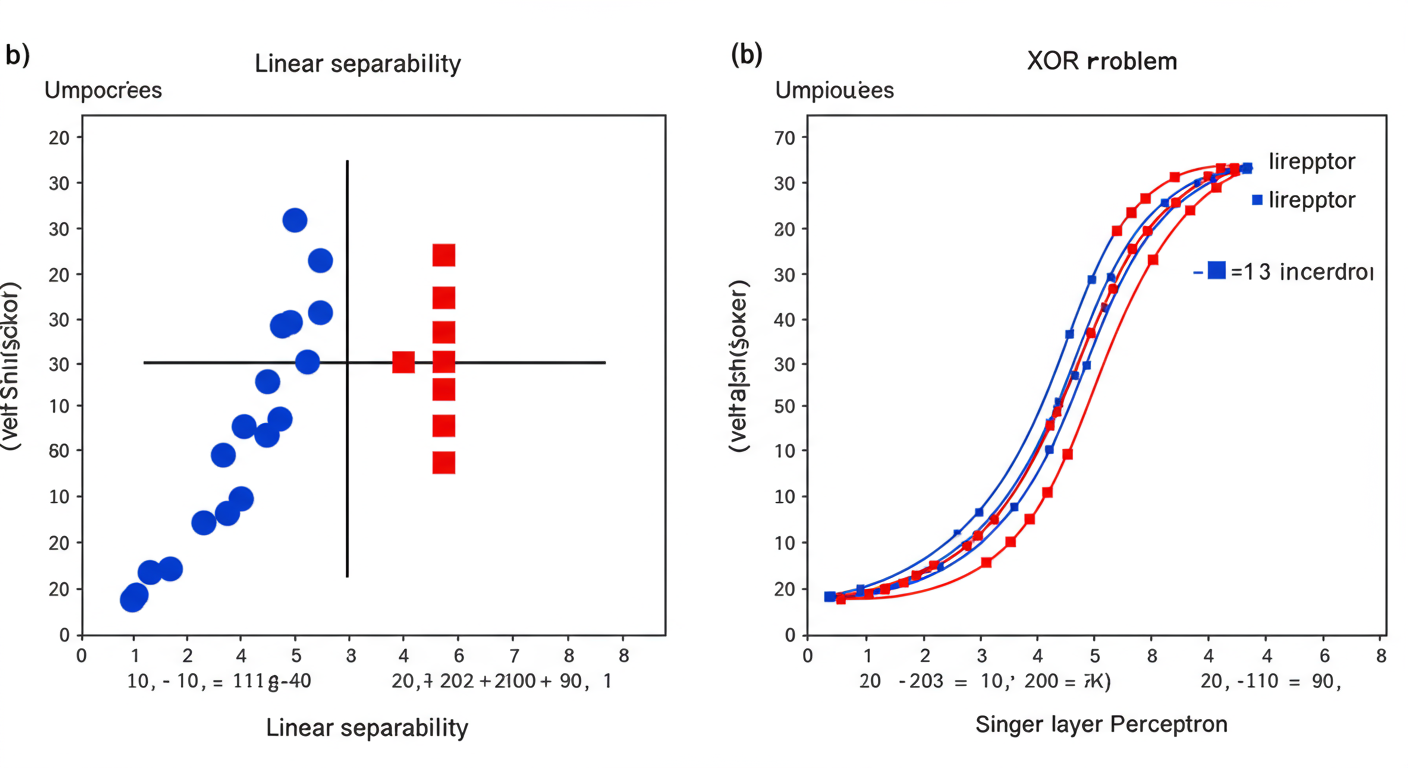

Das ursprüngliche Perzeptron, oft als Single-Layer Perceptron bezeichnet, war seiner Zeit voraus, hatte aber auch deutliche Einschränkungen. Diese führten zur Entwicklung komplexerer Architekturen, die als Multi-Layer Perceptron bekannt sind und die Leistungsfähigkeit neuronaler Netze revolutionierten. Das Verständnis dieser Entwicklung ist entscheidend für das Begreifen der Evolution von Machine Learning und Deep Learning.

Ein einschichtiges Perzeptron kann lediglich linear trennbare Funktionen lernen. Das bedeutet, es kann nur Probleme lösen, bei denen eine gerade Linie (oder eine Hyperebene in höheren Dimensionen) ausreicht, um die Datenpunkte verschiedener Klassen voneinander zu trennen. Dies war eine große Einschränkung, die das Interesse an neuronalen Netzen in den 1970er und 1980er Jahren stark dämpfte, bis neue Architekturen und Lernalgorithmen wie die Backpropagation entwickelt wurden.

Das Single-Layer Perceptron und seine Grenzen

Ein Single-Layer Perceptron, bestehend aus einem einzigen Schicht von Ausgabeneuronen, ist effektiv für die Klassifizierung von Daten, die linear trennbar sind. Beispiele hierfür sind logische Operationen wie das AND-Gatter oder das OR-Gatter. Bei diesen Problemen lassen sich die verschiedenen Ausgabezustände durch eine einfache Trennlinie im Merkmalsraum voneinander abgrenzen. Für das AND-Gatter etwa sind alle Punkte außer (1,1) als 0 klassifiziert, und (1,1) als 1. Eine Linie kann diese Punkte voneinander trennen.

Das berühmteste Beispiel für ein Problem, das ein Single-Layer Perceptron nicht lösen kann, ist das Exklusiv-Oder (XOR)-Problem. Hierbei sind die Eingabekombinationen (0,0) und (1,1) als 0 klassifiziert, während (0,1) und (1,0) als 1 klassifiziert sind. Im zweidimensionalen Raum ist es unmöglich, eine einzige gerade Linie zu ziehen, die diese vier Punkte korrekt in zwei Klassen trennt. Diese Erkenntnis, popularisiert durch Minsky und Papert, führte zu einem „KI-Winter“, da sie die damalige Forschung stark beeinflusste.

Das Multi-Layer Perceptron (MLP) als Lösung

Die Einschränkungen des Single-Layer Perzeptrons wurden durch die Einführung des Multi-Layer Perceptron (MLP) überwunden. Ein MLP, auch bekannt als „Feed-Forward Neuronales Netz“, besteht aus mindestens einer versteckten Schicht zwischen der Eingabe- und der Ausgabeschicht. Diese versteckten Schichten sind der Schlüssel zur Lösung nicht-linear trennbarer Probleme wie dem XOR-Gatter.

Jede Schicht in einem MLP verarbeitet die Ausgaben der vorhergehenden Schicht und leitet ihre eigenen Ausgaben an die nächste Schicht weiter. Durch die Kombination mehrerer Neuronen in versteckten Schichten und die Verwendung nicht-linearer Aktivierungsfunktionen (wie Sigmoid oder ReLU) kann ein MLP hochkomplexe Muster und Beziehungen in den Daten lernen. Der Lernprozess in MLPs erfolgt in der Regel durch den Backpropagation-Algorithmus, der die Fehler von der Ausgabeschicht zurück durch die versteckten Schichten leitet, um die Gewichte und Biase anzupassen.

Die Fähigkeit von MLPs, beliebige kontinuierliche Funktionen zu approximieren (Universelles Approximations-Theorem), machte sie zu einem mächtigen Werkzeug und ebnete den Weg für die Entwicklung des modernen Deep Learnings. Obwohl das Perzeptron selbst linear ist, können mehrere Perzeptronen in einem Multi-Layer-Netzwerk nichtlineare Entscheidungsflächen bilden.

Bedeutung des Perzeptrons für moderne KI

Obwohl das Perzeptron in seiner einfachsten Form nur linear trennbare Probleme lösen kann, ist seine fundamentale Bedeutung für die Entwicklung der modernen künstlichen Intelligenz und des Deep Learnings nicht zu unterschätzen. Es war der erste erfolgreiche Algorithmus, der die Idee des „Lernens“ durch Gewichtsaktualisierung in einem künstlichen neuronalen Modell implementierte und demonstrierte. Seine Konzepte von Eingaben, Gewichten, Summation und Aktivierungsfunktionen sind die Bausteine, auf denen alle komplexeren neuronalen Netze aufbauen.

Heute ist das Perzeptron, insbesondere in seiner erweiterten Form als Multi-Layer Perceptron, ein integraler Bestandteil vieler moderner KI-Architekturen. Es dient als grundlegendes Verständnismodell für Neuronale Netze und hilft, die Funktionsweise von komplexen Deep Learning Modellen wie Convolutional Neural Networks (CNNs) oder Recurrent Neural Networks (RNNs) zu erklären. Für jeden, der sich in die Welt der KI vertiefen möchte, ist das gründliche Verständnis des Perzeptrons der erste und wichtigste Schritt, um die Mächtigkeit und das Potenzial von maschinellem Lernen zu erkennen.

Das Erforschen des Perzeptrons öffnet die Tür zu tiefergehenden Themen wie Backpropagation, verschiedenen Aktivierungsfunktionen und der Architektur komplexer neuronaler Netze. Es ist der Ausgangspunkt, um die faszinierende Entwicklung von einfachen Klassifikatoren hin zu den leistungsstarken Algorithmen zu verstehen, die heute in Spracherkennung, Bildanalyse und vielen anderen bahnbrechenden KI-Anwendungen zum Einsatz kommen. Wir hoffen, dieser detaillierte Einblick hat Ihr Verständnis für dieses grundlegende Konzept erweitert und Sie dazu ermutigt, Ihre Reise in die Welt der Datenwissenschaft und des maschinellen Lernens fortzusetzen.

Möchten Sie Ihr Wissen über Perzeptron und neuronale Netze weiter vertiefen oder haben Sie spezifische Fragen zu den vorgestellten Konzepten und Codebeispielen? Teilen Sie Ihre Gedanken und Erfahrungen in den Kommentaren, und entdecken Sie weitere spannende Artikel in unserem Blog, um Ihre Fähigkeiten im Bereich Data Science und KI kontinuierlich auszubauen.

Als ich den Artikel über Perzeptronen gelesen habe, musste ich unweigerlich an meine eigenen „Lernprozesse“ denken, die ganz ohne Algorithmen auskamen, aber vom Prinzip her vielleicht gar nicht so unähnlich waren. Ich erinnere mich lebhaft an den Sommer, als ich unbedingt Fahrradfahren lernen wollte. Ich muss so um die sechs Jahre alt gewesen sein, und mein Vater war mein geduldiger „Trainer“.

Jedes Mal, wenn ich mich auf diesen viel zu großen Drahtesel schwang, gab es unzählige „Inputs“: Wie stark drücke ich die Pedale? Wie weit lehne ich mich zur Seite? Wie schnell drehe ich den Lenker? Am Anfang war das Ergebnis immer dasselbe: ein kurzer, wackeliger Moment der Hoffnung, gefolgt von einem unsanften Aufprall auf dem Kiesweg. Es war eine Abfolge von „Fehlklassifikationen“, wenn man so will.

Mein Gehirn war in diesem Moment wie ein kleines, überfordertes Perzeptron. Es versuchte, all diese sensorischen Daten – das Gefühl des Gleichgewichts, die Bewegung der Beine, den Blick nach vorn – zu gewichten und eine „Entscheidung“ zu treffen: Bleibe ich aufrecht? Und jedes Mal, wenn ich fiel, bekam es ein klares „Fehler-Signal“. Es war kein komplexer Backpropagation-Algorithmus, aber es war Feedback.

Langsam, über Stunden und Tage hinweg, passten sich diese inneren „Gewichtungen“ an. Ich lernte intuitiv, wie viel Druck ich auf die Pedale geben musste, um nicht umzufallen, wie ich den Lenker minimal korrigierte, um die Balance zu halten. Es war ein Prozess des Ausprobierens, des Scheiterns und des allmählichen, fast unbewussten Erfolgs. Plötzlich, nach unzähligen Stürzen, klickte es. Die „Neuronen“ in meinem Kopf hatten die richtigen Verbindungen gefunden, die „Gewichte“ waren justiert, und ich fuhr! Es war kein perfekter Algorithmus, aber es war mein erster großer Sieg über die Schwerkraft, gelernt durch reine Wiederholung und Feedback. Eine schöne Analogie dazu, wie selbst die komplexesten Fähigkeiten oft auf sehr einfachen, iterativen Lernprozessen basieren.

Es ist wunderbar zu lesen, wie sie die prinzipien der perzeptronen auf ihre eigenen kindheitserfahrungen übertragen. die analogie zum fahrradfahren lernen ist sehr treffend und zeigt hervorragend, wie grundlegende lernprozesse, selbst ohne explizite algorithmen, nach ähnlichen mustern ablaufen können. das „fehler-signal“ beim sturz und die anpassung der „gewichtungen“ im gehirn sind eine perfekte illustration dessen, was wir in der künstlichen intelligenz versuchen nachzubilden.

ihre geschichte verdeutlicht, dass das prinzip von input, verarbeitung, output und feedback ein universelles lernmodell ist, das sowohl in der menschlichen entwicklung als auch in der maschinellen intelligenz eine zentrale rolle spielt. vielen dank für diesen wertvollen kommentar, der den artikel so schön ergänzt. ich würde mich freuen, wenn sie sich auch andere artikel in meinem profil oder meine weiteren veröffentlichungen ansehen.

Dieser Artikel über Perzeptronen und die Grundlagen des maschinellen Lernens hat mich gerade an etwas ganz Persönliches erinnert, das zwar auf einer ganz anderen Ebene spielt, aber irgendwie doch die Faszination des Lernens und der Mustererkennung aufzeigt.

Ich hatte mal einen kleinen Terrier-Mischling namens Max. Max war ein liebenswerter Chaot, aber nicht gerade der hellste Stern am Hunde-Himmel, was Gehorsam anging. Ich wollte ihm unbedingt beibringen, „Sitz“ zu machen. Anfangs war das ein Desaster. Ich sagte „Sitz“, er sprang hoch, wedelte, versuchte, meine Hand zu lecken – alles, nur nicht sitzen. Es war, als würde er ein zufälliges Signal empfangen und völlig willkürlich darauf reagieren.

Ich habe es immer und immer wieder versucht. Jedes Mal, wenn er auch nur ansatzweise seinen Hintern Richtung Boden bewegte, gab es ein Leckerli und überschwängliches Lob. Wenn er sich hinhockte, noch bevor ich das Kommando gab, gab es nichts. Es war meine ganz eigene, rudimentäre „Lernregel“: Wenn Aktion X auf Kommando Y folgt, verstärke die Verbindung. Wenn nicht, schwäche sie ab.

Es dauerte Wochen, wirklich Wochen, in denen ich mich manchmal fragte, ob Max überhaupt lernfähig war. Aber dann, eines Tages, passierte es. Ich sagte „Sitz“, und er setzte sich. Nicht zögerlich, nicht mit einem Blick, der fragte „War das richtig?“, sondern zielstrebig und sofort. Es war ein kleiner Moment für die Welt, aber ein riesiger für mich und Max. Er hatte das Muster erkannt. Er hatte gelernt, welche „Eingabe“ (mein Kommando) welche „Ausgabe“ (sitzen) erfordert, um die „Belohnung“ zu erhalten. Seine kleinen neuronalen Verbindungen hatten sich angepasst, seine „Gewichtungen“ für das Kommando „Sitz“ waren so stark geworden, dass die richtige Reaktion quasi automatisiert ablief.

Jedes Mal, wenn ich heute über neuronale Netze und deren Fähigkeit spreche, Muster zu erkennen und zu lernen, muss ich an Max denken. Es ist natürlich eine extreme Vereinfachung, aber im Kern ist es doch diese unglaubliche Fähigkeit, aus Erfahrung zu lernen und seine internen Mechanismen so anzupassen, dass die gewünschte Reaktion erfolgt. Ob es nun ein Hund ist, der „Sitz“ lernt, oder ein Perzeptron, das Kategorien klassifiziert – die Grundidee des Lernens und der Anpassung bleibt faszinierend.

Es ist wirklich schön zu lesen, wie sehr die beschreibung der perzeptronen sie an ihre persönlichen erfahrungen mit max erinnert hat. ihre geschichte verdeutlicht auf wunderbare weise, wie grundlegende prinzipien des lernens und der mustererkennung, die wir in der informatik untersuchen, auch im alltag und in der tierwelt zu finden sind. die geduld und die konsequente verstärkung, die sie angewendet haben, sind genau das, was auch in vielen algorithmischen lernprozessen zum tragen kommt, wenn auch in einer formalisierten form.

es ist faszinierend, wie sie die anpassung von max’s verhalten mit der anpassung von gewichtungen in neuronalen netzen vergleichen. diese parallelität zeigt, dass die zugrunde liegenden mechanismen des lernens, sei es biologisch oder künstlich, oft ähnliche konzepte von eingabe, verarbeitung und ausgabe mit einem feedback-mechanismus teilen, um die gewünschten ergebnisse zu erzielen. vielen dank für diesen wertvollen kommentar und die inspirierende geschichte. ich würde mich freuen, wenn sie auch andere artikel in meinem profil oder meine weiteren veröffentlichungen ansehen.