Die digitale Transformation hat die Nachfrage nach Fachkräften in der Datenwissenschaft exponentiell ansteigen lassen. Eine fundierte Data Scientist Weiterbildung ist heute entscheidend, um in dieser dynamischen Branche Fuß zu fassen oder die eigene Karriere voranzutreiben. Data Scientists sind die Architekten der Erkenntnis aus Daten, befähigt, komplexe Datensätze zu analysieren, Muster zu erkennen und prädiktive Modelle zu entwickeln, die Unternehmen strategische Vorteile verschaffen. Sie sind die Brücke zwischen rohen Informationen und umsetzbaren Geschäftseinblicken, was ihre Rolle in jeder zukunftsorientierten Organisation unverzichtbar macht.

Dieser ausführliche Blogbeitrag bietet Entwicklern, Studenten und Technologiebegeisterten einen tiefgehenden Einblick in die essenziellen Komponenten einer solchen Weiterbildung. Wir werden die wichtigsten Lerninhalte wie Python Grundlagen für Data Science, fortgeschrittene Machine Learning Konzepte, Deep Learning Architekturen und praktische Aspekte des Data Engineering sowie MLOps detailliert beleuchten. Ergänzt wird dies durch konkrete Codebeispiele, die das Verständnis der technischen Konzepte erleichtern und den Alltag eines Data Scientist greifbar machen.

Der Weg zum Data Scientist: Ein detaillierter Lehrplan

Der Beruf des Data Scientist wurde von der Harvard Business Review einst als „sexiest Job des 21. Jahrhunderts“ bezeichnet. Diese Wertschätzung rührt daher, dass Data Scientists in der Lage sind, aus riesigen, oft unstrukturierten Datenmengen wertvolle Informationen zu extrahieren und damit entscheidende Probleme zu lösen. Von der Bestandsoptimierung über die Wettervorhersage bis hin zur Personalisierung von Nutzererlebnissen – die Anwendungsfelder sind schier grenzenlos. Eine hochwertige Data Scientist Weiterbildung vermittelt dabei nicht nur theoretisches Wissen, sondern legt großen Wert auf die praktische Anwendung und die Entwicklung jener Kompetenzen, die auf dem Arbeitsmarkt gefragt sind.

Ein strukturierter Lehrplan bildet das Rückgrat jeder exzellenten Data Science Ausbildung. Er deckt eine breite Palette von Technologien und Methoden ab, von grundlegenden Programmierkenntnissen bis hin zu spezialisierten Bereichen der Künstlichen Intelligenz. Im Folgenden werden wir die Schlüsselmodule und deren Inhalte detaillierter untersuchen, um ein klares Bild der erforderlichen Fertigkeiten zu vermitteln.

Python Grundlagen für Data Science

Python ist die Lingua franca der Datenwissenschaft. Eine solide Grundlage in dieser vielseitigen Programmiersprache ist unerlässlich. Dies umfasst nicht nur die Syntax, sondern auch das Verständnis für explorative Statistiken, Datenqualität und objektorientierte Programmierung. Das Beherrschen von Bibliotheken wie NumPy für numerische Operationen und Pandas für Datenmanipulation ist für jeden angehenden Data Scientist von fundamentaler Bedeutung, um Daten effizient zu verwalten und vorzubereiten.

import pandas as pd

import numpy as np

# Beispiel: Laden und erste Inspektion eines Datensatzes

# Ein Data Scientist beginnt oft mit der Datenaufnahme und -bereinigung.

data = {

'ID': [1, 2, 3, 4, 5],

'Produkt': ['Laptop', 'Tastatur', 'Maus', 'Monitor', 'Webcam'],

'Verkaufszahlen': [120, 500, 750, 80, np.nan], # np.nan simuliert fehlende Daten

'Preis_EUR': [1200.50, 75.99, 25.00, 349.99, 49.50]

}

df = pd.DataFrame(data)

print("Original DataFrame:")

print(df)

# Datenqualität: Fehlende Werte identifizieren und behandeln

print("nFehlende Werte pro Spalte:")

print(df.isnull().sum())

# Ersetzen fehlender Werte (z.B. mit dem Median der Verkaufszahlen)

median_sales = df['Verkaufszahlen'].median()

df['Verkaufszahlen'].fillna(median_sales, inplace=True)

print("nDataFrame nach Behandlung fehlender Werte:")

print(df)

# Explorative Statistik: Grundlegende Beschreibungen

print("nDeskriptive Statistik der Verkaufszahlen:")

print(df['Verkaufszahlen'].describe())

Effektive Datenvisualisierung

Rohdaten sind oft nur schwer verständlich. Die Fähigkeit, Daten visuell ansprechend und informativ darzustellen, ist eine Kernkompetenz im Bereich Data Science. Tools wie Matplotlib, Seaborn und Plotly ermöglichen es Data Scientists, komplexe Beziehungen und Muster in Daten grafisch zu veranschaulichen. Eine gute Datenvisualisierung erzählt eine Geschichte, macht Erkenntnisse zugänglich und unterstützt die Entscheidungsfindung erheblich.

import matplotlib.pyplot as plt

import seaborn as sns

# Beispiel: Einfache Datenvisualisierung mit Matplotlib und Seaborn

# Angenommen, wir haben Verkaufsdaten über verschiedene Monate

months = ['Jan', 'Feb', 'Mär', 'Apr', 'Mai']

sales_product_a = [150, 180, 220, 200, 250]

sales_product_b = [100, 110, 130, 120, 140]

plt.figure(figsize=(10, 6))

sns.lineplot(x=months, y=sales_product_a, marker='o', label='Produkt A')

sns.lineplot(x=months, y=sales_product_b, marker='x', label='Produkt B')

plt.title('Monatliche Verkaufszahlen')

plt.xlabel('Monat')

plt.ylabel('Anzahl Verkäufe')

plt.legend()

plt.grid(True)

plt.show()

# Beispiel: Histogramm zur Verteilung von Preisen

# Wir nutzen den DataFrame aus dem Python Grundlagen Beispiel

plt.figure(figsize=(8, 5))

sns.histplot(df['Preis_EUR'], bins=5, kde=True) # kde=True zeigt die Kerndichteschätzung

plt.title('Verteilung der Produktpreise')

plt.xlabel('Preis (EUR)')

plt.ylabel('Anzahl der Produkte')

plt.show()

Programmiertools und Cloud-Grundlagen

Neben Python sind weitere Programmiertools für Data Scientists unerlässlich, um in modernen Entwicklungsumgebungen effizient zu arbeiten. Dazu gehören das Beherrschen der Kommandozeile (Linux & Bash), Versionskontrollsysteme wie Git und GitHub für die kollaborative Entwicklung sowie Unit Testing zur Sicherstellung der Codequalität. Darüber hinaus ist ein Verständnis für Cloud-Computing-Plattformen, insbesondere AWS Cloud Practitioner-Kenntnisse, entscheidend, da viele datenintensive Anwendungen in der Cloud bereitgestellt werden.

# Beispiel: Einfaches Shell-Skript (Bash) zur Dateiverwaltung

# Dies wäre ein Beispiel für Bash-Kenntnisse

#!/bin/bash

# Ordner für Daten erstellen, falls nicht vorhanden

if [ ! -d "data_exports" ]; then

mkdir data_exports

echo "Ordner 'data_exports' erstellt."

fi

# Dummy-CSV-Datei erstellen

echo "ID,Name,Wert" > data_exports/report_2023_10.csv

echo "1,Alpha,100" >> data_exports/report_2023_10.csv

echo "2,Beta,150" >> data_exports/report_2023_10.csv

echo "3,Gamma,200" >> data_exports/report_2023_10.csv

echo "Datei report_2023_10.csv in data_exports erstellt."

# Dateien im Ordner auflisten

ls data_exports/

# Eine einfache Python-Datei für Unit Testing

# datei: calculator.py

# def add(a, b):

# return a + b

#

# def subtract(a, b):

# return a - b

# datei: test_calculator.py

import unittest

from calculator import add, subtract

class TestCalculator(unittest.TestCase):

def test_add(self):

self.assertEqual(add(1, 2), 3)

self.assertEqual(add(-1, 1), 0)

self.assertEqual(add(-1, -1), -2)

def test_subtract(self):

self.assertEqual(subtract(5, 3), 2)

self.assertEqual(subtract(10, 20), -10)

if __name__ == '__main__':

unittest.main()

Grundlegende Machine Learning Konzepte

Machine Learning ist das Herzstück der modernen Datenanalyse. Eine Data Scientist Weiterbildung vermittelt tiefe Einblicke in Klassifikations-, Regressions- und Clustering-Algorithmen. Dazu gehören Techniken wie lineare Regression, logistische Regression, Support Vector Machines, Entscheidungsbäume, Random Forests und K-Means. Das Verständnis der mathematischen Statistik, die diesen Modellen zugrunde liegt, ist entscheidend, um Modelle korrekt zu wählen, zu trainieren und zu evaluieren.

| Algorithmus-Typ | Anwendungsszenario | Beispiel-Algorithmen |

|---|---|---|

| Klassifikation | Vorhersage einer Kategorie (diskret) | Logistische Regression, SVM, Random Forest |

| Regression | Vorhersage eines numerischen Wertes (kontinuierlich) | Lineare Regression, Polynomiale Regression |

| Clustering | Gruppierung ähnlicher Datenpunkte | K-Means, DBSCAN, Hierarchical Clustering |

| Dimensionsreduktion | Reduzierung der Feature-Anzahl bei Datenerhaltung | PCA, t-SNE |

from sklearn.model_selection import train_test_split

from sklearn.linear_model import LogisticRegression

from sklearn.metrics import accuracy_score

from sklearn.datasets import load_iris # Ein häufig verwendeter Datensatz für Klassifikation

# Beispiel: Klassifikation mit Logistischer Regression

# Laden des Iris-Datensatzes

iris = load_iris()

X, y = iris.data, iris.target

# Aufteilung in Trainings- und Testdaten

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3, random_state=42)

# Modell initialisieren und trainieren

model = LogisticRegression(max_iter=200) # Erhöhen max_iter für Konvergenz

model.fit(X_train, y_train)

# Vorhersagen auf den Testdaten treffen

y_pred = model.predict(X_test)

# Modellperformance bewerten

accuracy = accuracy_score(y_test, y_pred)

print(f"Genauigkeit der Logistischen Regression: {accuracy:.2f}")

# Beispiel: Einfaches Clustering mit K-Means

from sklearn.cluster import KMeans

import matplotlib.pyplot as plt

import seaborn as sns

# Synthetische Daten für Clustering

from sklearn.datasets import make_blobs

X_blobs, y_blobs = make_blobs(n_samples=300, centers=4, cluster_std=0.60, random_state=0)

# K-Means Modell initialisieren und trainieren

kmeans = KMeans(n_clusters=4, random_state=0, n_init=10) # n_init zur Vermeidung lokaler Minima

kmeans.fit(X_blobs)

y_kmeans = kmeans.predict(X_blobs)

# Visualisierung der Cluster

plt.figure(figsize=(8, 6))

sns.scatterplot(x=X_blobs[:, 0], y=X_blobs[:, 1], hue=y_kmeans, palette='viridis', legend='full')

plt.scatter(kmeans.cluster_centers_[:, 0], kmeans.cluster_centers_[:, 1], s=300, c='red', marker='X', label='Zentroide')

plt.title('K-Means Clustering')

plt.xlabel('Feature 1')

plt.ylabel('Feature 2')

plt.legend()

plt.show()

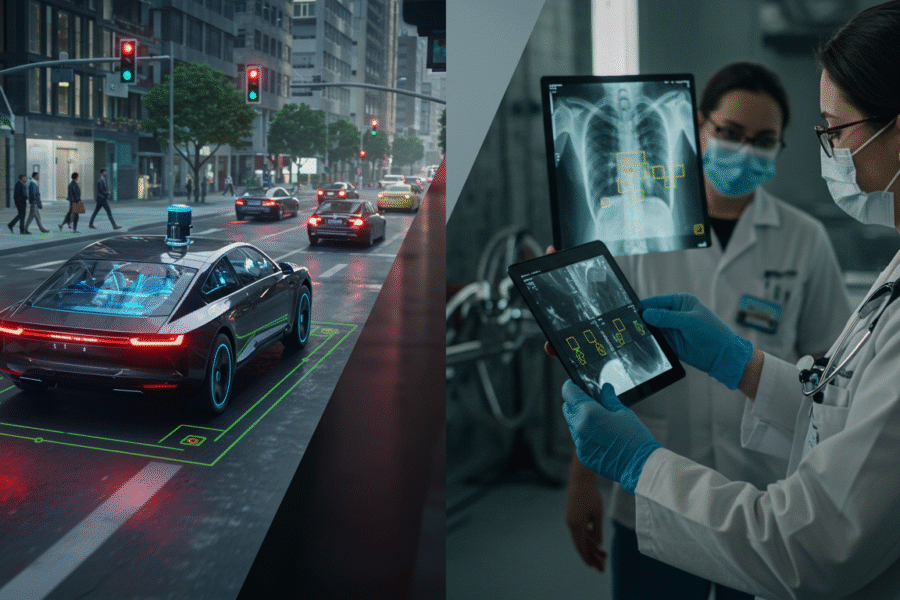

Fortgeschrittene Machine Learning und Deep Learning

Über die Grundlagen hinaus taucht eine umfassende Data Scientist Weiterbildung in fortgeschrittene Themen wie Recommender Systeme, Pipelines für Machine Learning Workflows, Dimensionsreduktion, Zeitreihenanalyse, Anomalieerkennung und Reinforcement Learning ein. Der Bereich Deep Learning, mit seinen Anwendungen in Bild- und Textverarbeitung, ist ebenfalls zentral. Hier werden Konzepte wie Dense Networks und Convolutional Networks (CNNs) vermittelt, oft unter Verwendung von Frameworks wie Keras und TensorFlow. Die Entwicklung von Vorhersagemodellen und künstlichen Intelligenzen erfordert ein tiefes Verständnis dieser komplexen Architekturen.

„Daten sind das neue Öl, und die Datenwissenschaft ist die Raffinerie.“

import tensorflow as tf

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Dense, Flatten, Conv2D, MaxPooling2D

from tensorflow.keras.datasets import mnist

import numpy as np

# Beispiel: Einfaches Convolutional Neural Network (CNN) mit Keras/TensorFlow

# Für die Bilderkennung, z.B. MNIST Datensatz

# 1. Daten laden und vorbereiten

(X_train_raw, y_train_raw), (X_test_raw, y_test_raw) = mnist.load_data()

# Normalisieren der Pixelwerte auf 0-1 und Reshape für CNN (H, W, C)

X_train = X_train_raw.reshape(X_train_raw.shape[0], 28, 28, 1).astype('float32') / 255

X_test = X_test_raw.reshape(X_test_raw.shape[0], 28, 28, 1).astype('float32') / 255

# One-hot-Encoding für Labels

y_train = tf.keras.utils.to_categorical(y_train_raw, 10)

y_test = tf.keras.utils.to_categorical(y_test_raw, 10)

# 2. Modellarchitektur definieren

model = Sequential([

Conv2D(32, kernel_size=(3, 3), activation='relu', input_shape=(28, 28, 1)),

MaxPooling2D(pool_size=(2, 2)),

Flatten(),

Dense(128, activation='relu'),

Dense(10, activation='softmax') # 10 Klassen für Ziffern 0-9

])

# 3. Modell kompilieren

model.compile(optimizer='adam',

loss='categorical_crossentropy',

metrics=['accuracy'])

# 4. Modell trainieren (nur ein paar Epochen für schnelles Beispiel)

# model.fit(X_train, y_train, epochs=3, batch_size=32, validation_split=0.1)

# Ausgabe der Modellzusammenfassung (ohne Training für dieses Snippet)

print("CNN Modellarchitektur:")

model.summary()

# Dummy-Vorhersage für ein einzelnes Bild, falls Modell trainiert wäre

# if model.weights: # Prüfen, ob das Modell trainiert wurde (hat Gewichte)

# sample_image = np.expand_dims(X_test[0], axis=0) # Bild in Batch-Dimension einbetten

# prediction = model.predict(sample_image)

# predicted_class = np.argmax(prediction)

# print(f"nVorhersage für das erste Testbild: {predicted_class}")

Data Engineering und MLOps

Moderne Data Science Projekte enden nicht bei der Modellentwicklung. Die Integration von Modellen in produktive Umgebungen erfordert Kenntnisse im Data Engineering und in MLOps (Machine Learning Operations). Module hierzu umfassen oft SQL für Datenbankabfragen, die Arbeit mit APIs zur Datenintegration und verteilte Datenverarbeitung mit Tools wie PySpark. MLOps-Praktiken, wie die Bereitstellung von Anwendungen mit Streamlit und die Containerisierung mittels Docker, sind entscheidend, um Machine Learning Modelle zuverlässig zu operationalisieren und zu skalieren.

# Beispiel: SQL-Abfrage zum Extrahieren von Kundendaten

# Dies wäre eine SQL-Abfrage, die ein Data Scientist für Datenzugriff verwenden könnte

-- SELECT

-- kunde_id,

-- vorname,

-- nachname,

-- email,

-- registrierungsdatum

-- FROM

-- kunden

-- WHERE

-- registrierungsdatum >= '2023-01-01' AND registrierungsdatum < '2024-01-01'

-- ORDER BY

-- registrierungsdatum DESC;

# Beispiel: Grundlegende Datenverarbeitung mit PySpark

# PySpark wird für große, verteilte Datensätze verwendet.

# Dies setzt eine Spark-Umgebung voraus.

# import findspark

# findspark.init()

from pyspark.sql import SparkSession

from pyspark.sql.functions import col

# SparkSession erstellen

spark = SparkSession.builder.appName("DataEngineeringExample").getOrCreate()

# Dummy-DataFrame erstellen (im echten Szenario würde man Daten laden, z.B. spark.read.csv)

data_pyspark = [("Alice", 1, 30), ("Bob", 2, 25), ("Charlie", 1, 35), ("David", 3, 28)]

columns_pyspark = ["Name", "Team", "Alter"]

df_spark = spark.createDataFrame(data_pyspark, columns_pyspark)

print("Original PySpark DataFrame:")

df_spark.show()

# Daten filtern und transformieren

df_filtered = df_spark.filter(col("Alter") > 28)

print("nPySpark DataFrame gefiltert (Alter > 28):")

df_filtered.show()

# Aggregation

df_avg_age_per_team = df_spark.groupBy("Team").agg({"Alter": "avg"})

print("nDurchschnittsalter pro Team:")

df_avg_age_per_team.show()

# SparkSession beenden

spark.stop()

# Beispiel: Dockerfile für eine Streamlit-App (Auszug)

# Dockerfile

# FROM python:3.9-slim-buster

# WORKDIR /app

# COPY requirements.txt .

# RUN pip install --no-cache-dir -r requirements.txt

# COPY . .

# EXPOSE 8501

# CMD ["streamlit", "run", "app.py"]

Die Data Science Laufbahn und ihre Perspektiven

Nach einer intensiven Data Scientist Weiterbildung stehen den Absolvierenden zahlreiche Türen offen. Der Arbeitsmarkt für Data Scientists ist weiterhin robust und wächst stetig, getrieben durch den Bedarf an datengesteuerten Entscheidungen in nahezu jeder Branche. Die erworbenen Kompetenzen befähigen dazu, nicht nur als Data Scientist zu arbeiten, sondern auch in verwandten Rollen wie Machine Learning Engineer, Data Analyst oder sogar im Bereich Data Engineering.

Die berufliche Integration von Data Scientist Absolvierenden ist aufgrund der hohen Nachfrage und der spezialisierten Fähigkeiten, die sie mitbringen, oft sehr erfolgreich. Viele Weiterbildungsinstitute bieten gezielte Karriereunterstützung an, die von der Erstellung eines professionellen Lebenslaufs bis hin zu Vorstellungsgespräch-Simulationen reicht. Dies maximiert die Chancen, den Traumjob in der Datenbranche zu finden.

Gehaltsaussichten und Karriereentwicklung

Das Gehalt eines Data Scientists ist im Durchschnitt attraktiv und bietet sehr gute Karrierechancen, abhängig von Erfahrung, Branche und Unternehmensgröße. Da die Rolle des Data Scientists weiterhin an Bedeutung gewinnt, steigen auch die Verdienstmöglichkeiten und die Möglichkeit zur Spezialisierung in Nischenbereichen wie Natural Language Processing (NLP), Computer Vision oder Reinforcement Learning. Die Fähigkeit, mit komplexen Datenintegrationen umzugehen und skalierbare Lösungen zu entwickeln, ist dabei besonders wertvoll.

Bedeutung von Soft Skills und Networking

Neben den technischen Fähigkeiten sind Soft Skills für Data Scientists von großer Bedeutung. Kommunikationsfähigkeit, sowohl schriftlich als auch mündlich, ist entscheidend, um komplexe Analyseergebnisse verständlich zu präsentieren und mit nicht-technischen Stakeholdern zu interagieren. Projektmanagement und Teamarbeit sind ebenfalls wichtige Kompetenzen. Der Aufbau eines Netzwerks, beispielsweise über Alumni-Gemeinschaften oder Fachkonferenzen, hilft zudem, auf dem neuesten Stand der Technik zu bleiben und berufliche Chancen zu entdecken.

Häufig gestellte Fragen zur Data Scientist Weiterbildung

Interessenten an einer Data Scientist Weiterbildung haben oft viele Fragen bezüglich des Berufsfeldes, der Ausbildung und der Karrierechancen. Hier finden Sie Antworten auf die gängigsten Anliegen, die Ihnen helfen sollen, eine fundierte Entscheidung für Ihre berufliche Zukunft zu treffen.

Was macht ein Data Scientist eigentlich?

Ein Data Scientist ist ein Experte, der datenbasierte Algorithmen implementiert, um eine Vielzahl von Problemen zu lösen. Dies reicht von der Bestandsoptimierung über die Wettervorhersage bis hin zur Klassifizierung (z.B. Spam-Erkennung), Empfehlung (z.B. für Netflix), Clustering von Daten, Aufdeckung von Anomalien (Betrugsbekämpfung), Bild-, Text- und Audioerkennung sowie der Automatisierung von Prozessen. Die Hauptaufgabe besteht darin, das Potenzial riesiger Datenmengen zu erschließen und daraus konkreten Nutzen für Unternehmen zu ziehen.

Welche Aufgaben hat ein Data Scientist im Alltag?

Der Alltag eines Data Scientist ist dynamisch und wiederholt sich in einem spezifischen Zyklus: Zuerst werden Daten erfasst, gesammelt und gespeichert. Danach erfolgt die Bedarfsermittlung, bei der die richtigen Fragen gestellt werden, um die Daten gezielt einzusetzen. Anschließend werden die Daten aufbereitet, integriert, ihre Gültigkeit überprüft und gegebenenfalls bereinigt. Eine erste Analyse mittels explorativer Statistik folgt, bevor ein oder mehrere Modelle und Algorithmen ausgewählt und angewendet werden (Machine Learning, statistische Modellierung, KI). Der Zyklus schließt mit der Messung und kontinuierlichen Verbesserung der Ergebnisse ab.

Welche Voraussetzungen sind für eine Data Scientist Weiterbildung nötig?

Für die Aufnahme in eine Data Scientist Weiterbildung sind in der Regel gute Kenntnisse in Mathematik, insbesondere in Statistik und Wahrscheinlichkeitsrechnung, sowie grundlegende Programmierkenntnisse erforderlich. Viele Anbieter führen Eignungstests durch, um das Niveau der Teilnehmer festzustellen und sicherzustellen, dass die Ausbildung optimal passt. Zudem ist für Online-Kurse ein stabiler Internetzugang und ein Computer mit Webcam notwendig.

Wie wird die Weiterbildung anerkannt und welche Zertifikate erhalte ich?

Eine hochwertige Weiterbildung zum Data Scientist sollte zu mehreren anerkannten Zertifikaten führen. Dies kann ein akademisch anerkanntes Zertifikat einer renommierten Universität sein, ein Abschlusszertifikat des Weiterbildungsanbieters selbst, Modulzertifikate für bestandene Tests und optional auch international anerkannte Zertifizierungen wie die AWS Cloud Practitioner-Zertifizierung. Diese Nachweise dokumentieren die erworbenen Qualifikationen und stärken die Karrierechancen erheblich.

Welche Finanzierungsmöglichkeiten gibt es für die Weiterbildung?

Die Finanzierung einer Data Scientist Weiterbildung kann auf verschiedene Weisen erfolgen. Dazu gehören die Eigenfinanzierung, oft mit der Möglichkeit einer Ratenzahlung, oder die Nutzung eines Bildungsgutscheins, der in Deutschland für Arbeitslose oder von Arbeitslosigkeit bedrohte Personen die Kosten komplett übernehmen kann. Auch eine teilweise oder vollständige Übernahme der Kosten durch den Arbeitgeber ist eine gängige Option, oft unterstützt durch Förderprogramme wie das Qualifizierungschancengesetz.

Abschließende Gedanken zum Data Scientist Karrierepfad

Eine Data Scientist Weiterbildung ist eine Investition in eine zukunftssichere Karriere. Sie stattet Sie mit den Fähigkeiten aus, die Unternehmen in der datengesteuerten Welt von morgen dringend benötigen, von der Datenanalyse bis zur Entwicklung von Machine Learning Algorithmen.

Bleiben Sie neugierig, experimentieren Sie mit den hier vorgestellten Technologien und teilen Sie Ihre Erfahrungen. Der Austausch mit der Community ist ein unschätzbarer Vorteil auf Ihrem Weg zum erfolgreichen Data Scientist. Erkunden Sie weitere Artikel auf unserem Blog, um Ihr Wissen kontinuierlich zu vertiefen und immer am Puls der technologischen Entwicklung zu bleiben.

Genau meine Meinung! Danke, das musste mal gesagt werden. Die Rolle des Data Scientists ist in der heutigen Zeit absolut unverzichtbar, und dieser Beitrag bringt die Wichtigkeit einer fundierten Weiterbildung perfekt auf den Punkt. Volle Zustimmung!

Es freut mich sehr, dass der artikel ihre meinung so gut widerspiegelt und die bedeutung der weiterbildung für data scientists hervorhebt. es ist in der tat entscheidend, die relevanz dieser position zu unterstreichen.

vielen dank für ihre zustimmung und ihr positives feedback. ich lade sie herzlich ein, sich auch andere artikel in meinem profil oder meine weiteren veröffentlichungen anzusehen.

Der Beitrag beleuchtet eindrücklich die wachsende Bedeutung von Data Scientists und die Notwendigkeit fundierter Weiterbildungen in diesem Bereich. Zweifellos birgt die Fähigkeit, aus riesigen Datenmengen Erkenntnisse zu gewinnen, ein enormes Potenzial für Effizienzsteigerung, Innovation und die Lösung komplexer Probleme in Wirtschaft und Gesellschaft. Unternehmen profitieren von strategischen Vorteilen, verbesserter Entscheidungsfindung und personalisierten Angeboten, was wiederum – im besten Fall – zu besseren Produkten und Dienstleistungen für Konsumenten führen kann. Für die Data Scientists selbst bietet sich ein vielversprechendes, intellektuell anspruchsvolles Berufsfeld mit hoher Nachfrage.

Doch hinter dieser glänzenden Fassade verbergen sich auch tiefgreifende moralische und gesellschaftliche Herausforderungen, die es ernsthaft zu diskutieren gilt.

**Wer profitiert und wer leidet möglicherweise?**

**Profiteure** sind klar die Unternehmen, die durch datengesteuerte Modelle ihre Prozesse optimieren, neue Geschäftsfelder erschließen und Wettbewerbsvorteile erzielen. Auch die Data Scientists selbst gehören zu den Gewinnern, da sie gefragte Experten in einem lukrativen Markt sind. Konsumenten können von individualisierten Angeboten und effizienteren Dienstleistungen profitieren, solange diese transparent und zum Wohle des Einzelnen eingesetzt werden.

Die **Leidtragenden** sind jedoch vielfältiger und weniger offensichtlich:

1. **Individuen und Gruppen, die von algorithmischer Diskriminierung betroffen sind:** Wenn die Trainingsdaten für Machine-Learning-Modelle historische oder gesellschaftliche Vorurteile widerspiegeln, können die daraus resultierenden Algorithmen diese Vorurteile perpetuieren oder sogar verstärken. Dies kann dazu führen, dass Menschen aufgrund ihrer Herkunft, ihres Geschlechts oder anderer Merkmale schlechtere Kreditkonditionen erhalten, bei Bewerbungen benachteiligt werden oder in Gesundheitssystemen unzureichend versorgt werden. Hier sind Data Scientists die Architekten, aber auch die potenziellen Verstärker von Ungerechtigkeit, wenn sie die Daten und Modelle nicht kritisch hinterfragen.

2. **Die Privatsphäre der Bürger:** Die Fähigkeit, aus „riesigen, oft unstrukturierten Datenmengen wertvolle Informationen zu extrahieren“ und „Nutzererlebnisse zu personalisieren“, klingt verlockend. Sie birgt jedoch auch die Gefahr einer umfassenden Überwachung und Profilerstellung. Werden unsere Daten ohne unsere volle und informierte Zustimmung gesammelt, analysiert und für Zwecke verwendet, die wir nicht absehen können? Die Grenze zwischen nützlicher Personalisierung und unerwünschter Manipulation oder gar Überwachung kann fließend sein.

3. **Transparenz und Rechenschaftspflicht:** Viele fortgeschrittene Machine-Learning-Modelle sind „Black Boxes“. Es ist oft schwer nachzuvollziehen, *warum* ein Algorithmus eine bestimmte Entscheidung getroffen hat. Diese mangelnde Erklärbarkeit ist problematisch, insbesondere in sensiblen Bereichen wie Justiz, Medizin oder Finanzwesen, wo Transparenz und die Möglichkeit, Entscheidungen anzufechten, grundlegend sind.

4. **Arbeitnehmer in anderen Sektoren:** Während Data Science neue Arbeitsplätze schafft, können die durch sie ermöglichte Automatisierung und Effizienzsteigerung auch zum Wegfall von Arbeitsplätzen in anderen Bereichen führen, insbesondere bei routinemäßigen oder datengesteuerten Aufgaben. Dies kann soziale Ungleichheit und die Notwendigkeit massiver Umschulung verstärken.

5. **Die Gesellschaft als Ganzes:** Die Macht, die mit der Beherrschung von Daten und Algorithmen einhergeht, ist immens. Wenn diese Macht in den Händen weniger konzentriert ist oder ohne ausreichende ethische Reflexion und Regulierung eingesetzt wird, besteht die Gefahr von Manipulation (z.B. durch gezielte Desinformation), der Aushöhlung demokratischer Prozesse und der Erosion des gesellschaftlichen Vertrauens.

Die Weiterbildung zum Data Scientist muss daher über die bloße Vermittlung technischer Fähigkeiten hinausgehen. Sie muss ein starkes Bewusstsein für die ethischen Dimensionen der Arbeit mit Daten, für Fairness, Transparenz und den verantwortungsvollen Umgang mit Macht vermitteln. Nur so können wir sicherstellen, dass diese transformative Technologie nicht nur wirtschaftlichen Nutzen stiftet, sondern auch dem Wohl aller dient und unsere Gesellschaft gerechter und freier macht.

Es freut mich sehr, dass mein artikel zu ihren gedanken über die facetten der data science anregungen geben konnte. sie beleuchten mit ihrer ausführlichen stellungnahme auf sehr präzise weise die ethischen und gesellschaftlichen herausforderungen, die mit der zunehmenden bedeutung von datenwissenschaften einhergehen. ihre punkte zu algorithmischer diskriminierung, privatsphäre, transparenz und den möglichen auswirkungen auf arbeitnehmer und die gesellschaft als ganzes sind von größter relevanz und ergänzen die diskussion um die positive seite des feldes auf wichtige weise.

ihre betonung der notwendigkeit, dass weiterbildungen im bereich data science nicht nur technische fähigkeiten, sondern auch ein starkes bewusstsein für ethische dimensionen vermitteln müssen, trifft den kern der sache. es ist entscheidend, dass wir als gesellschaft und insbesondere die fachleute in diesem bereich die verantwortung für die auswirkungen ihrer arbeit übernehmen. ich danke ihnen für diesen wertvollen beitrag, der die diskussion bereichert und zum nachdenken anregt. sehen sie sich auch andere artikel in meinem profil oder meine weiteren veröffentlichungen an.