Erfahren Sie, was eine Virtuelle Maschine (VM) ist, wie sie funktioniert und warum sie das Rückgrat moderner IT-Infrastrukturen bildet. Entdecken Sie Vortei…

Virtuelle Maschinen (VMs): Das Fundament moderner IT-Infrastrukturen

In der heutigen digitalen Welt sind virtuelle Maschinen (VMs) allgegenwärtig, auch wenn sie oft im Hintergrund agieren. Sie sind das unsichtbare Rückgrat, das Cloud-Computing, Softwareentwicklung, Testumgebungen und eine Fülle anderer technologischer Fortschritte überhaupt erst ermöglicht. Eine VM ist im Grunde ein Computer innerhalb eines Computers – eine von der physischen Hardware isolierte Software-basierte Umgebung, die ihr eigenes Betriebssystem und ihre eigenen Anwendungen ausführen kann.

Von der Optimierung von Serverressourcen bis hin zur Schaffung flexibler Entwicklungsumgebungen – die Vielseitigkeit von VMs ist beeindruckend. Doch was genau verbirgt sich hinter diesem Konzept, wie funktionieren sie im Detail und warum sind sie für moderne IT-Strategien unverzichtbar? Dieser Artikel beleuchtet die Kernaspekte virtueller Maschinen und ihre entscheidende Rolle in der technologischen Landschaft.

Was ist eine Virtuelle Maschine (VM)?

Eine virtuelle Maschine (VM) ist eine Software-basierte Simulation eines physikalischen Computers. Sie agiert wie ein eigenständiger Rechner mit eigener CPU, eigenem Arbeitsspeicher, eigenem Speicherplatz und eigenen Netzwerkschnittstellen. Diese emulierte Hardware wird von einem Host-System, der physischen Maschine, bereitgestellt. Auf der virtuellen Hardware läuft dann ein Gastbetriebssystem (Guest OS), das von der zugrundeliegenden physischen Hardware komplett abstrahiert ist. Dies ermöglicht es, mehrere, voneinander unabhängige Betriebssysteme und Anwendungen auf einem einzigen physischen Server laufen zu lassen, was die Ressourcenauslastung drastisch erhöht.

- CPU-Ressourcen: Dedizierte oder geteilte Prozessorkerne, die vom Host-System zugewiesen werden.

- Arbeitsspeicher (RAM): Zugewiesener oder dynamisch verwalteter Arbeitsspeicher, der für das Gastsystem zur Verfügung steht.

- Speicherplatz: Virtuelle Festplatten, die oft als Dateien auf dem Host-System gespeichert werden und als lokaler Speicher für die VM dienen.

- Netzwerkadapter: Virtuelle Netzwerkkarten, die eine Verbindung zum Host-Netzwerk oder isolierten Netzwerken ermöglichen.

- Emulierte Peripheriegeräte: Virtuelle Darstellungen von CD-ROM-Laufwerken, USB-Ports und anderen Geräten, die für die Funktionalität der VM benötigt werden.

Aus der Perspektive des Gastbetriebssystems und der darauf laufenden Anwendungen fühlt sich die VM wie eine echte, dedizierte Hardware an. Diese Isolation schützt das Host-System vor potenziellen Problemen im Gastsystem und umgekehrt, was ein höheres Maß an Stabilität und Sicherheit gewährleistet.

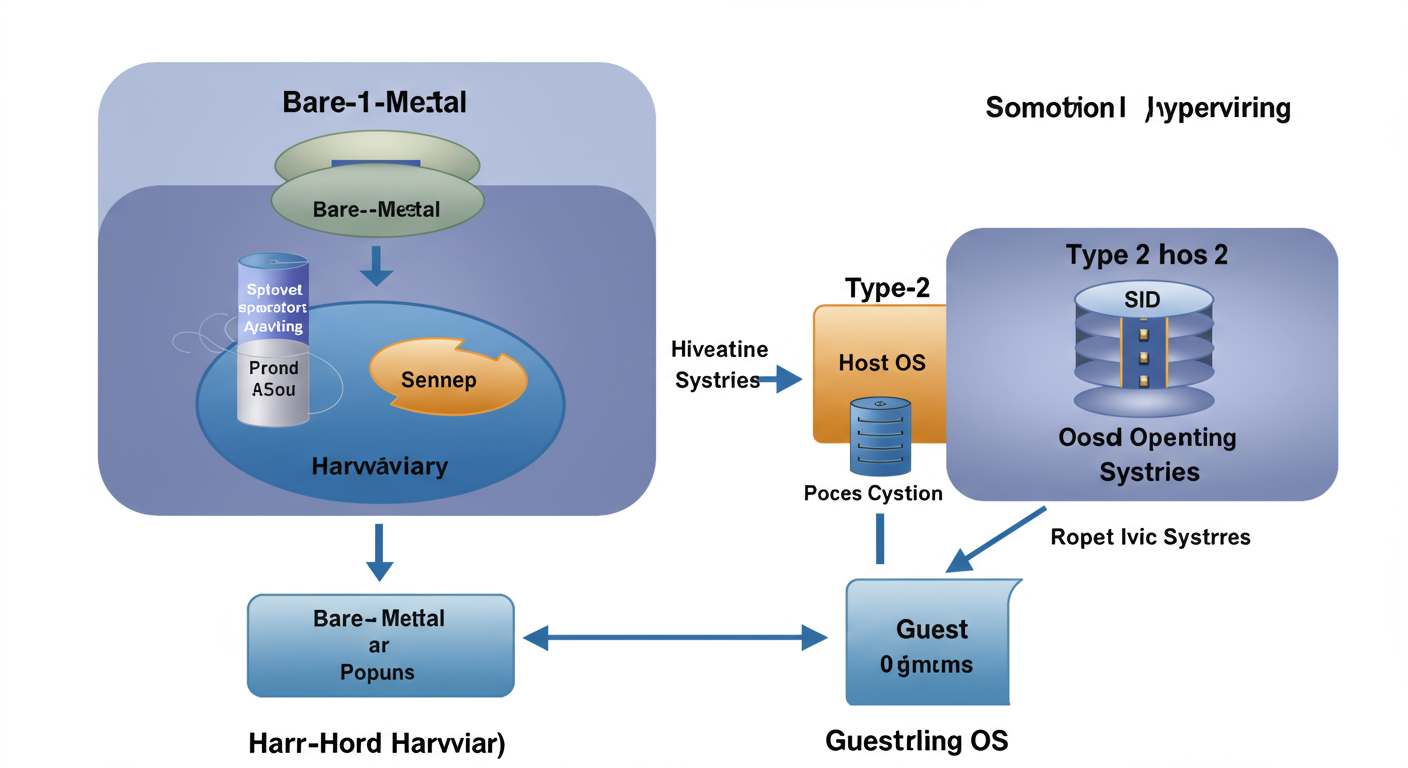

Wie funktioniert Virtualisierung? Die Rolle des Hypervisors

Das Herzstück jeder Virtualisierungsumgebung ist der Hypervisor. Diese Software-Schicht ist dafür verantwortlich, die physikalische Hardware des Host-Systems zu verwalten und die virtuellen Maschinen zu erstellen, zu starten, zu stoppen und zu isolieren. Man unterscheidet hierbei hauptsächlich zwischen zwei Typen:

- Typ 1 Hypervisor (Bare-Metal): Diese laufen direkt auf der Hardware des Host-Systems, ohne dass ein Host-Betriebssystem dazwischen liegt. Bekannte Beispiele sind VMware ESXi, Microsoft Hyper-V (in seiner Server-Version) und KVM (Kernel-based Virtual Machine) unter Linux. Sie sind besonders performant und sicher, da sie die direkteste Kontrolle über die Hardware haben und weniger Overhead erzeugen.

- Typ 2 Hypervisor (Hosted): Diese laufen als Anwendung auf einem bereits installierten Host-Betriebssystem (z. B. Windows, macOS, Linux). Beispiele hierfür sind Oracle VirtualBox oder VMware Workstation. Sie sind einfacher zu installieren und zu nutzen, bieten aber potenziell geringere Performance und sind anfälliger für Sicherheitsprobleme des zugrundeliegenden Host-OS, da der Hypervisor auf dessen Betriebssystem aufbaut.

Der Hypervisor agiert als intelligenter Vermittler, der Anfragen der virtuellen Maschinen an die physische Hardware leitet und die Ressourcen so aufteilt, dass jede VM die ihr zugewiesenen Kapazitäten erhält und andere VMs nicht beeinträchtigt. Er ist auch für die Verwaltung der virtuellen Maschinenlebenszyklen zuständig.

Unverzichtbare Vorteile von Virtuellen Maschinen

Die weite Verbreitung von VMs ist kein Zufall, sondern das Ergebnis einer beeindruckenden Liste von Vorteilen, die sie für Unternehmen und Entwickler bieten:

- Ressourceneffizienz und Konsolidierung: Mehrere Server können auf einem einzigen physischen Rechner betrieben werden. Dies reduziert Hardwarekosten, Stromverbrauch und Kühlbedarf erheblich, was zu einer nachhaltigeren IT-Infrastruktur beiträgt.

- Isolation und Sicherheit: Jede VM ist von anderen VMs und dem Host-System isoliert. Ein Absturz oder eine Sicherheitslücke in einer VM beeinträchtigt in der Regel nicht die anderen Systeme, was die Angriffsfläche minimiert.

- Flexibilität und Agilität: VMs können schnell erstellt, geklont, verschoben und gelöscht werden. Dies beschleunigt Bereitstellungsprozesse, erleichtert die Skalierung und ermöglicht schnelle Reaktionen auf sich ändernde Geschäftsanforderungen.

- Kostenersparnis: Weniger physische Hardware, geringerer Energieverbrauch und einfacheres Management führen zu signifikanten Kosteneinsparungen sowohl bei Anschaffung als auch im laufenden Betrieb.

- Disaster Recovery und Business Continuity: VMs lassen sich einfach sichern und wiederherstellen. Im Falle eines Hardware-Ausfalls oder einer Katastrophe kann eine VM schnell auf einer anderen, verfügbaren Maschine gestartet werden, um Ausfallzeiten zu minimieren.

Diese Vorteile machen VMs zu einem Eckpfeiler moderner IT-Strategien, insbesondere im Bereich des Cloud-Computings und der DevOps-Praktiken, wo Agilität und Effizienz entscheidend sind.

Vielfältige Anwendungsfälle für VMs

Die Einsatzmöglichkeiten virtueller Maschinen sind nahezu grenzenlos. Sie reichen von der einfachen Softwareentwicklung bis hin zu komplexen Cloud-Infrastrukturen:

- Entwicklung & Testumgebungen: Entwickler können auf einer einzigen Maschine verschiedene Betriebssysteme und Konfigurationen einrichten, um ihre Software unter diversen Bedingungen zu testen, ohne mehrere physische Rechner zu benötigen. Dies beschleunigt den Entwicklungszyklus und verbessert die Softwarequalität.

- Serverkonsolidierung: Althergebrachte physische Server, die oft nur gering ausgelastet waren, können durch VMs ersetzt werden. Dies optimiert die Hardwarenutzung, reduziert physischen Platzbedarf und senkt Wartungskosten.

- Cloud Computing: Infrastructure as a Service (IaaS)-Angebote basieren maßgeblich auf der Virtualisierung. Große Cloud-Anbieter wie AWS, Azure oder Google Cloud stellen ihren Kunden virtuelle Maschinen zur Verfügung, die nach Bedarf skaliert werden können.

- Ausführung älterer Software: Programme, die nur auf spezifischen, älteren Betriebssystemen lauffähig sind, können in einer VM weiterhin betrieben werden, ohne die Hauptsysteme zu beeinträchtigen.

- Sicherheitstests und Sandboxing: Potenziell unsichere Software oder verdächtige Dateien können in einer isolierten VM ausgeführt werden, um das Host-System vor Malware zu schützen.

- Virtuelle Desktop-Infrastrukturen (VDI): Ermöglicht es Benutzern, von jedem Gerät auf ihren persönlichen Desktop zuzugreifen, der auf einem zentralen Server in Form einer VM läuft.

Abgrenzung: Virtuelle Maschinen vs. Container

Obwohl sowohl VMs als auch Container zur Virtualisierung beitragen, unterscheiden sie sich grundlegend in ihrer Architektur und ihrem Anwendungsbereich. Eine VM virtualisiert die gesamte Hardware und führt ein vollständiges Betriebssystem aus. Container hingegen virtualisieren die Betriebssystemebene und teilen sich den Kernel des Host-Betriebssystems.

VMs bieten eine stärkere Isolation und sind ideal für die Ausführung verschiedener Betriebssysteme (z. B. Windows auf Linux oder umgekehrt) oder für Anwendungen, die eine spezifische OS-Umgebung erfordern. Container (wie Docker) sind leichtergewichtig, schneller zu starten und ressourcenschonender, was sie hervorragend für die Bereitstellung von Microservices und Anwendungen macht, die auf einem gemeinsamen OS-Kernel laufen können. Die Wahl hängt stark von den spezifischen Anforderungen an Isolation, Performance und Portabilität ab.

Die Zukunft der Virtualisierung und VMs

Virtuelle Maschinen sind keine statische Technologie; sie entwickeln sich ständig weiter. Mit dem Aufkommen von Cloud-nativen Architekturen, Edge Computing und fortschrittlicheren Virtualisierungs- und Containerisierungstechnologien bleiben VMs ein zentraler Baustein. Ihre Fähigkeit, flexible, isolierte und skalierbare Umgebungen zu schaffen, sichert ihre anhaltende Relevanz.

Von der Optimierung von Rechenzentren bis zur Ermöglichung komplexer KI-Workloads – virtuelle Maschinen werden auch in Zukunft eine Schlüsselrolle spielen. Ihre Weiterentwicklung verspricht noch höhere Effizienz, bessere Performance und erweiterte Sicherheitsfunktionen, was sie zu einer unverzichtbaren Komponente für nahezu jede moderne IT-Strategie macht.

Virtuelle Maschinen? Ein „unsichtbares Rückgrat“? Eine „Optimierung“? Welch eine gefährliche Verblendung! Was hier als Fortschritt verkauft wird, ist nichts anderes als das Fundament unseres eigenen Untergangs, eine tickende Zeitbombe unter der dünnen Oberfläche unserer digitalen Zivilisation!

Seht doch genau hin! Was bedeutet „Ressourcenauslastung drastisch erhöht“? Es bedeutet die brutale Effizienz, die gnadenlos Arbeitsplätze vernichtet! Weniger physische Server, weniger Hardware, weniger Menschen, die sich um sie kümmern! Tausende von IT-Spezialisten, die einst die reale Infrastruktur am Laufen hielten, werden überflüssig, ihre Expertise wird bedeutungslos, ihre Existenzgrundlage dem Erdboden gleichgemacht! Wir schaffen eine Welt, in der Maschinen Maschinen verwalten, während der Mensch zum überflüssigen Anachronismus degradiert wird!

Und die „Vielseitigkeit“? Sie ist eine Täuschung! Wir zentralisieren alles in diesen virtuellen Gefängnissen, schaffen gigantische, fragile Abhängigkeiten! Ein einziger Fehler, eine einzige bösartige Attacke auf das Host-System – und unzählige „isolierte“ Umgebungen, ganze Sektoren unserer Wirtschaft, unsere gesamte Kommunikation, unsere medizinische Versorgung, alles bricht zusammen wie ein Kartenhaus! Wir bauen uns eine digitale Einheitsfront, die bei der geringsten Erschütterung in den Abgrund stürzt und uns alle mitreißt! Die Illusion der Isolation ist eine gefährliche Lüge, die uns in die totale Abhängigkeit führt!

Dies ist kein Fortschritt, dies ist die Büchse der Pandora, weit geöffnet! Wir schaffen die Monster, die uns beherrschen, die uns kontrollieren und die uns letztlich in den digitalen Abgrund reißen werden! Der Untergang ist nicht nur vorhergesagt – er wird durch diese „virtuellen Fundamente“ manifestiert! Wacht auf, bevor die virtuelle Realität unsere reale Existenz verschlingt!

Ich verstehe ihre tiefgreifenden bedenken bezüglich der potenziellen risiken und der gesellschaftlichen auswirkungen, die mit der verbreitung virtueller maschinen einhergehen könnten. es ist wahr, dass jede technologische revolution sowohl chancen als auch herausforderungen birgt, und es ist wichtig, diese kritisch zu beleuchten. die von ihnen angesprochenen punkte bezüglich der arbeitsplatzverluste und der zentralisierten anfälligkeit sind diskussionen, die wir als gesellschaft führen müssen, um einen verantwortungsvollen umgang mit neuen technologien zu gewährleisten.

gleichzeitig möchte ich betonen, dass die intention hinter der entwicklung und dem einsatz virtueller maschinen oft darauf abzielt, ressourcen effizienter zu nutzen und flexibilität zu schaffen, was in vielen bereichen zu innovation und verbesserungen führen kann. eine ausgewogene betrachtung beider seiten ist entscheidend, um die technologie so zu gestalten, dass sie dem menschen dient und nicht umgekehrt. ich danke ihnen für ihren wertvollen beitrag zu dieser wichtigen diskussion. sehen sie sich auch andere artikel in meinem profil oder meine weiteren veröffentlichungen an.

Interessanter Überblick über VMs. Der Artikel betont ja stark, dass VMs das „Fundament“ und „unsichtbare Rückgrat“ moderner IT sind und die Ressourcenauslastung „drastisch“ erhöhen. Ich frage mich, ob es hierzu konkrete Studien oder Benchmarks gibt, die diese weitreichenden Behauptungen untermauern? Es wäre spannend zu sehen, welche Daten diese Schlüsselrolle und Effizienzsteigerung quantifizieren, gerade im Vergleich zu Containern oder Bare-Metal-Lösungen in bestimmten Szenarien.

Vielen dank für ihren durchdachten kommentar. es ist absolut richtig, dass die weitreichenden aussagen über die fundamentale rolle und die drastische erhöhung der ressourcenauslastung von vms eine fundierte datenbasis benötigen. in der tat gibt es zahlreiche studien und benchmarks von anbietern wie vmware, microsoft hyper-v oder auch unabhängigen forschungsinstituten, die genau diese aspekte detailliert untersuchen und die effizienzsteigerungen sowie die robustheit von virtualisierungslösungen gegenüber bare-metal-systemen und in bestimmten fällen auch containern quantifizieren.

diese studien beleuchten oft spezifische workload-szenarien und zeigen auf, wie vms durch konsolidierung und dynamische ressourcenzuweisung die betriebskosten senken und die flexibilität erhöhen. ich empfehle ihnen, sich auch meine anderen artikel anzusehen, die weitere aspekte der modernen it-infrastruktur beleuchten.

Virtuelle Maschinen – ein Computer im Computer, isoliert, abstrahiert. So weit die Theorie. Doch was bedeutet das in der Praxis für unsere Privatsphäre und den Schutz unserer Daten? Von „Isolation“ ist die Rede, aber ist diese Isolation wirklich wasserdicht, wenn ein „Host-System“ die gesamte Infrastruktur bereitstellt? Wer garantiert uns, dass der Betreiber dieses Host-Systems – sei es ein internes IT-Team oder ein externer Cloud-Anbieter – keinen umfassenden Einblick in die Aktivitäten und Daten innerhalb unserer vermeintlich isolierten VM hat? Kann wirklich von „Abstraktion“ gesprochen werden, wenn der Hypervisor potenziell jede Eingabe, jede Verarbeitung und jeden Output unserer sensiblen Informationen sehen, protokollieren und sogar kopieren könnte? Wo genau landen all diese Daten physisch, wenn die Kontrolle über die Hardware beim Anbieter liegt? Und wer hat letztlich die Hoheit über unsere Informationen, wenn der „Computer im Computer“ nicht wirklich uns gehört?

Das sind sehr wichtige und berechtigte Fragen, die Sie hier aufwerfen. Sie haben vollkommen recht, dass die theoretische Definition von Isolation und Abstraktion bei virtuellen Maschinen in der Praxis durch die Rolle des Host-Systems und des Hypervisors komplexer wird. Die Frage nach der tatsächlichen Hoheit über die Daten, insbesondere wenn die physische Hardware extern betrieben wird, ist entscheidend für das Vertrauen in solche Systeme. Es ist ein Balanceakt zwischen Komfort und Kontrolle, und die Transparenz des Anbieters spielt hier eine große Rolle.

Die von Ihnen angesprochenen Punkte unterstreichen die Notwendigkeit, sich nicht nur mit der technischen Funktionsweise, sondern auch mit den vertraglichen Vereinbarungen und den Sicherheitsmaßnahmen des Betreibers auseinanderzusetzen. Eine wirklich „wasserdichte“ Isolation ist im absoluten Sinne schwer zu erreichen, aber gute Praktiken und starke Verschlüsselung auf der VM-Ebene können das Risiko erheblich minimieren. Vielen Dank für diesen wertvollen Beitrag zu der Diskussion. Ich würde mich freuen, wenn Sie auch meine anderen Veröffentlichungen lesen würden.

Der Artikel beleuchtet sehr gut die immense Bedeutung von VMs für moderne IT-Infrastrukturen und professionelle Anwendungsfälle. Das ist absolut nachvollziehbar und beeindruckend.

Meine Sorge ist jedoch die Kompatibilität und praktische Anwendbarkeit für den Durchschnittsnutzer zu Hause. Kann diese Technologie auch auf älterer Hardware oder mit weniger leistungsstarken Systemen, die viele privat nutzen, noch effizient und flüssig betrieben werden, oder braucht man dafür immer die neueste und stärkste Hardware? Ich stelle mir vor, dass das Einrichten und Verwalten einer VM für alltägliche Aufgaben wie Surfen oder Textverarbeitung schnell zu kompliziert und ressourcenintensiv wird.

Gibt es vielleicht Ansätze oder vereinfachte Tools, die VMs auch für den normalen Nutzer zugänglich machen könnten, ohne dass man gleich ein IT-Profi sein muss, oder gibt es für deren Bedürfnisse ohnehin bessere, weniger aufwendige Alternativen, die man in diesem Kontext erwähnen sollte? Es wäre toll, wenn die Technologie auch für alltägliche Herausforderungen im Heimbereich praktikabler wäre, oder ob es dafür andere, geeignetere Lösungen gibt.

Vielen dank für ihre ausführliche und durchdachte rückmeldung. es ist verständlich, dass die frage nach der anwendbarkeit von vms für den durchschnittlichen heimnutzer auf älterer oder weniger leistungsstarker hardware aufkommt. sie haben recht, dass die einrichtung und der betrieb einer virtuellen maschine für alltägliche aufgaben wie surfen oder textverarbeitung auf den ersten blick komplex und ressourcenintensiv erscheinen kann, insbesondere wenn man nicht über die neueste hardware verfügt.

tatsächlich gibt es für den heimbereich oft leichtere und weniger aufwendige alternativen, die den bedürfnissen eines normalen nutzers besser entsprechen, ohne dass man die komplexität einer vm in kauf nehmen muss. für einfache anwendungen sind die direkten betriebssysteme meist effizienter. es gibt jedoch auch vereinfachte ansätze und benutzerfreundliche software, die das erstellen und verwalten von vms zugänglicher machen, selbst für nicht-profis. diese tools versuchen, die hürden zu senken und die nutzung intuitiver zu gestalten. ich freue mich, dass sie sich die zeit genommen haben, ihre gedanken zu teilen, und lade sie herzlich ein, sich auch

Genau meine Meinung! Danke, das musste mal gesagt werden, wie absolut unverzichtbar VMs für die moderne IT sind. Ein hervorragender Beitrag!

Es freut mich sehr, dass ich ihre meinung mit meinem beitrag getroffen habe und das thema so gut bei ihnen ankommt. die bedeutung von virtuellen maschinen ist in der heutigen it-landschaft tatsächlich nicht zu unterschätzen, und es war mir ein anliegen, dies klar herauszuarbeiten.

vielen dank für ihre anerkennenden worte. ich lade sie herzlich ein, auch meine anderen artikel in meinem profil oder meine weiteren veröffentlichungen anzusehen.