Die Fähigkeit, menschliche Sprache zu verstehen und zu verarbeiten, ist ein zentrales Ziel in der Künstlichen Intelligenz und insbesondere im Bereich des Natural Language Processing (NLP). Ein fundamentaler Schritt auf diesem Weg ist die Transformation von Wörtern in eine numerische Form, die Maschinen interpretieren können. Hier setzt das Konzept des Word Embedding an, eine der revolutionärsten `NLP-Methoden` der letzten Jahre. Es ermöglicht, die Komplexität und Nuancen der Sprache in dichte Vektordarstellungen zu überführen, die nicht nur eine Unterscheidung zwischen Wörtern erlauben, sondern auch ihre semantischen und syntaktischen Beziehungen abbilden. Für `Entwickler`, `Studenten` und `Technologiebegeisterte`, die sich mit der `Vektorielle Darstellung von Wörtern` und `fortgeschrittene NLP-Methoden` befassen, ist ein tiefes Verständnis dieser Technik unerlässlich.

In diesem umfassenden Artikel werden wir die Evolution der Wortrepräsentation beleuchten, angefangen bei einfachen, aber limitierten Ansätzen bis hin zu den mächtigen `Worteinbettungstechniken`. Wir werden drei Hauptmethoden zur Darstellung eines Wortes als Vektor untersuchen: das klassische One-Hot-Encoding, das Image Embedding als intuitive Analogie zur Merkmalsextraktion, und schließlich das detaillierte `Word Embedding` selbst. Besonderes Augenmerk legen wir auf das Training von Embedding-Matrizen und demonstrieren dies an einem praktischen Beispiel der `Sentimentanalyse mit Word Embedding` unter Verwendung der Keras-Bibliothek. Sie erhalten Einblicke in `Keras Embedding Layer`, `GlobalAveragePooling1D Funktion` und lernen, wie Sie ein robustes Modell für die `IMBD Rezensionen Klassifikation` aufbauen können.

Grundlagen der Worteinbettung und ihre Entwicklung

Um maschinelles Lernen auf Textdaten anzuwenden, müssen Wörter und Sätze in ein numerisches Format umgewandelt werden, das von Algorithmen verstanden und verarbeitet werden kann. Die Herausforderung dabei ist, nicht nur die Existenz von Wörtern zu kodieren, sondern auch deren Bedeutungen, Kontexte und Beziehungen zueinander abzubilden. Frühe Ansätze zur `Vektorielle Darstellung von Wörtern` litten oft unter der sogenannten „Curse of Dimensionality“ und konnten semantische Ähnlichkeiten nicht erfassen. Sie behandelten jedes Wort als eine isolierte Einheit, was zu einer Verlust der relationalen Informationen führte.

Das Konzept der Worteinbettung überwindet diese Limitierungen, indem es Wörter in einen kontinuierlichen Vektorraum projiziert. In diesem Raum sind Wörter, die eine ähnliche Bedeutung oder einen ähnlichen Kontext aufweisen, auch geografisch – also vektoriell – nah beieinander. Dies ist entscheidend für Anwendungen wie maschinelle Übersetzung, Textzusammenfassung oder Chatbots, da es Modellen ermöglicht, über bloße Wortübereinstimmungen hinaus eine tiefere sprachliche `semantische Ähnlichkeit` zu verstehen. Die Entwicklung von `Word Embedding` markiert einen Wendepunkt in der Art und Weise, wie Computer Sprache „lernen“ und „verstehen“.

One-Hot-Encoding: Die simple Vektordarstellung

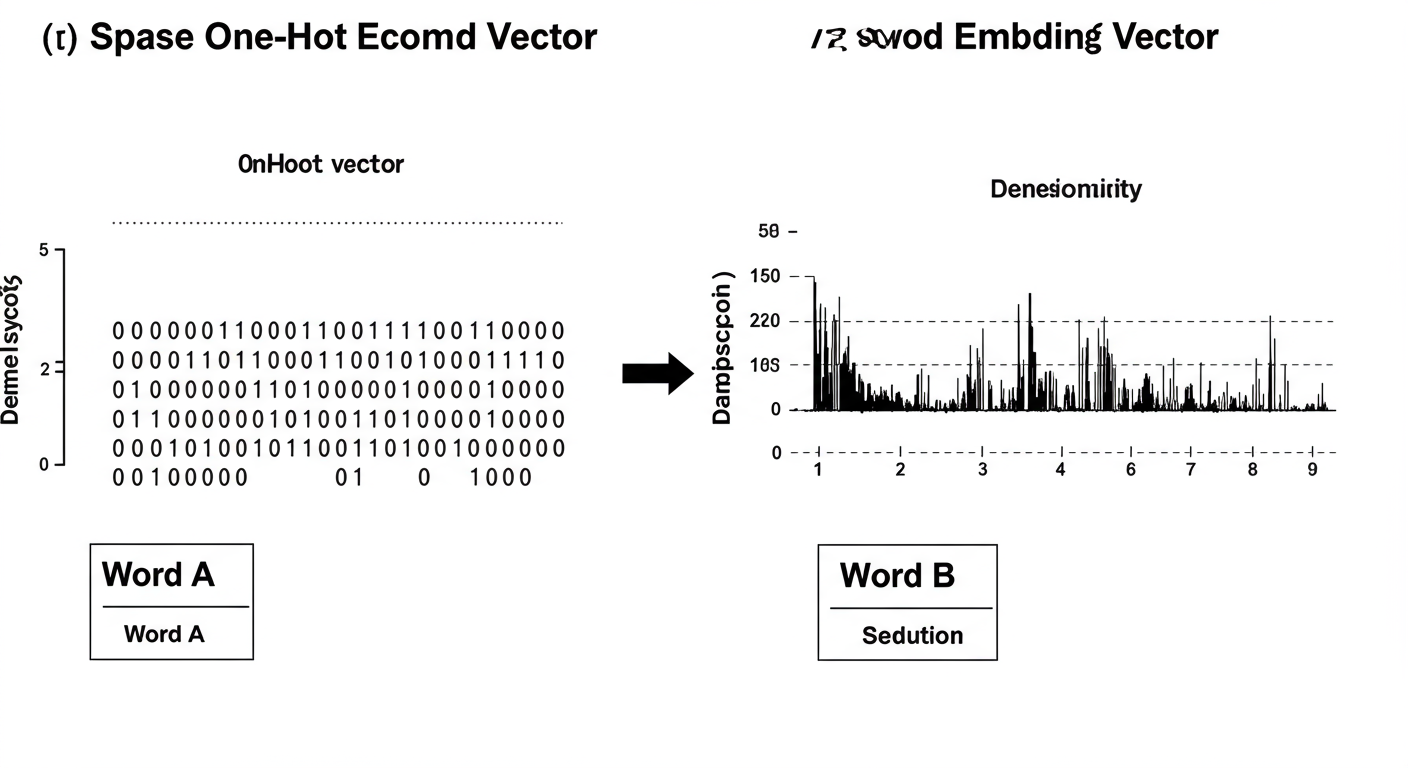

Die klassischste Methode der `vektoriellen Darstellung von Wörtern` ist das One-Hot-Encoding. Bei diesem Verfahren wird jedes einzigartige Wort im gesamten Korpus als eine separate Dimension in einem hochdimensionalen Vektorraum betrachtet. Für jedes Wort wird ein binärer Vektor erstellt, dessen Länge der Gesamtanzahl der einzigartigen Wörter (dem Wortschatz) entspricht. Alle Werte in diesem Vektor sind Null, mit Ausnahme des Indexes, der dem betreffenden Wort zugewiesen ist; dieser Wert ist Eins.

Ein Beispiel zur Veranschaulichung: Nehmen wir den Satz „Der Hund bellt, die Katze miaut“. Zuerst erstellen wir den Wortschatz (einzigartige Wörter): {‚Der‘: 0, ‚Hund‘: 1, ‚bellt‘: 2, ‚die‘: 3, ‚Katze‘: 4, ‚miaut‘: 5}. Der Wortschatz hat eine Größe von 6. Jedes Wort wird nun als ein Vektor der Dimension 6 dargestellt.

One-Hot-Encoding bietet eine klare, aber grundlegende `Wortrepräsentation`, die jedoch die feinen Nuancen sprachlicher Bedeutungen vollständig ignoriert.

Die Repräsentation für „Hund“ wäre dann `[0, 1, 0, 0, 0, 0]`. Für „Katze“ wäre es `[0, 0, 0, 0, 1, 0]`. Der Hauptnachteil dieser Methode ist, dass sie keine `semantische Ähnlichkeit` zwischen Wörtern erfasst. Der euklidische Abstand zwischen „Hund“ und „Katze“ ist hier genauso groß wie zwischen „Hund“ und „bellt“, obwohl „Hund“ und „Katze“ Tiere sind und daher eine engere Beziehung haben. Außerdem führt dies bei großen Vokabularien zu extrem spärlichen und hochdimensionalen Vektoren, was die Berechnung ineffizient macht und das `Lernproblem` erschwert.

import numpy as np

def one_hot_encode(text):

# Text in Kleinbuchstaben umwandeln und Satzzeichen entfernen

words = text.lower().replace(',', '').replace('.', '').split()

# Wortschatz erstellen und jedem Wort einen Index zuweisen

vocab = sorted(list(set(words)))

word_to_idx = {word: i for i, word in enumerate(vocab)}

idx_to_word = {i: word for i, word in enumerate(vocab)}

vocab_size = len(vocab)

# One-Hot-Vektoren für jedes Wort erstellen

encoded_vectors = {}

for word in words:

one_hot_vector = np.zeros(vocab_size)

one_hot_vector[word_to_idx[word]] = 1

encoded_vectors[word] = one_hot_vector

return word_to_idx, encoded_vectors, vocab_size

# Beispielanwendung für One-Hot-Encoding

sentence = "Der Hund bellt, die Katze miaut"

word_to_idx, encoded_vectors, vocab_size = one_hot_encode(sentence)

print("Wortschatz und Indizes:", word_to_idx)

print("Größe des Wortschatzes:", vocab_size)

print("nOne-Hot-Vektoren:")

for word, vector in encoded_vectors.items():

print(f"'{word}': {vector}")

# Ausgabe für 'hund' und 'katze' zur Demonstration

print(f"nOne-Hot-Vektor für 'hund': {encoded_vectors['hund']}")

print(f"One-Hot-Vektor für 'katze': {encoded_vectors['katze']}")

Wie das Codebeispiel zeigt, sind die Vektoren für ‚hund‘ und ‚katze‘ orthogonal zueinander, d.h. ihr Skalarprodukt ist Null, was bedeutet, dass sie keinerlei `semantische Beziehung` zueinander aufweisen, obwohl sie beide Tiere sind. Dies ist die Kernschwäche des One-Hot-Encoding für anspruchsvolle NLP-Aufgaben.

Analogie: Image Embedding zur Merkmalsextraktion

Bevor wir tiefer in das `Word Embedding` eintauchen, ist es hilfreich, eine Analogie aus der Bildverarbeitung zu betrachten: das Image Embedding. Ein Bild wird digital als ein Raster von Pixeln dargestellt, wobei jeder Pixel einen Farbwert besitzt. Diese rohen Pixelwerte sind für einen Computer schwer direkt zu interpretieren, wenn es darum geht, komplexe Objekte oder Muster zu erkennen. Beispielsweise ist ein roter Pixel in einem Bild nicht aussagekräftig genug, um zu wissen, ob es sich um ein Auto, einen Apfel oder ein Haus handelt.

Hier kommen `Konvolutionale Neuronale Netze (CNNs)` ins Spiel. Sie verwenden `Konvolutionen und Pooling-Schichten`, um `Merkmale aus Bildern zu extrahieren`. Anstatt direkt mit den rohen Pixelwerten zu arbeiten, „lernt“ ein CNN hierarchisch relevantere und abstraktere Merkmale. Ein Kernel (oder Filter) kann beispielsweise Kanten, Texturen oder spezifische Formen erkennen. Diese extrahierten Merkmale sind viel aussagekräftiger als die ursprünglichen Pixelwerte, um Objekte zu klassifizieren. Das Ergebnis dieser Merkmalsextraktion ist ein „Embedding“ des Bildes – eine dichtere, niedrigdimensionale Repräsentation, die die wichtigsten visuellen Eigenschaften zusammenfasst.

| Schritt | Beschreibung |

|---|---|

| Eingabebild | Raw-Pixeldaten eines Bildes (z.B. 28x28x3 für RGB) |

| Konvolutionsschicht | Anwenden von Filtern (Kernen) zur Erkennung von Merkmalen wie Kanten, Ecken, Texturen |

| Pooling-Schicht | Reduktion der Dimensionalität und Erfassung der wichtigsten Informationen (z.B. Max Pooling) |

| Ausgabe (Embedding) | Ein dichter Vektor, der die `relevantesten Merkmale` des Bildes repräsentiert |

Diese Umwandlung von hochdimensionalen, rohen Daten (Pixeln) in eine niedrigdimensionale, merkmalsreiche Darstellung ist genau das, was `Embedding` bedeutet. Wir komprimieren die Informationen und konzentrieren uns auf das Wesentliche, um `Linearitätsbeziehungen zwischen Eigenschaften` wie Kunststil, spezifische Formen oder Objekttypen zu extrahieren. Diese Analogie hilft zu verstehen, warum wir auch bei Wörtern versuchen, über die einfache Identität hinauszugehen und ihren „Kern“ an Bedeutung und Kontext zu extrahieren.

Word Embedding: Semantik im Vektorraum

Im `Natural Language Processing` ist das Ziel von `Word Embedding`, genau wie beim Image Embedding, eine reduzierte und aussagekräftigere Darstellung zu finden. Hier geht es darum, den `Kontext`, die `semantische und syntaktische Ähnlichkeit` eines Wortes zu erfassen. Stell dir vor, du hast die Wörter „Hund“ und „Katze“. Intuitiv wissen wir, dass beide Tiere sind und sich in vielen Aspekten ähneln. Ein gutes `Worteinbettungsverfahren` würde diese Wörter in einem `Vektorraum` so platzieren, dass ihre Vektoren relativ nah beieinander liegen.

Im Gegensatz dazu würden Wörter wie „Computer“ oder „Wolke“ in einem völlig anderen Bereich des Vektorraums angesiedelt sein. Die Nähe im Vektorraum spiegelt also die konzeptuelle Nähe in der realen Welt wider. Diese dichten Vektoren sind nicht nur effizienter in der Speicherung und Verarbeitung als One-Hot-Vektoren, sondern ermöglichen es Modellen auch, Generalisierungen über ähnliche Wörter zu treffen. Ein Modell, das gelernt hat, etwas über „Hund“ zu wissen, kann dieses Wissen besser auf „Katze“ anwenden, wenn ihre Embeddings ähnlich sind. Dies ist ein entscheidender Fortschritt für `verbesserte NLP-Anwendungen`.

Word Embeddings können verschiedene Arten von Beziehungen erfassen:

- Semantische Ähnlichkeit: „König“ und „Monarch“ liegen nahe beieinander.

- Syntaktische Ähnlichkeit: „läuft“, „gehen“ und „schwimmt“ können Muster in Bezug auf Verben aufweisen.

- Kontextuelle Beziehungen: Das Embedding von „Bank“ könnte je nach Kontext (Flussbank vs. Finanzinstitut) variieren, obwohl klassische Embeddings (wie Word2Vec) dies nur begrenzt leisten.

Die Embedding-Matrix: Das Herzstück der Worteinbettung

Die `Embedding-Matrix` ist das zentrale Element, das die Transformation von einem One-Hot-Vektor in einen dichten Word Embedding-Vektor ermöglicht. Man kann sie sich als eine große Tabelle oder einen Lookup-Mechanismus vorstellen, der jedem Wort in unserem Wortschatz einen einzigartigen, niedrigdimensionalen Vektor zuordnet. Wenn wir ein Wort in unserem Modell verwenden möchten, schlagen wir einfach seinen entsprechenden Vektor in dieser Matrix nach. Die Multiplikation eines One-Hot-Vektors mit der Embedding-Matrix ist mathematisch gesehen äquivalent zu einem Index-Lookup.

Angenommen, unsere Embedding-Matrix W hat die Dimension (Wortschatzgröße × Embedding-Dimension). Wenn wir einen One-Hot-Vektor x (der Dimension Wortschatzgröße) für ein bestimmtes Wort haben, dann ist der Word Embedding-Vektor e dieses Wortes das Produkt e = x ⋅ W. Da der One-Hot-Vektor x nur eine ‚1‘ an der Stelle des Wortindexes hat und ansonsten Nullen, wählt diese Multiplikation effektiv die entsprechende Zeile aus der Matrix W aus, die den Embedding-Vektor für dieses Wort darstellt.

Die Embedding-Matrix ist somit nicht nur ein statisches Nachschlagewerk, sondern ein lernbares Element. Ihre Werte werden während des Trainings eines neuronalen Netzes optimiert, sodass die resultierenden Embeddings die gewünschten `semantischen und syntaktischen Beziehungen` im Vektorraum widerspiegeln. Die `Dimensionsreduktion durch Embedding` ermöglicht es uns, von Tausenden (oder Zehntausenden) Dimensionen eines One-Hot-Vektors auf einige Hundert (z.B. 100-300) Dimensionen zu reduzieren, ohne dabei an wesentlicher Information zu verlieren, sondern im Gegenteil, an `semantischer Dichte` zu gewinnen.

Training von Word Embeddings: Überwachtes Lernen am Beispiel der Sentimentanalyse

Das `Training der Embedding-Matrix` ist ein entscheidender Schritt. Eine gängige Methode ist die Anwendung in einem überwachten Lernproblem, bei dem die Embeddings als Teil eines größeren neuronalen Netzes gelernt werden. Ein hervorragendes Anwendungsbeispiel hierfür ist die `Sentimentanalyse`, auch bekannt als Stimmungsanalyse oder Sentiment Detection. Dabei geht es darum, die emotionale Tonalität eines Textes (positiv, negativ, neutral) zu erkennen.

Wir werden dieses Konzept anhand der `IMBD Rezensionen Klassifikation` demonstrieren. Der IMDB-Datensatz besteht aus 25.000 Filmkritiken, die jeweils als positiv oder negativ klassifiziert sind. Ziel ist es, ein Modell zu trainieren, das neue Filmkritiken korrekt kategorisiert.

Datenaufbereitung für NLP-Modelle: Bevor das Training beginnen kann, müssen die Textdaten in ein Format umgewandelt werden, das das neuronale Netz verarbeiten kann. Dies umfasst mehrere Schritte:

- Tokenisierung: Der Text wird in einzelne Wörter (Tokens) zerlegt.

- Indexierung: Jedem einzigartigen Wort im Wortschatz wird eine eindeutige Ganzzahl zugewiesen. Dies erstellt eine Abbildung von Wörtern zu Indizes.

- Sequenzierung: Jede Rezension wird in eine Sequenz von Ganzzahlen umgewandelt, wobei jede Ganzzahl den Index eines Wortes repräsentiert.

- Padding: Da Filmkritiken unterschiedliche Längen haben, müssen die Sequenzen auf eine einheitliche Länge gebracht werden. Kürzere Sequenzen werden mit Nullen „aufgefüllt“ (gepadded), längere Sequenzen werden entsprechend gekürzt. Dies ist entscheidend, da neuronale Netze feste Eingabedimensionen erwarten.

Ein Keras-Tokenizer wandelt beispielsweise den Satz `[‚hello my dear readers‘]` in eine Sequenz von Zahlen um, wie `[[4422, 10, 2974, 6117]]`, wobei jede Zahl den Index des entsprechenden Wortes im erstellten Wortschatz darstellt.

Modellarchitektur für Sentimentanalyse: Unser Modell wird eine einfache `Bag-of-Words`-Architektur mit einer Embedding-Methode sein. Es besteht typischerweise aus folgenden Schichten:

- Embedding Layer: Dies ist die erste Schicht des Modells. Sie nimmt die Integer-Indizes der Wörter als Eingabe und wandelt jeden Wortindex in einen dichten Embedding-Vektor um. Die `W-Matrix des Embeddings` wird hier als Schichtgewicht realisiert und während des Modelltrainings gelernt. Die resultierenden Dimensionen sind typischerweise `(Batch-Größe, Sequenzlänge, Embedding-Dimension)`.

- GlobalAveragePooling1D Layer: Diese Schicht ist eine Art `Dimensionsreduktion` auf der Sequenzebene. Sie berechnet den Durchschnitt über die Sequenzdimension für jeden Embedding-Vektor. Das Ergebnis ist ein Ausgabevektor fester Länge für jedes Beispiel, unabhängig von der ursprünglichen Sequenzlänge. Diese Transformation ähnelt einer `Bag of Words`-Darstellung, ermöglicht es dem Modell jedoch, mit Eingaben variabler Länge umzugehen und die kontextuellen Informationen der Embeddings zu aggregieren.

- Dense Layers (Klassifikation): Da wir ein `Klassifizierungsproblem` (positive oder negative Rezension) lösen, folgen auf die Pooling-Schicht ein oder mehrere Dense (vollständig verbundene) Schichten. Diese Schichten lernen, die aggregierten Merkmale zu interpretieren und eine endgültige Klassifikationsentscheidung zu treffen. Eine `softmax`-Aktivierungsfunktion in der letzten Schicht gibt Wahrscheinlichkeiten für jede Klasse aus (z.B. 0 für negativ, 1 für positiv).

Das gleichzeitige Training der `Embedding-Matrix` mit dem Klassifikationsproblem ermöglicht es dem Modell, Embeddings zu lernen, die speziell auf die Erfassung des Sentiments ausgerichtet sind.

Codebeispiel: Sentimentanalyse mit Keras

Im Folgenden sehen Sie ein detailliertes `Keras Modell für Sentimentanalyse`, das die beschriebenen Konzepte in die Praxis umsetzt. Beachten Sie die Verwendung der `Embedding Layer` und `GlobalAveragePooling1D`, die für die Verarbeitung der sequenziellen Wortdaten unerlässlich sind.

import tensorflow as tf

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Embedding, GlobalAveragePooling1D, Dense, Dropout

from tensorflow.keras.preprocessing.text import Tokenizer

from tensorflow.keras.preprocessing.sequence import pad_sequences

import numpy as np

# Beispiel-Daten (in einer realen Anwendung würden Sie einen Datensatz wie IMDB laden)

# Für diesen Demonstrationszweck simulieren wir X_train, y_train, X_test, y_test

# Normalerweise würden Sie tf.keras.datasets.imdb.load_data() verwenden

# Annahme: Maximum an Wörtern im Wortschatz

vocab_size = 10000

# Annahme: Maximale Länge einer Rezensionssequenz

max_sequence_length = 256

# Annahme: Dimension für die Word Embeddings

embedding_dim = 300

# Simulierte Daten (ersetzen Sie dies durch tatsächliche IMDB-Datenladevorgänge)

# Erstellen eines Dummy-Wortschatzes und Sequenzen

sample_texts_train = [

"this movie was absolutely fantastic and I loved every minute of it",

"the plot was weak and the acting was terrible I hated it",

"a surprisingly good film with great performances",

"i would not recommend this movie to anyone it was boring",

"excellent cinematography and a gripping storyline a must see"

]

sample_labels_train = np.array([1, 0, 1, 0, 1]) # 1 for positive, 0 for negative

sample_texts_test = [

"this film is a masterpiece truly amazing",

"worst movie ever total waste of time",

"mediocre at best not worth watching",

"an enjoyable experience highly recommended",

"just okay nothing special"

]

sample_labels_test = np.array([1, 0, 0, 1, 0])

# Tokenizer initialisieren und an den Trainingsdaten anpassen

tokenizer = Tokenizer(num_words=vocab_size, oov_token="<unk>")

tokenizer.fit_on_texts(sample_texts_train + sample_texts_test) # Fit an both train and test for full vocabulary coverage

# Texte in Sequenzen von Integern umwandeln

X_train_sequences = tokenizer.texts_to_sequences(sample_texts_train)

X_test_sequences = tokenizer.texts_to_sequences(sample_texts_test)

# Sequenzen padden, um eine einheitliche Länge zu gewährleisten

X_train_padded = pad_sequences(X_train_sequences, maxlen=max_sequence_length, padding='post', truncating='post')

X_test_padded = pad_sequences(X_test_sequences, maxlen=max_sequence_length, padding='post', truncating='post')

# Modellaufbau

model = Sequential()

# 1. Embedding Layer: Wandelt Wortindizes in dichte Vektoren um

# input_dim: Größe des Wortschatzes + 1 (für Padding/OOV-Token)

# output_dim: Die Dimension jedes Embedding-Vektors

# input_length: Maximale Länge der Eingabesequenz

model.add(Embedding(input_dim=vocab_size, output_dim=embedding_dim, input_length=max_sequence_length))

# 2. GlobalAveragePooling1D Layer: Berechnet den Durchschnitt der Embedding-Vektoren über die Sequenzlänge

# Dies fasst die Informationen der gesamten Sequenz zu einem festen Vektor zusammen

model.add(GlobalAveragePooling1D())

# Dropout für Regularisierung, um Overfitting zu reduzieren

model.add(Dropout(0.5))

# 3. Dense Layer (Klassifikation): Vollständig verbundene Schichten für die Klassifizierung

# Erste Dense Layer mit ReLU-Aktivierung

model.add(Dense(256, activation='relu'))

# Zweite Dropout-Schicht

model.add(Dropout(0.5))

# Ausgabe-Schicht: Zwei Neuronen für binäre Klassifikation (positiv/negativ)

# Softmax-Aktivierung, um Wahrscheinlichkeiten für jede Klasse auszugeben

model.add(Dense(2, activation='softmax'))

# Modell kompilieren

# Optimizer: Adam ist eine beliebte Wahl für neuronale Netze

# Loss: sparse_categorical_crossentropy für Integer-Labels (0 oder 1)

# Metrics: Genauigkeit zur Bewertung der Modellleistung

model.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy'])

# Modellzusammenfassung anzeigen

model.summary()

# Modell trainieren

# X_train_padded: Die gepaddeten Trainingssequenzen

# y_train: Die entsprechenden Trainingslabels

# batch_size: Anzahl der Samples pro Gradientenupdate

# epochs: Anzahl der vollständigen Durchläufe durch den Trainingsdatensatz

# validation_data: Daten zur Bewertung der Modellleistung nach jeder Epoche

history = model.fit(

X_train_padded,

sample_labels_train,

batch_size=32,

epochs=5,

validation_data=(X_test_padded, sample_labels_test)

)

print("nTrainingshistorie:")

print(history.history)

# Bewertung des Modells auf den Testdaten

loss, accuracy = model.evaluate(X_test_padded, sample_labels_test, verbose=0)

print(f"nGenauigkeit auf den Testdaten: {accuracy:.4f}")

Dieses Modell erreicht in der Praxis oft eine hohe Genauigkeit (im Referenzbeispiel 0.88), was mit herkömmlichen, rein zählen-basierten Methoden wie TF-IDF (Term Frequency-Inverse Document Frequency) ohne Embeddings nur schwer zu erreichen wäre. Die `Embedding-Matrix trainieren` durch das neuronale Netz ermöglicht es, die spezifischen `Kontextbedeutungen` zu erfassen, die für die `Sentimentanalyse` relevant sind.

Unüberwachte Word Embedding Ansätze: Jenseits der Klassifikation

Während das Training von Word Embeddings in einem überwachten Kontext effektiv ist, kann es dazu führen, dass die Embeddings spezifisch auf die überwachte Aufgabe zugeschnitten sind und andere `semantische Beziehungen` weniger gut erfassen. Um diese Einschränkung zu umgehen, wurden `unüberwachte Word Embedding Training` Ansätze entwickelt. Diese Methoden lernen die Embeddings aus riesigen Textkorpora ohne die Notwendigkeit manuell gelabelter Daten.

Der bekannteste `Word2Vec Algorithmus`, eingeführt von Google, revolutionierte diesen Bereich. Word2Vec besteht aus zwei Hauptarchitekturen:

- Continuous Bag of Words (CBOW): Hier wird versucht, ein Wort basierend auf seinem umgebenden Kontext (den Wörtern vor und nach ihm) vorherzusagen.

- Skip-gram: Im Gegensatz dazu versucht Skip-gram, die umgebenden Kontextwörter eines gegebenen Zielwortes vorherzusagen.

Beide `Word2Vec Algorithmus` lernen Embeddings, indem sie die Idee nutzen, dass Wörter, die in ähnlichen Kontexten auftreten, ähnliche Bedeutungen haben. Dies ermöglicht die Erfassung komplexer linguistischer Muster wie „König – Mann + Frau = Königin“ – ein klassisches Beispiel für die Fähigkeit von Word Embeddings, analoge Beziehungen im Vektorraum abzubilden. Da dieses Training `unüberwacht erfolgt`, werden die Verzerrungen vermieden, die mit der Lösung eines spezifischen überwachten Problems verbunden sind. Dies führt zu allgemeineren und übertragbareren Embeddings, die in einer Vielzahl von `NLP-Anwendungen` eingesetzt werden können.

Integration und zukünftige Trends im Natural Language Processing

Das `Word Embedding` hat sich als unverzichtbare Technik in der Welt der `Data Science` und des `Natural Language Processing` etabliert. Es hat die Art und Weise, wie wir Textdaten für maschinelles Lernen vorbereiten und nutzen, grundlegend verändert, indem es eine effiziente `Dimensionsreduktion` ermöglicht und gleichzeitig `komplexe Sprachstrukturen` in numerischer Form abbildet. Für `Entwickler`, die an `NLP-Anwendungen` arbeiten, bedeutet dies, dass Modelle nicht mehr jedes Wort als isoliertes Element betrachten müssen, sondern von den reichen `semantischen und syntaktischen Ähnlichkeiten` profitieren können, die in den Embeddings kodiert sind.

Die Fähigkeit, `kontextuelle Wortbedeutung` zu erfassen und die `Lernaufgabe zu reduzieren`, hat zu signifikanten Verbesserungen in der Genauigkeit und Leistungsfähigkeit von Textanalysemodellen geführt. Von der `Sentimentanalyse` über maschinelle Übersetzung bis hin zu Chatbots – Word Embeddings sind die stillen Helden hinter vielen modernen `KI-Systemen`. Der Trend geht weiter zu noch leistungsfähigeren, kontextualisierten Embeddings wie BERT oder GPT, die nicht nur die Bedeutung eines Wortes, sondern auch seinen gesamten Satzkontext berücksichtigen. Die Exploration dieser `fortgeschrittenen NLP-Methoden` und das Verständnis ihrer Grundlagen sind für jeden, der in der `Technologie` und `Softwareentwicklung` tätig ist, von entscheidender Bedeutung. Bleiben Sie neugierig und experimentieren Sie weiter mit diesen mächtigen Werkzeugen!

Möchten Sie Ihr Wissen im Bereich `Data Science` und `Machine Learning` vertiefen? Dann erkunden Sie unsere vielfältigen Angebote, um Ihre Fähigkeiten zu erweitern und sich auf die Zukunft der Technologie vorzubereiten. Es gibt hier Tests, mit denen Sie Ihren Kenntnisstand messen können und sich in dem von Ihnen gewünschten Bereich testen können.

Was sind die tatsächlichen Kosten für die Implementierung und den Betrieb solcher fortschrittlichen Word Embedding-Systeme? Gibt es hier hohe Lizenzgebühren für Software, Daten oder immense Ausgaben für Rechenleistung und spezialisiertes Personal? Ich befürchte, dass diese vielversprechende Technologie aufgrund der finanziellen Hürden letztlich nur den Big Playern und wohlhabenden Unternehmen zugänglich ist und eine weitere Kluft schafft.

Vielen Dank für Ihren durchdachten Kommentar. Sie sprechen einen sehr wichtigen Punkt an, der oft übersehen wird: die realen Kosten, die mit der Implementierung und dem Betrieb von fortschrittlichen Word Embedding-Systemen verbunden sind. Es ist absolut richtig, dass Lizenzgebühren für spezialisierte Software, die Beschaffung und Vorverarbeitung großer Datenmengen sowie die immense Rechenleistung, die für das Training und den Betrieb solcher Modelle benötigt wird, erhebliche finanzielle Investitionen darstellen können.

Ihre Sorge, dass dies eine Kluft zwischen großen und kleinen Unternehmen schaffen könnte, ist berechtigt. Es gibt jedoch auch Open-Source-Lösungen und Cloud-Anbieter, die Skalierbarkeit und Kostenreduzierung ermöglichen, was die Zugänglichkeit für kleinere Akteure verbessert. Dennoch bleibt die Expertise für die Implementierung und Wartung ein Faktor. Ich danke Ihnen nochmals für Ihren wertvollen Beitrag und lade Sie ein, sich auch andere Artikel in meinem Profil oder meine weiteren Veröffentlichungen anzusehen.

Entschuldigen Sie bitte die vielleicht „dumme“ Frage, aber ich bin noch ganz neu in diesem Thema und traue mich kaum zu fragen: Wenn hier steht, dass Wörter in eine „numerische Form“ oder „dichte Vektordarstellungen“ überführt werden, bedeutet das dann ganz einfach, dass jedes Wort eine Art eigene Zahlenreihe bekommt, damit der Computer es überhaupt „lesen“ kann? Oder ist das viel komplexer gemeint?

Das ist überhaupt keine dumme frage, sondern eine sehr gute und wichtige, besonders wenn man neu in diesem bereich ist. sie haben das prinzip im kern genau richtig verstanden. ja, es bedeutet im wesentlichen, dass wörter in eine form von zahlen umgewandelt werden, damit der computer sie verarbeiten kann. das konzept der „dichten vektordarstellungen“ geht allerdings noch einen schritt weiter, indem es nicht nur eine eindeutige zahl für jedes wort vergibt, sondern die beziehung und bedeutung der wörter zueinander in diesen zahlen widerspiegelt. so sind wörter mit ähnlicher bedeutung im zahlenraum näher beieinander.

ich hoffe, das macht es etwas verständlicher. vielen dank für ihr interesse und ihre frage. es freut mich, dass mein artikel sie zum nachdenken angeregt hat. ich lade sie herzlich ein, auch meine anderen artikel in meinem profil oder meine weiteren veröffentlichungen anzusehen, vielleicht finden sie dort noch weitere spannende themen.