Die Objekterkennung in der Computer Vision ist eine zentrale Säule moderner KI-Anwendungen, die von autonomen Fahrzeugen bis hin zu intelligenten Überwachungssystemen reicht. Lange Zeit prägten mehrstufige, rechenintensive Ansätze dieses Feld. Doch mit der Einführung des You Only Look Once (YOLO) Algorithmus im Jahr 2016 durch Joseph Redmon und sein Team änderte sich alles. YOLO stellte einen Wendepunkt dar, indem es die Erkennung und Klassifizierung von Objekten in einem einzigen Durchgang eines neuronalen Netzes ermöglichte, was eine beispiellose Geschwindigkeit und Effizienz mit sich brachte.

Dieser ausführliche Blogbeitrag taucht tief in die Welt von YOLO ein. Wir werden die historischen Grundlagen der Objekterkennung beleuchten, die Architektur und die fundamentalen Konzepte des YOLO-Algorithmus detailliert erläutern und dabei auch fortgeschrittene Themen wie Anchor Boxes und Non-Maximum Suppression (NMS) behandeln. Für Entwickler, Studenten und Technologiebegeisterte, die ein tiefes Verständnis für die Echtzeit-Objekterkennung suchen, bietet dieser Artikel nicht nur theoretisches Wissen, sondern auch praktische Codebeispiele, um die Funktionsweise greifbar zu machen. Entdecken Sie, wie YOLO die Landschaft der künstlichen Intelligenz nachhaltig verändert hat und weiterhin prägt.

Die Entwicklung der Objekterkennung: Vor-YOLO-Ära

Die Objekterkennung ist eine fundamentale Herausforderung im Bereich der Computer Vision und bildet die Basis für zahlreiche Innovationen, von der automatischen Gesichtserkennung bis zum autonomen Fahren. Bevor YOLO die Bühne betrat, waren die gängigen Ansätze in der Regel mehrstufig und seriell aufgebaut. Diese Techniken, obwohl funktional, litten unter erheblichen Geschwindigkeitsdefiziten, die ihren Einsatz in Echtzeitanwendungen stark einschränkten.

Ein prominentes Beispiel für diese älteren Methoden sind die Region-Based Convolutional Neural Networks (R-CNN). Diese Algorithmen funktionierten in mehreren, voneinander abhängigen Schritten. Zunächst wurden Tausende von potenziellen Regionen von Interesse (RoIs) aus einem Bild vorgeschlagen, oft mithilfe von Segmentierungsalgorithmen wie Selective Search. Jede dieser vorgeschlagenen Regionen wurde dann separat in der Größe angepasst und an ein Convolutional Neural Network (CNN) zur Merkmalsextraktion übergeben. Die extrahierten Merkmale wurden anschließend von einem Support Vector Machine (SVM)-Klassifikator analysiert, um das Vorhandensein und die Klasse eines Objekts zu bestimmen, und von einem Regressor, um die Bounding Boxen zu verfeinern. Dieser Ansatz war ein großer Fortschritt, jedoch extrem langsam, da jede RoI einzeln verarbeitet werden musste.

Evolution der Region-basierten Ansätze

Um die Geschwindigkeitsbeschränkungen von R-CNN zu adressieren, wurden Weiterentwicklungen wie Fast R-CNN und Faster R-CNN entwickelt. Fast R-CNN verbesserte die Effizienz, indem es die Merkmalsextraktion für das gesamte Bild nur einmal durchführte und dann die RoIs auf die gemeinsame Feature Map projizierte. Dies eliminierte die redundante CNN-Berechnung für jede einzelne RoI. Trotz dieses deutlichen Geschwindigkeitsgewinns blieb der Prozess der Regionen-Vorschläge (Selective Search) ein Flaschenhals, da er außerhalb des neuronalen Netzes stattfand und weiterhin langsam war.

Faster R-CNN löste dieses Problem, indem es ein Region Proposal Network (RPN) einführte, das direkt im neuronalen Netz integriert war. Das RPN lernte, Regionen von Interesse vorherzusagen, was den gesamten Prozess erheblich beschleunigte und die Notwendigkeit separater, traditioneller Regionenvorschlag-Algorithmen eliminierte. Obwohl Faster R-CNN die Geschwindigkeit im Vergleich zu seinen Vorgängern dramatisch erhöhte und als Goldstandard galt, bestand der Gesamtansatz immer noch aus mehreren sequenziellen Schritten (Regionenvorschlag, Klassifizierung, Bounding Box Regression), was für echte Echtzeit-Objekterkennung immer noch zu langsam war. Diese Modelle, obwohl leistungsfähig, hatten eine inhärente computertechnische Komplexität und Skalierungsschwierigkeiten, die ihre Anwendbarkeit in zeitkritischen Szenarien stark limitierten und den Weg für eine revolutionäre neue Technik ebneten: YOLO.

YOLO: Funktionsweise und technische Details der Echtzeit-Objekterkennung

Der You Only Look Once (YOLO)-Algorithmus revolutionierte die Echtzeit-Objekterkennung, indem er einen radikal neuen Ansatz verfolgte: Er behandelt Objekterkennung als ein einziges Regressionsproblem. Anstatt mehrere Schritte für Regionenvorschläge, Merkmalsextraktion und Klassifizierung zu durchlaufen, verarbeitet YOLO ein Bild in einem einzigen Vorwärtsdurchlauf durch ein Convolutional Neural Network (CNN). Dies ermöglicht eine signifikante Beschleunigung, ohne dabei die Genauigkeit wesentlich zu beeinträchtigen.

Architektur von YOLO: Das Herzstück der Objekterkennung

Das Kernprinzip von YOLO besteht darin, das Eingabebild in ein Gitter von S x S Zellen aufzuteilen. Jede dieser Gitterzellen ist dafür verantwortlich, Objekte zu erkennen, deren Mittelpunkt in dieser Zelle liegt. Für jede Gitterzelle sagt YOLO B (typischerweise B=2 oder B=5) Bounding Boxes voraus. Jede Bounding Box-Vorhersage besteht aus:

- Die Koordinaten der Bounding Box (x, y, Breite, Höhe). Die (x, y)-Koordinaten repräsentieren den Mittelpunkt der Box relativ zur Gitterzelle, und Breite (w) und Höhe (h) sind relativ zur Gesamtbildgröße.

- Ein Konfidenzwert (confidence score), der angibt, wie wahrscheinlich es ist, dass die Box ein Objekt enthält (Objektwahrscheinlichkeit) und wie genau die Box das Objekt umrahmt (IOU mit Ground Truth).

- Klassenwahrscheinlichkeiten für C Klassen. Dies ist die Wahrscheinlichkeit, dass das erkannte Objekt zu einer bestimmten Klasse gehört, vorausgesetzt, es gibt überhaupt ein Objekt in der Box.

Diese Vorhersagen werden direkt aus den von einem tiefen faltenden neuronalen Netz (oft ein speziell entwickelter Backbone wie Darknet) extrahierten Merkmalen abgeleitet, wodurch die Notwendigkeit von iterativen oder sequenziellen Verarbeitungsschritten entfällt.

import torch

# Beispiel für die Ausgabe eines YOLO-Modells für eine einzelne Gitterzelle

# Angenommen, das Gitter ist 7x7 und wir haben 2 Bounding Boxes pro Zelle

# und 20 Klassen.

# Die Ausgabe pro Zelle würde dann (B 5 + C) = (2 5 + 20) = 30 Werte sein.

# YOLOv1 Output Format (Simplified for explanation):

# [x, y, w, h, confidence_score, class_probabilities...]

# x, y: center of bounding box relative to grid cell (0 to 1)

# w, h: width and height relative to image size (0 to 1)

# confidence_score: P(Object) IOU(predicted, ground_truth)

# Simulation einer YOLO-Ausgabe für eine Zelle

# Eine Zelle sagt B=2 Bounding Boxes voraus

num_bounding_boxes = 2

num_classes = 20 # Beispiel: COCO-Dataset hat 80, hier vereinfacht auf 20

# Werte für die erste Bounding Box: [x, y, w, h, confidence_score]

bbox1_coords = torch.tensor([0.5, 0.5, 0.3, 0.4, 0.9])

# Werte für die zweite Bounding Box: [x, y, w, h, confidence_score]

bbox2_coords = torch.tensor([0.2, 0.8, 0.1, 0.2, 0.7])

# Klassenwahrscheinlichkeiten (für beide Bounding Boxes gleich in YOLOv1)

# P(class1), P(class2), ..., P(class20)

class_probs = torch.softmax(torch.randn(num_classes), dim=0) # Zufällige Wahrscheinlichkeiten

# Gesamtoutput für eine Zelle (vereinfacht, tatsächliche Implementierung variiert)

# In YOLOv1 sind Klassenwahrscheinlichkeiten nur einmal pro Zelle vorhergesagt, nicht pro Bounding Box

cell_output_yolov1 = torch.cat((bbox1_coords, bbox2_coords, class_probs))

print(f"YOLOv1 Output für eine Gitterzelle (vereinfacht, {len(cell_output_yolov1)} Werte):")

print(cell_output_yolov1)

# Um die tatsächliche Vorhersage zu erhalten, multipliziert man den Konfidenzwert mit den Klassenwahrscheinlichkeiten:

# conditional_class_probability = P(Class | Object)

# confidence = P(Object) IOU

# final_score = conditional_class_probability confidence = P(Class) IOU

print("nBerechnung der finalen Klassenscores für Bounding Box 1:")

final_scores_bbox1 = bbox1_coords[4] class_probs

print(final_scores_bbox1)

print(f"Erkannte Klasse für Box 1 mit höchstem Score: {torch.argmax(final_scores_bbox1).item()}")

„YOLO ist nicht nur ein Algorithmus, es ist eine Philosophie der Objekterkennung – ein einziger Blick genügt, um zu sehen, was da ist.“

Bounding Box Vorhersage und Konfidenzwerte

Die präzise Vorhersage von Bounding Boxes ist entscheidend für die Qualität der Objekterkennung. YOLO normalisiert die Box-Koordinaten (x, y, w, h) in Bezug auf die Gitterzellengröße und die Bilddimensionen, was die Netzstabilität während des Trainings verbessert. Der Konfidenzwert einer Box ist das Produkt aus der Wahrscheinlichkeit, dass die Box ein Objekt enthält (Objektness-Score), und dem Intersection Over Union (IOU) des vorhergesagten Rechtecks mit der tatsächlichen Ground Truth-Box. Ein hoher Konfidenzwert bedeutet, dass die Box mit großer Wahrscheinlichkeit ein Objekt korrekt umrahmt.

Anchor Boxes und Non-Maximum Suppression (NMS)

Ein weiteres Schlüsselmerkmal in späteren YOLO-Versionen (ab YOLOv2) sind die sogenannten Anchor Boxes (oder Prior Boxes). Diese sind vordefinierte Bounding Boxes mit bestimmten Breiten- und Höhenverhältnissen, die aus dem Trainingsdatensatz mittels K-Means-Clustering abgeleitet werden. Jede Gitterzelle sagt nun eine Abweichung von diesen Anchor Boxes voraus, anstatt die Box-Koordinaten von Grund auf neu zu lernen. Dies hilft dem Modell, Objekte unterschiedlicher Größe und Form besser zu erkennen und verbessert die Erkennungsgenauigkeit erheblich.

Nachdem das Modell zahlreiche Bounding Boxes mit ihren Konfidenzwerten und Klassenscores vorhergesagt hat, gibt es oft viele überlappende Boxen für dasselbe Objekt. Hier kommt die Non-Maximum Suppression (NMS) ins Spiel. NMS ist ein Post-Processing-Algorithmus, der redundante Boxen entfernt und nur die „beste“ Box für jedes erkannte Objekt beibehält. Der Prozess läuft wie folgt ab:

- Sortiere alle vorhergesagten Bounding Boxes nach ihrem Konfidenzwert absteigend.

- Wähle die Box mit dem höchsten Konfidenzwert aus und füge sie zur Liste der endgültigen Erkennungen hinzu.

- Entferne alle anderen Boxen, die sich signifikant mit der ausgewählten Box überlappen (d.h., deren IOU einen bestimmten Schwellenwert überschreitet).

- Wiederhole die Schritte 2 und 3, bis keine Boxen mehr übrig sind.

import torch

def iou(box1, box2):

"""

Berechnet Intersection Over Union (IOU) zwischen zwei Bounding Boxes.

Boxen im Format [x1, y1, x2, y2].

"""

# Koordinaten der Schnittmenge

x1_inter = max(box1[0], box2[0])

y1_inter = max(box1[1], box2[1])

x2_inter = min(box1[2], box2[2])

y2_inter = min(box1[3], box2[3])

# Fläche der Schnittmenge

inter_area = max(0, x2_inter - x1_inter) max(0, y2_inter - y1_inter)

# Fläche beider Boxen

box1_area = (box1[2] - box1[0]) (box1[3] - box1[1])

box2_area = (box2[2] - box2[0]) (box2[3] - box2[1])

# Fläche der Vereinigung

union_area = box1_area + box2_area - inter_area

return inter_area / union_area if union_area > 0 else 0

def non_max_suppression(boxes, scores, iou_threshold):

"""

Führt Non-Maximum Suppression durch.

boxes: Tensor von Bounding Boxes im Format [x1, y1, x2, y2]

scores: Tensor von Konfidenzwerten

iou_threshold: IOU-Schwellenwert für die Unterdrückung

"""

if len(boxes) == 0:

return []

# Sortiere Boxen nach Konfidenzwert absteigend

sorted_indices = torch.argsort(scores, descending=True)

boxes = boxes[sorted_indices]

scores = scores[sorted_indices]

keep_boxes = []

while len(boxes) > 0:

# Wähle die Box mit dem höchsten Score

best_box_idx = 0

best_box = boxes[best_box_idx]

keep_boxes.append(best_box)

# Entferne die beste Box und prüfe Überlappungen mit den restlichen Boxen

remaining_boxes = []

remaining_scores = []

for i in range(1, len(boxes)):

if iou(best_box, boxes[i]) < iou_threshold:

remaining_boxes.append(boxes[i])

remaining_scores.append(scores[i])

boxes = torch.stack(remaining_boxes) if remaining_boxes else torch.empty(0, 4)

scores = torch.tensor(remaining_scores) if remaining_scores else torch.empty(0)

return keep_boxes

# Beispielnutzung von NMS

# Annahme: 3 Bounding Boxes mit unterschiedlichen Konfidenzwerten

# Format: [x1, y1, x2, y2]

boxes_example = torch.tensor([

[50, 50, 150, 150], # Eine Box

[55, 55, 145, 145], # Überlappt stark mit der ersten

[200, 200, 250, 250] # Eine separate Box

], dtype=torch.float32)

scores_example = torch.tensor([0.9, 0.85, 0.7], dtype=torch.float32)

iou_threshold = 0.5

final_detections = non_max_suppression(boxes_example, scores_example, iou_threshold)

print("nErgebnisse nach Non-Maximum Suppression:")

for box in final_detections:

print(box)

Die Evolution von YOLO: Von v1 zu den neuesten Versionen

Seit seiner Einführung hat sich der YOLO-Algorithmus stetig weiterentwickelt. Jede neue Version hat Verbesserungen in Geschwindigkeit und Genauigkeit mit sich gebracht, um den steigenden Anforderungen der Deep Learning in Computer Vision gerecht zu werden.

- YOLOv1 (2016): Der ursprüngliche Algorithmus, bekannt für seine hohe Geschwindigkeit, aber mit einigen Einschränkungen bei der Erkennung kleiner Objekte und der Lokalisierungsgenauigkeit. Es hatte Schwierigkeiten mit dicht beieinander liegenden Objekten, da jede Gitterzelle nur ein Objekt vorhersagen konnte.

- YOLOv2 (YOLO9000, 2017): Einführung von Anchor Boxes und BatchNorm, Auflösungsanpassung während des Trainings und verbesserte Backbones (Darknet-19). Dies führte zu einer besseren Lokalisierungsgenauigkeit und einer höheren Recall-Rate.

- YOLOv3 (2018): Ein noch tieferes Backbone-Netzwerk (Darknet-53), Vorhersage von Bounding Boxes auf drei verschiedenen Skalen zur besseren Erkennung von Objekten unterschiedlicher Größe und die Verwendung von Logistik-Regressoren für Objektness-Scores. Dies verbesserte die Genauigkeit erheblich, insbesondere für kleinere Objekte, und machte YOLOv3 zu einem der beliebtesten und vielseitigsten Detektoren.

- YOLOv4 (2020): Optimierungen im Netzwerkdesign und Trainingsverfahren, einschließlich des Einsatzes von „Bag of Freebies“ (Trainingsmethoden, die die Genauigkeit verbessern, ohne die Inferenzkosten zu erhöhen, z.B. Data Augmentation) und „Bag of Specials“ (Module, die die Inferenzkosten geringfügig erhöhen, aber die Genauigkeit erheblich verbessern, z.B. PANet). Es verwendete CSPDarknet53 als Backbone.

- YOLOv5 (2020): Implementierung in PyTorch (anstatt Darknet C), was die Benutzerfreundlichkeit und Integration in andere Deep Learning-Frameworks verbesserte. Es bot verschiedene Modellgrößen (S, M, L, X) für unterschiedliche Leistungsanforderungen.

- YOLOX (2021): Fokus auf ankerfreie Objekterkennung (anchor-free), was die Komplexität des Designs reduziert und bessere Performance liefern kann. Einführung von Decoupled Head und SimOTA für bessere Trainingsergebnisse.

- YOLOv6 (2022) & YOLOv7 (2022) & YOLOv8 (2023): Diese jüngsten Versionen bringen weitere Optimierungen in der Architektur, den Loss-Funktionen und den Trainingsstrategien mit sich, um die Modelle noch schneller, genauer und robuster zu machen. Sie integrieren modernste Techniken aus der Forschung und sind oft in PyTorch implementiert, was ihre Anpassung und Bereitstellung vereinfacht.

| YOLO-Version | Schlüsselmerkmal | Impact auf Erkennung |

|---|---|---|

| YOLOv1 | Single-Shot Regression | Revolutionäre Geschwindigkeit, limitierte Genauigkeit bei kleinen/dichten Objekten |

| YOLOv2 | Anchor Boxes, Darknet-19 | Verbesserte Lokalisierung und Recall |

| YOLOv3 | Darknet-53, Multi-Scale Prediction | Deutlich höhere Genauigkeit, insbesondere für kleine Objekte |

| YOLOv4 | CSPDarknet53, Bag of Freebies/Specials | Robuste Optimierungen für hohe Leistung |

| YOLOv5 | PyTorch-Implementierung, Modell-Skalierung | Benutzerfreundlichkeit, verschiedene Größen für diverse Anforderungen |

| YOLOX | Anchor-Free, Decoupled Head | Vereinfachtes Design, verbesserte Performance, Flexibilität |

Vorteile und Herausforderungen des YOLO-Algorithmus

Der YOLO-Algorithmus bietet eine Reihe von entscheidenden Vorteilen gegenüber traditionellen Objekterkennungsmethoden, die ihn zu einem der bevorzugten Werkzeuge in der Computer Vision gemacht haben. Seine größte Stärke ist zweifellos die Geschwindigkeit. Da YOLO ein Bild in einem einzigen Durchlauf verarbeitet, erreicht es eine Echtzeit-Verarbeitungsgeschwindigkeit, was für Anwendungen wie autonome Fahrzeuge und Live-Videoanalyse unerlässlich ist. Diese Effizienz resultiert aus der Reduzierung redundanter Berechnungen und der direkten Vorhersage von Bounding Boxes und Klassenwahrscheinlichkeiten.

Darüber hinaus zeichnet sich YOLO durch seine Fähigkeit zur Generalisierung aus. Im Gegensatz zu regionenbasierten Methoden, die dazu neigen, lokale Merkmale zu optimieren, lernt YOLO globale Merkmale des gesamten Bildes. Dies reduziert Fehlalarme im Hintergrund und ermöglicht dem Modell, auch in neuen, unbekannten Umgebungen oder mit ungewöhnlichen Objektpositionen robust zu performen. Die verbesserte Ressourcennutzung und die Eignung für hochauflösende Bilder, ohne signifikante Geschwindigkeitseinbußen, sind weitere Pluspunkte, die YOLO für eine breite Palette von Anwendungen attraktiv machen.

Trotz seiner vielen Vorteile steht YOLO auch vor bestimmten Herausforderungen. Eine der häufigsten ist die Schwierigkeit, sehr kleine Objekte zu erkennen, insbesondere wenn sie in Gruppen auftreten. Da jede Gitterzelle nur eine begrenzte Anzahl von Bounding Boxes vorhersagt, kann es vorkommen, dass dicht beieinander liegende kleine Objekte von einer Zelle „übersehen“ werden. Außerdem kann die Lokalisierungsgenauigkeit bei Objekten mit ungewöhnlichen Seitenverhältnissen oder starken Überlappungen manchmal geringer sein als bei mehrstufigen Ansätzen, die feinere Regionenverfeinerungen durchführen.

Praktische Anwendungen von YOLO in der modernen Technologie

Die Flexibilität und Effizienz von You Only Look Once haben es zu einem unverzichtbaren Werkzeug in zahlreichen fortschrittlichen Technologiebereichen gemacht. Seine Fähigkeit zur Echtzeit-Objekterkennung ermöglicht Anwendungen, die zuvor undenkbar waren.

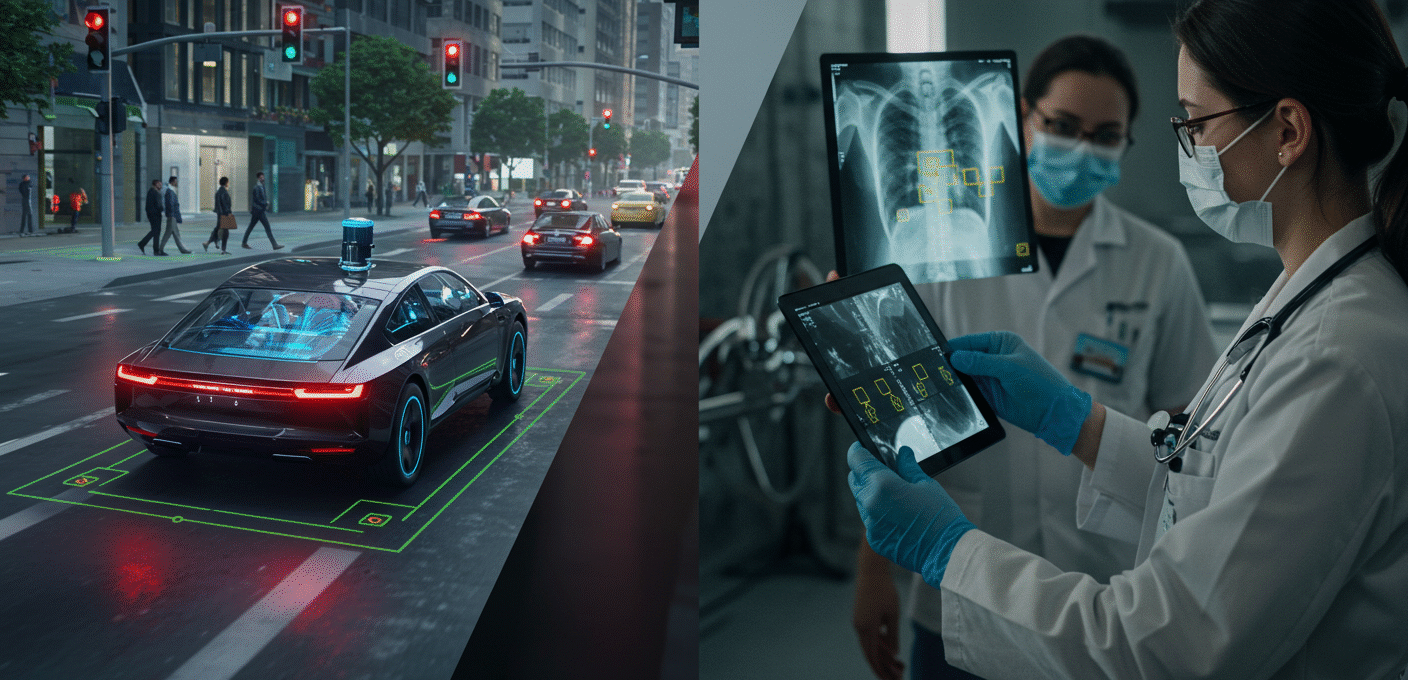

- Autonome Fahrzeuge: YOLO ist entscheidend für die Sicherheit und Funktionalität von selbstfahrenden Autos. Es identifiziert und verfolgt Fußgänger, Fahrräder, andere Fahrzeuge, Verkehrsschilder und Ampeln in Millisekunden. Diese Echtzeit-Verarbeitung ermöglicht den Steuerungssystemen, blitzschnell auf Veränderungen im Verkehr zu reagieren, Kollisionen zu vermeiden und eine präzise Routenführung zu gewährleisten.

- Videoüberwachung und Sicherheit: In der modernen Überwachung kann YOLO verdächtige Aktivitäten, das Vorhandensein unerlaubter Gegenstände oder Personen in gesperrten Bereichen erkennen. Es kann Menschen in Menschenmengen verfolgen, die Bewegungsmuster analysieren und bei der Suche nach verlorenen Personen oder Tieren in unübersichtlichem Gelände unterstützen. Bei Sicherheitskontrollen an Flughäfen oder Bahnhöfen kann es automatisch potenziell gefährliche Objekte in Gepäckstücken identifizieren.

- Aktivitätserkennung: Über die bloße Erkennung hinaus kann YOLO die Bewegung und Interaktion von Objekten analysieren. Dies ist nützlich für die Überwachung in großen Sportarenen, Einkaufszentren oder bei der Analyse von Produktionsprozessen, um Anomalien im Arbeitsablauf zu erkennen.

- Verkehrsmanagement und -analyse: Der Algorithmus ermöglicht die automatische Erkennung von Fahrzeugtypen, die Zählung von Fahrzeugen, die Erkennung von Staus und die automatische Nummernschilderkennung (ANPR). Dies unterstützt intelligente Verkehrsleitsysteme und die Effizienzplanung im städtischen Raum.

- Medizinische Bildanalyse: Im Gesundheitswesen wird YOLO zur Erkennung von Anomalien in medizinischen Bildern eingesetzt, beispielsweise zur Identifizierung von Tumoren in Röntgenaufnahmen, MRTs oder CT-Scans, oder zur Lokalisierung spezifischer Zellstrukturen in Mikroskopiebildern. Durch die Beschleunigung des Diagnoseprozesses kann es in Notfallsituationen lebensrettend sein und Ärzte bei der frühen Erkennung von Krankheiten unterstützen.

- Qualitätskontrolle in der Industrie: In der Fertigung kann YOLO Produkte auf Mängel oder Fehlplatzierungen von Komponenten prüfen, was die Effizienz steigert und Ausschuss reduziert.

YOLO: Ein Eckpfeiler der modernen KI und Objekterkennung

Mit der Einführung von You Only Look Once (YOLO) hat die Computer Vision einen bedeutenden Sprung nach vorne gemacht. Der Algorithmus ermöglichte erstmals eine schnelle und gleichzeitig präzise Objekterkennung und legte damit den Grundstein für eine Vielzahl von Anwendungen, die das Potenzial der künstlichen Intelligenz in unserem Alltag sichtbar machen.

YOLO ist mehr als nur ein Algorithmus; es ist ein Paradigmenwechsel, der die Ära der Echtzeit-Objekterkennung einläutete und weiterhin ein zentrales Forschungsobjekt ist, das ständig weiterentwickelt wird. Sein Einfluss auf autonome Systeme, Überwachungstechnologien und sogar die medizinische Diagnostik ist enorm und unterstreicht die Notwendigkeit, fundierte Kenntnisse in diesen Bereichen zu erwerben. Wer sich tiefer mit KI und den besten Algorithmen wie YOLO beschäftigen möchte, findet in spezialisierten Weiterbildungen wertvolle Möglichkeiten, um die notwendigen Fähigkeiten für eine erfolgreiche Karriere in der Datenbranche zu entwickeln.

Direkt zur Sache: Was sind die Kosten für die Implementierung und den langfristigen Betrieb dieser YOLO-basierten Systeme, insbesondere in kommerziellen Anwendungen? Fallen Lizenzgebühren oder Abonnementkosten für die Nutzung an? Ich mache mir Sorgen, dass diese revolutionäre Technologie letztendlich nur für finanzstarke Unternehmen oder sehr wohlhabende Institutionen erschwinglich sein wird.

Vielen dank für ihre sehr relevante frage. die kosten für die implementierung und den langfristigen betrieb von YOLO-basierten systemen können tatsächlich variieren. in vielen fällen sind die zugrunde liegenden YOLO-modelle quelloffen, was bedeutet, dass keine direkten lizenzgebühren für die nutzung der modelle selbst anfallen. die hauptkosten entstehen in der regel durch die hardware, die für das training und die inferenz benötigt wird, sowie durch die entwicklung und anpassung der software an spezifische kommerzielle anwendungen.

für den langfristigen betrieb müssen auch die wartung, aktualisierungen und gegebenenfalls die datenspeicherung berücksichtigt werden. es gibt jedoch auch kommerzielle anbieter, die fertige lösungen oder cloud-basierte dienste anbieten, die abonnementkosten verursachen können, aber den vorteil bieten, dass sie weniger technische expertise für die implementierung erfordern. es ist ein bereich, in dem die innovation bestrebt ist, die zugänglichkeit zu verbessern, und ich bin optimistisch, dass die kosten mit der zeit weiter sinken werden. ich danke ihnen für ihren kommentar und lade sie ein, sich auch andere artikel in meinem profil oder meine weiteren ver