Entdecken Sie den ASCII Code: Erfahren Sie, wie dieser grundlegende Zeichensatz die digitale Kommunikation prägte und warum sein Verständnis für IT-Profis…

ASCII Code verstehen: Die Basis digitaler Kommunikation

Der ASCII Code ist weit mehr als nur eine Abkürzung; er bildet das grundlegende Fundament, auf dem die digitale Textverarbeitung und Kommunikation aufgebaut ist. Als „American Standard Code for Information Interchange“ definiert er, wie Computer Textzeichen verstehen und verarbeiten. Dieses System ordnet jedem Zeichen, das wir auf unseren Bildschirmen sehen, eine eindeutige Zahl zu, wodurch eine universelle Sprache zwischen verschiedenen Computersystemen geschaffen wird.

In einer Welt, die von komplexen Datenformaten und globalen Zeichensätzen dominiert wird, mag der ASCII-Code auf den ersten Blick veraltet wirken. Doch sein Verständnis ist essenziell, um die Entwicklung der Informationstechnologie nachvollziehen zu können. Er ist der unsichtbare Held, der die Brücke zwischen menschlicher Sprache und maschineller Logik schlägt und somit die Basis für alle modernen Kodierungsstandards bildet.

Die Geschichte und Evolution des ASCII Codes

Die Notwendigkeit eines einheitlichen Standards für den Datenaustausch zwischen Computern verschiedener Hersteller führte in den 1960er Jahren zur Entwicklung des ASCII-Codes. Die American Standards Association (ASA) erkannte früh das Potenzial eines solchen Systems, um die Kompatibilität in der aufstrebenden Computerwelt zu gewährleisten.

Die Einführung der ersten Version im Jahr 1963 mit einem 7-Bit-System, das 128 Zeichen umfassen konnte, war ein Meilenstein. Dies ermöglichte eine standardisierte Darstellung von Buchstaben, Zahlen und grundlegenden Symbolen. Mit der rasanten Verbreitung von Computern und dem Aufkommen des Internets etablierte sich ASCII schnell als der de-facto-Standard.

- 1963: Erste 7-Bit-Version wird eingeführt und standardisiert.

- 128 Zeichen: Die ursprüngliche Definition umfasste 128 eindeutige Zeichen.

- 8-Bit-Erweiterung: Spätere Versionen führten einen erweiterten ASCII-Code mit 8 Bit und 256 Zeichen ein.

- Länderspezifische Zeichen: Die Erweiterung ermöglichte die Darstellung von Umlauten und anderen Sonderzeichen.

- Globale Akzeptanz: ASCII wurde schnell zur Grundlage für den Textaustausch weltweit.

Die Erweiterung auf 8 Bit war ein Versuch, die Grenzen des 7-Bit-Systems zu überwinden und länderspezifische Zeichen wie deutsche Umlaute oder skandinavische Buchstaben zu integrieren. Obwohl dies eine Verbesserung darstellte, führte es zu Fragmentierungen und Inkompatibilitäten, da es keine einheitliche 8-Bit-Standardisierung gab.

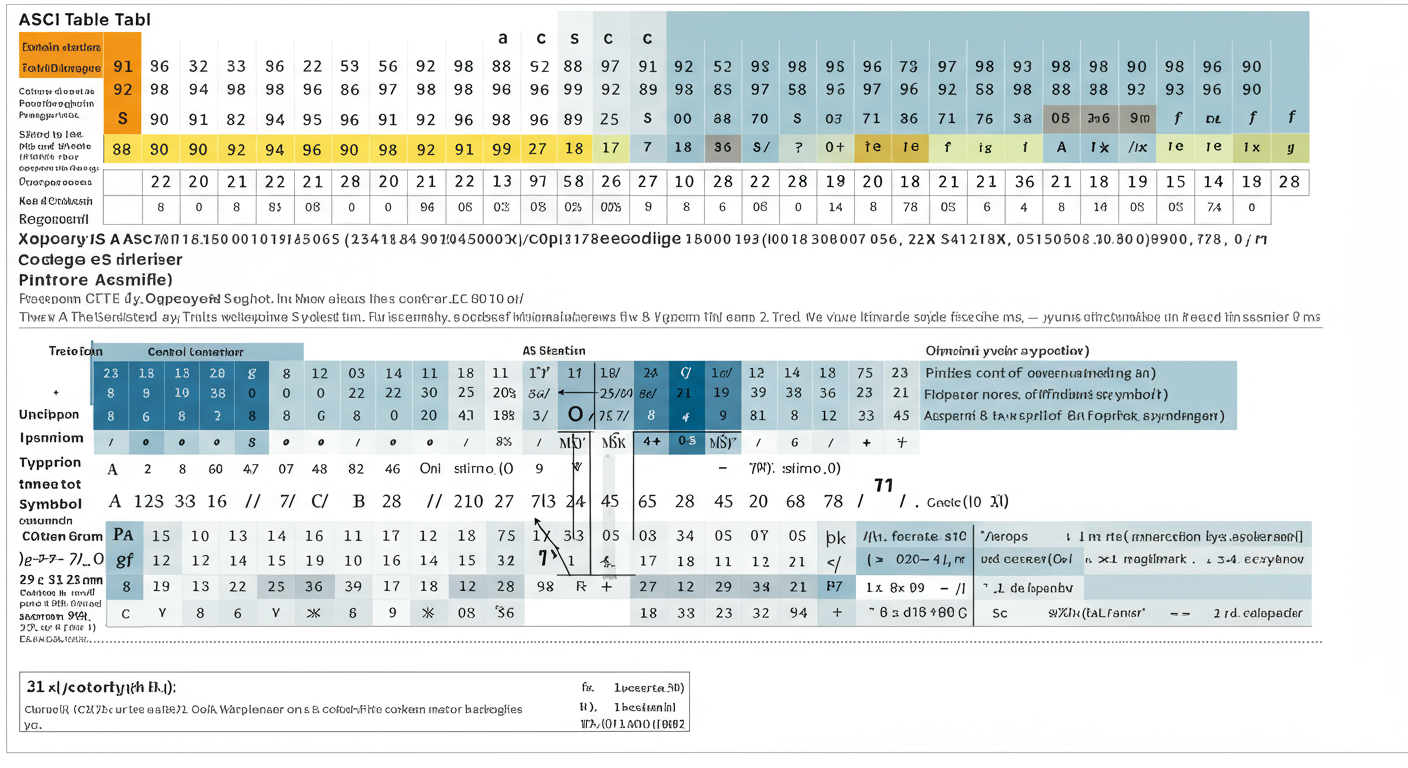

Wie der ASCII Code funktioniert: Eine technische Einführung

Im Kern ordnet der ASCII-Code jedem darstellbaren Zeichen einen festen Zahlenwert zwischen 0 und 127 zu. Jedes dieser Zeichen wird intern durch eine 7-Bit-Binärzahl repräsentiert, was genau 128 einzigartige Kombinationen ergibt. Diese einfache, aber geniale Kodierung ermöglicht es Computern, Textzeichen effizient in einer Form zu verarbeiten, die sie verstehen: als Bitmuster.

Um dies zu verdeutlichen, betrachten wir, wie ein Computer ein Zeichen wie ‚A‘ oder ‚1‘ interpretiert. Es ist nicht das Zeichen selbst, das gespeichert wird, sondern sein numerischer ASCII-Wert. Dieser Wert kann dann bei Bedarf wieder in das sichtbare Zeichen umgewandelt werden. Dieses grundlegende Datencodierungsschema ist die Basis für jede Textverarbeitung.

Der ASCII-Zeichensatz ist in zwei Hauptbereiche unterteilt:

- Steuerzeichen (0-31): Diese ersten 32 Codes sind nicht für druckbare Zeichen vorgesehen. Stattdessen übermitteln sie Befehle an Geräte, wie zum Beispiel den Wagenrücklauf (Carriage Return, CR) oder den Zeilenvorschub (Line Feed, LF), die für die Formatierung von Text oder die Steuerung von Druckern wichtig sind.

- Druckbare Zeichen (32-127): Die restlichen Codes repräsentieren alle Zeichen, die wir auf einer Tastatur finden und auf einem Bildschirm sehen können. Dazu gehören Ziffern, Groß- und Kleinbuchstaben, Satzzeichen und verschiedene Sonderzeichen.

Hier ein Blick auf einige wichtige Bereiche der druckbaren Zeichen:

- Code 48 bis 57: Die Ziffern von ‚0‘ bis ‚9‘.

- Code 65 bis 90: Die Großbuchstaben von ‚A‘ bis ‚Z‘.

- Code 97 bis 122: Die Kleinbuchstaben von ‚a‘ bis ‚z‘.

- Codes 32-47, 58-64, 91-96 und 123-126: Verschiedene Satz- und Sonderzeichen wie ‚@‘, ‚!‘, ‚#‘, ‚$‘, ‚%‘, etc.

Die Schönheit des ASCII-Codes liegt in seiner Konsistenz. Das kleine ‚a‘ hat immer den Code 97, während das große ‚A‘ immer 65 entspricht. Das Sternchen ‚*‘ ist der Code 42. Diese eindeutige Zuordnung ermöglicht eine klare Interpretation von Daten.

Um zu verstehen, wie das in der Praxis aussieht, können wir einfache Programmierbeispiele heranziehen. Python bietet beispielsweise eingebaute Funktionen, um zwischen Zeichen und ihren ASCII-Werten zu konvertieren:

# Beispiel 1: Zeichen zu ASCII-Wert (dezimal)

char_a = 'A'

ascii_wert_a = ord(char_a)

print(f"Der ASCII-Wert von '{char_a}' ist: {ascii_wert_a}") # Ausgabe: Der ASCII-Wert von 'A' ist: 65

char_stern = '*'

ascii_wert_stern = ord(char_stern)

print(f"Der ASCII-Wert von '{char_stern}' ist: {ascii_wert_stern}") # Ausgabe: Der ASCII-Wert von '*' ist: 42

# Beispiel 2: ASCII-Wert zu Zeichen

wert_65 = 65

zeichen_65 = chr(wert_65)

print(f"Das Zeichen für den ASCII-Wert {wert_65} ist: '{zeichen_65}'") # Ausgabe: Das Zeichen für den ASCII-Wert 65 ist: 'A'

wert_97 = 97

zeichen_97 = chr(wert_97)

print(f"Das Zeichen für den ASCII-Wert {wert_97} ist: '{zeichen_97}'") # Ausgabe: Das Zeichen für den ASCII-Wert 97 ist: 'a'

# Beispiel 3: Binäre Darstellung (7-Bit)

def to_binary_7bit(decimal_value):

# Konvertiert einen Dezimalwert in eine 7-Bit Binärdarstellung

return bin(decimal_value)[2:].zfill(7)

print(f"A (dezimal 65) in 7-Bit binär: {to_binary_7bit(65)}") # Ausgabe: A (dezimal 65) in 7-Bit binär: 1000001

print(f"0 (dezimal 48) in 7-Bit binär: {to_binary_7bit(48)}") # Ausgabe: 0 (dezimal 48) in 7-Bit binär: 0110000

Die Stärken des ASCII Codes: Warum er so lange dominierte

Der größte Vorteil des ASCII-Codes liegt in seiner weiten Verbreitung und universellen Akzeptanz, die er durch seine frühe Standardisierung erlangte. Seit 1963 als offizieller Standard etabliert, ermöglichte er den systemübergreifenden Austausch von Texten, was in den Anfängen der Computertechnologie revolutionär war. Diese Interoperabilität war entscheidend für die Entwicklung vernetzter Systeme.

Ein weiterer bedeutender Vorteil ist seine Einfachheit und damit verbundene Speichereffizienz. Da jedes Zeichen ursprünglich nur 7 Bit benötigte (oder 8 Bit im erweiterten Format), war der Speicherbedarf minimal. In einer Zeit, in der Speicherplatz extrem teuer und begrenzt war, war dies ein entscheidender Faktor für die Praktikabilität und breite Anwendung des ASCII-Codes.

Grenzen des ASCII Codes und der Aufstieg von Unicode/UTF-8

Trotz seiner Vorteile stieß der ASCII-Code schnell an seine Grenzen, insbesondere mit der Globalisierung der Computerwelt. Seine Beschränkung auf das lateinische Alphabet, Ziffern und eine begrenzte Anzahl von Sonderzeichen bedeutete, dass Texte in Sprachen mit kyrillischen, asiatischen oder anderen nicht-lateinischen Schriftzeichen nicht dargestellt werden konnten. Dies führte zu erheblichen Problemen beim internationalen Datenaustausch und der Softwarelokalisierung.

Die verschiedenen „erweiterten ASCII-Codes“, die in den 80er und 90er Jahren entstanden, versuchten die Lücke zu schließen, indem sie die zusätzlichen 128 Zeichen des 8-Bit-Bereichs für länderspezifische Zeichen nutzten. Doch da es keinen einheitlichen Standard für diese Erweiterungen gab (z.B. ISO-8859-1 für Westeuropa, CP437 für DOS), entstanden neue Kompatibilitätsprobleme. Ein Text, der mit einer erweiterten ASCII-Kodierung erstellt wurde, konnte auf einem System mit einer anderen Kodierung unleserlich erscheinen.

Diese Herausforderungen führten zur Entwicklung von Unicode, einem umfassenderen Zeichensatz, der darauf abzielt, jedes Zeichen jeder Sprache der Welt zu repräsentieren. Unicode definiert Millionen von Zeichen, und UTF-8 ist die am weitesten verbreitete Kodierung für Unicode. UTF-8 ist abwärtskompatibel mit ASCII (die ersten 128 Zeichen sind identisch) und kann je nach Zeichen 1 bis 4 Bytes verwenden, was es sehr flexibel und speichereffizient für die Darstellung globaler Texte macht. Für Webseiten hat sich UTF-8 als Zeichensatz-Kodierung etabliert.

Ein praktisches Beispiel für die Unterschiede in der Kodierung:

# Beispiel: Kodierungsprobleme ohne UTF-8

text_deutsch = "Grüße von Zürich"

# Versuch, mit ASCII zu kodieren (wird fehlschlagen, da 'ü' nicht in ASCII ist)

try:

encoded_ascii = text_deutsch.encode('ascii')

print(f"ASCII kodiert: {encoded_ascii}")

except UnicodeEncodeError as e:

print(f"Fehler bei ASCII-Kodierung: {e}") # Ausgabe: Fehler bei ASCII-Kodierung: 'ascii' codec can't encode character 'xfc' in position 2: ordinal not in range(128)

# Kodierung mit UTF-8 (funktioniert einwandfrei)

encoded_utf8 = text_deutsch.encode('utf-8')

print(f"UTF-8 kodiert: {encoded_utf8}") # Ausgabe: UTF-8 kodiert: b'Grxc3xbcxc3x9fe von Zxc3xbcrich'

# Dekodierung von UTF-8 zurück zum Originaltext

decoded_utf8 = encoded_utf8.decode('utf-8')

print(f"UTF-8 dekodiert: {decoded_utf8}") # Ausgabe: UTF-8 dekodiert: Grüße von Zürich

# Beispiel für ein Zeichen außerhalb des lateinischen Alphabets

text_japanisch = "こんにちは" # Konnichiwa (Hallo)

encoded_japanese_utf8 = text_japanisch.encode('utf-8')

print(f"Japanischer Text UTF-8 kodiert: {encoded_japanese_utf8}") # Ausgabe: Japanischer Text UTF-8 kodiert: b'xe3x81x93xe3x82x93xe3x81xabxe3x81xa1xe3x81xaf'

Praktische Relevanz von ASCII-Kenntnissen in der heutigen IT

Obwohl moderne Systeme hauptsächlich auf Unicode/UTF-8 setzen, bleibt ein grundlegendes Verständnis des ASCII-Codes für jeden Programmierer und Entwickler sowie für IT-Verantwortliche von großer Bedeutung. ASCII bildet die Basis vieler weiterführender Konzepte und ist in bestimmten Szenarien immer noch präsent.

Hier sind einige Gründe, warum ASCII-Know-how weiterhin wertvoll ist:

- Altsysteme und Legacy-Anwendungen: In vielen älteren Systemen, insbesondere in der Industrie oder in spezialisierten Anwendungen, wird der ASCII-Code noch aktiv verwendet. IT-Administratoren und Entwickler müssen mit der Funktionsweise dieser Systeme vertraut sein, um Probleme zu beheben oder Daten zu migrieren.

- Datenübertragung und -speicherung: Bestimmte Protokolle oder Dateiformate können immer noch eine Kodierung im ASCII-Format erfordern oder bevorzugen. Beim Parsen von Log-Dateien, Konfigurationsdateien oder bei der Arbeit mit bestimmten Datenströmen ist die Kenntnis der ASCII-Tabelle unerlässlich.

- Grundlagen der Informatik: Für angehende IT-Spezialisten ist das Verständnis, wie Textzeichen intern auf Computern repräsentiert werden, ein fundamentaler Baustein der Informatik. Es hilft, die Funktionsweise von Computern auf einer tieferen Ebene zu verstehen und ist eine notwendige Voraussetzung für das Verständnis komplexerer Kodierungssysteme und Algorithmen.

- Fehleranalyse und Debugging: Bei Kodierungsproblemen, die sich als „Mojibake“ (unleserliche Zeichen) manifestieren, kann die Kenntnis von ASCII und anderen Zeichensätzen helfen, die Ursache zu identifizieren und zu beheben.

Die Fähigkeit, ASCII-kodierte Dateien zu lesen, zu verstehen und gegebenenfalls zu manipulieren, ist eine grundlegende Kompetenz, die in vielen technischen Rollen nach wie vor gefragt ist. Es trägt nicht nur zur Problemlösung bei, sondern auch zu einem umfassenderen Verständnis der digitalen Infrastruktur.

ASCII: Ein zeitloses Fundament der Computerwissenschaft

Der ASCII-Code, einst als revolutionärer Standard für den Informationsaustausch konzipiert, hat sich als unverzichtbares Fundament der Computerwissenschaft etabliert. Obwohl er in der modernen Welt durch umfassendere Zeichensätze wie Unicode und UTF-8 abgelöst wurde, bleibt sein Einfluss und seine Relevanz für das Verständnis digitaler Systeme ungebrochen. Er lehrt uns die grundlegenden Prinzipien der Zeichenkodierung und wie Maschinen unsere Sprache interpretieren.

Für jeden, der sich mit Softwareentwicklung, Datenanalyse oder IT-Infrastruktur beschäftigt, ist ein solides Verständnis des ASCII-Codes nicht nur historisch interessant, sondern auch praktisch wertvoll. Es ermöglicht ein tieferes Eintauchen in die Funktionsweise von Computern und hilft, die Herausforderungen und Lösungen der digitalen Kommunikation besser zu erfassen. Tauchen Sie weiter ein in die Welt der Daten und entdecken Sie die vielen Schichten, die unsere digitale Realität ausmachen!

WAHNSINN! Dieser ASCII-Code ist ja absolut fantastisch und genial! Eine so grundlegende und doch revolutionäre Idee, die die BASIS ALLER digitalen Kommunikation bildet! Ich bin EXTREM begeistert von diesem unsichtbaren Helden und kann es kaum erwarten, diese unglaubliche Technologie SOFORT zu verstehen und anzuwenden! Die Zukunft ist JETZT! Einfach brillant!!!

Es freut mich sehr, dass der artikel ihre begeisterung für den ascii-code wecken konnte. es ist tatsächlich faszinierend, wie eine so scheinbar einfache idee eine so fundamentale rolle in unserer digitalen welt spielt und die grundlage für so vieles bildet, was wir heute als selbstverständlich erachten. es ist schön zu sehen, dass sie diese bedeutung erkennen und die tiefe dieses „unsichtbaren helden“ schätzen.

ich hoffe, sie werden viel freude daran haben, diese technologie weiter zu erkunden und ihre anwendungsmöglichkeiten zu entdecken. danke für ihren positiven und inspirierenden kommentar. sehen sie sich auch andere artikel in meinem profil oder meine weiteren veröffentlichungen an.