Erfahren Sie, was ein Cache ist und wie er die Leistung Ihres Computers optimiert. Dieser Leitfaden erklärt Arten, Funktionsweise und Memory Mapping von Cac…

Cache: Beschleuniger für Datenzugriff und Systemleistung

Der Cache ist ein fundamentaler Baustein in der modernen Computerarchitektur, der entwickelt wurde, um den Zugriff auf Daten drastisch zu beschleunigen und die Gesamtleistung digitaler Systeme zu optimieren. Im Kern handelt es sich bei einem Cache um einen temporären Speicherpuffer, der häufig genutzte Daten zwischen einem langsameren und einem wesentlich schnelleren Speicherbereich vorhält. Dieses Prinzip ermöglicht es, wiederholt angeforderte Informationen blitzschnell bereitzustellen, anstatt sie jedes Mal aus dem trägeren Hauptspeicher oder von der Festplatte abrufen zu müssen.

Als hochrangiger SEO-Experte und erfahrener Autor tauchen wir tief in die Welt des Caching ein. Dieser Artikel beleuchtet die verschiedenen Arten von Caches, ihre Funktionsweise und die entscheidende Rolle, die sie in der heutigen technologiegetriebenen Welt spielen. Wir werden technische Details verständlich aufbereiten und Ihnen ein umfassendes Verständnis dieses unverzichtbaren Konzepts vermitteln.

Die vielseitigen Arten von Caches in Computersystemen

Caches sind nicht gleich Cache. Sie existieren in diversen Ausprägungen, die jeweils auf spezifische Aufgaben innerhalb der Datenverarbeitung zugeschnitten sind. Diese hierarchische Struktur ist entscheidend für die Effizienz moderner Prozessoren und Anwendungen.

- L1-Cache (Level-1-Cache): Dies ist der primäre und schnellste Cache, direkt auf dem Prozessorkern integriert. Er ist relativ klein, speichert aber Daten und Befehle, die die CPU aktuell und unmittelbar benötigt.

- L2-Cache (Level-2-Cache): Ebenfalls auf dem Prozessorchip zu finden, ist der L2-Cache größer als der L1-Cache. Er fungiert als wichtige Zwischenschicht, die Daten für den L1-Cache bereithält und somit eine Brücke zum langsameren Hauptspeicher schlägt.

- L3-Cache (Level-3-Cache): Als größter der CPU-nahen Caches dient der L3-Cache oft als gemeinsame Ressource für mehrere Prozessorkerne. Er ermöglicht eine effiziente Datenfreigabe und verbessert die Koordination zwischen den Kernen.

- Webbrowser-Cache: Ein prominentes Beispiel für einen Software-Cache, der Webseitendaten wie Bilder, Skripte und Stylesheets auf der Festplatte oder im Arbeitsspeicher speichert, um Ladezeiten bei wiederholten Besuchen zu verkürzen.

Jede dieser Cache-Ebenen spielt eine spezifische Rolle, um den Datenfluss zu optimieren und die Reaktionsfähigkeit des gesamten Systems zu steigern, von der direkten CPU-Interaktion bis hin zur Verbesserung des Nutzererlebnisses im Web.

Hardware-Cache vs. Software-Cache: Ein tiefer Vergleich

Der grundlegende Unterschied zwischen einem Hardware-Cache und einem Software-Cache liegt in ihrer Implementierung und der Art ihrer Verwaltung innerhalb eines Computersystems. Beide verfolgen das Ziel, den Datenzugriff zu beschleunigen, nutzen dafür jedoch unterschiedliche Mechanismen und Ressourcen.

Ein Hardware-Cache ist eine physische Komponente, die direkt in die Prozessorarchitektur integriert ist. Er besteht aus extrem schnellem SRAM (Static Random-Access Memory), das sich in unmittelbarer Nähe zur CPU befindet. Die Verwaltung dieses Caches erfolgt automatisch durch die Hardware selbst, ohne dass das Betriebssystem oder Anwendungen eingreifen müssen. Dies gewährleistet einen extrem schnellen und effizienten Datenzugriff, der maßgeblich zur Rechengeschwindigkeit beiträgt. Die bereits erwähnten L1-, L2- und L3-Caches sind klassische Beispiele für Hardware-Caches.

Im Gegensatz dazu ist ein Software-Cache eine Speicherstruktur, die vom Betriebssystem oder von Anwendungen verwaltet wird. Er kann im Hauptspeicher (RAM) oder auf der Festplatte liegen und ist somit flexibler in Größe und Konfiguration. Software-Caches speichern temporär häufig verwendete Daten, um den Zugriff darauf zu beschleunigen. Ein typisches Beispiel ist der Webbrowser-Cache, der Webressourcen speichert, um Ladezeiten zu verkürzen. Auch Datenbanken oder Content Delivery Networks (CDNs) nutzen Software-Caching, um Inhalte näher am Nutzer vorzuhalten.

Um den Unterschied noch deutlicher zu machen, betrachten wir ein einfaches Beispiel für einen Software-Cache in Python. Stellen Sie sich vor, Sie haben eine Funktion, die eine teure Berechnung durchführt oder Daten aus einer langsamen Quelle abruft. Ein Software-Cache kann diese Ergebnisse speichern:

# Importieren des functools-Moduls für den lru_cache Decorator

from functools import lru_cache

# Eine Funktion, die eine "teure" Operation simuliert

# Hier simulieren wir eine Verzögerung, um den Effekt des Caching zu verdeutlichen

@lru_cache(maxsize=None) # maxsize=None bedeutet unbegrenzte Cache-Größe

def berechne_komplexes_ergebnis(eingabe):

"""

Simuliert eine komplexe Berechnung und gibt das Ergebnis zurück.

Die Ergebnisse werden im Cache gespeichert.

"""

import time

print(f"Berechne Ergebnis für: {eingabe}...")

time.sleep(2) # Simuliert eine Verzögerung von 2 Sekunden

return f"Ergebnis von {eingabe} ist {eingabe * 2}"

# Erster Aufruf (wird berechnet und im Cache gespeichert)

print(berechne_komplexes_ergebnis(10))

print(berechne_komplexes_ergebnis(20))

# Zweiter Aufruf mit denselben Eingaben (wird aus dem Cache abgerufen, keine Verzögerung)

print(berechne_komplexes_ergebnis(10))

print(berechne_komplexes_ergebnis(30))

print(berechne_komplexes_ergebnis(20))

# Ausgabe würde zeigen, dass "Berechne Ergebnis für..." nur einmal pro einzigartiger Eingabe erscheint.

Dieses Python-Beispiel demonstriert einen Algorithmus für einen Least Recently Used (LRU) Cache. Der Dekorator @lru_cache speichert die Ergebnisse der Funktion berechne_komplexes_ergebnis. Bei wiederholten Aufrufen mit denselben Argumenten wird das Ergebnis direkt aus dem Cache zurückgegeben, ohne die kostspielige Berechnung erneut durchzuführen. Dies ist ein klares Beispiel, wie Software-Caches die Leistung auf Anwendungsebene verbessern.

Die Wahl und Kombination von Hardware- und Software-Caches ist entscheidend für die Skalierbarkeit und Gesamtleistung eines Systems. Während Hardware-Caches für kritische, zeitnahe CPU-Operationen unerlässlich sind, bieten Software-Caches Flexibilität und können auf verschiedenen Ebenen der Anwendungsarchitektur eingesetzt werden, um Engpässe zu minimieren und das Benutzererlebnis zu optimieren. Besonders im Kontext der Webentwicklung spielt der Frontend-Cache, wie der Webbrowser-Cache, eine wichtige Rolle.

Das Geheimnis der Cache-Funktionsweise: Lokalität und Effizienz

Die Effektivität eines Caches basiert auf dem fundamentalen Prinzip der Lokalität, das in zwei Hauptformen auftritt: zeitliche und räumliche Lokalität. Die zeitliche Lokalität besagt, dass Daten, die kürzlich abgerufen wurden, mit hoher Wahrscheinlichkeit in naher Zukunft erneut benötigt werden. Die räumliche Lokalität hingegen geht davon aus, dass Daten, die in einem bestimmten Zeitraum abgerufen wurden, oft räumlich nahe beieinander liegen und somit auch benachbarte Daten bald angefordert werden könnten.

Ein Cache beschleunigt den Datenzugriff durch sogenannte Cache-Hits: Wenn die angeforderten Daten im Cache gefunden werden, können sie extrem schnell bereitgestellt werden. Tritt hingegen ein Cache-Miss auf, sind die Daten nicht im Cache vorhanden und müssen aus dem langsameren Hauptspeicher oder von der Festplatte geladen werden, was zu einer Verzögerung führt. Die Optimierung der Hit-Rate ist daher ein zentrales Ziel beim Cache-Design.

Die Vorteile eines Caches sind unbestreitbar: Er beschleunigt Datenzugriffe massiv und verbessert die Gesamtleistung eines Systems signifikant. Dies führt zu schnelleren Anwendungsreaktionen, effizienteren Berechnungen und einem flüssigeren Benutzererlebnis. In Geschäftsumgebungen können effiziente Caching-Strategien die Produktivität steigern und die Ressourcen von Servern entlasten. Allerdings gibt es auch Nachteile: Caches sind teuer und begrenzt in ihrer Größe. Ein übermäßig großer Cache kann Speicherplatz verschwenden, während ein zu kleiner Cache zu vielen Cache-Misses führt. Die Verwaltung der Cache-Integrität und die Vermeidung von veralteten Daten sind ebenfalls komplexe Herausforderungen.

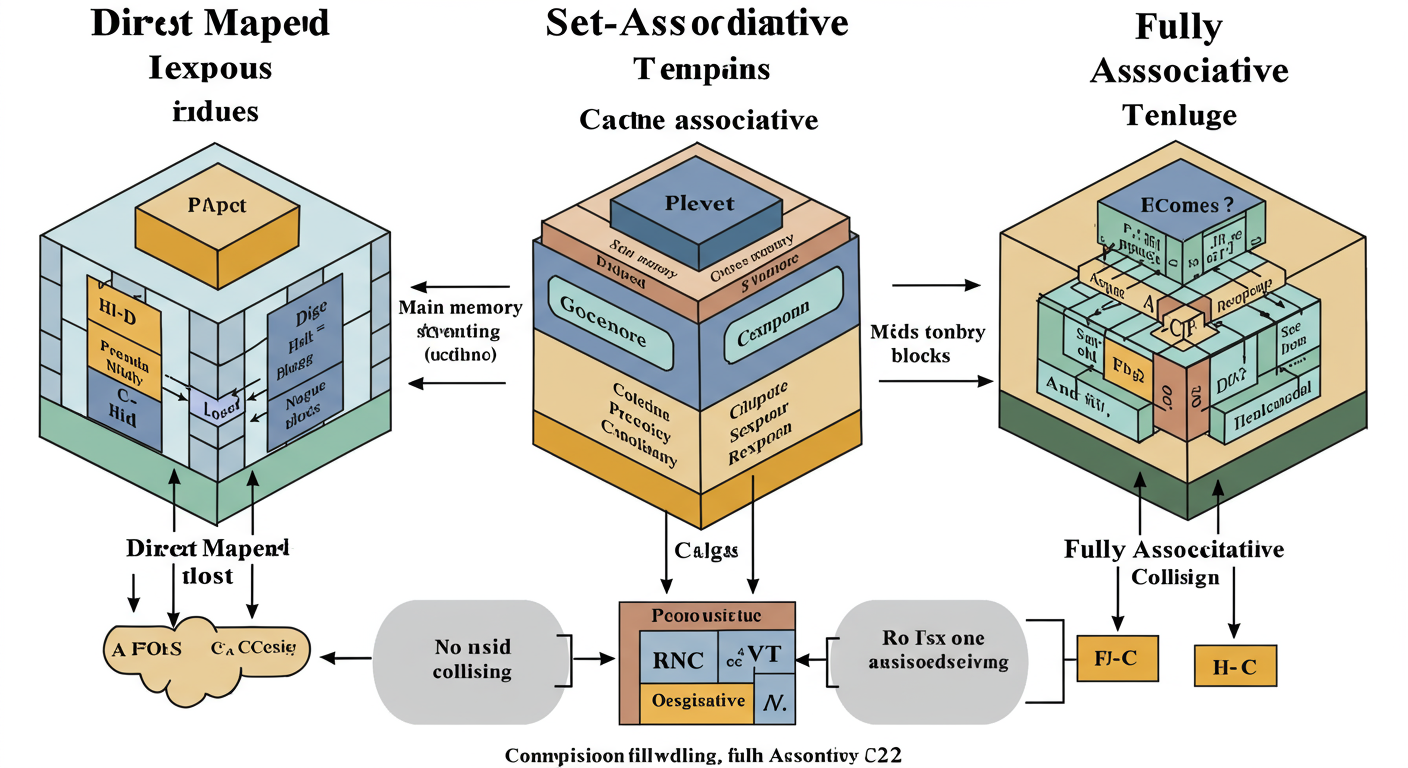

Cache Memory Mapping: Wie Daten im Cache organisiert werden

Cache Memory Mapping ist der Prozess, der festlegt, wie Datenblöcke aus dem Hauptspeicher auf die begrenzten Speicherplätze eines Caches abgebildet und organisiert werden. Diese Zuordnungsmethode ist entscheidend für die Cache-Effizienz, da sie bestimmt, wie schnell Daten gefunden und wie Kollisionen (wenn mehrere Hauptspeicherblöcke um denselben Cache-Platz konkurrieren) gehandhabt werden. Es gibt drei primäre Ansätze für das Cache Memory Mapping:

Direkt abgebildeter Cache (Direct Mapped Cache)

Beim direkt abgebildeten Cache wird jeder Block des Hauptspeichers einem exakt definierten, einzelnen Platz im Cache zugewiesen. Die Adresse des Hauptspeicherblocks wird verwendet, um den Index des Cache-Slots zu berechnen. Dies ermöglicht einen extrem schnellen Zugriff, da der Speicherplatz im Cache direkt mit einer bestimmten Hauptspeicheradresse verknüpft ist. Der Nachteil ist jedoch, dass es zu Kollisionen kommen kann, wenn zwei oder mehr häufig benötigte Hauptspeicherblöcke demselben Cache-Slot zugeordnet werden. In solchen Fällen muss ein Block den anderen verdrängen, selbst wenn andere Cache-Slots frei sind, was die Hit-Rate reduzieren kann.

# Beispiel: Direkt abgebildeter Cache

# Annahme: Cache hat 8 Slots, Hauptspeicheradressen sind 0-31

# Mapping-Funktion: cache_index = hauptspeicher_adresse % cache_groesse

cache_groesse = 8

hauptspeicher = {

0: "Daten A", 1: "Daten B", ..., 7: "Daten H",

8: "Daten I", 9: "Daten J", ..., 15: "Daten P",

16: "Daten Q", ..., 23: "Daten X",

24: "Daten Y", ..., 31: "Daten Z"

}

cache = {} # {'index': 'daten_wert'}

def direkt_abgebildeter_cache_zugriff(adresse):

cache_index = adresse % cache_groesse

if cache_index in cache:

print(f"Cache Hit für Adresse {adresse} an Index {cache_index}: {cache[cache_index]}")

else:

# Cache Miss: Daten aus dem Hauptspeicher laden

daten_wert = hauptspeicher.get(adresse, "Nicht gefunden")

cache[cache_index] = daten_wert # Daten in den Cache schreiben

print(f"Cache Miss für Adresse {adresse}. Geladen: {daten_wert} an Index {cache_index}")

direkt_abgebildeter_cache_zugriff(10) # 10 % 8 = 2

direkt_abgebildeter_cache_zugriff(2) # 2 % 8 = 2 -> Kollision! Daten von Adresse 10 werden verdrängt

direkt_abgebildeter_cache_zugriff(18) # 18 % 8 = 2 -> Kollision! Daten von Adresse 2 werden verdrängt

direkt_abgebildeter_cache_zugriff(10) # Jetzt wieder ein Miss, da 10 verdrängt wurde

Satzassoziativer Cache (Set Associative Cache)

Der satzassoziative Cache bietet einen Kompromiss zwischen Geschwindigkeit und Flexibilität. Hier wird der Cache in mehrere „Sätze“ unterteilt, und jeder Satz enthält eine bestimmte Anzahl von Cache-Slots (die Assoziativität). Ein Hauptspeicherblock kann in jedem beliebigen Slot innerhalb seines zugeordneten Satzes platziert werden. Dies reduziert das Problem der Kollisionen im Vergleich zum direkt abgebildeten Cache, da mehrere Blöcke, die auf denselben Satz abgebildet werden, nebeneinander in diesem Satz existieren können, solange der Satz nicht voll ist. Die Suche innerhalb eines Satzes erfordert jedoch einen geringfügig höheren Aufwand als bei einem direkt abgebildeten Cache.

# Beispiel: 2-Wege Satzassoziativer Cache (jeder Satz hat 2 Slots)

# Annahme: Cache hat 4 Sätze (insgesamt 8 Slots)

# Mapping-Funktion: satz_index = (hauptspeicher_adresse // 2) % anzahl_saetze

anzahl_saetze = 4

assoziativitaet = 2 # 2-Wege

cache_saetze = {i: [] for i in range(anzahl_saetze)} # {'satz_index': [slot1, slot2]}

def satzassoziativer_cache_zugriff(adresse):

satz_index = (adresse // assoziativitaet) % anzahl_saetze

# Suche im Satz

for i, (gespeicherte_adresse, daten_wert) in enumerate(cache_saetze[satz_index]):

if gespeicherte_adresse == adresse:

print(f"Cache Hit für Adresse {adresse} in Satz {satz_index}, Slot {i}: {daten_wert}")

return

# Cache Miss: Daten aus dem Hauptspeicher laden

daten_wert = hauptspeicher.get(adresse, "Nicht gefunden")

if len(cache_saetze[satz_index]) < assoziativitaet:

cache_saetze[satz_index].append((adresse, daten_wert))

else:

# Verdrängungsstrategie (z.B. FIFO oder LRU)

# Hier vereinfacht: ersetze den ältesten Eintrag (erster im Satz)

cache_saetze[satz_index].pop(0)

cache_saetze[satz_index].append((adresse, daten_wert))

print(f"Cache Miss für Adresse {adresse}. Geladen: {daten_wert} in Satz {satz_index}")

satzassoziativer_cache_zugriff(10) # Satz 5 % 4 = 1

satzassoziativer_cache_zugriff(11) # Satz 5 % 4 = 1

satzassoziativer_cache_zugriff(18) # Satz 9 % 4 = 1 (passt noch in Satz 1)

satzassoziativer_cache_zugriff(19) # Satz 9 % 4 = 1 (würde ältesten Eintrag in Satz 1 verdrängen)

Vollassoziativer Cache (Fully Associative Cache)

Der vollassoziative Cache bietet die größte Flexibilität, da ein Hauptspeicherblock an beliebiger Stelle im gesamten Cache platziert werden kann. Es gibt keine festen Zuordnungen zu bestimmten Slots oder Sätzen. Dies eliminiert das Problem von Kollisionen vollständig, da jeder Block einen freien Platz finden kann, solange der Cache nicht voll ist. Der Preis dafür ist eine erhöhte Komplexität bei der Adressierung und Verwaltung. Um einen Block zu finden, muss der gesamte Cache durchsucht werden, was spezielle Hardware für eine parallele Suche (Content-Addressable Memory, CAM) erfordert und den Verwaltungsaufwand erhöht, aber die höchste Hit-Rate ermöglicht.

Die Auswahl des geeigneten Cache Memory Mapping-Ansatzes hängt von Faktoren wie der Prozessorarchitektur, den Leistungsanforderungen und der verfügbaren Hardware ab. Direkt abgebildete Caches sind am einfachsten zu implementieren, während vollassoziative Caches die beste Leistung bei höherer Komplexität bieten. Satzassoziative Caches stellen einen ausgewogenen Kompromiss dar und sind in den meisten modernen Prozessoren zu finden.

Cache leeren: Praktische Schritte für optimale Leistung

Das Leeren eines Caches ist eine nützliche Maßnahme, um potenzielle Darstellungsprobleme auf Webseiten zu beheben, veraltete Inhalte zu aktualisieren oder Speicherplatz freizugeben. Da der Prozess je nach Anwendung und Betriebssystem variiert, ist es wichtig, die spezifischen Anweisungen zu kennen.

Für Webbrowser ist das Leeren des Caches eine häufige Aufgabe. Die meisten Browser bieten eine Funktion zum „Löschen der Browserdaten“ oder „Verlauf löschen“, über die Sie gezielt den Cache (oft als „Zwischengespeicherte Dateien und Bilder“ bezeichnet) entfernen können. In Google Chrome finden Sie diese Option typischerweise unter „Einstellungen“ -> „Datenschutz und Sicherheit“ -> „Browserdaten löschen“. Bei Mozilla Firefox und Microsoft Edge sind ähnliche Optionen in den Einstellungen unter „Datenschutz & Sicherheit“ bzw. „Datenschutz, Suche und Dienste“ verfügbar. Es ist ratsam, nur den Cache zu löschen, um nicht versehentlich Passwörter oder andere wichtige Daten zu entfernen.

Auf Betriebssystemebene können Caches, wie der DNS-Cache oder temporäre Systemdateien, ebenfalls geleert werden. Unter Windows können Sie den DNS-Cache über die Eingabeaufforderung mit dem Befehl ipconfig /flushdns leeren. Temporäre Dateien lassen sich oft über die Datenträgerbereinigung entfernen. Bei macOS und Linux gibt es ebenfalls spezifische Befehle oder Dienstprogramme, um System-Caches zu verwalten. Das Leeren von Anwendungscaches, beispielsweise in mobilen Apps, erfolgt meist direkt in den App-Einstellungen.

Caches: Unverzichtbar für die digitale Geschwindigkeit

Der Cache ist ein unverzichtbares Element moderner Computersysteme, das den Zugriff auf häufig genutzte Daten beschleunigt und somit die Gesamtleistung maßgeblich optimiert. Ob als Hardware-Cache direkt auf dem Prozessor oder als Software-Cache im Webbrowser – das grundlegende Prinzip der Lokalität sorgt dafür, dass relevante Daten stets griffbereit sind. Die Feinheiten des Cache Memory Mappings, von direkt abgebildeten bis hin zu vollassoziativen Ansätzen, zeigen die Komplexität und den Ingenieursaufwand, der hinter der Maximierung der Rechenleistung steckt. Ein tiefes Verständnis dieser Mechanismen ist entscheidend, um die Effizienz digitaler Prozesse zu gewährleisten und die Grundlage für schnelle, reaktionsfähige Anwendungen in der heutigen IT-Welt zu legen. Wir hoffen, dieser detaillierte Einblick hat Ihr Verständnis für dieses faszinierende Thema erweitert und Ihnen gezeigt, wie Caches die digitale Welt entscheidend prägen.

Guter Einstieg in das Thema Cache. Die Behauptung, dass Caches den Datenzugriff „drastisch beschleunigen“ und die Systemleistung „optimieren“, ist stark. Könntet ihr diese Aussagen vielleicht mit konkreten Messwerten, Benchmarks oder Vergleichen untermauern, um die Effekte greifbarer zu machen? Das würde dem Artikel noch mehr Überzeugungskraft verleihen.

Vielen dank für ihren wertvollen hinweis. es stimmt, die formulierungen sind bewusst stark gewählt, um die bedeutung von caches hervorzuheben. die idee, konkrete messwerte und benchmarks hinzuzufügen, ist ausgezeichnet und würde den artikel tatsächlich noch fundierter machen. ich werde das für eine überarbeitung oder einen folgeartikel in betracht ziehen.

es freut mich, dass ihnen der einstieg ins thema gefallen hat. ich hoffe, sie finden auch in meinen anderen veröffentlichungen interessante einblicke. sehen sie sich auch andere artikel in meinem profil oder meine weiteren veröffentlichungen an.