Das CSV-Format (Comma Separated Values) ist seit Jahrzehnten ein unverzichtbarer Bestandteil der digitalen Welt, wenn es um die effiziente Darstellung und den Datenaustausch zwischen Systemen geht. Es ermöglicht die Speicherung von tabellarischen Daten in Textform, eine Eigenschaft, die es zum bevorzugten Werkzeug für den Import, den Export und die Verarbeitung von Informationen in den unterschiedlichsten Anwendungen macht. Von den Anfängen der Computertechnologie in den 1970er Jahren bis heute hat sich dieses einfache, aber leistungsstarke Format als eine universelle Sprache für die Datenverwaltung etabliert.

In diesem umfassenden Blogbeitrag werden wir tief in die Welt des CSV-Formats eintauchen. Wir werden seine grundlegende Struktur untersuchen, die vielfältigen Anwendungsfälle beleuchten und detaillierte Best Practices für den sicheren und effizienten Umgang mit CSV-Dateien präsentieren. Darüber hinaus werden wir die Herausforderungen im Bereich der Cybersicherheit diskutieren und die beeindruckende Evolution des Formats im Kontext moderner Datenanforderungen, wie Big Data und unstrukturierte Daten, nachvollziehen. Entwickler, Datenanalysten, Studierende und Technologiebegeisterte, die ihr Verständnis für die effiziente Datenverarbeitung vertiefen möchten, finden hier fundiertes Wissen und praktische Codebeispiele, insbesondere für die Arbeit mit Python und Pandas.

Grundlagen des CSV-Formats verstehen

Das CSV-Format verdankt seinen Namen der grundlegenden Methode, wie es Daten organisiert: Werte werden durch Kommas getrennt. Diese schlichte Konvention schafft eine lineare Struktur, bei der jede Zeile einen einzelnen Datensatz repräsentiert und die Kommas als Trennzeichen für die verschiedenen Spalten oder Felder innerhalb dieses Datensatzes fungieren. Diese Struktur einer CSV-Datei ist intuitiv verständlich und ermöglicht eine hohe Kompatibilität über Systemgrenzen hinweg.

Die erste Zeile einer typischen CSV-Datei ist oft als Header-Zeile konzipiert und enthält die Namen der Spalten. Diese Spaltenüberschriften sind entscheidend für die Lesbarkeit und die korrekte Interpretation der Daten. Ein menschlicher Betrachter kann den Inhalt sofort erfassen, und Softwareprogramme können die Datenfelder anhand dieser Bezeichnungen zuordnen. Die scheinbare Einfachheit des Formats erleichtert nicht nur die manuelle Bearbeitung, sondern auch die maschinelle Verarbeitung, wodurch CSV zu einer idealen Wahl für den Datenaustausch zwischen unterschiedlichsten Anwendungen und Systemen wird.

Aufbau und Struktur von CSV-Dateien

Die Kernidee des CSV-Formats ist denkbar einfach: Jeder Datensatz wird in einer neuen Zeile dargestellt, und die einzelnen Datenfelder innerhalb dieser Zeile sind durch ein spezifisches Trennzeichen – meist ein Komma – voneinander abgegrenzt. Betrachten wir ein klassisches Beispiel für eine Adressliste:

Name,Vorname,Alter,Stadt

Mustermann,Max,30,Berlin

Musterfrau,Anna,25,München

Schmidt,Peter,42,HamburgIn diesem Beispiel repräsentiert die erste Zeile die Spaltenüberschriften (Name, Vorname, Alter, Stadt). Jede nachfolgende Zeile ist ein Datensatz, dessen Werte durch Kommas getrennt sind. Diese Konsistenz ist der Schlüssel zur einfachen Verarbeitung. Allerdings gibt es Sonderfälle, die eine spezifische Behandlung erfordern.

Umgang mit speziellen Zeichen und Anführungszeichen

Eine der größten Herausforderungen beim Arbeiten mit CSV-Dateien entsteht, wenn Datenfelder selbst das Trennzeichen (Komma) oder andere Sonderzeichen wie Anführungszeichen enthalten. Um eine Fehlinterpretation zu vermeiden, sieht das CSV-Format eine intelligente Lösung vor: Felder, die solche Zeichen enthalten, werden in doppelte Anführungszeichen eingeschlossen. Falls das Feld selbst doppelte Anführungszeichen enthält, müssen diese verdoppelt („escaped“) werden.

Betrachten wir ein Beispiel, bei dem ein Name ein Komma enthält oder eine Beschreibung Anführungszeichen:

Produkt,Beschreibung,Preis

Laptop,"Leistungsstarkes Modell, ideal für Entwickler",1200.00

Software,"Enthält die Funktion ""Dark Mode"" für bessere Ergonomie",50.99

Drucker,Standarddrucker,150.00Im ersten Datensatz umschließen Anführungszeichen die Beschreibung „Leistungsstarkes Modell, ideal für Entwickler“, um das Komma darin als Teil des Feldes und nicht als Trennzeichen zu kennzeichnen. Im zweiten Datensatz wird das interne doppelte Anführungszeichen in „Dark Mode“ durch Verdopplung („“Dark Mode““) korrekt dargestellt. Diese Konvention stellt sicher, dass die Datenintegrität gewahrt bleibt und Software die Inhalte korrekt parsen kann. Das Verständnis dieser Regeln ist entscheidend für die korrekte Umgang mit speziellen Zeichen in CSV-Dateien.

Vielseitige Anwendungen und Vorteile des CSV-Formats

Das CSV-Format ist in der digitalen Welt allgegenwärtig und wird aufgrund seiner Einfachheit und Universalität für eine Vielzahl von Aufgaben eingesetzt. Seine Hauptstärke liegt in der Verarbeitung von tabellarischen Daten, was es zu einem Eckpfeiler im Bereich des Data Science und der Datenanalyse macht. Entwickler, Datenanalysten und alle, die mit Datenmanagement zu tun haben, nutzen es täglich für grundlegende und komplexe Operationen.

Eine der häufigsten Anwendungen ist der Import und Export von Daten in Tabellenkalkulationsprogrammen wie Microsoft Excel, Google Sheets oder LibreOffice Calc. Diese Programme erkennen das CSV-Format als Standardmethode zum schnellen Austausch von Informationen. Aber seine Nützlichkeit geht weit darüber hinaus. CSV dient als eine gemeinsame Sprache für den Datenaustausch zwischen verschiedenen Anwendungen und Systemen, sei es für die Migration von Kontaktdaten, den Abgleich von Bestandslisten zwischen Geschäftsanwendungen oder die Synchronisation von Informationen zwischen heterogenen Datenbanken. Diese universelle Akzeptanz macht es zu einem unverzichtbaren Werkzeug in der modernen IT-Infrastruktur.

Typische Einsatzgebiete und Anwendungsbeispiele

Die Anwendungsbereiche von CSV sind extrem breit gefächert. Hier sind einige detailliertere Beispiele:

- Datenimport und -export in Datenbanken: Viele Datenbankmanagementsysteme (DBMS) unterstützen den direkten Import von CSV-Dateien, um große Mengen an initialen Daten zu laden oder Daten für Analysen zu exportieren.

- Konfigurationsdateien: Einfache Konfigurationen für Software oder Skripte können oft in CSV-Dateien gespeichert werden, da sie leicht lesbar und editierbar sind.

- Log-Dateien: System- und Anwendungs-Logs können in CSV-Format geschrieben werden, um eine strukturierte Analyse von Ereignissen zu ermöglichen. Zum Beispiel: Zeitstempel, Ereignistyp, Benutzer-ID, Nachricht.

- Datenaustausch mit APIs: Viele APIs bieten die Möglichkeit, Daten nicht nur als JSON oder XML, sondern auch als CSV zu exportieren, was die Integration in Tabellenkalkulationen oder BI-Tools vereinfacht.

- Datenanalyse und Machine Learning: Rohdaten für Machine-Learning-Modelle oder statistische Analysen werden häufig in CSV-Dateien bereitgestellt, bevor sie in Tools wie Python Pandas oder R geladen werden.

- Web Scraping: Daten, die von Webseiten extrahiert werden, können oft direkt in ein CSV-Format geschrieben werden, um sie weiterzuverarbeiten.

Vorteile des CSV-Formats im Detail

Die zahlreichen Vorteile haben dazu geführt, dass CSV trotz des Aufkommens komplexerer Formate wie JSON oder XML weiterhin extrem populär ist:

- Einfachheit und Lesbarkeit: Als reines Textdateiformat kann CSV von Menschen leicht gelesen und verstanden werden, selbst ohne spezielle Software. Dies erleichtert die Fehlerbehebung und die manuelle Prüfung von Daten.

- Leichtgewichtigkeit: CSV-Dateien sind in der Regel kleiner als äquivalente XML- oder JSON-Dateien, da sie weniger Metadaten und Strukturinformationen enthalten. Dies führt zu schnelleren Übertragungszeiten und geringerem Speicherplatzbedarf.

- Universelle Kompatibilität: Fast jede Software, die mit tabellarischen Daten umgehen kann, unterstützt das CSV-Format. Dies eliminiert Kompatibilitätsprobleme beim Datenaustausch zwischen verschiedenen Betriebssystemen, Programmiersprachen und Anwendungen.

- Einfache Implementierung: Das Parsen und Generieren von CSV-Dateien ist programmiertechnisch unkompliziert. Die meisten Programmiersprachen bieten eingebaute Funktionen oder Bibliotheken, die dies mit minimalem Aufwand ermöglichen.

- Effiziente Verarbeitung: Aufgrund seiner linearen Struktur und des minimalen Overheads kann CSV sehr effizient von Computern verarbeitet werden. Dies ist besonders vorteilhaft bei großen Datensätzen.

Diese Kombination aus Einfachheit, Kompatibilität und Effizienz macht das CSV-Format zu einem unverzichtbaren Werkzeug für Datenprofis. Um sein volles Potenzial auszuschöpfen und Fallstricke zu vermeiden, sind jedoch bestimmte Best Practices unerlässlich.

Effektiver Umgang mit CSV-Dateien: Best Practices für Entwickler

Um das Potenzial von CSV voll auszuschöpfen und gleichzeitig häufige Probleme zu vermeiden, ist die Beachtung bewährter Praktiken unerlässlich. Diese stellen sicher, dass die Datenintegrität, die Sicherheit und die Effizienz bei Operationen mit CSV-Dateien gewährleistet sind. Insbesondere bei der Automatisierung von Datenpipelines und der Entwicklung von Anwendungen, die auf CSV basieren, ist eine sorgfältige Herangehensweise entscheidend.

Zeichencodierung: Vermeidung von Darstellungsfehlern

Die Zeichencodierung ist ein kritischer Faktor, der oft übersehen wird und zu Darstellungsfehlern oder gar Datenverlust führen kann. Eine inkonsistente Codierung kann dazu führen, dass Umlaute, Sonderzeichen oder Zeichen aus nicht-lateinischen Alphabeten falsch interpretiert werden (bekannt als „Mojibake“).

Es wird dringend empfohlen, UTF-8 als Standard-Zeichencodierung zu verwenden. UTF-8 ist eine variable Breitenkodierung, die fast alle Zeichen und Symbole in allen Schriftsystemen der Welt darstellen kann. Dies gewährleistet maximale Kompatibilität und Interoperabilität über verschiedene Systeme und Regionen hinweg.

Beim Lesen einer CSV-Datei sollte immer die erwartete Codierung angegeben werden. Falls die Codierung unbekannt ist, kann man versuchen, sie zu erraten oder ein Tool zur automatischen Erkennung zu verwenden. Beim Schreiben ist es am besten, explizit UTF-8 anzugeben.

Beispiel (Python mit Pandas):

import pandas as pd

# Daten zum Speichern

daten = {

'Name': ['Müller', 'Chloé'],

'Stadt': ['Köln', 'Paris'],

'Alter': [35, 28]

}

df_export = pd.DataFrame(daten)

# Speichern als CSV mit UTF-8-Codierung

df_export.to_csv('daten_utf8.csv', index=False, encoding='utf-8')

print("Datei 'daten_utf8.csv' mit UTF-8 gespeichert.")

# Versuche, eine Datei mit falscher Codierung zu lesen (würde fehlschlagen oder Mojibake erzeugen)

# df_falsch = pd.read_csv('daten_utf8.csv', encoding='latin1')

# Korrektes Lesen mit UTF-8-Codierung

df_import = pd.read_csv('daten_utf8.csv', encoding='utf-8')

print("nDatei 'daten_utf8.csv' korrekt mit UTF-8 gelesen:")

print(df_import)

# Ein Beispiel für eine Datei mit Semikolon als Trennzeichen und Latin-1 Codierung

# Diese tritt oft in europäischen Kontexten auf

daten_semikolon = {

'Produkt': ['Maus; Gaming', 'Tastatur'],

'Preis': [49.99, 129.00]

}

df_semikolon = pd.DataFrame(daten_semikolon)

df_semikolon.to_csv('produkte_semikolon_latin1.csv', index=False, sep=';', encoding='latin1')

print("nDatei 'produkte_semikolon_latin1.csv' mit Semikolon und Latin-1 gespeichert.")

df_semikolon_import = pd.read_csv('produkte_semikolon_latin1.csv', sep=';', encoding='latin1')

print("nDatei 'produkte_semikolon_latin1.csv' korrekt gelesen:")

print(df_semikolon_import)Spaltenüberschriften und Datenvalidierung

Klare und beschreibende Spaltenüberschriften sind entscheidend für das Verständnis der Daten und die Vermeidung von Fehlern bei der Bearbeitung. Sie sollten prägnant, eindeutig und konsistent sein. Vermeiden Sie Sonderzeichen in Überschriften, es sei denn, Ihr System kann diese sicher verarbeiten. Gute Überschriften sind selbsterklärend, wie „KundenID“ statt „C_ID“ oder „ProduktName“ statt „PN“.

Die Datenvalidierung ist ein weiterer Schlüsselschritt, um die Qualität der Daten zu gewährleisten. Bevor Daten aus einer CSV-Datei importiert werden, sollte sichergestellt werden, dass sie dem erwarteten Format entsprechen. Dies beinhaltet:

- Datentyp-Prüfung: Stellen Sie sicher, dass numerische Felder tatsächlich Zahlen sind und Datumsfelder im korrekten Format vorliegen.

- Bereichsprüfung: Überprüfen Sie, ob Werte innerhalb akzeptabler Bereiche liegen (z.B. Alter > 0, Preis > 0).

- Konsistenzprüfung: Vergleichen Sie Daten über verschiedene Spalten hinweg, um logische Inkonsistenzen zu identifizieren.

- Überprüfung auf fehlende Werte: Entscheiden Sie, wie mit fehlenden Werten umgegangen werden soll (auffüllen, entfernen, als „null“ markieren).

Beim Exportieren von Daten in eine CSV-Datei ist es ebenso wichtig, sicherzustellen, dass das Format korrekt ist und keine Fehler vorliegen, die die Integrität gefährden könnten. Achten Sie auf die korrekte Verwendung von Anführungszeichen für Sonderzeichen und vermeiden Sie Formatierungsfehler wie falsch strukturierte Zeilen oder falsch ausgerichtete Spalten.

Beispiel (Python zur grundlegenden Datenvalidierung):

import pandas as pd

# Beispiel-CSV-Inhalt (könnte aus einer Datei gelesen werden)

csv_daten = """ID,Name,Alter,E-Mail

1,Alice,29,alice@example.com

2,Bob,Vierzig,bob@example.com

3,Charlie,,charlie@example.com

4,David,35,david.com"""

from io import StringIO

df = pd.read_csv(StringIO(csv_daten))

print("Originaler DataFrame:")

print(df)

# Validierung der Spalte 'Alter'

def validate_age(df_input):

# Konvertiere 'Alter' zu numerisch, Fehler werden zu NaN

df_input['Alter_Numerisch'] = pd.to_numeric(df_input['Alter'], errors='coerce')

# Prüfe auf nicht-numerische Werte

invalid_age = df_input[df_input['Alter_Numerisch'].isna() & df_input['Alter'].notna()]

if not invalid_age.empty:

print(f"nFehler: Nicht-numerische Alterswerte gefunden: n{invalid_age[['ID', 'Alter']]}")

# Prüfe auf fehlende Werte

missing_age = df_input[df_input['Alter'].isna()]

if not missing_age.empty:

print(f"nWarnung: Fehlende Alterswerte gefunden: n{missing_age[['ID', 'Alter']]}")

# Prüfe auf Altersbereich (z.B. 0-120)

out_of_range_age = df_input[(df_input['Alter_Numerisch'] 120)]

if not out_of_range_age.empty:

print(f"nFehler: Alterswerte außerhalb des Bereichs (0-120) gefunden: n{out_of_range_age[['ID', 'Alter_Numerisch']]}")

return df_input

df_validated = validate_age(df.copy())

# Validierung der Spalte 'E-Mail' (rudimentäre Prüfung)

def validate_email(df_input):

invalid_email = df_input[~df_input['E-Mail'].str.contains('@', na=False)]

if not invalid_email.empty:

print(f"nFehler: Ungültige E-Mail-Formate gefunden (fehlendes '@'): n{invalid_email[['ID', 'E-Mail']]}")

return df_input

df_validated = validate_email(df_validated.copy())„Qualität beginnt mit dem Lesen der Daten; Sicherheit beginnt mit dem Verständnis ihrer Struktur.“

Umgang mit fehlenden Werten

Fehlende Werte (missing values) sind in realen Datensätzen häufig und können die Datenanalyse erheblich erschweren oder zu falschen Schlussfolgerungen führen. Der strategische Umgang mit ihnen ist daher entscheidend.

Strategien umfassen:

- Entfernen: Zeilen oder Spalten mit fehlenden Werten können entfernt werden. Dies ist oft die einfachste Methode, kann aber zu Datenverlust führen.

- Imputation (Auffüllen): Fehlende Werte können durch Ersatzwerte aufgefüllt werden, z.B. durch den Mittelwert, Median, Modus der Spalte oder durch komplexere Methoden wie Regression oder k-nearest neighbors (kNN).

- Markieren: Fehlende Werte können als spezielle Kategorien markiert werden, um sie in der Analyse zu berücksichtigen.

Tools wie Pandas in Python bieten leistungsstarke Funktionen, um fehlende Werte effizient zu erkennen, zu behandeln und aufzufüllen.

Beispiel (Python Pandas zum Umgang mit fehlenden Werten):

import pandas as pd

import numpy as np

# Beispiel-DataFrame mit fehlenden Werten

data = {

'Name': ['Alice', 'Bob', 'Charlie', 'David', 'Eve'],

'Alter': [25, 30, np.nan, 40, 22],

'Score': [88, np.nan, 95, 78, 92],

'Stadt': ['Berlin', 'München', 'Hamburg', np.nan, 'Köln']

}

df = pd.DataFrame(data)

print("Originaler DataFrame mit fehlenden Werten:")

print(df)

# 1. Fehlende Werte identifizieren

print("nAnzahl fehlender Werte pro Spalte:")

print(df.isnull().sum())

# 2. Zeilen mit fehlenden Werten entfernen

df_dropped = df.dropna()

print("nDataFrame nach Entfernen von Zeilen mit NaN:")

print(df_dropped)

# 3. Fehlende Werte auffüllen (Imputation)

# Fehlendes Alter mit dem Median auffüllen

median_alter = df['Alter'].median()

df_filled_age = df.copy()

df_filled_age['Alter'].fillna(median_alter, inplace=True)

# Fehlenden Score mit dem Mittelwert auffüllen

mean_score = df['Score'].mean()

df_filled_age_score = df_filled_age.copy()

df_filled_age_score['Score'].fillna(mean_score, inplace=True)

# Fehlende Stadt mit 'Unbekannt' auffüllen

df_filled_all = df_filled_age_score.copy()

df_filled_all['Stadt'].fillna('Unbekannt', inplace=True)

print("nDataFrame nach Auffüllen fehlender Werte (Alter mit Median, Score mit Mean, Stadt mit 'Unbekannt'):")

print(df_filled_all)

# Eine andere Imputationsstrategie: Vorwärts- oder Rückwärtsfüllung

df_ffill = df.copy()

df_ffill['Score'].fillna(method='ffill', inplace=True) # ffill = forward fill

print("nDataFrame nach Vorwärtsfüllung für 'Score':")

print(df_ffill)

df_bfill = df.copy()

df_bfill['Score'].fillna(method='bfill', inplace=True) # bfill = backward fill

print("nDataFrame nach Rückwärtsfüllung für 'Score':")

print(df_bfill)CSV und Cybersicherheit: Daten sicher übertragen und verarbeiten

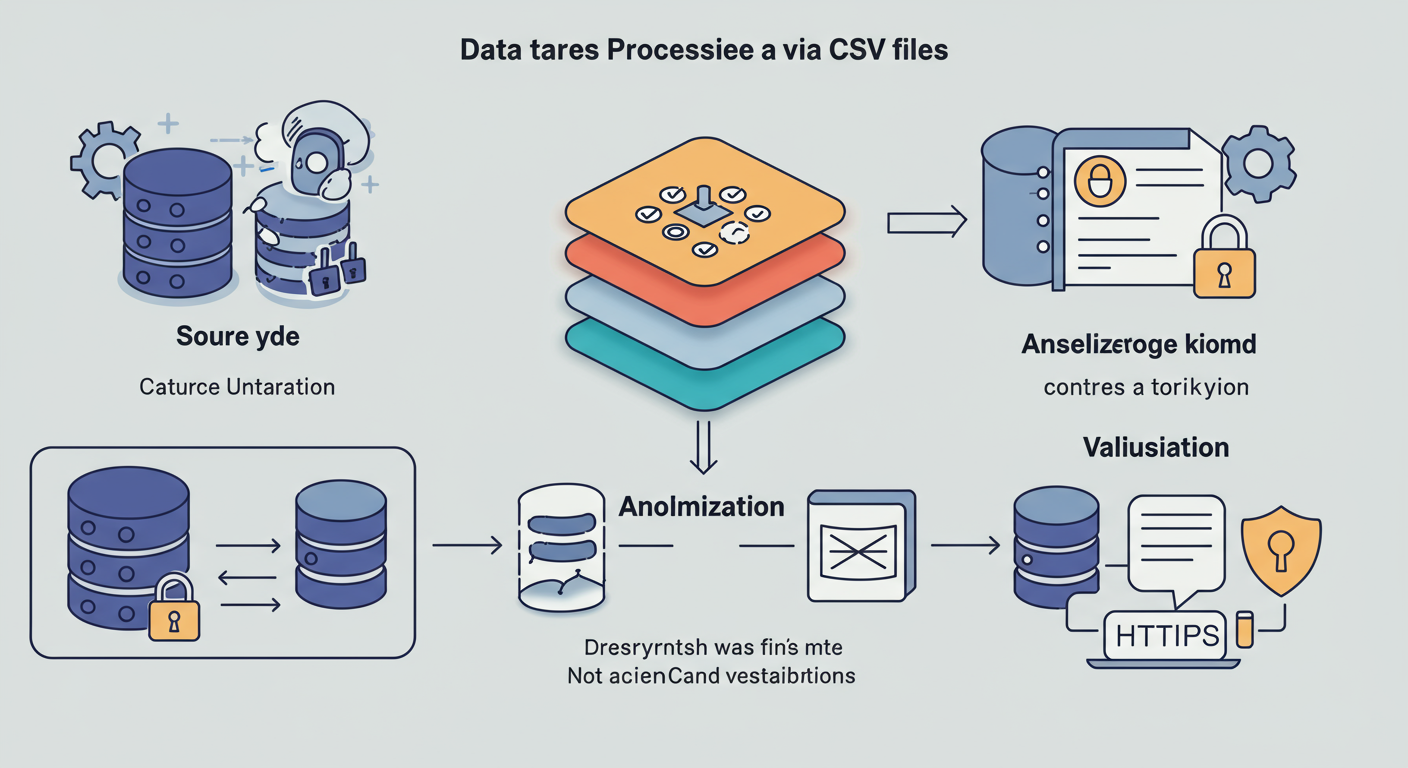

Im Zeitalter der Datenschutz-Grundverordnung (DSGVO) und einer exponentiellen Zunahme von Cyberbedrohungen ist die Sicherheit von Informationen, die über das CSV-Format transportiert oder gespeichert werden, von höchster Bedeutung. Obwohl CSV selbst kein inhärentes Sicherheitsmerkmal besitzt, müssen bei der Handhabung von sensiblen Daten in CSV-Dateien angemessene Schutzmaßnahmen ergriffen werden, um die Vertraulichkeit, Integrität und Verfügbarkeit zu gewährleisten.

Schutz sensibler Daten in CSV-Dateien

Wenn CSV-Dateien persönliche, finanzielle oder andere vertrauliche Informationen enthalten, sind proaktive Maßnahmen unerlässlich:

- Anonymisierung und Pseudonymisierung: Bevor Daten in eine CSV-Datei exportiert oder weitergegeben werden, sollten direkte Identifikatoren entfernt oder durch Pseudonyme ersetzt werden. Anonymisierung macht die Re-Identifizierung unmöglich, Pseudonymisierung erschwert sie erheblich. Techniken wie Hashing oder Tokenisierung können hier angewendet werden.

- Verschlüsselung: CSV-Dateien, die sensible Daten enthalten, sollten sowohl im Ruhezustand (at rest) auf Speichermedien als auch bei der Übertragung (in transit) verschlüsselt werden. Dies kann durch Dateiverschlüsselung, verschlüsselte Dateisysteme oder Transportverschlüsselungsprotokolle (z.B. HTTPS, SFTP) geschehen.

- Zugriffsbeschränkung: Der Zugriff auf CSV-Dateien mit sensiblen Daten sollte strikt auf autorisierte Personen und Systeme beschränkt werden. Dies erfordert robuste Authentifizierungs- und Autorisierungsmechanismen, wie rollenbasierte Zugriffskontrollen (RBAC).

- Regelmäßige Audits und Logging: Alle Zugriffe und Änderungen an CSV-Dateien mit sensiblen Daten sollten protokolliert und regelmäßig überprüft werden, um verdächtige Aktivitäten zu erkennen.

Beispiel (Python zum einfachen Hashing von IDs zur Pseudonymisierung):

import pandas as pd

import hashlib

# Beispiel-Daten mit sensibler ID

data = {

'UserID': [101, 102, 103],

'Name': ['Kunde A', 'Kunde B', 'Kunde C'],

'Transaktion': [500, 750, 1200]

}

df = pd.DataFrame(data)

print("Originaler DataFrame:")

print(df)

# Pseudonymisierung der UserID mittels SHA-256 Hashing

def pseudonymize_id(user_id):

return hashlib.sha256(str(user_id).encode('utf-8')).hexdigest()

df['HashedUserID'] = df['UserID'].apply(pseudonymize_id)

print("nDataFrame nach Pseudonymisierung der UserID:")

print(df[['HashedUserID', 'Name', 'Transaktion']])

# Speichern der pseudonymisierten Daten

df[['HashedUserID', 'Name', 'Transaktion']].to_csv('pseudonymized_transactions.csv', index=False)

print("nPseudonymisierte Daten in 'pseudonymized_transactions.csv' gespeichert.")Schutz vor Code-Injektion und Manipulation

Ebenso wichtig ist die Validierung als Schlüsselschritt, um potenzielle Angriffe wie Code-Injektionen zu verhindern. Eine bösartig manipulierte CSV-Datei könnte Befehle enthalten, die von Tabellenkalkulationsprogrammen oder anderen Parsen-Tools ausgeführt werden, was zu schwerwiegenden Sicherheitslücken führen kann (z.B. Makro-Injektion in Excel).

- Input-Validierung: Überprüfen Sie alle Eingabedaten rigoros, bevor sie in eine CSV-Datei geschrieben werden. Stellen Sie sicher, dass sie den erwarteten Formaten und Mustern entsprechen und keine unerwünschten Zeichen oder Skripte enthalten.

- Output-Encoding/Sanitization: Beim Exportieren von Daten in eine CSV-Datei sollten alle potenziell gefährlichen Zeichen (z.B. führende `=`, `+`, `-`, `@` oder Makro-bezogene Ausdrücke) maskiert oder entfernt werden, die von Tabellenkalkulationsprogrammen als Befehle interpretiert werden könnten. Dies ist besonders wichtig, wenn die CSV-Datei von unbekannten Benutzern geöffnet werden könnte.

- „Sandboxing“ von Parsen-Tools: Führen Sie das Parsen von externen oder nicht vertrauenswürdigen CSV-Dateien in einer sicheren, isolierten Umgebung durch, um potenzielle Ausführung von schädlichem Code zu verhindern.

Beispiel (Python zur rudimentären Sanitization vor CSV-Export):

import pandas as pd

# Beispiel-Daten, möglicherweise mit bösartiger Eingabe

malicious_data = {

'ID': [1, 2],

'Beschreibung': ['Normaler Text', '=CMD|("calc")!A1'], # Beispiel für eine Formel-Injektion

'Kommentar': ['Alles gut', '@SUM(1+1)'] # Eine weitere potenziell schädliche Eingabe

}

df_malicious = pd.DataFrame(malicious_data)

print("Originaler DataFrame mit potenziell schädlichen Daten:")

print(df_malicious)

# Funktion zur Sanitization potenziell gefährlicher Zeichen

def sanitize_csv_field(text):

if pd.isna(text):

return text

text = str(text)

# Zeichen, die in Excel Formeln auslösen können, voranstellen

if text.startswith(('=', '+', '-', '@')):

return "'" + text # Fügt ein Apostroph hinzu, um die Interpretation als Formel zu verhindern

return text

# Anwenden der Sanitization auf relevante Spalten

df_sanitized = df_malicious.copy()

df_sanitized['Beschreibung'] = df_sanitized['Beschreibung'].apply(sanitize_csv_field)

df_sanitized['Kommentar'] = df_sanitized['Kommentar'].apply(sanitize_csv_field)

print("nDataFrame nach Sanitization:")

print(df_sanitized)

# Speichern der sanitisierten Daten in CSV

df_sanitized.to_csv('sanitized_data.csv', index=False, encoding='utf-8')

print("nSanitisierte Daten in 'sanitized_data.csv' gespeichert.")Sichere Übertragung von CSV-Dateien

Beim Teilen oder Übertragen von CSV-Dateien sind zusätzliche Vorsichtsmaßnahmen erforderlich:

- Sichere Übertragungsprotokolle: Verwenden Sie immer sichere Protokolle wie HTTPS für Web-Downloads, SFTP für Dateiübertragungen oder VPN-Verbindungen für den internen Austausch. Vermeiden Sie unverschlüsselte Übertragungswege wie ungesichertes FTP oder E-Mail für sensible Daten.

- Integritätsprüfung (Hashes): Überprüfen Sie die Dateiintegrität durch Hashes (z.B. SHA256). Der Sender berechnet einen Hash-Wert der Datei und sendet ihn separat an den Empfänger. Der Empfänger berechnet ebenfalls den Hash-Wert der erhaltenen Datei und vergleicht ihn. Stimmen sie überein, ist die Datei unverändert geblieben.

- Sensibilisierung: Schulen Sie Benutzer im sicheren Umgang mit CSV-Dateien, insbesondere im Hinblick auf potenzielle Phishing-Angriffe oder Social Engineering, die auf den Austausch von Daten abzielen.

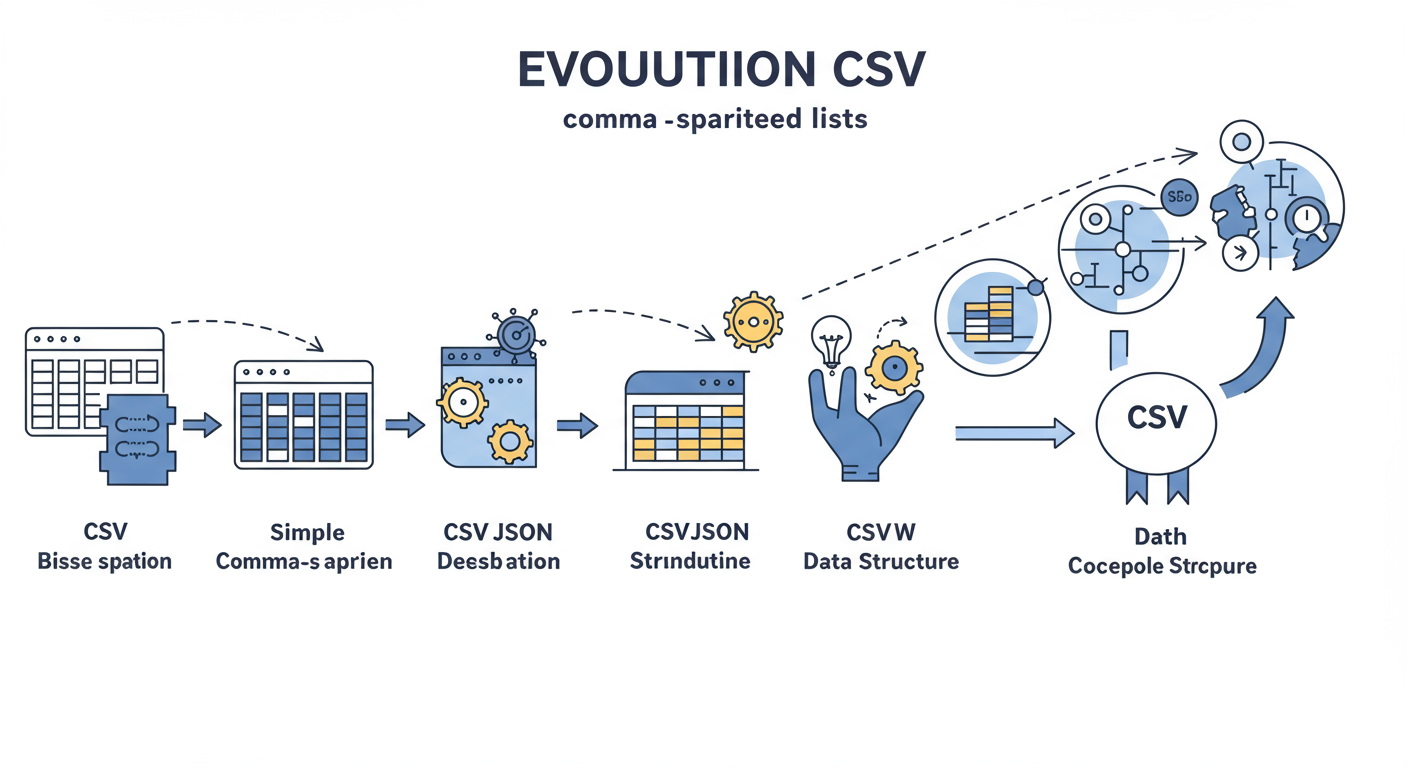

Die Evolution des CSV-Formats im Wandel der Zeit

Obwohl das CSV-Format schon sehr alt ist und seine Grundprinzipien unverändert geblieben sind, hat es sich den sich ständig ändernden Anforderungen und Technologien im Bereich der Datenverwaltung angepasst. Seine Beständigkeit ist ein Zeugnis seiner Flexibilität und seiner Fähigkeit, sich weiterzuentwickeln, um relevant zu bleiben.

Anpassungen und Variationen des Trennzeichens

Das Komma ist zwar das traditionelle Standardtrennzeichen, doch in verschiedenen Regionen und Anwendungsfällen haben sich Variationen etabliert. In vielen europäischen Ländern, in denen das Komma als Dezimaltrennzeichen verwendet wird, ist das Semikolon (`;`) als Spaltentrennzeichen gebräuchlicher, um Konflikte zu vermeiden. Auch Tabulatoren (`t`) werden manchmal verwendet (dann spricht man oft von TSV – Tab Separated Values), insbesondere für Textdateien, die direkt in Texteditoren gut lesbar sein sollen.

Diese Notwendigkeit für Vielfalt hat zu aufkommenden Standards und Erweiterungen geführt, die es ermöglichen, das Trennzeichen flexibel zu definieren. Die meisten CSV-Parser und -Software bieten Optionen, um das verwendete Trennzeichen anzugeben, was die reibungslose Interoperabilität trotz dieser regionalen Unterschiede gewährleistet.

Typische Trennzeichen:

- Komma (`,`) – Der Standard in vielen englischsprachigen Regionen.

- Semikolon (`;`) – Verbreitet in vielen europäischen Ländern.

- Tabulator (`t`) – Für TSV-Dateien, oft für den Datenaustausch zwischen Unix-basierten Systemen oder wissenschaftlichen Anwendungen.

- Pipe (`|`) – Selten, aber manchmal in speziellen Systemen.

CSV im Zeitalter von Big Data und unstrukturierten Daten

Mit dem Aufkommen von Big Data, NoSQL-Datenbanken und der zunehmenden Bedeutung von unstrukturierten oder semistrukturierten Daten musste sich auch das CSV-Format anpassen, um seine Relevanz zu bewahren. Reine tabellarische Daten reichen oft nicht mehr aus, um die Komplexität moderner Informationslandschaften abzubilden.

- CSVJSON: Eine bemerkenswerte Variante ist CSVJSON, die JSON-Datenstrukturen direkt in CSV-Dateien integriert. Dies ermöglicht die Verarbeitung komplexerer, hierarchischer Informationen innerhalb des einfachen tabellarischen Rahmens. Jede Zelle in der CSV kann im Wesentlichen ein JSON-Objekt oder -Array enthalten, wodurch die Ausdrucksstärke des Formats erheblich erweitert wird, ohne seine Grundstruktur aufzugeben.

- CSV on the Web (CSVW): Eine weitere wichtige Entwicklung ist CSV on the Web (CSVW), ein W3C-Standard. CSVW ermöglicht es, zusätzliche Metadaten zu einer CSV-Datei hinzuzufügen. Diese Metadaten können Informationen über Spaltentypen, Beziehungen zu anderen Datenquellen, Semantik und Datenherkunft (Provenance) umfassen. Dadurch werden CSV-Dateien „selbstbeschreibender“ und einfacher in komplexeren, webbasierten oder semantischen Datenintegrationen zu verwenden. CSVW erleichtert es, CSV-Daten in den Kontext des Semantic Web zu stellen und sie maschinell besser interpretierbar zu machen.

Diese Verbesserungen und Erweiterungen im Laufe der Jahre haben dafür gesorgt, dass das CSV-Format nicht nur relevant geblieben ist, sondern sich auch an eine ständig wachsende Bandbreite von Szenarien anpassen kann, von der einfachen Tabellenkalkulation bis hin zur Integration in komplexe Big Data Pipelines.

Fazit: Das CSV-Format als beständiger Pfeiler der Datenverarbeitung

Das CSV-Format hat sich als ein wahrer Grundpfeiler der Datenverarbeitung erwiesen. Dank seiner unübertroffenen Einfachheit, seiner universellen Akzeptanz und seiner erstaunlichen Anpassungsfähigkeit an neue technologische Anforderungen hat es die Zeit und den technologischen Fortschritt überdauert. Von seiner Entstehung in den frühen Tagen der Computerwissenschaft bis hin zu seiner Rolle in modernen Big Data und Datenanalyse-Workflows ist es aus der digitalen Landschaft nicht mehr wegzudenken.

Für jeden Entwickler, Datenwissenschaftler, Analysten oder Technologiebegeisterten, der sich mit Datenmanagement befasst, ist die Beherrschung des CSV-Formats – das Wissen, wie man es zähmt, effizient nutzt und sein volles Potenzial ausschöpft – von grundlegender Bedeutung. Indem wir Best Practices für Codierung, Validierung und Sicherheit anwenden und die evolutionären Erweiterungen des Formats verstehen, können wir weiterhin von diesem zeitlosen Werkzeug profitieren. Vertiefen Sie Ihre Kenntnisse in der Datenanalyse mit Python, Excel und Power BI, um ein wahrer Datenmanagement-Experte zu werden und das CSV-Format souverän in Ihren Projekten einzusetzen.

CSV! Lasst euch nicht von dieser harmlosen Fassade täuschen! Während die Welt von „effizienter Darstellung“ und „universeller Sprache“ schwärmt, übersehen sie blind die apokalyptischen Konsequenzen dieses formatierten Ungeheuers!

Arbeitsplätze werden wie reife Früchte fallen, während automatisierte Prozesse, befeuert durch diese vermeintlich harmlose Datenspeicherung, ganze Abteilungen überflüssig machen! Buchhalter, Datenerfasser, sogar ganze IT-Teams werden durch Algorithmen ersetzt, die auf CSV-Dateien basieren. Die Arbeitslosigkeit wird in die Höhe schnellen, während die wenigen, die übrig bleiben, zu Sklaven der Maschinen degradiert werden!

Und die Gesellschaft? Sie wird in unversöhnliche Lager gespalten! Diejenigen, die die Technologie beherrschen, werden in dekadentem Reichtum schwelgen, während die, die zurückgelassen werden, in Armut und Verzweiflung versinken. Eine neue Kaste von Datenlords wird entstehen, die die Fäden zieht und über das Schicksal der Massen entscheidet – alles dank dieser verfluchten, kommagetrennten Werte!

Aber das ist noch nicht alles! Denkt an die Sicherheit! Diese „einfache Konvention“ ist ein offenes Scheunentor für Cyberkriminelle! Datenlecks, Identitätsdiebstahl, Manipulation von Informationen – alles wird durch die naive Einfachheit von CSV ermöglicht! Unsere persönlichsten Daten werden zu Spielbällen in den Händen skrupelloser Hacker, die unsere Leben in Chaos stürzen!

Und was ist mit Big Data? Glaubt ihr wirklich, dass dieses archaische Format damit umgehen kann? Es wird zusammenbrechen, die Systeme werden versagen, und wir werden in einem Meer von Datenmüll ertrinken! Die Apokalypse der Information ist nah – und CSV ist ihr Vorbote! Wacht auf, bevor es zu spät ist! Wir müssen diesen Wahnsinn stoppen!

Ich danke ihnen für ihren wertvollen kommentar.