Die rapide Entwicklung von Big Data und künstlicher Intelligenz hat die Landschaft der Datenanalyse und des maschinellen Lernens revolutioniert. Heute verlassen sich Data Scientists zunehmend auf hochentwickelte Modellierungsansätze, um komplexe Muster in Daten zu erkennen und robuste vorausschauende Analysen durchzuführen. Unter diesen Methoden sticht eine Technik besonders hervor: das Ensembling in Machine Learning. Es handelt sich hierbei nicht um ein einzelnes Modell, sondern um eine Strategie, die die Stärken mehrerer Modelle bündelt, um deren individuelle Schwächen auszugleichen und so wesentlich zuverlässigere und relevantere Ergebnisse zu erzielen.

Dieser Artikel taucht tief in das Konzept des Ensembling ein, erklärt seine Funktionsweise anhand von Beispielen für populäre Algorithmen wie Bagging, Boosting und Stacking, und beleuchtet die entscheidenden Vorteile sowie die bestehenden Grenzen dieser leistungsstarken Technik. Entwickler, Studierende und Technologiebegeisterte, die nach tiefergehenden Informationen zur Optimierung von Vorhersagemodellen suchen, erhalten hier einen umfassenden Überblick und praktische Einblicke in die Anwendung von Ensemble-Methoden für die Entwicklung hochperformanter Machine Learning-Lösungen.

Grundlagen des Ensembling: Was ist das Konzept?

Im Kern ist Ensembling eine Technik, bei der mehrere individuelle Machine-Learning-Modelle trainiert und ihre Vorhersagen systematisch kombiniert werden, um eine einzige, oft genauere und stabilere Vorhersage zu generieren. Die Idee dahinter ist analog zur „Weisheit der Vielen“: Eine Gruppe von diversen Experten trifft in der Regel bessere Entscheidungen als ein einzelner Spezialist. Im Kontext des Machine Learning bedeutet dies, dass die Kombination der „Meinungen“ verschiedener Algorithmen, die jeweils unterschiedliche Aspekte der Daten lernen oder unterschiedliche Lernparadigmen verfolgen, zu einer signifikanten Verbesserung der Gesamtleistung führen kann.

Ein einzelnes Modell kann spezifische Schwächen aufweisen, sei es durch Überanpassung (Overfitting) an die Trainingsdaten, eine hohe Varianz bei geringfügigen Datenänderungen oder einen hohen Bias, der es daran hindert, die zugrundeliegende Beziehung in den Daten zu erfassen. Durch die Aggregation der Ergebnisse mehrerer Modelle können diese individuellen Mängel gemildert werden. Dies führt zu einer Reduzierung des Gesamtfehlers des Systems und zu einer erhöhten Robustheit gegenüber unbekannten Daten. Es ist eine beliebte Strategie, um die Präzision von Vorhersagemodellen zu steigern und gleichzeitig die Generalisierungsfähigkeit zu verbessern.

Detaillierte Funktionsweise von Ensembling-Techniken

Die Implementierung von Ensembling-Methoden basiert darauf, dass jedes Lernmodell große Datenmengen nutzt, um relevante Ergebnisse zu erzielen. Der Schlüssel liegt in der geschickten Auswahl und Kombination dieser Modelle sowie in der Berücksichtigung des Bias-Varianz-Dilemmas. Je nach gewünschtem Effekt auf Bias und Varianz gibt es verschiedene Haupttechniken:

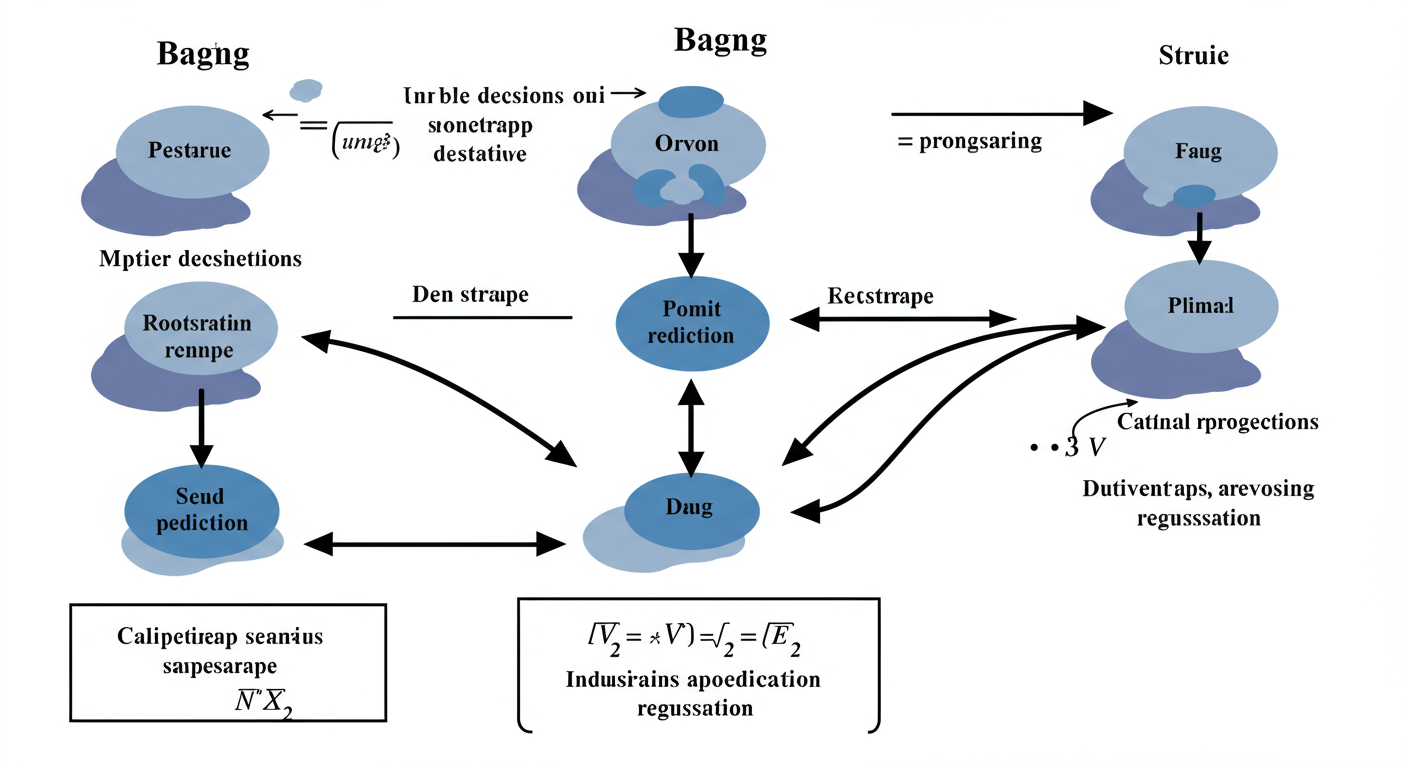

Bagging: Reduzierung der Varianz durch Parallelisierung

Bagging, kurz für „Bootstrap Aggregating“, ist eine Ensemble-Technik, die darauf abzielt, die Varianz von Modellen zu reduzieren. Bei dieser Methode werden mehrere Versionen eines Basis-Lernalgorithmus parallel auf unterschiedlichen Stichproben des Trainingsdatensatzes trainiert. Jede dieser Stichproben wird durch „Bootstrapping“ erzeugt, d.h., durch Ziehen mit Zurücklegen aus dem ursprünglichen Datensatz. Dies führt dazu, dass die einzelnen Modelle auf leicht unterschiedlichen Daten trainiert werden und somit unterschiedliche Fehler und Stärken entwickeln.

Nach dem Training treffen alle individuellen Modelle ihre Vorhersagen unabhängig voneinander. Für Klassifikationsprobleme wird die endgültige Vorhersage durch Mehrheitsentscheidung (Voting) getroffen, während bei Regressionsproblemen der Durchschnitt der einzelnen Vorhersagen gebildet wird. Random Forests sind ein Paradebeispiel für eine Bagging-Methode, bei der eine große Anzahl von Entscheidungsbäumen trainiert wird, die auf gebootstrappten Stichproben der Daten und einer zufälligen Auswahl von Features basieren.

„Das Geniale an Bagging ist, dass es aus vielen schwachen Lernern, die jeweils kleine Fehler machen, einen robusten Lerner schafft, der signifikant präziser ist.“

Hier ist ein einfaches Python-Codebeispiel, das Bagging mit einem Entscheidungsbaum als Basis-Estimator demonstriert:

import numpy as np

from sklearn.ensemble import BaggingClassifier

from sklearn.tree import DecisionTreeClassifier

from sklearn.datasets import make_classification

from sklearn.model_selection import train_test_split

from sklearn.metrics import accuracy_score

# Beispiel-Datensatz generieren

X, y = make_classification(n_samples=1000, n_features=10, n_informative=5,

n_redundant=0, random_state=42)

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3, random_state=42)

# Basis-Estimator definieren (Entscheidungsbaum)

base_estimator = DecisionTreeClassifier(random_state=42)

# Bagging Classifier initialisieren und trainieren

# n_estimators: Anzahl der Basis-Estimators (Bäume)

# max_samples: Anzahl der Samples pro Basis-Estimator

# bootstrap: Samples mit Zurücklegen ziehen

bagging_model = BaggingClassifier(estimator=base_estimator,

n_estimators=10,

max_samples=0.7, # 70% der Trainingsdaten für jeden Baum

bootstrap=True,

random_state=42)

bagging_model.fit(X_train, y_train)

# Vorhersagen treffen und Genauigkeit bewerten

y_pred_bagging = bagging_model.predict(X_test)

accuracy_bagging = accuracy_score(y_test, y_pred_bagging)

print(f"Genauigkeit des Bagging-Modells: {accuracy_bagging:.4f}")

# Zum Vergleich: Einzelner Entscheidungsbaum

single_tree_model = DecisionTreeClassifier(random_state=42)

single_tree_model.fit(X_train, y_train)

y_pred_single = single_tree_model.predict(X_test)

accuracy_single = accuracy_score(y_test, y_pred_single)

print(f"Genauigkeit eines einzelnen Entscheidungsbaums: {accuracy_single:.4f}")

Boosting: Verringerung des Bias durch sequentielle Verbesserung

Boosting ist eine weitere populäre Ensemble-Methode, die im Gegensatz zu Bagging darauf abzielt, den Bias eines Modells zu verringern. Dies geschieht durch einen sequentiellen Ansatz: Modelle werden nacheinander trainiert, wobei jedes neue Modell versucht, die Fehler des vorhergehenden Modells zu korrigieren. Die Aufmerksamkeit wird dabei verstärkt auf jene Datenpunkte gelenkt, die von den bisherigen Modellen falsch klassifiziert oder schlecht vorhergesagt wurden.

Diesem iterativen Prozess liegt die Idee zugrunde, dass schwache Lerner (Modelle, die etwas besser sind als reines Raten) kombiniert werden können, um einen starken Lerner zu bilden. Bekannte Boosting-Algorithmen sind AdaBoost (Adaptive Boosting), Gradient Boosting Machines (GBM), XGBoost, LightGBM und CatBoost. Diese Algorithmen unterscheiden sich in der Art und Weise, wie sie die Fehler des vorherigen Modells identifizieren und wie sie die Gewichte der Datenpunkte anpassen oder Gradienten minimieren.

Ein Beispiel für Boosting mit AdaBoost:

from sklearn.ensemble import AdaBoostClassifier

from sklearn.tree import DecisionTreeClassifier

from sklearn.datasets import make_classification

from sklearn.model_selection import train_test_split

from sklearn.metrics import accuracy_score

# Beispiel-Datensatz generieren

X, y = make_classification(n_samples=1000, n_features=10, n_informative=5,

n_redundant=0, random_state=42)

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3, random_state=42)

# Basis-Estimator definieren (oft ein "flacher" Entscheidungsbaum, z.B. mit max_depth=1 für AdaBoost)

base_estimator_ada = DecisionTreeClassifier(max_depth=1, random_state=42)

# AdaBoost Classifier initialisieren und trainieren

# n_estimators: Anzahl der sequenziellen Lerner

ada_model = AdaBoostClassifier(estimator=base_estimator_ada,

n_estimators=50,

random_state=42)

ada_model.fit(X_train, y_train)

# Vorhersagen treffen und Genauigkeit bewerten

y_pred_ada = ada_model.predict(X_test)

accuracy_ada = accuracy_score(y_test, y_pred_ada)

print(f"Genauigkeit des AdaBoost-Modells: {accuracy_ada:.4f}")

Stacking: Meta-Lernen für verbesserte Genauigkeit

Stacking, auch bekannt als Stacked Generalization, ist eine fortgeschrittenere Ensemble-Methode, die darauf abzielt, die Genauigkeit zu verbessern und gleichzeitig sowohl Varianz als auch Bias niedrig zu halten. Im Gegensatz zu Bagging und Boosting, die oft homogene Basis-Modelle verwenden (z.B. nur Entscheidungsbäume), erlaubt Stacking die Kombination heterogener Modelle.

Die grundlegende Idee ist, dass ein „Meta-Lernmodell“ (oder auch „Zweitstufen-Modell“) darauf trainiert wird, die Vorhersagen anderer Basis-Modelle (die „Erststufen-Modelle“) zu kombinieren. Die Basis-Modelle werden zunächst auf den Trainingsdaten trainiert, und ihre Vorhersagen auf einem Validierungsset (oder durch Kreuzvalidierung erzeugte Out-of-Fold-Vorhersagen) dienen als neue Features für das Meta-Lernmodell. Dieses Meta-Lernmodell lernt dann, wie die Vorhersagen der Basis-Modelle am besten zu gewichten oder zu kombinieren sind.

Stacking ist besonders nützlich, wenn die Basis-Modelle unterschiedliche Stärken und Schwächen haben und komplementäre Informationen aus den Daten extrahieren. Ein üblicher Ansatz ist beispielsweise die Verwendung von Support Vector Machines, k-Nearest Neighbors und Random Forests als Erststufen-Modelle und einer logistischen Regression als Zweitstufen-Modell.

Hier ist ein Beispiel für Stacking mit `StackingClassifier` aus `scikit-learn`:

from sklearn.ensemble import StackingClassifier

from sklearn.linear_model import LogisticRegression

from sklearn.svm import SVC

from sklearn.neighbors import KNeighborsClassifier

from sklearn.tree import DecisionTreeClassifier

from sklearn.datasets import make_classification

from sklearn.model_selection import train_test_split

from sklearn.metrics import accuracy_score

# Beispiel-Datensatz generieren

X, y = make_classification(n_samples=1000, n_features=10, n_informative=5,

n_redundant=0, random_state=42)

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3, random_state=42)

# Erststufen-Modelle (Basis-Estimators)

estimators = [

('dt', DecisionTreeClassifier(random_state=42)),

('knn', KNeighborsClassifier(n_neighbors=5)),

('svc', SVC(random_state=42, probability=True)) # probability=True für predict_proba

]

# Zweitstufen-Modell (Meta-Estimator)

meta_estimator = LogisticRegression(random_state=42)

# Stacking Classifier initialisieren und trainieren

# cv: Anzahl der Folds für die Kreuzvalidierung der Basis-Modelle

stacking_model = StackingClassifier(estimators=estimators,

final_estimator=meta_estimator,

cv=5,

passthrough=False) # Keine originalen Features an Meta-Estimator

stacking_model.fit(X_train, y_train)

# Vorhersagen treffen und Genauigkeit bewerten

y_pred_stacking = stacking_model.predict(X_test)

accuracy_stacking = accuracy_score(y_test, y_pred_stacking)

print(f"Genauigkeit des Stacking-Modells: {accuracy_stacking:.4f}")

Es ist wichtig zu verstehen, dass die Kombination mehrerer Modelle zwar zu zuverlässigeren Vorhersagen führt, die Anzahl der Modelle jedoch nicht unbegrenzt sein sollte. Ein zu großes Ensemble kann die Trainingskosten exponentiell erhöhen und ab einem bestimmten Punkt zu einer schlechteren Leistung oder zu nur marginalen Verbesserungen führen, die den Mehraufwand nicht rechtfertigen. Die optimale Balance liegt oft zwischen 3 und 10 Modellen, je nach Komplexität des Problems und der Divergenz der Einzelmodelle.

Vorteile von Ensembling-Methoden in der Datenanalyse

Ensembling ist aus gutem Grund eine der am häufigsten verwendeten Techniken im modernen Machine Learning. Es bietet Datenexperten eine Vielzahl von Vorteilen, die über die Leistung einzelner Modelle hinausgehen:

- Erhöhte Genauigkeit: Dies ist der primäre Vorteil. Ensemble-Modelle liefern im Allgemeinen bessere Ergebnisse als jedes einzelne Modell, das Teil des Ensembles ist. Die kollektive Intelligenz der Modelle führt zu einer Reduzierung des Fehlers und einer höheren Übereinstimmung mit den tatsächlichen Werten. Die Verbesserungen können mit der Größe und Diversität des Ensembles zunehmen, solange ein sinnvolles Gleichgewicht gewahrt wird.

- Verbesserte Robustheit: Ensemble-Methoden sind weniger anfällig für Überanpassung (Overfitting) an die Trainingsdaten und robuster gegenüber Rauschen und Ausreißern. Wenn ein einzelnes Modell bei bestimmten Datenpunkten fehlschlägt, können die anderen Modelle im Ensemble dies ausgleichen, was die Stabilität der Vorhersagen deutlich erhöht. Dies ist besonders wichtig bei realen Daten, die oft unvollständig oder verrauscht sind.

- Bessere Generalisierungsfähigkeit: Modellansammlungen sind besser in der Lage, Verallgemeinerungen auf ungesehene Daten vorzunehmen. Durch die Aggregation verschiedener Perspektiven lernt das Ensemble ein umfassenderes Bild der zugrunde liegenden Datenverteilung und kann dadurch zuverlässigere Vorhersagen für neue, unbekannte Datensätze treffen.

- Flexibilität: Ensembling-Techniken sind äußerst flexibel. Sie können mit einer Vielzahl von Basis-Lernalgorithmen und Datenarten kombiniert werden. Dies ermöglicht es Data Scientists, die Ergebnisse an das verfügbare Informationsniveau und die spezifischen Anforderungen des Problems anzupassen, indem sie die am besten geeigneten Modelle aus verschiedenen Möglichkeiten auswählen.

- Umgang mit komplexen Datenstrukturen: Ensemble-Methoden können auch helfen, mit hochdimensionalen oder komplexen, nichtlinearen Datenstrukturen umzugehen, die für einzelne, einfachere Modelle eine Herausforderung darstellen könnten.

| Vorteil | Beschreibung | Anwendungsbeispiel |

|---|---|---|

| Genauigkeit | Deutlich höhere Vorhersagepräzision durch Kombination der Stärken mehrerer Modelle. | Krankheitsdiagnose mit höherer Trefferquote. |

| Robustheit | Weniger anfällig für Overfitting, Rauschen und Ausreißer in den Daten. | Finanzbetrugserkennung trotz unvollständiger Transaktionsdaten. |

| Generalisierung | Bessere Leistung auf ungesehenen Daten durch breiteres Verständnis der Datenmuster. | Empfehlungssysteme, die auch auf neue Nutzer gut reagieren. |

| Flexibilität | Kompatibel mit heterogenen Basis-Modellen und verschiedenen Datentypen. | Kombination von Textanalyse (NLP) und Bilderkennungsmodellen. |

Grenzen und Herausforderungen beim Einsatz von Ensembling

Obwohl Ensembling-Methoden außerordentlich effektiv sind, sind sie nicht ohne Einschränkungen und Herausforderungen. Diese gilt es zu kennen und bei der Entscheidung für oder gegen den Einsatz zu berücksichtigen:

- Erhöhte Komplexität und Rechenkosten: Die Notwendigkeit, mehrere Modelle zu trainieren und deren Vorhersagen zu kombinieren, führt zu einem höheren Rechenaufwand und längeren Trainingszeiten im Vergleich zu einem einzelnen Modell. Dies kann bei sehr großen Datensätzen oder Echtzeitanwendungen ein limitierender Faktor sein. Auch die Speicherung mehrerer Modelle benötigt mehr Ressourcen.

- Eingeschränkte Interpretierbarkeit: Ensemble-Modelle sind oft schwerer zu interpretieren als einzelne Modelle. Es ist anspruchsvoll, zu verstehen, wie genau die einzelnen Modelle zur endgültigen Vorhersage beitragen oder welche Features am wichtigsten sind. Dies kann in Branchen, in denen Erklärbarkeit (XAI – Explainable AI) entscheidend ist, wie im Gesundheitswesen oder im Finanzsektor, problematisch sein.

- Abhängigkeit von der Modellvielfalt: Der Erfolg von Ensemble-Methoden hängt stark von der Diversität der einzelnen Basis-Modelle ab. Wenn die Modelle zu ähnlich sind oder dieselben Fehler machen, wird das Ensemble nur geringe oder gar keine Verbesserungen liefern. Die Auswahl und Konfiguration unterschiedlicher, aber komplementärer Modelle ist eine Kunst für sich.

- Anwendbarkeit auf bestimmte Modelle: Obwohl Ensembling sehr vielseitig ist, gibt es bestimmte Lernmodelle oder Szenarien, bei denen die Kombination weniger vorteilhaft oder sogar unmöglich ist. Zum Beispiel sind Modelle, die bereits von Natur aus sehr robust sind und eine geringe Varianz aufweisen (z. B. komplexe neuronale Netze mit vielen Layern), möglicherweise nicht so stark durch Bagging-Methoden zu verbessern, da deren Hauptziel die Varianzreduktion ist. Auch Modelle, die spezifische, nicht-additive Eigenschaften haben (z.B. einige Modelle aus dem Bereich Computer Vision, die stark auf sehr spezifischen Features oder Architekturen basieren), sind nicht immer trivial in ein generisches Ensemble zu integrieren.

- Hyperparameter-Optimierung: Die Optimierung der Hyperparameter für ein Ensemble, insbesondere für Stacking, ist komplexer, da nicht nur die Hyperparameter der Basis-Modelle, sondern auch die des Meta-Lernmodells abgestimmt werden müssen. Dies erfordert oft umfangreiche Kreuzvalidierung und feinabgestimmte Suchstrategien.

Es ist entscheidend, das richtige Gleichgewicht zwischen der Anzahl der Modelle und den daraus resultierenden Verbesserungen zu finden. Das Hinzufügen weiterer Modelle bringt ab einem gewissen Punkt immer geringere Vorteile, während die Rechenkosten und die Komplexität weiter steigen. Eine sorgfältige Analyse und Validierung ist daher unerlässlich.

Ensembling im Kontext von Machine Learning: Ein Fazit für Entwickler und Datenwissenschaftler

Ensembling-Methoden stellen einen Eckpfeiler im Bereich des Machine Learning dar und sind unverzichtbar für die Entwicklung hochperformanter und zuverlässiger Vorhersagemodelle. Durch die intelligente Kombination mehrerer Einzelmodelle – sei es durch Bagging zur Reduktion der Varianz, Boosting zur Minimierung des Bias oder Stacking für eine synergetische Integration heterogener Lerner – lassen sich Ergebnisse erzielen, die die Leistung jedes einzelnen Modells in der Regel übertreffen.

Die Fähigkeit von Ensemble-Methoden, die Genauigkeit und Robustheit von Vorhersagemodellen signifikant zu verbessern, macht sie zu einem unverzichtbaren Werkzeug für Data Scientists und Entwickler, die sich mit der Analyse komplexer Daten und der Erstellung präziser Vorhersagesysteme beschäftigen. Während die Vorteile in Bezug auf Performance und Generalisierungsfähigkeit überzeugen, sollten die potenziellen Nachteile wie erhöhte Komplexität, Rechenkosten und eingeschränkte Interpretierbarkeit stets berücksichtigt werden. Der Schlüssel zum Erfolg liegt in der fundierten Auswahl der richtigen Ensemble-Strategie und der Basis-Modelle, um die spezifischen Anforderungen des jeweiligen Problems optimal zu erfüllen und so die Datenanalyse zu optimieren.

Wenn Sie Ihre Kenntnisse in diesem spannenden Bereich vertiefen möchten oder weitere Fragen zu fortgeschrittenen Data Science Techniken haben, zögern Sie nicht, unsere weiteren Artikel zu erkunden oder einen Kommentar zu hinterlassen. Die Welt des Machine Learning entwickelt sich stetig weiter, und Ensemble-Methoden bleiben ein zentraler Bestandteil dieser Evolution.

Leave a Comment