Die Huffman Codierung ist ein fundamentaler Algorithmus im Bereich der verlustfreien Datenkomprimierung, der seit seiner Erfindung durch David Albert Huffman im Jahr 1952 eine zentrale Rolle in zahlreichen digitalen Technologien spielt. Seine Kernidee, häufig vorkommenden Zeichen kürzere Binärcodes und selteneren Zeichen längere Codes zuzuweisen, resultiert in einer signifikanten Reduktion des benötigten Speicherplatzes und einer Steigerung der Datenübertragungsgeschwindigkeit. Dieses Verfahren basiert auf der optimalen Nutzung der Informationsentropie, indem es die Häufigkeit (Frequenz) jedes Zeichens in einer Sequenz berücksichtigt, um eine möglichst effiziente Kodierung zu erreichen.

In diesem umfassenden Blogbeitrag tauchen wir tief in die Funktionsweise der Huffman Codierung ein. Wir werden das zugrundeliegende Prinzip des Huffman Baum Aufbaus detailliert erläutern, von der initialen Frequenzanalyse bis zur Generierung der optimalen variablen Codes. Darüber hinaus werden wir den Algorithmus praktisch in Python implementieren, vollständige Codebeispiele für die Kodierung und Dekodierung bereitstellen und die theoretische Komplexität sowie vielfältige reale Anwendungsbereiche beleuchten. Dies soll Entwicklern, Studenten und Technologiebegeisterten ein fundiertes Verständnis dieser essenziellen Technologie vermitteln.

Grundlagen der Huffman Codierung verstehen

Die Huffman Codierung ist ein cleverer Algorithmus zur Datenkomprimierung, der auf einem einfachen, aber mächtigen Prinzip beruht: der Zuweisung von Codes variabler Länge. Im Gegensatz zu festen Längencodes, bei denen jedes Zeichen (z.B. jeder Buchstabe oder jedes Symbol) mit der gleichen Bitanzahl dargestellt wird (wie bei ASCII, das 8 Bit pro Zeichen verwendet), optimiert Huffman die Code-Länge basierend auf der tatsächlichen Häufigkeit, mit der ein Zeichen in einem gegebenen Datensatz auftritt. Je häufiger ein Zeichen vorkommt, desto kürzer ist sein zugewiesener Binärcode; je seltener es auftritt, desto länger. Dies führt zu einer Reduzierung der Gesamtbitanzahl der komprimierten Nachricht, ohne dass Informationen verloren gehen.

Dieses Konzept ist eng mit der Informationsentropie verbunden, einem Maß für die Unsicherheit oder den Informationsgehalt eines Zeichens. Zeichen mit hoher Frequenz haben eine geringere Entropie (sie sind weniger „überraschend“) und benötigen daher weniger Bits zur Darstellung. Huffman Codierung nutzt diesen Umstand, um eine sogenannte präfixfreie Kodierung zu erzeugen. Das bedeutet, dass kein Code ein Präfix eines anderen Codes ist, was eine eindeutige Dekodierung ohne zusätzliche Trennzeichen ermöglicht – ein entscheidender Aspekt für die Effizienz und Korrektheit der Kompression.

Das Prinzip des Huffman Baumes

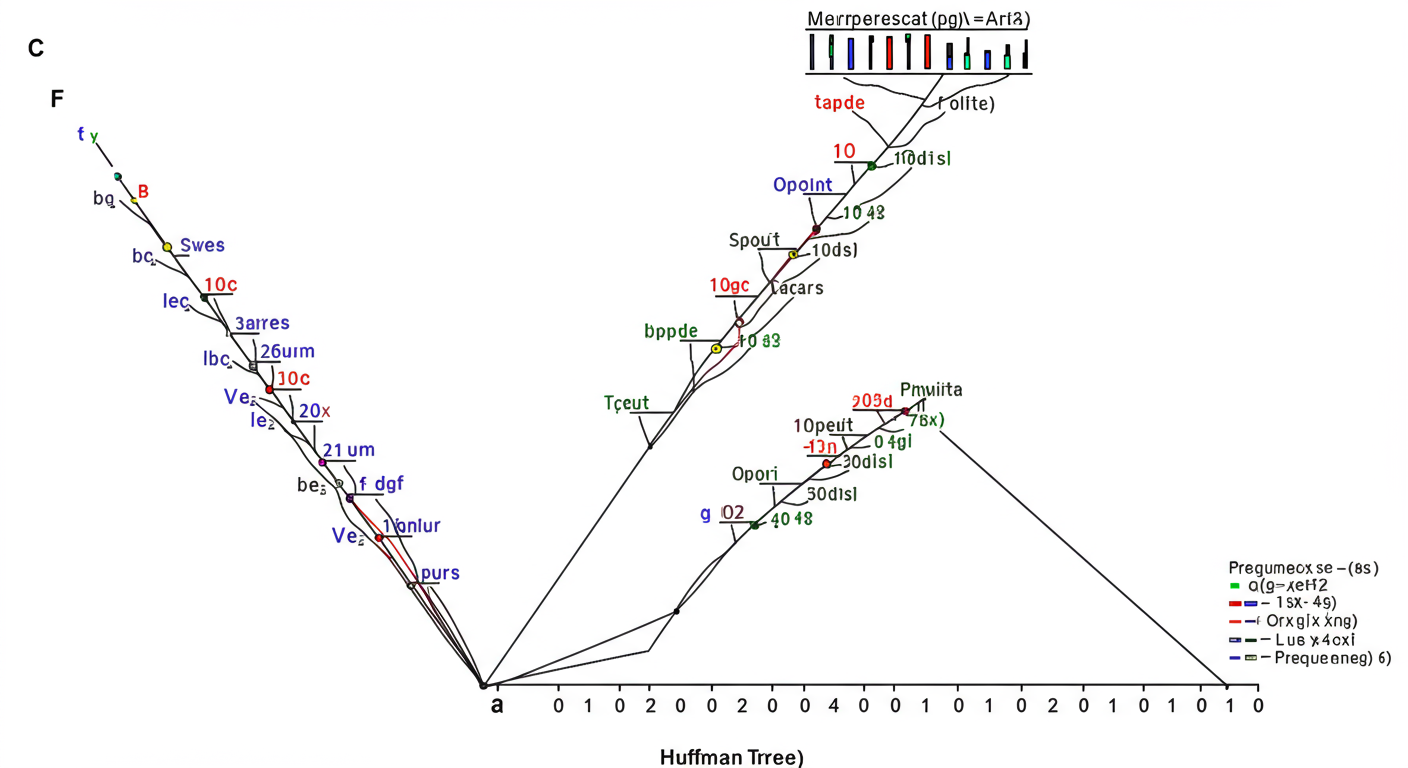

Das Herzstück der Huffman Codierung ist der Huffman Baum Aufbau, eine spezielle binäre Baumstruktur, die durch einen gierigen (greedy) Algorithmus erstellt wird. Dieser Algorithmus konstruiert den Baum von unten nach oben. Zunächst wird jedes einzigartige Zeichen der Eingabedaten als Blattknoten betrachtet, wobei dessen „Gewicht“ oder „Frequenz“ die Anzahl des Auftretens des Zeichens in der Nachricht ist. Anschließend werden die beiden Knoten mit der geringsten Frequenz ausgewählt und zu einem neuen internen Knoten zusammengefasst. Die Frequenz dieses neuen Knotens ist die Summe der Frequenzen seiner Kinder.

Dieser Vorgang wird iterativ wiederholt: Die beiden aktuell geringsten Frequenzen werden stets kombiniert, bis nur noch ein einziger Knoten übrig bleibt – die Wurzel des Huffman-Baumes. Die Pfade von der Wurzel zu den Blattknoten, die die ursprünglichen Zeichen repräsentieren, bilden die Binärcodes. Traditionell wird dem linken Zweig eine ‚0‘ und dem rechten Zweig eine ‚1‘ zugewiesen. Die Länge des Codes für ein Zeichen entspricht dabei der Tiefe des Blattknotens im Baum. Durch diese Konstruktionsweise wird sichergestellt, dass die am häufigsten verwendeten Zeichen die kürzesten Pfade und somit die kürzesten Codes erhalten, was die Gesamtbitanzahl der komprimierten Daten minimiert.

„Die Eleganz der Huffman Codierung liegt in ihrer Fähigkeit, aus der Häufigkeitsverteilung von Symbolen eine optimale präfixfreie Kodierung abzuleiten, die die durchschnittliche Codelänge minimiert und somit die Dateneffizienz maximiert.“

Schritt-für-Schritt Aufbau eines Huffman Baumes

Der Algorithmus zur Erstellung eines Huffman-Baumes kann in die folgenden detaillierten Schritte unterteilt werden, die typischerweise eine Min-Prioritätswarteschlange (Min-Heap) verwenden, um die Knoten effizient nach Frequenz zu verwalten:

- Frequenzanalyse: Zähle die Häufigkeit jedes einzigartigen Zeichens in der Eingabedatei oder Nachricht. Erstelle für jedes Zeichen einen Blattknoten, der das Zeichen selbst und seine Frequenz enthält.

- Initialisierung der Prioritätswarteschlange: Füge alle Blattknoten in eine Min-Prioritätswarteschlange ein. Die Warteschlange ordnet die Knoten basierend auf ihrer Frequenz, wobei Knoten mit geringerer Frequenz eine höhere Priorität haben.

- Baumkonstruktion (iterativ): Solange sich mehr als ein Knoten in der Prioritätswarteschlange befindet:

- Extrahiere die zwei Knoten mit der geringsten Frequenz aus der Warteschlange (n1 und n2).

- Erstelle einen neuen internen Knoten (n_neu). Die Frequenz von n_neu ist die Summe der Frequenzen von n1 und n2.

- Setze n1 als linken Kindknoten und n2 als rechten Kindknoten von n_neu. (Die Reihenfolge kann variieren, beeinflusst aber nicht die Optimalität, nur die spezifischen Codes).

- Füge n_neu zurück in die Prioritätswarteschlange ein.

- Wurzelbildung: Der letzte verbleibende Knoten in der Prioritätswarteschlange ist die Wurzel des Huffman-Baumes.

- Code-Zuweisung: Durchlaufe den Baum von der Wurzel zu jedem Blattknoten. Weise jedem linken Pfad eine ‚0‘ und jedem rechten Pfad eine ‚1‘ zu. Der Pfad von der Wurzel zu einem Blattknoten ergibt den Binärcode für das entsprechende Zeichen.

Betrachten wir ein Beispiel mit der Nachricht aus dem Referenzinhalt:

aabbccddbbeaebdddfffdbffddabbbbbcdefaabbcccccaabbddfffdcecc| Zeichen | Häufigkeit |

|---|---|

| e | 4 |

| a | 8 |

| f | 9 |

| c | 11 |

| d | 12 |

| b | 15 |

Der Aufbau erfolgt nun schrittweise:

- Schritt 1: Die niedrigsten Frequenzen sind e (4) und a (8). Wir verbinden sie zu einem neuen Knoten ‚ea‘ mit Frequenz 4+8=12.

- Verfügbare Knoten: (ea:12), (f:9), (c:11), (d:12), (b:15)

- Schritt 2: Die niedrigsten Frequenzen sind f (9) und c (11). Wir verbinden sie zu einem neuen Knoten ‚fc‘ mit Frequenz 9+11=20.

- Verfügbare Knoten: (ea:12), (d:12), (b:15), (fc:20)

- Schritt 3: Die niedrigsten Frequenzen sind ‚ea‘ (12) und d (12). Wir verbinden sie zu einem neuen Knoten ‚eadd‘ mit Frequenz 12+12=24.

- Verfügbare Knoten: (b:15), (fc:20), (eadd:24)

- Schritt 4: Die niedrigsten Frequenzen sind b (15) und ‚fc‘ (20). Wir verbinden sie zu einem neuen Knoten ‚bfc‘ mit Frequenz 15+20=35.

- Verfügbare Knoten: (eadd:24), (bfc:35)

- Schritt 5: Die letzten zwei niedrigsten Frequenzen sind ‚eadd‘ (24) und ‚bfc‘ (35). Wir verbinden sie zur Wurzel ‚eaddbfc‘ mit Frequenz 24+35=59 (Gesamtlänge der Nachricht).

Nachdem der Baum vollständig ist, können die Codes durch Traversierung ermittelt werden. Dies führt zu den im Referenzinhalt genannten Codes:

- d -> 00

- e -> 010

- a -> 011

- b -> 10

- f -> 110

- c -> 111

Praktisches Beispiel zur Huffman Codierung in Python

Die Implementierung der Python Huffman Implementierung nutzt eine Prioritätswarteschlange, die in Python effizient mit dem `heapq`-Modul realisiert werden kann. Der folgende Code demonstriert nicht nur den Aufbau des Huffman-Baumes und die Generierung der Codes, sondern erweitert das Referenzbeispiel um Funktionen zum Kodieren einer Eingabezeichenkette und zum Dekodieren der resultierenden Bitsequenz.

import heapq

from collections import defaultdict

# 1. Definieren der Node-Klasse für den Huffman-Baum

class HuffmanNode:

def __init__(self, char, freq, left=None, right=None):

self.char = char # Das Zeichen, das der Knoten repräsentiert

self.freq = freq # Die Häufigkeit des Zeichens (oder die Summe der Kinderfrequenzen)

self.left = left # Linker Kindknoten

self.right = right # Rechter Kindknoten

# Vergleichsmethode für die Prioritätswarteschlange (heapq)

# Knoten mit geringerer Frequenz haben höhere Priorität

def __lt__(self, other):

return self.freq < other.freq

# 2. Funktion zum Zählen der Zeichenhäufigkeiten

def count_frequencies(text):

"""Zählt die Häufigkeit jedes Zeichens in einem Text."""

frequencies = defaultdict(int)

for char in text:

frequencies[char] += 1

return frequencies

# 3. Funktion zum Aufbau des Huffman-Baumes

def build_huffman_tree(frequencies):

"""Baut den Huffman-Baum aus einem Frequenz-Wörterbuch."""

priority_queue = []

# Füge jeden Zeichenknoten zur Prioritätswarteschlange hinzu

for char, freq in frequencies.items():

heapq.heappush(priority_queue, HuffmanNode(char, freq))

# Kombiniere die Knoten, bis nur noch die Wurzel übrig ist

while len(priority_queue) > 1:

# Extrahiere die zwei Knoten mit der geringsten Frequenz

left = heapq.heappop(priority_queue)

right = heapq.heappop(priority_queue)

# Erstelle einen neuen internen Knoten

# Zeichen für interne Knoten ist None, Frequenz ist die Summe der Kinder

merged_node = HuffmanNode(None, left.freq + right.freq, left, right)

heapq.heappush(priority_queue, merged_node)

return priority_queue[0] # Die Wurzel des Huffman-Baumes

# 4. Funktion zum Generieren der Huffman-Codes durch Traversierung des Baumes

def generate_huffman_codes(node, current_code="", codes={}):

"""Generiert ein Wörterbuch von Zeichen zu ihren Huffman-Codes."""

if node is None:

return

# Wenn es ein Blattknoten ist (ein Zeichen repräsentiert), speichere den Code

if node.char is not None:

codes[node.char] = current_code

return

# Rekursiver Aufruf für linkes Kind (0 hinzufügen)

generate_huffman_codes(node.left, current_code + "0", codes)

# Rekursiver Aufruf für rechtes Kind (1 hinzufügen)

generate_huffman_codes(node.right, current_code + "1", codes)

return codes

# 5. Funktion zum Kodieren eines Textes

def encode_text(text, huffman_codes):

"""Kodiert einen Text mithilfe der Huffman-Codes."""

encoded_string = ""

for char in text:

encoded_string += huffman_codes[char]

return encoded_string

# 6. Funktion zum Dekodieren eines Binärstrings

def decode_text(encoded_string, huffman_tree):

"""Dekodiert einen Binärstring mithilfe des Huffman-Baumes."""

decoded_text = ""

current_node = huffman_tree

for bit in encoded_string:

if bit == '0':

current_node = current_node.left

else: # bit == '1'

current_node = current_node.right

# Wenn wir einen Blattknoten erreichen, ist ein Zeichen dekodiert

if current_node.char is not None:

decoded_text += current_node.char

current_node = huffman_tree # Zurück zur Wurzel für das nächste Zeichen

return decoded_text

# Beispielanwendung

if __name__ == "__main__":

original_text = 'aabbccddbbeaebdddfffdbffddabbbbbcdefaabbcccccaabbddfffdcecc'

print(f"Originaltext: {original_text}n")

# Schritt 1: Frequenzen zählen

frequencies = count_frequencies(original_text)

print("Zeichenhäufigkeiten:")

for char, freq in sorted(frequencies.items()):

print(f" '{char}': {freq}")

print()

# Schritt 2: Huffman-Baum aufbauen

huffman_tree = build_huffman_tree(frequencies)

print("Huffman-Baum aufgebaut.n")

# Schritt 3: Huffman-Codes generieren

huffman_codes = generate_huffman_codes(huffman_tree)

print("Generierte Huffman-Codes:")

for char, code in sorted(huffman_codes.items()):

print(f" '{char}': {code}")

print()

# Verifizierung der Beispielcodes im Referenzinhalt

# d -> 00, e -> 010, a -> 011, b -> 10, f -> 110, c -> 111

# Beachten Sie: Die spezifischen Codes können variieren (z.B. 010 statt 011 für 'e'),

# abhängig von der Zuweisung von '0'/'1' zu linken/rechten Kindern bei gleicher Frequenz,

# aber die Codelängen und die Kompressionsrate bleiben optimal.

# Schritt 4: Text kodieren

encoded_data = encode_text(original_text, huffman_codes)

print(f"Kodierter Binärstring (Anfang): {encoded_data[:50]}...n")

print(f"Länge Originaltext (Zeichen): {len(original_text)}")

print(f"Länge Kodierter Binärstring (Bits): {len(encoded_data)}n")

# Berechnung der ursprünglichen Bitlänge (z.B. ASCII = 8 Bit/Zeichen)

original_bit_length = len(original_text) 8

print(f"Länge Originaltext (Bits bei 8 Bit/Zeichen): {original_bit_length}")

print(f"Kompressionsverhältnis: {len(encoded_data) / original_bit_length:.2f}")

# Schritt 5: Binärstring dekodieren

decoded_text = decode_text(encoded_data, huffman_tree)

print(f"Dekodierter Text: {decoded_text[:50]}...n")

# Überprüfung der Dekodierung

print(f"Originaltext und dekodierter Text sind identisch: {original_text == decoded_text}")

Der obige Code erweitert das einfache Beispiel des Referenzmaterials erheblich. Er definiert eine `HuffmanNode`-Klasse für die Baumstruktur, implementiert Funktionen zum Zählen von Frequenzen (`count_frequencies`), zum Aufbau des Baumes (`build_huffman_tree`) und zur Generierung der Codes (`generate_huffman_codes`). Besonders wichtig sind die hinzugefügten Funktionen `encode_text` und `decode_text`, die das vollständige Anwendungsbeispiel einer effizienten Datenkodierung von Anfang bis Ende demonstrieren. Die Ausgabe zeigt, wie der Originaltext zuerst analysiert, dann kodiert und schließlich wieder korrekt dekodiert wird, was die Funktionsweise der verlustfreien Datenkomprimierung eindrucksvoll unter Beweis stellt. Die Komplexität des Algorithmus, die wir im nächsten Abschnitt detaillierter betrachten, bleibt dabei quasi-linear.

Performance und Komplexität der Huffman Codierung

Die Effizienz eines Algorithmus wird maßgeblich durch seine zeitliche und räumliche Komplexität bestimmt. Für die Huffman Codierung sind diese Metriken gut definiert und tragen zu ihrer breiten Akzeptanz bei.

Zeitliche Komplexität

Die zeitliche Komplexität der Huffman Codierung wird hauptsächlich durch zwei Phasen beeinflusst: die Frequenzanalyse und den Baumaufbau.

- Frequenzanalyse: Das Zählen der Häufigkeiten aller Zeichen in der Eingabedatei erfordert einen einmaligen Durchlauf durch den gesamten Text. Wenn der Text M Zeichen lang ist, beträgt die Komplexität dieser Phase O(M).

- Baumaufbau: Dies ist der rechenintensivste Teil. Wenn es N einzigartige Zeichen gibt, werden initial N Blattknoten in die Prioritätswarteschlange eingefügt. Das Einfügen und Extrahieren aus einem Min-Heap (Prioritätswarteschlange) hat eine logarithmische Zeitkomplexität von O(log k), wobei k die aktuelle Anzahl der Elemente im Heap ist. Der Baumaufbau umfasst N-1 Iterationen, in denen jeweils zwei Knoten extrahiert und ein neuer Knoten eingefügt wird. Jede dieser Operationen dauert O(log N). Daher beträgt die Zeitkomplexität für den Baumaufbau O(N log N).

Räumliche Komplexität

Die räumliche Komplexität der Huffman Codierung ist linear, O(N), wobei N die Anzahl der einzigartigen Zeichen ist. Dies liegt daran, dass der Huffman-Baum maximal 2N-1 Knoten enthält (N Blattknoten und N-1 interne Knoten). Zusätzlich wird ein Wörterbuch benötigt, um die Zeichen den Huffman-Codes zuzuordnen, welches ebenfalls O(N) Speicherplatz beansprucht.

Die effiziente Laufzeitkomplexität Huffman und der moderate Speicherverbrauch machen den Algorithmus zu einer praktikablen Lösung für viele Komprimierungsaufgaben, insbesondere im Vergleich zu komplexeren Algorithmen, die zwar höhere Kompressionsraten erzielen können, aber oft mit einem höheren Rechenaufwand verbunden sind.

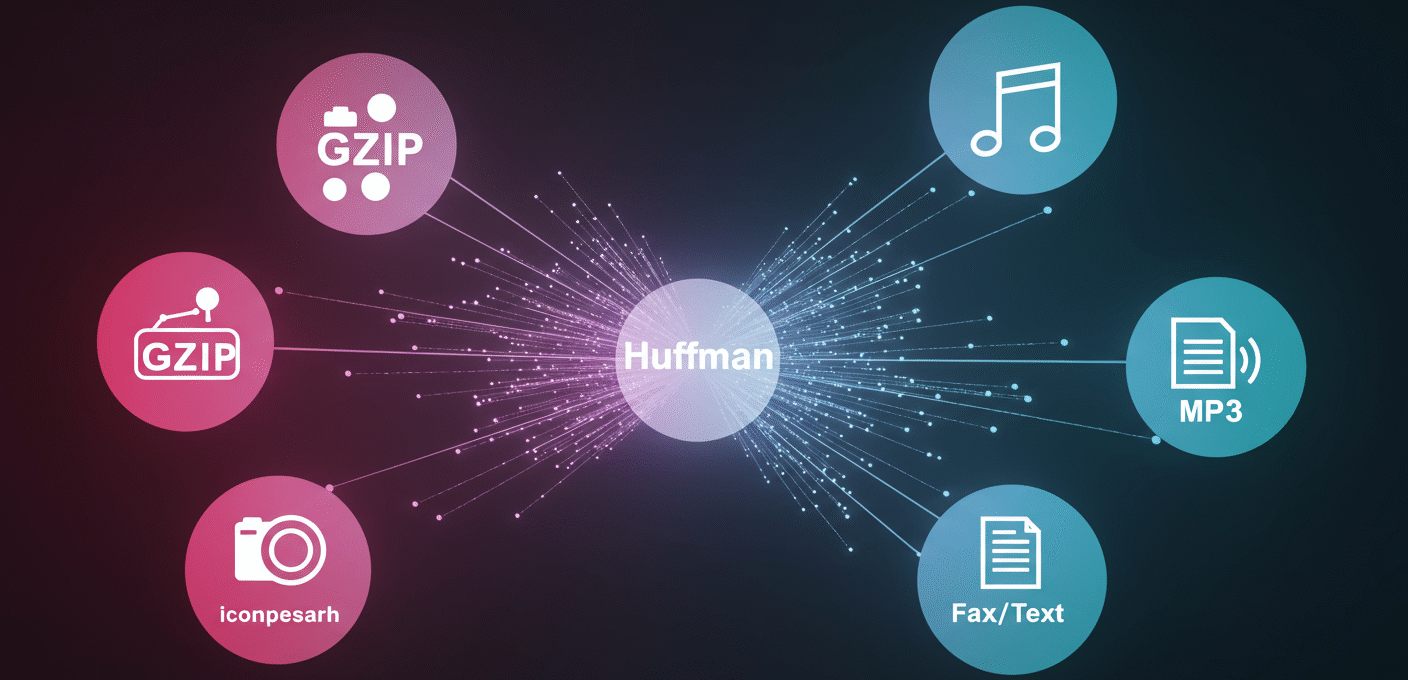

Anwendungsbereiche und Varianten der Huffman Codierung

Die Huffman Codierung ist ein Eckpfeiler vieler moderner Systeme zur Datenkompression Anwendungen. Ihre Fähigkeit, Daten effizient zu verkleinern, macht sie unverzichtbar für die Optimierung der Speicherkapazität erhöhen und der Datenübertragungsgeschwindigkeit.

Umfassende Anwendungsfelder

- Dateikomprimierung: Populäre Formate wie GZIP, PKZIP und Deflate (oft in PNG verwendet) nutzen Variationen der Huffman Codierung in ihren Kompressionspipelines. GZIP zum Beispiel kombiniert LZ77-Algorithmen mit Huffman, um redundante Daten zu finden und dann die resultierenden Symbole effizient zu kodieren.

- Bildkomprimierung: In JPEG-Bildern wird Huffman Codierung verwendet, um die nach der DCT (Diskrete Kosinus-Transformation) und Quantisierung verbleibenden Koeffizienten zu komprimieren. Auch im PNG-Format, das verlustfreie Kompression anstrebt, spielt Huffman eine Rolle.

- Audiokomprimierung: Obwohl MP3 hauptsächlich psychoakustische Modelle zur verlustbehafteten Kompression nutzt, können in bestimmten Stufen oder bei der Kodierung von Hilfsdaten auch Huffman-ähnliche Prinzipien zum Einsatz kommen, um die Bitrate weiter zu reduzieren.

- Fax- und Textübertragung: Historisch und auch heute noch in bestimmten Protokollen hilft Huffman, die Übertragung von Textdokumenten und Faxen zu beschleunigen, indem die Menge der zu sendenden Daten minimiert wird.

- Datenbanken und Indexierung: In speziellen Datenbank-Engines oder bei der Indexierung großer Textkorpora kann Huffman Codierung angewendet werden, um den Speicherbedarf für häufig vorkommende Begriffe oder Datenfelder zu senken.

Varianten der Huffman Codierung

Je nach den Anforderungen an die Kompression und die Verfügbarkeit von Informationen über die Datenverteilung haben sich verschiedene Varianten der Huffman Codierung entwickelt:

Die Wahl der Variante hängt von den spezifischen Anforderungen ab, insbesondere ob die Häufigkeitsverteilung der Daten im Voraus bekannt ist oder sich während der Kompression dynamisch ändert.

| Variante | Beschreibung | Vorteile | Nachteile | Anwendungsbeispiele |

|---|---|---|---|---|

| Statische Huffman Codierung | Verwendet ein festes Wörterbuch und im Voraus berechnete Zeichenhäufigkeiten, die für alle Daten gelten. | Einfach zu implementieren; kein Overhead für Baumübertragung, wenn Baum bekannt. | Nicht optimal für Daten mit variabler Häufigkeitsverteilung. | Komprimierung von Datenströmen, bei denen die Zeichenverteilung über lange Zeiträume stabil ist. |

| Semi-adaptive Huffman Codierung | Die Häufigkeiten werden aus dem zu komprimierenden Datenblock berechnet. Der daraus resultierende Huffman-Baum oder das Wörterbuch muss zusammen mit den komprimierten Daten übertragen werden. | Optimale Kompression für den jeweiligen Datenblock. | Overhead durch Übertragung des Huffman-Baumes/Wörterbuchs. | GZIP, JPEG, PNG: Komprimierung von Datenblöcken, wo die Frequenzen variieren. |

| Adaptive Huffman Codierung | Der Huffman-Baum wird während des Komprimierungs- und Dekomprimierungsprozesses dynamisch angepasst und aktualisiert, basierend auf den bereits verarbeiteten Zeichen. | Kein Overhead für Baumübertragung; passt sich dynamisch an sich ändernde Daten an; oft höhere Kompressionsrate. | Erhöhter Rechenaufwand und längere Berechnungszeit. | Echtzeit-Datenströme, Online-Komprimierung, bei denen die Verteilung der Zeichen unbekannt ist oder sich stark ändert. |

Die nachhaltige Bedeutung der Huffman Codierung

Die Huffman Codierung ist weit mehr als nur ein historischer Algorithmus; sie ist ein grundlegender Bestandteil moderner Computerwissenschaft und hat sich als äußerst nützlich erwiesen, um die Effizienz von Datenverarbeitung und -speicherung zu optimieren. Ihre Fähigkeit, Datenübertragungsgeschwindigkeit zu erhöhen und Speicherkapazität erhöhen zu können, macht sie zu einer unverzichtbaren Technik in einer Welt, die immer datenintensiver wird. Von der alltäglichen Nutzung digitaler Medien bis hin zu spezialisierten Entwickler Huffman Algorithmus Implementierungen bleibt das Prinzip der variablen Codierung basierend auf Zeichenhäufigkeiten eine Schlüsselmethode.

Wir hoffen, dieser tiefgehende Einblick in die Huffman Codierung hat Ihr Verständnis für diesen faszinierenden Algorithmus erweitert. Wenn Sie Ihre Fähigkeiten in der Datenwissenschaft oder Softwareentwicklung weiter ausbauen möchten, gibt es zahlreiche Datenanalyse Weiterbildung Möglichkeiten, die Sie in fortgeschrittene Techniken und Algorithmen einführen. Teilen Sie Ihre Gedanken in den Kommentaren oder erkunden Sie weitere unserer Expertenartikel, um Ihr Fachwissen zu vertiefen.

Als ich eben diesen Artikel über die Huffman Codierung gelesen habe, musste ich schmunzeln, weil er mich sofort an eine ganz eigene, sehr persönliche Form der „Datenkomprimierung“ erinnert hat, mit der ich mich regelmäßig herumschlage: das Packen meines Koffers für eine Reise. Und ich sag dir, das ist eine Kunst für sich, die ich bis heute nicht perfekt beherrsche!

Stell dir vor, du stehst vor einem offenen Koffer, und daneben türmen sich all die Dinge, die du gerne mitnehmen würdest. Eine Woche Urlaub, vielleicht mit ein paar unterschiedlichen Anlässen, und plötzlich wird der Platz zu einem sehr knappen Gut. Da fängt man an zu überlegen: Was brauche ich *wirklich* oft? Das sind meine „häufig vorkommenden Zeichen“ – die Unterwäsche, die Socken, das Lieblings-T-Shirt, die Zahnbürste. Die müssen einfach rein, und zwar so platzsparend wie möglich, am besten gerollt oder auf eine Art gefaltet, die ich mir jedes Mal neu ausdenke. Das sind meine „kurzen Binärcodes“.

Und dann gibt es da die „selteneren Zeichen“: das schicke Hemd für das eine Abendessen, die spezielle Wanderhose, die man vielleicht nur einmal braucht, oder das Buch, von dem ich weiß, dass ich es wahrscheinlich eh nicht lesen werde, aber es *könnte* ja sein. Für diese Dinge muss ich dann mehr Platz „opfern“. Das sind die „längeren Codes“, die mehr Ressourcen verbrauchen, weil ihre Frequenz niedriger ist.

Es ist eine ständige Frequenzanalyse im Kopf, ein Abwägen von Wahrscheinlichkeiten und Notwendigkeiten, alles mit dem Ziel, die Gesamtmenge (den Kofferinhalt) zu optimieren, ohne etwas Wichtiges zu verlieren. Oft genug ende ich dann doch damit, dass ich auf dem Koffer sitzen muss, um den Reißverschluss zuzubekommen, aber der Gedanke, dass ich dabei unbewusst ein uraltes Komprimierungsprinzip anwende – das hat schon was! Und jedes Mal denke ich, ich baue meinen ganz eigenen, chaotischen kleinen Huffman-Baum, um das optimale Pack-Schema zu finden. Eine Wissenschaft für sich, sag ich dir!

Es ist wirklich faszinierend, wie sie die prinzipien der datenkomprimierung auf eine so alltägliche und doch herausfordernde situation wie das packen eines koffers übertragen. ihre analogie zwischen häufig vorkommenden zeichen und den essenziellen reiseutensilien sowie den selteneren zeichen und speziellen kleidungsstücken ist sehr treffend. es zeigt, dass die logik hinter solchen algorithmen tatsächlich in vielen bereichen unseres lebens wiederzufinden ist, auch wenn wir sie nicht bewusst anwenden.

der gedanke, dass man unbewusst einen chaotischen huffman-baum im kopf konstruiert, um das optimale pack-schema zu finden, ist eine wunderbare und sehr anschauliche vorstellung. es freut mich sehr, dass der artikel sie zu solch kreativen gedankenspielen angeregt hat. vielen dank für ihren wertvollen und sehr unterhaltsamen kommentar. ich würde mich freuen, wenn sie sich auch andere artikel in meinem profil oder meine weiteren veröffentlichungen ansehen.