Der t-SNE-Algorithmus, auch bekannt als t-distributed Stochastic Neighbor Embedding, ist eine leistungsstarke Methode zur Dimensionsreduktion, die in der Datenanalyse und im maschinellen Lernen weit verbreitet ist. Besonders bei der Visualisierung hochdimensionaler Datenmengen ermöglicht t-SNE Dimensionsreduktion, komplexe Strukturen in niedrigdimensionale Räume wie 2D oder 3D zu projizieren, ohne wesentliche lokale Ähnlichkeiten zu verlieren. Entwickelt von Laurens van der Maaten und Geoffrey Hinton im Jahr 2008, eignet sich t-SNE ideal für Entwickler und Datenwissenschaftler, die Cluster in großen Datensätzen erkunden möchten, etwa in Bilderkennung oder Genomik.

In diesem Artikel tauchen wir tief in den t-SNE-Algorithmus ein, beginnen mit einem Vergleich zur Hauptkomponentenanalyse (PCA) und erklären die drei Kernschritte detailliert. Wir ergänzen die theoretischen Grundlagen mit praktischen Python-Beispielen unter Verwendung der Bibliothek scikit-learn, um die Implementierung greifbar zu machen. So lernen Sie nicht nur, wie t-SNE funktioniert, sondern können es sofort in eigenen Projekten anwenden, inklusive Tipps zur Optimierung von Parametern wie Perplexität für bessere Ergebnisse in der Datenvisualisierung.

Grundlagen des t-SNE-Algorithmus

Im Gegensatz zu linearen Methoden wie PCA, die globale Strukturen priorisieren, fokussiert sich der t-SNE-Algorithmus auf die Erhaltung lokaler Nachbarschaften. PCA minimiert die Verluste in der Varianz, was zu einer guten globalen Approximation führt, aber oft Cluster in hochdimensionalen Daten überdeckt. t-SNE hingegen modelliert Ähnlichkeiten probabilistisch, was zu klareren Visualisierungen führt, insbesondere bei nicht-linearen Datenverteilungen. Diese Eigenschaft macht t-SNE unverzichtbar für exploratory data analysis, wo der Fokus auf der Entdeckung von Mustern liegt.

Bevor wir zu den Schritten kommen, ist es wichtig zu verstehen, dass t-SNE iterativ arbeitet und anfällig für Initialisierungen ist. Eine gängige Praxis ist die Kombination mit PCA für eine Vorreduktion, um Rechenzeit zu sparen. In der Praxis wählen Nutzer eine Perplexität zwischen 5 und 50, abhängig von der Datensatzgröße, um eine Balance zwischen lokaler und globaler Struktur zu erreichen.

Unterschiede zwischen t-SNE und PCA

Die Hauptkomponentenanalyse (PCA) transformiert Daten in einen niedrigeren Dimensionsraum, indem sie die Richtungen maximaler Varianz identifiziert. Sie ist deterministisch und effizient für lineare Abhängigkeiten, eignet sich jedoch weniger für die Visualisierung komplexer, nicht-linearer Strukturen. t-SNE hingegen verwendet stochastische Elemente und eine nicht-lineare Abbildung, die lokale Distanzen stärker betont. Das Ergebnis: PCA erzeugt oft überlappende Cluster, während t-SNE klare Gruppierungen schafft, wie im MNIST-Datensatz sichtbar, wo Ziffern in distincten Clustern erscheinen.

Um dies zu illustrieren, betrachten wir einen einfachen Vergleich: PCA maximiert die erklärte Varianz, was bei skalierbaren Datensätzen nützlich ist, aber globale Ausreißer betont. t-SNE minimiert hingegen die Divergenz zwischen Wahrscheinlichkeitsverteilungen in hoch- und niedrigdimensionalem Raum, was zu einer besseren Darstellung feiner Strukturen führt. In der Praxis zeigt t-SNE bei Bilddaten wie MNIST eine überlegene Clusterung, da es Ähnlichkeiten von Nachbarn priorisiert.

| Methode | Ansatz | Stärken | Schwächen |

|---|---|---|---|

| PCA | Linear, varianzbasiert | Schnell, globaler Überblick | Schlecht für nicht-lineare Daten |

| t-SNE | Nicht-linear, probabilistisch | Exzellente lokale Cluster | Rechenintensiv, nicht deterministisch |

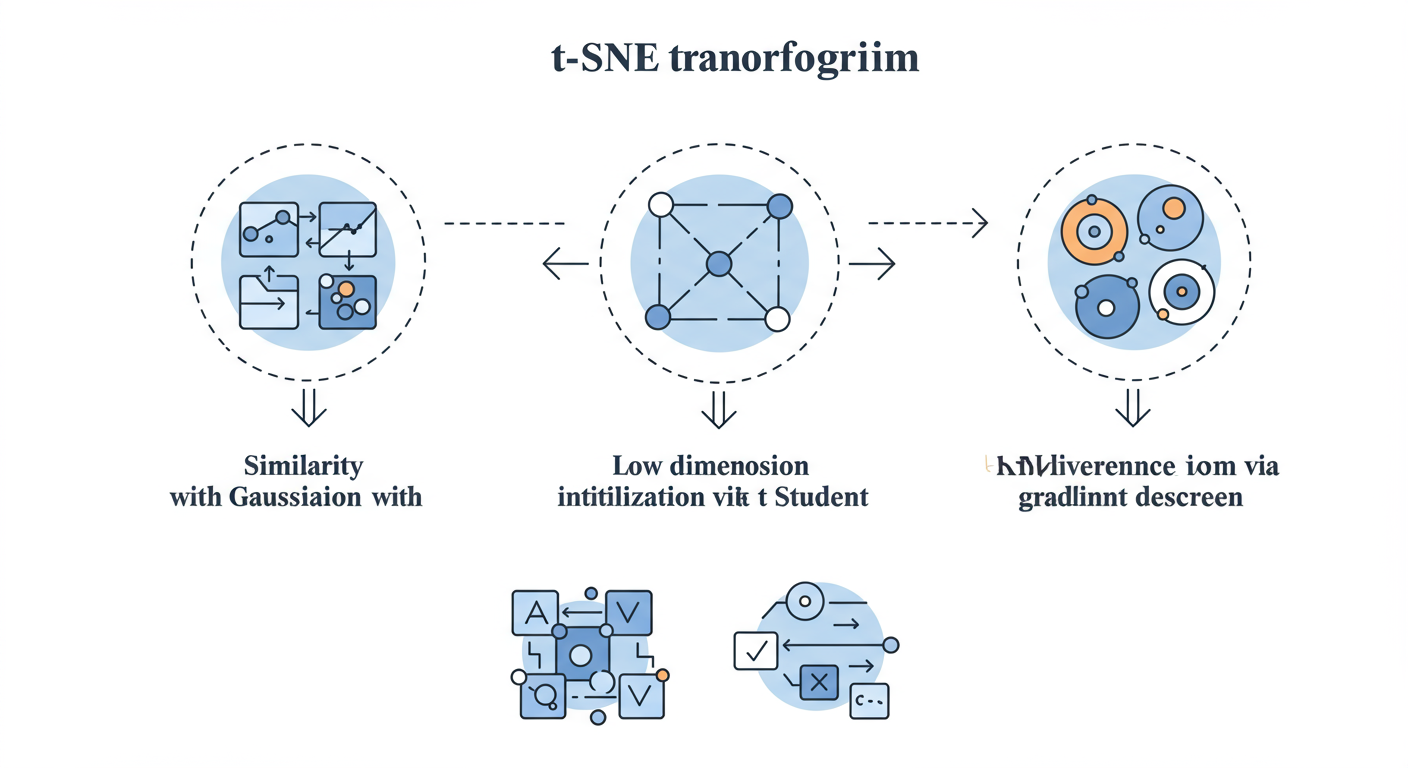

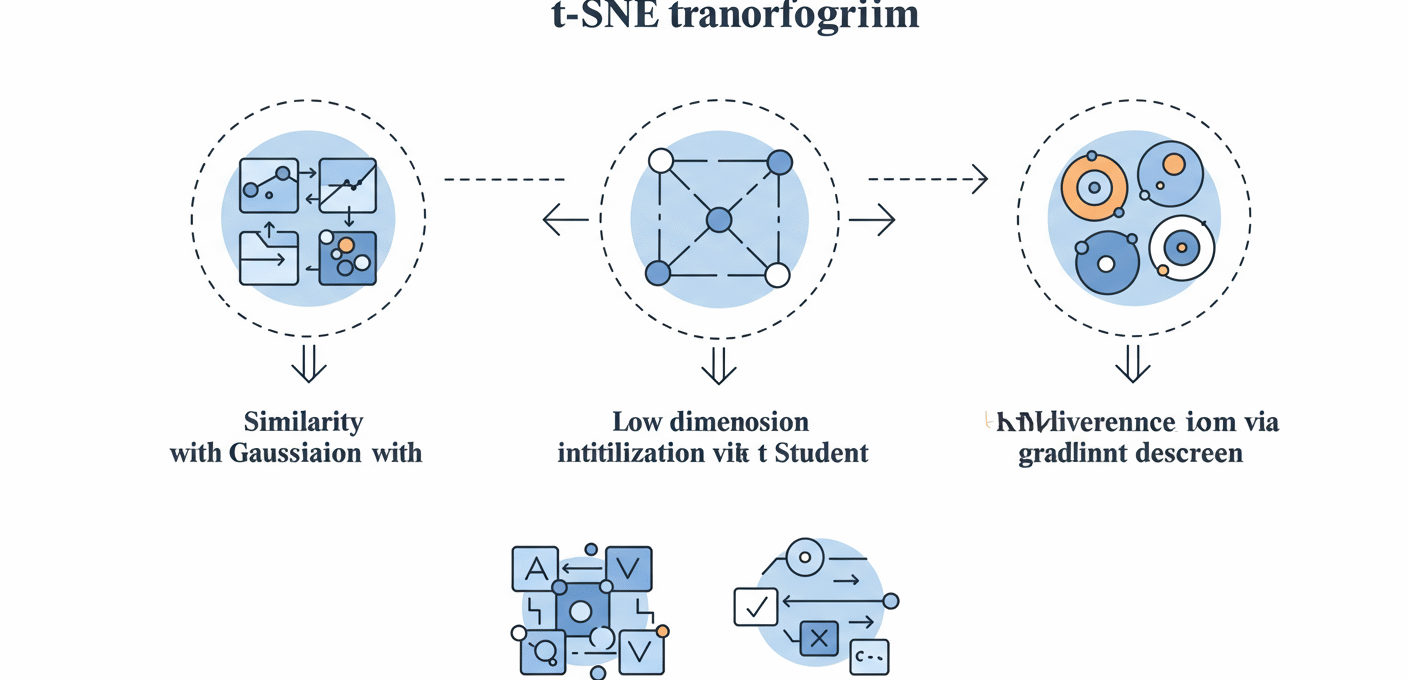

Schritt 1: Ähnlichkeiten im hochdimensionalen Raum berechnen

Im ersten Schritt des t-SNE-Algorithmus werden die Ähnlichkeiten zwischen Datenpunkten im ursprünglichen hochdimensionalen Raum modelliert. Für jeden Punkt ( x_i ) wird eine Gaußsche Verteilung zentriert, und die Wahrscheinlichkeit ( p_{j|i} ), dass Punkt ( x_j ) ein Nachbar von ( x_i ) ist, wird berechnet. Die Formel lautet ( p_{j|i} = frac{exp(-||x_i – x_j||^2 / 2sigma_i^2)}{sum_{k neq i} exp(-||x_i – x_k||^2 / 2sigma_i^2)} ), wobei ( sigma_i ) durch die Perplexität bestimmt wird. Die Perplexität, ein hyperparametrischer Wert, simuliert die effektive Anzahl der Nachbarn und wird typischerweise logarithmisch angepasst, um die Varianz zu kontrollieren.

Diese probabilistische Modellierung wandelt Euklidische Distanzen in Symmetrien um, symmetrisch zu ( p_{ij} = frac{p_{j|i} + p_{i|j}}{2N} ). Der Vorteil: Es erfasst lokale Dichten besser als reine Distanzen. In der Implementierung mit scikit-learn können wir dies direkt anwenden, um die Ähnlichkeitsmatrix zu generieren.

# Import der notwendigen Bibliotheken

import numpy as np

from sklearn.manifold import TSNE

from sklearn.datasets import load_digits

import matplotlib.pyplot as plt

# Laden des MNIST-ähnlichen Datensatzes (Digits)

digits = load_digits()

X = digits.data # Hochdimensionale Daten (8x8 Pixel = 64 Dimensionen)

# Initialisierung von t-SNE mit Perplexität 30

tsne = TSNE(n_components=2, perplexity=30, random_state=42)

# Fit und Transform (intern berechnet Ähnlichkeiten im hohen Raum)

X_tsne = tsne.fit_transform(X)

# Visualisierung

plt.scatter(X_tsne[:, 0], X_tsne[:, 1], c=digits.target, cmap='tab10')

plt.title('t-SNE Visualisierung des Digits-Datensatzes')

plt.show()Dieses Codebeispiel demonstriert, wie scikit-learn die Ähnlichkeiten intern handhabt. Der Parameter perplexity=30 balanciert lokale und globale Strukturen; experimentieren Sie mit Werten wie 5 für kleine Datensätze oder 50 für größere, um die Sensitivität zu sehen.

Schritt 2: Niedrigdimensionalen Raum initialisieren und Ähnlichkeiten modellieren

Im zweiten Schritt initialisiert t-SNE die Punkte ( y_i ) zufällig im niedrigdimensionalen Raum (z. B. 2D). Ähnlichkeiten werden dann mit einer t-Student-Verteilung berechnet: ( q_{ij} = frac{(1 + ||y_i – y_j||^2)^{-1}}{sum_{k neq l} (1 + ||y_k – y_l||^2)^{-1}} ). Die t-Verteilung mit einem Grad der Freiheit verhindert das „Crowding Problem“, bei dem ferne Punkte zu nah gerückt werden, im Gegensatz zur Gauß-Verteilung im hohen Raum.

Diese Asymmetrie zwischen Gauß (hochdim.) und t-Student (niedrigdim.) sorgt für eine robuste Erhaltung lokaler Strukturen. In der Praxis führt dies zu iterativen Anpassungen, die in Bibliotheken wie scikit-learn durch Barnes-Hut-Approximation beschleunigt werden, um die Komplexität von O(n²) auf O(n log n) zu reduzieren.

„t-SNE erfasst die Essenz lokaler Geometrien in Daten, wo lineare Methoden scheitern.“

Schritt 3: Minimierung der Divergenz durch Gradientenabstieg

Der abschließende Schritt minimiert die Kullback-Leibler-Divergenz (KL-Divergenz) zwischen den Verteilungen P (hochdim.) und Q (niedrigdim.): ( C = sum_i KL(P_i || Q_i) = sum_i sum_j p_{ij} log frac{p_{ij}}{q_{ij}} ). Durch Gradientenabstieg werden die Positionen ( y_i ) angepasst, bis die Divergenz konvergiert. Der Gradient ist ( frac{partial C}{partial y_i} = 4 sum_j (p_{ij} – q_{ij}) (y_i – y_j) (1 + ||y_i – y_j||^2)^{-1} ), was eine repulsive Kraft für unähnliche Punkte und attractive für ähnliche erzeugt.

Typischerweise laufen 1000 Iterationen mit Lernraten von 200-1000, wobei frühe Iterationen große Sprünge erlauben und spätere feinjustieren. Erweitern Sie das obige Codebeispiel, indem Sie n_iter=1000 setzen, um die Konvergenz zu beobachten – die KL-Werte sinken stetig.

t-SNE in der Praxis anwenden

Zusammenfassend ermöglicht der t-SNE-Algorithmus eine nuancierte Visualisierung von Datenclustern, die über PCA hinausgeht und lokale Muster enthüllt. Durch die drei Schritte – Ähnlichkeitsberechnung, Initialisierung und Optimierung – wird eine intuitive Erkundung hochdimensionaler Daten ermöglicht.

Experimentieren Sie mit t-SNE in Ihren Projekten, teilen Sie Ihre Erfahrungen in den Kommentaren und erkunden Sie verwandte Themen wie UMAP für schnellere Alternativen. Für tiefergehende Schulungen in Dimensionsreduktion und Data Science empfehlen wir zertifizierte Kurse, die praktische Anwendungen abdecken.

Häufige Fragen zum t-SNE-Algorithmus

Was ist die optimale Perplexität für t-SNE? Die Perplexität sollte 3 bis 50 betragen, abhängig von der Datensatzgröße. Für kleine Sets (unter 100 Punkte) wählen Sie niedrige Werte, um Überfokussierung zu vermeiden.

Ist t-SNE für Clustering geeignet? t-SNE ist primär für Visualisierung gedacht, nicht für Clustering. Es kann jedoch als Preprocessing für Algorithmen wie K-Means dienen, indem es Strukturen aufdeckt.

Wie verbessere ich die Reproduzierbarkeit von t-SNE? Setzen Sie random_state in scikit-learn und kombinieren Sie mit PCA-Vorverarbeitung, um konsistente Ergebnisse zu erzielen.

Unterscheidet sich t-SNE bei großen Datensätzen? Ja, für über 10.000 Punkte nutzen Sie Approximationen wie BH-SNE; andernfalls subsample Sie den Datensatz.

Ich trau mich ja kaum zu fragen, aber wenn hier von „Dimensionen“ die Rede ist – sind das eigentlich so etwas wie verschiedene Eigenschaften oder Merkmale von Daten, die man dann reduziert?

Das ist eine sehr gute Frage, die den Kern des Themas trifft. Wenn wir von Dimensionen sprechen, meinen wir tatsächlich die verschiedenen Eigenschaften oder Merkmale, die ein Datensatz besitzt. Stellen Sie sich vor, Sie haben Informationen über Häuser. Die Anzahl der Zimmer, die Quadratmeterzahl, der Baujahr oder die Lage wären alles einzelne Dimensionen. Bei der Dimensionsreduktion geht es dann darum, diese Vielzahl an Merkmalen so zu vereinfachen, dass die wichtigsten Informationen erhalten bleiben, aber der Datensatz übersichtlicher wird.

Vielen Dank für Ihren aufmerksamen Kommentar. Ich hoffe, das klärt die Sache etwas. Schauen Sie sich auch andere Artikel in meinem Profil oder meine weiteren Veröffentlichungen an, vielleicht finden Sie dort weitere interessante Themen.

Der Artikel beschreibt t-SNE sehr überzeugend für Entwickler und Datenwissenschaftler! Ich frage mich aber, wie praktikabel diese leistungsstarke Methode für den ‚Durchschnittsnutzer‘ ist, der vielleicht keine tiefen Programmierkenntnisse hat oder nicht täglich mit riesigen Datensätzen arbeitet. Ist die Technologie auch mit älterer Hardware oder Software kompatibel, oder erfordert sie zwingend aktuelle, ressourcenintensive Umgebungen? Und wie hoch ist die Einarbeitungshürde für den täglichen Gebrauch, wenn man nicht ständig im Machine Learning Kontext unterwegs ist – die Optimierung von Parametern wie ‚Perplexität‘ klingt für Ungeübte nach einer echten Herausforderung. Wäre es denkbar, dass es vereinfachte Schnittstellen oder ‚light‘-Versionen gibt, die den Zugang für ein breiteres Publikum erleichtern, oder gibt es Empfehlungen für Mindestanforderungen an die Hardware, um Enttäuschungen zu vermeiden? Ein paar bodenständige Tipps zur Zugänglichkeit wären super!

Es freut mich sehr, dass der artikel für entwickler und datenwissenschaftler überzeugend war. ihre fragen zur praktikabilität von t-sne für den durchschnittsnutzer sind absolut berechtigt und adressieren einen wichtigen punkt. tatsächlich erfordert t-sne, insbesondere bei großen datensätzen, eine gewisse rechenleistung und das verständnis der parameter wie perplexität ist für neulinge oft eine hürde. es gibt jedoch bestrebungen, diese methoden zugänglicher zu machen, beispielsweise durch grafische benutzeroberflächen in bestimmten datenanalyse-tools, die eine visuelle exploration ohne tiefgreifende programmierkenntnisse ermöglichen.

für den durchschnittsnutzer, der nicht täglich mit machine learning arbeitet, empfehle ich, mit kleineren datensätzen zu experimentieren und sich zunächst auf die interpretation der visualisierungen zu konzentrieren, anstatt sich sofort in die parameteroptimierung zu vertiefen. was die hardware betrifft, so ist es wahr, dass t-sne ressourcenintensiv sein kann, aber für kleinere datensätze (<10.000 punkte) ist es oft auch auf älterer hardware mit ausreichend ram machbar. es gibt noch keine weit verbreiteten "light"-version